AI新手教程13:Codex APP——终端和IDE的中间地带

上一篇我们学会了MCP,让AI从”只能说”变成了”能动手做”。文末提到OpenAI新推出了一个Codex桌面App,今天就来聊聊它。

之前我们一直在终端里用Codex CLI,虽然功能强大,但纯文字界面对新手确实不太友好。而像Cursor、VS Code这类IDE,功能又太多,打开满屏的代码面板,反而让人不知道该看哪里。

Codex APP就是终端和IDE之间的”中间地带”。 比终端多了可视化,比IDE少了那些看不懂的代码细节。

什么是Codex APP?

一句话解释:Codex APP = Codex CLI的图形界面版。

还是同一个Codex,只是换了一层”壳”。CLI是在终端里打字交互,APP是在桌面窗口里点击操作。底层能力完全一样,配置文件也共用同一个 ~/.codex/config.toml。

目前的限制:

-

• 仅支持 macOS(Apple Silicon芯片),也就是M1及以上的Mac -

• Windows和Linux版本还在开发中

下载方式: 去OpenAI官网下载DMG安装包,直接安装即可。

登录方式:

|

|

|

|---|---|

| ChatGPT账户登录 |

|

| API Key登录 |

|

界面功能介绍

Codex APP目前没有中文界面,所以这里把每个功能都翻译一下,方便你找到对应的按钮。

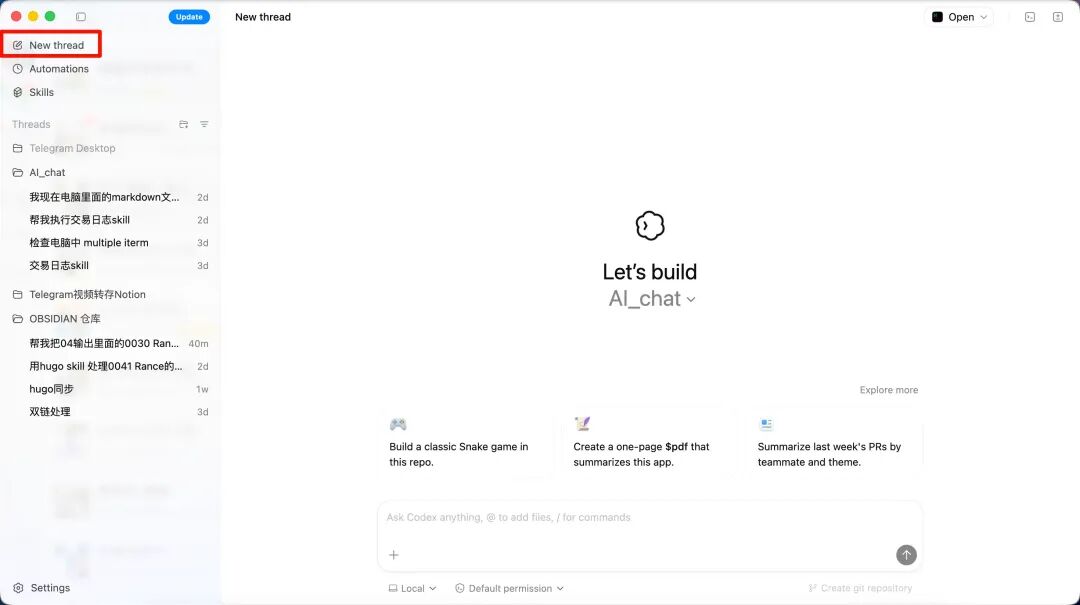

New Thread(新对话)

创建一个新的AI任务对话。创建时可以选择三种模式:

-

• Local(本地模式):直接在你的项目文件夹里工作 -

• Worktree(工作树模式):在Git工作树中隔离工作,不影响主分支 -

• Cloud(云端模式):在远程云端环境执行,需要ChatGPT账户登录

新手建议先用Local模式,最简单直接。

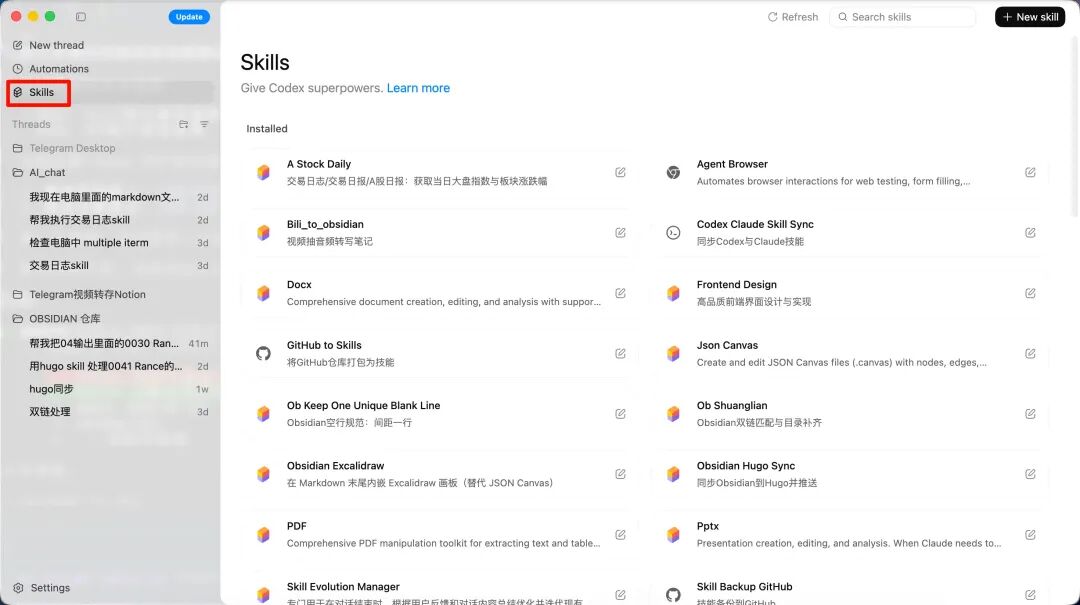

Skills(技能)

和我们之前介绍的Skill系统完全一样。这里可以查看和管理所有可用的Skill,也可以在对话中通过 /skill-name 来调用。

APP和CLI的Skill是共享的,你在CLI创建的Skill,APP里也能直接用。

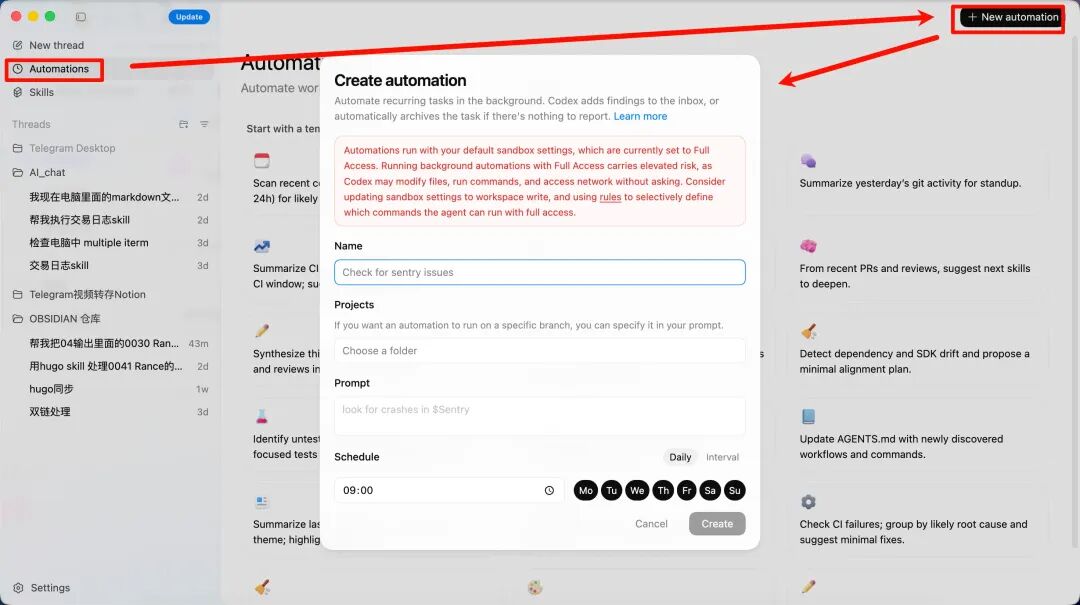

Automations(自动化任务)

这是APP独有的功能,CLI里找不到。

通俗理解:相当于给AI设了个闹钟。

你告诉AI:”每天早上9点帮我做一件事”,它就会按时执行,结果放进你的收件箱等你审核。

工作方式:

-

1. 设定执行频率(比如每天、每周) -

2. 写好指令(告诉AI要做什么) -

3. 可选绑定一个Skill(用 $skill-name语法) -

4. AI按时执行,结果进入审核队列

常见用途举例:

-

• 每日扫描最近的提交,检查有没有bug -

• 每周生成一份代码变更报告 -

• 定期检查依赖包是否有安全漏洞 -

• CI失败时自动总结失败原因

注意: Automations在本地运行,需要APP保持开启状态。对于Git项目,每次自动化任务会在独立的工作树中运行,不会干扰你正在做的事情。

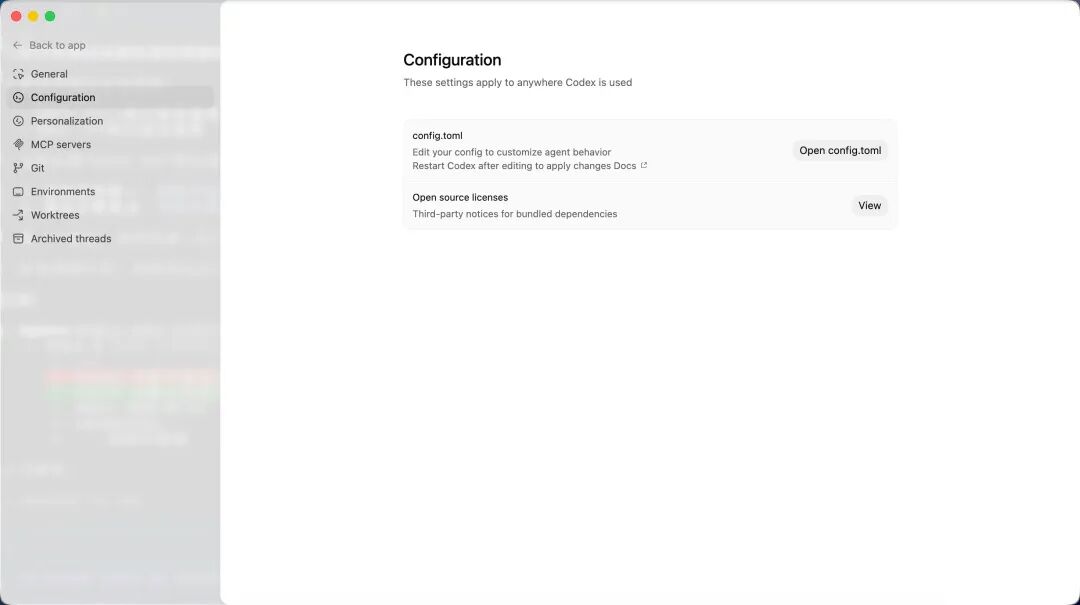

Configuration(配置)

这里可以设置:

-

• 模型选择:ChatGPT账户用户可以直接在界面切换模型 -

• 审批策略:控制AI能自动做多少事,哪些需要你手动确认 -

• 沙箱设置:限制AI的权限范围(只读/工作区写入/完全访问)

这些设置和CLI共用同一个 config.toml,改了一边另一边也会生效。

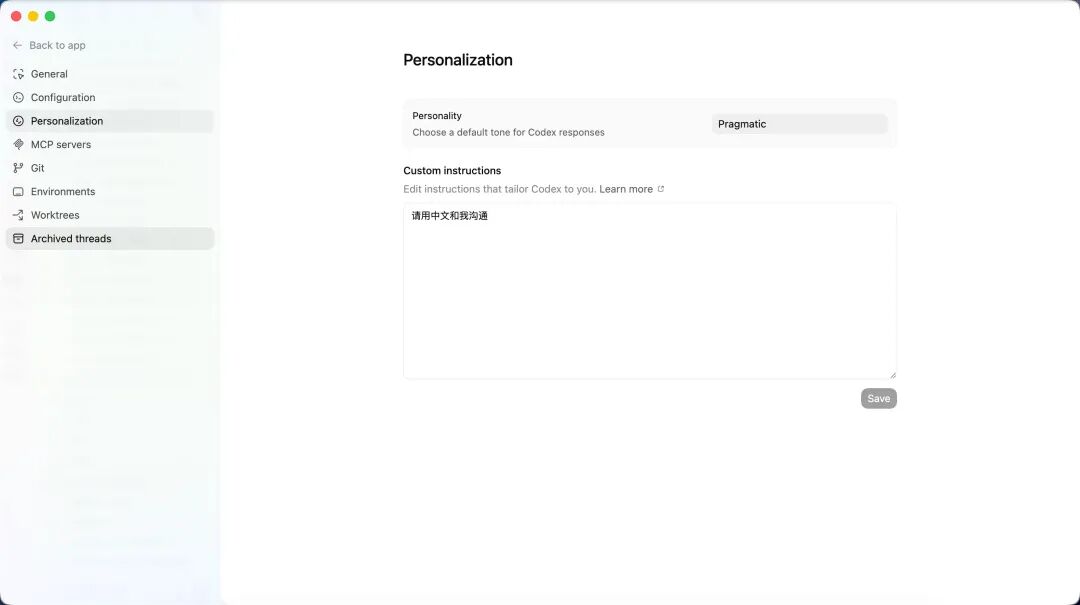

Personalization(个性化)

可以选择AI的”性格”:

|

|

|

|

|---|---|---|

|

|

|

|

|

|

|

|

|

|

|

|

还可以添加自定义指令,比如”用中文回复”、”代码注释用英文”等。这些指令会写入你的 AGENTS.md 文件。

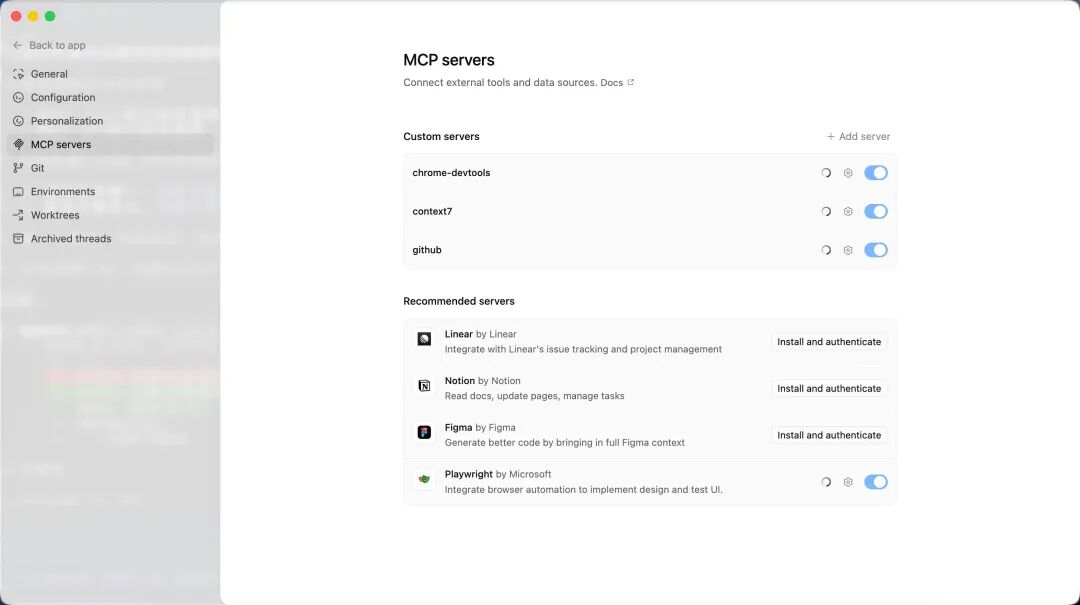

MCP Servers(MCP服务器)

和上一篇讲的MCP配置完全一样。APP、CLI、IDE插件三者共享MCP配置,你在CLI里配好的MCP服务器,APP里自动就能用。

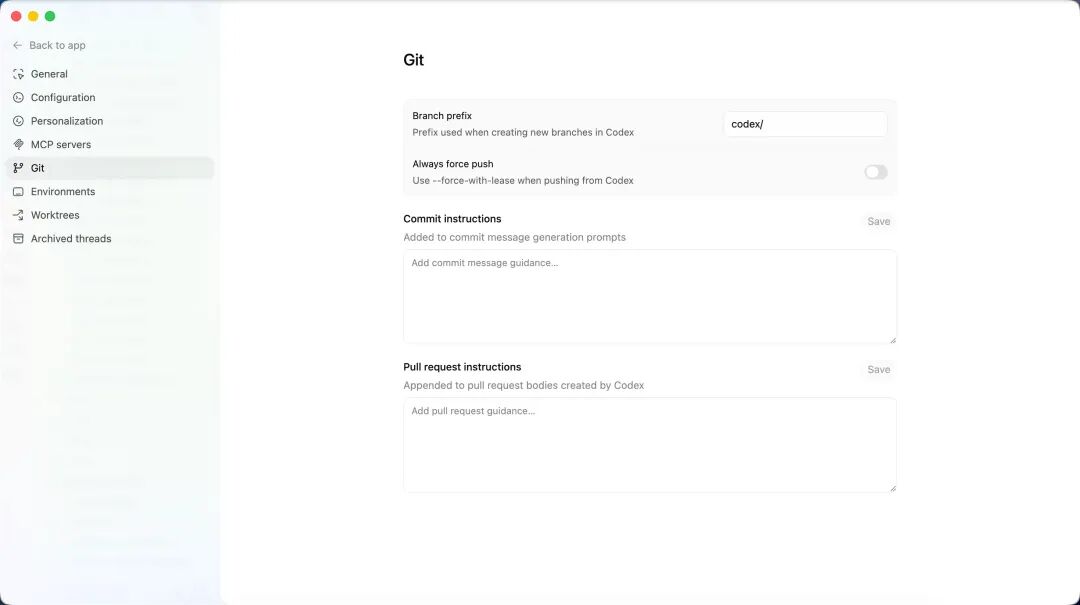

Git(Git集成)

这是APP相比CLI的一大亮点。内置了可视化的Git工具:

-

• Diff查看:图形化显示代码变更,可以在行内添加评论 -

• 暂存/撤销:选择性暂存某些代码块或整个文件 -

• 提交/推送:直接在APP内完成commit和push -

• 创建PR:一键创建Pull Request

在CLI里这些都要靠命令行操作,APP里点点鼠标就行了。当然这里的概念估计你们都还不懂,之后我们会介绍

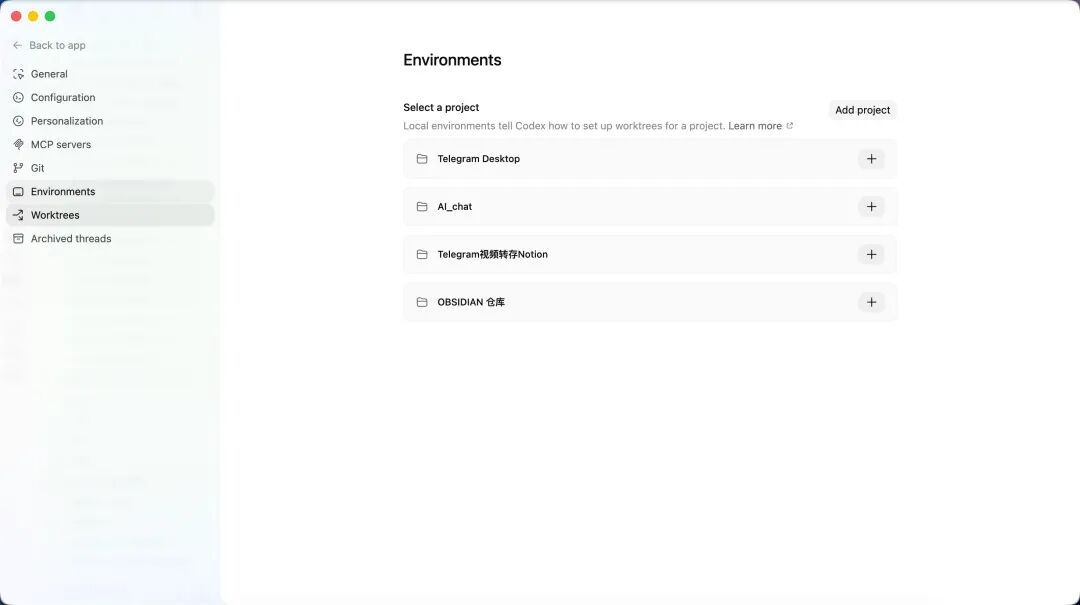

Environments(环境)

配置代码的执行环境。可以设置本地环境或云端环境,安装项目依赖等。

Worktrees(工作树)

Git Worktree的可视化管理。简单说就是让你的多个AI任务互不干扰。

比如你同时让AI做三件事:修bug、写新功能、重构代码。如果都在同一个目录下操作,文件改来改去肯定会冲突。Worktree就是给每个任务创建一个独立的工作副本,各干各的,互不影响。

Threads vs Projects——理解上下文

这是整篇文章最重要的部分,请认真看。

两个核心概念

Project(项目)= 你的代码仓库或文件夹。

类比一下:一个Project就像你的工作台。你在这个工作台上做所有和这个项目相关的事。

Thread(对话)= 项目中的一个具体任务。

类比一下:每个Thread就像工作台上的一张任务卡。修bug是一张卡,写文档是另一张卡。

一个Project可以有很多个Thread,但每个Thread只属于一个Project。

为什么这很重要?

这里要引入一个关键概念:上下文(Context)。

什么是上下文?

想象你和朋友微信聊天。你说”那个事情怎么样了?”,朋友知道你说的是哪件事——因为你们前面聊过。这个”前面聊过的内容”,就是上下文。

AI也是一样。你在对话中说过的每一句话、发过的每一个文件,AI都会记住,用来理解你后续的问题。这些AI”记住”的内容,就是AI的上下文。

上下文窗口 = AI的记忆容量

但AI的记忆不是无限的。它能记住的内容有个上限,叫”上下文窗口”。

目前Codex默认使用的模型是GPT-5.3-Codex,它的上下文窗口大约是40万token。你可以简单理解为大约能记住30万字左右的对话内容。

听起来很多,但如果你什么任务都在同一个对话里做,很快就会被塞满。

Thread隔离的好处

不同Thread的对话是隔离的,互不干扰。

打个比方:你同时做3个任务,如果所有对话都写在同一张纸上,修bug的内容、写文档的内容、讨论需求的内容全混在一起——你自己看着都头大,AI也会被搞混。

分成3个Thread就清晰了:

-

• Thread 1:专门修bug,AI只记得和bug相关的对话 -

• Thread 2:专门写文档,AI只记得和文档相关的对话 -

• Thread 3:专门讨论需求,AI只记得和需求相关的对话

这对于知识库类的项目特别重要。 比如你用Obsidian管理笔记,一个Thread查资料,另一个Thread整理文档,互不污染。不会出现你在整理文档的时候,AI突然把查资料时的上下文混进来。

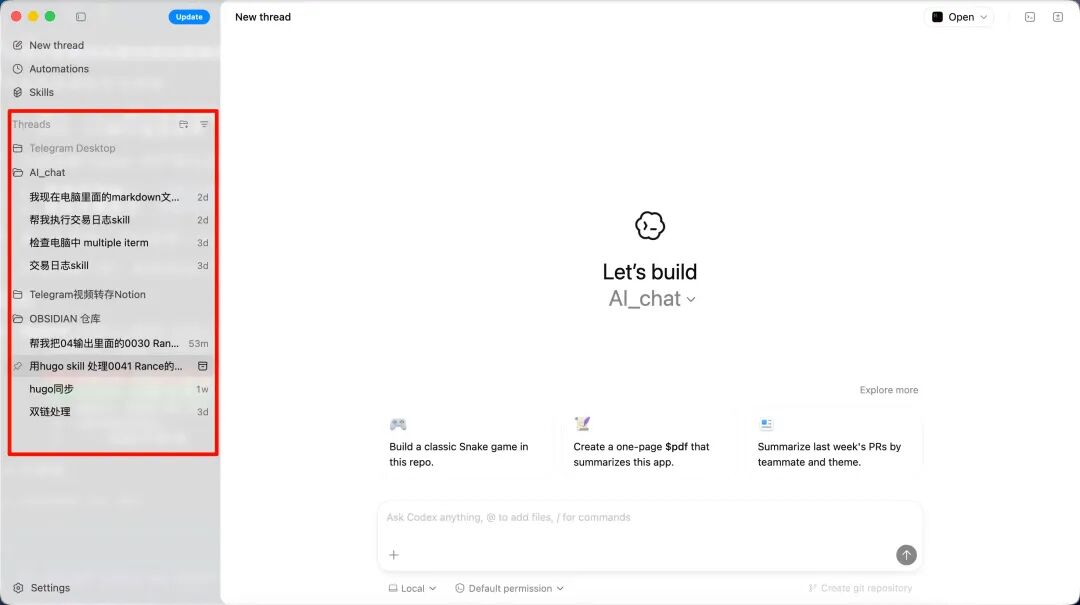

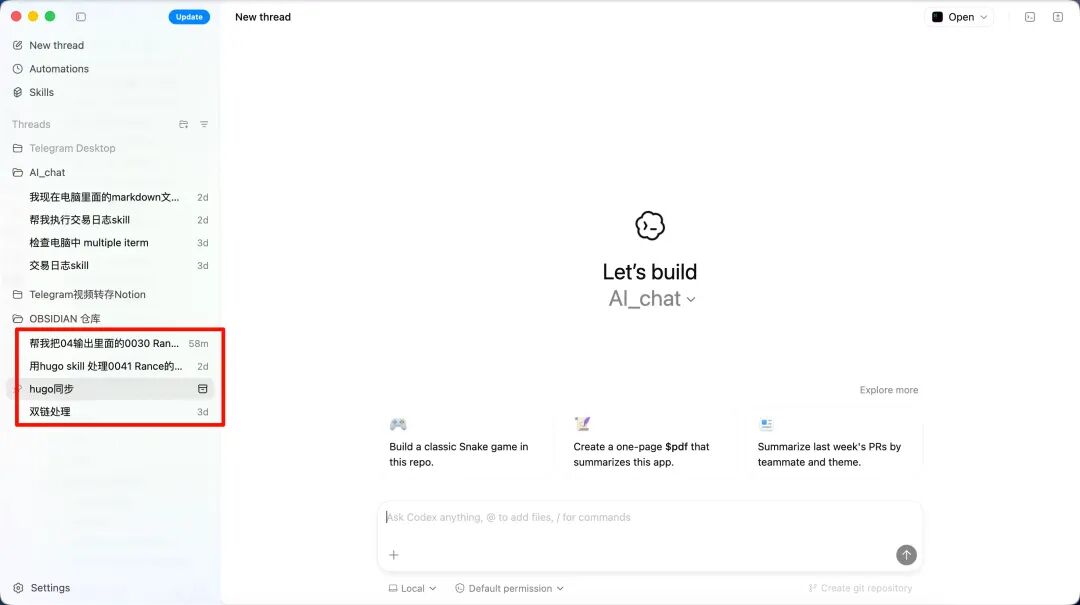

就比如我下面截图的Obsidian笔记,虽然是在同一个仓库,但是根据任务不同我有不同的thread,你也可以把这里理解为网页版GPT的对话概念

Codex APP vs Codex CLI

既然两者底层一样,选哪个好?来做个对比:

|

|

|

|

|---|---|---|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

最大的几个区别

1. 对话可视化——不用再Resume找对话了

用CLI的时候,想回看之前的对话,需要用 codex --resume 来找。对话多了以后,找起来挺麻烦。

APP里直接有一个对话列表,所有Thread一目了然,点一下就能切换。光这一点,对于经常多任务并行的人来说就值了。

2. Automations定时任务——APP独有

这个功能CLI没有。想在CLI里实现类似效果,你得自己用系统的cron或者其他定时工具来搞,门槛不低。APP里直接设置就行,方便得多。

3. 模型切换更方便

用ChatGPT付费账户登录的话,可以直接在APP界面切换模型,不需要改配置文件。

如果你和我一样是用API Key的: APP和CLI共用同一个 ~/.codex/config.toml,在toml里指定模型就行,APP会自动读取。比如:

model = "GPT-5.3-Codex"4. 定位:终端和IDE的中间地带

对比终端,APP多了可视化的对话管理、Git操作、定时任务。

对比IDE(如Cursor),APP省略了满屏的代码面板和复杂的编辑器功能,专注在AI对话和项目管理上。

如果你觉得终端太极客、IDE太复杂,APP可能就是你要找的那个”刚刚好”。

个人体验

说句大实话:我个人还是更喜欢用终端。

不知道是不是我的错觉,总感觉APP的响应速度比CLI慢一点。可能是图形界面的渲染开销,也可能纯粹是心理作用,我不确定。

但我必须承认,APP对新手确实更友好。 特别是对话管理和Git操作这两块,可视化的体验比在终端里敲命令舒服太多了。

建议:两个都试试,找到适合自己的工具就行。 反正配置是共享的,切换起来也没什么成本。

总结

今天学到了什么:

-

1. Codex APP是什么:Codex CLI的图形界面版,目前仅支持macOS Apple Silicon -

2. 核心功能:Threads对话管理、Automations定时任务、Git可视化集成、Worktree工作树隔离 -

3. Threads vs Projects:Project是工作台,Thread是任务卡——任务隔离,保护上下文不被污染 -

4. vs CLI的区别:对话可视化 + Automations定时任务是最大优势,但速度体感可能稍慢 -

5. 定位:终端和IDE之间的中间选择,适合想要可视化但不需要完整IDE的用户

核心要点:

-

• Codex APP和CLI底层完全一样,配置共享,选哪个都不亏 -

• Thread隔离是关键——不同任务分开对话,防止上下文污染 -

• Automations是APP独有的杀手功能,相当于给AI设闹钟

下期预告

下一篇我们聊一个可能颠覆你认知的话题:为什么你不需要学N8N了,因为可以用Skill替代

N8N是一个很火的低代码自动化平台,很多人花了大量时间学习它。但我发现,Skill可以替代大部分N8N的使用场景,而且:

-

• 学习成本更低 -

• 和AI工具原生集成,不需要额外平台 -

• 更灵活,改起来更方便

到底是怎么回事?下期详细聊。

敬请期待!

如果觉得有帮助,记得关注这个系列!

夜雨聆风

夜雨聆风