OpenClaw调研文档

云原生基础软件、AI Infra 创新领导者

博云

www.bocloud.com.cn

摘要

本调研文档围绕 GitHub 上爆火的开源个人 AI Agent 框架 OpenClaw 展开全面分析,介绍了其曾用名、核心定位与传统 Chatbot 的差异化特点,详细复盘了 Windows + WSL 环境下该框架的安装、初始化流程,重点阐述了对接本地 LM Studio 模型的关键配置步骤,同时梳理了 OpenClaw 依托 “Skills” 实现的信息获取、文件操作等六大核心能力,并结合实际场景列举了其在隐私保护、远程协助、自动化管理等方面的应用方式。调研最终明确,OpenClaw 是 BYOM 趋势下的典型代表,能够基于 Windows + WSL + LM Studio 搭建出免费、数据私有、高扩展性的 AI Agent 系统,为个人私有化智能助理的搭建提供了优质解决方案。

项目介绍

OpenClaw(曾用名 ClawdBot, MoltBot)是一个近期在 GitHub 上爆火的开源个人 AI Agent(智能体)框架。它的核心理念是提供一个运行在用户本地设备上、拥有“双手”的 AI 助手。

与传统的 Chatbot(如网页版 ChatGPT)不同,OpenClaw 的特点在于:

-

本地优先 (Local-First): 核心逻辑运行在你的设备上(Node.js 环境),数据掌握在自己手中。

-

全渠道集成 (Omnichannel): 你不像是在和一个网页对话,而是通过你常用的聊天软件(如 Telegram, WhatsApp, Discord, Slack 等)与它交流。它就像你的微信好友一样存在。

-

持久记忆 (Persistent Memory): 它会自动记录用户的偏好、历史对话和上下文,不会像普通 LLM 那样刷新页面就“失忆”。

-

工具调用能力 (Agentic Capabilities): 它不仅能说话,还能通过“技能(Skills)”执行操作,如浏览网页、读写文件、运行代码、管理日程等。

简而言之: OpenClaw 是一个可以连接任意大模型(包括本地 LM Studio)并集成到你即时通讯软件中的私人全能管家。

安装过程

基于 Windows + WSL (Windows Subsystem for Linux) 的环境,以下是标准的安装路径复盘:

2.1 环境准备

-

启用 WSL: 在 Windows 上通过 PowerShell 运行 wsl –install 安装 Ubuntu 等发行版。

-

环境依赖: OpenClaw 是基于 TypeScript/Node.js 构建的,需要 Node.js 环境(建议 v18+)。

-

在 WSL 中安装 Node.js:

curl -fsSL https://deb.nodesource.com/setup_20.x | sudo -E bash -sudo apt-get install -y nodejs

2.2 安装 OpenClaw

OpenClaw 提供了方便的一键安装脚本,直接在 WSL 终端中执行:

curl -fsSL https://openclaw.ai/install.sh | bash

或者通过 npm 全局安装:

npm install -g openclaw

2.3 初始化

安装完成后,运行引导程序进行初始化:

openclaw onboard

在此过程中,系统会引导用户选择 LLM 提供商(通常默认为 Anthropic 或 OpenAI),在这里可以跳过,我们将在后续步骤手动修改为 LM Studio。

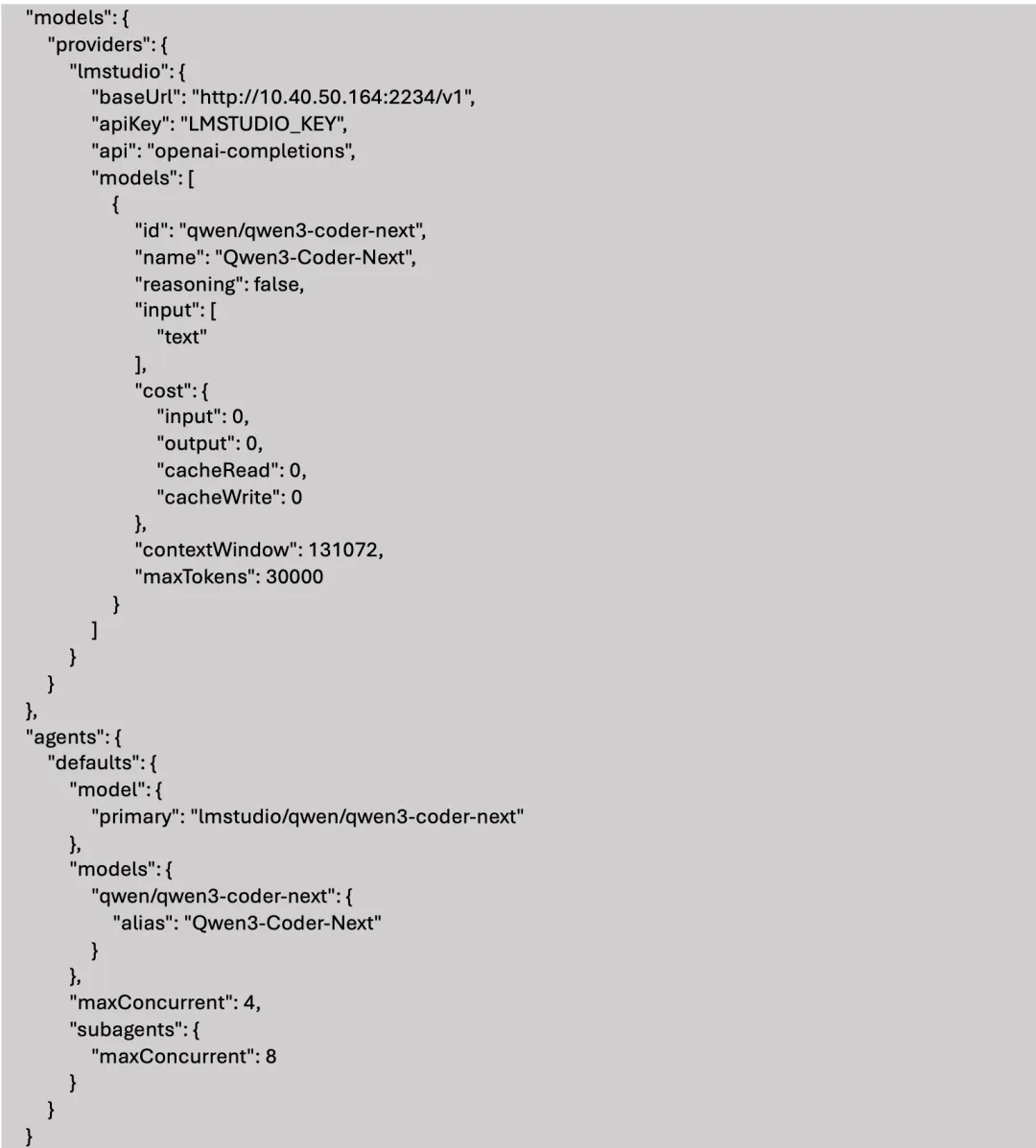

配置本地模型

这是你实践中的关键步骤。为了让 OpenClaw 使用本地的 LM Studio 算力(而不是付费的 API),需要修改配置文件 openclaw.json。

3.1 配置文件位置

在 WSL 环境中,配置文件通常位于:

- ~/.openclaw/openclaw.json

3.2 修改openclaw.json

你需要将模型提供商指向 LM Studio 兼容的 OpenAI 接口。

前提条件:

-

LM Studio 已启动并加载模型。

-

LM Studio 的 Local Server 已开启。

配置示例:

3.2 重启openclaw

openclaw gateway restart

重启完即可使用配置好的本地模型

支持的能力

OpenClaw 的强大之处在于其 Agentic(代理) 能力,它通过 “Skills”(技能)扩展功能:

-

信息获取 (Browsing):

-

支持通过 Puppeteer 或 API 浏览互联网,实时搜索信息(OpenClaw 能够“阅读”网页内容并总结)。

-

文件系统操作 (FileSystem):

-

可以直接读取、写入、修改用户指定目录下的文件(在 WSL 中即为 Linux 文件系统,也可以挂载 Windows 目录 /mnt/c/)。

-

代码执行 (Code Execution):

-

拥有解释器能力,可以编写并运行 Python 或 JavaScript 代码来解决数学问题、处理数据或生成图表。

-

持久化记忆 (Memory):

-

User Profile: 记住你的名字、职业、偏

-

Context: 记住几天前的对话内容,无需重复提供背景信息。

-

主动行为 (Proactivity):

可以设定定时任务(Cron jobs),例如“每天早上8点通过 Telegram 给我发送天气简报”。

-

多模态支持 (Vision):

如果底层连接的模型支持视觉(如 LLaVA 或 GPT-4o),你可以发送图片给它进行分析。

使用场景

结合本地 LM Studio,OpenClaw 可以在隐私完全保护的情况下通过以下场景使用:

-

隐私敏感的个人助理:

- 场景:

你有一些包含个人隐私文档需要整理。 -

操作: 将文档放在 WSL 目录下,让 OpenClaw 读取并总结,通过 Telegram 发送给你。全过程数据不离本地。

-

全天候即时百科/编码助手:

- 场景:

在手机上(通过 Telegram/WhatsApp)直接向家中电脑上的 OpenClaw 提问代码问题。 -

优势: 无论身在何处,只要家中电脑开着,你就有了一个私有的、免费的强力 AI 助手。

-

自动化监控与简报:

-

场景: 让 OpenClaw 每天定时爬取特定的技术博客或新闻站点(使用 Browsing 技能),总结成摘要发送到你的聊天软件中。

-

家庭服务器管家:

- 场景:

由于运行在 WSL/Linux 上,它可以执行 Shell 命令。你可以通过聊天指令让它检查服务器负载、重启某个 Docker 容器(需谨慎配置权限)。

总结

OpenClaw 是目前 “Bring Your Own Model (BYOM)” 趋势下的典型代表。通过 Windows + WSL + LM Studio + OpenClaw 构建了一套完全免费、数据私有、且具备极高扩展性的 AI Agent 系统。

相关阅读

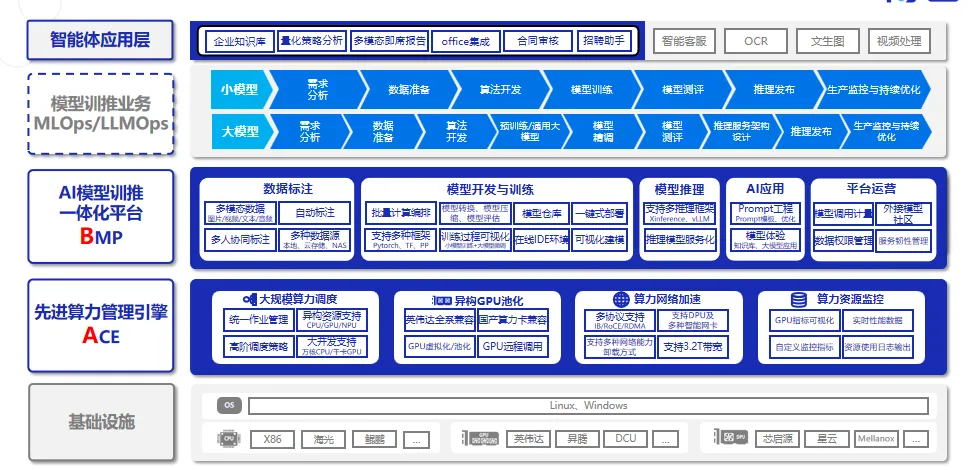

关于博云AIOS

AIOS是博云专为AI应用推出的企业级一站式人工智能操作系统,屏蔽底层异构算力差异,面向AI大模型、生信、仿真渲染、气象、智能控制、图像视频处理等领域的分布式计算提供调度器管理,在网络、存储等基础能力方面增强高性能适配,为AI应用提供稳定、高效、可观测的部署与服务运行时管理能力。

同时AIOS提供轻量化多框架AI训推工具链平台,支持多种分布式AI深度学习框架,模型推理框架,IDE工具,算法、模型仓库,以及模型量化和转化能力,覆盖数据标注、算法开发、模型训练、模型推理的全生命周期。

AIOS可以帮助企业和开发者自主构建人工智能业务,助力企业保持行业领先能力。

夜雨聆风

夜雨聆风