开源低代码智能体工作流平台Sim解析

1 简介

-

Github主页:https://github.com/simstudioai/sim, 26.5K stars -

官网:https://www.sim.ai/

当前构建生产级的智能体工作流往往面临两大挑战:有一定的技术门槛(需掌握LangChain、LlamaIndex等框架)和部署依赖云端(存在数据隐私与成本问题)。在此背景下,Sim应运而生——一个100%开源、支持本地部署、面向智能体工作流的拖拽式低代码平台,旨在成为这款流行的 Fair-Code 工作流自动化工具的开源替代品。

1.1 准确识别n8n的非开源性质

简单来说:n8n的源代码是公开的,但它使用的并非 OSI(Open Source Initiative,开放源代码促进会) approved 的开源许可证,因此严格意义上不属于“开源软件”。

n8n 的授权模式是“Fair-Code”而非“Open Source”:

- 源代码可用,但有严格限制:n8n 的源代码在 GitHub 上是公开的,任何人都可以查看、下载、修改,甚至可以自托管部署。这给了人们一种“开源”的直观感受。

- 许可证是“Sustainable Use License”:n8n 使用的是自己创建的“可持续使用许可证”。这个许可证明确限制了软件的商业使用场景。例如:

-

你不能将 n8n 作为一项服务直接卖给客户(比如白标后提供给他人)。 -

你不能使用用户的凭证来为你的应用提供后端自动化服务。 - 为什么不能叫“开源”?

根据 OSI 的定义,开源许可证不能对软件的特定用户或特定用途施加限制。n8n 的许可证限制了商业用途,因此不符合开源标准。它将这种模式称为 “Fair-Code”(公平代码),即源代码可用,但作者保留对商业使用的控制权。

1.2 Sim的定位:为智能体工作流而生的低代码平台

Sim的目标是“让智能体开发像搭积木一样简单”,其设计围绕三大支柱:

- 100%开源与全本地部署。Sim所有代码托管于GitHub,支持Docker一键启动,无需任何云端依赖。这一特性对于金融、医疗、政务等数据敏感行业至关重要——企业可将智能体完全运行于自有服务器,杜绝数据外泄风险。

- 原生智能体支持。不同于传统自动化工具(如n8n)仅能串联API,Sim将“智能体”作为一等公民。平台内置了智能体模块,支持记忆管理(滑动窗口)、多智能体协作、工具调用等高级特性,开发者只需拖拽即可赋予工作流“思考”能力。

- 本地LLM优先兼容。Sim可无缝对接任何本地部署的大语言模型(如Ollama运行的Llama 3、vLLM托管的Mistral),避免API调用延迟与成本,同时满足离线环境需求。

1.3 特性:模块化、可视化、生态集成

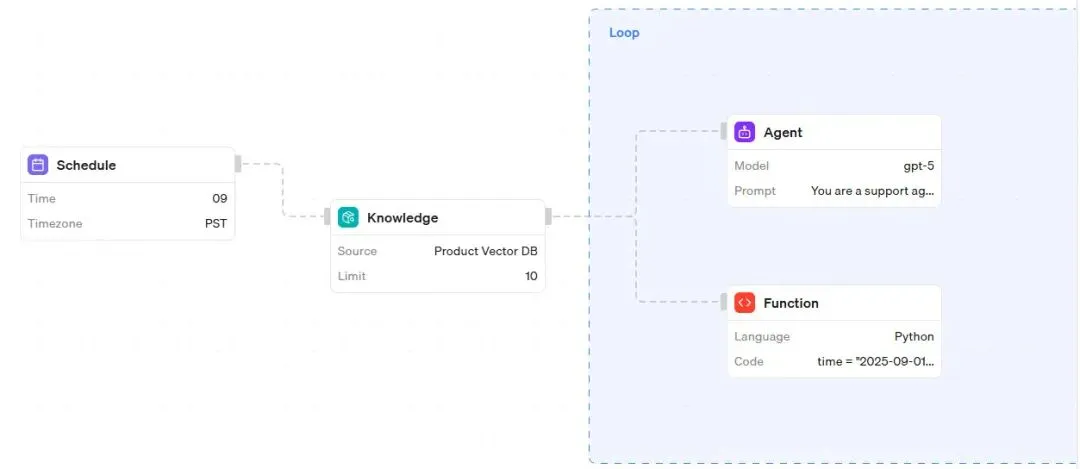

1)可视化“积木式”构建

Sim将所有功能封装为Block(模块),包括输入/输出、LLM调用、工具(如搜索引擎、数据库)、智能体等。用户通过拖拽连接Block,即可定义工作流逻辑,全程无需编写代码,极大降低开发门槛。

2)模块化扩展与MCP生态

Sim采用插件化架构,目前内置138+模块,涵盖常用工具(Firecrawl网页抓取、Alpha Vantage金融数据)和协议(MCP服务器)。MCP(Module Communication Protocol)是Sim的生态核心,允许开发者快速接入第三方API或内部系统,实现“即插即用”的功能扩展。

3)智能体专属能力

- 意图分类器:自动分流用户请求,区分领域(如金融、客服)。

- 记忆管理:通过滑动窗口机制保留对话历史,支持短期与长期记忆。

- 多智能体协作:可编排多个专用Agent(如数据获取Agent、响应生成Agent)协同工作,各司其职。

1.4 采用 Apache-2.0 许可证

这意味着它可以免费用于商业化用途,且没有任何使用限制。

Apache-2.0 属于宽松型许可证(Permissive License),这类许可证的核心特点就是允许自由使用、修改、分发,并且明确允许商业使用,衍生作品可以闭源或商业化。

Apache-2.0 的特点是:

- ✅ 允许商业使用(Commercial use):你可以将基于 Sim 开发的系统、服务或产品直接用于商业目的,向客户收费,无需向原作者支付任何费用

- ✅ 允许闭源分发:如果你基于 Sim 开发了商业产品,可以选择不公开你的修改代码(但需保留原项目的版权声明)

- ✅ 专利授权保护:这是 Apache-2.0 相比 MIT 的一大优势——贡献者自动授予使用者专利许可,避免“用了开源代码还被专利诉讼”的风险

虽然可以免费商用,但 Apache-2.0 要求你在分发产品时保留原作者的署名:

|

|

|

|---|---|

|

|

|

|

|

|

|

|

|

|

|

|

这些要求本质上是让使用者的权利透明化,同时尊重原作者的贡献。

2 竞品对比:Sim vs n8n vs LangFlow vs Dify

| 维度 | Sim | n8n | LangFlow | Dify |

|---|---|---|---|---|

| 核心定位 |

|

|

|

|

| 智能体支持 |

|

|

|

|

| 生态集成 |

|

|

|

|

| 部署方式 |

|

|

|

|

| 适用场景 |

|

|

|

|

| 优势 |

|

|

|

|

| 局限 |

|

|

|

|

2.1 Sim的优势

2.1.1 相比传统自动化平台(n8n)的AI原生优势

n8n在系统集成领域积淀深厚,拥有超过200个应用和API的连接能力,但其核心设计围绕数据流转与任务自动化,缺乏对智能体的原生支持。若需在n8n中构建AI驱动的工作流,开发者必须通过HTTP请求节点调用外部AI服务,并自行管理对话状态、工具调用逻辑和错误处理,开发复杂度陡增。

Sim则将智能体作为一等公民内置:平台提供开箱即用的智能体模块,支持记忆管理(滑动窗口)、多轮对话、工具调用和意图识别等核心能力。开发者只需拖拽智能体节点,配置提示词和可用工具,即可快速构建具备认知能力的自动化流程,无需关注底层状态维护和API集成细节,大幅降低AI原生应用的开发门槛。

2.1.2 相比LLM编排工具(LangFlow)的生产级特性

LangFlow以其直观的可视化界面和快速原型能力受到开发者青睐,尤其适合RAG(检索增强生成)和单智能体场景的快速验证。然而,LangFlow的架构更偏向实验性应用,当需要将原型推向生产环境时,开发者往往面临扩展性挑战:缺乏内置的工作流缓存、错误重试、并发控制等机制,多智能体协作需手动编排且状态管理复杂。

Sim从设计之初即面向企业级落地,内置了完整的生产级特性——工作流缓存可避免重复计算,智能重试机制保障任务可靠性,并发控制支持高吞吐场景,同时提供日志监控和告警能力。这些特性使得Sim构建的应用能够平滑过渡到生产环境,满足企业对稳定性、性能和可维护性的要求。

2.1.3 数据隐私与成本控制

在数据隐私日益敏感的今天,Sim的全本地部署能力成为其核心优势之一。企业可将Sim完全运行于自有服务器或私有云环境,所有用户数据、对话记录和业务逻辑均不出域,满足金融、医疗、政务等行业的合规要求。

同时,Sim原生支持对接本地大语言模型(如通过Ollama部署的Llama 3、Mistral等),无需依赖云端API服务。这不仅彻底消除了网络延迟和数据外泄风险,更大幅降低了调用成本——对于高频交互场景(如企业内部客服、实时数据分析),本地LLM的单次推理成本可降至云端API的十分之一以下,实现性能与成本的双重优化。

2.1.4 相比智能体应用开发平台(Dify)的独特优势

Dify作为功能全面的LLM应用开发平台,在模型集成、应用生命周期管理和可视化编排方面表现优异,但其设计更侧重于单智能体或工作流多节点的串联。Sim则在智能体协作的深度和灵活性上形成差异化:

- 多智能体协作:Sim将多智能体协作作为原生能力,内置意图分类器、任务分发和结果聚合模块,开发者可通过拖拽快速定义多个智能体的角色、职责与协作关系,智能体间可共享记忆并动态调整分工,适用于金融分析、企业OA等复杂业务场景。Dify实现类似功能需通过复杂的工作流节点手动编排,且状态共享机制相对基础。

- 模块化与MCP生态:Sim采用模块化Block设计,所有工具、API和智能体均以独立模块形式存在,通过MCP协议实现即插即用。开发者可用Python/JavaScript快速封装内部系统为自定义模块,无缝接入工作流。Dify的插件系统虽丰富,但新增功能需遵循其插件规范,深度集成外部系统往往依赖官方适配或编写自定义代码。

- 轻量部署:Sim聚焦智能体工作流核心场景,采用轻量化架构,Docker镜像仅数百MB,启动秒级,可轻松运行于树莓派、边缘服务器等资源受限环境。Dify为支撑全生命周期管理,依赖PostgreSQL、Redis、向量数据库等多个组件,部署包较大,对硬件资源要求更高。

- 许可证自由度:Sim采用纯正Apache-2.0许可证,允许自由修改、闭源分发和商业化使用(包括多租户SaaS服务),无任何额外限制。Dify采用“修改版Apache-2.0”,增加了关键限制:未经书面授权不得用于运营多租户环境(条件1a),且使用前端时需保留LOGO和版权信息(条件1b)。这意味着基于Dify构建面向多客户的服务需获取商业许可,而Sim为开发者提供了更彻底的法律自由度。

2.2 选型建议:如何从四者中做出选择?

- 若您需要构建复杂的多智能体协作系统,且数据隐私要求极高:优先考虑Sim。其原生多Agent能力和本地优先架构在此场景下优势明显。

- 若您的核心需求是连接数百个企业应用(如Salesforce、Slack、数据库)并自动化业务流程:n8n仍是无可争议的首选,尽管AI能力需额外开发。

- 若您只是想快速验证一个RAG或Agent原型,用于演示或教学:LangFlow足够轻量,能让您在几分钟内跑通流程。

- 若您希望从原型平滑过渡到生产,且需要一个功能全面、易于维护的AI应用开发平台:Dify的综合体验最佳。它平衡了易用性与生产级需求,尤其适合需要快速交付AI功能的团队。

3 实战案例:分钟级搭建Telegram金融助手

以下通过一个金融辅助场景,直观展示Sim的工作流构建逻辑。

3.1 场景需求

用户通过Telegram咨询股票价格、加密货币行情等金融问题,系统需自动识别意图、获取数据并回复。

3.2 工作流搭建步骤

- 触发节点:选择“Telegram Trigger”模块,配置机器人Token,监听消息。

- 意图分流:拖入“意图分类器”模块,训练少量样本区分“金融”与“非金融”问题。非金融问题直接引导回复。

- 金融智能体:对于金融问题,激活“金融Agent”模块。该Agent内置两种工具:

-

Firecrawl模块:抓取财经网站实时新闻。 -

MCP客户端模块:对接Alpha Vantage API,获取结构化股价数据。 - 响应智能体:将获取的数据交给“响应Agent”模块,生成自然语言回复。

- 输出节点:通过Telegram模块将结果推送给用户。

整个流程从搭建到测试仅需数分钟,充分体现了Sim的低代码效率。

4 快速部署指南(基于Docker)

4.1 前置条件

-

Docker & Docker Compose(版本≥20.10) -

2GB以上内存(推荐4GB+)

4.2 部署步骤

git clone https://github.com/simstudioai/sim.git

cd sim

docker-compose up -d

访问 http://localhost:3000,默认账号 admin@simstudio.ai / password。

4.3 对接本地LLM(以Ollama为例)

-

确保Ollama运行(如 ollama serve)。 -

在Sim平台「Settings → Models」添加Local LLM,填写地址 http://host.docker.internal:11434。 -

测试连接后即可在工作流中使用。

5 多行业扩展方案

5.1 企业办公自动化(OA)智能助手

- 触发:Slack消息、邮件附件

- 处理:文档解析Agent(PDF发票提取)、审批规则Agent(校验合规)、纪要生成Agent(整理会议)

- 输出:推送审批结果、同步待办至Notion、写入财务数据库

5.2 电商客户服务智能体

- 触发:电商平台客服消息

- 处理:意图分类(订单/售后/咨询)、订单查询Agent(调用电商API)、售后处理Agent(自动审核简单申请)

- 输出:智能回复、创建售后工单

5.3 研发协作智能助手

- 触发:GitHub代码提交、Jira需求更新

- 处理:代码检查Agent(SonarQube扫描)、评审提醒Agent(Slack通知)、测试报告Agent(Jenkins对接)

- 输出:报告同步至Confluence、Jira状态更新

5.4 医疗健康咨询(合规场景)

- 触发:加密咨询消息

- 处理:症状分析Agent(本地医疗知识库RAG)、用药提醒Agent(定时推送)

- 输出:加密回复、健康档案本地存储、高危症状提醒就医

6、进阶使用建议与安全考量

6.1 自定义模块开发

若现有模块不满足需求,Sim提供SDK(支持Python/JavaScript)供开发者封装自有逻辑,实现行业专属功能。

6.2 性能优化

-

开启工作流缓存,避免重复计算。 -

合理设置Agent记忆窗口,防止内存溢出。 -

对高频工作流进行分片处理,利用并发。

6.3 安全加固

-

启用HTTPS,配置反向代理。 -

基于RBAC的权限管理,限制敏感操作。 -

定期备份数据库,制定灾备策略。

7 待完善之处

尽管Sim设计理念先进,但作为一个新兴开源项目,仍存在一些值得关注的局限:

- 技术细节披露不足:官方文档尚未详细说明技术栈(如前端框架、后端语言)、并发处理能力、模型量化支持等,开发者评估适配性时需自行探索。

- 生态成熟度有待提升:相比n8n的200+成熟节点,Sim的138个模块多为基础功能,垂直行业模块(如医疗、法律)尚需社区共建。

- 安全性文档缺失:虽强调本地部署,但未提供数据加密传输、模块沙箱隔离等安全实践指南,对金融、政务等敏感领域可能成为采纳障碍。

- 开源社区活跃度:GitHub仓库的贡献者规模、版本更新频率等未明确,影响企业对其长期维护的信心。

展望未来,Sim若能在生态建设、安全合规、行业方案沉淀上持续发力,有望成为智能体低代码开发的事实标准,尤其适合注重隐私与成本的中大型企业。

8 结语

Sim为智能体工作流的平民化开辟了一条新路径:它既保留了低代码平台的易用性,又深度融合了智能体原生能力,同时坚守开源与本地部署的隐私底线。尽管生态尚处早期,但其清晰的定位与开放架构已展现出巨大潜力。对于希望在数据安全前提下快速落地AI智能体的团队,Sim无疑是一个值得密切关注和尝试的选项。

夜雨聆风

夜雨聆风