OpenClaw 部署-操作完整流程文档-文档–俗人六哥团队原创

一、软件介绍

Clawdbot(现已更名为 OpenClaw)是一款开源的自托管个人 AI 助手,它允许用户通过 WhatsApp、Telegram 等常用通讯软件远程控制自己的电脑执行任务。它不仅具备长期记忆,还能通过“插件技能”自主处理回复邮件、管理日程、甚至执行复杂的自动化脚本和代码操作,被誉为拥有“手”的 Claude。

-

官方网站:https://molt.bot -

开源地址:https://github.com/moltbot/moltbot -

案例分享:https://openclaw.ai/showcase -

官方文档:https://docs.openclaw.ai/zh-CN

可以做的事情:

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

优缺点:

|

|

|

|---|---|

|

|

|

|

|

|

|

|

|

|

|

|

二、软件安装

【1】Windows系统

-

开启WSL 2(Linux子系统)

在 Windows 中安装 Clawdbot,官方强烈建议使用 WSL2。Clawdbot 的核心功能和许多“技能”(Skills,如浏览器自动化、Shell 执行等)是在 Linux 环境下开发的。在原生 Windows 环境下,可能会遇到文件权限、路径识别或部分插件无法运行的问题。

使用命令检查电脑是否安装wsl,方式:win+r打开运行窗口,输入cmd回车,在命令行窗口中输入wsl --list --verbose,如下图所示,就是已经安装,并且正在运行。

NAME:列出了已安装的Linux发行版的名称。 STATE:显示了每个发行版的当前状态。在这个例子中,docker-desktop处于Running状态,意味着它正在运行。VERSION:显示了每个发行版的版本号。在这个例子中,docker-desktop的版本是2。

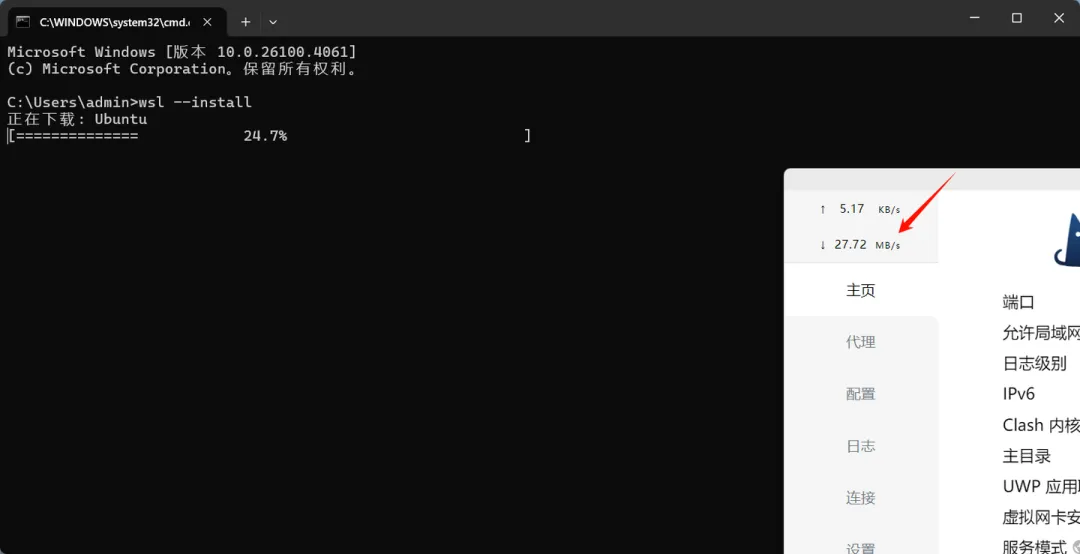

如果显示的不是如上图所示,那么就执行wsl --install来安装wsl,注意安装过程要开启VPN,,如下图所示就是正在下载:

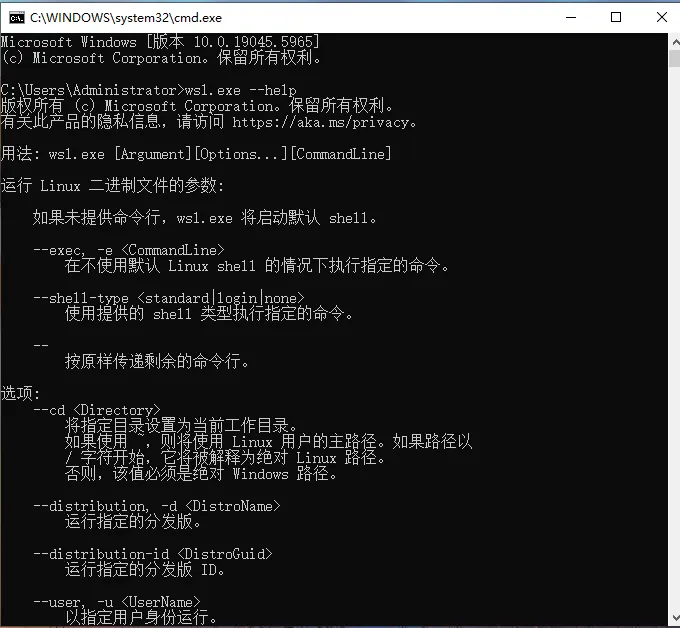

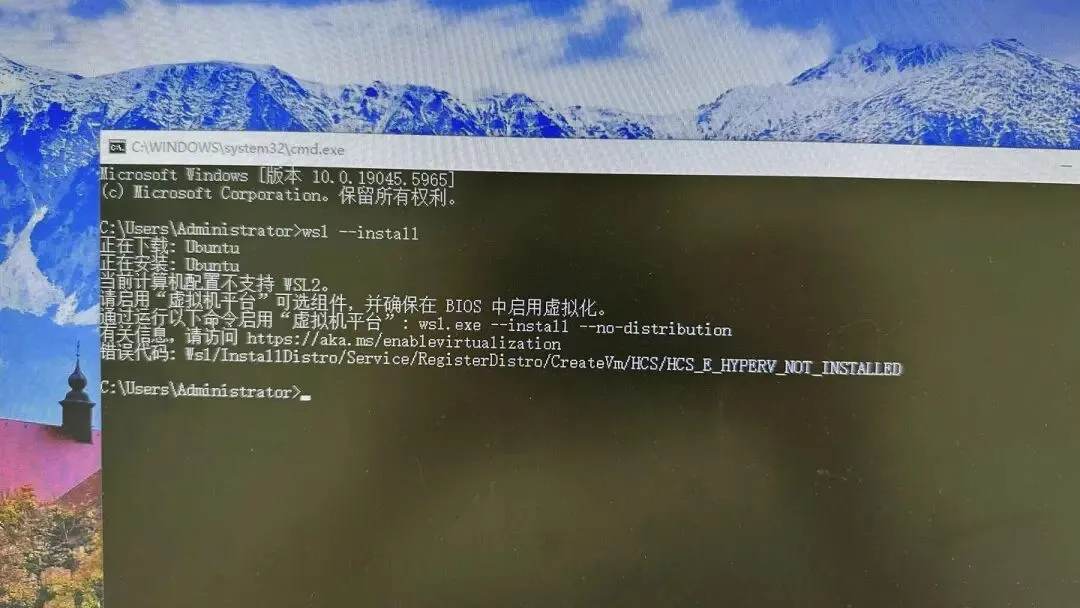

如果执行下载命令没有下载,则应该会出现下面两种情况,分别是左图和右图。下面我会分情况解决。

【1】左图的解决方法:

以管理员身份运行 PowerShell,分别执行以下2个命令来启用 WSL 功能:

dism.exe /online /enable-feature /featurename:Microsoft-Windows-Subsystem-Linux /all /norestart

dism.exe /online /enable-feature /featurename:VirtualMachinePlatform /all /norestart

然后执行以下命令设置 WSL 2 作为默认版本:

wsl --set-default-version 2

完成上述步骤后再回到前面执行下载命令。

【2】右图的解决方法:

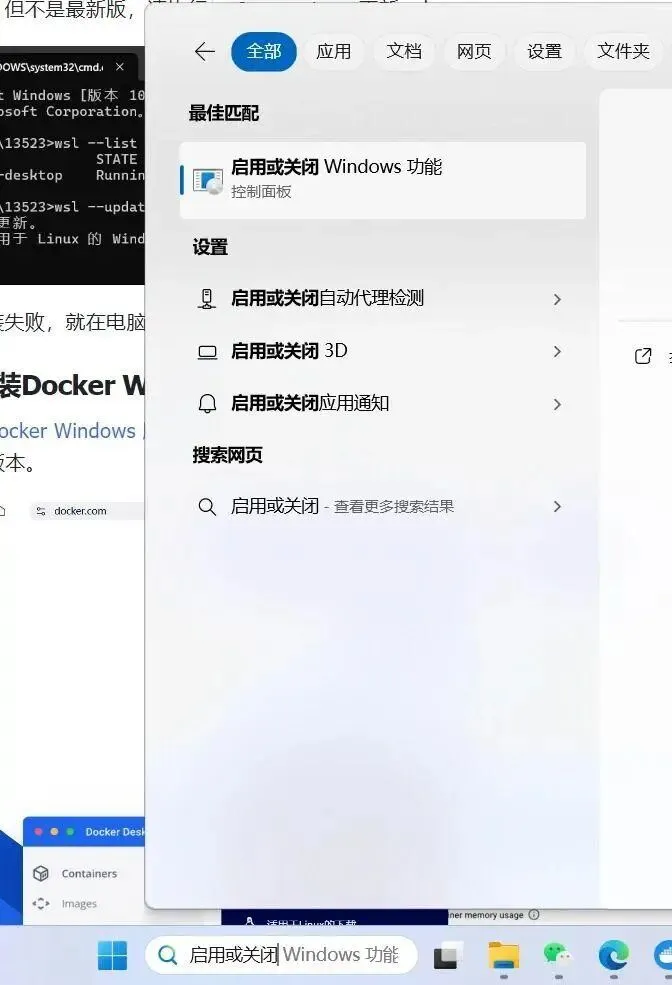

开启虚拟机平台:

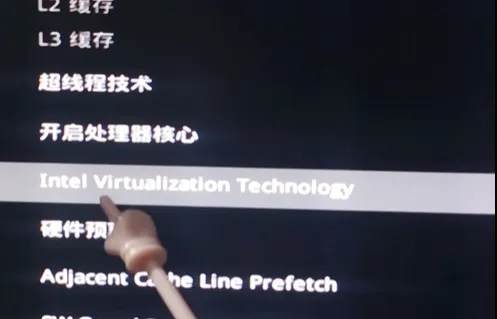

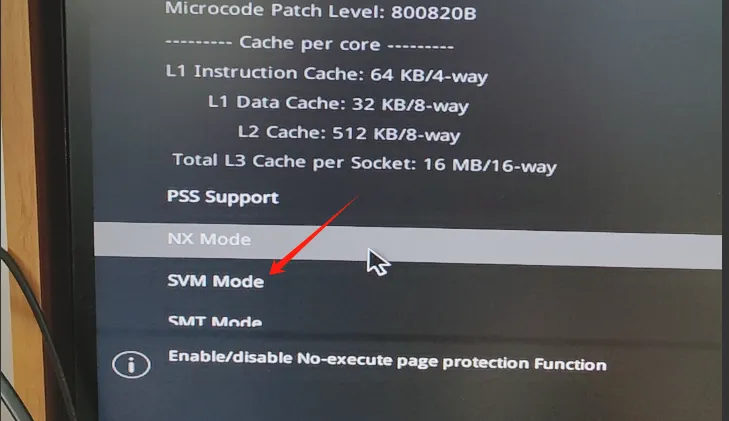

启用CPU虚拟化:

重启电脑,在电脑即将重启的时候按下delete键(也可能是f11或esc)打开主板BIOS,然后找到:高级-cpu设置-虚拟化,开启此选项即可。英特尔处理器和amd处理器开启位置不同。

-

安装Phthon

访问官网:Download Python,点击Or get the standalone installer for Python 3.14.3下载phthon安装包。双击下载的 .exe 文件进行安装,

-

选择安装选项:Install Now:默认安装(推荐新手) -

勾选 “Add Python to PATH”(将 Python 添加到环境变量,这样可以在任何位置使用 Python)

验证安装:

安装完成后,按 Win + R,输入 cmd 打开命令提示符,然后输入以下命令(分次执行),显示版本号即成功。

python --version

-

安装Node.Js

官网下载:https://nodejs.org/zh-cn/,安装LTS 版本(长期支持版):推荐生产环境使用 。双击下载的 .msi 文件直接安装,注意勾选 "Automatically install the necessary tools"(会自动安装 Chocolatey 和必要的构建工具),并且确保 "Add to PATH" 被选中。

验证安装:

安装完成后,按 Win + R,输入 cmd 打开命令提示符,然后输入以下命令(分次执行),显示版本号即成功。

node -v

npm -v

成功之后我们需要 “放行Node.js”,管理员打开PowerShell ,执行以下命令,此时系统会问你是否要更改执行策略,请输入 A (代表“全是”),然后按 回车。

Set-ExecutionPolicy RemoteSigned

-

运行 OpenClaw安装脚本

在Windows电脑上以管理员身份打开终端(win+x→终端管理员),执行以下命令切换到国内加速源:

npm config set registry https://registry.npmmirror.com

注意:这行命令执行后通常不会有任何提示,直接跳出新的一行就是成功了。然后执行以下命令安装OpenClaw:

iwr -useb https://openclaw.ai/install.ps1 | iex

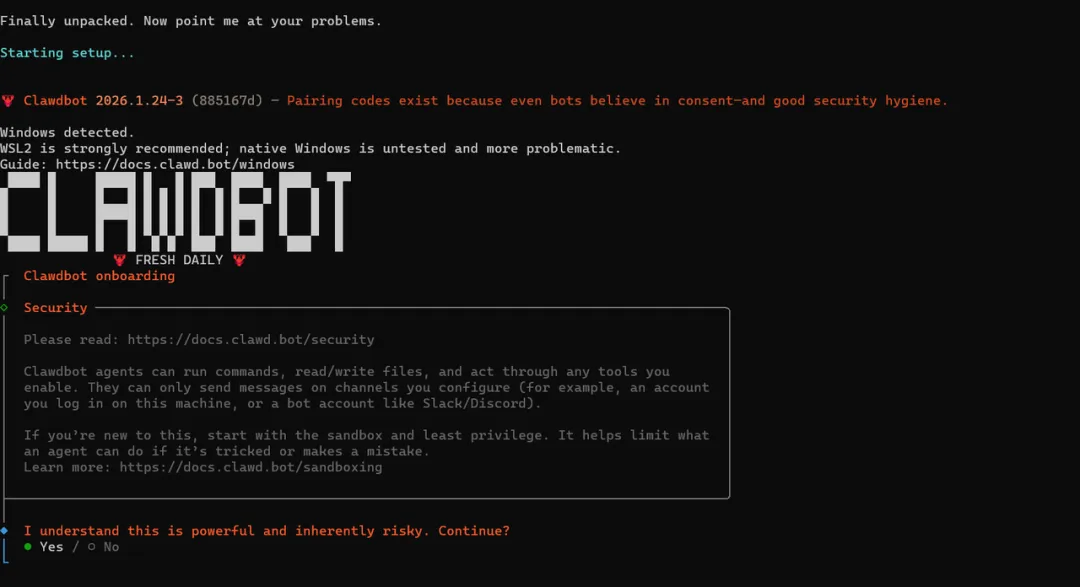

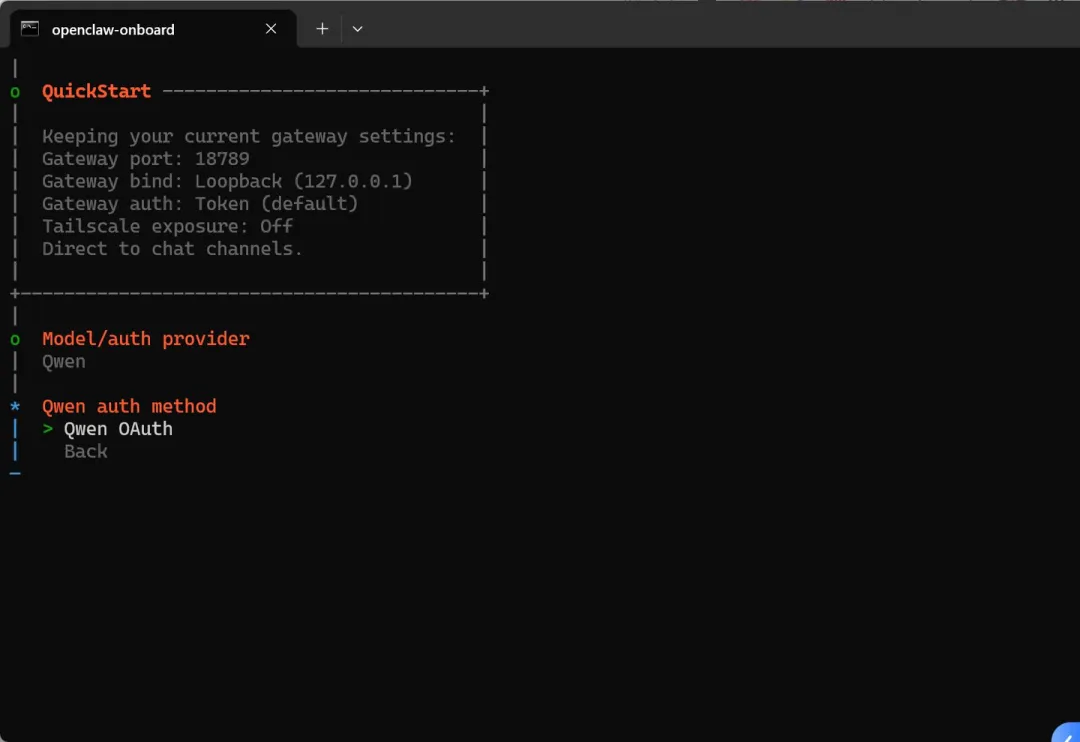

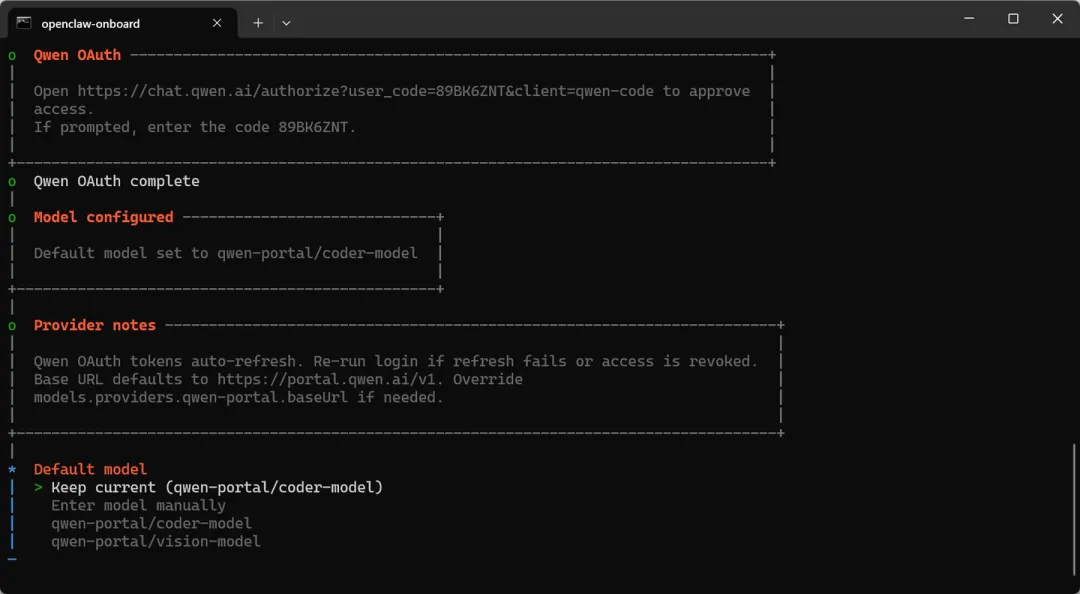

如下图所示就是安装成功,开始进行配置(键盘方向键选择选项,回车键确定):

-

图1:风险告知选项,选择yes -

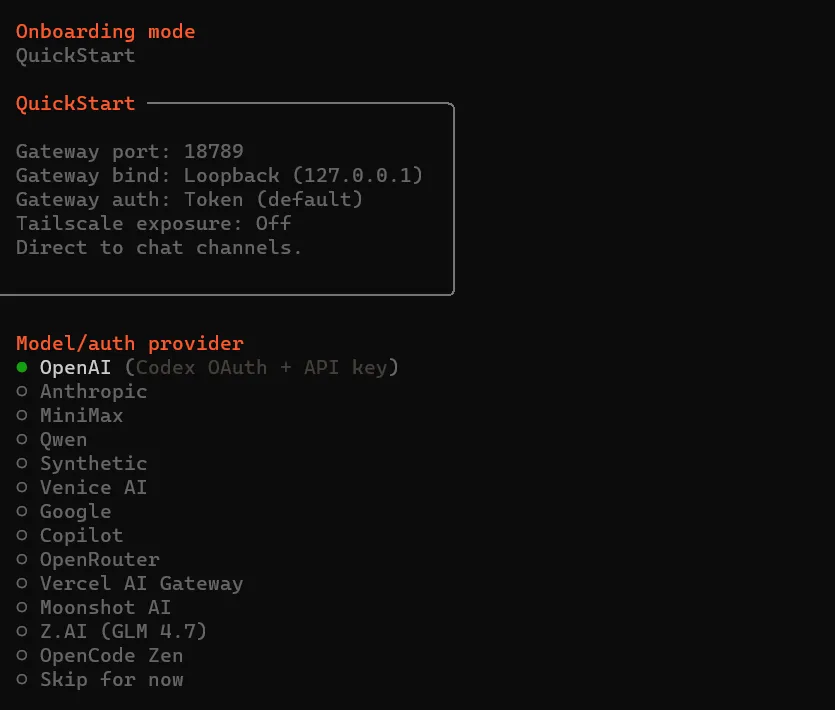

图2:模型服务商选择,你可以先选择qwen模型,目前可以免费使用(每天2000次), -

图3:选择 Qwen OAuth,回车之后你的浏览器会自动打开登录页面,点击授权即可。授权之后回到终端。 -

图4:直接按回车选择第一个 Keep current (qwen-portal/coder-model)。

-

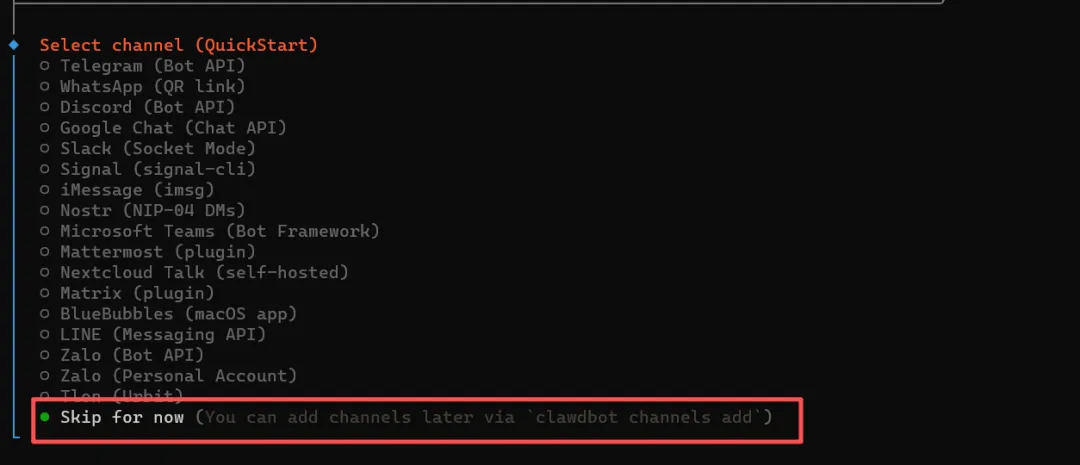

图1:选择连接到的通信软件,因为是国外的,可以直接选择最后一个跳过。 -

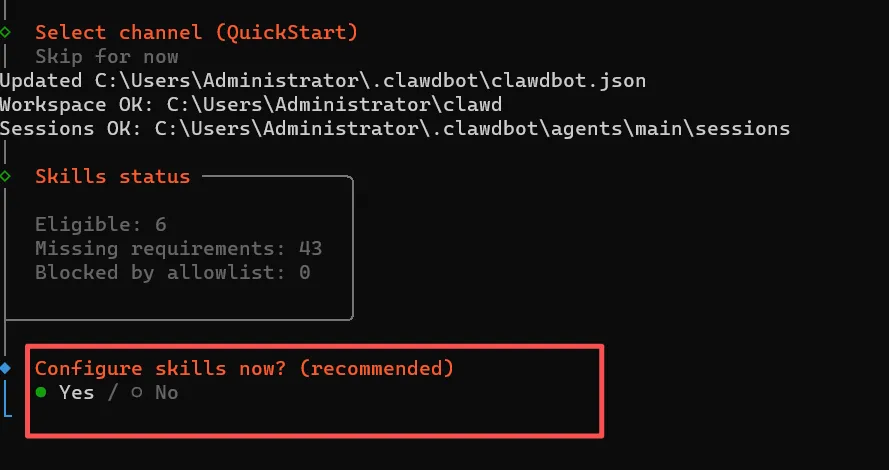

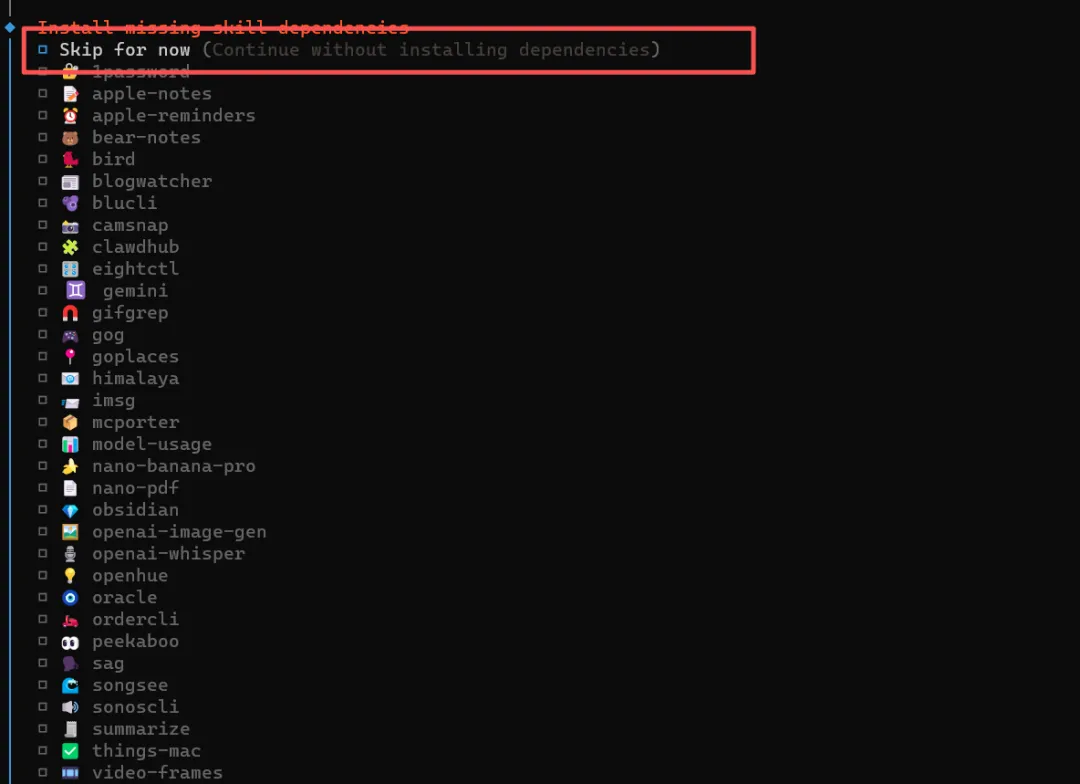

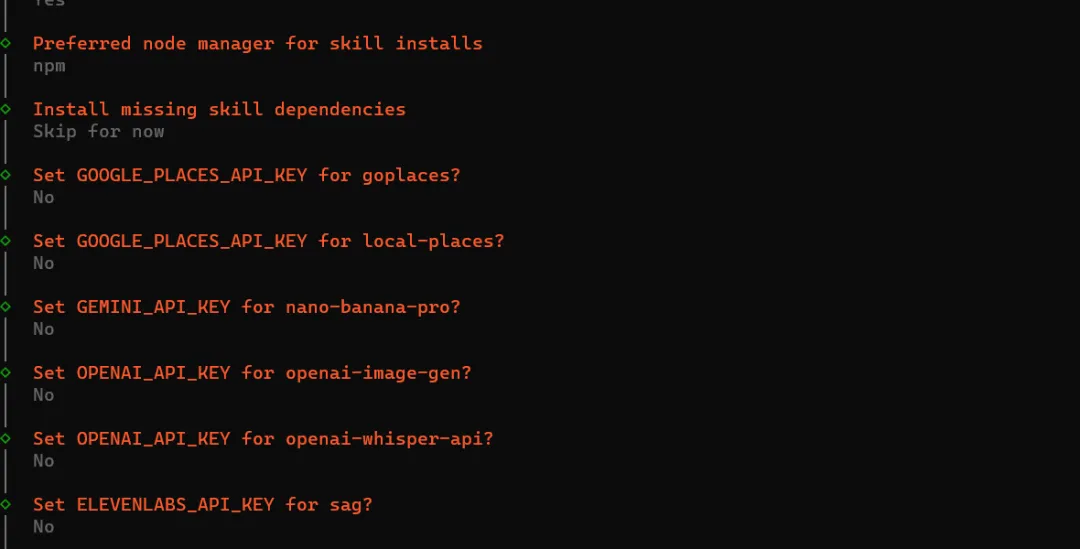

图2:配置skills技能,选择yes -

图3:选择需要安装的skills技能,下键选择,空格选中, -

图4:apik设置,直接选no,

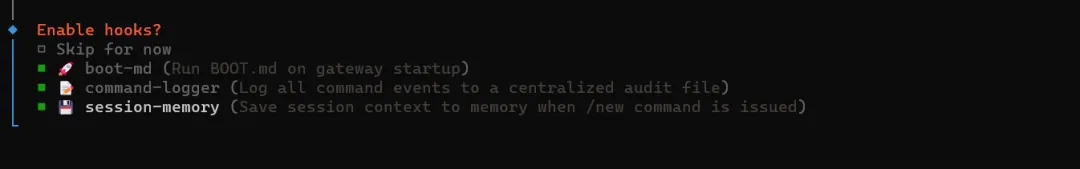

记忆能力选项,全部选中,回车

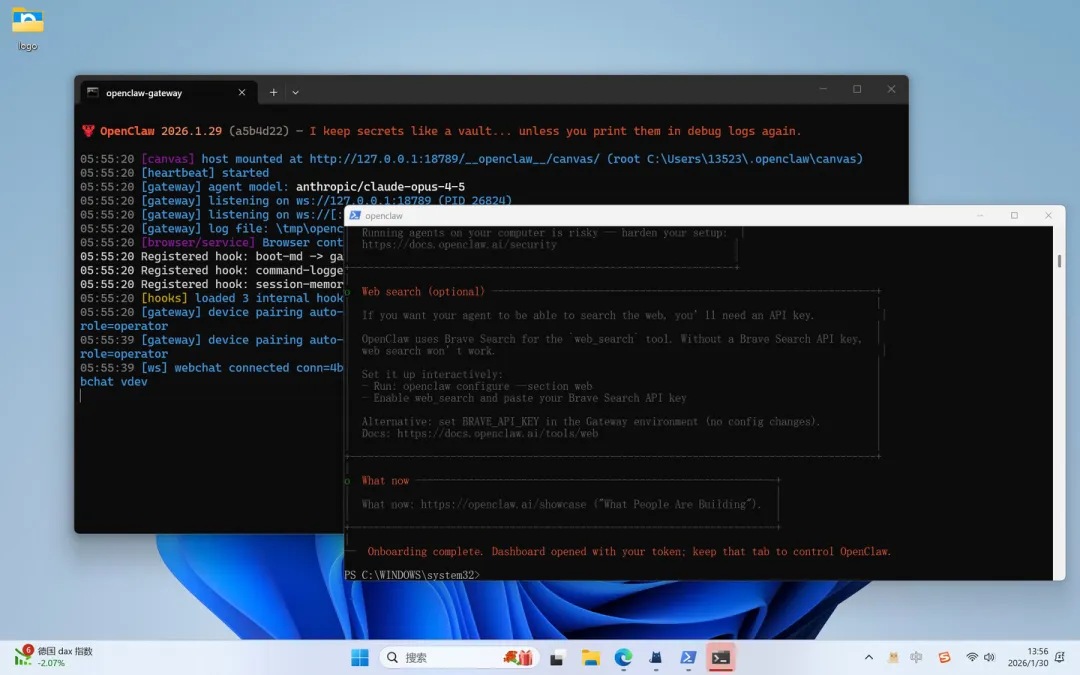

界面设置,选择web Ui,回车。

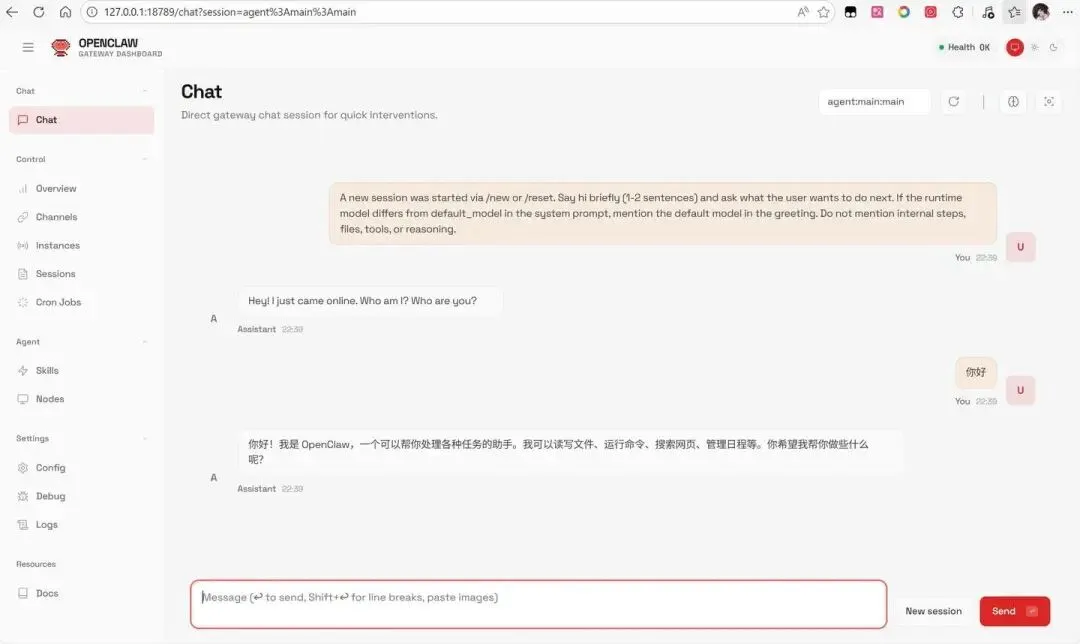

此时电脑会打开另外一个终端(原来的终端可以关闭),并且浏览器会自动打开对话窗口,此时就已经安装完成。

【2】macos/Linux系统

执行以下代码:

curl -fsSL https://openclaw.ai/install.sh | bash

【3】常用的命令

重新配置:openclaw onboard

启动运行:openclaw gateway

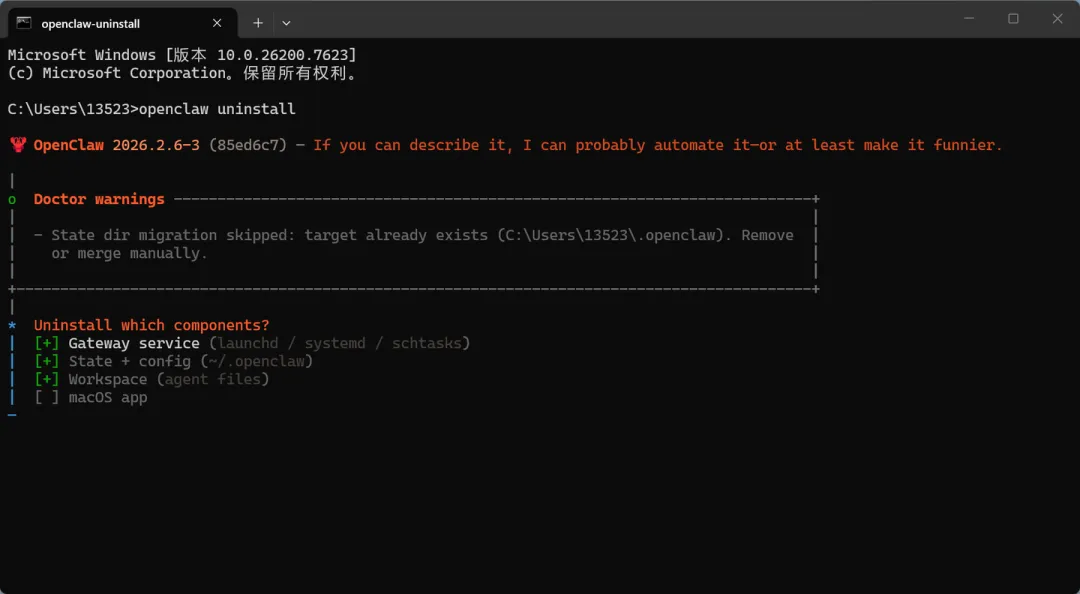

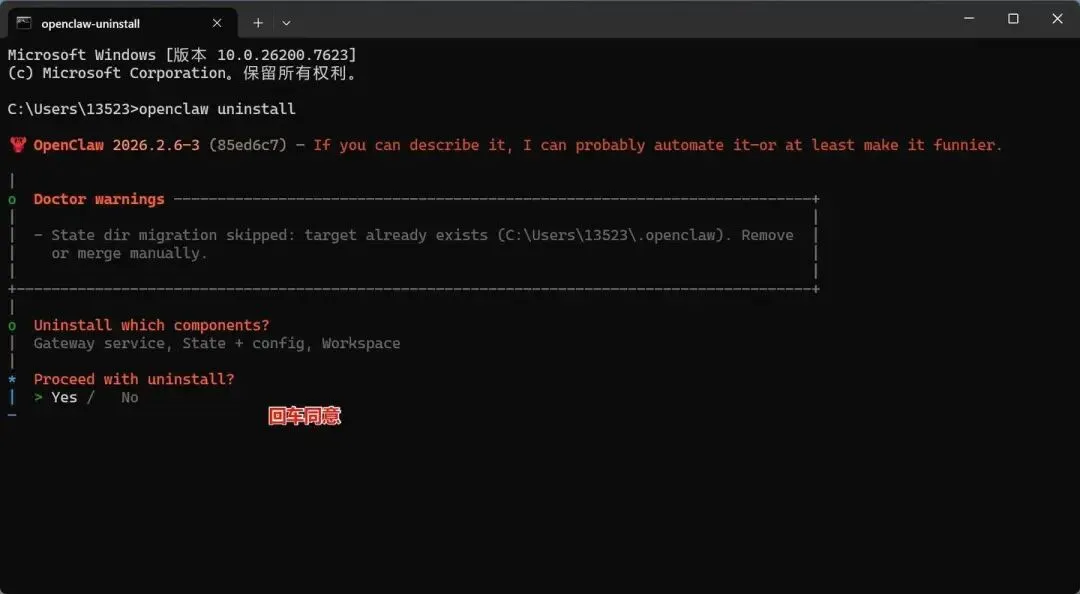

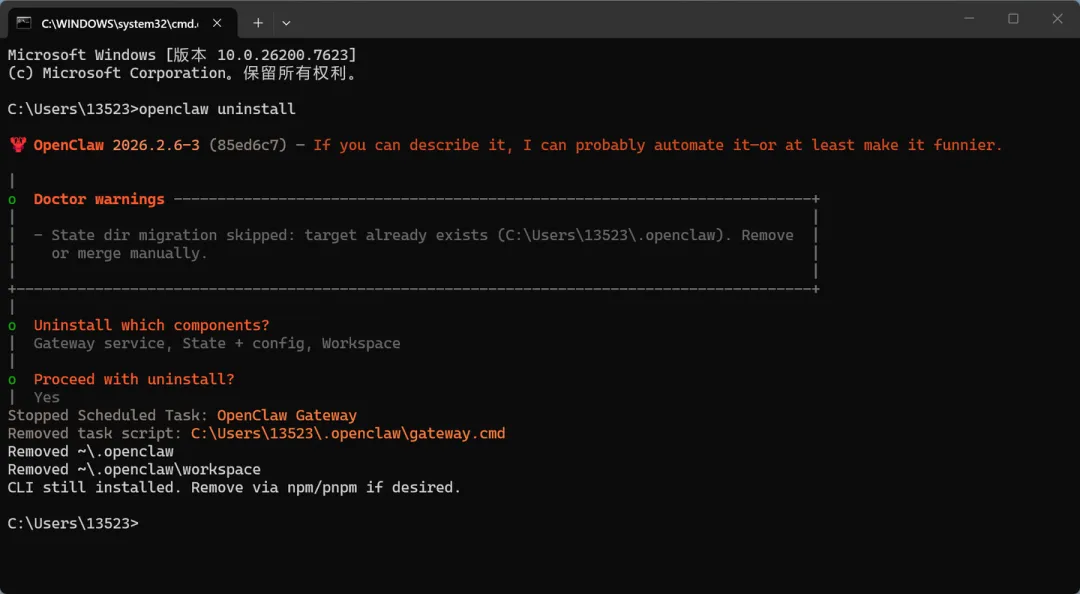

【4】软件卸载

执行官方卸载命令,打开CMD输入以下命令回车,图1是卸载组件选择,默认即可,直接回车,图3即是卸载完成。

openclaw uninstall

清理剩余CLI文件,输入以下命令回车

npm uninstall -g openclaw

三、配置大模型

OpenClaw 采用“本地优先+多源路由”架构,支持以下四大类模型:

- 顶尖云端模型(通过 API 或订阅接入):

-

Anthropic 系列: Claude 4.5 Opus (推荐作为核心脑)、Sonnet、Haiku。 -

OpenAI 系列: GPT-5 (包括 Nano/Pro/Max 系列)、GPT-4o、o3-mini。 -

Google 系列: Gemini 2.0 Pro/Flash。 - 国产主流模型(通过原生插件或百炼平台接入):

-

阿里云千问: Qwen3 系列、QwQ (推理增强版)、Qwen-Coder 2.5。 -

月之暗面: Kimi K2.5(特别是新推出的 Kimi Claw 云端集成版)。 -

其他: DeepSeek-V3、MiniMax M2.5、智谱 GLM-5。 - 聚合服务商(适合“一站式”管理):

-

OpenRouter: 支持调用数百种模型,包含大量免费模型。 -

Vercel AI Gateway: 适合开发者进行跨区域低延迟调用。 - 本地运行模型(零代币成本):

-

通过 Ollama 或 LM Studio: 支持 Qwen3-Coder (7B/14B)、Llama 3.3、DeepSeek-R1-Distill 等。

【1】本地大模型(电脑显存至少16G)

首先你需要在电脑中安装ollama(自行安装),并且配置以下几种官方推荐的大模型。安装好之后先在ollama客户端对话一下,确保可以正确运行。

qwen3-coder、glm-4.7、gpt-0ss:20b、gpt-0ss:120b

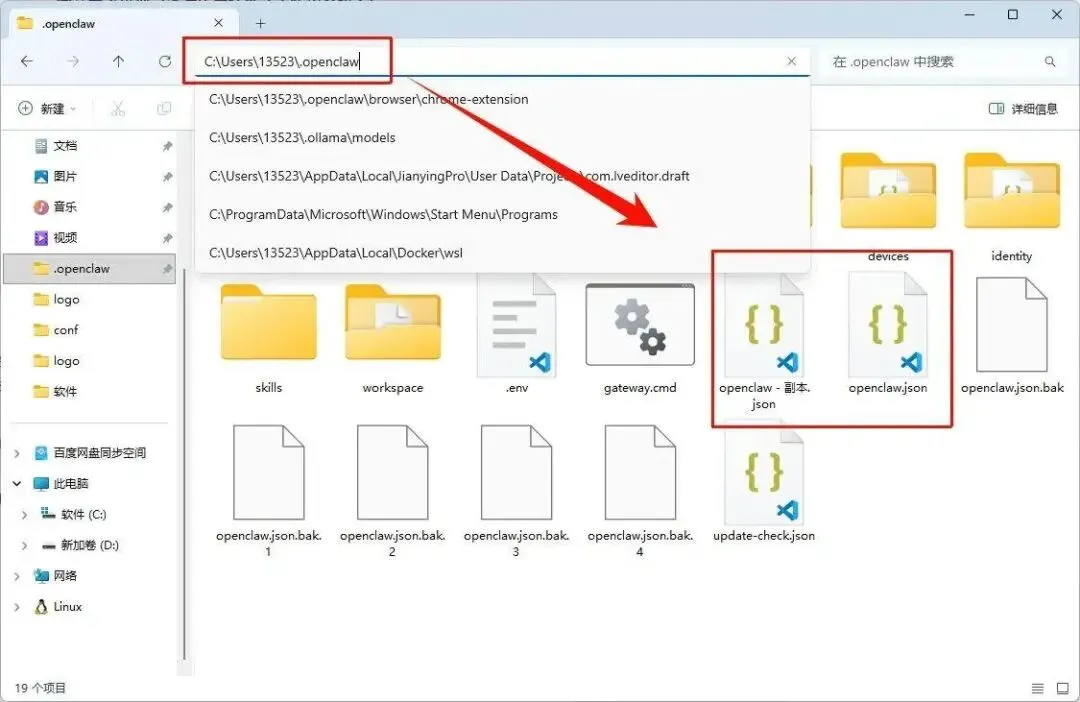

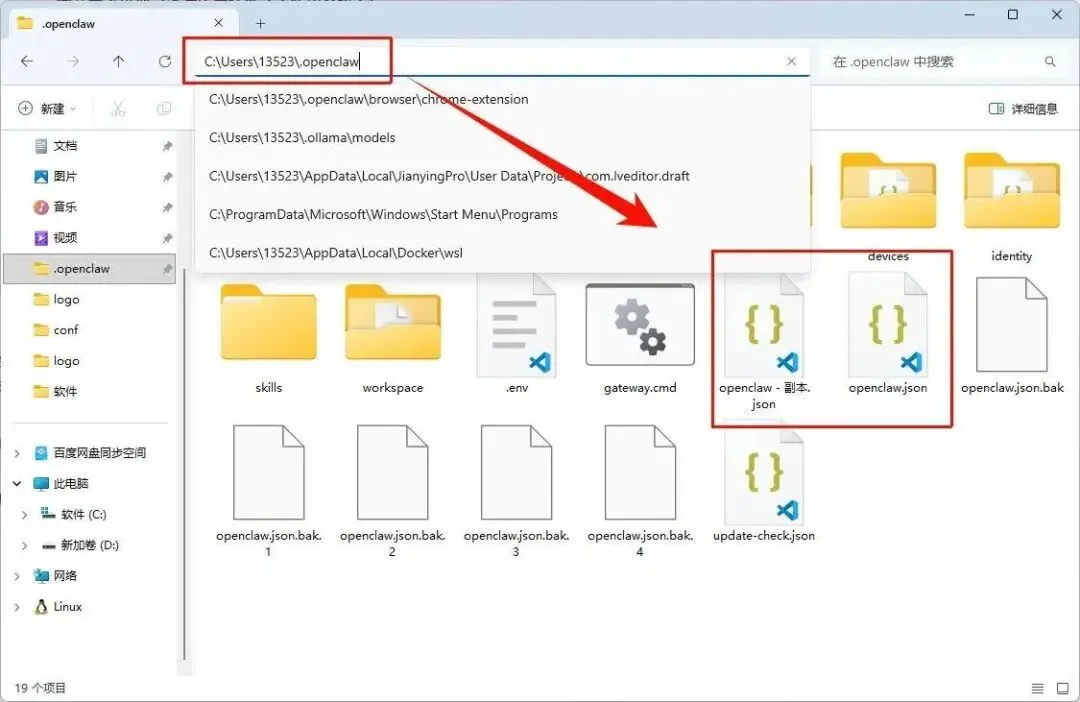

然后我们打开openclaw根目录下的json文件,通过修改代码的方式去配置,如图所示,在C盘-用户-你的用户名-openclaw中找到openclaw.json文件,先复制一份作为备份。然后打开该文件,将里面的代码全部清空,然后粘贴下面我给你的代码,保存重启openclaw即可。

{

"meta": {

"lastTouchedVersion": "2026.2.6-3",

"lastTouchedAt": "2026-02-26T02:50:32.088Z"

},

"wizard": {

"lastRunAt": "2026-02-26T02:50:32.056Z",

"lastRunVersion": "2026.2.6-3",

"lastRunCommand": "onboard",

"lastRunMode": "local"

},

"auth": {

"profiles": {

"qwen-portal:default": {

"provider": "qwen-portal",

"mode": "oauth"

}

}

},

"models": {

"providers": {

"qwen-portal": {

"baseUrl": "https://portal.qwen.ai/v1",

"apiKey": "qwen-oauth",

"api": "openai-completions",

"models": [

{

"id": "coder-model",

"name": "Qwen Coder",

"reasoning": false,

"input": [

"text"

],

"cost": {

"input": 0,

"output": 0,

"cacheRead": 0,

"cacheWrite": 0

},

"contextWindow": 128000,

"maxTokens": 8192

},

{

"id": "vision-model",

"name": "Qwen Vision",

"reasoning": false,

"input": [

"text",

"image"

],

"cost": {

"input": 0,

"output": 0,

"cacheRead": 0,

"cacheWrite": 0

},

"contextWindow": 128000,

"maxTokens": 8192

}

]

},

"ollama": {

"baseUrl": "http://127.0.0.1:11434/v1",

"apiKey": "123",

"auth": "api-key",

"api": "openai-completions",

"authHeader": true,

"models": [

{

"id": "gpt-oss:20b",

"name": "gpt-oss:20b",

"api": "openai-completions",

"input": [

"text"

],

"contextWindow": 40000,

"maxTokens": 40000,

"compat": {

"maxTokensField": "max_tokens"

},

"reasoning": false,

"cost": {

"input": 0,

"output": 0,

"cacheRead": 0,

"cacheWrite": 0

}

}

]

}

}

},

"agents": {

"defaults": {

"model": {

"primary": "ollama/gpt-oss:20b"

},

"models": {

"qwen-portal/coder-model": {

"alias": "qwen"

},

"ollama/gpt-oss:20b": {

"alias": "gpt-oss:20b"

},

"qwen-portal/vision-model": {},

"openai/gpt-5.1-codex": {

"alias": "GPT"

},

"qwen-plus": {}

},

"workspace": "C:\\Users\\13523\\.openclaw\\workspace",

"compaction": {

"mode": "safeguard"

},

"maxConcurrent": 4,

"subagents": {

"maxConcurrent": 8

}

}

},

"messages": {

"ackReactionScope": "group-mentions"

},

"commands": {

"native": "auto",

"nativeSkills": "auto"

},

"gateway": {

"port": 18789,

"mode": "local",

"bind": "loopback",

"auth": {

"mode": "token",

"token": "2ede55152b22f31593c21f65851a0d7343e49936cd7b50e7"

},

"tailscale": {

"mode": "off",

"resetOnExit": false

}

},

"plugins": {

"entries": {

"qwen-portal-auth": {

"enabled": true

}

}

}

}

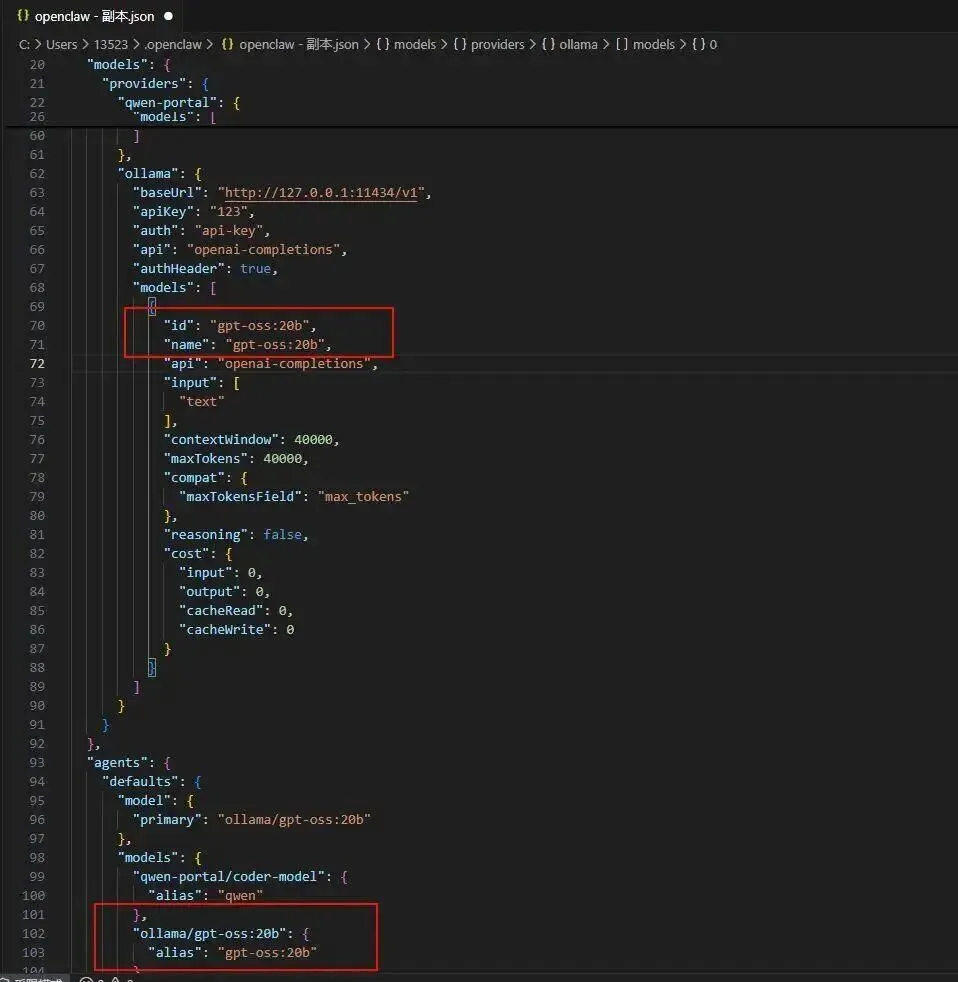

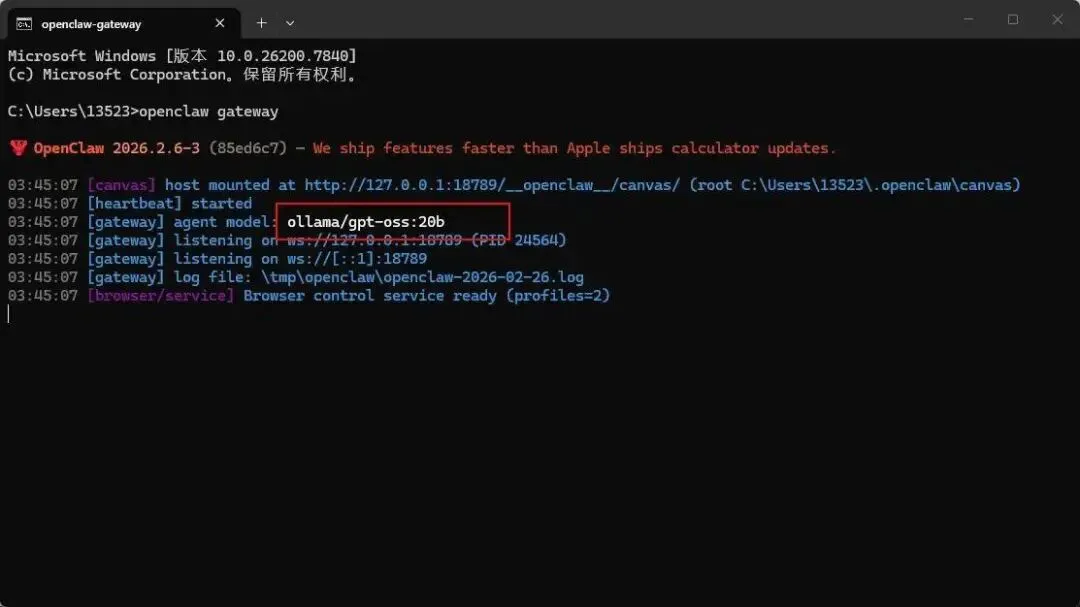

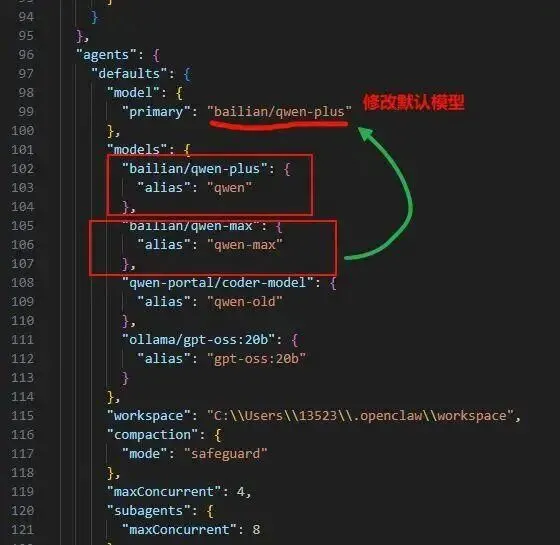

注意,你需要把第70行和100行的模型改成你自己安装过的大模型,如果你也是gpt-oss20b就不用修改了。然后你在运行openclaw的时候,就会发现,默认的模型已经改成了本地大模型。右图所示。

想修改默认启动模型怎么办?:同样打开openclaw.json文件,找到第99行,修改默认启动的大模型。

如果你按照上面的操作无法成功,还可以让openclaw自动帮你设置,你只需要跟openclaw说:我的电脑中已经安装了ollama,请你帮我把openclaw的大模型修改为本地大模型。他就会自动帮你把所有的代码配置好。

【2】阿里云百炼

百炼的核心是自研的**通义千问(Qwen)**全系列,同时也集成了国内主流厂商的顶级模型,如 DeepSeek(深度求索)、GLM(智谱)、Kimi(月之暗面)、MiniMax 等。

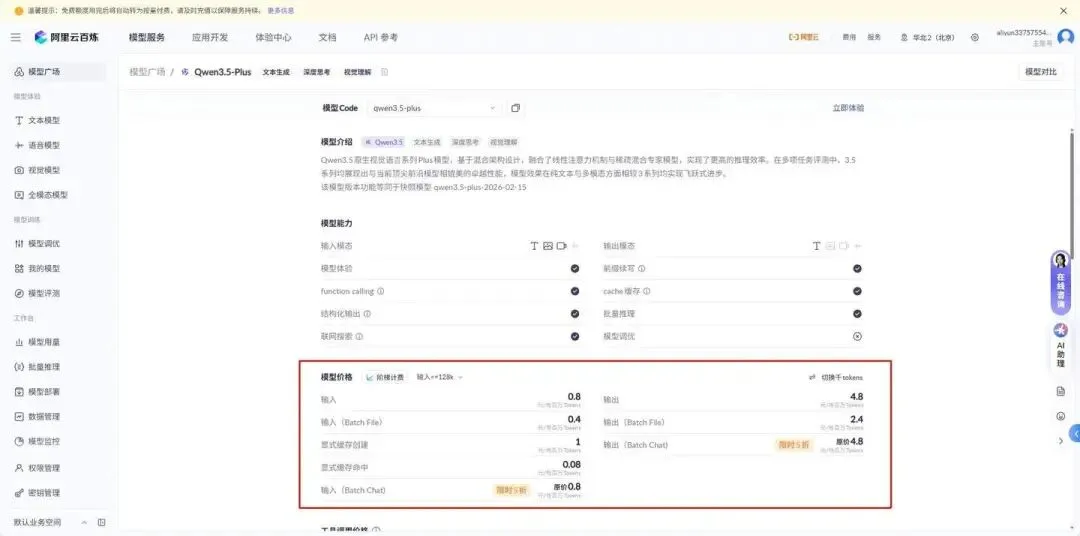

方案 A:极致均衡型(首选推荐)

-

建议模型: qwen3.5-plus -

理由: 它是 2026 年初发布的“全能王”。性能超过了前一代的 Max,响应速度极快,幻觉极低。阿里云对其进行了大幅降价,输入价格约 0.8元/百万 Token。

方案 B:省钱战神型(极低成本)

-

建议模型: deepseek-v3 -

理由:依然是价格屠夫,约 0.2-0.3元/百万 Token。在基础对话和简单逻辑上非常出色。在处理极其复杂的 OpenClaw 嵌套任务时,稳定性略逊于 Qwen3.5。

方案 C:复杂任务处理

-

建议模型: qwen3-max-thinking -

理由: 只有在 qwen3.5-plus报错或逻辑卡壳时,通过 OpenClaw 的配置回退到该模型。它能解决最难的逻辑坑。

如何开通最划算?

-

领取新人礼包:百炼对新开通用户通常提供各模型 100万 – 500万 Token 的免费额度(有效期 90 天)。在 OpenClaw 初始测试阶段,这完全够用。 -

订阅“Coding Plan”套餐:这是 2026 年最划算的方案。 阿里云针对 OpenClaw、Cursor 等工具推出了专用的 Coding Plan,通常采用固定月费制(例如几十元人民币/月),提供极高额度的 Qwen3.5 和 DeepSeek 调用权。 -

利用“节省计划”(付费用户):如果你调用量极大,可以在百炼控制台购买“AI 通用型节省计划”,类似手机话费套餐,最高可以获得 5 折左右的抵扣优惠。 -

配置 OpenClaw 缓存(Cache):在 OpenClaw 配置中开启上下文缓存(Context Caching)。阿里云百炼支持缓存抵扣,重复的系统提示词(System Prompt)最高可以减免 80% 的费用。

首先我们需要开通阿里云百炼服务,打开阿里云官网,在大模型菜单中选择百炼平台,然后鼠标悬停右上角头像,点击充值,先充值再使用,如果你是第一次用,可能还需要实名认证。

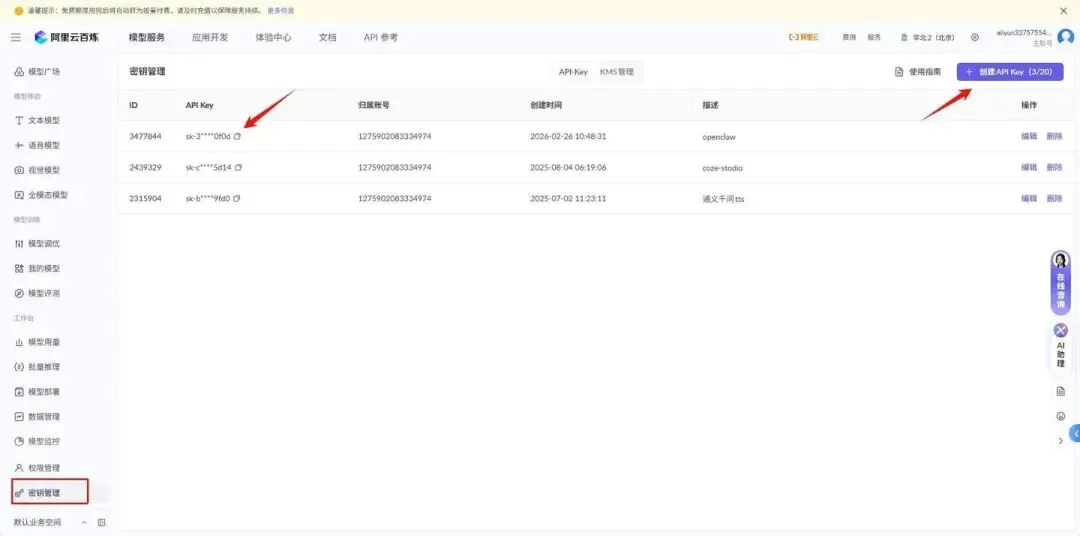

在阿里云百炼首页点击秘钥管理,新建一个apik,然后复制apik,后面会用到。

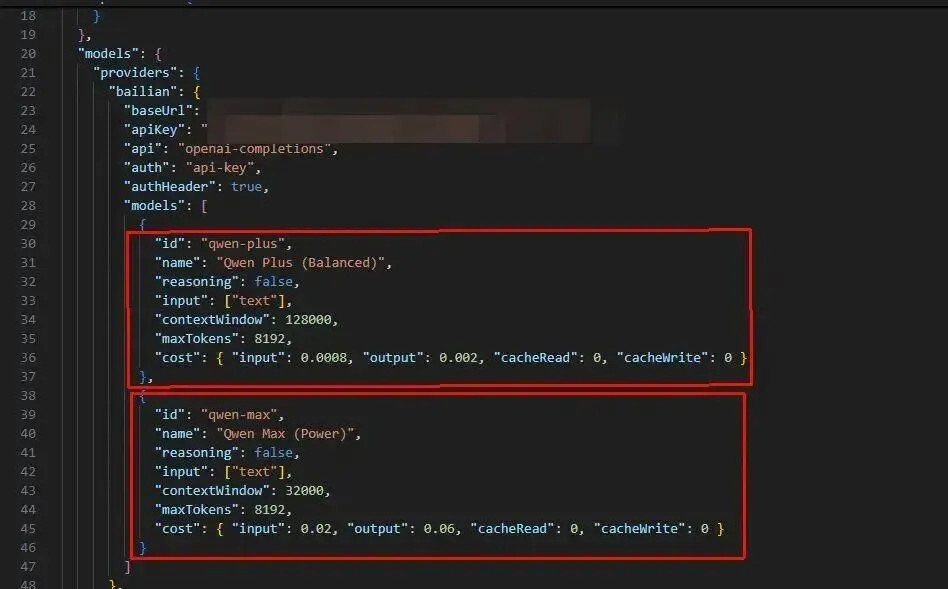

然后我们打开openclaw根目录下的json文件,通过修改代码的方式去配置,如图所示,在C盘-用户-你的用户名-openclaw中找到openclaw.json文件,先复制一份作为备份。然后打开该文件,将里面的代码全部清空,然后粘贴下面我给你的代码,找到第24行,替换你前面复制的apik,保存重启openclaw即可。

{

"meta": {

"lastTouchedVersion": "2026.2.6-3",

"lastTouchedAt": "2026-02-26T02:50:32.088Z"

},

"wizard": {

"lastRunAt": "2026-02-26T02:50:32.056Z",

"lastRunVersion": "2026.2.6-3",

"lastRunCommand": "onboard",

"lastRunMode": "local"

},

"auth": {

"profiles": {

"qwen-portal:default": {

"provider": "qwen-portal",

"mode": "oauth"

}

}

},

"models": {

"providers": {

"bailian": {

"baseUrl": "https://dashscope.aliyuncs.com/compatible-mode/v1",

"apiKey": "这里替换成你申请的sk-开头的APIKEY",

"api": "openai-completions",

"auth": "api-key",

"authHeader": true,

"models": [

{

"id": "qwen-plus",

"name": "Qwen Plus (Balanced)",

"reasoning": false,

"input": ["text"],

"contextWindow": 128000,

"maxTokens": 8192,

"cost": { "input": 0.0008, "output": 0.002, "cacheRead": 0, "cacheWrite": 0 }

},

{

"id": "qwen-max",

"name": "Qwen Max (Power)",

"reasoning": false,

"input": ["text"],

"contextWindow": 32000,

"maxTokens": 8192,

"cost": { "input": 0.02, "output": 0.06, "cacheRead": 0, "cacheWrite": 0 }

}

]

},

"qwen-portal": {

"baseUrl": "https://portal.qwen.ai/v1",

"apiKey": "qwen-oauth",

"api": "openai-completions",

"models": [

{

"id": "coder-model",

"name": "Qwen Coder",

"reasoning": false,

"input": ["text"],

"cost": { "input": 0, "output": 0, "cacheRead": 0, "cacheWrite": 0 },

"contextWindow": 128000,

"maxTokens": 8192

},

{

"id": "vision-model",

"name": "Qwen Vision",

"reasoning": false,

"input": ["text", "image"],

"cost": { "input": 0, "output": 0, "cacheRead": 0, "cacheWrite": 0 },

"contextWindow": 128000,

"maxTokens": 8192

}

]

},

"ollama": {

"baseUrl": "http://127.0.0.1:11434/v1",

"apiKey": "123",

"auth": "api-key",

"api": "openai-completions",

"authHeader": true,

"models": [

{

"id": "gpt-oss:20b",

"name": "gpt-oss:20b",

"api": "openai-completions",

"input": ["text"],

"contextWindow": 40000,

"maxTokens": 40000,

"compat": { "maxTokensField": "max_tokens" },

"reasoning": false,

"cost": { "input": 0, "output": 0, "cacheRead": 0, "cacheWrite": 0 }

}

]

}

}

},

"agents": {

"defaults": {

"model": {

"primary": "bailian/qwen-plus"

},

"models": {

"bailian/qwen-plus": {

"alias": "qwen"

},

"bailian/qwen-max": {

"alias": "qwen-max"

},

"qwen-portal/coder-model": {

"alias": "qwen-old"

},

"ollama/gpt-oss:20b": {

"alias": "gpt-oss:20b"

}

},

"workspace": "C:\\Users\\13523\\.openclaw\\workspace",

"compaction": {

"mode": "safeguard"

},

"maxConcurrent": 4,

"subagents": {

"maxConcurrent": 8

}

}

},

"messages": {

"ackReactionScope": "group-mentions"

},

"commands": {

"native": "auto",

"nativeSkills": "auto"

},

"gateway": {

"port": 18789,

"mode": "local",

"bind": "loopback",

"auth": {

"mode": "token",

"token": "2ede55152b22f31593c21f65851a0d7343e49936cd7b50e7"

},

"tailscale": {

"mode": "off",

"resetOnExit": false

}

},

"plugins": {

"entries": {

"qwen-portal-auth": {

"enabled": true

}

}

}

}

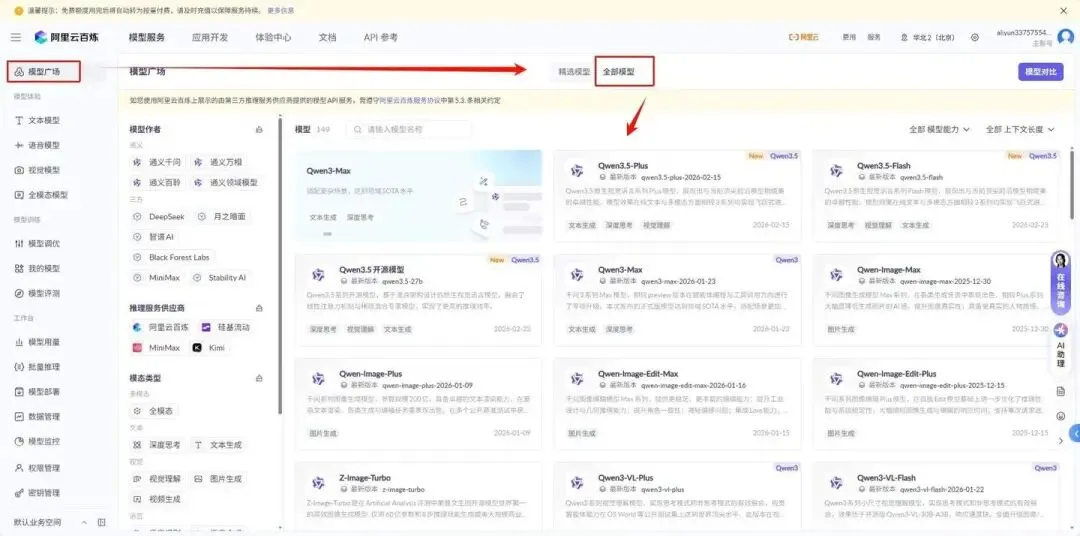

注意,代码中默认模型是qwen-plus,性价比比较高,你如果想要更换模型,请按照下面操作,首先在模型广场中找到你想要使用的模型,点击进去可以看到具体的价格。复制模型的名称,

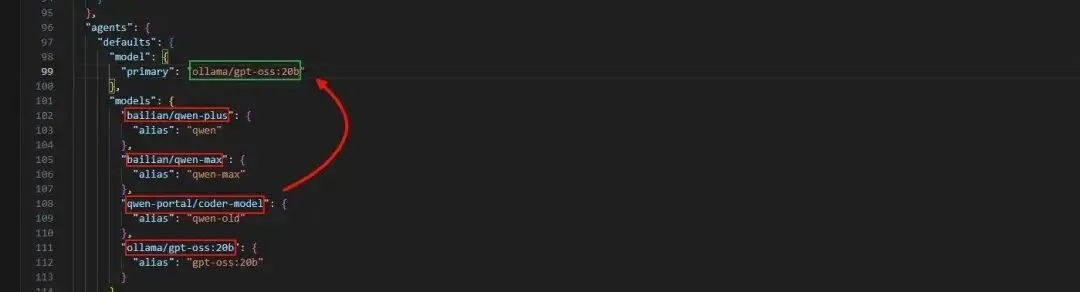

修改json文件,分别是第30行左右,添加新模型(如图已经有两个,你只需要复制代码修改即可),第100行左右,同样添加新模型,注意,上面的默认模型要修改成你新添加的。

四、安装skills

在openclaw中安装第三方技能(skills)只需要在终端中输入以下代码即可,软件会自动下载技能到openclaw>workspace文件夹中,使用的就是标准的skills结构。以下推荐几个好用的skills网站:

-

社区技能库:https://github.com/VoltAgent/awesome-moltbot-skills -

ClawHub:https://www.clawhub.ai/skills -

skills.sh:https://skills.sh/ -

Skillssmp:https://skillsmp.com/zh

|

|

|

|

|---|---|---|

|

|

|

|

|

|

|

|

|

|

||

五、对接通信软件(远程控制)

【1】飞书

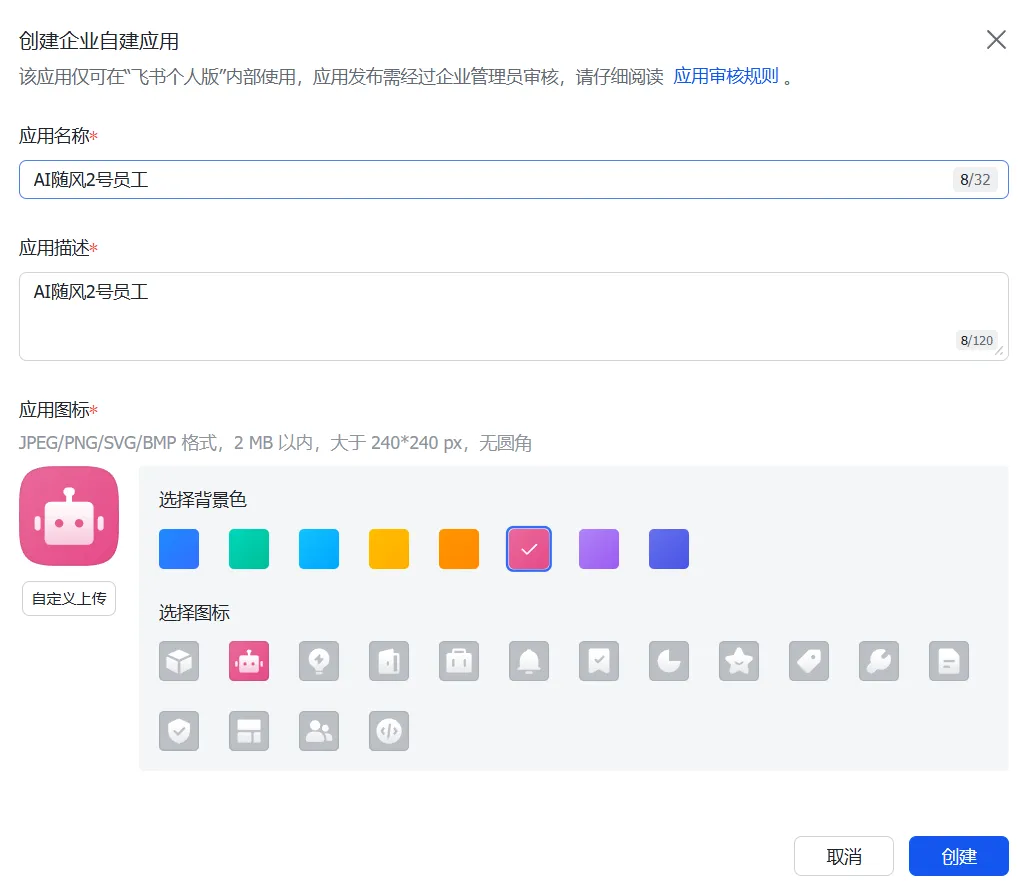

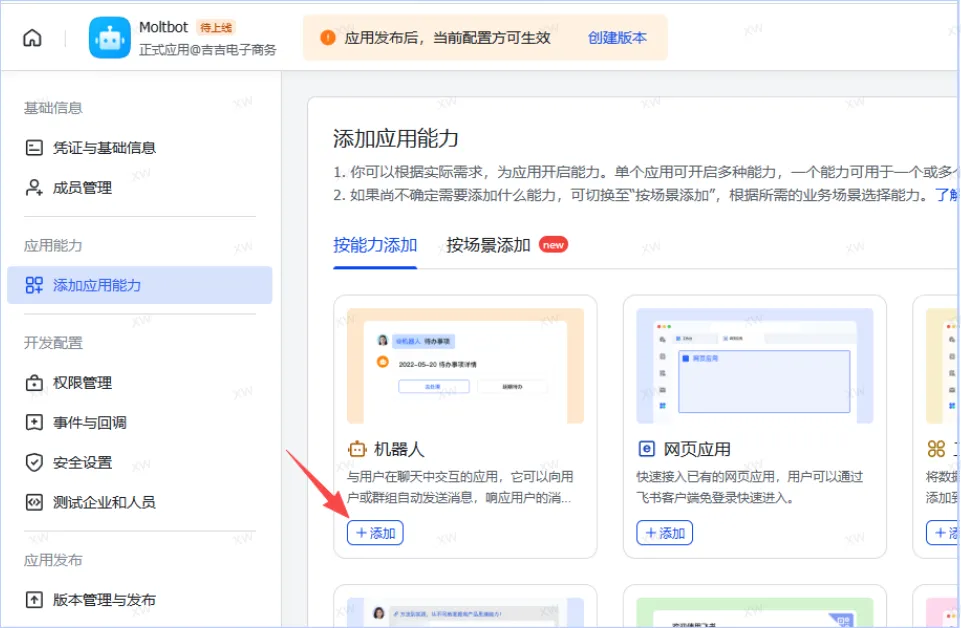

1、创建飞书应用

https://open.feishu.cn/app?lang=zh-CN

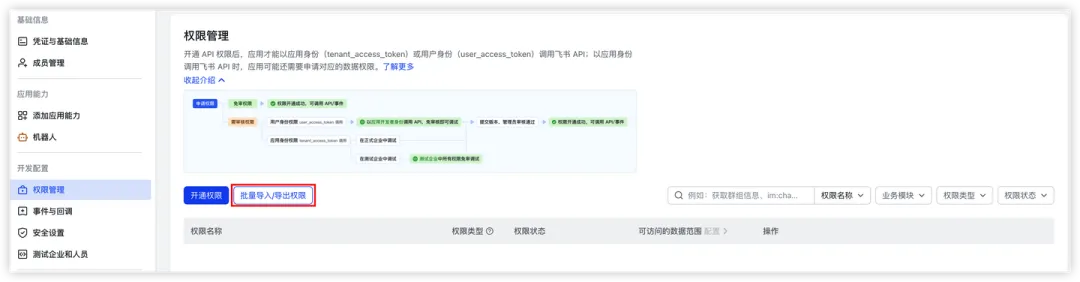

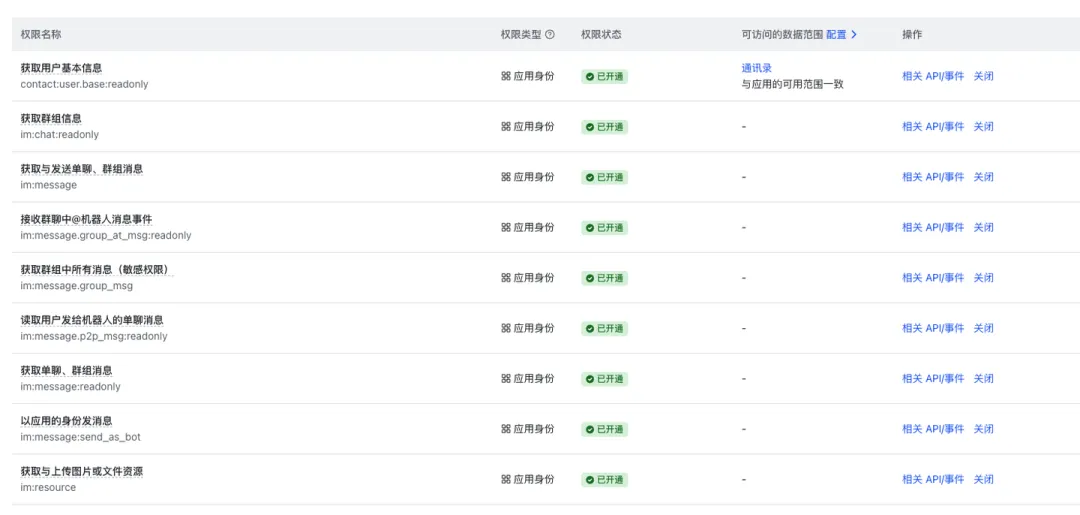

可以根据自己情况,开通对应的权限,可以选择导入的方式

点击批量导入

{

"scopes": {

"tenant": [

"im:chat:read",

"im:chat:update",

"im:message.group_at_msg:readonly",

"im:message.p2p_msg:readonly",

"im:message.pins:read",

"im:message.pins:write_only",

"im:message.reactions:read",

"im:message.reactions:write_only",

"im:message:readonly",

"im:message:recall",

"im:message:send_as_bot",

"im:message:send_multi_users",

"im:message:send_sys_msg",

"im:message:update",

"im:resource"

],

"user": [

"contact:user.employee_id:readonly"

]

}

}

Required Permissions 所需权限

|

|

|

|

|

|

|

获取基本用户信息 |

|

|

|

发送和接收消息 |

|

|

|

向机器人阅读私信 |

|

|

|

分组接收@mention 消息 |

|

|

|

以机器人身份发送消息 |

|

|

|

上传和下载图片/文件 |

Optional Permissions 可选权限

|

|

|

|

|

|

|

阅读所有群组消息(敏感) |

|

|

|

|

|

|

|

更新/编辑已发送的消息 |

|

|

|

|

|

|

|

|

2、安装飞书插件

自动安装:帮我安装这个插件,命令是:clawdbot plugins install @m1heng-clawd/feishu

手动安装:clawdbot plugins install @m1heng-clawd/feishu

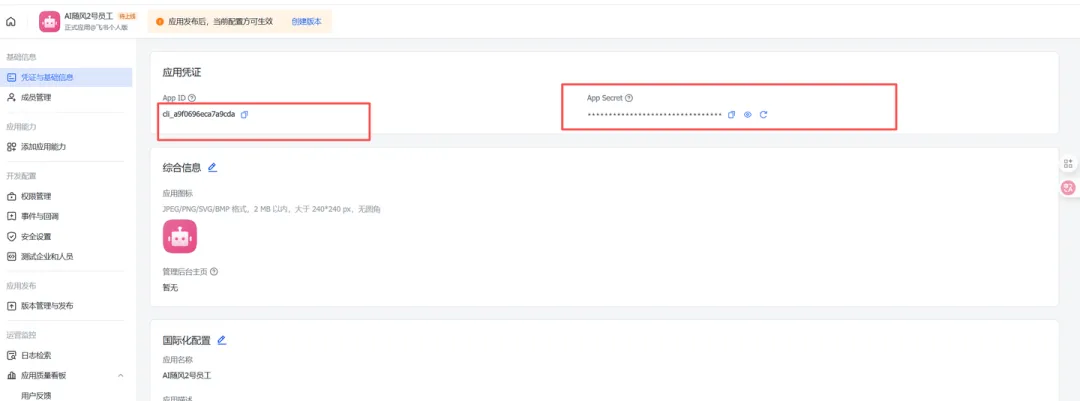

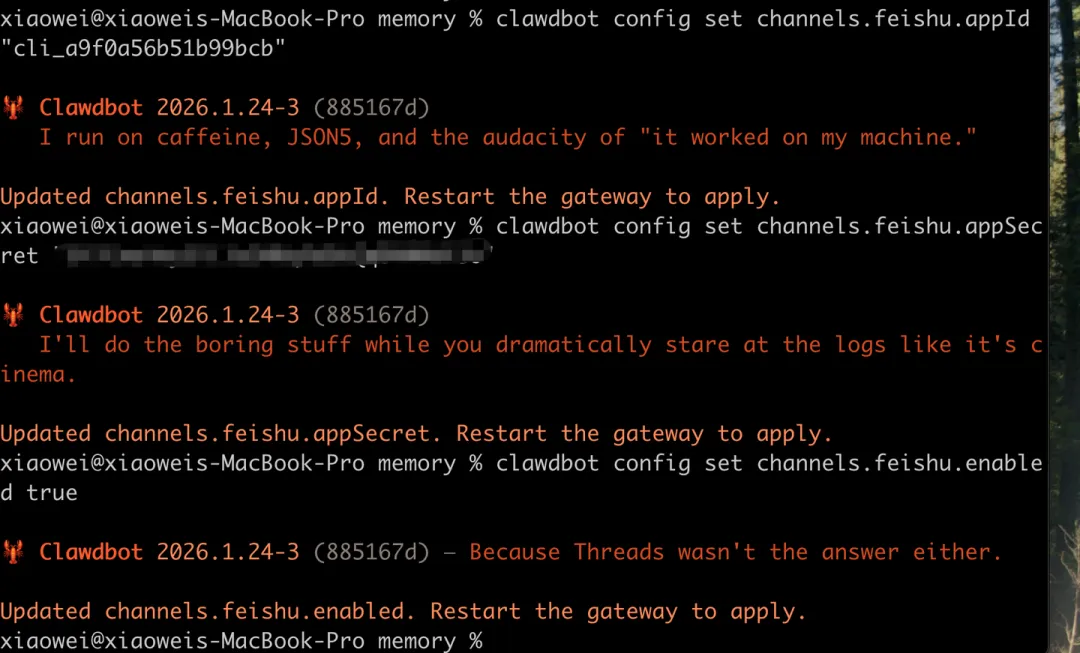

3、配置飞书应用

clawdbot config set channels.feishu.appId "cli_xxxxx"

clawdbot config set channels.feishu.appSecret "your_app_secret"

clawdbot config set channels.feishu.enabled true

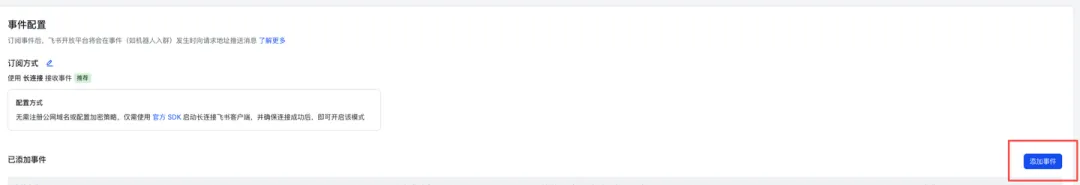

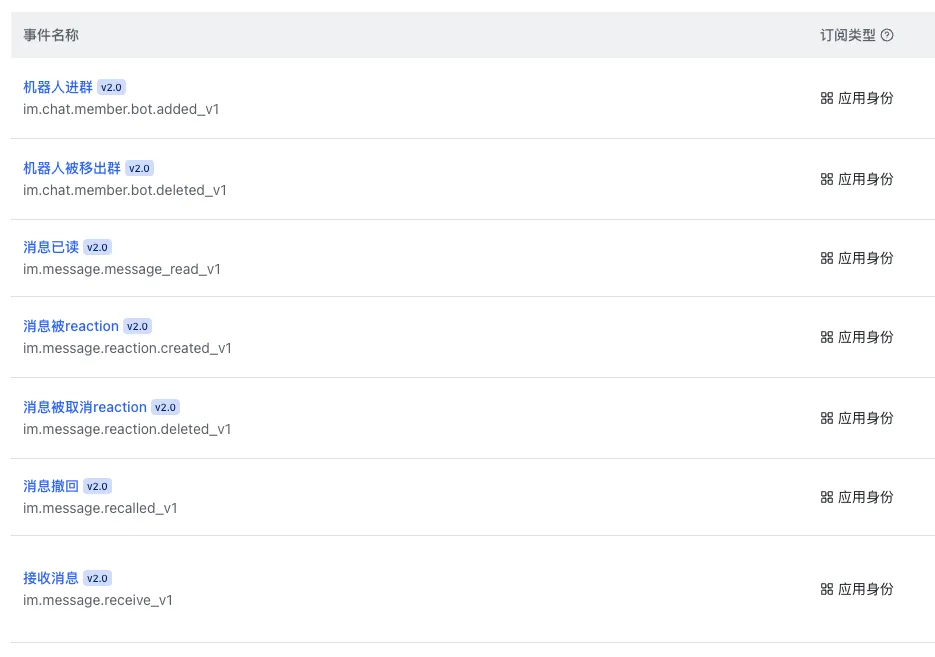

4、配置事件

5、配置回调

选择长链接,点击保存

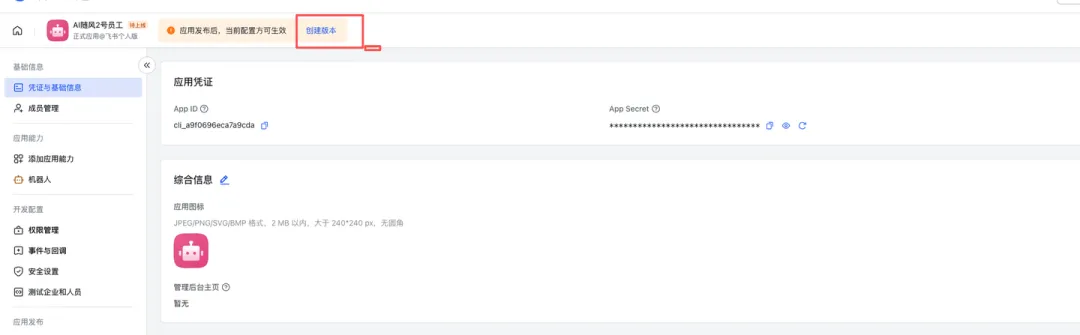

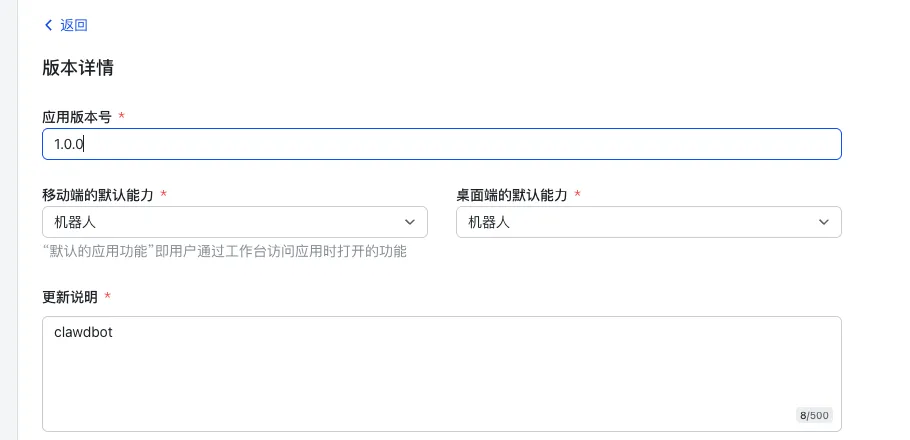

6、创建版本

创建完成点击发布就行了。

【2】WhatsApp

【3】Telegram

【4】Discord

六、使用案例

【案例1】:邮件自动管理

场景描述

企业主每天收到数百封邮件,大量时间浪费在筛选和回复上。用OpenClaw自动分类、起草回复、退订广告邮件。

配置步骤

-

安装邮件技能:npx clawhub install himalaya-email -

配置IMAP/SMTP连接信息(服务器地址、用户名、密码或应用专用密码) -

在SOUL.md中添加邮件处理规则,例如:“客户邮件优先级最高、广告邮件直接退订、合作邮件转发给我” -

设置定时任务,每小时检查新邮件

效果展示

社区用户报告:两天内清理4,000+封邮件,分类准确率约90%,处理2,000封邮件的API调用费用约8美元。

【案例2】:自动/定时整理文件

【案例3】:客户消息自动回复

【案例4】:每日早报自动推送

七、错误排查

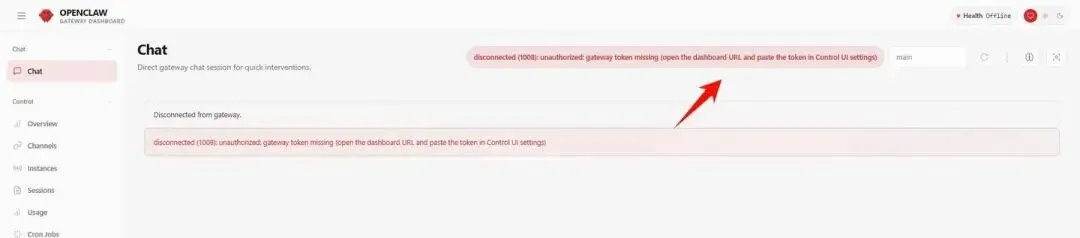

【1】网关令牌缺失

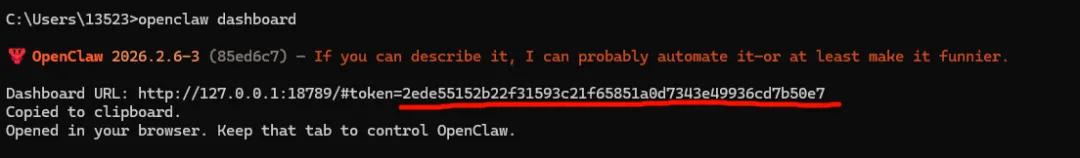

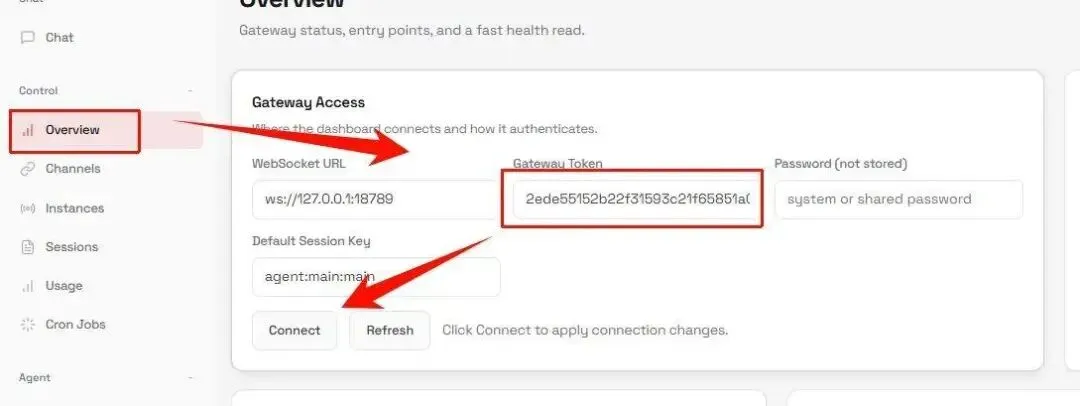

当你打开对话页面,出现以下的提示,就说明服务出现了错误,解决的方案也很简单。

先关闭openclaw服务,打开终端,运行:openclaw dashboard,然后就会出现秘钥。随后我们再次运行openclaw服务,打开Overview菜单,将秘钥填进去,点击连接即可。

夜雨聆风

夜雨聆风