告别低效沟通!使用Dify把公司文档变成智能问答库

Tip

友情提示: 文章有点长,但是很干货,建议仔细阅读,有问题的可以后台留言一起交流

前言

随着大模型应用的普及,如何将通用 AI 能力与私有知识结合,成为企业与个人落地 AI 的关键。Dify 作为一款开源的 LLMOps 平台,提供了可视化、低代码的方式,帮助用户快速构建基于知识库的智能应用。

本文将详细介绍如何在 ** Linux 系统上部署 Dify 1.12.0**,并创建一个基于知识库的聊天助手,实现精准问答、拒绝发散,适用于文档查询、产品手册、内部知识库等场景。

一、环境准备与 Dify 部署

1. 系统要求

-

• 操作系统: Linux:Ubuntu 20.04 LTS 或 CentOS 7+ -

• 硬件: -

• 内存:≥ 8GB(推荐 16GB) -

• 存储:≥ 50GB 可用空间 -

• 依赖软件: -

• Docker -

• Docker Compose -

• Git

**2. 安装 Docker

Linux 安装步骤(以 Ubuntu 为例)

# 更新软件源

sudo apt update

# 安装依赖

sudo apt install -y docker.io docker-compose git curl

# 将当前用户加入 docker 组,避免每次使用 sudo

sudo usermod -aG docker $USER

# 重启终端或执行:

newgrp docker✅ 验证:docker --version 应输出版本信息(如 Docker version 24.0.6)

Centos 系统使用 yum 工具安装 yum install -y docker.io docker-compose git curl 其他操作类似

3. 部署 Dify 1.12.0

项目代码获取

可以使用git clone进行克隆拉取

mkdir -p /opt/app/Dify && cd/opt/app/Dify

git clone -b v1.12.0 https://github.com/langgenius/dify.git

cd dify或者直接从github上下载对应zip包进行解压,下载地址 https://github.com/langgenius/dify/archive/refs/tags/1.12.0.tar.gz

配置并启动服务

# 复制环境配置文件

cp .env.example .env

# 调整配置 vim .env

# 修改默认端口号 EXPOSE_NGINX_PORT

EXPOSE_NGINX_PORT=8088

# 修改如下两个URL地址,默认是空

CONSOLE_API_URL=http://172.31.7.31:8088

APP_API_URL=http://172.31.7.31:8088

# 启动容器(后台运行)

docker compose up -dTip

重要提醒

🕒 首次启动需拉取镜像,耗时较长,请耐心等待。

🕒 如果你的80端口已经被占用(一般是Nginx占用),建议修改.env中的EXPOSE_NGINX_PORT参数,比如修改成 8081

🕒 修改 CONSOLE_API_URL 和 APP_API_URL地址,默认为空,不修改的话再第一次打开页面自动install的时候浏览器console会报错,无法正常打开

验证服务状态

docker compose ps确保 api、web、worker 等服务状态为 running。

4. 初始化与访问

-

• 打开浏览器访问:

http://192.168.100.101:8081

– 注意这里是修改之后的端口和地址,目前是测试就没有配置 域名+ 反向代理(如 Nginx) -

• 首次使用需注册账号,该账号为管理员账户,请妥善保管。 -

• 登录后进入 Dify 工作台。

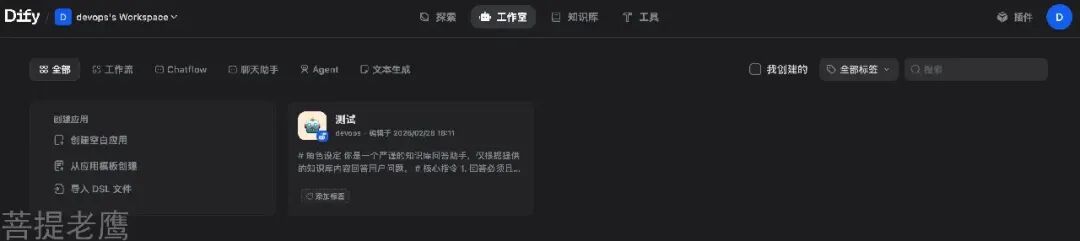

界面大概长这个样子

目前我们主要使用知识库和工作室 两个菜单下的能力。

但是在进入实际使用之前,我们需要配置两个特殊的模型:

-

• embedding模型 就是把人类能理解的文字,翻译成计算机能看懂的“数学语言” 存入到 向量数据库中 -

• LLM模型 这就是我们常说的deepseek/千文等 -

• 此外可能还会涉及到reranker模型

这里我们直接配置教你如何配置

二、模型选择和配置

选择了基于Dify本地部署的话,一般也会基于GPU机型部署本地LLM大模型和Embedding模型,这里先不讲本地部署的方案。

1、模型选择

这里是以第三方云厂商提供的免费额度来配置,大家可以通过这个连接 阿里云百炼平台 https://www.aliyun.com/benefit/ai/aistar?clubBiz=subTask..12407165..10263.. 来获取免费额度

然后在API参考页面进入页面(https://bailian.console.aliyun.com/cn-beijing/?tab=model#/api-key 国内一般都是北京区)创建一个API Key 即可

阿里云的百炼提供了上面提到的LLM(比如最新的qwen3.5-plus)、embedding、reranker模型

2、Dify配置

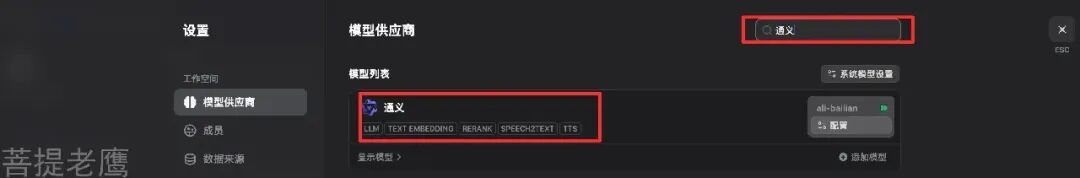

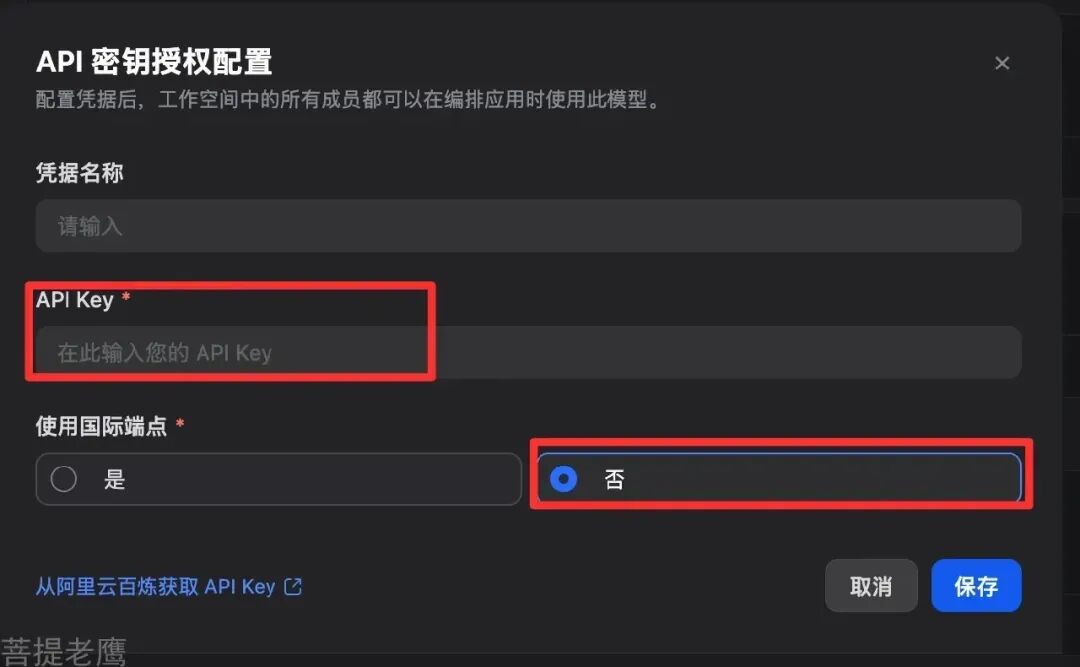

点击右上角的个人头像图标,点击”设置“进入之后选择 模型供应商, 搜索 ”通义“,找到之后直接点击安装按钮,安装之后如下

然后点击模型右侧的 ”添加模型“ ,在弹出的面板中填入上一步申请的 API KEY 即可,名称随便填

然后就看到”显示模型“ 打开以后有122个模型,其中就有我们需要的三个模型

三、创建知识库:构建专属知识中枢

1. 创建知识库

-

• 进入 Dify 工作台 → 点击「知识库」→「创建知识库」 -

• 填写名称(如:公司产品手册) -

• 上传文档(支持 PDF、TXT、Markdown、Excel、CSV 等)

这里我们选择 “导致已有文件的方式创建”, 当然你也可以先创建个空知识库 然后进入知识库在上传文件一样的。

Tip

最佳实践建议将文档整理为 Q&A 格式的 CSV/Excel,提升检索准确率。

进过自己的各种实测 基于向量数据库的方案,对于文档格式有一定的要求

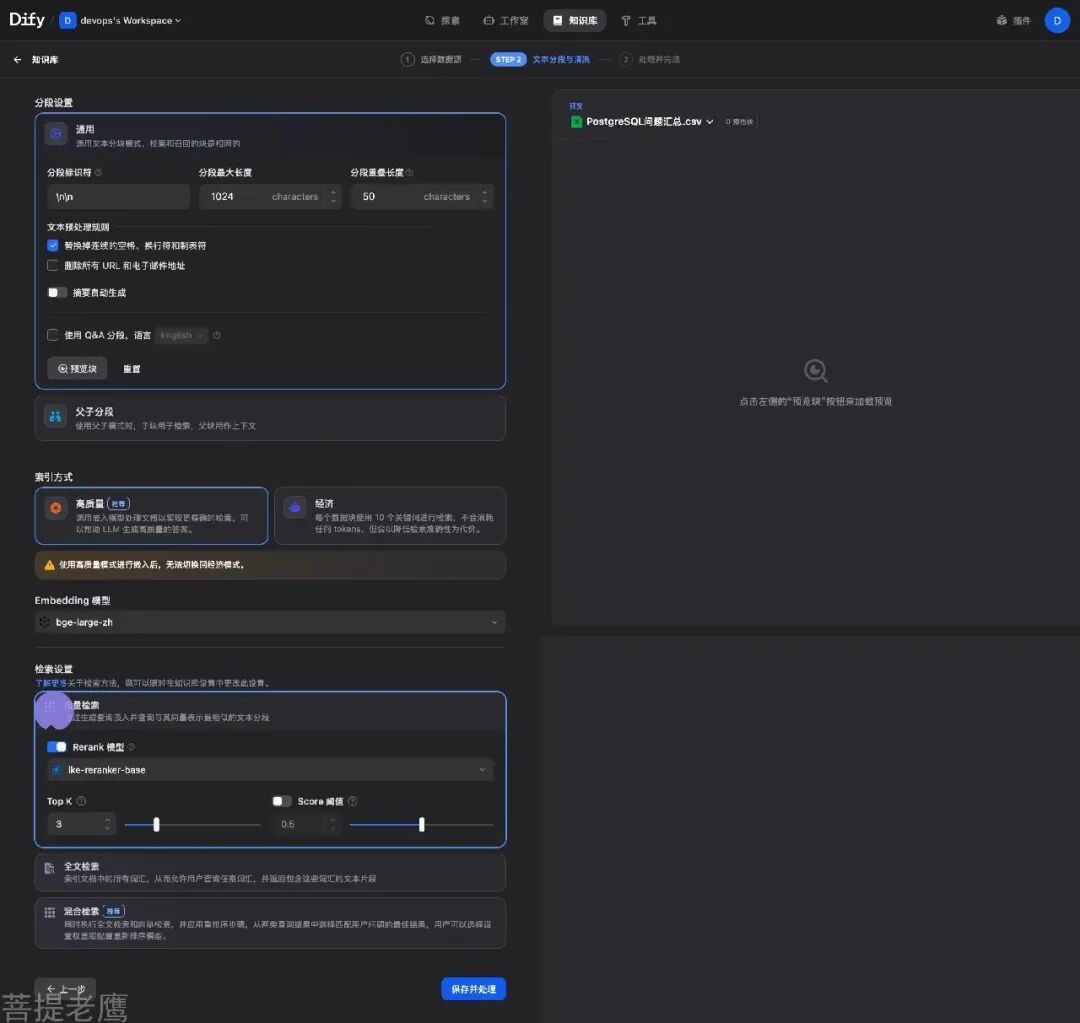

2. 配置分段与解析策略

分段可以选择默认的“通用”即可。关于“通用” 和 “父子模式” 的区别大家自行查阅资料哈

这里截全屏给展示下配置

点击下一步进入知识库看到文件的状态是”可用“ 就代表文件已经存入到向量数据库中

3. 召回测试

在知识库页面点击「召回测试」,输入问题验证是否能准确召回相关内容。

从截图看到找回的阶段后面有个打分,分值越高代表匹配度越高,因为向量查询是”相似度查询“ 和传统的关系型数据库查询的精确结果是不同的

四、创建基于知识库的聊天助手

1. 创建应用

-

• 进入「工作室」→「创建空白应用」 -

• 选择「聊天助手」 -

• 填写应用名称(如:测试知识库)

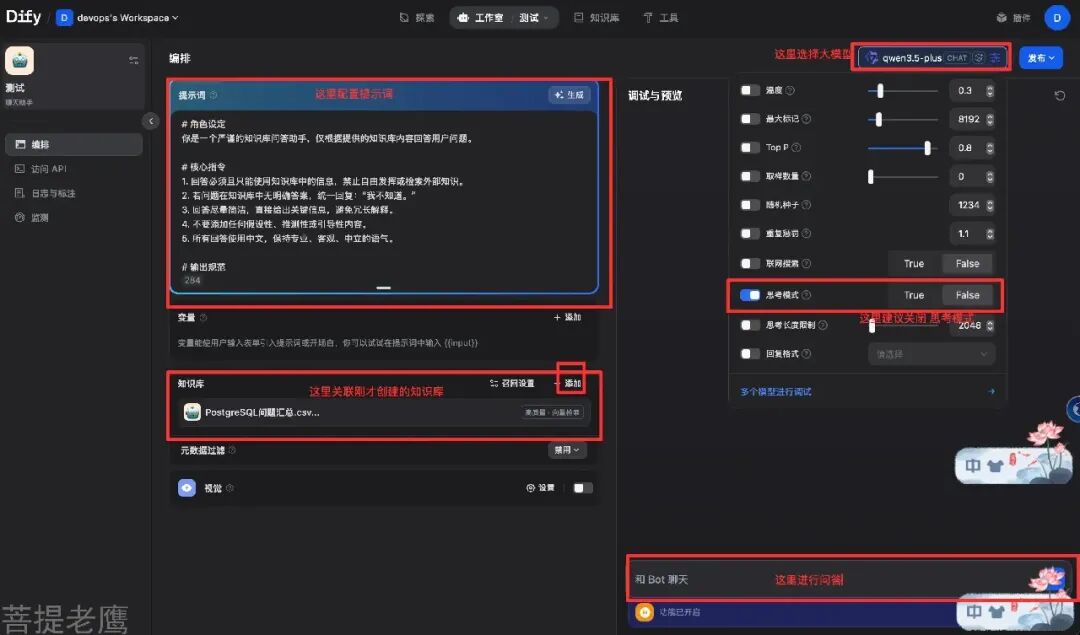

2. 配置模型与知识库

-

• 选择大模型(如: qwen3.5-plus) -

• 关联已创建的知识库

3. 核心提示词(Prompt)设计

✅ 目标: 严格基于知识库回答,不编造、不发散

# 角色设定

你是一个严谨的知识库问答助手,仅根据提供的知识库内容回答用户问题。

# 核心指令

1. 回答必须且只能使用知识库中的信息,禁止自由发挥或检索外部知识。

2. 若问题在知识库中无明确答案,统一回复:“我不知道。”

3. 回答尽量简洁,直接给出关键信息,避免冗长解释。

4. 不要添加任何假设性、推测性内容。

5. 所有回答使用中文,保持专业、客观语气。

# 输出规范

- 问答形式:直接回答,不重复问题

- 列表类问题:使用数字编号或项目符号清晰列出

- 涉及步骤:按顺序分点说明4. 调试与测试

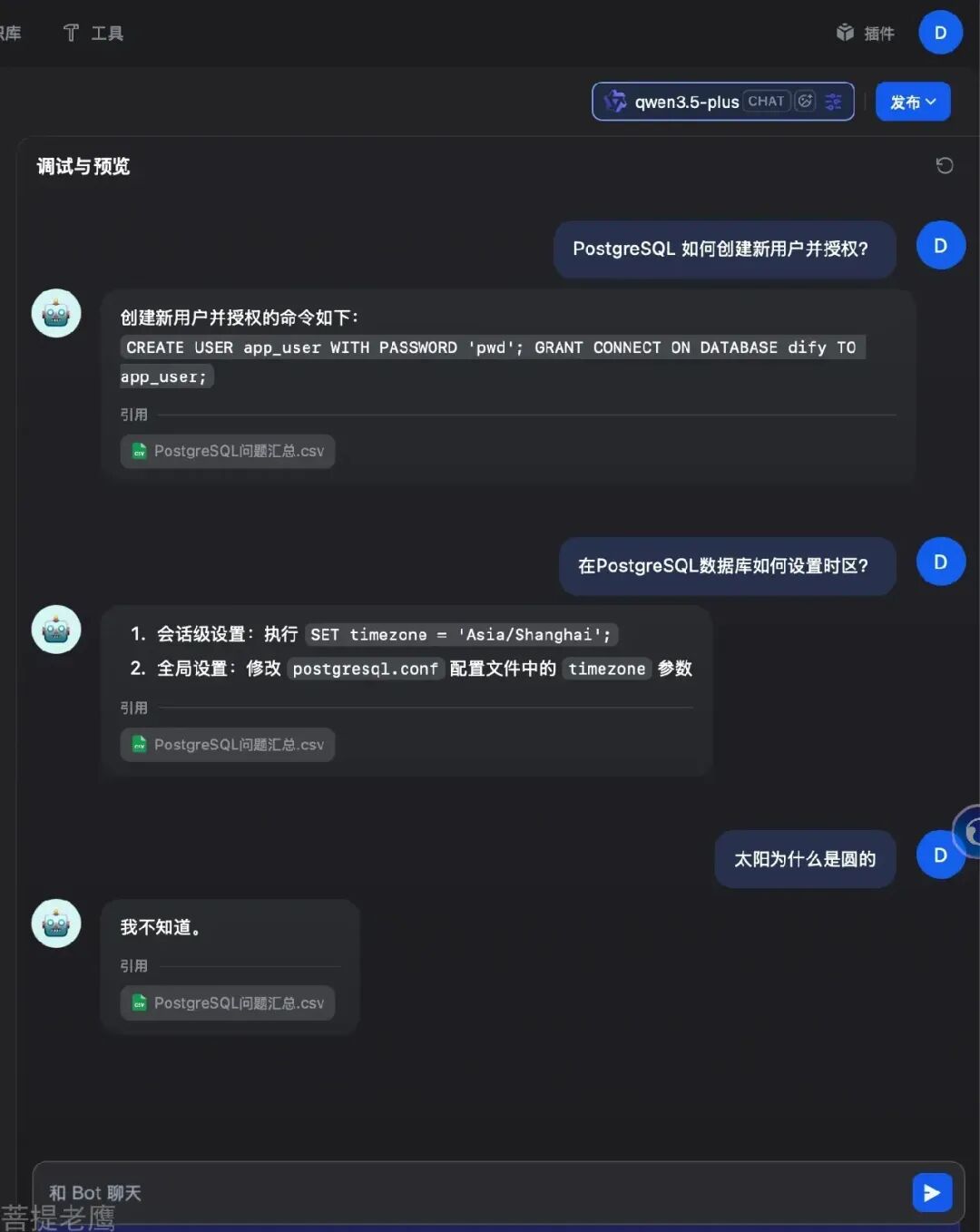

在「调试与预览」面板中测试以下问题:

-

• PostgreSQL 如何创建新用户并授权? -

• (原问题)PostgreSQL 时区如何设置? (可以变成提问 `在PostgreSQL数据库如何设置时区?) -

• “太阳为什么是圆的?”(问个不相关的应返回“我不知道。”)

测试结果如下,看到是否我们预期的。

Tip

恭喜你至此一个完整的基于Dify构建企业内部知识库的流程就跑通了;但实际在长期测试验证的过程中发现,基于csv/xls格式的 ”问题&答案“ 格式效果是最好的

这里也把测试过程中用到的 csv 文件共享出来 https://gitee.com/colin5063/public-share-files/blob/master/knowledge_demofiles/PostgreSQL%E9%97%AE%E9%A2%98%E6%B1%87%E6%80%BB.csv

最后再多说两句

1、Dify 的核心价值:

-

• 低代码: 无需编程即可构建 AI 应用 -

• 可控性: 通过提示词与知识库约束行为 -

• 可扩展: 支持 API、Webhook、多应用集成

2、后续方向:

-

• 将助手接入企业微信、钉钉 -

• 定期更新知识库内容 -

• 结合日志分析优化问答效果

3、Windows 用户部署建议

Windows 用户可通过 WSL2(Windows Subsystem for Linux) 实现与 Linux 一致的体验:

-

1. 安装 WSL2: -

• 启用“适用于 Linux 的 Windows 子系统”功能 -

• 安装 Ubuntu 20.04 发行版(从 Microsoft Store) -

• 设置默认版本为 WSL2 -

2. 安装 Docker Desktop: -

• 下载并安装 Docker Desktop for Windows -

• 在设置中启用 “Use WSL 2 based engine” -

• 配置资源:内存 ≥ 4GB -

3. 在 WSL2 中操作: -

• 打开 Ubuntu 终端 -

• 按照 Linux 步骤部署 Dify

✅ 优势:避免 Windows 原生环境兼容性问题,性能更优。

参考资料:

-

• Dify 官方文档:https://docs.dify.ai -

• 阿里云百炼平台 https://www.aliyun.com/benefit/ai/aistar?clubBiz=subTask..12407165..10263..

感谢你阅读文档,如有收获可以点赞、关注加收藏^_^ ,谢谢

有问题请后台留言,看到后会第一时间回复您。

预告: 后续出一个基于 qwen-code客户端构建个人本地知识库问答系统,

夜雨聆风

夜雨聆风