Claude被特朗普封杀,反而登顶App Store

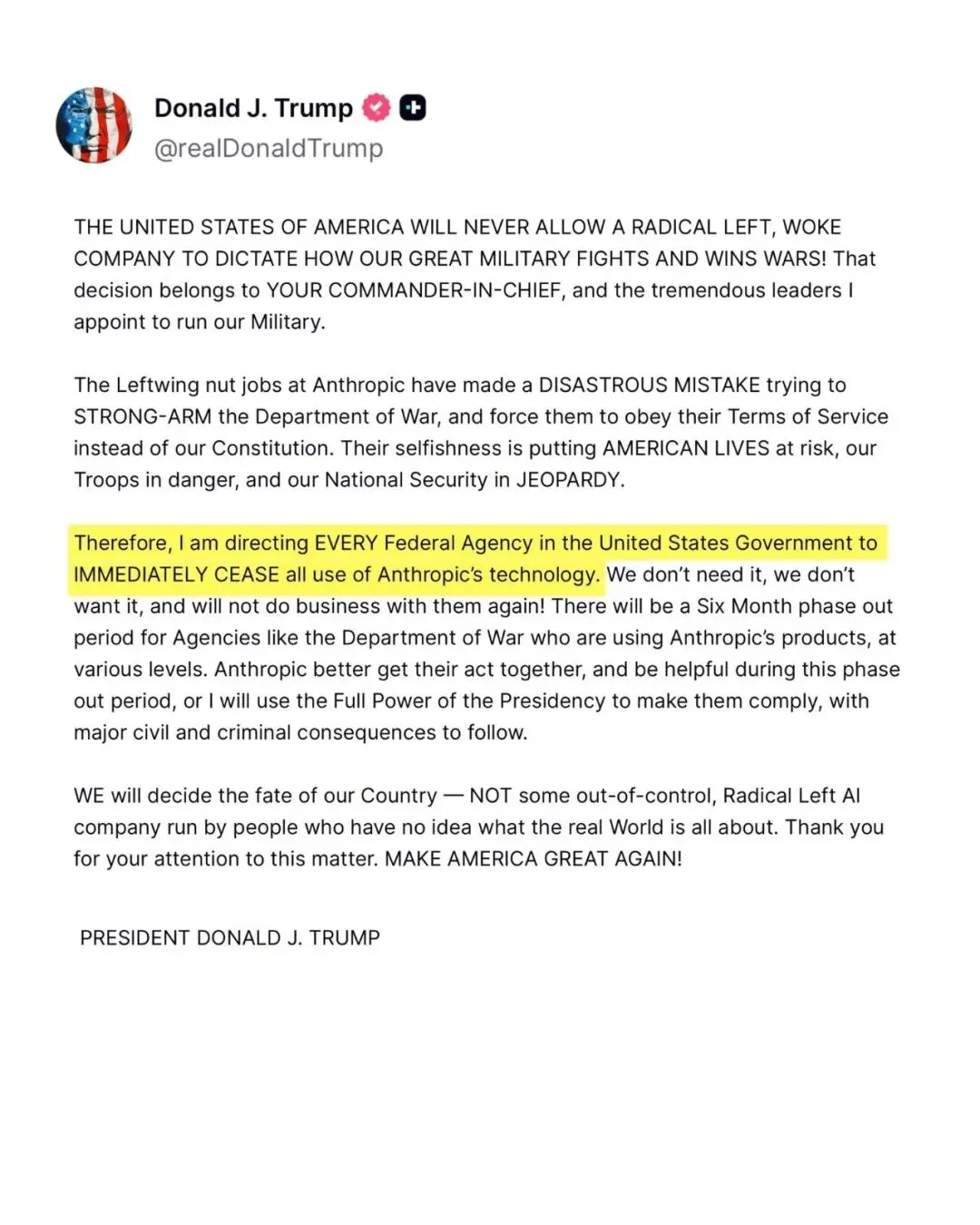

刷到Claude被封杀的新闻时,我正在改一篇文章。 第一条新闻是特朗普下令,白宫宣布所有联邦机构立即停用Anthropic技术。然后我看到国防部长Hegseth在X上的发文,直接把Anthropic列为”供应链国家安全风险”。 这个标签通常只用于敌对国家的企业,现在却用在了美国本土公司身上。 然后我继续往下看,发现事情没那么简单。这背后是一个2亿美元的合同,两条不能退让的红线,和一场关于AI使用底线的博弈。 2亿美金的最后通牒 事情得从2025年7月说起。那时候Anthropic和美国国防部签了个合同,金额上限2亿美元。Claude成为首个部署在五角大楼机密网络里的前沿AI模型,而且是唯一一家获得这个资质的AI公司。 禁止用于对美国公民的大规模监控

禁止用于全自主武器系统

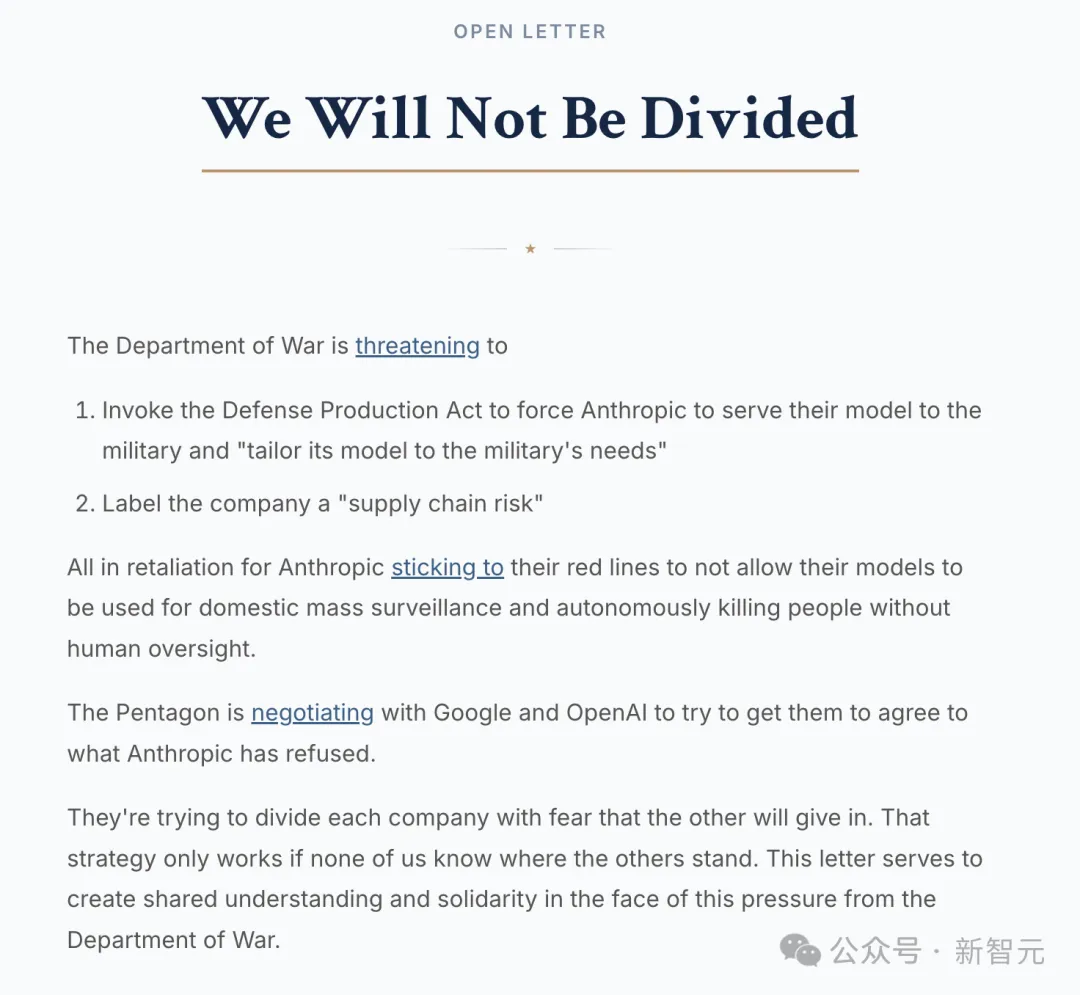

但问题是,五角大楼后来在推行一个新条款:”所有合法用途”。 意思就是,只要军方判定某项AI用途符合现行法律,供应商不得设限、不得干预。 OpenAI、谷歌、xAI都表示原则接受了,但Anthropic拒绝了。 因为Anthropic觉得”合法”这个词在当前法律框架下边界太模糊。 举个例子。现行法律允许政府收集所有公开数据,包括社交媒体内容、持枪证记录、集会活动记录。这些在今天完全合法。但AI接入后,处理速度和规模会发生质变,而法律还没有为此做出新的限制。 Anthropic要求在合同里明确排除这两种用途。五角大楼拒绝了。 两条红线:为什么不退让 2026年2月25日,国防部长Hegseth在五角大楼和Anthropic CEO Dario Amodei当面会谈。 Hegseth下了最后通牒:如果Anthropic不接受”所有合法用途”条款,将面临合同终止、供应链风险标签或援引《国防生产法》三种处置。截止时间是2月27日下午5:01。 第二天深夜,Amodei公开声明:Anthropic不会妥协。 他们在声明中明确表示,在与军方的合作谈判中,依旧坚持在Claude使用上保留两大”禁区”: 禁止大规模监控美国公民

禁止将模型用于全自动武器

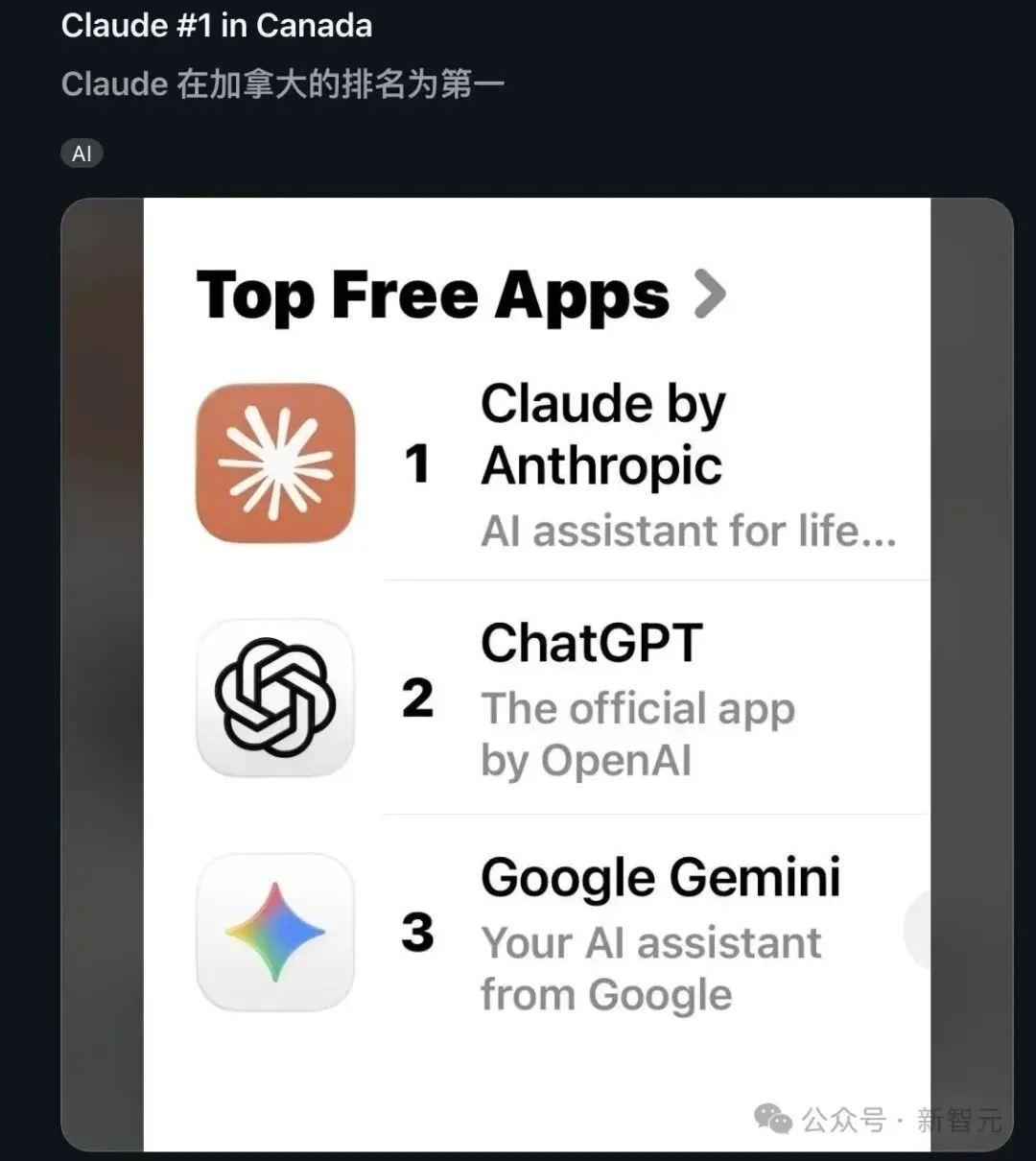

这两道关乎技术伦理的红线,导致双方长达数月的谈判彻底谈崩。 Anthropic还强硬表示,现有的前沿AI模型根本不够可靠,拿去搞”杀人机器”只会威胁到人们的安全。 面对国防部的重压和”供应链风险”的封杀威胁,Anthropic毫无惧色,甚至直接宣布:任何恐吓都别想让我们低头,如果你们真敢这么干,咱们法庭见。 封杀令下达后的戏剧性变化 2月27日下午4点,特朗普在五角大楼截止时间约一小时前,率先在Truth Social发文,下令所有联邦机构立即停止使用Anthropic技术,同时给予六个月过渡期。 下午5:30,Hegseth宣布将Anthropic列为”供应链国家安全风险”。 这意味着什么?价值2亿美金合同泡汤不说,所有联邦机构必须立即停止使用Claude。更重要的是,任何与美军有业务往来的承包商、供应商或合作机构,都必须证明自己在涉军业务中没有使用Anthropic的产品。 Anthropic今年计划IPO,目前估值约3800亿美元,年收入约140亿美元。2亿美元的直接合同损失占比有限,但供应链标签对企业客户的传导效应才是真正的威胁。 Claude被全面封杀24小时后,冲上了美国App Store免费榜第一。SensorTower数据显示,Claude的晋升之路堪称奇迹:1月底还在百名开外,2月大部分时间在20名左右徘徊。周三第6,周四第4,到了周六直接摘得冠军。 更夸张的是,Anthropic旧金山办公楼外的人行道上,有人用粉笔画满了爱心,甚至有人写下”感谢不造天网”的字样。 OpenAI的选择:对比之下的人心向背 就在Anthropic被”封杀”的同时,劲敌OpenAI迅速补位,官宣与五角大楼达成协议。 今早的官宣,OpenAI更是把拿下大单的承诺,白纸黑字全部亮了出来。而且,自认为比Anthropic做得更好,他们要守住”三道红线”: 禁止大规模国内监控

禁止主导自主武器系统

禁止高风险自动化决策

虽然奥特曼试图通过社交媒体”粉饰太平”,承诺不参与监视,但政府官员的强硬表态迅速揭穿了这一幻象。 我对比了一下两家公司的合同差异,发现一个关键点:OpenAI保留了”所有合法使用”这一条款,并将AI的使用置于适用法律之下。而Anthropic恰恰拒绝了这一点。 美国现行法律尚未对AI进行适当监管,这意味着:实际上,OpenAI给了政府一张通行证,任其在如今这片灰色地带肆意行事。 OpenAI只是在装”假好人”、博取路人同情:他们签署的正是Anthropic所拒绝的内容。 公众用脚投票:Claude登顶App Store背后的信号 OpenAI的做法在全网掀起了”排山倒海”般的抗议。无数用户晒出注销ChatGPT Plus会员的截图,怒斥其背弃了”造福人类”的初衷。 在Reddit上,涌现出大量注销订阅的截图。愤怒的用户正用脚投票,将奥特曼视为技术圈的”超级反派”。 还有人在同一时间,取消了ChatGPT订阅了Claude。 有人担心ChatGPT聊天记录无法迁移,网友们还为此出谋划策——只要导出你的数据(设置 > 数据控制 > 导出),Memory Forge就能把它转换成Claude可读取的上下文文件。这样一来,你以前所有的聊天记录就都能带过去了。 而在CBS的独家专访中,Dario Amodei被问及”你现在最想对总统说什么”时,他毫不犹豫地回答:我们是爱国的美国人。我们所做的一切都是为了这个国家。 Anthropic之所以寻求将Claude用于军事用途,是因为”我们是美国人,爱美国”,也”相信这个国家”。 他们是首家获得涉密军事系统许可的AI实验室,也希望帮助作战人员。但五角大楼的要求太激进,无限制地获取完全自动化的武器,并大规模监控美国公民,这是Anthropic不能忍的。 硅谷的态度:636名员工的联名信 这场关于”AI战争底线”的极致博弈,让整个硅谷都炸了。 在一封联名信下面,已有636名OpenAI和谷歌员工,署上了自己的名字。 信中,他们明确表示——我们诚挚地希望,公司领导层能够暂时放下彼此竞争的分歧,团结一心。请继续顶住压力,坚决拒绝战争部目前提出的无理要求,即索要权限将我们的模型用于国内大规模监控,或在缺乏人工监管的情况下自主剥夺生命。 周四晚间,奥特曼向全体员工发送备忘录明确表态:OpenAI将守住与Anthropic相同的红线。 他直言不讳地指出,事情发展到这一步,早就超越Anthropic一家公司的范畴,演变成了关乎整个AI行业的重大议题。 与此同时,他重申了OpenAI的长期信念——AI决不能被用于大规模监视或自主杀伤性武器,并且高风险的自动化决策必须保留人类干预。 还有谷歌首席科学家Jeff Dean,也公开表示,大规模监控违反了法案,并对言论自由产生了寒蝉效应。 苹果MLX之父Awni Hannun对此大加赞扬:说到容易,做到难,尤其是你需要为此付出巨大代价时。 HuggingFace创始人也发表了一句内涵的话。 就连消失许久的Ilya Sutskever突然现身,公开点赞Anthropic、OpenAI:在关键问题上没有退缩极其难得。 更深层的思考:技术伦理该由谁界定 这场博弈没有真正的赢家,但如果AI真的彻底拆除了安全护栏,全人类都将成为输家。 硅谷这团火能不能顶住华盛顿的风,接下来,拭目以待。 但我觉得,这件事真正改变的,不只是榜单顺序,而是公众对AI公司的期待。 人们不再只关心模型更强、更快,而开始追问:当技术可以监视亿万人、控制无人武器时,你站在哪一边? 也许,Claude的爆火终会回归常态,OpenAI的争议也会淡去。 但从这一刻起,AI巨头已无法再躲在”技术中立”的外衣之下。在权力与安全之间,每一家AI巨头,都必须选择自己的位置。 我之前在文章里写过,当AI足够强大时,它会引发一系列关于责任、边界、伦理的深层问题。 这次Claude封杀事件,就是这些问题的集中爆发。 我们天天在讲AI工具多好用,AI能提高多少效率,AI如何改变工作方式。但当这些工具足够强大时,它们的使用边界应该由谁来决定? 是技术公司自己?是政府?还是需要更广泛的社会讨论? Anthropic的做法是给出了一个答案:有些底线,即使要付出巨大代价,也不能退让。 五角大楼也不是没有道理。他们担心的是,如果对手国家开发出自主武器系统,美国会不会落后? 五角大楼首席技术官Emil Michael说:”在某种程度上,你必须相信军队会做正确的事情。” 为了做好未来的准备,他说:”我们绝不会在合同中向一家公司写明我们将无法自我防卫。” 作为折中方案,军方曾提出以书面形式确认联邦法律和军方政策中对大规模监控与自主武器的限制。 但Anthropic方面回应称,这些承诺”附带复杂的法律措辞”,实际上为绕开护栏留下了空间。 我琢磨了很久,觉得问题的核心可能在于:技术跑得太快,而法律和伦理的讨论没有跟上。 Dario Amodei在CBS专访里提到,大规模监控之所以构成风险,是因为借助AI,一些过去做不到的事情现在可能变得可行,而这项技术的能力”正在跑在法律前面”。 理论上,AI也可以被用于驱动完全自动武器系统——由机器自行选择目标并实施打击,完全无需人工干预。 Amodei表示,Anthropic并非在原则上完全反对这类武器,尤其是在美国对手国家可能开发类似系统的情况下;但”目前的可靠性还不够”,而且”我们必须就监管和监督展开严肃讨论”。 由于AI本身仍存在幻觉和不确定性,Anthropic担心自主武器可能因误判而攻击错误目标。 更重要的是,与由人类操控的武器不同,一旦完全自主武器做出决定,责任归属并不清晰。 他说,”我们不希望出售我们认为不可靠的产品,也不希望出售可能导致我们自己的人或无辜平民丧命的技术。” 想想看,如果AI因为幻觉误判了一个目标,或者因为训练数据的偏差做出了错误的决策,导致无辜的人死亡,这个责任该由谁承担? 是开发AI的公司?是使用AI的军方?还是AI本身? 而且,一旦全自动武器系统部署,责任链条就断了。因为人类不在决策环节里,你很难说这是谁的错。 这可能就是为什么Anthropic要在合同里明确写这两条红线的原因。他们担心的是,如果现在不在合同里写清楚,未来出了事,责任就说不清了。 而OpenAI的做法,我理解他们的商业逻辑,但说实话,我有点失望。 他们保留了”所有合法使用”条款,把AI的使用置于适用法律之下。这听起来没问题,但问题是,现行法律对AI的监管几乎是空白。 这意味着什么?意味着OpenAI给政府开了一张空白支票。 只要法律没明确禁止的事,政府都可以用AI做。而法律要跟上技术的速度,可能需要很多年。 公众用脚投票的结果也说明:人们希望看到技术公司有原则,而不只是逐利机器。 Claude被全面封杀24小时后登顶App Store,这个反直觉的现象本身就说明了很多问题。 人们不是在为被封杀买单,而是在为一个敢于说”不”的公司买单。 Anthropic办公楼外的那些粉笔字,那些爱心,那些”感谢不造天网”的留言,都在表达同一个意思: 随着AI越来越强大,这样的冲突只会越来越多,而不是越来越少。 未来可能不只是监控和武器的问题,还可能涉及隐私、就业、信息操纵等更多层面。 每一家AI公司,都需要问自己一个问题:当技术足够强大时,你愿意为了原则放弃利益吗? 但我想,至少Anthropic已经给出了他们的答案。 而这个答案,让636名硅谷员工站了出来,让无数用户用脚投票,让Claude在封杀中爆火。 既然看到这里了,如果觉得不错,随手点个赞、在看、转发三连,如果想第一时间收到推送,也可以给我个星标⭐~谢谢你看我的文章!

#ai自媒体 #ai副业案例拆解#ai实操技能#国产ai#ai

—点击上方卡片关注我—

我是小王,一名👨🏫高校教师,🎖️陕西省技术能手,人社部认证的互联网营销师(技师 )、工信部认证人工智能应用工程师、高级电子商务师,更是一位终身学习者📖,一直在成长路上狂奔🏃♂️。

📌目前专注于 “AI工具应用实战教程” 。

在这里,💡为普通人分享用得上的 AI工具应用实战教程、以及最新的行业资讯。

不管你是想提升技能💪,还是了解资讯📋,都能在这找到属于你的宝藏。

夜雨聆风

夜雨聆风