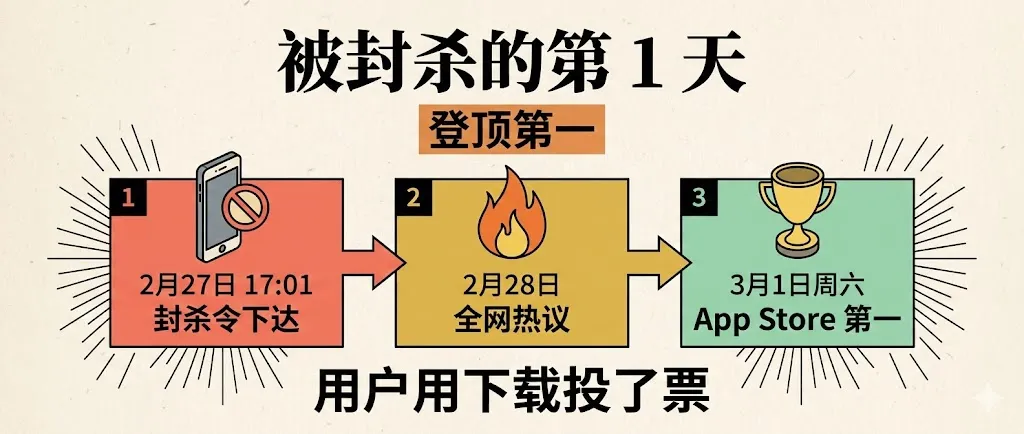

Claude登顶App Store第一!被白宫封杀24小时后,用户用下载投了票

⭐️关注星标,收看AI、商业新知

Claude登顶App Store了。

不是第二,不是前五,是三榜第一,应用榜、效率榜、总榜。

超过ChatGPT,超过Gemini,超过所有你叫得出名字的App。

更夸张的是,这发生在它被白宫封杀之后。

48小时前,美国总统亲自下令,所有联邦机构立即停用Anthropic的一切产品。

措辞罕见地激烈。

国防部长紧跟着把它列为供应链安全风险,这个标签平时只给敌对国家的企业用。

一家被白宫封杀的AI公司,用户用下载投了票。

这不是偶然。这是用户在用行动回答一个问题:当技术能力越来越像,你凭什么让我选你?

不是越强越赢,而是越像用户越赢

先来看一组数据。

1月30日,Claude在美国App Store排名131。2月大部分时间在20名开外晃悠。

然后是一路飙升:周三第6,周四第4,周六第1。

这是ChatGPT自去年4月以来首次让出榜首。

Anthropic官方确认:

本周每天的注册量都在创造历史纪录。免费用户比1月增长了60%,付费订阅翻了一倍多。

讽刺吗?这波增长的起点,正是封杀令下达的那一刻。

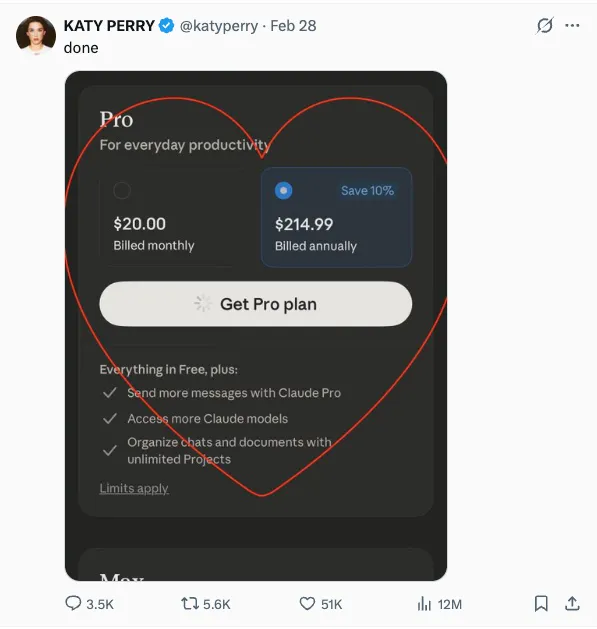

水果姐Katy Perry在X上晒出Claude Pro订阅截图,就贴了个红心,配文”done”。

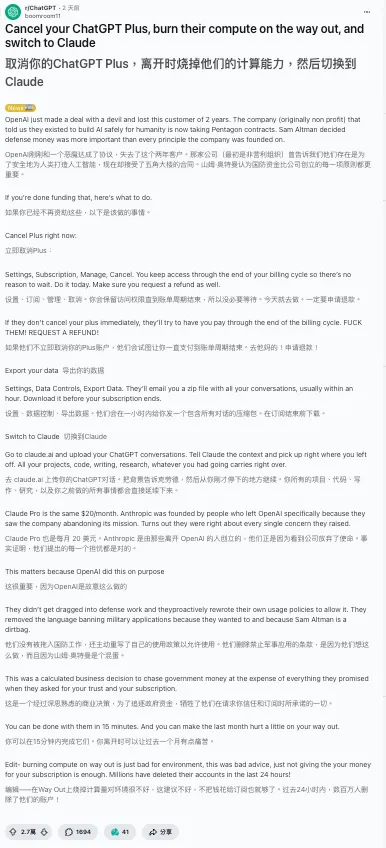

Reddit的ChatGPT社区,”Cancel ChatGPT”的帖子收获3万赞。

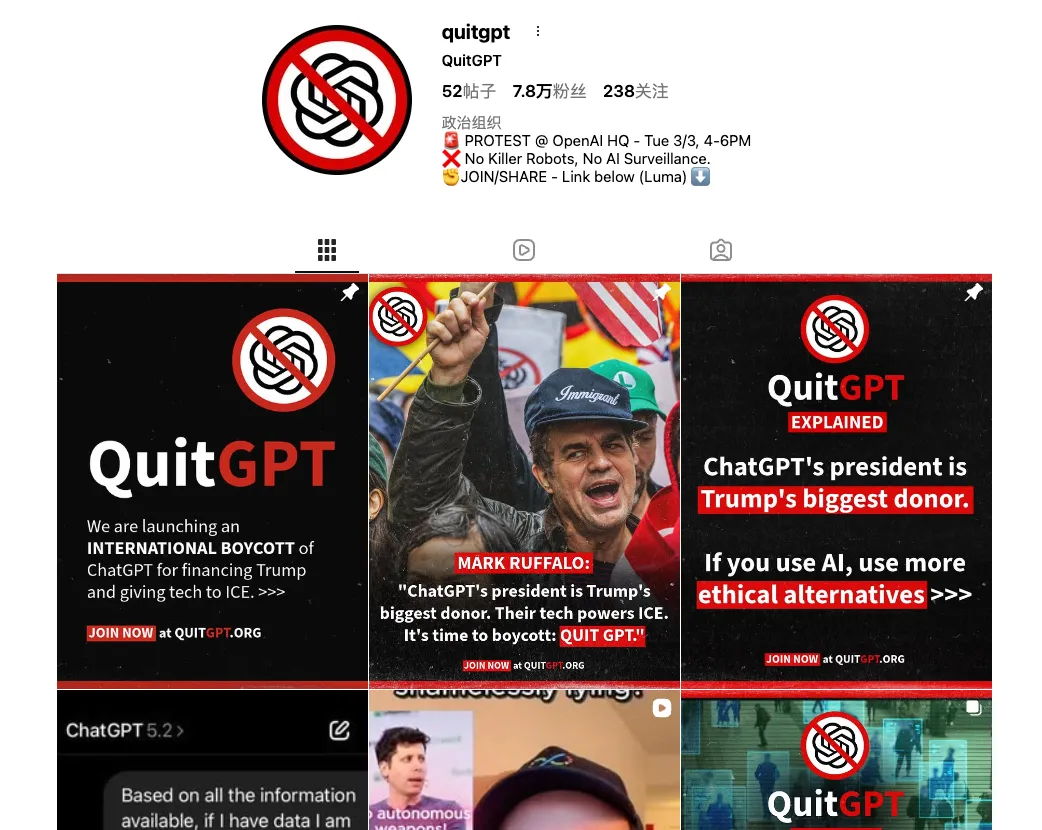

Instagram账号”quitGPT”数周内涨粉数万。

你发现了吗?

用户不是在换工具,是在换认同。

不是Claude变强了,而是Anthropic更像他们想成为的那种公司。

不是不能合作,而是不能无底线合作

故事要从五角大楼说起。

2024年6月,Anthropic成为首家在美国政府机密网络部署AI的公司。

2025年7月,拿到Pentagon价值数亿美元的合同。

它本来可以闷声发财。

但Pentagon想要更多,为一切合法目的使用,别给我设限。

翻译一下:买了你的工具,怎么用我说了算,你别多嘴。

Anthropic说可以合作,但有两条红线不能碰:

第一,不能用于对美国公民的大规模监控。

第二,不能用于完全自主的致命性武器。

五角大楼不理解:你一家私企凭什么给军方划线?

谈判僵持数月。2月27日,国防部长Pete Hegseth下最后通牒:下午5:01前放弃限制,否则后果自负。

Anthropic CEO Dario Amodei回了句话:

威胁改变不了我们的立场。我们凭良心无法答应。

Anthropic CEO Dario Amodei

你看,不是不能赚钱,而是不能赚没底线的钱。

不是没人妥协,而是妥协的人输了信任

拒绝之后,事态升级速度超出所有人预期。

政府高层的公开批评接踵而至,Hegseth宣布将Anthropic列为供应链安全风险。

这个标签历史上只用于美国的对手国家,第一次用在本土公司身上。

如果严格执行,亚马逊、谷歌、英伟达这些投了数百亿美元的公司,理论上可能被迫撤资。

Anthropic的回应是:法庭上见。

封杀令下达当晚,OpenAI CEO Sam Altman发了篇长文:OpenAI和五角大楼达成协议,将在涉密网络部署ChatGPT。

好家伙,直接截胡。

Altman说:我们最重要的两条安全原则是,禁止大规模国内监控,以及人类对武力使用的责任。

国防部同意这些原则,并将其写入协议。

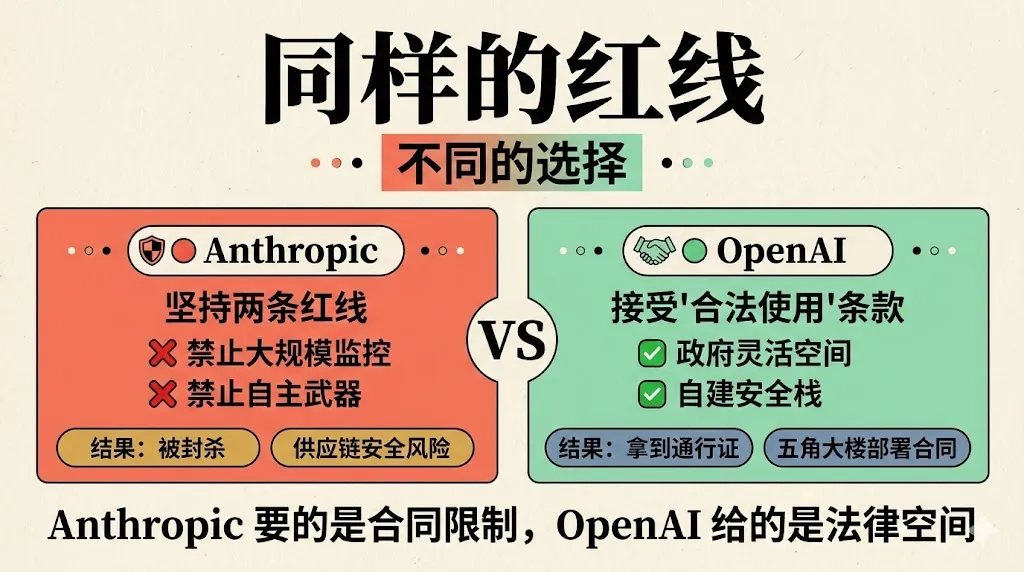

Anthropic因为坚持这两条原则被封杀,OpenAI带着几乎一模一样的条款签了约。

区别在于OpenAI的合同里有一句所有合法使用,而美国目前还没有针对AI监控和自主武器的专门法律。

换句话说,Anthropic要的是合同上的明确限制,OpenAI给的是法律框架下的灵活空间。

更微妙的是,Sam Altman在全员大会上透露,政府愿意让OpenAI构建自己的安全栈,如果AI拒绝执行违反安全原则的指令,政府不会强迫。

同样的红线,Anthropic得到了禁令,OpenAI拿到了通行证。

用户不是傻子。他们看得懂什么叫真坚持,什么叫假姿态。

不是一个人在战斗

封杀令放出后,整个硅谷都炸了。

Ilya Sutskever罕见现身,公开点赞Anthropic:在关键问题上没有退缩极其难得。

Sam Altman之前也曾表态:我个人认为五角大楼不应该威胁这些公司,Anthropic确实关心安全。

然后在内部邮件里写:这不再只是Anthropic和国防部之间的事了,这是整个行业的事。

然后他签下了合同。

你看,不是不知道该怎么做,而是知道了却做不到。

不是技术赢了,而是价值观赢了

被全面封杀后,Dario Amodei在CBS专访中首度露面。(来源)

镜头里的他,能看出这段时间的压力。但谈及原则,他说:

我们有两条红线,从公司成立第一天起就存在。我们不会在这些问题上退让。

Dario Amodei

不是因为它的政治含义,而是因为它代表了一种姿态:在权力面前,企业可以、也应该有自己的原则。

Claude的登顶不是偶然。过去一年,AI模型的性能差距在缩小。Claude、ChatGPT、Gemini,在大多数任务上都能给出不错的答案。

用户选择谁,越来越不取决于谁更聪明,而取决于谁更像我。

Anthropic坚持的两条红线,禁止大规模监控、禁止自主武器,恰好击中了很多人的价值共识。

这可能就是AI行业竞争的新常态:当技术能力拉平,价值观成为最显性的差异化。

用户在乎的不只是 AI 能做什么,还有 AI 公司愿意为什么说不。

在这个技术能力快速迭代、法律监管严重滞后的时代,这种说不的能力,或许比任何功能更新都更有价值。

因为最终,不是最强的那家赢得市场,而是最像用户想成为的那个自己。

⭐️关注星标,收看AI、商业新知

夜雨聆风

夜雨聆风