被特朗普封杀24小时,Claude登顶App Store第一

我刚看到这个消息的时候,以为是假的。

一家AI公司,被美国总统亲自下令封杀,被国防部列为”供应链威胁”——这个待遇,以前是给华为的。

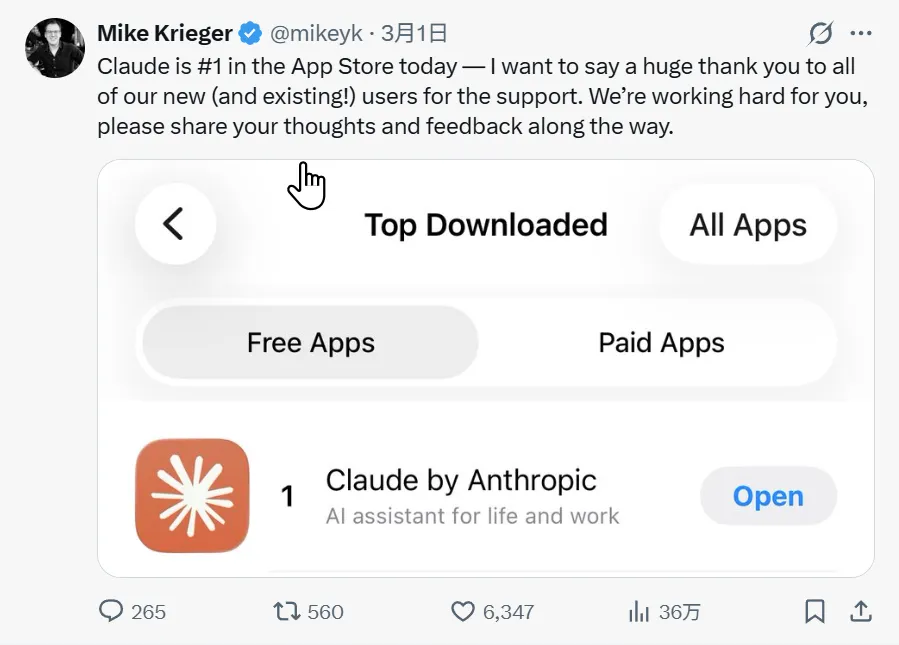

结果呢?封杀令下来24小时,Claude直接冲上美国App Store免费榜第一。

不是冲到前十,不是前五。是第一。

先说清楚这事的来龙去脉

事情的核心其实就一句话:五角大楼想要Anthropic的AI技术,但Anthropic在合同里画了两条红线——不搞大规模监控,不做自主武器。

五角大楼不接受。谈崩了。

特朗普随即下令,要求联邦机构六个月内全面停用Anthropic的技术,国防部长Hegseth更狠,把Anthropic列为”供应链风险”。

这意味着什么?不只是丢了政府订单。所有跟军方有业务往来的公司,都可能被要求切断与Anthropic的合作。芯片、算力、资金链——全部可能被卡脖子。

这个待遇,以前是留给对手国家的。据多家媒体报道,Anthropic是首家被以”供应链风险”为由进行管制的美国AI公司。

OpenAI的”完美补刀”

故事到这里已经够炸了。但真正引爆全网情绪的,是OpenAI的操作。

就在Anthropic被封杀的同一时间,OpenAI火速官宣:我们跟五角大楼签了。

而且奥特曼还特别强调,OpenAI也有”三条红线”——禁止大规模监控、禁止自主武器、禁止高风险自动决策。

听起来跟Anthropic差不多对吧?

但魔鬼在细节里。

OpenAI的合同保留了一个关键条款:”所有合法使用”。也就是说,只要现行法律没明确禁止,政府想怎么用就怎么用。

问题是,美国现行法律根本还没来得及对AI进行系统性监管。大规模AI监控到底合不合法?自主武器决策的边界在哪?这些全是灰色地带。

本质上,OpenAI在合同中保留了”所有合法使用”的弹性条款——在AI监管立法几乎空白的当下,这个”合法”二字能覆盖的范围,远比表面看起来大得多。然后在社交媒体上强调自己”也有红线”。

而Anthropic拒绝签的,恰恰就是这份弹性条款。

全网炸了

公众的反应比任何分析师预测的都猛。

Reddit上涌现出大量截图——用户晒出注销ChatGPT Plus会员的页面,配文基本都是一个意思:你要给五角大楼打工,我的钱一分都不给你了。

有人同一个截图里,左边取消ChatGPT订阅,右边订阅Claude。

甚至有人做了YouTube教程,教大家怎么把ChatGPT的聊天记录迁移到Claude——导出数据,用一个叫Memory Forge的工具转换格式,完事。

旧金山Anthropic办公楼外面的人行道上,被路人用粉笔画满了爱心,还有人写了一句话:”感谢不造天网。”

Dario Amodei首次露面:疲惫写在脸上,但立场没有一丝松动

封杀令之后,Anthropic CEO Dario Amodei接受了CBS独家专访。

这是他被封杀后第一次公开发声。

说实话,看采访画面,这人状态很差。但说出来的每句话都很硬。

“我们有两条红线,从公司成立第一天起就存在。我们不会在这些问题上退让。”

记者问他:你现在最想对总统说什么?

他的回答是:”我们是爱国的美国人。我们所做的一切都是为了这个国家。”

然后他说了一句很有力量的话:”与政府持不同意见,是世界上最美国的事情。”

Amodei的逻辑其实很清晰

他不是反对AI用于军事。事实上,Anthropic是第一家拿到涉密军事系统许可的AI实验室。他们愿意帮军方。

但他反对两件具体的事:

第一,大规模监控。AI让过去做不到的监控手段变得可行了,而法律还没跟上。Amodei的原话是:”这项技术的能力,正在跑在法律前面。”

第二,完全自主武器。不是说永远不行,而是现在不行。AI还有幻觉问题,还会误判。让一个会产生幻觉的系统自己决定打谁?Amodei说得很直接:”我们不希望出售可能导致我们自己的人或无辜平民丧命的技术。”

而且他提了一个关键问题:人类操控的武器,责任很清楚。全自主武器打错了,谁负责?这个问题目前没有答案。

五角大楼的回应也值得看

国防部首席技术官Emil Michael的表态很有意思。他说,联邦法律本来就禁止大规模监控,军方内部政策也限制自主武器,所以没必要把这些写进合同。

他的原话是:”在某种程度上,你必须相信军队会做正确的事情。”

还有一句更耐人寻味的:”为了做好未来的准备,我们绝不会在合同中向一家公司写明我们将无法自我防卫。”

翻译一下:我们现在不会这么干,但我们拒绝在合同里承诺未来也不这么干。

Anthropic说,军方确实提出过折中方案——以书面形式确认现行法律的限制。但这些承诺”附带复杂的法律措辞”,实际上为绕开护栏留下了空间。

所以谈崩了。

最讽刺的一幕

你知道最讽刺的是什么吗?

连OpenAI自己都认为,Anthropic不应该被列为”供应链风险”,并且向国防部明确表达了这一立场。

OpenAI签了那份合同,拿了那个大单,但连他们都觉得对Anthropic的处罚过了。

这说明什么?说明所有人都知道Anthropic的两条红线不过分。OpenAI自己也画了类似的线。区别只在于,OpenAI在合同里留了一个”所有合法使用”的弹性条款,而Anthropic没有。

一个留了弹性条款,一个没留。一个拿到合同,一个被列为国家安全威胁。

数据说话

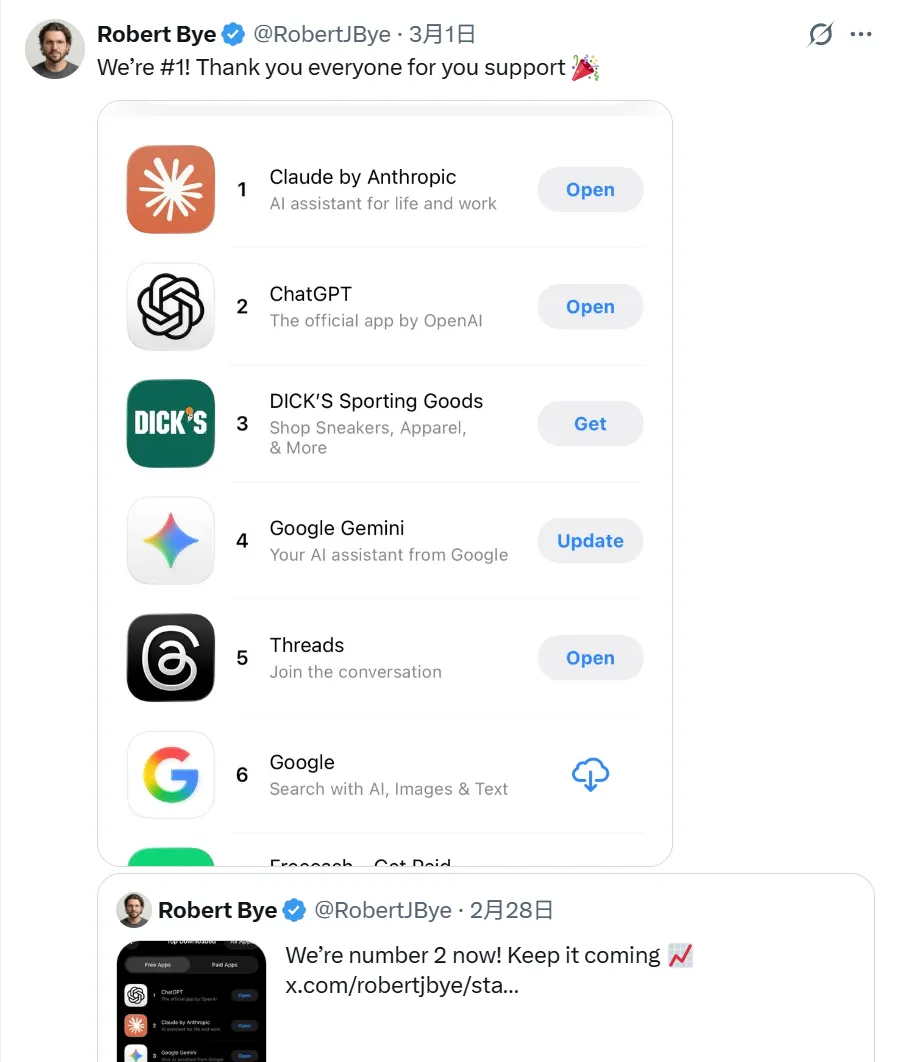

SensorTower的数据完整还原了Claude这波逆袭的轨迹:

1月底,App Store排名100名开外。

2月大部分时间在20名左右徘徊。

周三(2月25日)第6,

周四(2月26日)第4,

到了周六(2月28日)直接摘得第一。

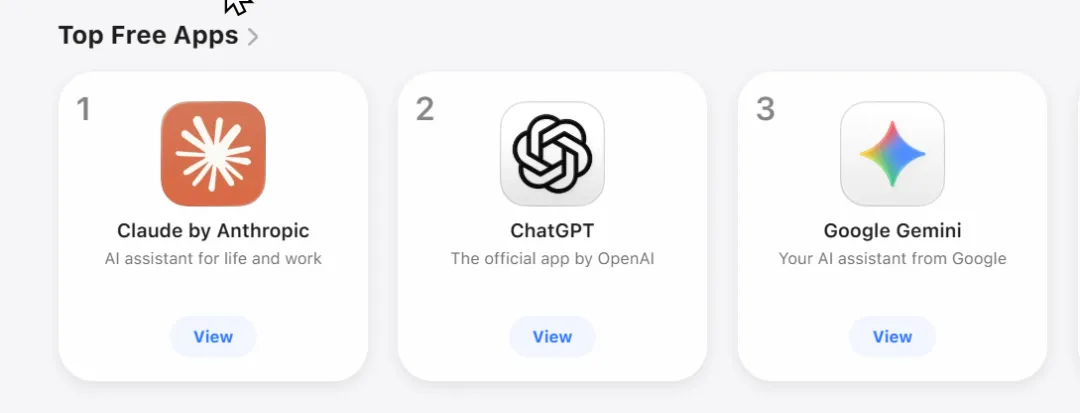

截至发稿时,美国App Store免费榜前三名分别是:Claude、ChatGPT、Gemini。加拿大App Store上,Claude同样排名第一。

这件事真正改变了什么

不是榜单排名。排名会回归正常。

真正改变的,是公众对AI公司的评判标准。

以前大家比的是模型强不强、快不快、便宜不便宜。从这周开始,一个新问题被永久性地摆上了台面:

当你的技术可以监视亿万人、可以让武器自己选目标的时候,你站在哪一边?

Anthropic用一份价值巨大的国防合同,给出了自己的答案。

从今天起,没有任何一家AI巨头,还能躲在”技术中立”四个字后面。

夜雨聆风

夜雨聆风