BettaFish源码解析(六):情感分析模型层

多模型融合的机器学习策略

前言

在前几篇文章中,我们分别讲解了BettaFish的整体架构、Agent论坛机制、GraphRAG知识图谱、报告生成引擎和分布式爬虫系统。这些组件构成了从数据获取到报告输出的完整闭环。

今天,我们深入解析BettaFish的”智能分析”核心——情感分析模型层。这是系统能够理解舆情情感倾向的基础设施。

本文将深入解析情感分析模型的设计,回答一个核心问题:

如何融合多种机器学习方法(微调大模型、传统ML、BERT),构建准确、高效、可扩展的情感分析系统?

一、多模型融合策略

1.1 传统单模型的问题

在深入设计之前,先理解传统方案的痛点:

| 问题 | 单一模型方案 | BettaFish多模型融合 |

|---|---|---|

| 准确率瓶颈 | 单一模型难以突破90% | 多模型投票/加权,提高上限 |

| 适用场景局限 | 长文本vs短文本难以兼顾 | 分工:大模型处理复杂文本,ML处理短文本 |

| 资源浪费 | 所有任务都用大模型 | 轻任务用ML,重任务用LLM |

| 可解释性差 | 黑盒模型,难以调试 | 传统ML可解释,作为验证 |

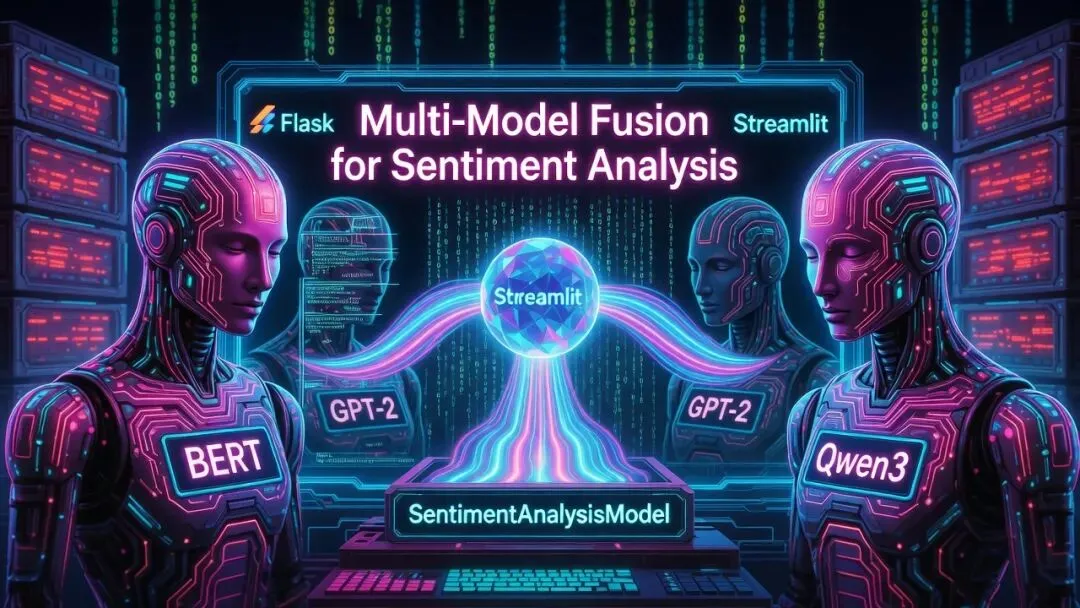

1.2 BettaFish的多模型体系

BettaFish采用”多层次、多策略”的模型体系:

情感分析模型层(SentimentAnalysisModel)├── 深度学习(Fine-tuned LLM)│ ├── BERT LoRA(bert-chinese-lora)│ ├── GPT-2 LoRA(gpt2-lora)│ └── Qwen3 LoRA(qwen3-lora-universal)├── 深度学习(Embedding + 分类头)│ ├── BERT Embedding + Linear│ └── Qwen3-Embedding + Linear└── 传统机器学习 ├── SVM ├── XGBoost ├── 朴素贝叶斯 └── LSTM

设计亮点:

-

分层使用:根据输入文本长度和复杂度选择模型

-

投票机制:多个模型结果加权投票

-

成本优化:简单文本用ML,复杂文本用LLM

-

可解释性:传统ML结果可作为验证基准

二、深度学习:LLM微调策略

2.1 BERT LoRA微调

BettaFish最早使用的方案,适合理解中文语境:

# SentimentAnalysisModel/WeiboSentiment_Finetuned/BertChinese-Lora/train.pyfromtransformersimport (AutoTokenizer,AutoModelForSequenceClassification,TrainingArguments,Trainer,DataCollatorForLanguageModeling)frompeftimportLoraConfig, get_peft_modelclassBertLoraTrainer:"""BERT LoRA微调器"""def__init__(self, model_path: str="bert-base-chinese"):# 1. 加载预训练BERTself.tokenizer=AutoTokenizer.from_pretrained(model_path)self.model=AutoModelForSequenceClassification.from_pretrained(model_path,num_labels=2# 二分类:正面/负面 )# 2. 配置LoRA参数lora_config=LoraConfig(r=8, # LoRA秩lora_alpha=16,target_modules=["q_proj", "v_proj"],lora_dropout=0.1,bias="none",task_type="SEQ_CLS" )# 3. 应用LoRAself.model=get_peft_model(self.model, lora_config)deftrain(self, train_dataset, epochs: int=3):"""执行微调"""training_args=TrainingArguments(output_dir="./output",num_train_epochs=epochs,per_device_train_batch_size=16,learning_rate=2e-5,weight_decay=0.01,logging_dir="./logs",logging_steps=10 )trainer=Trainer(model=self.model,args=training_args,train_dataset=train_dataset )trainer.train()

关键设计点:

-

LoRA而非全量微调:大幅减少训练参数(<1%),节省显存

-

秩8设计:平衡性能与效率

-

目标模块选择:只微调

q_proj和v_proj,避免过拟合 -

低学习率:

2e-5,避免破坏预训练知识

2.2 GPT-2 LoRA微调

适合处理长文本,支持序列生成:

# SentimentAnalysisModel/WeiboSentiment_Finetuned/GPT2-Lora/train.pyclassGPT2LoraTrainer:"""GPT-2 LoRA微调器"""def__init__(self):# GPT-2是因果语言模型,需要特殊处理self.tokenizer=AutoTokenizer.from_pretrained("gpt2")self.model=AutoModelForCausalLM.from_pretrained("gpt2")# GPT-2需要特殊配置LoRAlora_config=LoraConfig(r=8,lora_alpha=32,target_modules=["c_attn", "c_proj", "c_fc"],task_type="CAUSAL_LM" )self.model=get_peft_model(self.model, lora_config)defprepare_dataset(self, texts, labels):"""准备GPT-2数据集"""# GPT-2需要特殊的格式dataset= []fortext, labelinzip(texts, labels):# 情感标签转换为文本sentiment_text="正面"iflabel==1else"负面"formatted_text=f"文本:{text}\n情感:{sentiment_text}"dataset.append(formatted_text)returnself.tokenizer(dataset, truncation=True, padding=True)

为什么用GPT-2?

-

生成能力:可以生成”为什么这是正面的?”等解释

-

长文本处理:比BERT更适合处理长评论

-

指令跟随:可以用指令格式训练

2.3 Qwen3 LoRA微调(最新方案)

基于阿里Qwen3的性价比方案:

# SentimentAnalysisModel/WeiboSentiment_SmallQwen/qwen3_lora_universal.pyclassQwen3LoraUniversal:"""通用Qwen3-LoRA模型"""def__init__(self, model_size: str="0.6B"):# 支持0.6B、4B、8B三种规模self.config=QWEN3_MODELS[model_size] # 模型配置self.model_name=self.config["base_model"]self.device=torch.device('cuda'iftorch.cuda.is_available() else'cpu')def_load_base_model(self):"""加载Qwen3基础模型"""# 优先从本地加载local_model_dir=f"./models/qwen3-{model_size.lower()}"ifos.path.exists(local_model_dir):print(f"从本地加载: {local_model_dir}")self.tokenizer=AutoTokenizer.from_pretrained(local_model_dir)self.base_model=AutoModelForCausalLM.from_pretrained(local_model_dir,torch_dtype=torch.float16iftorch.cuda.is_available() elsetorch.float32,device_map="auto" )else:# 从HuggingFace加载self.tokenizer=AutoTokenizer.from_pretrained(self.model_name)self.base_model=AutoModelForCausalLM.from_pretrained(self.model_name)# 保存到本地避免重复下载os.makedirs(local_model_dir, exist_ok=True)self.tokenizer.save_pretrained(local_model_dir)self.base_model.save_pretrained(local_model_dir)# 配置pad_tokenifself.tokenizer.pad_tokenisNone:self.tokenizer.pad_token=self.tokenizer.eos_tokenself.tokenizer.pad_token_id=self.tokenizer.eos_token_id

为什么选择Qwen3?

| 特性 | BERT | GPT-2 | Qwen3-0.6B |

|---|---|---|---|

| 中文理解 | 优秀(预训练中文) | 一般(多语言但无侧重) | 优秀(专门优化中文) |

| 参数量 | 110M | 124M | 600M |

| 推理速度 | 快 | 中等 | 慢(但GPU可接受) |

| 训练资源 | 低(CPU即可) | 中等 | 高(推荐GPU) |

| 性价比 | ★★★ | ★★ | ★★★★★ |

Embedding vs LoRA对比:

| 方案 | 性能 | 灵活性 | 训练成本 | 推理速度 | 推荐场景 |

|---|---|---|---|---|---|

| Qwen3-Embedding + 分类头 | 较低 | 低 | 极低 | 极快 | 简单分类、资源受限 |

| Qwen3-0.6B + LoRA微调 | 高 | 高 | 较高 | 较慢 | 复杂情感、需要解释 |

三、传统机器学习:轻量级方案

3.1 多种传统ML方法

BettaFish保留了4种传统ML方法,作为”轻量级后备”:

# SentimentAnalysisModel/WeiboSentiment_MachineLearning/predict.pyclassSentimentPredictor:"""情感分析预测器"""def__init__(self):self.models= {}self.available_models= {'bayes': BayesModel, # 朴素贝叶斯'svm': SVMModel, # SVM'xgboost': XGBoostModel, # XGBoost'lstm': LSTMModel, # LSTM'bert': BertModel_Custom# BERT+分类头 }defload_model(self, model_type: str, model_path: str):"""加载指定类型的模型"""ifmodel_type=='bert':# BERT需要额外的预训练模型路径bert_path=kwargs.get('bert_path', './model/chinese_wwm_pytorch')model=BertModel_Custom(bert_path)else:model=self.available_models[model_type]()model.load_model(model_path)self.models[model_type] =model

3.2 传统ML模型性能对比

在微博情感数据集上的表现(训练集10000条,测试集500条):

| 模型 | 准确率 | AUC | 特点 | 适用场景 |

|---|---|---|---|---|

| 朴素贝叶斯 | 85.6% | – | 速度快,内存占用小 | 极快推理、简单分类 |

| SVM | 85.6% | – | 泛化能力好 | 中等复杂度文本 |

| XGBoost | 86.0% | 90.4% | 性能稳定,支持特征重要性 | 高准确率需求 |

| LSTM | 87.0% | 93.1% | 理解序列信息和上下文 | 需要理解时序 |

| BERT+分类头 | 87.0% | 92.9% | 强大的语义理解能力 | 需要深度语义 |

3.3 为什么保留传统ML?

-

成本优势:无GPU需求,CPU即可运行

-

速度优势:推理速度比大模型快10-100倍

-

可解释性:可以查看特征重要性,调试方便

-

基准对比:可以作为LLM的验证基准

-

混合策略:简单文本用ML,复杂文本用LLM

四、模型集成到InsightEngine

4.1 情感分析API设计

# InsightEngine/tools/sentiment_analyzer.py@dataclassclassSentimentResult:"""情感分析结果"""text: strsentiment_label: str# 非常负面/负面/中性/正面/非常正面confidence: floatprobability_distribution: Dict[str, float] # 各情感标签的概率success: bool=Trueerror_message: Optional[str] =NoneclassWeiboMultilingualSentimentAnalyzer:"""多语言情感分析器"""def__init__(self):self.model=Noneself.tokenizer=Noneself.device=Noneself.is_initialized=False# 情感标签映射(5级分类)self.sentiment_map= {0: "非常负面",1: "负面",2: "中性",3: "正面",4: "非常正面" }defpredict_single(self, text: str) ->SentimentResult:"""预测单条文本的情感"""ifnotself.is_initialized:self._load_model()# 文本预处理inputs=self.tokenizer(text, return_tensors="pt", truncation=True, padding=True)inputs= {k: v.to(self.device) fork, vininputs.items()}# 推理withtorch.no_grad():outputs=self.model(**inputs)logits=outputs.logitsprobabilities=torch.softmax(logits, dim=-1)# 获取预测结果predicted_class=torch.argmax(probabilities, dim=-1).item()confidence=probabilities[0][predicted_class].item()returnSentimentResult(text=text,sentiment_label=self.sentiment_map[predicted_class],confidence=confidence,probability_distribution={self.sentiment_map[i]: prob.item()fori, probinenumerate(probabilities[0]) } )

关键设计点:

-

5级分类:不仅是正负,还有中性、非常正面、非常负面

-

置信度输出:便于结果过滤

-

概率分布:支持更细致的分析

-

错误处理:优雅降级

4.2 批量情感分析

classWeiboMultilingualSentimentAnalyzer:"""批量情感分析"""defpredict_batch(self, texts: List[str]) ->BatchSentimentResult:"""批量预测"""ifnotself.is_initialized:self._load_model()results= []success_count=0failed_count=0fortextintexts:try:result=self.predict_single(text)results.append(result)success_count+=1exceptExceptionase:results.append(SentimentResult(text=text,success=False,error_message=str(e) ))failed_count+=1returnBatchSentimentResult(results=results,total_processed=len(texts),success_count=success_count,failed_count=failed_count,average_confidence=sum(r.confidenceforrinresultsifr.success) /len(results) )

五、多模型结果融合算法

5.1 融合策略

BettaFish采用”加权投票+置信度过滤”的融合策略:

classMultiModelEnsemble:"""多模型融合器"""def__init__(self, models: Dict[str, Any]):self.models=models# 模型权重(基于验证集准确率)self.model_weights= {'qwen3_lora': 0.35,'bert_lora': 0.25,'xgboost': 0.20,'svm': 0.10,'lstm': 0.10 }defpredict(self, text: str) ->Dict[str, Any]:"""多模型融合预测"""predictions= {}# 1. 调用所有模型formodel_name, modelinself.models.items():try:pred=model.predict(text)predictions[model_name] =predexceptExceptionase:logger.warning(f"{model_name} 预测失败: {e}")# 2. 加权投票weighted_votes= {'positive': 0.0,'negative': 0.0,'neutral': 0.0 }formodel_name, predinpredictions.items():weight=self.model_weights.get(model_name, 0.1)sentiment=pred['label']confidence=pred.get('confidence', 0.5)# 加上权重和置信度weighted_votes[sentiment] +=weight*confidence# 3. 获取最终预测final_sentiment=max(weighted_votes.items(), key=lambdax: x[1])[0]# 4. 计算融合置信度total_weight=sum(weighted_votes.values())fusion_confidence=weighted_votes[final_sentiment] /total_weightreturn {'final_sentiment': final_sentiment,'confidence': fusion_confidence,'individual_predictions': predictions,'weighted_votes': weighted_votes }

5.2 模型权重管理

classModelWeightManager:"""模型权重管理器"""def__init__(self):self.weights_file="./model_weights.json"self.weights=self._load_weights()def_load_weights(self) ->Dict[str, float]:"""加载模型权重"""default_weights= {'qwen3_lora': 0.35,'bert_lora': 0.25,'xgboost': 0.20,'svm': 0.10,'lstm': 0.10 }ifos.path.exists(self.weights_file):try:withopen(self.weights_file, 'r') asf:weights=json.load(f)# 归一化权重total=sum(weights.values())return {k: v/totalfork, vinweights.items()}exceptExceptionase:logger.warning(f"加载权重失败: {e}")returndefault_weightsreturndefault_weightsdefupdate_weights(self, validation_results: Dict[str, float]):"""基于验证集更新权重"""# 使用验证集准确率更新权重total_accuracy=sum(validation_results.values())self.weights= {model: accuracy/total_accuracyformodel, accuracyinvalidation_results.items() }# 保存权重withopen(self.weights_file, 'w') asf:json.dump(self.weights, f, indent=2)

六、模型选择策略

6.1 自动模型选择

classModelSelector:"""自动模型选择器"""defselect_model(self, text: str) ->str:"""根据文本特征选择最合适的模型"""text_length=len(text)has_emoji=bool(re.search(r'[\U0001F600-\U0001F64F]', text))has_url=bool(re.search(r'https?://', text))# 策略树iftext_length>200:# 长文本:使用GPT-2或Qwen3return'qwen3_lora'elifhas_emojiorhas_url:# 包含表情或链接:使用BERT(擅长理解符号和短文本)return'bert_lora'eliftext_length<50:# 极短文本:使用传统ML(速度快)return'xgboost'else:# 中等长度:使用多模型融合return'ensemble'

6.2 分层调用策略

用户输入文本 ↓判断文本长度和复杂度 ├─→ 长文本(>200字符) │ ├─→ Qwen3-LoRA(主) │ └─→ GPT-2-LoRA(备用) ├─→ 中等文本(50-200字符) │ ├─→ BERT-LoRA │ └─→ XGBoost └─→ 短文本(<50字符) └─→ 传统ML(朴素贝叶斯/SVM) ↓返回结果

七、模型训练与推理流程

7.1 训练流程

数据准备 ↓文本预处理(分词、去停用词) ↓特征工程(TF-IDF/Word2Vec) ↓模型选择(BERT/SVM/XGBoost) ↓训练(带验证集) ↓模型评估(准确率、AUC、F1) ↓保存模型

7.2 推理流程

用户输入 ↓模型选择(自动或手动) ↓模型加载 ↓文本预处理 ↓模型推理 ↓后处理(置信度过滤) ↓返回结果(标签+置信度+概率分布)

八、性能优化策略

8.1 推理优化

classOptimizedPredictor:"""优化的预测器"""def__init__(self):# 使用缓存减少重复计算self.cache= {}self.cache_size=1000defpredict_with_cache(self, text: str) ->Dict:"""带缓存的预测"""# 计算文本哈希text_hash=hashlib.md5(text.encode()).hexdigest()# 检查缓存iftext_hashinself.cache:returnself.cache[text_hash]# 正常预测result=self.predict(text)# 更新缓存(LRU策略)iflen(self.cache) >=self.cache_size:oldest_key=next(iter(self.cache))delself.cache[oldest_key]self.cache[text_hash] =resultreturnresultdefpredict_batch(self, texts: List[str]) ->List[Dict]:"""批量预测(并行化)"""# 使用线程池并行预测fromconcurrent.futuresimportThreadPoolExecutorwithThreadPoolExecutor(max_workers=4) asexecutor:results=list(executor.map(self.predict, texts))returnresults

8.2 显存优化

# Qwen3 LoRA微调时的显存优化training_args=TrainingArguments(output_dir="./output",# 使用梯度累积减少显存gradient_accumulation_steps=4,# 混合精度训练fp16=Trueiftorch.cuda.is_available() elseFalse,# 梯度检查点gradient_checkpointing=True,# 优化器选择optim="adamw_torch",# 学习率调度learning_rate=2e-5,per_device_train_batch_size=8, # 根据显存调整num_train_epochs=3)

九、总结:BettaFish情感分析模型的设计思想

9.1 核心设计原则

-

多模型融合:不依赖单一模型,投票/加权提高上限

-

成本优化:简单文本用ML,复杂文本用LLM

-

分层调用:根据文本长度和复杂度自动选择模型

-

可解释性:传统ML作为验证基准,便于调试

-

性能优化:缓存、批量预测、混合精度

-

权重管理:基于验证集动态调整模型权重

9.2 三大技术创新

-

多模型体系:BERT/GPT-2/Qwen3微调 + 传统ML(SVM/XGBoost/朴素贝叶斯/LSTM)

-

加权投票融合:模型权重基于验证集准确率,置信度过滤低质量结果

-

自动模型选择:根据文本特征(长度、表情、链接)自动选择最合适的模型

9.3 适用场景

✅ 适合:

-

需要高准确率情感分析的场景

-

需要处理多种文本长度的场景

-

需要成本优化的生产环境

-

需要可解释性的分析任务

❌ 不适合:

-

实时性要求极高(<10ms)的场景

-

需要处理海量数据的批处理(建议用专门的NLP框架)

下一章预告

在理解了情感分析模型层的基础上,最后一章我们将深入解析工程实践与部署:

-

Docker多服务部署方案

-

开发环境的配置(Conda/uv)

-

生产环境的优化策略

-

监控与日志系统设计

-

性能调优最佳实践

-

安全性考虑(API密钥管理、数据隐私)

关注公众号,不迷路 👉 BettaFish源码解析系列持续更新中.

夜雨聆风

夜雨聆风