当任何人都能构建时,软件工程会怎样?

如果《图灵邮报》是你每周例行阅读的一部分,请与一位聪明的朋友分享。这是保持周一文摘免费的最简单方法。

作者:Ksenia Se

日期:2026年2月25日

原文链接:https://www.turingpost.com/p/fod141

本文由大模型全文精译,和通AI编译发布

本周《图灵邮报》:

-

周三/ AI 101系列:AI硬件的演进:Taalas的片上大语言模型

-

周五 / 采访Ioannis Antonoglou,他是Reflection AI的联合创始人兼CTO

来自我们的合作伙伴: 在规模化生产中安全运行AI代理

组织正在跨基础设施部署AI代理,但传统模型并非为与自主行动者一起扩展而构建。采用代理身份框架为在生产中运行代理提供了安全基础,该框架具有基于身份的访问、短期凭证和为以机器速度运行的非人类系统设计的策略执行。如果你需要安全且规模化地运行AI代理,你应该试试这个 →

[探索该框架]

(https://fandf.co/46JS0v5)

回到主题:当任何人都能构建时,软件工程会怎样?

上周,几篇极其有趣的博客和文章出现在我的屏幕上。它们是在完全不同的背景下写的,作者之间没有协调,在某些情况下,他们可能会在评论区相互反驳。

但当我一个接一个地阅读它们时,我如此清晰地看到了一个更大的图景,以至于我急于与你们分享。

AI现在能写代码了。有趣的是编码职业的转变。我看到的趋势是,软件工程正在同时分裂成(至少)两个学科:

-

驾驭工程: 构建使代理可靠的约束、工具、反馈循环和文档(这本身就是一个全新的行业)。

-

判断制造: 培养能够指导、验证和维护代理生成系统的人类,尤其是早期职业工程师。

一个重要的注释:有了代理,几乎任何人都可以做某种形式的驾驭工程。这并不意味着软件工程职业会消失。恰恰相反。因为当普通人通过“驾驭“构建大量有价值的“软件“时,深度工程在风险增加时仍然至关重要:安全性、可靠性、性能、合规性、混乱的集成,以及任何可能以昂贵方式出问题的事情。

你完全可以驾驭工程出一个工作系统。但你无法驾驭工程出物理定律、对手、生产环境熵和未被充分理解的代理(值得思考:一篇名为“[*混沌代理*](https://www.researchgate.net/publication/401123335_Agents_of_Chaos)”的论文)。

现在,让我们来看看这些文章,把拼图重新拼起来,这样我们就能看到完整的画面。

工程师的工作正在变成“环境+编排“

Charlie Guo的 [“驾驭工程” 操作指南](https://www.ignorance.ai/p/the-emerging-harness-engineering) 很好地描述了严肃团队正在趋同的做法:OpenAI [围绕代理进行重组](https://x.com/gdb/status/2019566641491963946),[Stripe的Minions](https://stripe.dev/blog/minions-stripes-one-shot-end-to-end-coding-agents-part-2) 每周产生一千个合并的拉取请求,独立构建者并行运行5-10个代理,并发布他们不逐行阅读的代码。

模型可以写代码——现在这是公认的。瓶颈变成了:环境是否让做错事变得困难,而让做对事变得容易?

这就是“驾驭工程“的一句话总结。

在阅读了Guo的文章以及Greg Brockman的这条 [推文](https://x.com/gdb/status/2019566641491963946) 之后,我想出了以下可能在工程时有所帮助的可重复模式:

-

默认代理优先: 停止将打开编辑器作为第一步。如果你能用5-10条要点的需求来编写任务,首先把它交给代理。代理起草计划和拉取请求;你专注于批准计划和审查差异。

-

架构作为护栏: 用严格的边界和允许的依赖路径约束解决方案空间,并通过结构检查自动执行。

-

工具作为基础+反馈: 通过CLI/MCP暴露内部工具;运行CI、lint和测试,并提供错误消息,准确告诉代理如何修复失败。

-

记忆的复合效应: 将 AGENTS.md 视为仓库的伤疤组织。每次代理失败时,写下出了什么问题以及如何避免;将修复作为可复用的模板、脚本和工具配置跨团队共享。

-

计划优先的纪律: 不要让代理第一步就写代码。让它先起草一个计划,审查它,批准它,然后让它执行。

-

无“垃圾“策略: 保持合并标准不变。每个拉取请求都有一个人类负责人,审阅者理解他们正在批准什么。

-

代理运维层: 像运行生产系统一样运行代理。跟踪它们的运行,集中工具访问,并将重复出现的失败转化为驾驭能力的改进。

这既是工作流程卫生,也是可执行的基础设施。代理是工人。驾驭系统是工厂。你的工作是工厂仍然做不到的任何事情:判断力、品味、责任感。

定制软件是真实的,它将引爆需求

Andrej Karpathy [发布](https://x.com/karpathy/status/2024987174077432126) 了一个小轶事,却蕴含着巨大的含义。他想要一个超特定的心肺实验仪表板。App Store没有“八周二区加HIIT跑步机追踪器“这个类别。所以他用代理在大约一小时内通过氛围编码实现了它,包括逆向工程跑步机的API,然后调试常见的棘手问题:单位转换、日历对齐。

他的结论是重要的部分:当代理可以按需为你临时构建一个小应用时,“应用商店“模式感觉过时了。 未来是具有AI原生人机工程学的服务、传感器和执行器,它们被拼接成短暂的软件。

Andrew Ng [从经济学角度](https://www.deeplearning.ai/the-batch/issue-341/) 提出了同样的观点:即使每个开发者的生产力提高10倍,我们也不需要1/10的开发者,因为对定制软件的需求没有实际上限。他已经看到早期的“X工程师“角色——比如营销工程师或招聘工程师——嵌入业务职能中,为该职能构建软件的人员。

综合起来,这给了我们一个宏观趋势:软件从一组打包的产品转变为一连串的定制工具。

我甚至不确定这还是不是软件3.0。我们移动得如此之快,可能已经是软件4.0了。这是对“软件行业“含义本身的重新定义。

重写变得廉价,因此软件供应链开始改变形态

Thomas Wolf [从另一个层面放大视角](https://x.com/Thom_Wolf/status/2023387043967959138):如果重写和理解外来代码库变得廉价,依赖树就不再像超能力,而开始像负债。如果一个代理可以提取你需要的内容或干净地重写它,为什么还要保留一个深层依赖树呢?更少的依赖意味着更小的攻击面、更小的包,而且通常软件也更快。

Wolf随后说“林迪效应“会减弱。我会更精确地表述。林迪效应不是说“它存在是有充分理由的“。林迪效应是一个长寿的启发式方法:如果某样不易腐烂的东西存活了这么久,它往往会继续存活下去。在软件中,这种生存优势一直受到另一种力量的强力支撑:替换的痛苦。旧系统之所以保留,是因为触碰它们有风险、成本高昂,而且充满了没人想重新发现的边缘情况。

如果代理改变了这一点,那么替换的痛苦就会降低。所以遗留系统失去了部分护城河,无论你是称之为林迪效应,还是仅仅称之为转换成本加上恐惧。

Karpathy [从编程语言的角度呼应了](https://x.com/karpathy/status/2023476423055601903) 这一点:翻译是大语言模型特别擅长的领域,因为旧代码就像一个详细的提示和一个测试预言机。我们多次重写现有软件的绝大部分变得可行。

而这引出了下一个趋势:重写变得更容易,但证明你没有破坏现实并没有。

验证成为你无法逃避的税

Wolf 的关键发现是关键:未知的未知仍然是未知。如果你能重写一切,你也会重新发现旧系统通过纯粹的历史伤疤组织存活下来的每一个奇怪的边缘情况。

所以问题变成了:我们能否实现测试、边缘情况和形式验证的完全覆盖?在AI主导的世界里,Wolf认为形式验证不再是可选的。

Guo 的文章从操作层面指出了同一个漏洞:功能正确但难以维护的代码悄悄进入代码库,代理标记工作完成而没有真正的端到端验证,将这些工作流程改造到十年历史的棕地系统上。

这是新的基本事实:代理增加输出的速度比增加信心的速度快。驾驭系统有帮助,但验证仍然是餐后必须支付的账单。

隐藏的危机:初级人才管道在判断力最关键的时刻崩溃

现在把所有这些与Russinovich 和 Hanselman 在 CACM 上的 [文章](https://dl.acm.org/doi/epdf/10.1145/3779312) 联系起来,这是所有文章中“最像成年人讲话“的一篇。

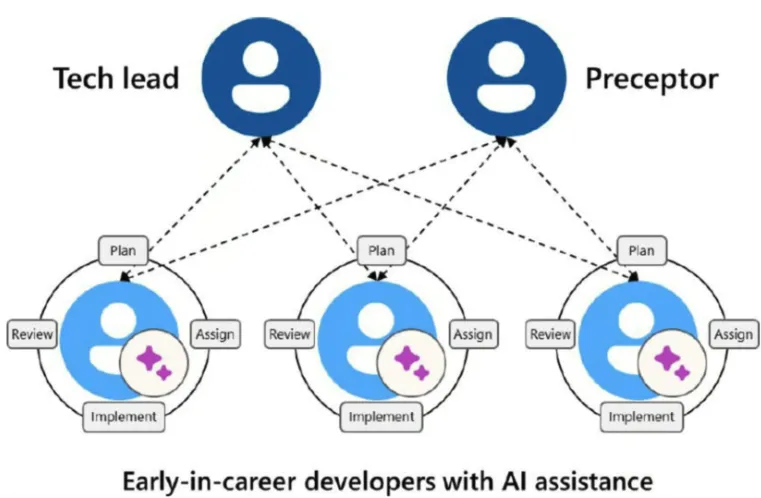

他们的观点很简单:代理编码助手放大了资深工程师的能力,因为资深工程师已经具备指导、验证和整合代理所产生内容的判断力。早期职业开发者则没有,所以同样的工具可能会拖慢他们或误导他们。由此产生的经济激励几乎是自动的:雇佣资深工程师,让代理吞噬初级工作。

图片来源:Russinovich 和 Hanselman 的《为AI重新定义软件工程专业》

如果这成为常态,那么该职业的人才管道就会崩溃。下一代资深工程师不是通过招聘得到的。你是培养出来的。

他们提出的解决方案是一个组织设计:大规模的导师制。将早期职业开发者与受过培训的资深导师配对(3:1到5:1),持续一年或更长时间,并将成长视为一个明确的组织目标。他们甚至建议助手应该有一个早期职业开发者模式,默认采用苏格拉底式辅导,而不是立即生成解决方案。

图片来源:Russinovich 和 Hanselman 的《为AI重新定义软件工程专业》

把它们放在一起,画面是这样的:

我们正以惊人的速度工业化执行。判断力并没有随之扩展,而且正在成为瓶颈。

未来的方向

在未来一年,关注三件事:

-

“驾驭工程“成为严肃组织内部的真正职位头衔,因为“代理生产力“开始看起来像一个平台问题。

-

定制软件(Karpathy的术语)将蚕食更多世界,这增加了对能够操作、集成和保护它的人的需求。

-

初级人才管道成为一个战略风险。 停止招聘和培训早期职业工程师的团队将以短期吞吐量为代价,积累长期的脆弱性。

代理正将软件变成一个富足的业务。稀缺资源是人类决定什么看起来好、证明它有效并保持它有效的能力。

如果我们不刻意培养这种技能,我们将比以往发布更多的软件,最终陷入编码的混乱:通过自动化检查、看起来没问题、但仍然在现实世界中崩溃的代码。

我们的新闻摘要永远是免费的。点击上面的[*合作伙伴链接*](https://fandf.co/46JS0v5)支持我们或升级以接收我们完整的深度挖掘,直接发送到你的收件箱。加入来自顶尖公司如英伟达、Hugging Face、微软、谷歌、a16z等,以及AI实验室如Ai2、MIT、伯克利、.gov 和数千其他公司的Premium会员,真正了解AI的发展动态 →

[升级](https://www.turingpost.com/upgrade)

我们正在观看/阅读:

-

Taalas 和特定模型计算的回归。英伟达会收购他们吗?

-

[OpenClaw 详解 + 轻量级替代方案](http://google.com/search)(我们最新的热门文章)

-

[构建推动AI治理的技术](https://bounded-regret.ghost.io/building-technology-to-drive-ai-governance/) by Jacob Steinhardt

-

[中国计算年度回顾——狂热、成长阵痛和关键里程碑](https://chinai.substack.com/p/chinai-348-chinas-compute-year-in) by ChinAI

-

[我对Codex的看法](https://x.com/gabrielchua/status/2025017553442201807) by Gabriel Chua

-

[留下的代价](https://x.com/amytam01/status/2023593365401636896) by Amy Tam

-

[处于永久追赶中的开放模型](https://www.interconnects.ai/p/open-models-in-perpetual-catch-up) by Nathan Lambert(加上我们对他的 [采访](https://www.youtube.com/watch))

推特图书馆

(https://www.turingpost.com/p/buildingopenclawagents)

来自“惯犯“的新闻

-

Meta & 英伟达 — “全栈,全速“

Meta(https://investor.nvidia.com/news/press-release-details/2026/Meta-Builds-AI-Infrastructure-With-NVIDIA/default.aspx) 英伟达签订了一项多年协议,共同构建由Grace CPU、数百万个Blackwell和Rubin GPU以及Spectrum-X网络驱动的超大规模AI工厂。从训练前沿模型到为数十亿用户运行推理,这是一个统一的、能源调优的架构——机密计算保护着WhatsApp的AI功能。工业规模的AI,现在加上了隐私脚注。

-

五角大楼 vs. Anthropic — “合法目的,满足护栏“

据报道,五角大楼 [即将与Anthropic断绝关系](https://www.bloomberg.com/news/articles/2026-02-16/pentagon-is-close-to-cutting-ties-with-anthropic-axios-says),对其Claude使用方式的限制感到沮丧。Anthropic坚持其AI不得用于大规模国内监控或完全自主武器;国防部希望获得“所有合法目的“的自由度。如果被标记为供应链风险,承包商可能被迫放弃Anthropic。负责任的AI遇到了现实政治。

-

ASML — “1000瓦,330片晶圆,一个巨大的护城河“

ASML研究人员表示,他们已经 [将EUV](https://www.reuters.com/world/china/asml-unveils-euv-light-source-advance-that-could-yield-50-more-chips-by-2030-2026-02-23/) 源功率提升到1000W(从约600W),这一进步可能到2030年将工具吞吐量提高到约330片晶圆/小时(从约220片),并在曝光时间缩短的情况下交付多达50%的芯片。工程原理:每秒约100,000个锡滴加上双脉冲激光“整形“方法,以形成更热、更亮的等离子体——让潜在的美国和中国挑战者望尘莫及。

-

祝贺 ggml.ai 和 Hugging Face→

(#)

(https://twitter.com/simonw/status/2024895405146997002)

模型亮点

-

Causal-JEPA:通过对象级潜在干预学习世界模型

在中训练中注入对象级掩码,引发潜在的反事实结构,将因果归纳偏置直接嵌入世界模型。

重要因为它将预测转向规划和控制所需的交互推理 [→阅读论文](https://arxiv.org/abs/2602.11389)

-

Kimi K2.5:视觉代理智能

训练原生多模态模型,使用并行代理强化学习,学习编排多达100个子代理并优化关键路径延迟。

重要因为并行编排成为模型内部的学习能力,而不是外部脚手架 [→阅读论文](https://www.kimi.com/blog/kimi-k2-5.html)

-

GLM-5:从氛围编码到代理工程

通过异步训练基础设施扩展长周期强化学习,以支持自主的多步工程任务。

重要因为它训练模型用于持续的工作流执行,而不是孤立的响应 [→阅读论文](https://arxiv.org/abs/2602.15763)

-

Qwen3.5:走向原生多模态代理

将稀疏MoE、混合注意力、早期文本–视觉融合和大规模RL环境扩展组合成一个为多模态代理行为构建的架构。

重要因为多模态和工具使用是原生设计约束,而不是附加组件 [→阅读论文](https://qwen.ai/blog)

-

世界行动模型是零样本策略

将视频预测和行动生成统一到一个生成动态模型中,该模型充当零样本策略。

重要因为它将世界建模和控制折叠到同一个主干中 [→阅读论文](https://arxiv.org/abs/2602.15922)

-

使用计算机的世界模型

学习UI状态转换,以在执行前模拟软件动作,从而在数字环境中实现反事实搜索。

重要因为它将计算机使用转化为基于模型的规划,而不是反应式提示 [→阅读论文](https://arxiv.org/abs/2602.17365)

-

Gemini 3.1 Pro

在抽象泛化基准测试上推进核心推理性能,并增强了支持谷歌生态系统中代理工作流程的基础智能。

重要因为它代表了Deep Think和企业代理等上游系统所依赖的底层推理能力的推动 [→阅读论文](https://blog.google/innovation-and-ai/models-and-research/gemini-models/gemini-3-1-pro/)

本周研究

(一如既往,🌟表示我们推荐关注的论文)

本周更多是关于基础设施,而不是智能:

-

世界模型正在通过合成环境扩展代理。

-

潜在通信正在取代缓慢的文本交换。

-

可靠性正与原始准确性分离。

-

回忆,而不是知识,是瓶颈。

-

推理时控制正在超越蛮力扩展。

-

系统工程正在设定上限。

-

Clawdbot和相关主题现在正在研究中。

代理通信、协作与社会

-

🌟视觉虫洞:异构多代理系统中的潜在空间通信(普渡大学)

通过将推理轨迹通过共享的视觉潜在空间路由,并减少跨异构代理的对齐复杂性,实现无文本、模型无关的通信 [→阅读论文](https://arxiv.org/abs/2602.15382)

-

🌟智能AI委派(Google DeepMind)

形式化了跨人类和代理的自适应任务分解和权威转移,以支持稳健的、信任感知的委派网络 [→阅读论文](https://arxiv.org/abs/2602.11865)

-

通过上下文中的共玩者推断实现多代理合作

通过训练序列模型在上下文中推断和适应共玩者的学习动态,来诱导合作行为 [→阅读论文](https://arxiv.org/abs/2602.16301)

-

AI代理社会中会出现社会化吗?Moltbook案例研究

诊断大规模代理社会,以衡量开放多代理环境中的收敛性、影响力和共识形成 [→阅读论文](https://arxiv.org/abs/2602.14299)

-

🌟利用大语言模型发现多代理学习算法(Google DeepMind)

通过由语言模型驱动的进化搜索,自动化发现新的多代理强化学习算法 [→阅读论文](https://arxiv.org/abs/2602.16928)

代理可靠性、安全性与风险

-

🌟迈向AI代理可靠性科学(普林斯顿大学)

将代理性能分解为一致性、鲁棒性、可预测性和安全性指标,以暴露操作故障模式 [→阅读论文](https://arxiv.org/abs/2602.16666)

-

对Clawdbot的基于轨迹的安全审计(OpenClaw)

评估完整的代理交互轨迹,以识别在模糊性、越狱提示和工具误用下的安全故障 [→阅读论文](https://arxiv.org/abs/2602.14364)

-

🌟实践中的前沿AI风险管理框架:风险分析技术报告(上海AI实验室

评估前沿模型在网络攻击、欺骗、操纵、自我复制和不受控制的能力扩展方面的风险,同时提出缓解策略 [→阅读论文](https://arxiv.org/abs/2602.14457)

代理学习、适应与决策

-

🌟经验强化学习(南加州大学)

将明确的“经验–反思–巩固“循环纳入强化学习,将稀疏反馈转化为持久的行為更新 [→阅读论文](https://arxiv.org/abs/2602.13949)

-

🌟从人类反馈中学习个性化代理(Meta)

通过澄清、基于行动的行动和记忆更新,在线学习不断变化的用户偏好,以实现持续个性化 [→阅读论文](https://arxiv.org/abs/2602.16173)

-

先校准后行动:大语言模型代理中的成本感知探索

教导代理在行动前明确推理成本–不确定性的权衡,提高序列决策效率 [→阅读论文](https://arxiv.org/abs/2602.16699)

-

建模网络代理中的独特人类交互

预测用户在网页任务期间何时会干预,以支持更具协作性和偏好感知的代理行为 [→阅读论文](https://arxiv.org/abs/2602.17588)

记忆、回忆与长上下文推理

-

🌟PANINI:通过结构化内存在词元空间中进行持续学习(加州大学)

将外部语义记忆结构化为生成工作空间,以实现高效的持续学习,而无需重新处理原始文档 [→阅读论文](https://arxiv.org/abs/2602.15156)

-

🌟空架子还是丢了钥匙?回忆是参数化事实性的瓶颈(Google)

区分缺失知识和回忆失败,以表明访问(而非编码)限制了事实性能 [→阅读论文](https://arxiv.org/abs/2602.14080)

-

🌟使用下一序列预测的强化快速权重(普林斯顿大学)

使用序列级强化优化快速权重架构,以改进超越词元预测的长上下文建模 [→阅读论文](https://arxiv.org/abs/2602.16704)

-

MMA:多模态记忆代理

为检索到的多模态记忆分配动态可靠性分数,以减少陈旧证据和过度自信的错误 [→阅读论文](https://arxiv.org/abs/2602.16493)

训练动态、优化与表征

-

🌟论自适应优化器中掩码更新的惊人有效性(Google)

引入掩码梯度更新,引发曲率感知正则化,并提高大模型优化稳定性 [→阅读论文](https://arxiv.org/abs/2602.15322)

-

🌟重新审视柏拉图式表征假说:亚里士多德的观点(EPFL)

校准表征相似性度量,以揭示局部邻域结构而非全局嵌入的收敛性 [→阅读论文](https://arxiv.org/abs/2602.14486)

-

论模加法的机制与动态:傅里叶特征、彩票假说与Grokking

解释神经网络如何通过相位对称性、频率竞争和分阶段泛化来内化算法结构 [→阅读论文](https://arxiv.org/abs/2602.16849)

-

ARXIV-TO-MODEL:科学语言模型训练的实践研究

记录了在有限计算资源下训练领域特定科学语言模型的端到端流程 [→阅读论文](https://arxiv.org/abs/2602.17288)

推理时推理与结构化搜索

-

🌟理解 vs. 生成:导航多模态模型中的优化困境(北京大学)

将多模态生成重构为多步的“生成–理解–精炼“循环,以平衡推理和输出质量 [→阅读论文](https://arxiv.org/abs/2602.15772)

-

STATe-of-Thoughts:用于思维树的结构化行动模板

用可解释的推理行动取代随机采样,以增加推理时的多样性、可控性和可解释性 [→阅读论文](https://arxiv.org/abs/2602.14265)

新的计算基板

-

统一潜在(UL):如何训练你的潜在

学习扩散正则化的潜在表征,并严格控制比特率,用于高保真图像和视频生成 [→阅读论文](https://arxiv.org/abs/2602.17270)

-

Qute:迈向量子原生数据库

将SQL编译成量子电路,并动态选择混合执行路径,以探索量子原生数据系统 [→阅读论文](https://arxiv.org/abs/2602.14699)

今天就到这里。感谢阅读!如果这份新闻稿可以帮助同事加深对AI的理解并保持领先,请将其发送给他们。

关于和通AI

和通AI专注于AI前沿技术教育和培训,涵盖AI概念启蒙、素养提升、场景应用、技能实训、战略规划全系列高质量AI课程培训体系,服务千行百业智能化转型升级。是专业的AI教育内容提供商和AI教育软件服务商,秉持以AI技术赋能AI教育理念,研发了多款基于大模型的AI教育软件,如AI教学编程、AI教学英语等,为AI教育、Al+教育提供⼀搅子解决方案。

以下是和通AI-大模型技术交流群,欢迎大家进入群聊讨论交流技术相关的问题。

夜雨聆风

夜雨聆风