我开发了一款免费的Obsidian插件,让大家能够更方便的在Obsidian中使用AI践行 FLOW笔记法

上次分享的FLOW笔记法的模板,为了能让大家用到免费的AI模型,使用的是OpenCode,但是在obsidian中没有合适的插件,上次推荐的那款很多人说不好用,于是过年期间我自己用空余时间开发了一个,同步的也把FLOW笔记法配套的技能升级了一下,新的模板及插件已经更新到网盘了

链接: https://pan.baidu.com/s/1rUsUY_TXl5jhT83FfPyaug?pwd=ztpj 提取码: ztpj 。

如果你想最快跑通,先用 OpenCode 自带免费模型。如果你想把内容尽量留在本机,并且电脑配置还不错,使用 Ollama + qwen3.5:9b。如果你想省本地显存,又想保持简单,就走 Ollama Cloud,按提示把模型接进 OpenCode 即可。

如何把 FLOWnote 正确装进 Obsidian。

如何把 OpenCode 装好,并确认 FLOWnote 能连上。

如何配置模型,尤其是 Ollama 本地模型、Ollama Cloud,以及 Qwen 3.5 这类常用模型。

初次使用FLOWnote笔记的用户建议按这个顺序安装

FLOWnote 的聊天、会话和技能工作流都依赖它。

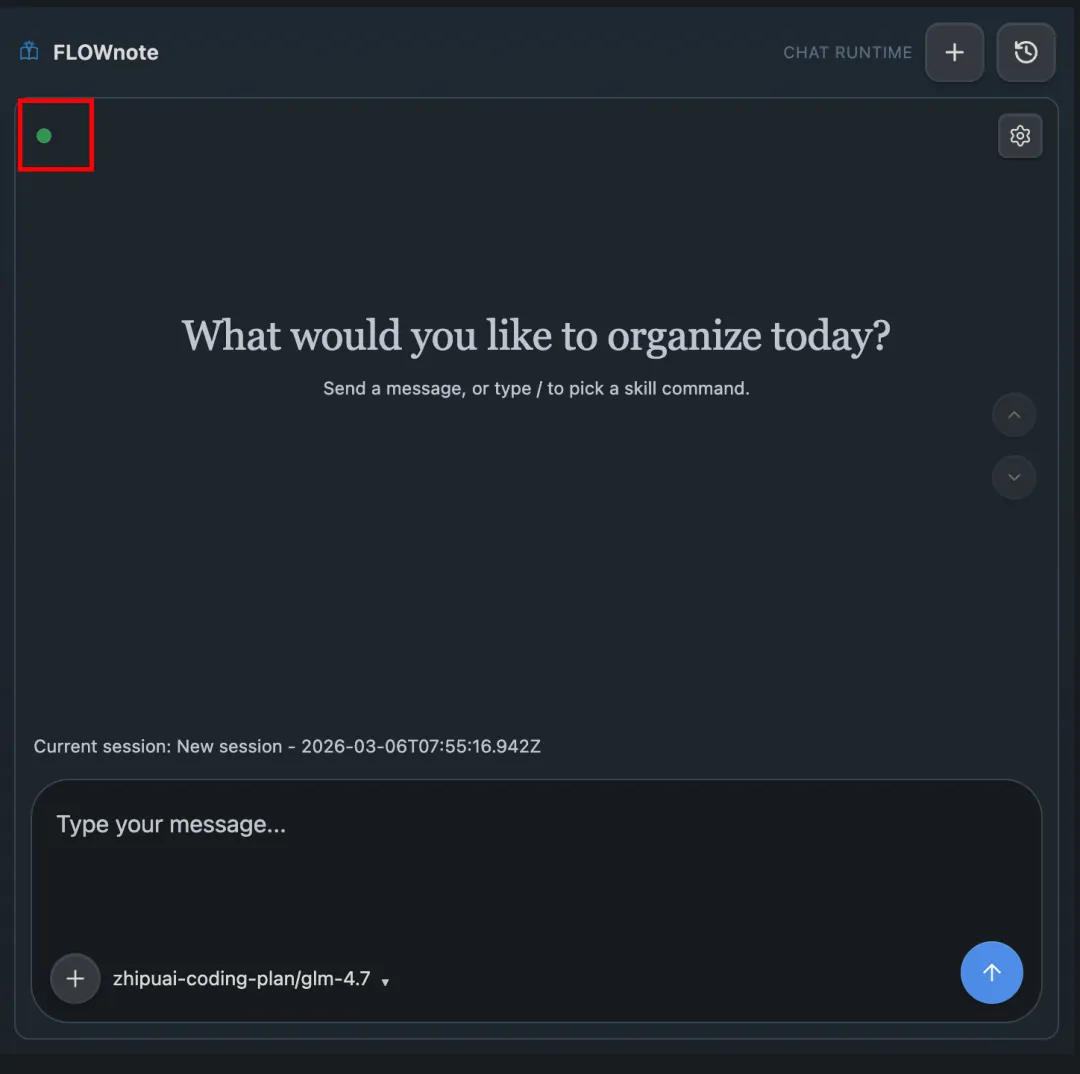

在 FLOWnote 中确认 OpenCode 已连接

免费模型、本地模型、云端模型都可以,按需选择即可。

如果你直接使用完整的 FLOWnote 仓库,插件已经在仓库里了,目录就是:

.obsidian/plugins/flownote/

2. 如果你只想把 FLOWnote 单独装进自己的仓库

请把 flownote 文件夹复制到你的 Obsidian 仓库中:

<你的仓库>/.obsidian/plugins/flownote/ ├── main.js ├── manifest.json └── styles.css

启用成功后,你应该能在侧边栏或命令面板里看到 FLOWnote 的入口,并能打开聊天面板。

二、先装 OpenCode,再用 FLOWnote

FLOWnote 的聊天、会话和技能工作流都依赖 OpenCode。没有安装 OpenCode,FLOWnote 只能显示界面,不能真正工作。

curl -fsSL https://opencode.ai/install | bash

brew install anomalyco/tap/opencode

Windows 更推荐先装 Node.js,再打开 PowerShell 或 CMD 执行:

npm install -g opencode-ai

注意:对于 FLOWnote,Windows 下优先建议使用本机 Node.js + npm 安装,不要优先走 WSL 那套。

node -v npm -v opencode –version

如果能看到版本号和路径,说明 OpenCode 已安装成功。

如果你完全不熟悉终端,可以用 Trae 辅助安装 OpenCode。最基础的做法是:下载并安装 Trae,打开你的 FLOW 仓库文件夹,然后在对话框中输入下面这句话。

帮我安装 OpenCode,官网是 https://opencode.ai/

如果安装过程提示沙盒环境,就继续做下面这个关键设置。

在“命令运行方式”里,把 IDE 和 SOLO 都改成 自动运行。这一步非常关键,如果不改,AI 无法真的把 OpenCode 装好。

如果这条命令不通,FLOWnote 仍然无法正常工作。

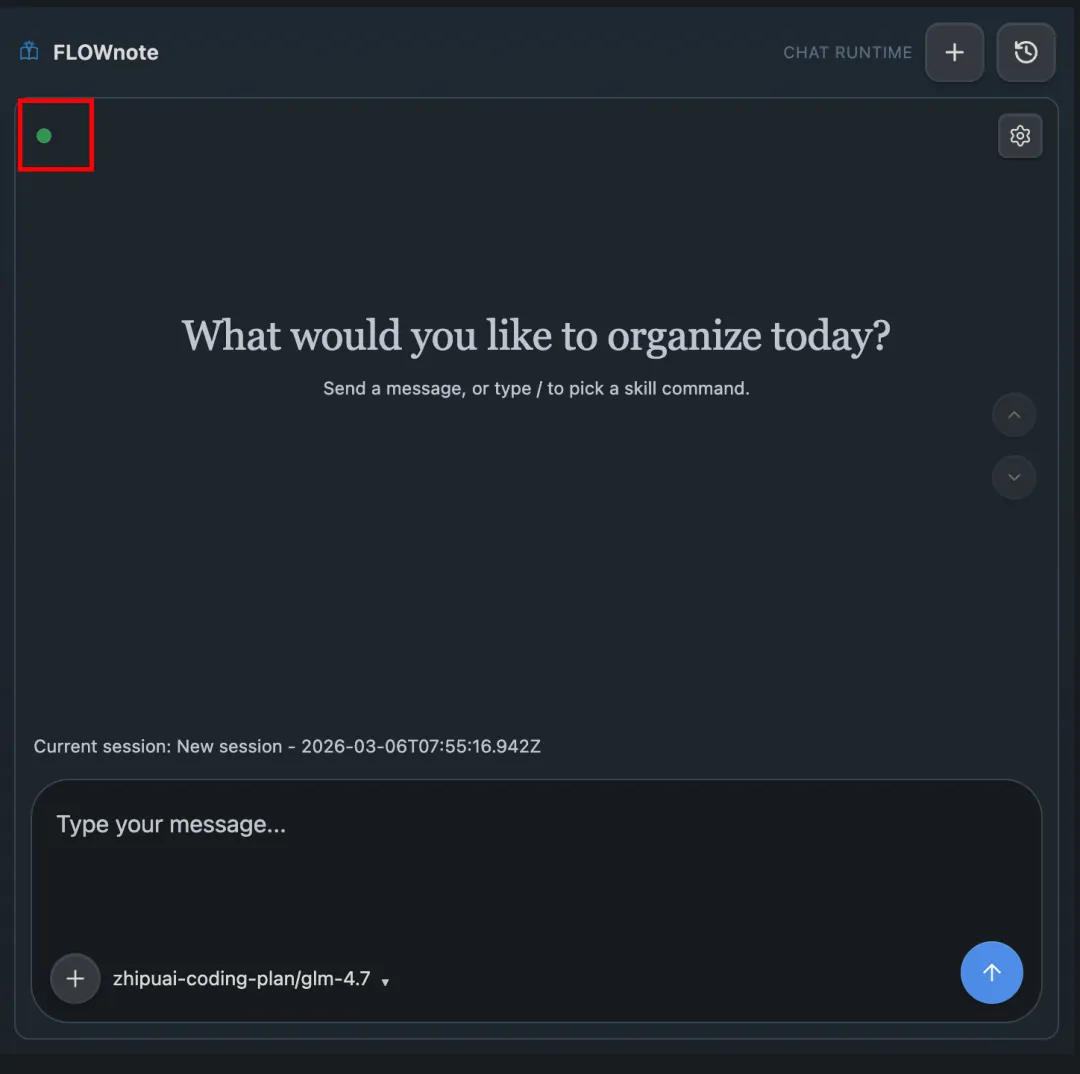

四、在 FLOWnote 里确认 OpenCode 已连接

OpenCode 装好以后,回到 Obsidian。如果你看到插件首页上面的绿点亮起,说明连接成功。

where opencode 或 which opencode 是否能找到路径。

Windows 下 OpenCode 是否装在了 WSL 中。

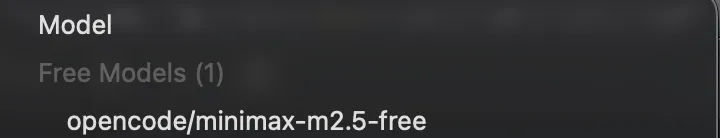

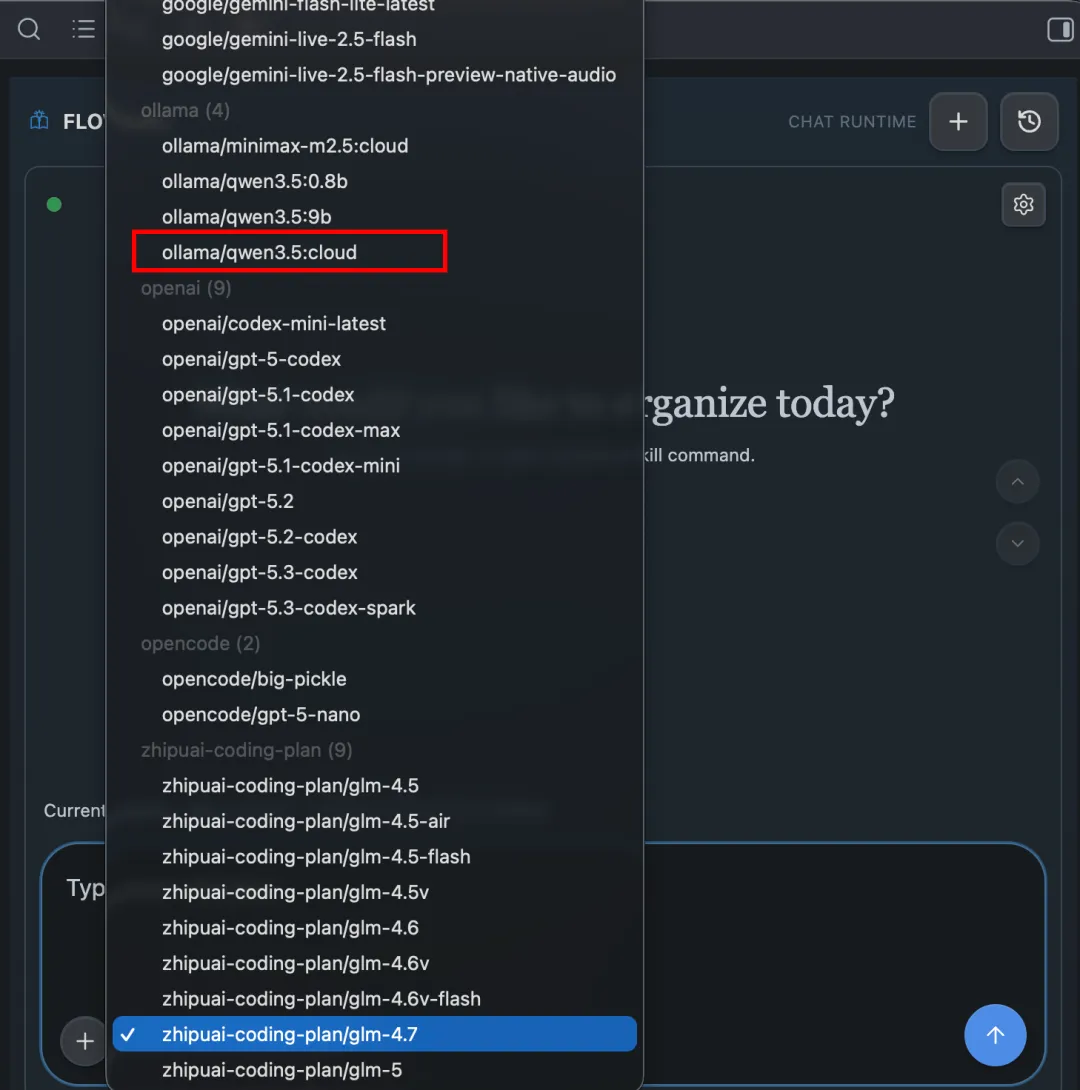

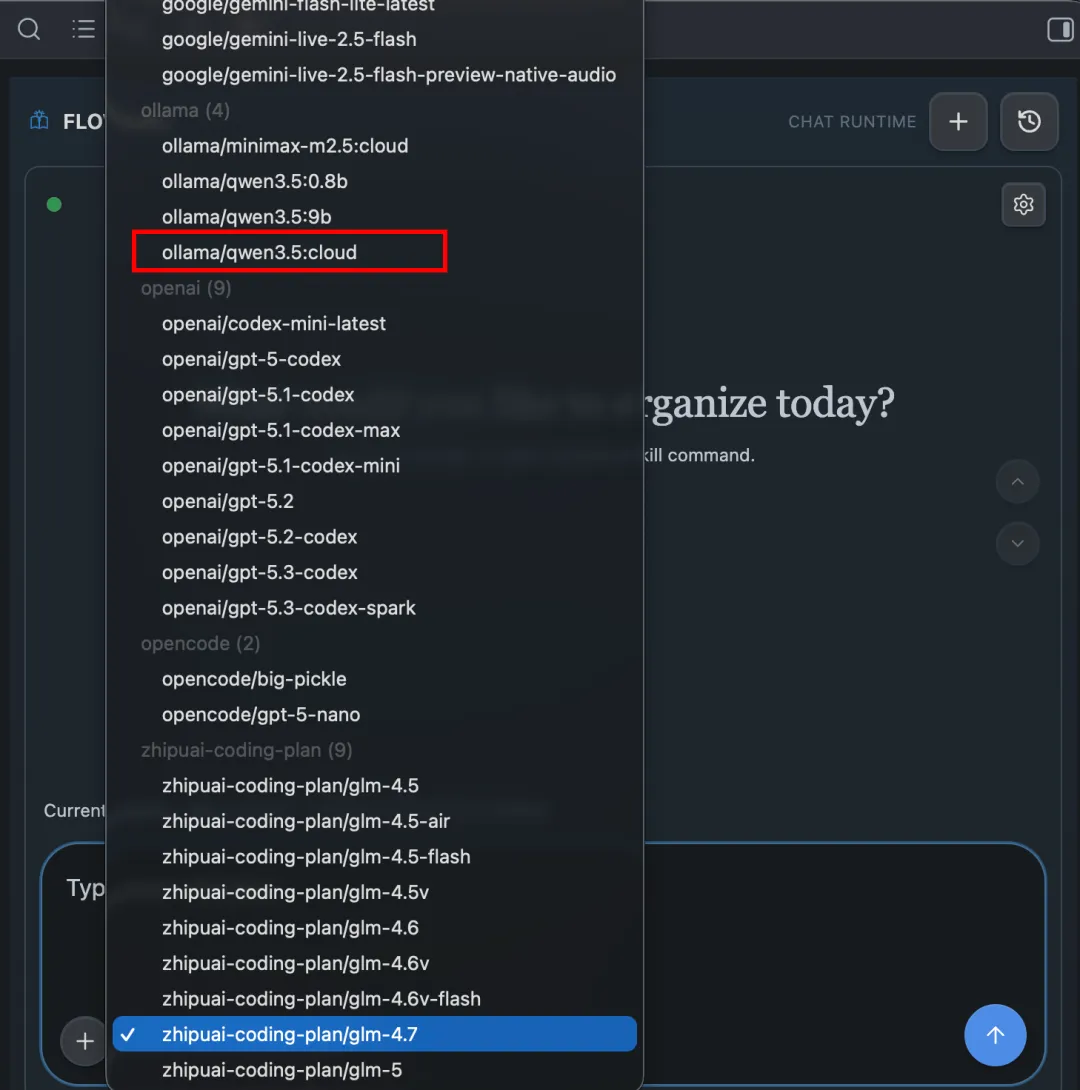

FLOWnote 里的模型,实际上是由 OpenCode 管理的。你可以把模型配置理解成两层:第一,OpenCode 能不能看到这个模型;第二,FLOWnote 能不能切换到这个模型。只要 OpenCode 能识别,FLOWnote 一般就能切换。

方案 A:直接使用 OpenCode 自带免费模型,最快开始。

方案 B:使用 Ollama 在本地运行模型,适合隐私内容。

方案 C:使用 Ollama Cloud 云端模型,兼顾方便和效果。

方案 D:接入其他 OpenAI 兼容云端 API,适合已有 API Key 的用户。

如果你只是想最快开始,建议先用 OpenCode 自带免费模型,选择带有 free 标记的模型。

注意:免费模型列表会变化,请以你本地实际显示为准。它更适合普通整理和轻量问答,不建议处理特别敏感的隐私内容。

到这里,其实就已经可以开始使用了。后面的内容属于进阶配置,按需折腾即可。

如果你希望数据尽量保留在本机,或者更想自己控制模型,可以直接用 Ollama 本地模型。

如果你已经安装了 Ollama,这一步直接跳过。还没装的话,去官网下载:

https://ollama.com/download

能看到版本号,就说明 Ollama 已安装成功。这里不需要进入任何特殊目录,直接在终端里执行命令就行。

第一次运行时,Ollama 会自动下载模型,下载完成后会直接进入对话界面。只要能正常回复,就说明模型已经装好了。测试完后按 Ctrl + C 退出即可。

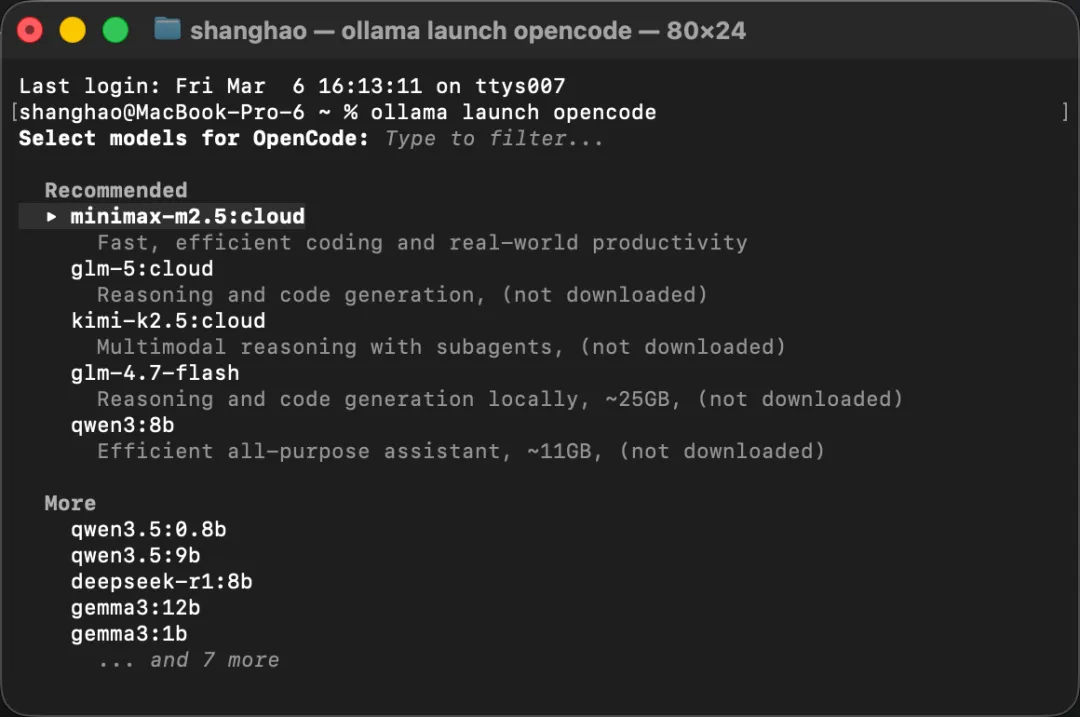

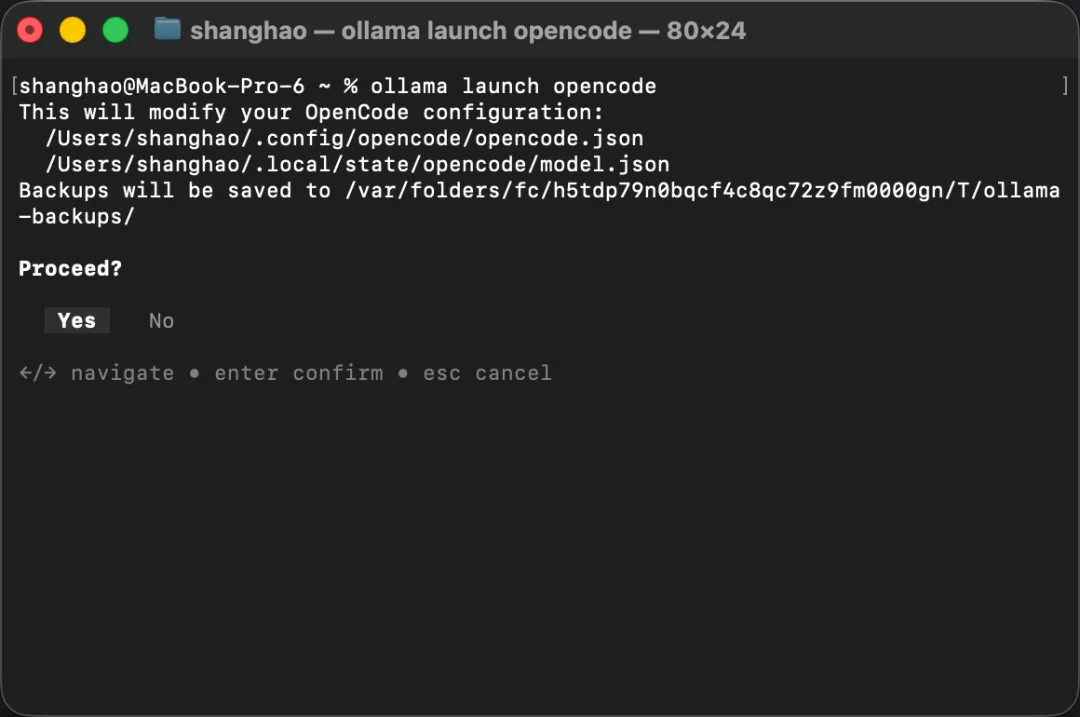

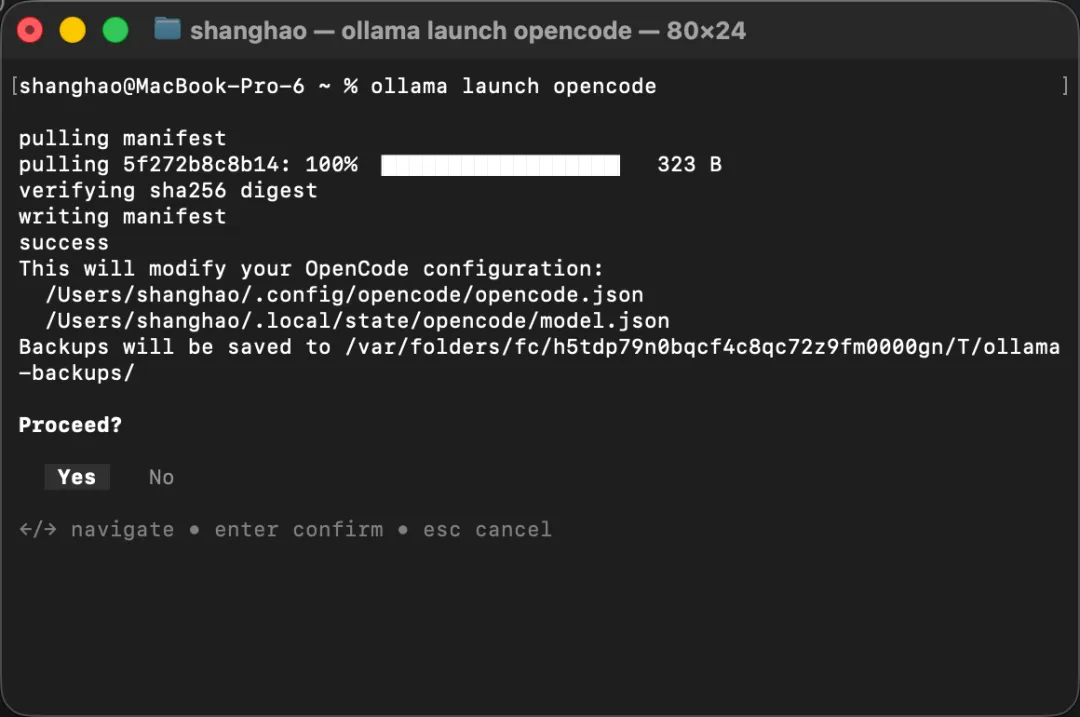

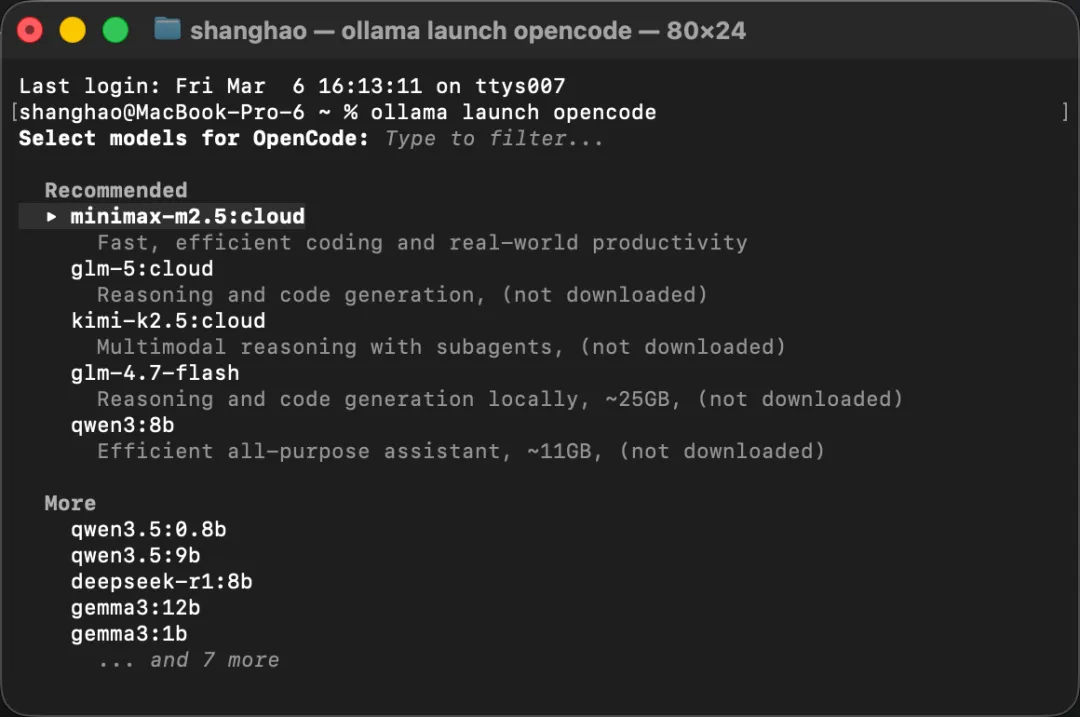

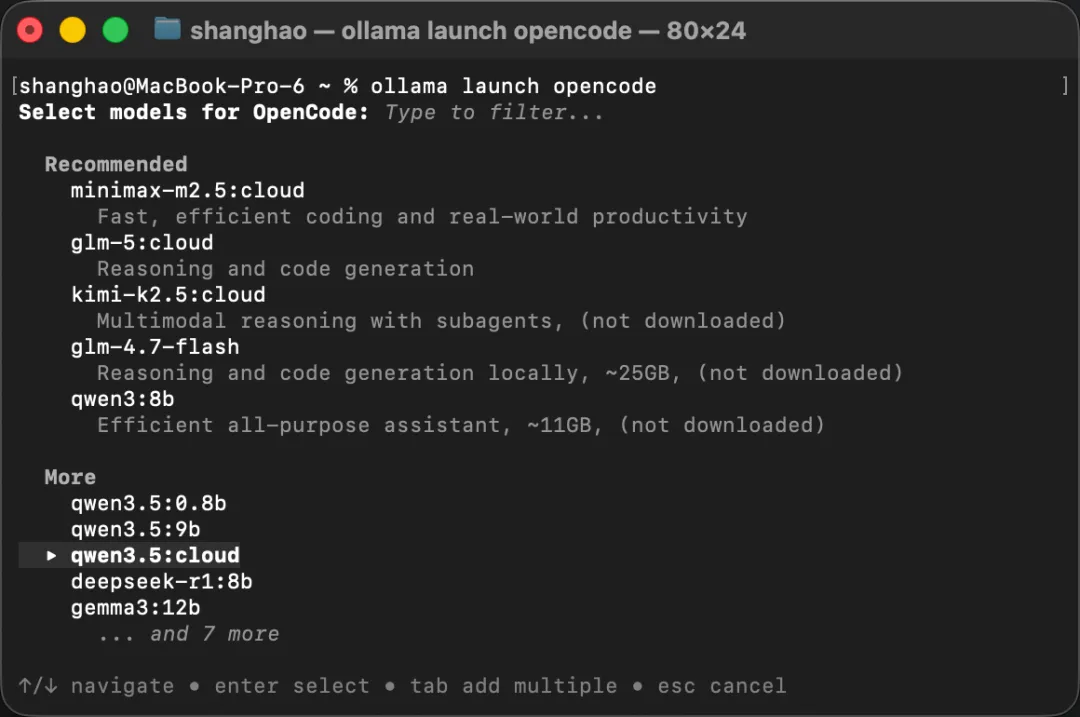

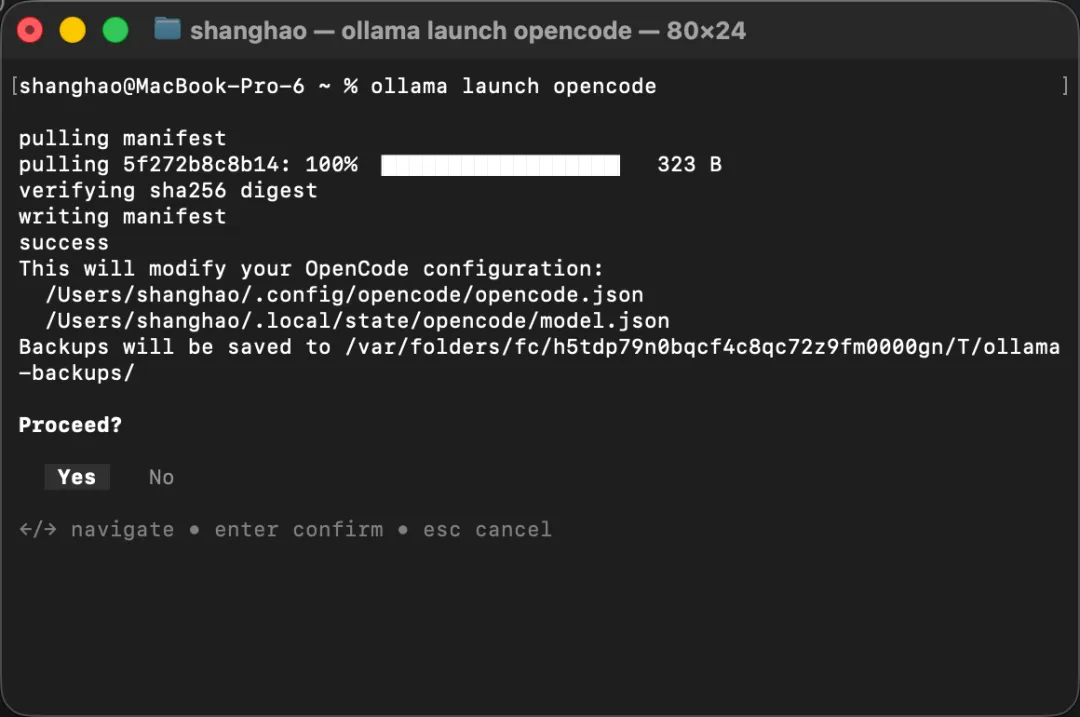

运行后,Ollama 会引导你选择模型,并自动帮你完成 OpenCode 配置。

如果你只想先配置,不马上启动 OpenCode,可以用:

ollama launch opencode –config

配好以后,回到 FLOWnote 或 OpenCode 的模型选择位置,选择刚才配置的 Ollama 模型即可。

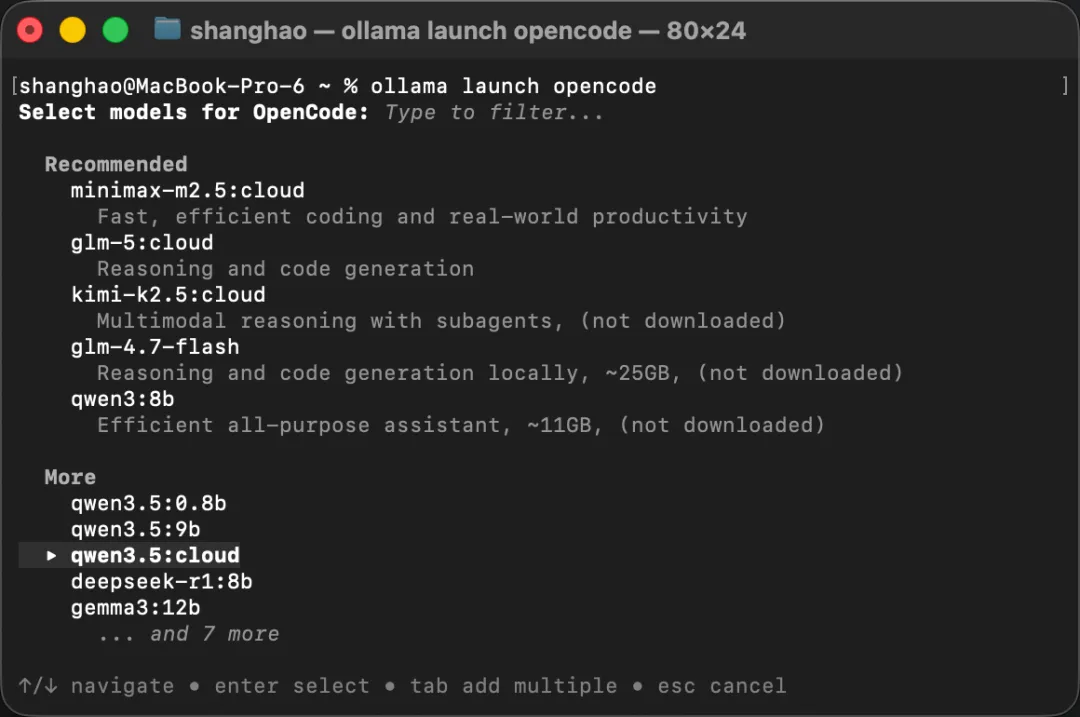

方案 C:配置 Ollama Cloud 云端模型

如果你的电脑带不动本地模型,或者不想占本机空间,也可以直接用 Ollama Cloud。

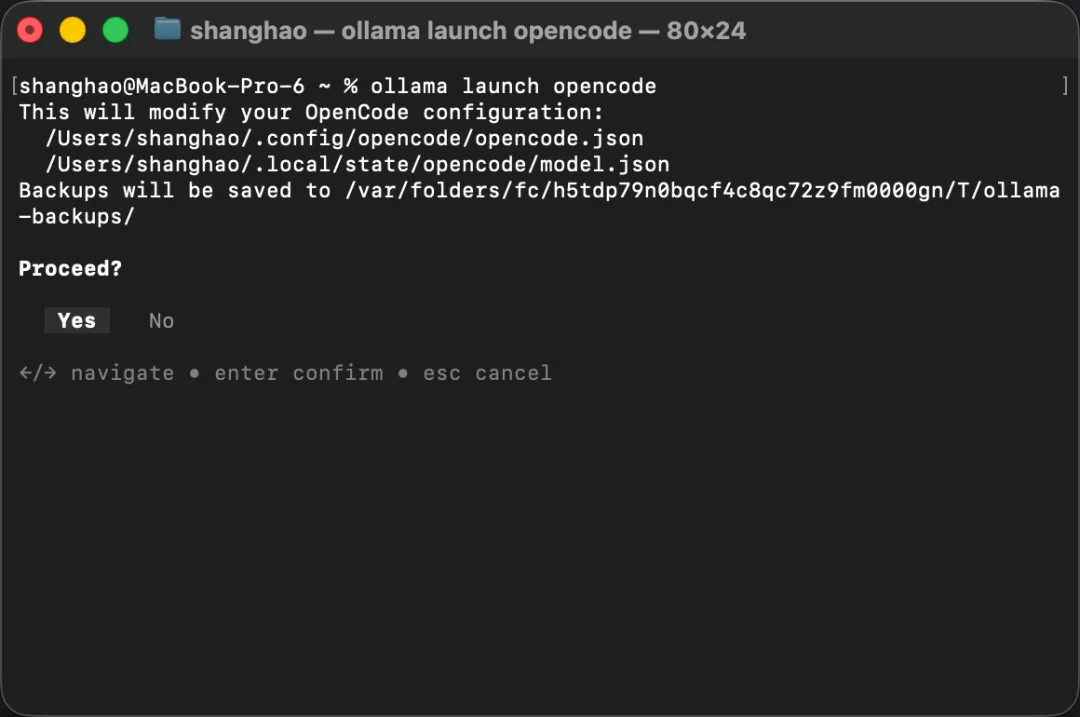

首先在 Ollama App 里登录,如果已经登录,这一步可以跳过。然后直接执行:

然后选择 Yes 并回车。等看到配置完成的画面后,按键盘右键,把选项切到 No,再按回车,就可以关闭终端了。

重启 Obsidian 后,如果模型列表里能看到刚才添加的模型,就表示配置正确。

如果你只是想先把 FLOWnote 跑起来,按照这篇文章做到“插件启用 + OpenCode 装好 + 选定一个能用的模型”,就已经足够开始用了。后面的复杂配置,不必一口气全做完。先把基础链路跑通,再按需求慢慢补,会轻松很多。