阿里面试官冷笑:"5000 份文档扔进去就算建好知识库了?难怪你的 RAG 答非所问." 我无言以对…

大家好,我是吴师兄。

之前有个学员面阿里的 NLP 岗,简历上写着”搭建了基于 RAG 的企业知识问答系统”。面试官翻着简历问: “你们知识库有多少文档?什么格式?”

他说:”大概 5000 份,PDF、PPT、Word 都有,还有一些扫描件。”

面试官接着问: “那你的离线解析是怎么做的?文档扔进去就完事了?”

他说了句”用 PyPDF 提取文本,然后按 512 token 切分”,面试官冷笑了一下:

“PDF 多栏排版你怎么处理的?表格结构丢了怎么办?切分的时候把一段完整的理赔流程从中间切断了,检索的时候能召回完整信息吗?”

他愣住了。

这个场景我见过太多次了。很多人做 RAG 项目,90% 的精力花在在线检索和模型选型上,却忽略了最基础的一环——离线解析和知识库构建。

真相是:你的知识库质量,决定了 RAG 系统效果的上限。 后面的检索再精准、模型再强大,如果喂进去的文档本身就是一坨乱码或者切分得支离破碎,那就是经典的 “Garbage in, Garbage out”。

今天我就把训练营里关于离线解析模块的内容给大家系统梳理一遍。

一、离线解析到底在干什么?

很多人对”离线解析”的理解就是”把文档变成文字”,这只对了 20%。

完整的离线解析流程其实包含五个步骤:多格式文档解析 → 内容清洗与规范 → 文本分块(Chunking) → Embedding 向量生成 → 索引构建与存储。每一步都有坑,每一步出问题都会导致后续链路全崩。

我在训练营的实战项目中,用的是一个金融保险公司的真实场景——5000 份不同格式的文档,包含 PPT、PDF、纯文本、扫描图片甚至视频,用户的问题涉及报销制度、销售策略、产品信息、理赔流程等各种类别。

这个场景下,离线解析面临的挑战比你想象的复杂得多。

二、多格式文档解析:第一个大坑

坑一:PDF 多栏排版解析错乱

这是实战中最高频的问题。很多保险公司的理赔流程指南采用双栏排版,左栏写步骤,右栏写具体要求。

传统 PDF 解析工具(比如 PyPDF2)是按行从上往下读的,它根本不理解”栏”这个概念。结果就是左栏第一行和右栏第一行被拼到一起,变成:

理赔流程 申请人需提交以下材料:事故发生后,尽快联系保险公司 - 身份证复印件这样一坨东西,语义完全混乱。用户问”理赔需要提交哪些材料”,检索系统根本无法从这堆乱文本中精准匹配到”材料提交”的部分。

正确做法是引入版面分析(Layout Analysis)技术。 先识别出文档的物理布局——哪些区域是左栏、哪些是右栏、哪些是表格、哪些是页眉页脚——然后按逻辑结构而非文本顺序提取内容。推荐使用 MinerU 或 Marker 这类专门做文档解析的工具,它们内置了版面分析能力,能正确处理多栏、表格等复杂布局。

坑二:OCR 把表格和代码全毁了

扫描版 PDF 必须走 OCR,但普通 OCR 对结构化内容的还原能力很差。

在我们的实战项目中,有一份保险产品对比表,原始格式是这样的:

| 险种 | 最高赔付 | 免赔额 ||------|---------|-------|| A款 | 500,000 | 5,000 || B款 | 300,000 | 3,000 |OCR 处理后变成了:

险种 最高赔付 免赔额 A款 500000 5000 B款 300000 3000表格结构完全丢失,所有数据串成一行。如果用户问”A款的免赔额是多少”,检索系统很难从这行流水账里准确提取答案。

代码块也是重灾区。一段 Python 代码经过 OCR 后,缩进丢了、括号没了、关键字都变形了:

# 原始代码def calculate_payout(amount, deductible):return max(amount - deductible, 0)# OCR 后def calculate payout(amount deductible)return max amount - deductible 0优化方案: 对表格区域做专门的表格识别,按单元格顺序输出并保留结构化格式;对代码块设置 OCR 保持换行和空格格式。整体建议使用 PaddleOCR 配合版面分析,先检测区域类型(文字/表格/代码/图片),再分别用针对性策略处理。

坑三:PPT 里的图片信息直接丢了

PPT 是另一个容易出问题的格式。python-pptx 能提取文本框里的文字,但对嵌在图片里的文字完全无能为力。

在项目中,有份产品说明 PPT,关键信息”保障范围:重大疾病、意外伤害,最高赔付额度:500,000 元”是做在图片里的。传统解析直接返回空,这部分知识就从知识库中彻底消失了。

解决办法: 对 PPT 中的图片元素,先提取出来做 OCR 识别,把图片中的文字也纳入知识库。同理,视频类文档需要先做语音识别(ASR)得到字幕文本,再按内容语义分段入库。

三、文本分块:看似简单,实则最容易翻车

解析完文档拿到了干净文本,接下来就是分块(Chunking)。这一步直接决定了检索的精度——块切得好不好,比你选什么 Embedding 模型都重要。

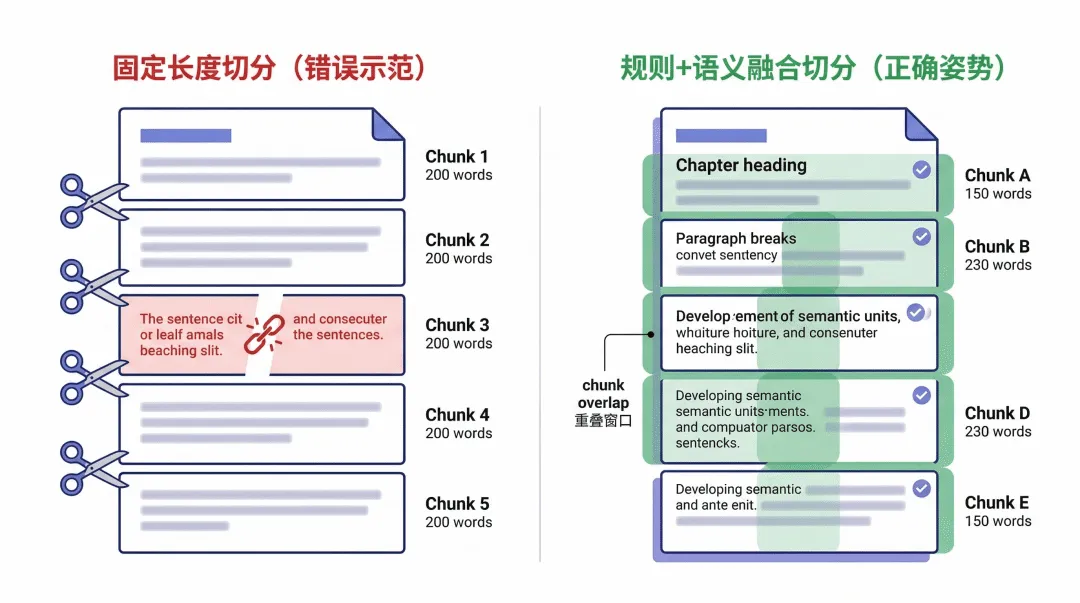

固定长度切分:最简单也最粗暴

很多教程教你”按 512 token 固定切分”,这是最偷懒的做法。它的问题在于完全不管语义边界,可能把一段完整的理赔流程从中间切开。

比如一段文档讲的是”特殊情况处理:交通事故需提供交警事故责任认定书;重大疾病保险理赔需提供住院病历”,如果刚好在”交通事故需提供交警事故”这里被切断,那用户问”重大疾病理赔需要什么材料”时,这个 chunk 里根本没有完整信息,还跟”特殊情况处理”这个上下文断开了,检索系统也无法识别它属于特殊情况的一部分。

正确姿势:规则 + 语义融合切分

在我们的实战项目中,采用的是三层切分策略:

第一层:基于文档结构的规则切分。 利用章节标题、段落换行、列表项、表格边界等自然结构作为切分点。检测到新章节或新列表就开启新 chunk。表格和代码块整段作为一个 chunk,绝不中途截断。

第二层:语义连贯性检查与调整。 规则切完后,检查相邻 chunk 的语义连贯性。如果某个 chunk 过短且和前后内容语义紧密相关(比如上一个 chunk 以冒号结尾、内容未完结),就跟相邻 chunk 合并。跨页的段落如果下页开头不是新章节标题,也应该合并为同一 chunk。

第三层:长度平衡。 在保证语义完整的前提下控制 chunk 长度。过长的按语义次级节点再拆分,过短的与相邻内容补充合并。最终每个 chunk 都是自包含、主题聚焦的一段内容。

另外还有一个关键细节——重叠窗口(chunk overlap)。上一个 chunk 的最后两三句话同时出现在下一个 chunk 的开头,保留块与块之间的连续性,避免硬切分导致的上下文断裂。

四、层级标签:大多数人忽略的隐藏大招

分块做好了,很多人就直接算 Embedding 入库了。但这样做丢掉了一个极其重要的信息——文档的层级结构。

在训练营的实战项目中,保险公司的文档都是有清晰层次的:一级标题是”报销政策”,下面二级标题有”差旅报销””医疗报销””通讯报销”等。如果你在分块时把”差旅报销上限 5000 元”这段内容切出来,但不记录它属于”报销政策 > 差旅报销”这个层级路径,那检索的时候就少了一层上下文。

层级标签的做法是: 在解析阶段捕获文档的层次结构,维护一个层级栈。比如检测到”1 总则”是一级标题,”1.1 范围”是二级标题,就把当前 chunk 标记为”总则 > 范围”。检索时,这些标题词也会参与索引匹配,用户搜索”差旅报销”不仅能匹配到 chunk 内容本身,还能通过层级标签匹配到相关 chunk。

除了层级标签,还建议给每个 chunk 打上内容类别标签——标记它是”表格””代码块”还是普通文本,属于”政策条例”还是”操作指南”。以及来源标签——记录来源文档名、页码、幻灯片编号等,方便检索命中后追溯原文,也方便在生成答案时标注引用出处。

这些元数据看起来不起眼,但在检索阶段可以用来做元数据过滤。比如用户问”昨天发布的报销制度有什么变化”,系统识别出时间约束”昨天”后,就可以在检索时用发布时间过滤,大幅缩小候选范围,提升命中精度。这个能力的前提就是离线阶段已经把这些元数据标好了。

五、模块联动:离线质量如何影响全链路

很多人把离线解析和在线检索当成两个独立的事情来做,这是大忌。实际上它们之间的联动关系非常紧密,离线阶段的每一个决策都会在在线阶段产生连锁反应。

chunk 大小要配合 LLM 上下文窗口

chunk 切多大,不是拍脑袋决定的。你得考虑:LLM 的上下文窗口能放多少个 chunk?

块太大,一个 chunk 可能就占了几千 token,LLM 一次只能放两三个片段,覆盖面就很窄。块太小,虽然每个 chunk 更精确,但语义残缺,召回阶段需要拼凑更多片段才能凑出完整答案,容易触发上下文窗口限制,而且信息散乱会干扰模型理解。

理想的 chunk 长度需要通过实验,在召回准确率和生成效果之间取得平衡。

元数据质量决定检索过滤能力

前面讲了,离线阶段存储的层级标签、内容类型、发布时间等元数据,在在线阶段可以用来做精准过滤。如果离线阶段偷懒没打这些标签,在线阶段想过滤都没法过滤,只能靠纯语义匹配硬撑,效果自然差。

解析质量直接影响 Embedding 质量

如果 OCR 把表格解析成了一行乱码,就算你用最好的 Embedding 模型去编码,得到的向量也是”乱码的语义表示”。后续无论用向量检索还是 BM25,都不可能准确匹配到用户的问题。

这就是为什么我在训练营里反复强调:离线解析是 RAG 的地基,地基打不好,上层建筑再漂亮也是空中楼阁。

六、面试怎么说?

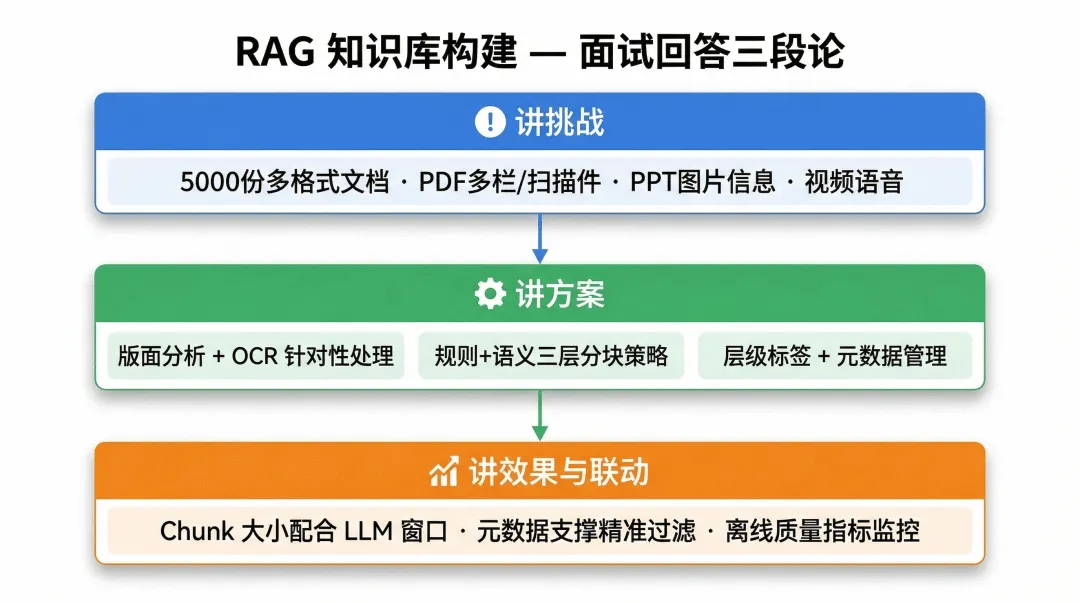

如果面试官问你”离线解析模块是怎么做的”或者”知识库是怎么建的”,你可以这样展开:

先讲挑战。 我们项目有 5000 份多格式文档,包含 PDF(多栏排版、扫描版)、PPT、纯文本甚至视频。主要挑战是多格式统一解析、OCR 对表格和代码的还原、以及分块时保持语义完整性。

再讲方案。 解析层面,我们针对不同格式做了针对性处理——PDF 用版面分析技术处理多栏和表格,扫描件用 PaddleOCR 配合区域检测,PPT 对图片元素做 OCR 补充提取,视频走 ASR 转字幕。分块层面,采用规则+语义融合的三层切分策略,配合 chunk overlap 保持连续性。同时给每个 chunk 打上层级标签、内容类型和来源元数据,支持在线阶段的精准过滤。

最后讲效果和联动。 chunk 大小通过实验配合 LLM 上下文窗口调优,元数据标签在检索阶段支持按时间、来源、类型等维度过滤,整体提升了召回的准确率。我们用解析失败率、平均 chunk 长度等指标监控离线流程质量,持续迭代优化。

这样回答,从挑战到方案到效果,有实战细节有系统思维,比干巴巴地说”用 PyPDF 提取再固定切分”强十倍。

写在最后

RAG 系统的优化,很多人一上来就盯着 Rerank、混合检索这些”上层”技术,却忽略了离线解析这个”地下室”。

但实际上,我在项目中踩过的最深的坑,全都出在离线阶段——PDF 解析错乱导致检索结果语义混乱、固定长度切分导致关键信息被切断、缺少元数据标签导致无法做时间过滤……这些问题在在线阶段根本补救不了。

记住一句话:RAG 系统效果不好,先别急着换模型、调参数,先回去看看你的知识库是不是一团糟。

如果这篇文章对你有帮助,欢迎转发给同样在做 RAG 项目的朋友。有问题可以在评论区交流,我会尽量回复。

夜雨聆风

夜雨聆风