TGRS 2025 | 轻量插件 yyds!UMIS-YOLO 两大模块:频域增强 + 残差融合,水下分割提速提效

点击下方名片,每天获取最新论文

先抛个结论:这款基于YOLO改造的UMIS-YOLO,在自建的UMIS-Coral珊瑚数据集上mAP50和mAP75分别涨了2.3和3.0,在扩展后的UIIS水下数据集上更是涨了3.9和2.8,还能保持实时分割速度,最高83FPS!咱就是说,这波操作属实把水下多模态融合玩明白了~

论文信息

题目:UMIS-YOLO: Underwater Multimodal Images Instance Segmentation With YOLO

基于YOLO的水下多模态图像实例分割方法

作者:Yue Yang, Xiaoyi Feng, Ming Li, Xiangyun Hu, Jiangying Qin, Armin Gruen, Deren Li, Jianya Gong

源码:https://github.com/zhangsanhulk/UMIS-YOLO

为啥水下珊瑚分割这么难?

先聊聊背景,水下实例分割可不是闹着玩的,尤其是珊瑚礁——珊瑚形态千奇百怪,边界模糊得像开了柔光,还总跟海底岩石“撞脸”,加上水下光照忽明忽暗、图像容易失真,传统只靠RGB图像的分割方法,要么漏检要么边界画不准,简直是CVer的噩梦。

过去的方法要么精度不够,要么速度太慢,没法落地到水下机器人实时监测的场景。这篇论文的作者直接剑走偏锋:既然单模态不行,那就上双模态!把RGB图像(管颜色纹理)和深度图像(管边界轮廓)捏到一起,再配两个自研的“神级模块”,直接把痛点全解决了~

核心架构:双主干+双模块,把多模态玩出花

先上大招——UMIS-YOLO的整体架构图镇楼👇

是不是一眼就能看明白?核心就是在YOLO原有架构(主干+颈部+头部)基础上,做了两个关键改造:

-

双主干网络:一个专门啃RGB图像的特征,一个专攻深度图像的特征,再也不用让单主干“兼顾两头”,各自发挥强项; -

两个即插即用模块:频域特征增强融合模块(FDFEF)+残差特征融合模块(RFF),前者负责多模态特征“提纯融合”,后者负责补全细节,简直是黄金搭档。

咱挨个唠唠这两个模块有多牛:

1. FDFEF模块:频域“魔法”,让特征更纯粹

传统的特征融合都是在空间域瞎凑活,作者直接把特征扔到频域去处理,用傅里叶变换把特征拆成振幅和相位,再用可学习的权重给RGB和深度特征“精准加权”——简单说,就是把目标特征放大,把背景噪声摁住,再把两种模态的优点捏到一起。

放张FDFEF模块的结构图,一看就懂👇

这个模块最绝的是,既能增强单模态的特征,又能让RGB和深度特征的融合不掺水,不像直接拼接通道那样容易引入噪声,实测在珊瑚数据集上mAP50直接涨了0.3,mAP75涨了0.9,性价比拉满!

2. RFF模块:残差补细节,分割边界更丝滑

实例分割拼的就是像素级细节,可深层网络容易把底层的细节丢了。作者设计的RFF模块,专门把主干网络最底层的P1特征(像素级细节拉满)和颈部的高层特征(语义信息足)用残差的方式融到一起,还能动态调整通道大小,不增加多少参数,却能让分割边界精准到“像素级”。

看看RFF模块的结构👇

消融实验证明,单加RFF模块,mAP50涨0.8,mAP75涨1.5,而且参数还少了——既要精度又要轻量化,这波属实双赢!

数据集:开源高难度UMIS-Coral,专治各种不服

光有方法不够,得有硬通货数据集!作者搞了个UMIS-Coral数据集,堪称水下珊瑚分割的“地狱级”题库:

-

3143张400×400高分辨率图,每张都配RGB+深度图像,分辨率精准到1毫米; -

24960个珊瑚实例,活珊瑚、死珊瑚都有,还全是专业人员标注的像素级标签; -

珊瑚和岩石长得像、还互相遮挡,难度直接拉满!

除此之外,作者还给经典的UIIS水下数据集补了深度图像,用DepthAnythingV2生成的深度图,让数据集也能支持多模态研究,太良心了~

实验结果:吊打基线,鲁棒性还贼强

咱用数据说话:

-

在UMIS-Coral数据集上,对比YOLOv8m/11m/12m,UMIS-YOLO的mAP50分别涨2.3/0.9/0.2,mAP75涨3.0/1.6/0.1; -

在UIIS数据集上,YOLOv8m加了UMIS-YOLO的改造后,mAP50直接涨3.9,mAP75涨2.8; -

速度还贼快,基于YOLOv8m的版本能跑到83FPS,水下机器人实时用完全没问题!

看看分割效果对比图,差距一眼就能看出来👇

左边是传统YOLO,要么漏检要么边界糊,右边UMIS-YOLO不仅全检出来,珊瑚的边缘还贼清晰!

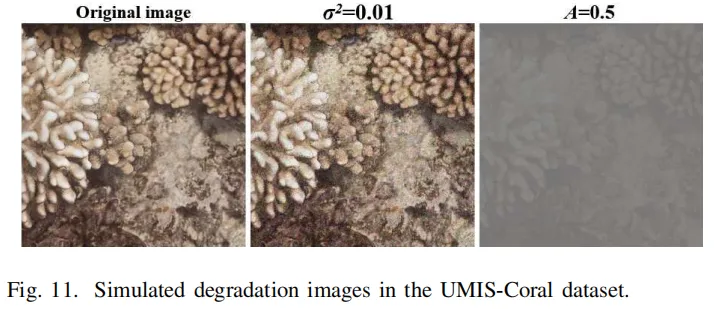

更狠的是鲁棒性实验——作者给图像加了高斯噪声、雾化噪声,模拟水下恶劣环境,结果UMIS-YOLO的性能下降幅度远小于原版YOLOv11m,抗造能力拉满👇

总结:水下分割的“最优解”之一

UMIS-YOLO这篇论文,核心就是把“多模态融合”玩到了极致:双主干解决特征提取问题,FDFEF解决频域融合问题,RFF解决细节补全问题,还开源了高价值数据集,既兼顾精度又兼顾速度,简直是水下实例分割的“六边形战士”。

当然作者也说了,极端场景下(比如RGB和深度都分不清目标)还有提升空间,未来可以加声纳模态、进一步轻量化,但现阶段已经足够能打了!

夜雨聆风

夜雨聆风