OpenClaw 记忆总掉线?这个开源插件,正在把长期记忆补到生产级

有一说一,OpenClaw 自带的基础记忆插件,能用是能用,但只要对话一拉长,问题就很容易暴露出来。

前面明明聊过的设定、偏好、任务背景,过一会儿就像没发生过一样。你会很明显感觉到,小龙虾不是不会聊,而是“记不住重点”。

刚好最近看到一个开源插件,名字叫 memory-lancedb-pro,就是冲着这件事来的。

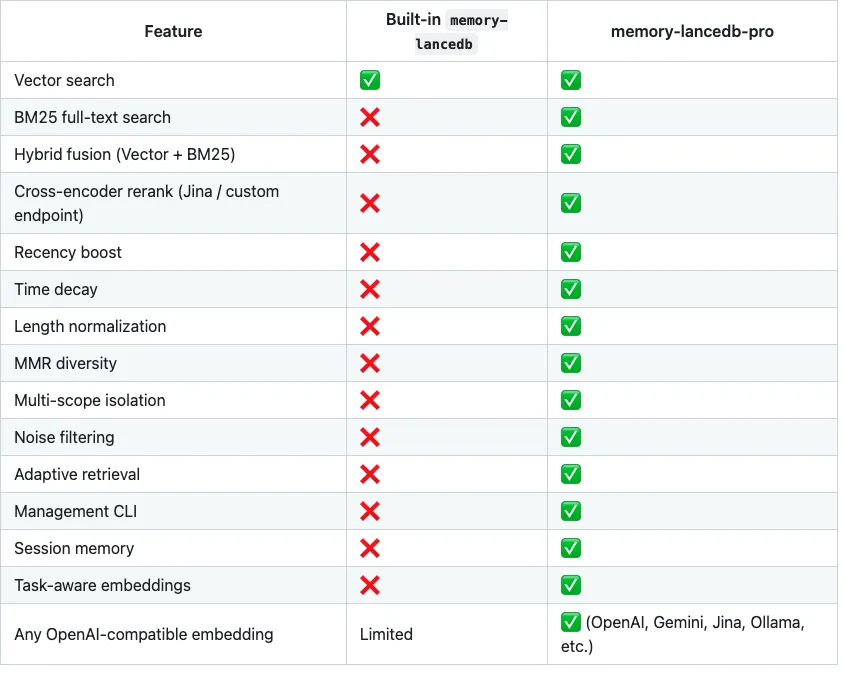

它做的不是那种“把记忆多存一点”的小修小补,而是直接把 OpenClaw 的记忆检索这件事,往更像生产环境的方向推了一大步。

一句话概括:它不是在堆记忆,而是在认真解决“怎么把对的记忆,在对的时候捞出来”这件事。

问题其实不在“存不存”,而在“会不会找”

很多人刚接触 Agent 记忆系统时,容易有个误区:以为记忆差,是因为存得不够多。

但实际用下来你会发现,真正的问题常常不是没存进去,而是到了该用的时候,没把最重要的那几条捞出来。

尤其是长对话场景里,简单的模糊匹配很容易失灵。

你想让它回忆“用户之前明确提过自己在做 OpenClaw 插件调试”,结果它给你翻出来的是几段语义接近、但价值不高的旧聊天碎片。表面上像在检索,实际上一点没帮上忙。

而 memory-lancedb-pro 比较有意思的地方,就在这里。

它不再只靠一套粗糙的相似度搜索硬顶,而是把语义理解和关键词匹配放到一起做,还会尽量保证最后喂给 AI 的,不是最像的那堆内容,而是最新、最核心、最该被记住的信息。

这就很关键了。

因为长期记忆这东西,最怕的不是“忘”,最怕的是记混了、记偏了、记出一堆陈旧上下文。那比忘掉还麻烦。

这类插件最值钱的,不是“能记”,而是“记得越来越像回事”

我看这个项目时,另一个比较戳我的点,是它不只是做了检索增强。

它还支持自我反思和纠错。

这个说白了,就是别让 Agent 每次都把旧错误原样存进知识库,越存越乱。它需要有一点点“复盘能力”——知道哪些记忆该强化,哪些记忆可能过时了,哪些结论之前判断错了,后面要修。

很多所谓“记忆系统”做着做着会变成一个巨大的聊天垃圾桶,什么都往里塞,最后越用越浑。

但如果有反思和纠错这层机制,味道就不一样了。

它开始像一个真的在长期工作的 Agent:不是机械囤积上下文,而是在对话里慢慢修正自己的知识状态。

这件事平时可能不显山不露水,但一旦你拿它跑长周期任务,差别会非常明显。

另外一个很实用的点,是它的接口兼容做得比较宽。

Jina、OpenAI、本地 Ollama 这些常见方案都能接,意味着不管你现在是云端优先,还是本地优先,配置上都还有转圜空间,不至于被绑死在某一套栈里。

这类插件我现在会特别在意一个问题:它到底是“演示能跑”,还是“真能接进现有工作流”。

memory-lancedb-pro 至少从设计思路上看,是偏后者的。

包括它自带了完整的 CLI 命令行工具,这点我觉得比很多人想的更重要。

这两年大家都在聊 Agent,聊工具调用,聊工作流自动化。

但很多时候,Agent 真正卡住的,不是不会做事,而是做着做着就忘了自己之前做过什么。

这事听起来有点好笑,其实很伤。

所以像 memory-lancedb-pro 这种插件,未必最热闹,但很有可能是那种你装上之后,过几天会回来说一句:

哦,这下终于像个有长期记性的 Agent 了。

GitHub地址: win4r/memory-lancedb-pro

夜雨聆风

夜雨聆风