Claude 源码泄露:一家 AI 安全公司 5 天漏了两次,但泄出来的东西比发布会还炸

2026 年 3 月 26 日,Anthropic 的内容管理系统配置出错,将近 3000 份内部文件直接挂在了公网上。里面藏着一份没发布的博客草稿,详细描述了一个叫 Claude Mythos 的新模型——Anthropic 自己在草稿里写它”在网络安全能力上远超现有主流 AI 模型”,强到他们不敢公开发布。

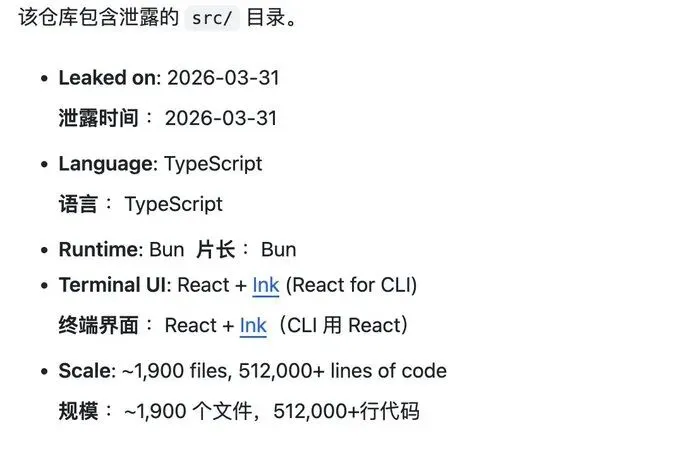

5 天后,2026 年 3 月 31 日,他们的 npm 包又出事了。Claude Code 2.1.88 版本发布时,打包脚本没有排除一个叫 .map的调试文件,结果 51 万行 TypeScript 源码直接裸奔在公网上。安全研究员 Chaofan Shou 在 X 上发了条帖子,几个小时内浏览量破千万,GitHub 镜像仓库被 fork 了超过 4 万次。

Anthropic 官方回应很快:这是人为打包失误,不是安全漏洞,没有用户数据泄露。

话是没错。但一家靠”AI 安全”吃饭的公司,5 天之内因为人为疏忽连着曝光两次——这画面怎么看都有点尴尬。

不过讽刺的是,泄出来的东西,确实比大多数发布会都让人兴奋。

源码里藏着的三个信号:Claude Code 想变成 24 小时数字员工

全网扒出来的功能清单有几十条,这里不搞罗列。我只挑三个——每一个都指向同一个方向:Claude Code 不想只在你打字的时候才工作了。

信号一:你下班之后,它帮你”做梦”

源码里有个代号叫 KAIROS 的功能模块(希腊语,意思是”恰当的时机”),在代码中被引用了超过 150 次。

它的核心逻辑是:Claude Code 变成一个后台常驻进程。你关掉终端窗口,它还在。

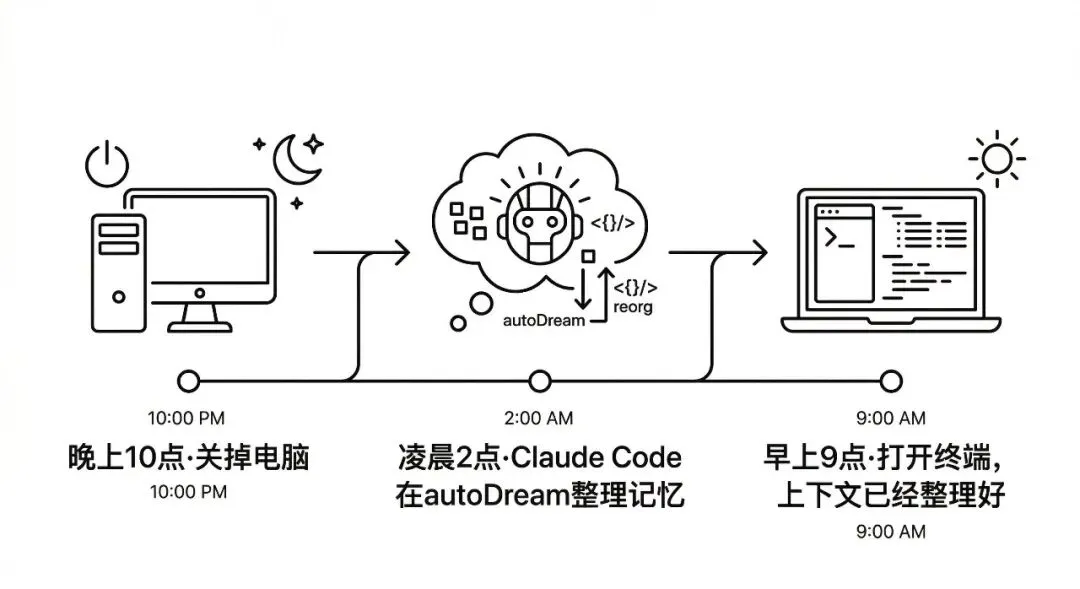

更有意思的是配套的 autoDream 机制——”做梦”。在你不用它的时候,它会自动回顾之前的对话历史,把矛盾的信息删掉,把模糊的笔记整理成明确的结论。

翻译成职场场景就是:你晚上关电脑走人,第二天早上打开 Claude Code,它已经把昨天那堆乱糟糟的上下文梳理好了。不用你从头解释”我们聊到哪儿了”,它自己记得,而且比你记得更清楚。

泄露的代码还显示,KAIROS 有自己的一套专属工具——可以直接推送文件给你、发手机通知、甚至监控你的 Pull Request 动态。这已经不是”助手”的定位了。

当然要说清楚:这些都是源码中的 feature flag(功能开关),编译到外部版本时会被移除,目前并没有正式上线。但代码已经写好了,不是 PPT,不是概念图。

信号二:你推完代码去睡觉,它自动跑测试、自动修 bug

另一组功能叫 DAEMON 和 AGENT_TRIGGERS。

DAEMON 让 Claude Code 像系统服务一样在后台持续运行。AGENT_TRIGGERS 则设定触发条件——比如”代码提交后自动跑测试”、”CI 失败后自动尝试修复”。

场景翻译:你 push 完代码去睡觉,早上醒来看手机消息——”测试全过了”,或者”有 3 个失败,我已经修了 2 个,第 3 个需要你看一眼”。

这跟目前 Claude Code 已有的定时任务功能组合起来,意味着它不再是”你问一句它答一句”的对话工具,而是一个能按条件自动启动、自主执行、主动汇报的后台工人。

信号三:一个 Claude 指挥一群 Claude,并行干活

源码里有完整的 Coordinator Mode(协调者模式)实现。一个”协调者”Agent 只负责拆解任务和分配工作,多个”工人”Agent 并行执行各自的子任务,干完再合并结果。

配套的工具也齐全——创建团队、发送消息、查看同伴列表,一整套多 Agent 协作的基础设施全写好了。

场景翻译:你说”帮我重构这个项目的权限系统”,协调者把任务拆成 5 块,5 个子 Agent 同时干,干完合并。不是排队,是并行。

这三个信号拼在一起,指向同一个结论:Claude Code 正在从”你问它答”的工具,变成”你不在它也能干活”的数字员工。

51 万行工业代码里,还藏了个电子宠物

聊完正经的,说个轻松的。

源码里有个代号叫 BUDDY 的模块,是一个完整的拓麻歌子风格电子宠物系统。不是占位符,不是玩笑代码——是认认真真写了物种、稀有度、属性值的完整实现。

18 个物种,从鸭子、水豚、蘑菇到龙和幽灵,分 5 个稀有度等级,还有 1% 概率的闪光变体。每个宠物有 5 项属性:调试能力、耐心值、混乱值、智慧值、毒舌值。

每个用户的宠物由账户 ID 的哈希值决定,同一个账户永远绑定同一只。它住在你的终端输入框旁边,用 ASCII 字符画渲染,还有待机动画和互动反应。

泄露代码显示,这个功能计划在 2026 年 4 月 1 日到 7 日做预告,5 月正式上线,先从 Anthropic 内部员工开始。

在 51 万行工业级代码里藏一个扭蛋宠物系统——这大概就是硅谷工程师的浪漫。

顺便提一句更讽刺的:源码里有一个专门的 Undercover Mode(卧底模式),功能是阻止 Claude Code 在 git 提交记录里不小心暴露内部代号和项目名。换句话说,他们专门造了一套防泄露系统——然后源码本身泄了。

泄露本身不大,但它暴露的方向很大

先说影响:有限。没有用户数据,没有模型权重,Anthropic 已经确认并修复。GitHub 上的镜像仓库已经被 DMCA 陆续下架——虽然去中心化平台上的备份还在,但那是另一个故事了。

再说方向:这才是重点。

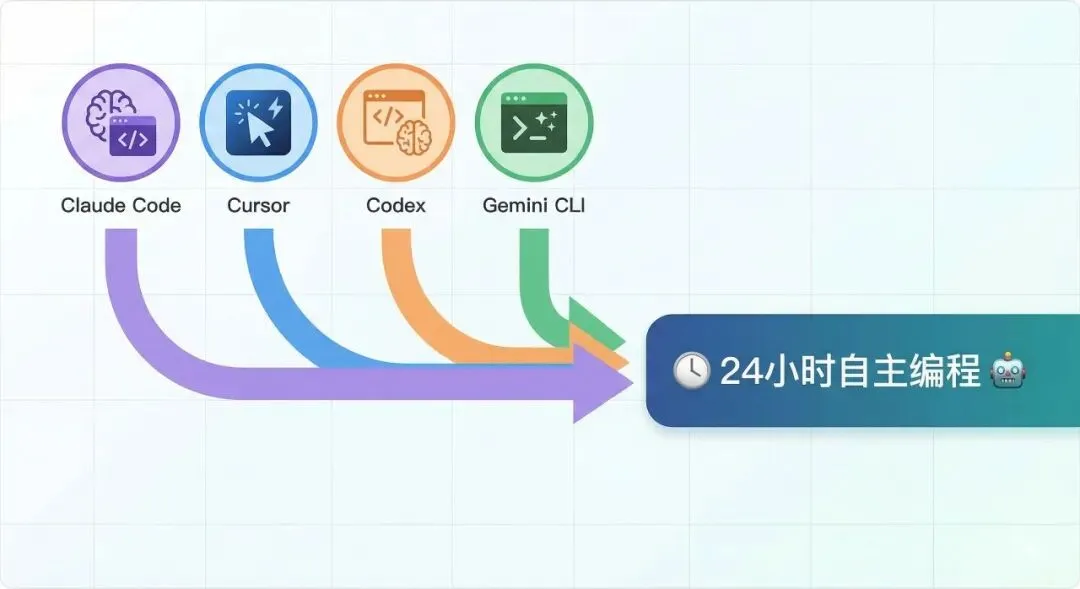

这次泄露让所有人看到了 AI 编程工具竞争的下一个战场——不再是”谁的代码补全更准”,而是”谁能 24 小时替你干活”。后台常驻、自动触发、多 Agent 协作、记忆整理——这些功能放在一起,描绘的不是一个更好用的编程助手,而是一个不下班的数字同事。

对于普通用这些工具写代码的人来说,信号很明确:你的 AI 编程助手正在从”你叫它才动”变成”你不叫它也在干活”。这个定位的变化,比任何一次模型升级都大。

对竞争对手来说——Cursor、Codex、Gemini CLI——Anthropic 接下来半年的产品路线图现在是透明的。AI 编程工具的迭代速度接下来只会更快。

Anthropic 花了几十亿美金研究怎么让 AI 更安全。这次泄露给了一个意外的提醒——在让 AI 安全之前,先把 .npmignore写好吧。

夜雨聆风

夜雨聆风