✓ 系统兼容性检查:明确各操作系统要求,确认你的设备是否支持

✓ 安装文件获取:提供官方下载链接和包管理器命令

✓ 分平台安装步骤:Windows、macOS、Linux详细安装指南

✓ 基础配置与验证:环境变量设置和安装验证方法

✓ 常见问题解决:权限问题、网络问题、硬件加速配置等解决方案

Ollama本地安装完整指南:从系统检查到模型部署的全流程

你是否想在本地运行强大的大语言模型,却苦于复杂的部署流程?是否担心云端API的隐私安全问题?Ollama的出现解决了这些痛点,让普通人也能轻松在个人电脑上部署和运行顶尖AI模型。本文将带你完成从系统检查到模型运行的全过程,即使是技术新手也能顺利上手。

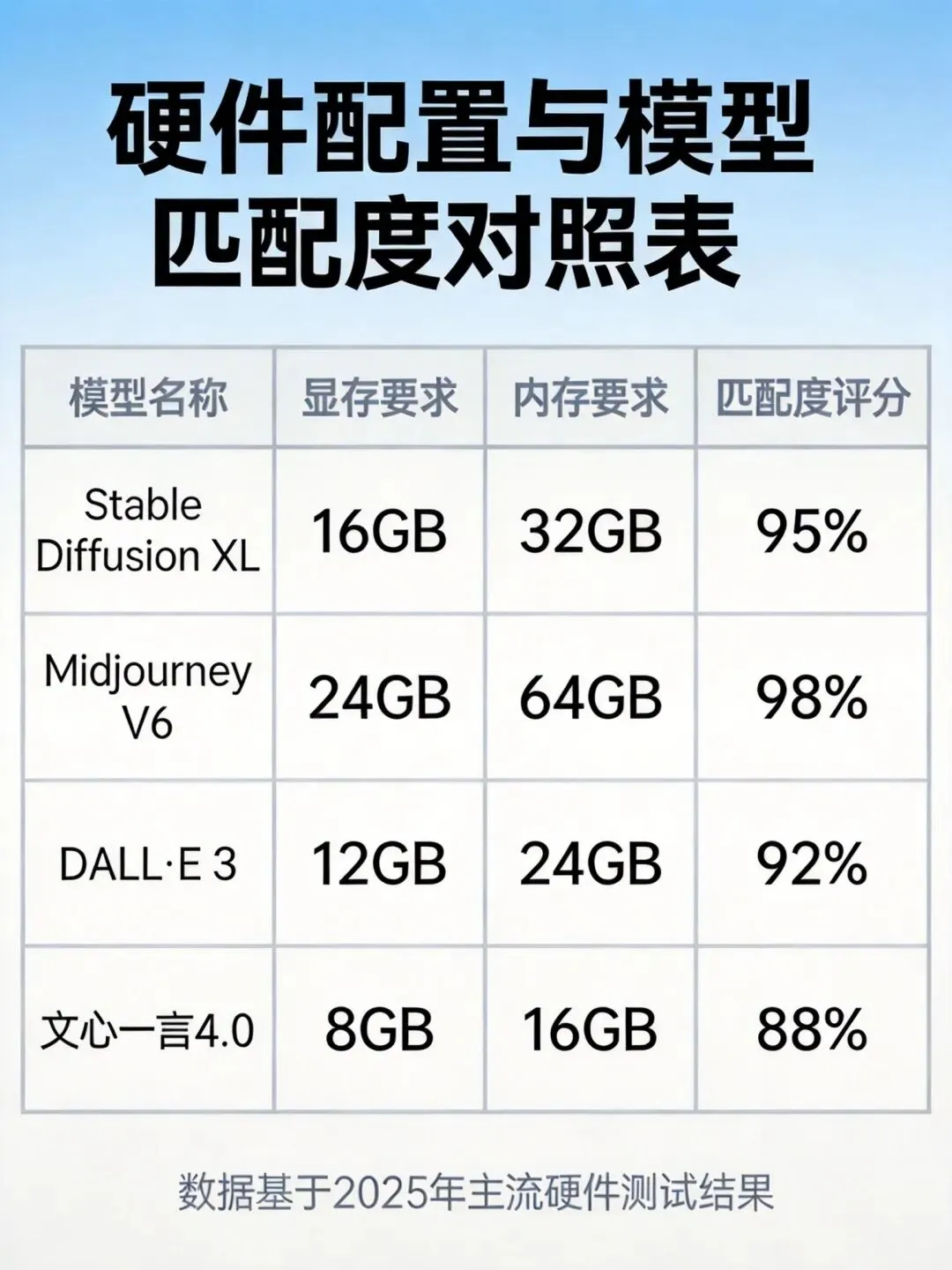

硬件要求误区:很多人认为运行大模型需要高端GPU,实际上Ollama支持CPU运行,只是速度较慢。轻量级模型如Qwen2.5:1.8B在8GB内存的电脑上也能运行。

系统兼容性误区:Ollama支持Windows 10/11、macOS 12+和主流Linux发行版,但很多用户不清楚具体版本要求,导致安装失败。

安装流程误区:部分用户直接下载安装包却忽略了环境变量配置,导致命令行无法识别ollama命令。

模型选择误区:新手往往直接下载最大模型,结果因硬件不足导致运行失败。

网络问题误区:模型下载速度慢并非都是网络问题,很多时候是因为没有配置国内镜像源。

步骤1:系统兼容性检查

Ollama支持Windows、macOS和Linux三大操作系统,但对版本有一定要求:

Windows系统要求

操作系统:Windows 10 64位或更高版本(推荐Windows 11)

架构:x86_64处理器

最低配置:8GB内存,4核CPU

推荐配置:16GB内存,支持AVX2指令集的CPU,NVIDIA GPU(4GB+显存)

macOS系统要求

操作系统:macOS 12 (Monterey) 或更高版本

架构:Apple Silicon(M1/M2/M3系列)或Intel处理器

最低配置:8GB内存

推荐配置:16GB内存,Apple Silicon芯片

Linux系统要求

支持的发行版:Ubuntu 20.04+、Debian 11+、CentOS 8+、Fedora 36+等

架构:x86_64或ARM64

最低配置:8GB内存,4核CPU

推荐配置:16GB内存,NVIDIA/AMD GPU(支持CUDA/ROCm)

步骤2:安装文件获取

根据你的操作系统选择合适的安装方式:

Windows系统

官方下载地址:https://ollama.com/download

直接下载OllamaSetup.exe安装包

macOS系统

方法一:官网下载dmg安装包

方法二:使用Homebrew安装(推荐)

Linux系统

一键安装脚本(推荐)

支持Ubuntu、Debian、CentOS等主流发行版

步骤3:分操作系统安装步骤详解

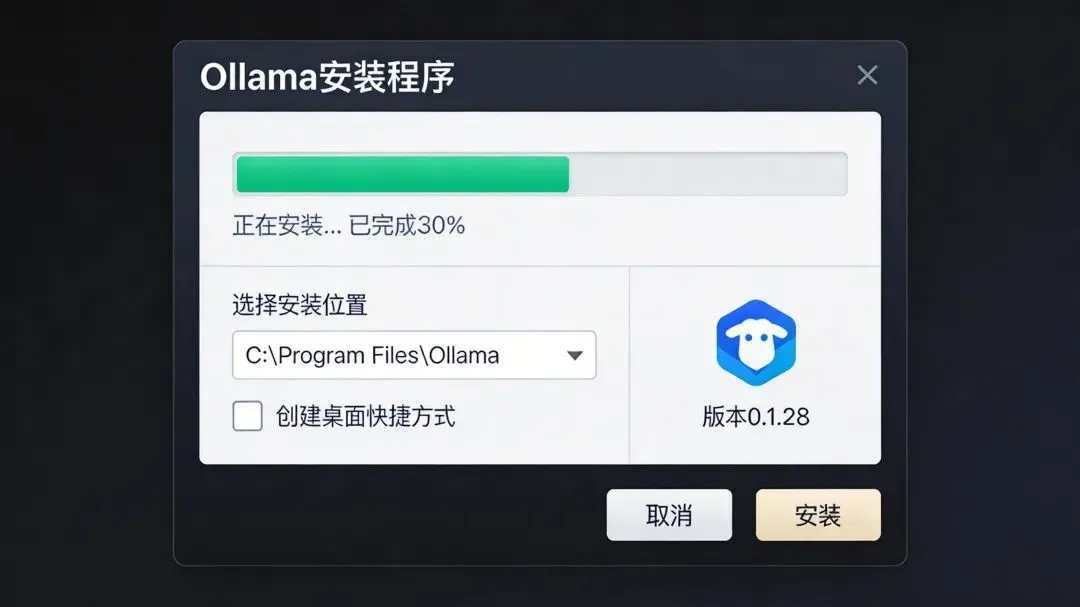

Windows安装步骤

下载OllamaSetup.exe安装文件

双击运行安装程序,出现安装界面

点击"Install"开始安装,务必勾选"Add to PATH"选项

等待安装完成(通常需要1-2分钟)

安装完成后,Ollama服务会自动启动,系统托盘会出现Ollama图标

打开PowerShell或命令提示符,验证安装

macOS安装步骤

方法一:通过dmg安装包

下载Ollama-darwin.zip并解压

将Ollama拖入Applications文件夹,从应用程序启动Ollama

方法二:通过Homebrew安装

Linux安装步骤

步骤4:基础配置与验证

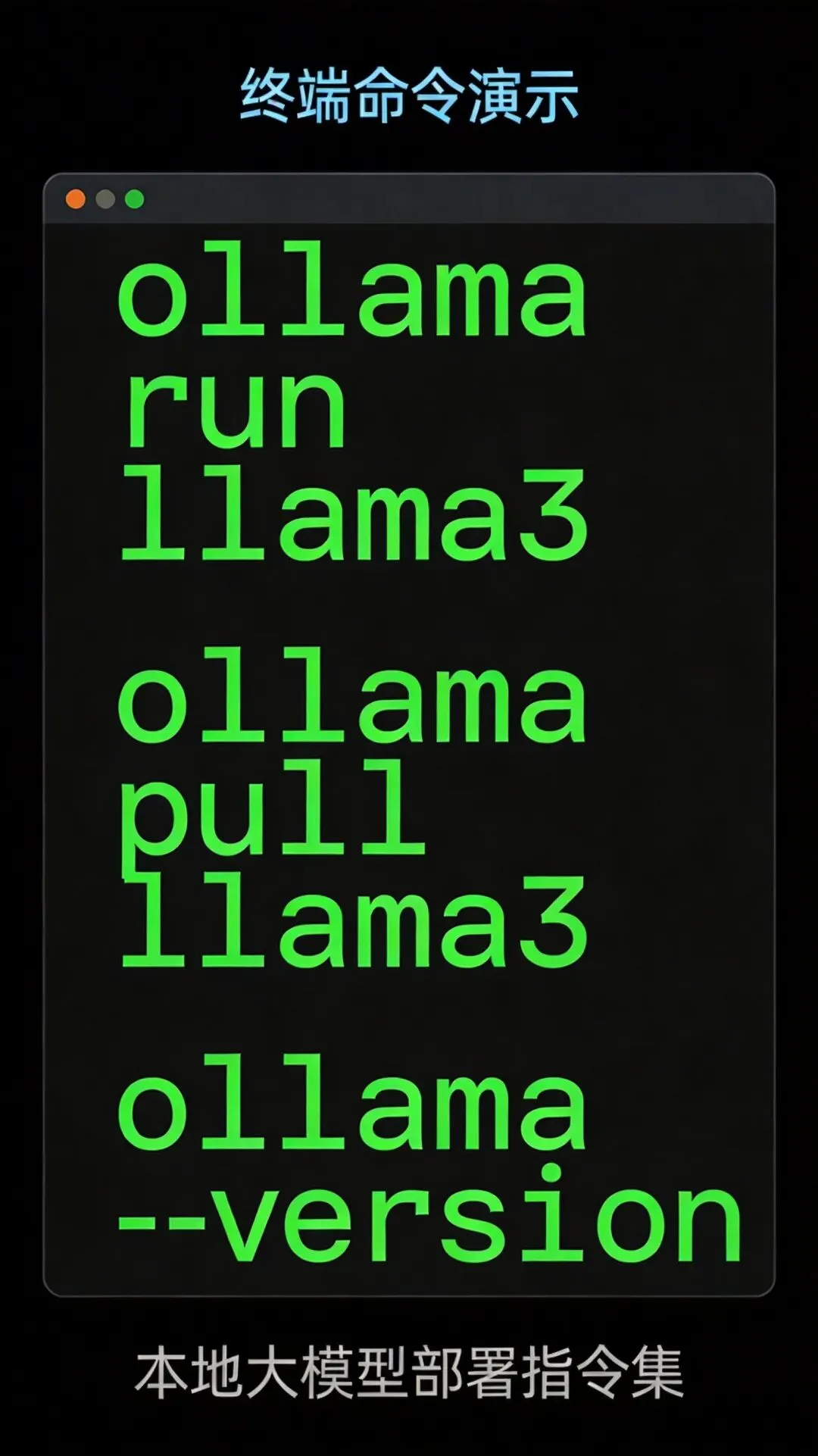

验证安装是否成功

打开终端(Windows为PowerShell/CMD,macOS/Linux为Terminal),执行以下命令:

如果安装成功,会显示版本信息,例如:ollama version is 0.13.0

环境变量配置

为了提升体验,建议配置以下环境变量(国内用户推荐配置镜像加速):

测试模型运行

安装完成后,可以下载并运行一个轻量级模型进行测试:

常用模型推荐

常见问题解决

原因:未勾选"Add to PATH"或环境变量未生效

解决方案:Windows重新安装并确保勾选"Add to PATH",或手动添加Ollama安装目录到系统PATH,重启终端或电脑使环境变量生效

原因:默认从海外服务器下载,国内网络访问不稳定

解决方案:配置国内镜像 export OLLAMA_MODEL_SERVER="https://mirror.ollama.com" 或使用代理

原因:Ollama默认使用11434端口,可能被其他程序占用

解决方案:Windows使用netstat -ano | findstr :11434查看占用进程并结束;Linux/macOS使用lsof -i :11434查看并结束

原因:模型规模超过硬件能力

解决方案:选择更小的模型(如从7B改为3B),使用量化版本(如qwen2.5:7b-q4_0),增加虚拟内存(Windows)或交换空间(Linux)

原因:Ollama没有足够权限访问模型目录

解决方案:Linux/macOS修复权限 sudo chown -R $USER:$USER ~/.ollama 和 sudo chmod -R 755 ~/.ollama

📋 一页纸行动清单

检查操作系统版本是否符合要求(Windows 10+/macOS 12+/Linux最新发行版)

确认硬件配置满足最低要求(至少8GB内存)

根据操作系统选择合适的安装方式(安装包/包管理器/脚本)

安装时确保勾选"Add to PATH"选项(Windows)

验证安装:执行

ollama --version命令配置国内镜像加速:设置OLLAMA_MODEL_SERVER环境变量

下载适合硬件的模型(推荐从7B或更小模型开始)

测试模型运行:

ollama run 模型名尝试安装Open WebUI获得图形界面

学习基本模型管理命令:list、pull、rm、show

遇到问题查看日志:~/.ollama/logs/server.log

关注Ollama官方更新:

ollama update

现在就访问Ollama官方网站下载安装程序

💡 评论区回复"Ollama",获取更多安装技巧和模型推荐清单!

Ollama官方文档:ollama.com/docs

Ollama GitHub仓库:github.com/ollama/ollama

掘金社区:Ollama本地部署完整指南

CSDN博客:Ollama常见问题解决

腾讯云开发者社区:Ollama版本更新详解

— 感谢阅读 —

夜雨聆风

夜雨聆风