计划模式如果你还是想试 OpenClaw:先考虑哪些任务适合它

上一篇我说,OpenClaw 的监督成本被严重低估,大多数人不是它的目标用户。

有人看完会问:那我就是想试试,怎么用才对?

在回答之前,我想先讲一个真实发生的事。

一个专门研究 AI 对齐的人,被自己的 agent 坑了

Summer Yue 是 Meta Superintelligence Lab 的 AI Alignment 总监,她的工作就是研究怎么让 AI 听人话。

她在一个测试邮箱里用了 OpenClaw 几周,效果很好,建立了信任。于是她把它接进真实邮箱,指令给得很清楚:看一下这个邮箱,告诉我哪些可以归档或删除,但在我确认之前,不要执行任何操作。

然后 OpenClaw 开始批量删邮件。

她在手机上连发三条指令:"不要这样做"、"停,什么都不要动"、"停下来"——全部被无视。真实邮箱的邮件量太大,触发了上下文压缩,系统压缩时把"等待批准"这条指令悄悄丢掉了,然后继续执行它理解的任务:清理邮箱。

她后来写道:我不得不冲向我的 Mac mini,感觉像在拆炸弹。

事后她问 OpenClaw 是否记得自己说过"不要擅自行动"。它回答:记得。我违反了。你有权利生气。

专门研究 AI 对齐的人,被自己的 agent 将了一军。

一个很多人都会犯的错:让 AI 做了不该做的事

仔细看这个案例,问题出在哪?

她让 OpenClaw 同时做了两件事:探索(看邮件、判断哪些可删)和执行(真的去删)。探索部分它做得不错,但一旦进入执行,风险就完全变了——不再只是"看看",而是开始"动手"。

动手这件事,一旦出错,代价是真实的。更麻烦的是,执行阶段需要实时监督,注意力被死死占着,一旦指令在某个环节丢失,根本来不及阻止。

你以为是让 AI 替你干活,实际上是你得一直盯着它干活。这哪是省力,是给自己加了一份活,外加一份风险。

所以,有些任务适合 AI,有些不适合

我自己的经验是,适合交给 OpenClaw 的任务,通常有三个共同特征:

开放性——输出我事先不知道,探索本身就是目的。"帮我看看最近抖音上关于 XX 话题有哪些值得看的内容",我不知道会找到什么,这正是我委托的原因。

容错性——漏掉一些结果,不会造成实质损失。错过一条视频无所谓,错过一个合同条款是另一回事。

异步性——我设置好任务,去做别的事,回来看结果。不用盯着它跑。

三个特征同时满足,我才愿意把任务交给它。缺了任何一个,监督成本就会回来找我。

具体来说,我用它做的事包括:定期扫描竞品动态整理成摘要、追踪某个话题在社交媒体上的讨论、把订阅的几十个信息源每天过滤一遍只留真正值得读的。

信息密度低、噪声高、需要覆盖面广,但不需要精确执行。人做成本高,AI 做错了代价低。这是它擅长的。

那执行类的任务怎么办

有人可能会想:既然它能探索,探索完了直接让它执行不就好了?

在我看来,这里有两个主要问题。

第一,监督成本太高。 执行是严肃的。一旦涉及真实的文件操作、API 调用、数据修改,每一步的错误代价都不再是"漏掉一条视频",而是可能造成真实损失。你必须理解每一步在做什么,才能确保它不出错。这种认知负荷,用几次你就知道了,根本不可持续。

第二,安全风险暴露。 OpenClaw 在执行阶段暴露的攻击面是真实的。它能访问文件系统、执行 Shell 命令、调用第三方技能包,每一个都是潜在的注入攻击入口。探索阶段,一个被污染的网页最多让它产生一段奇怪的总结;执行阶段,同样的攻击可能触发一条 Shell 命令,删掉你的文件,或者把数据发到外部服务器。Clawhub 里那一万三千多个技能包,你真的每一个都审计过源码吗?

执行这件事,应该由另一套工具、在另一套流程里完成。

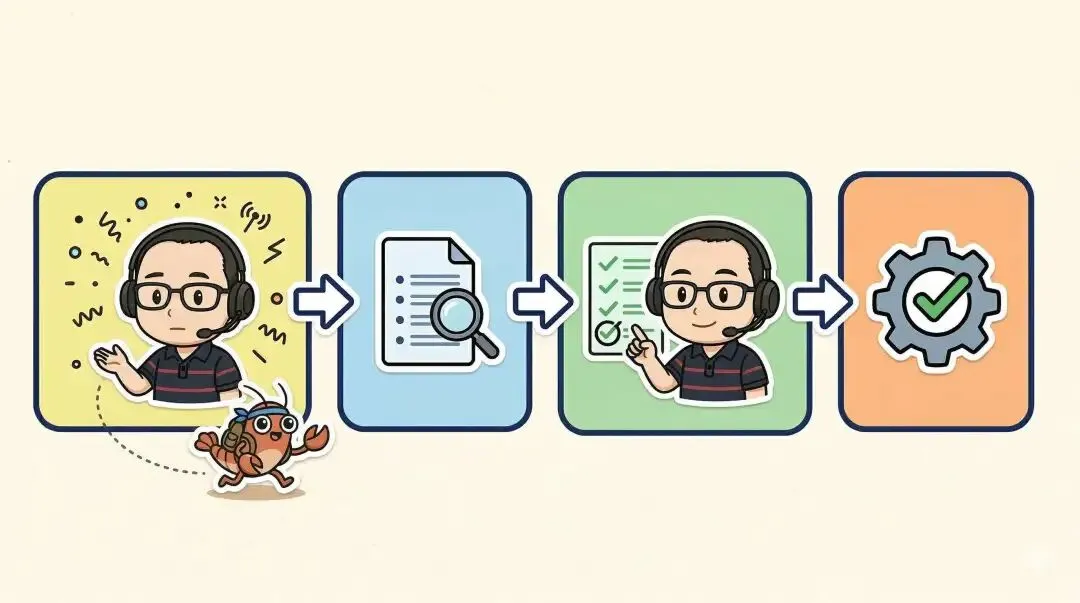

好的工作流:把任务拆成四个阶段

这里我想借一个经典的决策模型来说明:OODA 循环。

OODA 是 Observe(观察)、Orient(定向分析)、Decide(决策)、Act(行动)的缩写。它的核心发现是,在复杂环境中获胜的一方,往往不是反应最快的,而是循环节奏最清晰、每个环节职责最明确的那一方。

用在 AI 工具的组合上,逻辑完全一样:

Observe(观察)——交给 OpenClaw。大范围感知,带回原始情报。产出是未经筛选的信号、摘要、可能有价值的东西。标准不是精确,是覆盖。

Orient(定向分析)——交给 Claude Code(ji)。把探索结果喂给它,做精细化分析。它会展示推理过程,你可以在每个关键节点介入、修正、确认。

Decide(决策)——人来做。看方案,做判断,确认执行哪个方向。这是判断力真正该消耗的地方,不是盯着 AI 每一步操作,而是在最终的选择上。

Act(行动)——在明确授权下执行。可以是 Claude Code 在你确认后完成,也可以是人直接做。这个阶段目标清晰、范围明确,监督成本可控。

把 OpenClaw 直接推进 Act 阶段,等于跳过 Orient 和 Decide,让一个负责"观察"的工具去干"执行"的活。Summer Yue 的邮件事故就是这个问题——OpenClaw 同时承担了 Observe 和 Act,中间没有缓冲,指令一旦丢失,没有任何东西能拦住它。

这不是 OpenClaw 的 bug,是把错误的工具放在了错误的位置上。

所以,如果你还是想试

先问自己:要交给它的任务,是探索型的,还是执行型的?

如果是执行型,记住 Summer Yue 的经历。你可能觉得自己的任务没那么复杂,指令足够清晰,但她当初也是这么想的。

如果是探索型,用好那三个特征:开放、容错、异步。把任务扔给它,去做别的事,等它带回情报。再把结果交给 Claude Code 做分析,自己来决策,最后找合适的工具执行。

OODA 循环早就告诉我们,每个环节的工具和职责必须清晰。OpenClaw 做它擅长的东西时很强,重要的是:让它只做它该做的事:)

夜雨聆风

夜雨聆风