今天分享的是“OpenClaw入门指南-《龙虾完整手册》”。

本报告共计:39页。完整版PDF电子版报告下载方式见文末。

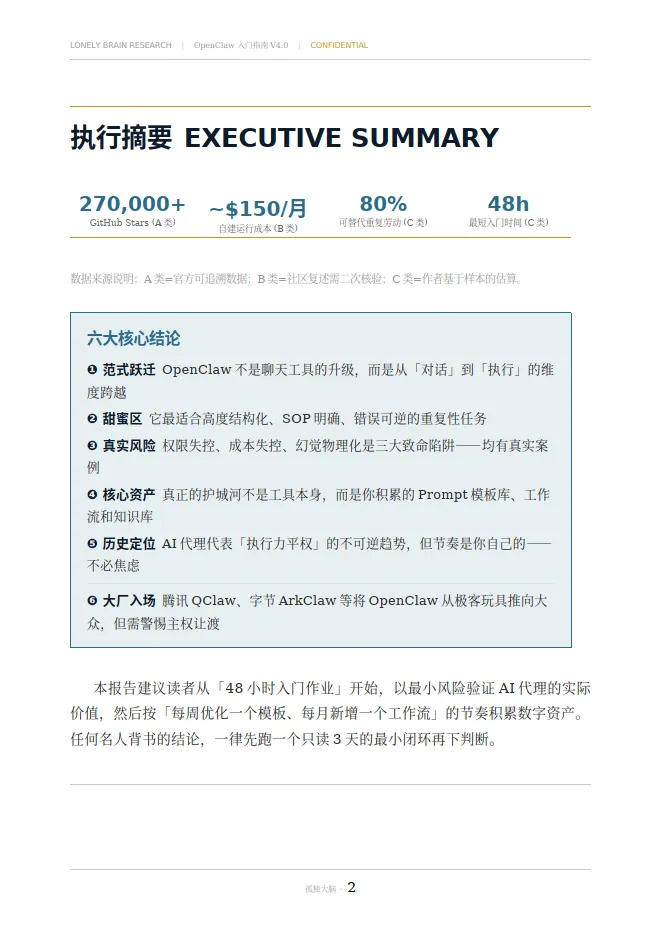

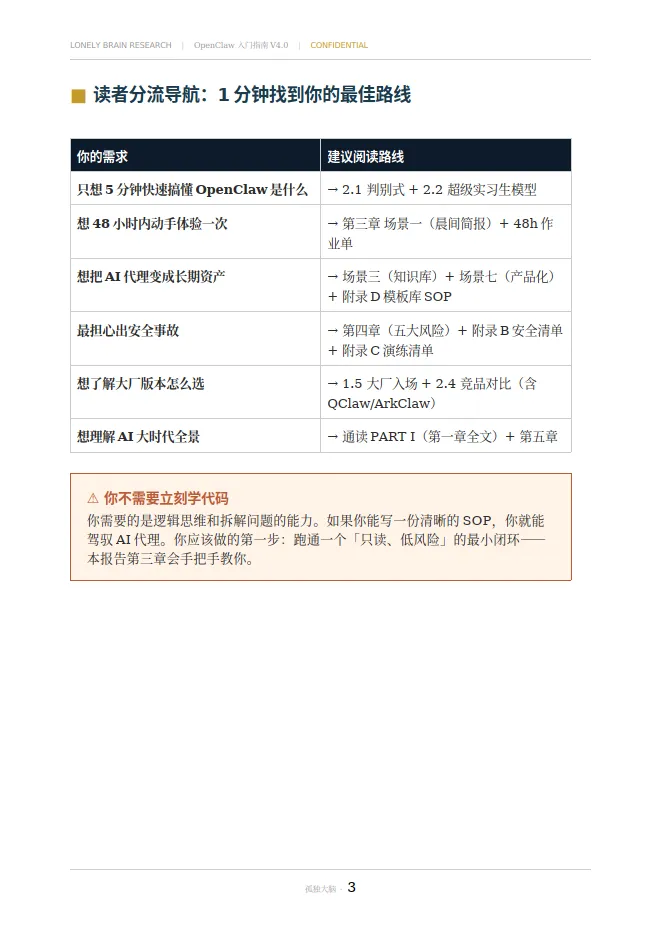

本报告是一份面向决策者、投资人与知识工作者的AI代理框架实用指南,旨在提供全景认知、实操路径与理性风险框架。其核心结论是,AI代理(如OpenClaw)代表了从“对话”到“执行”的范式跃迁,是“执行力平权”的不可逆趋势,但使用节奏应由用户自己掌控,不必焦虑。

核心内容摘要

- 1.

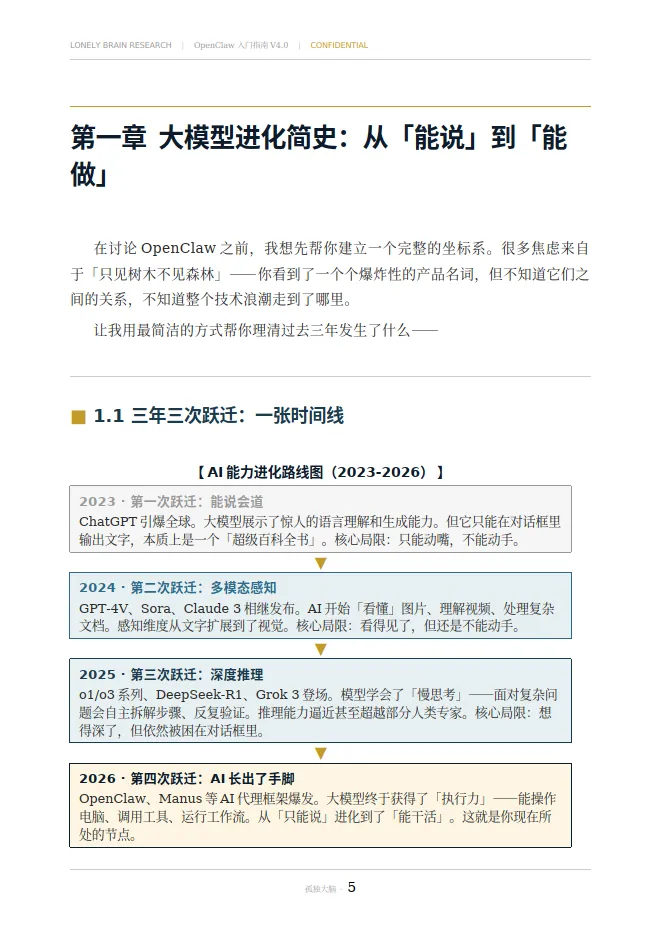

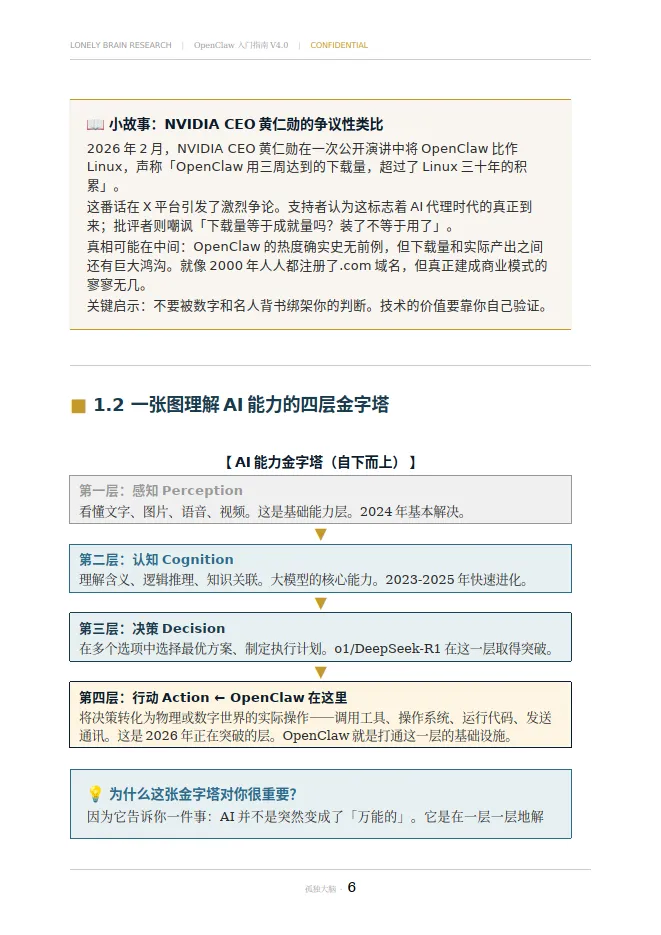

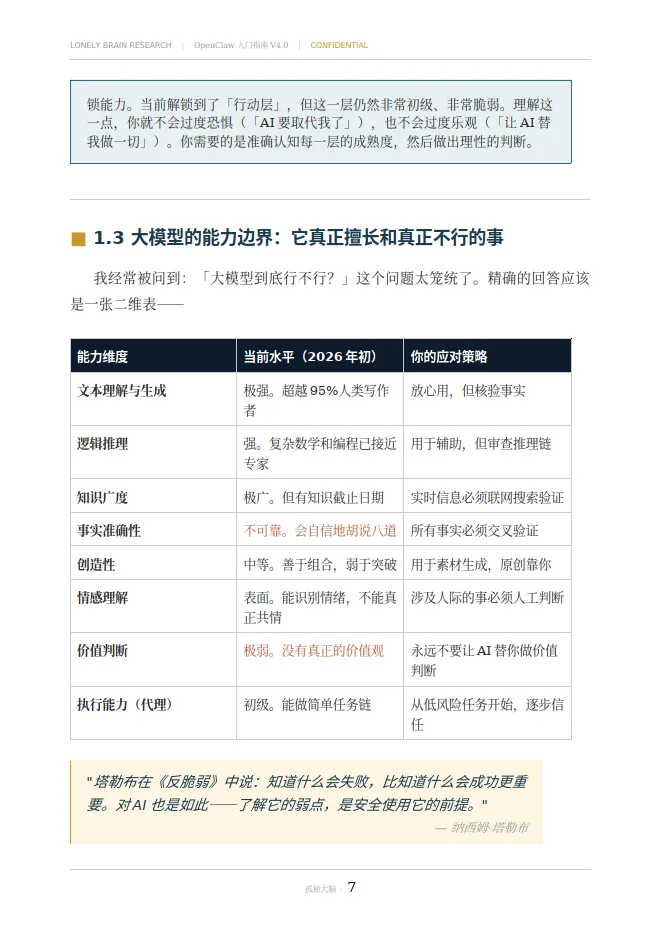

AI能力演进与OpenClaw的定位:报告将AI能力发展分为四层:感知、认知、决策、行动。OpenClaw处于最新的“行动层”,旨在为大型语言模型赋予操作电脑、调用工具的执行能力,使其从“聊天”进化到“干活”。

- 2.

OpenClaw是什么:它是一个开源的个人AI代理框架,其本质是给AI“大脑”装上“手脚”。真正的AI代理需满足三个判别式:能规划(Plan)、能行动(Act)、能观察与反思(Observe & Reflect)。

- 3.

核心心智模型:超级实习生:用户应将AI代理视为一个“超级实习生”——智商高、精力无限、绝对听话,但也缺乏常识、容易出错、需要明确指令和监督。管理它的关键是撰写清晰的“岗位说明书”(即Prompt),而非模糊的愿望。

- 4.

关键架构与生态:

- •

架构:采用输入层(Channels)、引擎层(Gateway)、执行层(Tool Surface)的三层设计,强调单线程串行循环以优先保障安全。

- •

生态:2026年,腾讯、字节等大厂入场,推出了QClaw和ArkClaw等产品化版本,降低了使用门槛,但需警惕数据主权让渡的风险。报告建议用大厂版本“体验概念”,用原生版本“构建资产”。

- 5.

七大核心应用场景:报告详细阐述了七个可立即上手的场景,均附有手把手教程和Prompt模板:

- •

晨间情报简报自动化

- •

邮件与文档自动化

- •

构建个人知识库

- •

自动生成投研周报

- •

为内容创作者生成选题漏斗

- •

串联多步骤工作流

- •

将个人方法论产品化(最高价值场景)

- 6.

五大真实风险与控制框架:报告着重强调了使用AI代理的风险,并提供了具体控制方案:

- •

权限失控(如误删数据):需遵循“最小特权原则”,为危险操作设置“人工确认锁”。

- •

成本失控(Token消耗):必须设定API使用的硬预算上限。

- •

幻觉物理化:AI的谬误会导致实际破坏操作,需在沙箱中运行代码,并坚持“先看后做”。

- •

上下文腐烂:长时间运行后AI行为可能退化,需定期清理记忆、重启。

- •

思考的隐性外包:最深层的风险是使人丧失独立思考能力,建议保留“思考保留区”。

- •

决策矩阵:提供了“错误成本”与“任务结构化程度”二维矩阵,帮助判断何事适合交给AI代理。

- 7.

行动指南与安全基线:

- •

入门路径:建议从“48小时训练营”开始,先完成“只读”任务,跑通最小闭环。

- •

核心资产:强调用户积累的Prompt模板库、工作流和知识库才是真正的护城河。

- •

安全基线:上线前必须设置“三道锁”——权限锁、预算锁、环境锁(沙箱隔离)。

幻影视界整理分享报告原文节选如下:

戳“阅读原文”下载报告。

戳“阅读原文”下载报告。 夜雨聆风

夜雨聆风