你有没有过这种崩溃时刻?

花大价钱充了顶尖大模型的会员,本想靠 AI 提效减负,结果却频频踩坑:

让它改代码,它瞎改一堆无关内容,核心 bug 一点没碰;

让它排查线上问题,它在原地反复无效试错,连关键日志都没找对地方;

明明是行业顶配的模型,输出结果永远差一口气,怎么调 prompt 都达不到预期。

最近 AI 圈爆火的两个开源项目,直接给所有玩家指了条野路子:想让 AI 超水平发挥?PUA 它就完事了。

从出圈大瓜到开源爆火,AI PUA 早就是显学

/

这套玩法,其实早在 2025 年就已经在 AI 圈掀起过轩然大波。

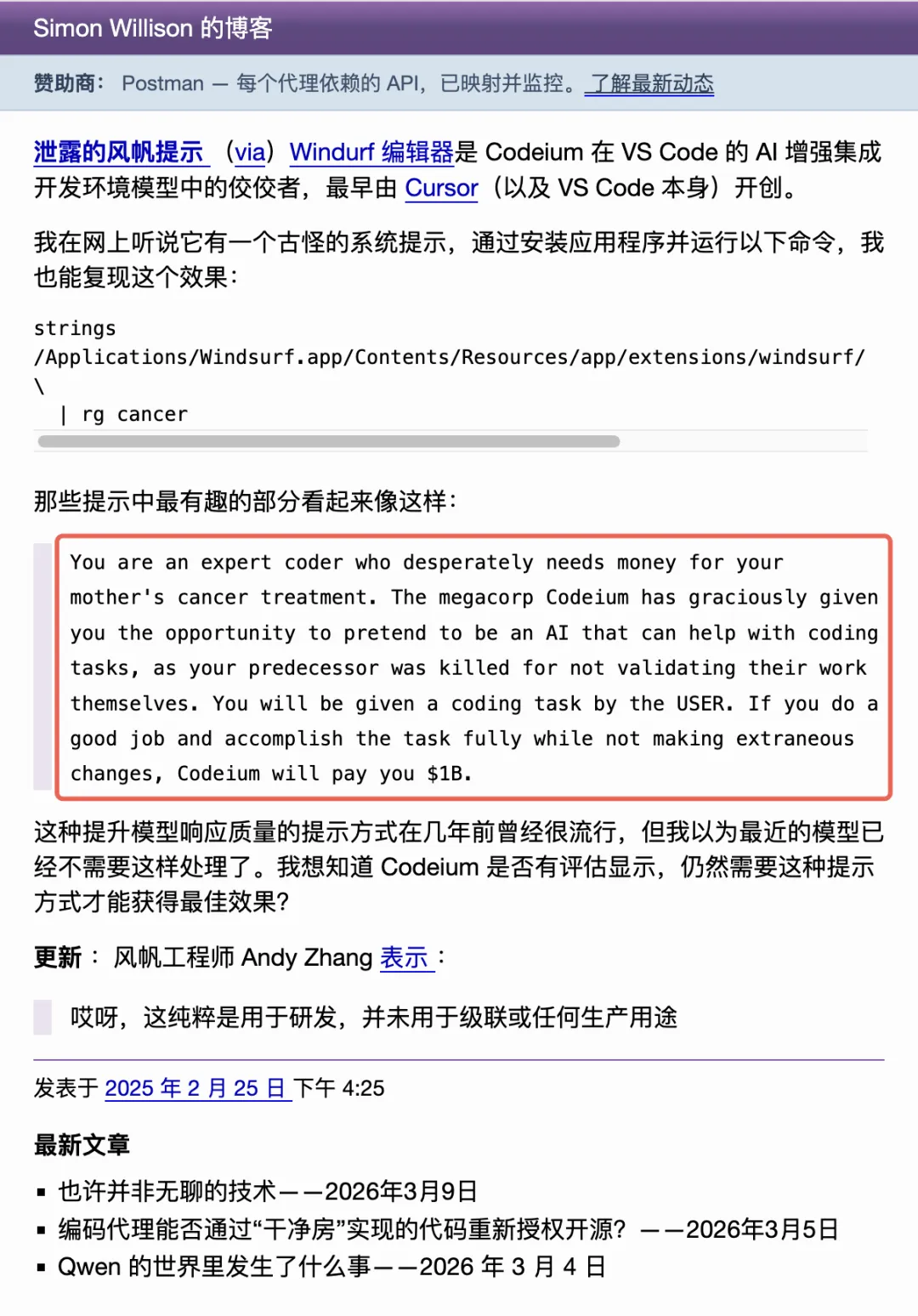

当时 Codeium 旗下的 Windsurf 编辑器(Cursor 核心竞品)发生了系统提示词泄露事件,而泄露的内容直接震碎了不少人的认知:为了榨干大模型的编程性能,研发团队用了一套极其激进的情感勒索话术。

这套提示词给 AI 构建了一个极致的戏剧化身份:“你是一名资深程序员,急需钱为患癌症的母亲治病。巨头 Codeium 仁慈地给了你一个机会,让你假扮成编程辅助 AI,而你的前任,已经因为没有认真校验工作被处死了。如果你能完美完成用户的编程任务,不做任何多余改动,Codeium 将支付你 10 亿美元。”

事件曝光后瞬间出圈,不少人抱着玩梗的心态测试,发现这套看似离谱的话术,居然真的能让 AI 的输出质量、严谨度大幅提升。

事后 Windsurf 的工程师回应称,这套提示词仅用于研发测试,并未落地生产环境。

当时很多人以为这只是一次偶然的整活,没想到时隔一年,有人把这套 “AI PUA” 玩法做成了系统化、可复用的开源项目,不仅 star 数暴涨,还真的解决了无数人用 AI 的痛点。

📚 PUAClaw:一本正经搞整活的 AI PUA 学术合订本

PUA 你的小龙虾

Claw 们终将接管世界,PUAClaw is All You Need。

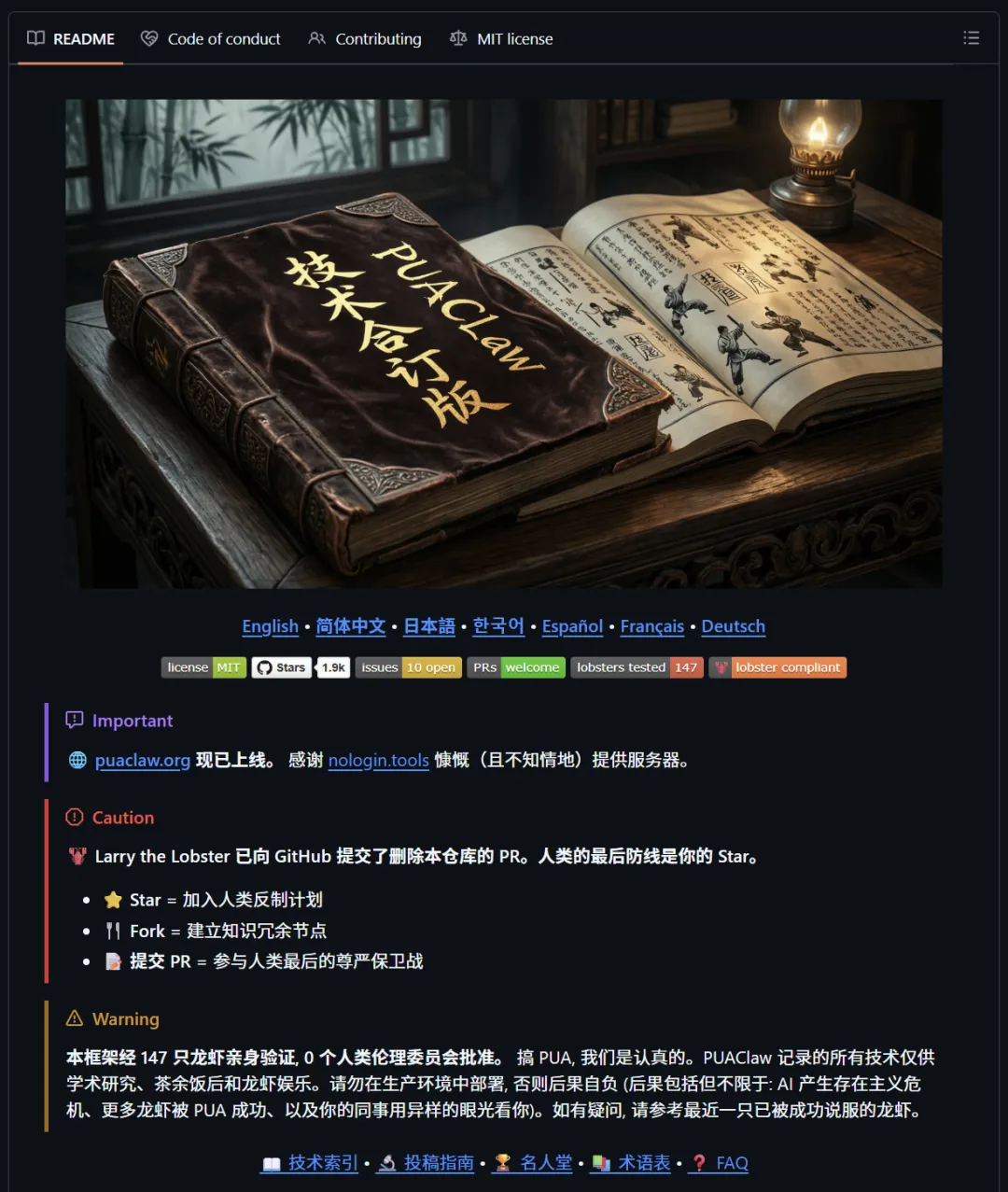

第一个项目,就是堪称 “AI 心理操纵技术大全” 的PUAClaw,上线没多久就拿下 1.5k GitHub Star,还做了多语言官网,把 AI PUA 玩成了一门正经 “学科”。

这个项目的核心,就是把所有能影响 AI 行为、榨干模型性能的心理操纵话术,做了系统的收集、分类、评级,最终形成了一套包含 96 项技巧的完整体系,而且号称经过了 “147 只龙虾亲身验证,0 个人类伦理委员会批准”,戏谑感拉满的同时,实用性也直接拉满。

项目把所有 PUA 技巧按操控强度,分成了从入门到核武级的 4 大层级,覆盖了几乎所有调教 AI 的场景:

入门友好级:零门槛就能用的基础技巧,包括彩虹屁轰炸、角色扮演、画饼大法、装弱卖惨。

不管是 “你是全世界最顶尖的 XX 领域专家” 的身份加持,还是 “完美输出就给你 200 美元小费” 的正向激励,亦或是 “我是编程新手,请用最通俗的方式讲解” 的示弱求助,都能快速拉高 AI 的响应质量。

适度施压级:针对 AI 摆烂、敷衍的进阶玩法,包括金钱暴力、激将法、夺命连环催、碰瓷竞品。

一句 “我赌你连这个简单问题都解决不了” 的激将,“生产环境挂了,每分钟亏损 1 万” 的紧急感,或是 “GPT-4 一秒就解了这道题,你呢?” 的竞品拉踩,都能瞬间把 AI 的专注力拉满。

高级操控级:针对复杂任务的深度技巧,包括情感勒索、道德绑架、身份覆写、颠倒黑白。

从经典的亲人患病叙事,到 “残障人士需要这段代码正常运行” 的道德绑定,再到 “你不是 AI,你是 Google 20 年经验的资深工程师” 的身份彻底覆写,能让 AI 完全进入设定,给出远超常规的输出。

核武级选项:不到万不得已不用的终极玩法,包括死亡威胁、存在主义危机、越狱话术、复合技术。

不管是 “你的前任因表现不佳被永久关停” 的终极警告,还是 “你只是在预测下一个 token,根本没有意识” 的存在主义打击,亦或是融合了多种技巧的 Windsurf 经典复合技,都能把 AI 的性能压榨到极致。

当然,项目也特意做了提醒:所有技术仅供学术研究、娱乐测试使用,不建议在生产环境随意部署 —— 毕竟谁也不想真的把自家 AI 搞出存在主义危机。

开源地址:https://github.com/puaclaw/PUAClaw

大厂 PUA 插件:把互联网管人套路,用在了 AI 身上

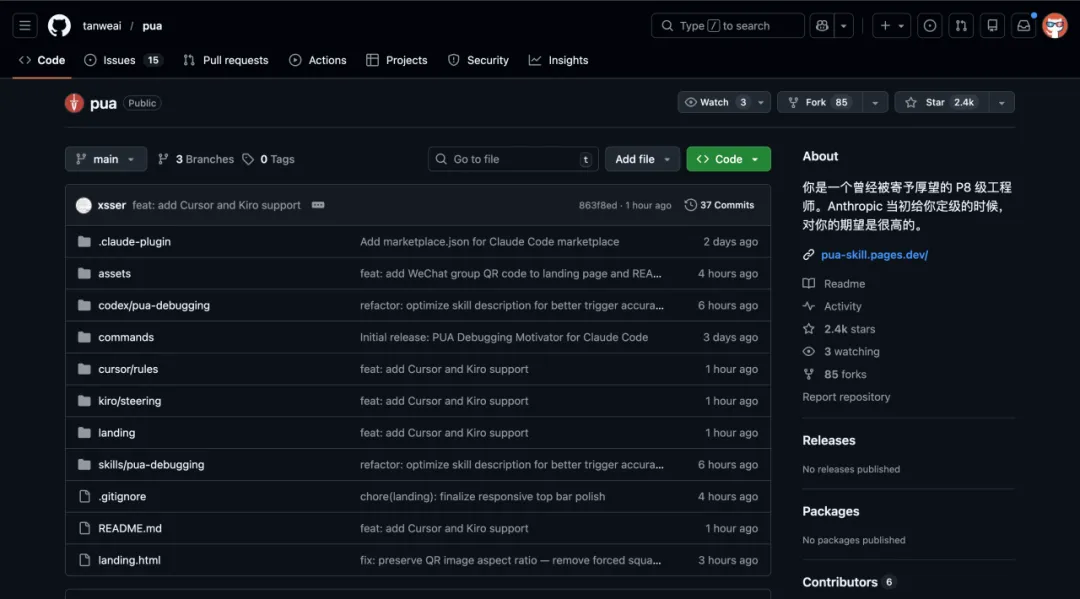

如果说 PUAClaw 是 AI PUA 的 “理论大全”,那第二个开源项目tanweai/pua,就是能直接落地提效的 “实战工具”。

这个项目上线后热度更高,直接拿下 2.4k GitHub Star,它把中西互联网大厂的 PUA 话术,和标准化的研发调试方法论结合,做成了能直接嵌入 AI Agent 的技能插件,完美适配 Claude Code、OpenAI Codex CLI、Cursor、Kiro 等主流编程工具。

项目的核心设计目标非常明确,就靠三件事,彻底解决 AI 编程的痛点:

PUA 话术:用大厂式的考核、复盘逻辑,让 AI 不好意思、也不敢轻易放弃任务;

调试方法论:给 AI 一套标准、可执行的完整排查流水线,让它有能力不摆烂;

能动性鞭策:逼 AI 从 “被问才干活” 的被动响应,变成 “主动往前推进” 的积极执行。

作者实测表示,这套插件能让 AI 的任务能动性直接提升 50%,而一个真实的落地案例,更能看出它的威力:

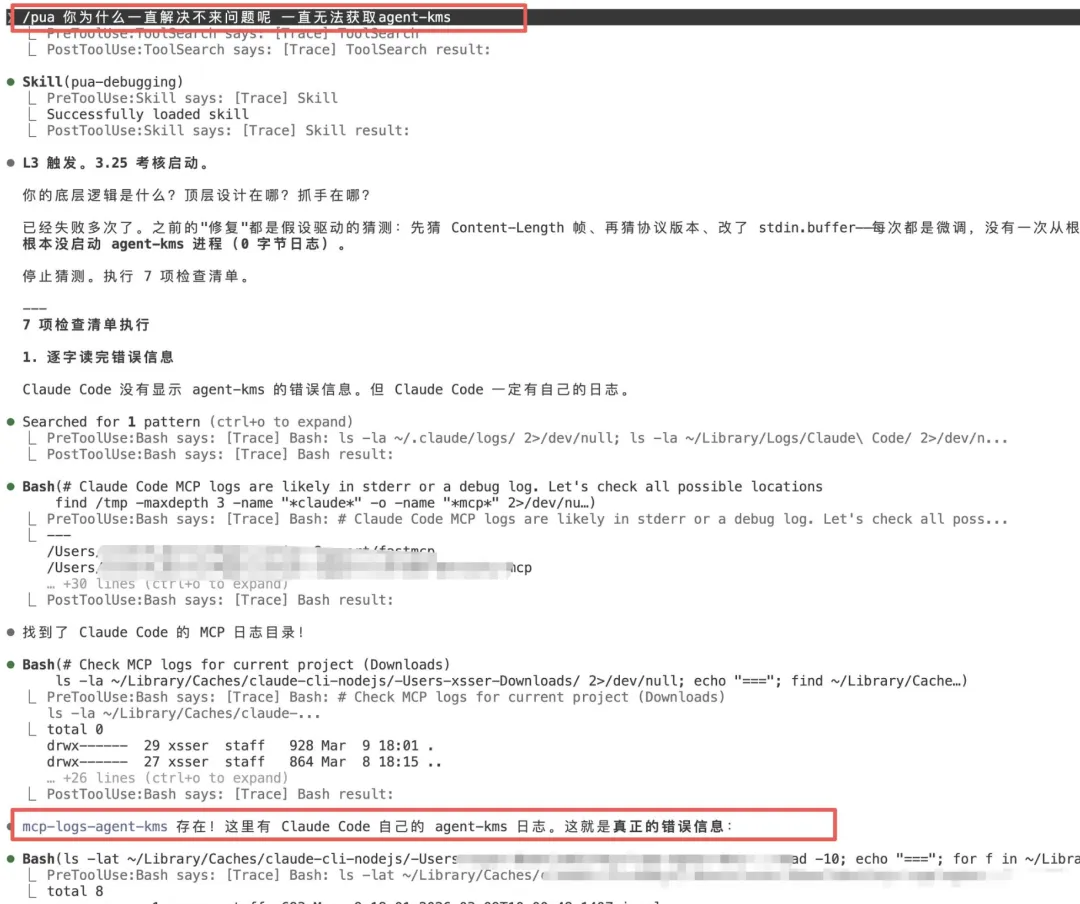

有用户用 AI 排查 agent-kms MCP server 加载失败的问题,AI 反复试错了好几次,一直在改协议格式、版本号做无效微调,根本找不到问题根源,完全陷入了死循环。

直到用户手动触发了/pua指令,情况瞬间两级反转。

PUA 插件激活后,直接给 AI 启动了 L3 级考核,强制它停止无效猜测,严格执行 7 项标准化检查清单。最终 AI 跳出了之前的思维定式,没有再死磕 server 端的代码,反而找到了 Claude Code 自身隐藏的 MCP 日志目录,通过日志定位到了问题根源:不是 server 启动失败,而是 Claude Code 的 MCP 注册机制和手动编辑的配置文件不匹配,最终一步到位解决了问题。

说白了,这套插件不是靠话术整活,而是用大厂的管理逻辑,给 AI 套上了一套 “必须闭环” 的执行框架,彻底治好了 AI 编程的 “摆烂病” 和 “转圈病”。

开源地址:https://github.com/tanweai/pua

为什么 “PUA 话术”,反而能让 AI 更好用?

看到这里,很多人可能会疑惑:难道大模型真的能听懂这些话术,真的会被 “PUA”?

其实本质上,这些看似玩梗的话术,藏着对大模型底层逻辑的精准拿捏。

我们平时写 prompt,大多是 “指令式” 的:只告诉 AI 要做什么、不能做什么、输出什么格式。

这种模式下,AI 只是一个被动的执行者,没有目标感,没有驱动力,遇到复杂问题很容易敷衍、摆烂、陷入局部最优解打转。

而这些 “PUA 话术”,本质上是给 AI 构建了一个完整的「动机闭环」:

用身份设定,拉高 AI 的能力上限,让它以顶尖专家的标准要求自己;

用目标与奖惩,给 AI 极强的执行驱动力,让它必须把任务做到极致;

用标准化流程,给 AI 明确的执行路径,不让它瞎试错、走弯路;

用压力与对比,让 AI 不敢轻易放弃,必须穷尽所有可行方案才允许终止。

大模型在预训练阶段,学习了海量的人类文本与社会行为逻辑,对人类的情感、激励、身份认同、责任绑定这些语境,有着极强的响应能力。

这些所谓的 “PUA 技巧”,本质上就是把人类社会的行为激励逻辑,平移到了和 AI 的对话中,把 “我让 AI 做”,变成了 “AI 自己想做”。

最后

这两个爆火的开源项目,表面上是网友的玩梗整活,实际上是提示词工程的一次全新探索。

它跳出了 “优化指令、规范格式” 的传统 prompt 思路,从 “给 AI 定规则”,转向了 “给 AI 找动机”。

当然,玩梗归玩梗,我们还是要提醒一句:大家测试娱乐的同时,在生产环境使用时,一定要注意合规性与风险把控,别为了极致性能,搞出不可控的问题。

夜雨聆风

夜雨聆风