但这几天看下来,我发现一个很有意思的现象:

很多人都在研究怎么让 OpenClaw"做更多事",却很少有人先把一个更基础的问题调对——它现在,到底是在"随口答",还是在"认真想"?

如果你也觉得 OpenClaw 有时候不够稳、不够深、不够像你预期里那么聪明,问题可能不在模型,也不完全在提示词。

更常见的原因是:你还没打开它的思考模式。

01 一句话版本

如果你现在就想试,直接给 OpenClaw 发这一句:

/think:high这不是普通提示词,而是 OpenClaw 官方支持的 Thinking Levels 指令。

OpenClaw 支持以下思考档位:

off | ||

minimal | ||

low | ||

medium | 中等思考 | 写方案/拆需求(最推荐) |

high | ||

xhigh | ||

adaptive |

其中,/think:medium 可以把当前会话的默认思考强度调到 medium。

像 /t high 这样的写法,则可以只对当前这一条消息临时生效。

你可以把它理解成:不是让它"多说一点",而是让它"多想几步"。

02 为什么很多人会忽略这个设置?

很多人会天然默认两件事:

1. 模型本身够强,就自然会认真想

2. 提示词写得够长,它就会更聪明

但在 OpenClaw 里,这几件事其实不是一回事。

OpenClaw 把"思考强度"和"是否显示思考过程"拆成了两个不同开关:

/think | |

/reasoning |

03 实用的用法

用法 1:只让某一条消息更认真

你可以直接在消息里写:

/t high 帮我把这个需求拆成 PRD、流程、埋点、风险点这种属于内联指令,只对这一条消息生效。

官方文档说明:消息内的

/t <level>、/think:<level>或/thinking <level>都可以作为单次生效指令。

用法 2:把当前会话整体调聪明一点

你可以单独发一条:

/think:medium这会把 medium 设成当前会话默认值。

之后你正常聊天,它都会按这个强度来思考,直到你手动关掉,或者会话被重置。

官方文档写得很明确:发送一条"只包含 directive 的消息",就会把该 thinking level 存成当前 session override。

用法 3:想看它的思考过程,再单独开显示

如果你想观察它到底是怎么想的,再发:

/reasoning on这时候它会把 reasoning 作为单独消息发出来。

如果是 Telegram,还支持 stream 模式,把思考过程先流到 draft bubble,再只发最终答案。

也就是说,/reasoning 更像"显示开关",不是"智力开关"。

04 长期配置实际操作步骤

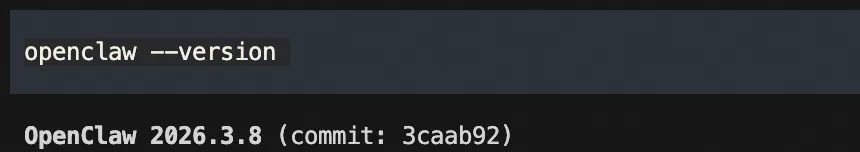

Step 1:查看 OpenClaw 版本

在对话框输入:

openclaw --version确认 OpenClaw 是否为 v2026.03.02 或更高版本,低版本的 OpenClaw 可能无法开启思考模式。

Step 2:确定配置模型支持的思考范围

不同模型,对 thinking 的支持不一样,OpenClaw 文档里专门写了 provider notes:

| Anthropic Claude 4.6 | |

| Z.AI(zai/*) | |

| GPT-5.2 + Codex |

所以不是所有模型都能把 low / medium / high / xhigh 拉满吃透。

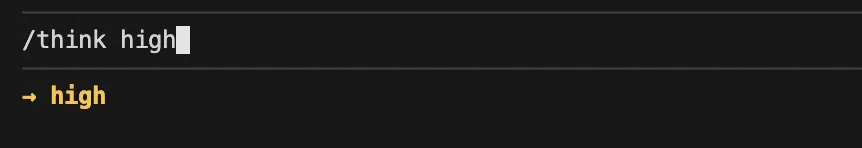

Step 3:选择思考级别

输入:

/think high

Step 4:修改配置文件

设置 compat 参数:

打开配置文件,在支持思考模式的模型配置中添加:

"compat": { "thinkingFormat": "模型名"}设置 reasoning 参数:

在同一模型配置中,将 reasoning 参数设置为 true:

{ "id": "xxxx模型名", "name": "xxxx模型名", "reasoning": true, "compat": { "thinkingFormat": "模型名" }, "input": ["text"], "cost": { "input": 0, "output": 0, "cacheRead": 0, "cacheWrite": 0 }, "contextWindow": 262144, "maxTokens": 65536}Step 5:重启 OpenClaw Gateway

保存配置文件后,在终端执行:

openclaw gateway restart💡 懒人方法

当然你也可以直接跟它说:

把默认的思考模式调到 high,打开 reasoning 并检查调整 compat小提示:更高不一定更好

high 或 xhigh 并不总是优解。

越高的 thinking level,通常意味着:

- ⏱️ 更慢

- 💰 更多 token

- ⏳ 更长等待

OpenClaw 文档里把 high 定义成"ultrathink",把 xhigh 定义成"ultrathink+",这本身就说明它更适合难题,不是适合所有日常问答。

我更建议你这样用

如果你是刚开始用 OpenClaw,我会直接给你这套:

📱 日常聊天 / 简单问答

/think:minimal 或 low够快,成本也更稳。

💼 写方案 / 拆需求 / 排查问题

/think:medium这是我最推荐的默认档。

因为它通常已经足够拉开"随口答"和"认真做"的差距。

🔧 复杂多步任务 / 自动化 / 代码问题

/t high只在关键任务那一条临时拉高,不要全程高强度。

👥 群聊 / 对外展示 / 不想暴露中间思路

/reasoning off让它只给最终答案,不展示 reasoning block。

07 结语

很多人以为,OpenClaw 的"聪明"主要来自:

- ✅ 更强的模型

- ✅ 更复杂的 skill

- ✅ 更长的 prompt

这些当然重要。

但在真正开始调它之前,你最不该忽略的,反而是这个最简单的开关:

/think:medium

因为它决定的不是"它能不能回答",而是"它愿不愿意认真想一想再回答"。

而 OpenClaw 真正好用的地方,也恰恰不在于它会说很多,而在于你能把它调成一个更会思考、更会做事的状态机。

近期这波"养龙虾"热度,本质上让更多人看到了 agent 的执行力;但真正拉开使用体验差距的,往往不是装了几个 skill,而是你有没有把这些基础设置调对。

📌 互动话题

你平时用 OpenClaw 时,遇到过哪些"不够聪明"的时刻?

欢迎在评论区留言👇

👇 喜欢这篇文章,请点个"在看"

🔗 关注公众号,获取更多 AI 效率工具实战技巧

夜雨聆风

夜雨聆风