先表达一个观点——一切欠下的技术债,早晚都是要还的。

为啥这么说,因为就在这两天,就被我的小龙虾给坑了,罢工了几个小时。

搁以前,每安装好一个软件,我都一定会先习惯性的,去搞清楚它的目录结构、有哪些配置文件,每个配置文件都写了些啥,以及分别有哪些作用。

但这一次安装 Openclaw,我飘了,压根就没去在意这些,心想:都 AI 智能体了,不就应该是全程我指挥,要它干嘛就干嘛吗?这些配置不看也罢。

实际体验也确实是的,但是,从我之前文章内容可以看出来,它虽然「听话」,但很多时候也很「稚嫩跟鲁莽」。

比如昨天,我因为一个大模型的切换问题,就把这只龙虾送进了 ICU,折腾几个小时,才给抢救回来。

0. 起因

因为之前用 kimi k2.5 模型烧 token 的速度,实在是太快,我那 100 块巨款还没折腾几天,就快见底了。

而刚好同事推荐,说联通云最近搞什么活动,新用户可以赠送一定数量的 token,心想,要不咱也占点便宜试试?

摸索了大概半小时,薅到了两个免费额度的 API key(一个 deepseek 一个 qwen),然后我在对话框里,让小龙虾帮我把这两个 key 给添加到配置里(问过它,是可以同时支持多个不同大模型的)。

根据小龙虾的意思,我后续使用的时候,是可以根据心情,随意切换模型的,看起来很美好对不对。

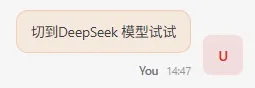

但就是这么一切:

出事了!

1. 活虾变死虾

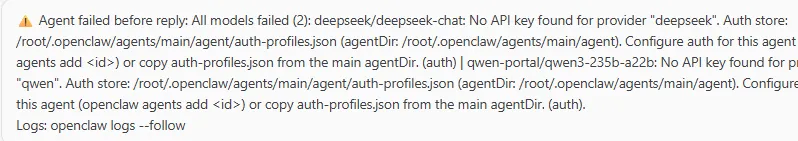

跟小龙虾的所有对话,瞬间就变成了这样:

就好比一个活泼乱跳的人,突然住进了 ICU。

作为它的主人,内心瞬间也跟着不淡定了——对话框不能用了,后续还怎么玩?还有个项目等着它开发呢。

情急之下,只能把这个问题(我猜是当前这个免费的 API key 根本没法用导致的),贴到各个 AI 的对话框里挨个问,然鹅,根据我以往的经验,越是着急想搞定的事情,越是短时间内搞不定。

一番折腾之后,其实我只想把模型切回成原来的 Kimi,但就是这个小小的愿望,一时间居然很难搞定。

原因很简单,我对这个问题背后涉及到的相关配置,根本就不熟。

再加上当前 Openclaw 版本的的一些 bug(严重怀疑是的),就让这个本来应该一点都不复杂的问题,却看上去迷雾重重。

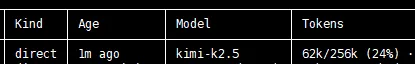

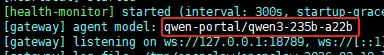

比如,我通过「openclaw status」命令,看到当前 main agent 配置的大模型,依然还是修改之前的 kimi-k2.5:

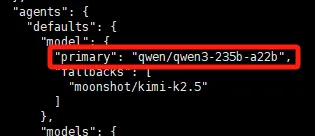

但我用命令「openclaw config get agents.defaults.model」,看到的,又变成了 qwen:

root@VM-16-13-ubuntu:/data# openclaw config get agents.defaults.model

🦞 OpenClaw 2026.3.2 (85377a2) — Powered by open source, sustained by spite and good documentation.

{

"primary": "qwen/qwen3-235b-a22b",

"fallbacks": [

"moonshot/kimi-k2.5"

]

}

就,一时间让人很懵逼。

2. 相关配置

得,估计只剩最后一招了——找到相关配置文件,老老实实研究一下,然后修改。

跟根据上面的报错线索,可以找到 3 个相关的配置文件:

配置文件 1:~/.openclaw/openclaw.json;

配置文件 2:~/.openclaw/agents/main/agent/models.json;

配置文件3:~/.openclaw/agents/main/agent/auth-profiles.json。

其中第 1 个配置文件(openclaw.json):

从路径跟名字应该可以看出来,它是 openclaw 读取的,第 1 个文件。

它里面定义了,当前系统有多少个可以调用的大模型,和各个模型的「provider 地址、默认设置、认证方式」。

以及一个非常重要的配置——首选模型设置。

它藏在这个地方(我一顿好找):

这里的配置,给我改成了 qwen(明明在命令行里,我让它改成 deepseek,也不知道为什么就变成了 qwen)。

而又因为我提供的 qwen 免费 API key 不能用(应该是的),所以就导致了前面的对话框报错。

而想要把首选模型,给切回到之前的 kimi,就必须把这个框框部分的 qwen,给改回成 Kimi。

文件保存退出,重启 openclaw 网关,问题就搞定了。

出问题时,网关启动日志是这样的:

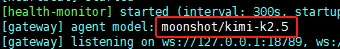

修改后,变成了这样:

对于配置文件 2(models.json):

Openclaw 会根据配置文件 1 的模型配置,跑到配置文件 2 中,找到相关模型的「模型参数、上下文窗口、成本计算」等内容。

对于配置文件 3(auth-profiles.json):

Openclaw 再根据配置文件 2,找到配置文件 3,再找到对应大模型的「API Key、密钥、访问令牌」等信息,开始调用大模型。

情况就是这么个情况,事情就是这么个事情,等你了解到这些信息后,问题自然也就解决了。

最后

一次小龙虾的崩溃,换来对 3 个配置文件的深入理解,怎么说呢,值,也不值。

同时也证明一件事,作为技术人,欠下的技术栈,早晚都是要还的。

另外,对于这种可能引起系统崩溃的操作,希望大家以后一定要慎重,除了对话确认外,最好亲自去检查一下对应的配置文件。

毕竟,对话可能有水分,而配置文件,则不会骗人。

最后,祝大家的养虾之路,越来越顺。

夜雨聆风

夜雨聆风