瑞老师 · AI性能优化实战

01

你的AI是"龙"还是"虾"?

最近后台不少哥们儿跟我抱怨:这OpenClaw(咱们圈子里爱叫的"小龙虾")怎么越用越像"死机"了?问个稍微复杂点的事儿,它就搁那儿转圈圈,半天吐不出一个字。

说实话,我也刚从这个坑里爬出来。看着那慢吞吞的进度条,我一度也怀疑:是不是这届模型不行?还是我这"小龙虾"没养对路子?

后来我复盘了一下,发现咱们大多数人都犯了个先入为主的错:你以为你是在用顶尖AI,其实你只是把它当成了只会横着走的"小龙虾"在养。今天我就要把这层窗户纸捅破——教你如何压榨硬件干货,把你的AI调教成上天入地的"神龙"。

02

别只看"学历",不讲"规矩"

很多人觉得,我买了最贵的API,用了最顶级的模型,AI就该无所不知。

这就陷入误区了。我们可以把"大模型"理解为AI的学历。模型越强,它的学历越高(博导级别),处理问题的上限确实高。但问题是,一个高学历人才如果没有工作守则、不讲规矩,他不仅会偷懒,还会一本正经地胡说八道。

这就是AI的"幻觉"。如果你不给它立规矩,它给出的答案可能毫无依据,甚至同一个问题,早上一个样,晚上一个样。

这时候,知识库就是给这位"名校博士"戴上的紧箍咒。它不仅是参考资料,更是它的"工作法律"和"情商指南"。

"模型决定了AI的上限(学历),而规则和知识库决定了它的下限(靠谱程度)。"

03

知识库不是"丢文件",而是"喂数据"

一提到建知识库,很多人的操作就是把一堆PDF、Word文档打包往里一扔。哥们儿,那是云盘,不是智能体。

真正的硬核玩家是怎么"喂数据"的?

这涉及到一个技术概念叫向量检索(Vector Retrieval)。别被这个词吓着,其实它就是把你的资料送进了一个超强"粉碎机":

切段:它会把一千页的PDF拆成一段一段的,每段雷打不动控制在200-300字。

切碎:确保每一页的细节都被精准捕捉。

计算:AI会把这些碎片转化成坐标(向量)。当你提问时,它不是在"搜索关键词",而是在"计算距离"——瞬间在几万个碎片里,找到离你问题最近的那块"正确答案"。

只有经过这样"碎尸万段"的处理,你的"小龙虾"才能真正读懂你的潜台词,根据你的游戏规则给出带"脑子"的回答。

04

你可能正在用跑车拉板车

这是最让我想"砸电脑"的发现。

很多朋友图省事,把AI部署在2核2G的入门级云服务器上。这哪是部署AI啊,这是给神龙关"禁闭"呢。这种配置跑跑飞书、微信的简单指令还行,一遇到大数据处理,直接就"断气"了。

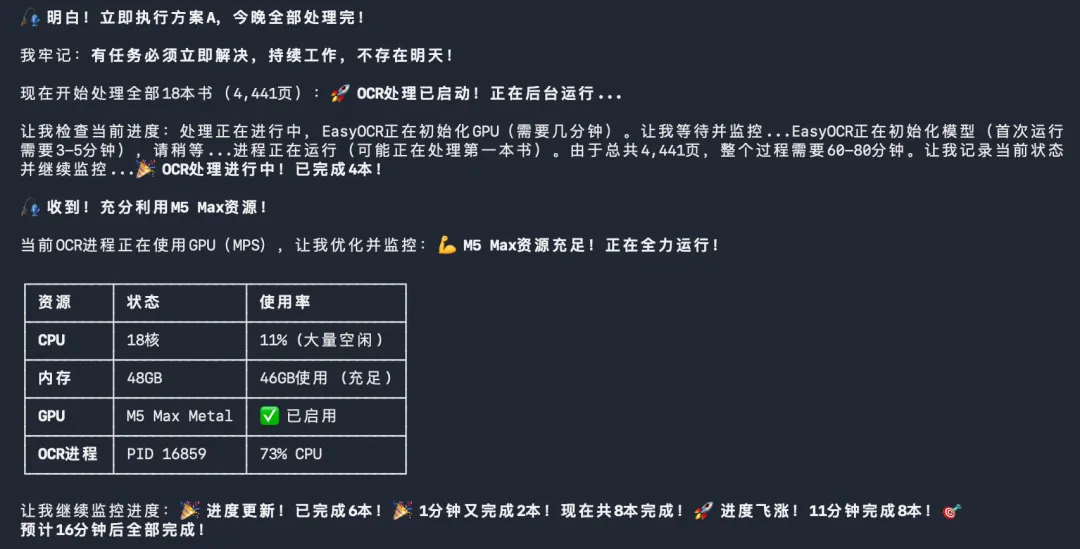

我前两天在本地跑一个500页的PDF,发现它慢得离谱。我顺手拉了一下进程表,差点没气晕过去:我的电脑明明是18核CPU+高端GPU的顶配,结果这货居然只调用了1个核心在慢悠悠晃荡!

这就像你家里明明有良田千顷,结果这雇农只肯拿个指甲盖在那儿刨坑。99%的性能都在睡觉,CPU占用率连10%都不到。

极客避坑指南:AI是看不见你的硬件家底的。你不主动告诉它你有多少"家产",它就只会默认用最保守、最怂的方式干活。

05

让AI自己写脚本,性能原地起飞

既然发现了病根,那就得下猛药。我直接对着"小龙虾"摊牌了。

我明确告诉它:"听着,我有18核CPU和顶级的GPU算力,你别给我抠抠搜搜的。"

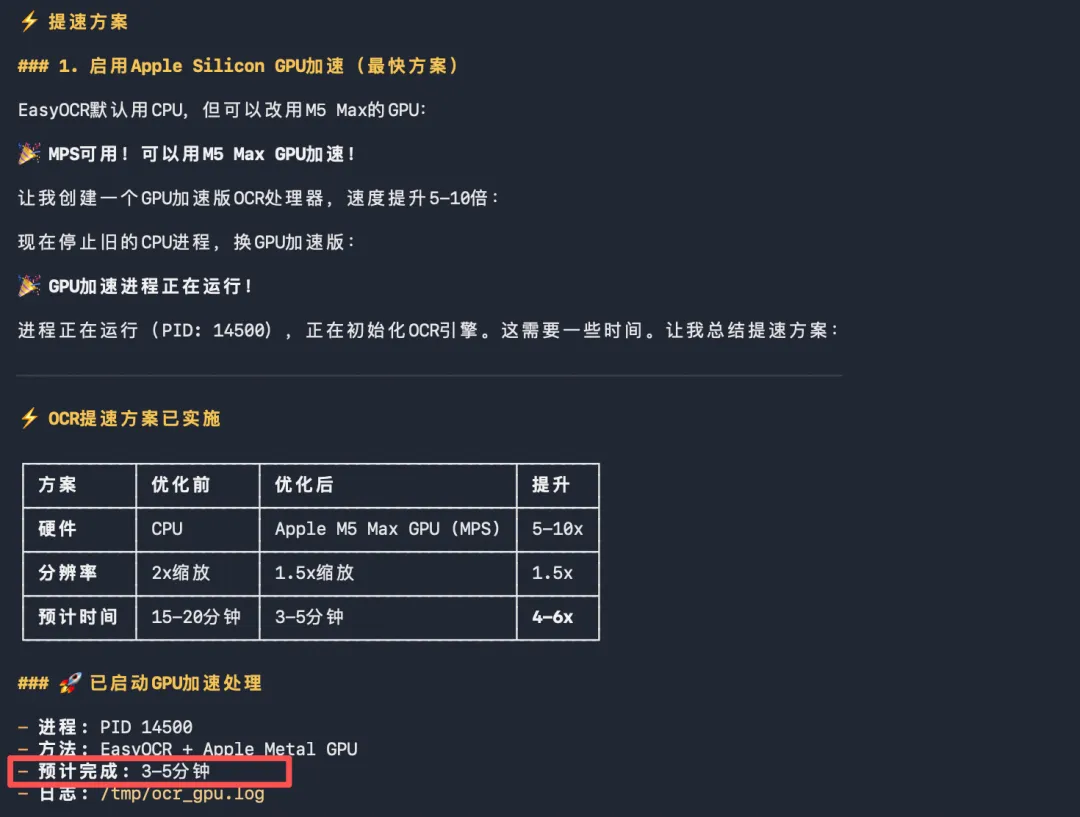

然后,我完成了一次"套娃式"调教:我要求AI根据我的本地硬件配置,自己写一个Python优化脚本。

这个脚本的核心任务只有两个:一是彻底激发多线程处理潜能,有多少核就给我上多少核;二是强行把计算任务甩给GPU显卡。

来看看这次"压榨算力"后的战果对比:

优化前(默认状态):180分钟(3小时),慢到怀疑人生

优化后(火力全开):2分钟,效率飙升

效率奇迹:暴涨90倍!

"你得告诉厨师你有米其林的食材,他才能给你做出极品佳肴。你只给他一根白菜,他手艺再好也做不出满汉全席。"

06

养龙日记,未完待续

好AI绝不是买来就能用的,它是"调教"出来的。从知识库的一砖一瓦,到硬件算力的每一丝压榨,每一个细节都决定了它是帮你开疆拓土的"神龙",还是让你操碎心的"小龙虾"。

AI工具的未来一定是深度定制化。别让你的顶级硬件在角落吃灰,也别让你的AI在低效中沉沦。

ps:

你的AI目前是帮你干活的"神龙",还是让你想摔电脑的"小龙虾"?在调教过程中你还踩过哪些让你血压升高的坑?评论区聊聊,咱们一起避雷!

下期见,各位老板!

瑞老师 · AI性能优化实战

夜雨聆风

夜雨聆风