你有没有这种感觉——

AI很强大,但跟它说什么,它给你的答案总是"差点意思"。

不是AI不够聪明,是它根本不知道你是谁、你做什么、你脑子里装着什么上下文。

这不是你的问题,也不是AI的问题。

是"上下文"的问题。

一个被反复验证的尴尬

我最近在折腾AI Agent,用的是MiniMax M2.7 + OpenClaw。

说真的,换了M2.7之后,模型确实能跑了——以前跑不通的复杂任务,现在能一条指令跑完了。

但跑着跑着,我发现了一个很别扭的问题:

AI执行任务的能力上去了,但它输出的东西,总是"对不上"我的实际需求。

让它写周报,它写得很完整,但格式跟公司的完全不一样。

让它整理会议纪要,它整理得很清晰,但它不知道这场会议是跟谁开的、讨论了什么背景。

让它做数据分析,它算得很准,但它不知道这份数据是哪个业务线的、应该跟哪些指标对比。

问题出在哪?

模型能处理信息,但它不知道这些信息对你意味着什么。

一个99%的人都没想清楚的真相

AI行业这两年聊得最多的,是模型能力。

谁家参数更大、谁家跑分更高、谁家上下文窗口更长……

这些当然重要。但大部分人忽略了一个更根本的问题:

模型能处理多少上下文,和模型能"读懂"多少上下文,是两回事。

打个比方:给你一堆原材料,厨师能做出菜来。但同样的原材料,一个跟你合作了三年的老助手,知道你的口味、知道你不能吃什么、知道今天是为重要客人准备的——他做出来的东西,就是不一样。

差距不在原材料,在"懂你"。

AI Agent也一样。

OpenClaw很强大,能操控各种工具、能执行复杂的多步骤任务。

但为什么它这么快就进入了"卸载周期"?

因为大部分人用它做不出真正能用的东西。不是它不会干活,是它不知道你的活长什么样。

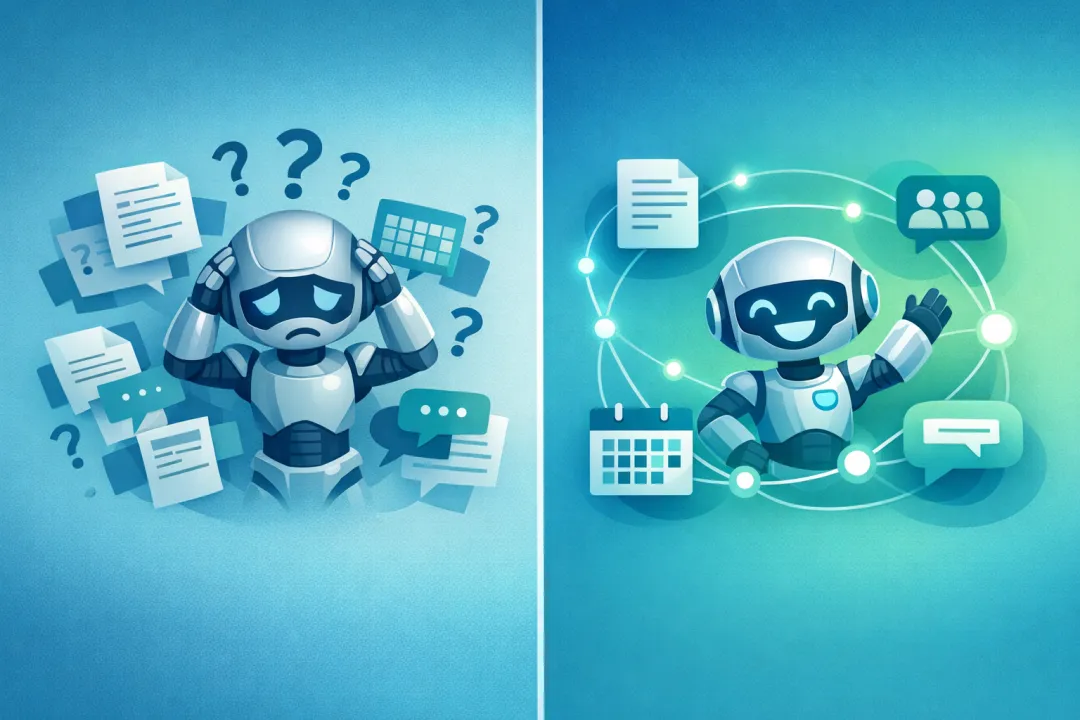

真正卡住AI的,不是模型,是上下文

什么叫上下文?

你写过的文档、开会说的内容、跟同事讨论过的背景、沉淀在飞书里的那些消息和表格——这些东西加起来,才是"你的工作"。

这些东西,AI模型本身是不知道的。

模型训练用的是公开数据,它能说清楚"什么是项目管理",但它不知道你们公司的项目管理是怎么分工的、谁负责哪块、什么节点该找谁。

这就是为什么AI落地这么难。

不是模型不够强,是你喂给它的上下文不够多、不够准确、不够结构化。

大多数AI工具,解决的是"模型能做什么"的问题。

真正决定使用体验的,是"AI能获取多少你的上下文"。

为什么飞书 aily,让我觉得不一样

飞书最近发布了 aily。

我仔细看了发布会,没有讲什么"颠覆性革命",也没有讲"AGI指日可待"。

它讲的就是一件事:让AI读懂你的工作。

第一,它能读你的飞书——你知道什么文档,它就能操作什么文档。你跟谁开过会、讨论过什么,它都能关联上。

第二,它有长期记忆——用得越多,它越懂你负责什么业务、偏好什么格式。

第三,它能调用技能——Skill市场里有官方认证的插件,安全扫描过,按需安装。

它不是凭空给你生成一个文件就完事了,它的交付物是文档、表格、任务——可以继续被协作、被引用、被追踪。

这不是一个生成工具,是一个工作流工具。

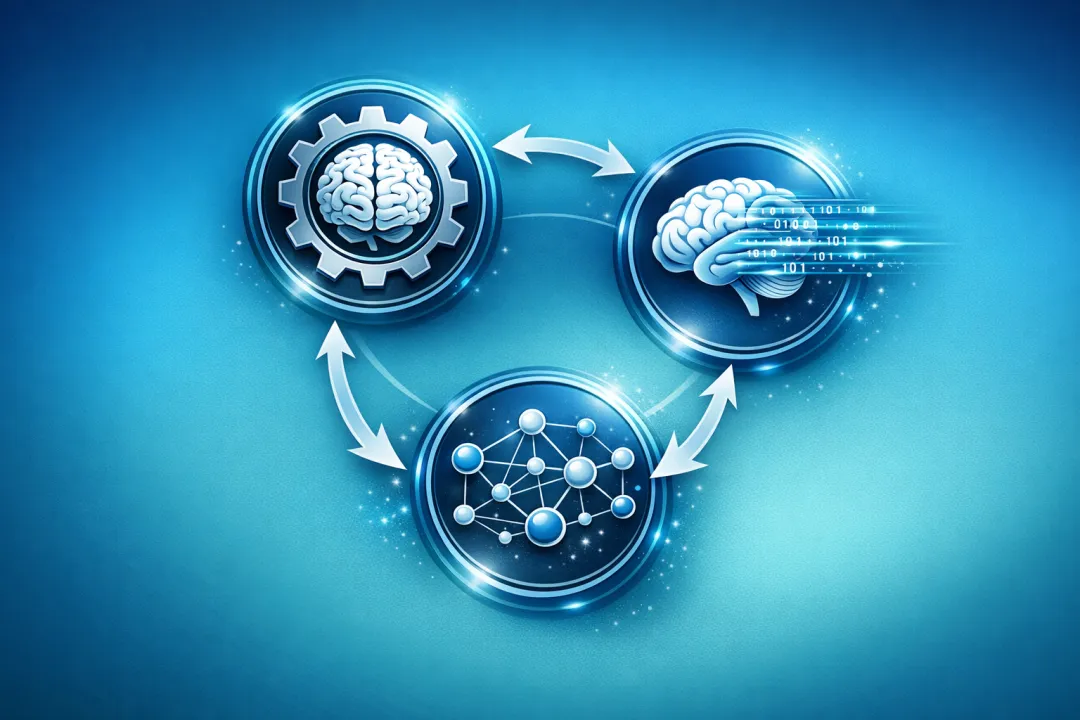

一个让我重新思考行业格局的洞察

企业AI竞争的终局,不取决于谁家模型最强,而取决于谁的地盘里上下文最丰富。

模型能力会越来越商品化,这是趋势。但你在某个平台上沉淀了几年的工作记录、决策过程、团队协作模式——这些东西是不可被复制的。

飞书的地盘可能不是最大的,但它沉淀的上下文密度可能是最高的。

换句话说:你在哪个平台留下了最多的工作痕迹,那个平台的AI就最懂你。

这不是功能竞争,是数据生态竞争。

给普通人的判断框架

第一,不要只看模型参数选AI工具。

模型能力固然重要,但更重要的是:这个AI能不能获取你的工作上下文?如果不能,再强的模型也是空转。

第二,重视工作数据的结构化沉淀。

你今天在飞书里写的每一份文档、开的每一个会议、填的每一个表格——都是未来AI理解你的原材料。

第三,AI落地的门槛在降低,不是在抬高。

从"会写代码才能用",到"会用飞书",门槛已经降了很多。接下来的趋势是:AI会越来越像"同事"而不是"工具"。

写在最后

回到开头的问题:为什么你的AI助手,总是不懂你的工作?

现在你知道了——不是它不够聪明,是它没有足够的上下文。

给它上下文,它就能懂你,让它接入你的工作流,它就能真正帮你干活。

OpenClaw解决了"AI能做什么"的问题。

飞书 aily在试图解决"AI怎么能懂你"的问题。

这才是AI真正落地的样子。

不是替代你思考,是帮你省掉那些消耗精力的琐碎,让你腾出脑子去做真正重要的事。

有些东西,自己用一遍,才会有最真实的感受。

公众号后台回复「龙虾」,加入交流群一起探讨龙虾。

夜雨聆风

夜雨聆风