引言

智能体的相关概念在不断演进推陈出新。本文初步梳理了目前比较成熟的概念,并以结构图与时序图的方式呈现,让读者可以直观地看到技术演进的脉络。同时,我们结合2024年9月的Google Agent开发白皮书与OpenClaw案例,通过对比表格,分析不同阶段智能体技术的核心差异,帮助你快速建立认知地图。

概念梳理:智能体的核心能力拆解

AI Agent的核心技术可概括为:以大模型为“大脑”,以规划推理为“思维”,以工具调用为“手脚”,以智能体协作为“团队”,以环境互动为“感知”。

1. 规划推理为“思维”——什么是Agent

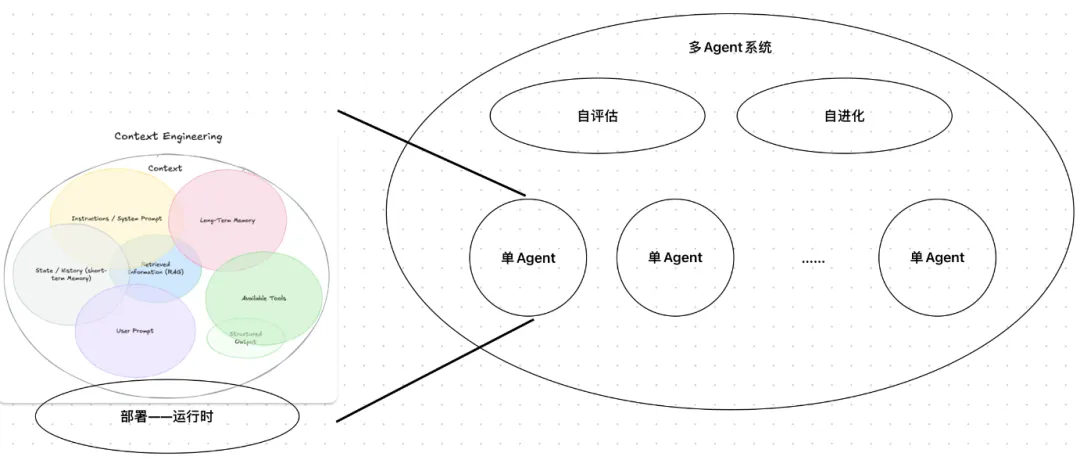

一个最小的单体Agent,其核心是从提示词工程向上下文工程的演进。这一演进反映出业界不再满足于仅通过提示词“调用”大模型大脑中预先学习到的知识,而是通过上下文工程,将实际场景中“感知”到的信息和以工具为“手脚”的能力融合,更好地解决当前任务。

提示词工程

指为生成式AI模型设计和优化提示的过程,以获得高质量的模型响应。它包括精心设计清晰、具体且与任务相关的提示,引导模型输出有用结果。提示词工程在软件开发中应用广泛,例如让LLM根据简要对话生成故事、API或测试用例。培养有效的提示词技巧正成为处理AI系统的重要技能——有人视之为艺术,有人视之为科学。但同时也需警惕“提示注入攻击”等安全风险。

上下文工程

旨在让AI模型在正确的时间获取正确的信息。它涵盖了将大型语言模型与企业数据(文档、数据库、日志和机构知识)连接所需的策略、架构和工具,使模型能够准确地对特定领域的内容进行推理。

2. 环境互动为“感知”——外部数据

RAG

检索增强生成是一种通过为生成式大语言模型提供外部知识库访问权限,让模型在生成答案前先从指定数据源检索相关信息,并利用这些信息构建回答的技术框架。

Memory

智能体记忆是指智能体在与其他智能体、用户或环境交互过程中,对信息进行编码、存储、检索和管理的机制,使其能够在长期任务中积累知识、学习经验、适应新任务而不遗忘旧知识。

3. 工具调用为“手脚”——工具集成

Function Call

OpenAI在Chat Completions API中正式引入Function Calling功能,允许开发者向GPT模型描述函数,模型智能选择输出包含调用这些函数参数的JSON对象。

MCP

由Anthropic推出的开源协议,旨在为大型语言模型与外部数据源和工具之间的连接提供统一、标准化的接口。

Skill

同样由Anthropic提出的概念,指将特定任务的执行方法、工具调用方式以及相关知识材料封装为一个完整的“能力扩展包”,使AI智能体具备稳定、可复用、可传承的做事方法。

Computer Use

Anthropic的“Computer Use”功能让AI模型(如Claude 3.5 Sonnet)像人类一样直接操作电脑屏幕、移动光标、点击按钮和输入文本。它标志着AI交互从传统的“对话框”跃迁到了“操作系统界面”的新范式。

4. 运行环境——部署环境

安全沙箱

在AI智能体领域,安全沙箱指通过操作系统级的隔离技术,为AI智能体创建一个受限的执行环境,使其在运行代码、调用工具、访问资源时无法影响宿主系统安全的技术机制。2025年初Claude的Computer Use功能遭恶意利用造成主机劫持、Cursor AI的YOLO模式暴露主机被控风险——智能体安全事件多点爆发,凸显了安全沙箱的重要性。

5. 智能体协作为“团队”——多智能体(系统)

多智能体系统代表了协作智能的顶峰,它使多个自主智能体能够通过协调与通信,共同解决远超单个智能体能力范围的复杂问题。从线性工作流出发,业界发展出了蜂群、交叉评估等多种团队协同分工机制。在实践中,多智能体协同机制与智能体自我评估、长时间自主工作、自我演进相互关联、相互影响。

智能体工作流

- 广义定义:

指将大语言模型与预定义的执行步骤相结合的系统,其中工作流提供结构化的流程框架,LLM在关键节点提供智能决策和内容生成。 - 狭义定义:

指由LLM驱动的、能够自主规划、执行和调整任务步骤的动态流程系统,区别于传统的、完全由开发者预先写死的确定性流程。

6. AGI智能化

需要指出的是,广义上的自我评估、自我演进等概念,至少可追溯到提示词与上下文工程的相关论文(如ReAct与CoT)。

自我评估

智能体自我评估是指智能体在执行任务过程中或完成后,对自己的推理过程、中间步骤和最终输出进行质量检查、错误识别和反思改进的能力。

长时间自主工作

长时自主工作智能体指能够在长时间尺度(数小时至数天)内,无需人工干预,自主维持目标一致性、动态适应环境变化、持续执行复杂任务并积累经验的智能体系统。

自我演进

自我演进是指智能体在与环境持续交互的过程中,自主地调整和优化自身的模型参数、记忆结构、工具使用能力乃至整体架构,从而不断提升任务性能和适应能力的过程。

技术演进时间线

案例分析:从Google白皮书到OpenClaw

本章节我们以2024年9月的Google Agent开发白皮书和OpenClaw为案例,分析智能体技术的演进。

Google Agent白皮书(2024年9月)

2024年9月的Google Agent开发白皮书反映了当时主流的Agent设计思路(下图左)。那时MCP(24年10月发布)尚未出现,架构相对简单——主要依赖提示词、代码编排、记忆和工具调用。而在2025年11月的新版白皮书中(下图右),我们看到了包含多智能体系统的金字塔形层级规划。当时,Agent设计主要聚焦在单智能体实现上,采用上下文工程作为指导思想,基于系统提示词、RAG、Memory、Function Call实现业务逻辑。在自适应与评估方面,主要依赖CoT、ReAct、ToT等提示词设计思想。

OpenClaw:多智能体系统的实践样本

OpenClaw实际上可以被认为是一个多智能体系统,其单体智能体通过用户配置的方式由pi-agent-core框架实现。

- 工具支持方面:

pi-agent-core本身拥有良好的工具集成能力,支持Function Call、MCP与Skill。 - 安全方面:

支持沙箱功能,有效隔离风险。多智能体交互方面,OpenClaw摒弃了传统的线性工作流布局,转而通过控制平面与队列进行消息传递。这一设计带来了几个关键优势: 每个智能体只关注自己需要响应的队列任务,在完成任务后自动挂起,释放资源。 通过监听机制和定时任务,实现长时间运行。 以文件方式传递状态与上下文,保持低耦合。 通过自我评估触发上下文压缩,避免上下文过长导致的性能下降。OpenClaw的设计理念体现了智能体技术从“单体工具”向“生态协作”的演进,为复杂任务的自动化提供了可借鉴的范例。 OpenClaw的详细技术解读,可以参考笔者之前的文章。

互动话题

💬 你在实际项目或实验中,尝试让AI智能体帮你解决过最“棘手”或最“有趣”的任务是什么?

是让它帮你自动整理周报、爬取数据? 还是尝试了本文提到的多智能体协作、或者接入了MCP工具?欢迎在评论区“晒”出你的智能体应用场景或踩坑经历,无论是成功的经验还是失败的教训,都可能成为其他开发者宝贵的参考!咱们一起把评论区变成一个“智能体实战案例库”。

夜雨聆风

夜雨聆风