Openclaw记忆这件事,一直是个让人又爱又恨的功能。

有记忆,好;但记混了、记错了、明明告诉过它的事情下次又问你,比没有记忆更烦。

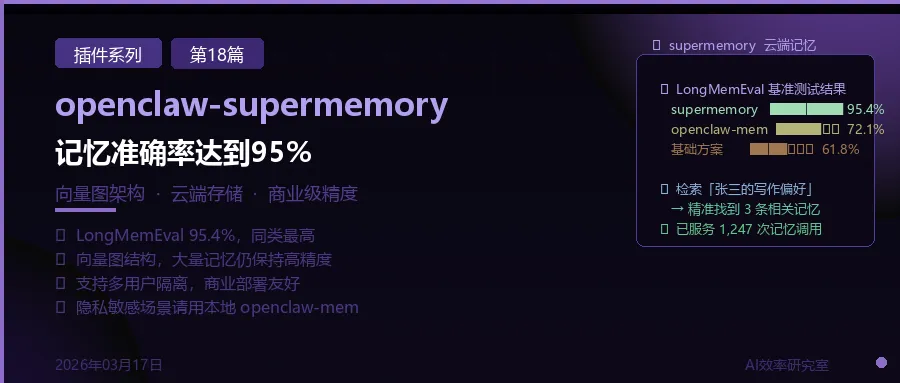

记忆的核心挑战不是"能不能存",而是"存进去的东西能不能在对的时候精准找回来"。本地的openclaw-mem解决了基础的持久记忆问题,但在记忆精度上有局限。对于真正需要高准确率的场景,openclaw-supermemory提供了一个更强的方案。

它是什么

openclaw-supermemory是一个基于Supermemory云端服务的记忆插件,核心技术是向量图(Vector Graph)记忆架构。

它在LongMemEval基准测试中达到了95.4%的记忆准确率,这是目前公开测试里AI记忆方案的顶级水平。对比一下,大多数基础记忆方案的准确率在60-75%之间,差距相当明显。

高准确率背后的原理:普通的记忆方案通常把内容向量化存储,检索时用相似度匹配。这在内容简单的时候够用,但在记忆量大、内容复杂的情况下,相似度匹配容易"找错"——找到语义相近但实际上不是你需要的那条记忆。

supermemory在向量存储的基础上加了图结构:记忆之间的关联关系也被建模,检索时同时利用语义相似度和关联网络,找到的结果更准确,也更有上下文。

和本地 openclaw-mem 的区别

| 对比项 | openclaw-mem | openclaw-supermemory |

|---|---|---|

| 存储位置 | 本地(数据不出门) | 云端(Supermemory服务器) |

| 记忆精度 | 中等 | 95.4%(LongMemEval) |

| 隐私性 | 高 | 中(数据上云) |

| 适用场景 | 个人使用、隐私敏感 | 商业部署、高精度需求 |

| 联网要求 | 不需要 | 需要 |

选哪个取决于你的需求:个人使用、对隐私比较在意的,用本地openclaw-mem;商业部署、需要极高记忆精度、不介意数据上云的,supermemory是更好的选择。

能解决什么问题

场景一:高频交互的商业AI助手

客服机器人、销售辅助AI、用户成长顾问……这类场景里AI需要记住大量用户的偏好、历史对话、购买记录,并在几十万条记忆中精准找到和当前对话相关的那几条。

普通记忆方案在这个量级下准确率会明显下降,supermemory的图结构架构在大规模记忆中保持高精度。

场景二:需要跨会话长期记忆的专业工具

比如AI写作助手,需要记住你写过的所有文章、你的写作风格偏好、你不喜欢的表达方式、已经用过的例子……这些记忆量很大,而且检索时需要非常精准,用错了记忆比没有记忆还糟糕。

场景三:多用户共享的团队AI

团队里每个人都和同一个AI交互,AI需要区分不同用户的记忆,同时能在共享知识库里检索相关信息,精准度要求很高。

怎么装

前提:需要注册Supermemory账号(supermemory.ai),获取API Key。

clawcli install openclaw-supermemory

配置API Key和存储空间:

clawcli config openclaw-supermemory --api-key 你的API_Key clawcli config openclaw-supermemory --space-id 你的空间ID

如果是多用户场景,可以按用户ID分隔记忆空间:

clawcli config openclaw-supermemory --user-isolation true

重启服务:

openclaw restart

装好之后,OpenClaw的记忆操作会自动路由到supermemory,你不需要改变使用方式。

怎么用

使用方式和普通记忆插件一样,直接对话操作:

存入记忆:

记住:用户张三偏好简洁的回答风格,不喜欢长篇大论

检索记忆:

我之前记过关于张三的哪些偏好?

查看当前记忆存储统计:

clawcli status openclaw-supermemory

一个重要提醒

supermemory是云端服务,你存入的内容会上传到Supermemory的服务器。如果涉及用户隐私数据、企业机密、个人敏感信息,使用前需要评估一下数据合规性,看是否符合你所在地区和行业的数据保护要求。

对于完全不能让数据出门的场景,请使用本地的openclaw-mem,记忆精度低一点,但数据留在你手里。

小结

95.4%的记忆准确率,对于商业化AI部署来说是一个实质性的差距。如果你在构建一个需要大规模、高精度记忆能力的AI产品,supermemory是目前插件生态里最好的选项之一。

下一篇聊openclaw-framework,多个AI项目同时跑的调度管理方案,用本地Web仪表板统一管理所有自动化任务。

夜雨聆风

夜雨聆风