用 OpenClaw 的人,大概都碰到过一个很现实的问题。

一开始聊得挺顺,需求、约束、项目背景都交代清楚了,AI 也像是“听明白了”。但对话一拉长,前面那些关键设定就开始往后掉。你明明前面说过一遍,它还是会在后面突然“失忆”,逼得你再提醒一次。次数多了,真的会有点烦。

OpenClaw 作者显然也意识到了这个痛点,所以给了一个很务实的推荐:ossless-claw。

这不是那种“功能很多、介绍很炫”的插件,它解决的问题特别直接——别让长对话里的重要信息白白丢掉。

它的思路也挺聪明。不是一股脑把所有聊天记录都硬塞进上下文里,那样 Token 很快就炸了,而是把每条消息先持久化进 SQLite 数据库,再在后台把旧消息逐层整理、压缩,做成一种树状摘要结构。说白了,就是把“原始记录”和“浓缩记忆”分开存着:该省的省,该留的留。

这个设计最妙的地方在于,它不是简单粗暴地删旧消息,而是尽量保留信息脉络。你后面继续聊的时候,AI 拿到的不只是零散摘要,而是经过组织后的历史上下文。那种“前面说过,但系统已经忘了”的割裂感,会轻很多。

更实用的一点,是它不只会“记”,还给 AI 配了检索能力。

像 lcm_grep、lcm_describe 这类工具,本质上是在给模型一个翻旧账的入口。AI 如果在当前上下文里找不到某个细节,不用硬猜,也不用你重新复述,它可以回头去搜原始记录,把之前讲过的设定、路径、结论再捞出来。

这个感觉其实很重要。

因为很多 AI 工具的问题,不是不会答,而是聊到后面开始靠猜。一旦猜,项目就容易跑偏。尤其你拿它写代码、做 Agent、推进复杂任务时,最怕的不是它慢,而是它自信地忘了。

ossless-claw 的价值就在这儿:它不是让模型变聪明了,而是尽量别让它在本来该记住的地方犯傻。

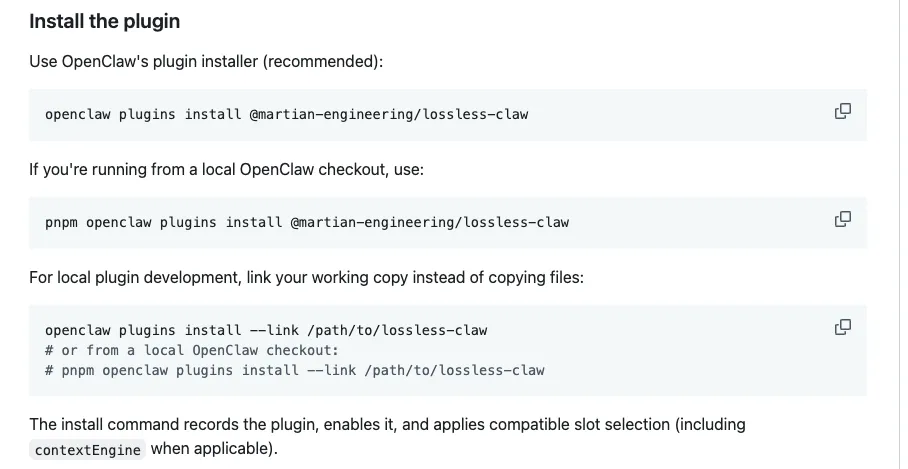

安装也不折腾,基本上一条命令就能塞进 OpenClaw。最近保留多少消息、什么时候触发压缩,这些参数也都能自己调。你可以按项目复杂度来配,不至于被默认设置绑死。

我会觉得,这类插件现在已经不算“锦上添花”了,越来越像长流程 AI 工具的基础设施。

大家以前总在卷模型能力、卷提示词、卷 Agent 框架,但真到了实际使用阶段,很多体验问题最后都落在这种很朴素的地方:它到底记不记得我前面说过什么。

所以,如果你正在用 OpenClaw,或者本来就在拿 AI 跑复杂项目、长链路任务,又总被上下文限制折腾,那这个插件确实值得装上试试。

它不花哨,但很对症。

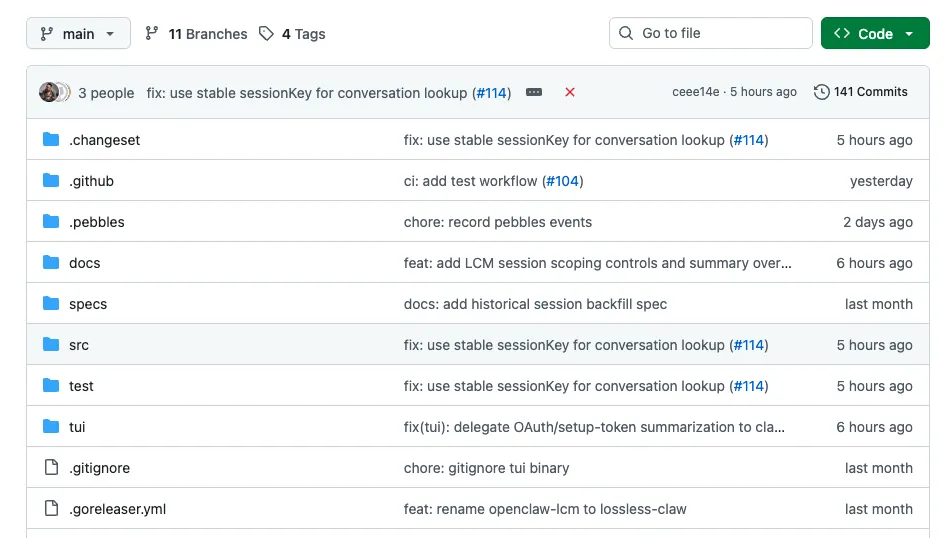

GitHub地址:martian-engineering/lossless-claw

夜雨聆风

夜雨聆风