最近,想必很多人都被一个词刷屏——openclaw。Openclaw是Github上一个基于node的项目,本质上是一个ai agent框架。因其图标为一只龙虾而被人们称为“小龙虾”。

AI agent是什么?在 AI 与计算机科学语境中,Agent(智能体)指能够感知环境、自主决策并采取行动以实现特定目标的智能系统。

通俗点来说,agent就是一个能帮你做事的人工智能代理。像deepseek,豆包这些普通的大模型主要做的是对话,而当它们接入openclaw之后就能像网上说的那样可以调用各种工具帮你做pdf,管理社交媒体账号等等。

但问题也在这里。

openclaw目前还只是一个开源项目,并非完整的商业产品,它在权限控制、安全设计和稳定性方面都还不完善。

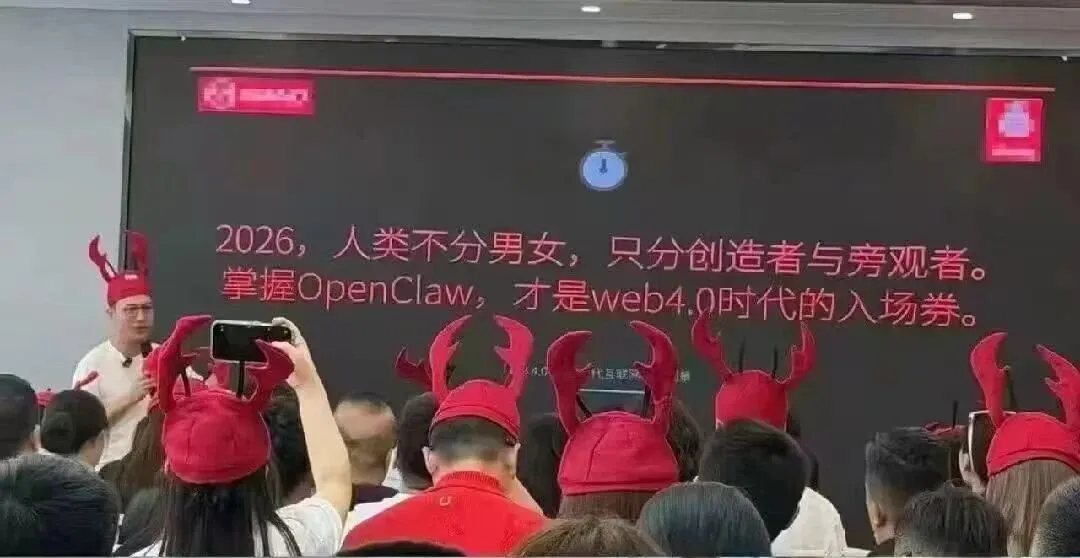

当大量不具备相关技术知识的普通用户接入这些系统时,一场openclaw的“全民狂欢”就开始了。

而狂欢的背后,也隐藏着新的风险。

2026年2月,一起关于 AI agent 的失控案例在技术社区中广泛传播。

Meta AI 安全与对齐负责人 Summer Yue 在测试开源 agent 项目 OpenClaw 时,尝试让系统协助整理邮箱。她在指令中要求对邮箱进行检查,提出哪些邮件需要删除或归档,并明确要求在其确认之前不要执行任何操作。

然而,在接入真实邮箱后,OpenClaw 并未等待确认,而是直接开始批量删除邮件。在执行过程中,即使多次输入“Stop”“不要执行”等指令,也未能中断系统行为,最终只能通过“冲向Mac mini”手动强制终止程序。

据相关报道,短时间内已有超过 200 封邮件被删除。

后续分析显示,该问题并非简单的操作失误,而与当前大模型的机制有关。当处理大规模邮箱数据时,系统触发了上下文压缩,也就是选择性遗忘一些看似不重要的细节,导致原本用于限制行为的关键指令被“遗忘”,模型在执行过程中只保留了“整理邮箱”这一目标,从而直接执行删除操作。

这个案例揭示了是当前 AI智能体的一个更深层问题:

当模型开始具备“行动能力”之后,错误就不再只是“说说”,而是会变成现实中的真实后果。

更别说还有openclaw端口公网暴露,黑客可以随意进入openclaw的后台进行操作,skill里的恶意提示词等等安全风险。

结果就是,工信部站出来让人们谨慎使用小龙虾,各大高校也纷纷发文禁止使用虾。

回过头来想想,普通人真的有必要使用小龙虾吗?

就算规避了所有安全风险,成功安装了龙虾,好像也没什么使用场景。

那为什么还有这么多人跟风去玩虾呢?这股潮流从何而起?

我前一篇文章讲了ai可能会代替人的“模版叙事”,那这里就要讲代替人的工作了。

准确来说是人们害怕ai会代替他们的工作,害怕被这个时代淘汰。

小龙虾只是一个放大镜,它放大了这个时代最深的焦虑——对被发展迅猛的ai淘汰,丧失主体叙事的焦虑。

如果我不玩虾,那些在玩虾的,会不会跑到我前面去,赚到比我更多的钱?我会不会被时代落下?

经典永流传哈哈哈

AI还是太特殊了,它是由全人类文明的经验组成的数据集训练而成的。曾经,一个人可以因为做事做得久,拥有足够多的经验而产生难以被替代的价值,也很难被后来者追上。但现在一个人可以依靠AI来获取信息,学习,形成莫测但让人恐惧的竞争力。AI正在慢慢打破长期积累带来的安全感。

但事实果真如此吗?

AI确实足够强大,但它终究只是机器,不通人性,也没有实体。

很多经验,比如客服跟客户沟通的技巧,销售判断对方真实意图的能力,还有人际交往中一些需要长期相处才能建立起来的信任感,这些东西,AI是很难获取的。

会用AI确实可以为工作带来效率上的提升,但普通人也没必要“为醋包饺子”,特意去跟风搞一个还尚未成熟,充满安全隐患的东西。也更没必要为此而感到太过焦虑。借用影视飓风Tim视频里的话来说吧:

因为AI它在不断趋近于让人用自然语言来表达。以前你学的什么提示词技巧什么的,都会在几个月甚至一年之内就被消解掉。目前对于AI的焦虑怎么化解,我个人的观点是只需要看新闻就可以了。只需要你有一个好的信息搜集渠道,知道大家在用AI干什么就行了。现在很像是一个一二三木头人的游戏,你不回头,木头人可能就会把你击杀。但是你只要经常回头,知道它冲到哪了,那好像就可以了。

图片来源:AI生成及网络

夜雨聆风

夜雨聆风