本地跑 OpenClaw,真的比云端香吗?

朋友问我:"你这个 AI 助手跑在哪?"

我说本地服务器。他一脸惊讶——现在还有人费这劲?不是一堆平台一键部署就行了吗?

我用了大半年本地部署的 OpenClaw,说说真实感受。

先聊最在意的:隐私

▲ 数据隐私保护概念图

本地部署最大的卖点就一个字:我的数据在我这儿。

OpenClaw 作为 AI Agent,能读你的消息、操作你的文件、调用你的 API Key。这些东西如果跑在别人的云服务器上,你会怎么想?哪怕服务商口碑再好,合同条款写得再漂亮,你的对话记录、工作文档、API 密钥这些敏感信息,终究是从你的机器搬到了别人的硬盘上。

本地部署不存在这个问题。数据从头到尾没离开过你的硬盘,网络请求只走你配好的模型 API,没有中间商。

对处理商业敏感信息的用户来说,这一条就够了。

费用这回事

云部署的价格不算贵,但它是按月计费的。一个月 24 美元起步,一年下来 288 美元。三年就是 864 美元。

这钱能买一台相当不错的小主机了。

如果你手头刚好有闲置的旧电脑、一台树莓派、或者一台 Mac Mini,那实际投入几乎为零。我就是在家里一台旧 Linux 工作站上跑的,已经跑了半年多,除了电费没别的开销。

当然,硬件出故障你得自己修。云服务器挂了有人帮你换,本地机器坏了没人替你重启服务。这笔账因人而异,但如果你的闲置硬件能用,本地部署在成本上确实划算得多。

想怎么改就怎么改

▲ 定制化工具箱概念图

这是本地部署的另一个杀手锏。

云端部署用的是平台预制好的镜像,你只能调调配置文件。但本地部署,你可以直接改 OpenClaw 的源码,装自己写的 Skills,配自定义的 MCP 工具,甚至改它的运行逻辑。

我干过几个事:

给 OpenClaw 写了个定时任务技能,让它每天早上自动推送行业热点摘要。这东西云端版本得等官方支持,我自己本地直接加了。

接了一套自动化工作流,让它帮我管理飞书群里的待办事项,同步到日历。这需要对 MCP 协议和飞书 API 做定制,本地改起来毫无阻碍。

调试的时候想看完整日志,tail -f 就行。云端版本你连日志都不一定能拿到。

离线也不是不行

这个很多人不知道:OpenClaw 配合 Ollama 跑本地大模型,可以做到完全离线使用。

我在公司网络不稳定的时候试过,用本地跑的 Llama 模型顶了一下午。体验肯定不如 Claude 或 GPT-4,但基本的对话、文件整理、代码审阅都能跑。关键时刻不掉链子,这个价值比想象中大。

说点不香的

本地部署不是没有代价。

安全风险是实打实的。 AI Agent 有执行 shell 命令、读写文件的能力,跑在本地意味着它直接接触你的系统。一旦配置不当或者被提示注入攻击,后果比云端严重得多。安全圈有人直接说这是"安全噩梦"。

所以该做的隔离措施不能省:Docker 容器、非 root 用户、防火墙规则、API Key 限权,这些一个都不能少。

配置门槛也不低。 装 Node.js、配守护进程、搞反向代理、管 SSL 证书、设置自动更新……对于不熟悉 Linux 的用户来说,光是搭建环境就要花一两个晚上。而且后续的维护也得你自己来——系统更新、磁盘空间监控、日志轮转,都是你的事。

硬件性能有限。 我的旧工作站跑 OpenClaw 本身没什么压力,但如果同时跑本地大模型做推理,内存和 GPU 就捉襟见肘了。云端随便升配,本地换硬件就麻烦得多。

到底怎么选

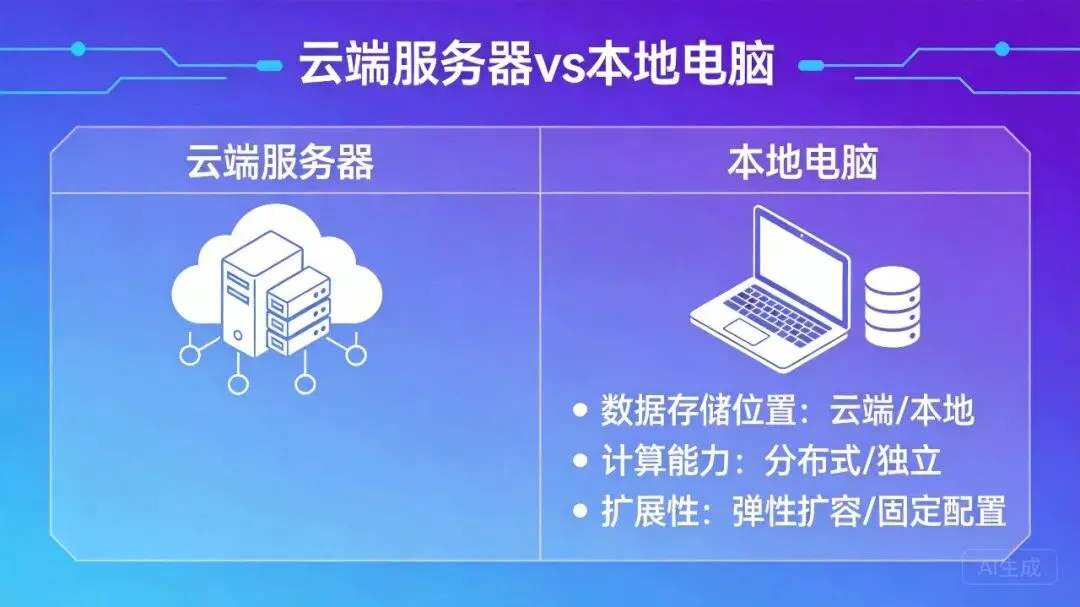

▲ 云端vs本地部署对比图

我的建议很简单:

选本地的情况: 你有一台闲置机器,你重视数据隐私,你愿意花时间折腾技术,你想深度定制自己的 AI 助手。

选云端的情况: 你只是想先试试 OpenClaw,你不想管运维的事,你需要多人协作,你的安全要求更倾向于隔离而不是控制。

两条路都行,没有绝对的好坏。我自己选本地,是因为我享受掌控一切的踏实感——我的数据、我的配置、我的工具链,全在我手里。这种自由感,是云端服务给不了的。

想试试本地部署?OpenClaw 官方文档写得很清楚,Docker 一键启动,十分钟就能跑起来。先在旧机器上练手,熟悉了再考虑当主力用。

好了,是不是很简单,今天的分享就到此结束,咱们下回见;

如果觉得文章对你有帮助,记得点.赞.转.发.收.藏喔!

夜雨聆风

夜雨聆风