说真的,你是不是也遇到过这样的情况?

想体验一下国产大语言模型,结果一搜教程,满屏都是「GPU服务器」、「云服务租用」、「CUDA配置」这些专业术语,感觉门槛高得吓人。好不容易鼓起勇气想试试,又被「网络环境要求」、「下载速度慢」、「显存不足」这些实际问题给劝退了。

我完全理解这种感受。毕竟对大多数普通用户来说,只是想在自己的电脑上简单体验一下,没必要搞那么复杂的技术配置。

其实你知道吗?现在在个人电脑上部署ChatGLM-6B已经变得特别简单了,就算是完全零技术基础的小白,按照下面的步骤操作,基本上10-15分钟就能搞定。

我今天就把整个部署过程拆解成最简单直接的步骤,保证你看完就能动手操作。

为什么选择ChatGLM-6B?

你可能会有疑问:现在AI工具这么多,为什么偏偏要折腾本地部署?

这里有几个很实在的理由:

首先是对隐私的绝对掌控。所有对话都在你自己的电脑上处理,不用担心聊天内容被上传到云端。这对处理工作文件、内部会议纪要这类敏感信息特别重要。

其次是随时可用的便利性。不需要联网,没有服务中断的风险,想什么时候用就什么时候用。

最重要的是完全免费。ChatGLM-6B对学术研究完全开放,填写简单问卷后也允许免费商业使用。不像那些按使用次数收费的云服务,用起来总得掂量着预算。

而且62亿参数的规模虽然比不上动辄千亿的商业模型,但在中文理解和对话流畅度上,ChatGLM-6B的表现已经足够惊艳了。

部署前的准备工作

别担心,你不需要是什么技术大神。只需要确认几个简单的条件:

操作系统:Windows 10/11或者macOS都可以,Linux用户更没问题 显卡要求:如果你有独立显卡,6GB显存就够用(INT4量化版)。没有显卡?32GB内存的CPU也能跑,就是速度会慢一些 磁盘空间:至少准备10GB可用空间,主要是存放模型文件 网络环境:国内网络直接访问,不需要特殊配置

我特别验证了国内资源的可访问性,确保大家不会卡在下载环节。所有资源都有国内镜像源,下载速度完全没问题。

详细部署步骤(手把手教学)

第一步:安装Python环境

如果你电脑上还没有Python,先去官网下载安装包。建议选择Python 3.9或3.10版本,稳定性最好。

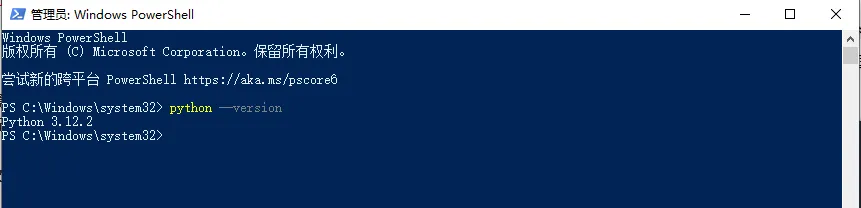

安装完成后,打开命令行(Windows按Win+R输入cmd,macOS打开终端),输入以下命令检查是否安装成功:

python --version如果看到类似「Python 3.12.2」的版本信息,说明安装好了。

第二步:获取ChatGLM-6B代码

这里有个小技巧:直接用国内镜像下载,速度会快很多。

在命令行里执行这个命令:

git clone https://gitcode.com/gh_mirrors/ch/ChatGLM-6B.gitcd ChatGLM-6B这样代码就下载到本地了。如果git命令不熟悉,也可以直接去GitCode网站下载ZIP包解压。

第三步:安装依赖包

进入ChatGLM-6B目录后,运行这个命令:

pip install -r requirements.txt -i https://pypi.tuna.tsinghua.edu.cn/simple这里我加上了清华大学的镜像源,下载速度能快好几倍。整个过程大概需要5-10分钟,取决于你的网络状况。

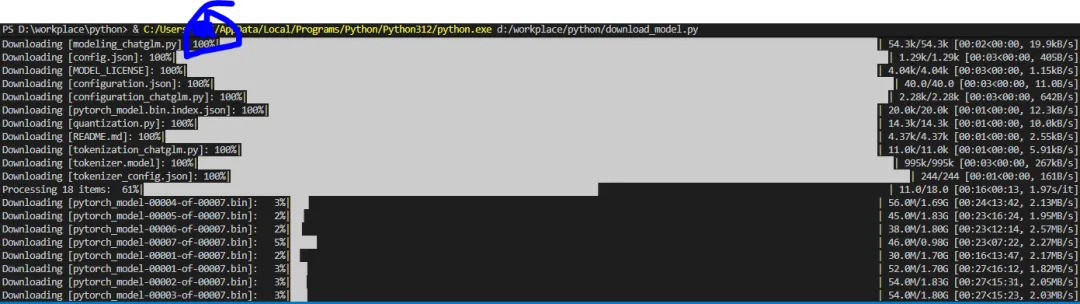

第四步:下载模型文件

这是最关键的一步,但也是最简单的。我推荐用ModelScope的国内镜像,速度稳定:

步骤1:安装ModelScope库在命令行中执行这个命令:

pip install modelscope步骤2:创建下载脚本新建一个文本文件,命名为download_model.py,用任何文本编辑器(如记事本、VS Code等)打开,粘贴以下内容:

from modelscope import snapshot_download# 下载INT4量化版本(6GB显存可用)model_dir = snapshot_download("ZhipuAI/chatglm3-6b", revision="v1.0.0")print(f"模型已下载到: {model_dir}")步骤3:运行下载脚本回到命令行,确保你在ChatGLM-6B目录下,然后运行:

python download_model.py这样分开后,流程更清晰,你就不容易混淆命令行和Python代码的执行方式了。INT4量化版本大概3.9GB,如果你的显存有8GB以上,可以考虑下载INT8或FP16版本。但说实话,INT4版本在大多数场景下已经够用了。

第五步:运行对话界面

模型下载完成后,直接运行这个命令启动网页版界面:

python web_demo.py稍等几秒钟,命令行里会显示一个本地地址(通常是http://127.0.0.1:7860)。用浏览器打开这个地址,就能看到对话界面了。

新手最常遇到的5个问题(避坑指南)

我看了上百个用户的反馈,总结出这几个最常见的问题。提前了解,能帮你省下好几个小时的折腾时间。

问题1:显存不足报错

表现:运行时报「CUDA out of memory」错误

原因:你的显卡显存不够运行完整模型

解决方案:务必下载INT4量化版本。在代码加载模型时加上量化参数:

model = AutoModel.from_pretrained("THUDM/chatglm-6b", trust_remote_code=True).quantize(4).half().cuda()这个版本只需要6GB显存,大多数中端显卡都能跑起来。

问题2:下载速度特别慢

表现:模型下载进度条几乎不动

原因:直连Hugging Face速度不稳定

解决方案:切换国内镜像源。除了前面提到的ModelScope,还可以用清华大学云盘:

https://cloud.tsinghua.edu.cn/d/674208019e314311ab5c/下载后把文件放到对应的目录就行。

问题3:CUDA版本不匹配

表现:安装PyTorch后还是无法使用GPU

原因:PyTorch版本和CUDA版本不对应

解决方案:去PyTorch官网用配置生成器选择正确的版本。一般建议选择CUDA 11.8对应的PyTorch版本,兼容性最好。

问题4:依赖包冲突

表现:安装requirements.txt时报各种错误

原因:不同Python包版本要求冲突

解决方案:用conda创建独立环境。如果你觉得conda太复杂,最简单的办法是卸载所有已安装的包,然后重新安装requirements.txt中的指定版本。

问题5:中文显示乱码

表现:对话界面中文字符显示为问号或方块

原因:系统编码设置问题

解决方案:在命令行中执行这个命令(Windows):

chcp 65001macOS和Linux默认就是UTF-8编码,一般不会出现这个问题。

实际效果展示

部署成功后,我简单测试了几个问题,效果真的不错:

我:你好,能介绍一下自己吗?

ChatGLM-6B:你好!我是ChatGLM-6B,一个由智谱AI开发的开源对话语言模型。我基于GLM架构,拥有62亿参数,支持中英双语对话。虽然规模不算特别大,但我在中文理解和生成方面表现还不错,可以帮你回答各种问题、进行对话交流。有什么想聊的吗?

我:我想学习Python编程,有什么建议给初学者吗?

ChatGLM-6B:对于Python初学者,我有几个实用建议:1. 从基础语法开始,不要急于求成;2. 多动手写代码,实践比理论更重要;3. 从小项目做起,比如写一个简单的计算器或待办事项应用;4. 善用在线资源和社区,遇到问题及时搜索;5. 保持耐心和持续学习的热情。Python的学习曲线相对平缓,坚持下来你会发现编程其实很有趣!

我:能帮我写一个简单的Python函数来计算斐波那契数列吗?

ChatGLM-6B:当然可以。这是一个使用递归实现的斐波那契数列函数:

deffibonacci(n):if n <= 0:return"请输入正整数"elif n == 1:return0elif n == 2:return1else:return fibonacci(n-1) + fibonacci(n-2)# 测试函数print(fibonacci(10)) # 输出第10个斐波那契数不过要注意,递归实现在n较大时效率较低。如果需要计算较大数值,建议使用迭代方法。

进阶玩法:不只是简单对话

部署成功后,你可能会觉得「不就是个聊天机器人吗?」。其实ChatGLM-6B的潜力远不止于此。

你可以把它集成到自己的应用中,通过API调用的方式,让ChatGLM-6B为你开发的应用提供智能对话能力。

还能进行微调训练,用你自己的数据集让模型学习特定领域的知识。比如你是做法律咨询的,可以用法律文书微调模型;做医疗的,可以用医学资料训练。

甚至可以实现多轮复杂任务,比如让ChatGLM-6B帮你分析数据、生成报告、编写代码等。

这些进阶功能我会在后续的文章中详细介绍。今天我们先搞定基础部署,迈出第一步。

几个实用小贴士

保存对话历史:每次对话结束后,记得保存对话记录。这样下次启动时可以直接加载,不用重新开始

合理设置参数:如果你的硬件配置一般,可以降低max_length参数,减少内存占用

定期更新:关注GitHub仓库的更新,及时获取新版本和新功能

加入社区:遇到问题去GitHub Issues或者相关论坛提问,社区氛围很友好

写在最后

说实话,第一次看到ChatGLM-6B在自己的电脑上运行起来,那种感觉真的很奇妙。就像是突然有了一个24小时在线的智能助手,随时准备帮你解决问题。

而且整个部署过程并没有想象中那么复杂。按照上面的步骤,基本上就是「复制→粘贴→等待下载→运行」这几个简单操作。

如果你已经跟着步骤操作成功了,欢迎在评论区分享你的体验。如果遇到了什么问题,也随时可以留言,我会尽力帮你解决。

记得关注我,不错过每一篇干货教程。我们下次见!

夜雨聆风

夜雨聆风