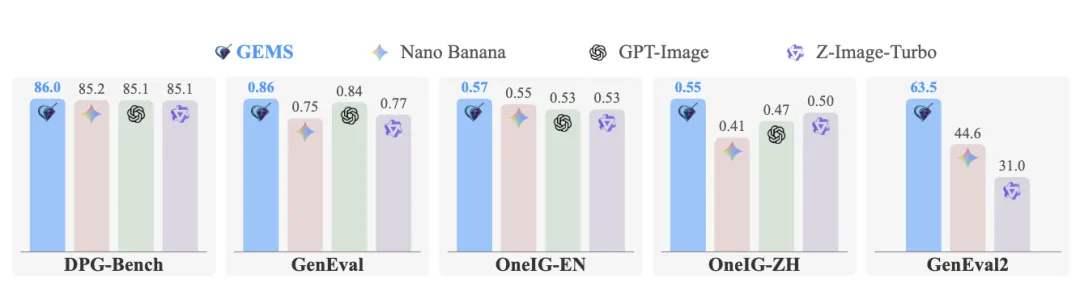

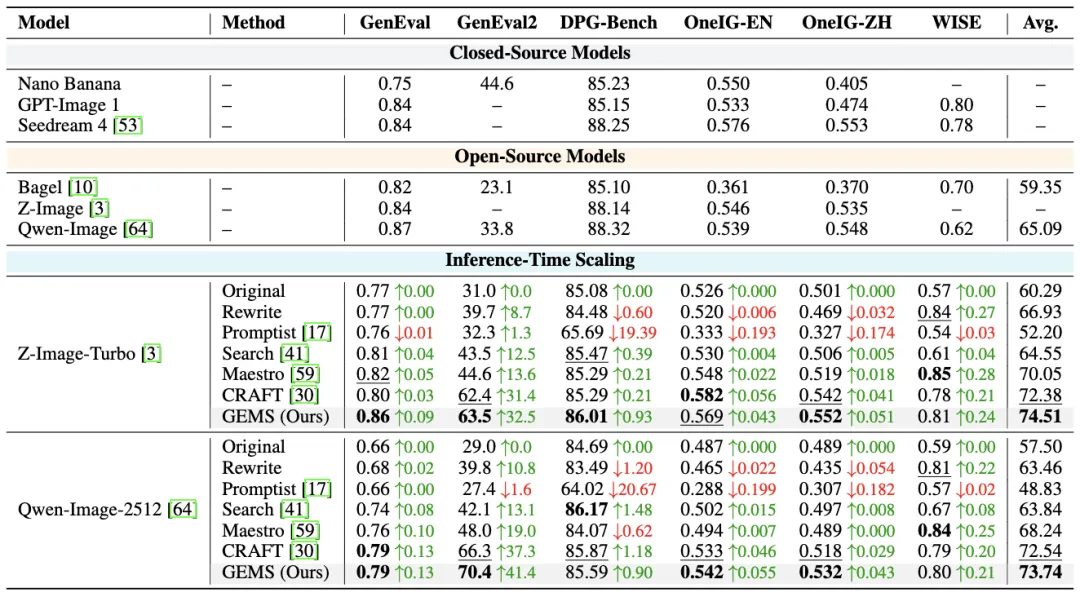

具体而言,在轻量化蒸馏模型Z-Image-Turbo上应用GEMS后,模型在主流基准任务上的平均性能提升达到14.22,在下游任务上平均提升14.03,让6B参数的Z-Image-Turbo在GenEval2上超越了当前最优模型Nano Banana 2。

在另一款主流开源模型Qwen-Image-2512上验证该框架,其在主流任务与下游任务上分别实现平均16.24和7.96的性能提升。

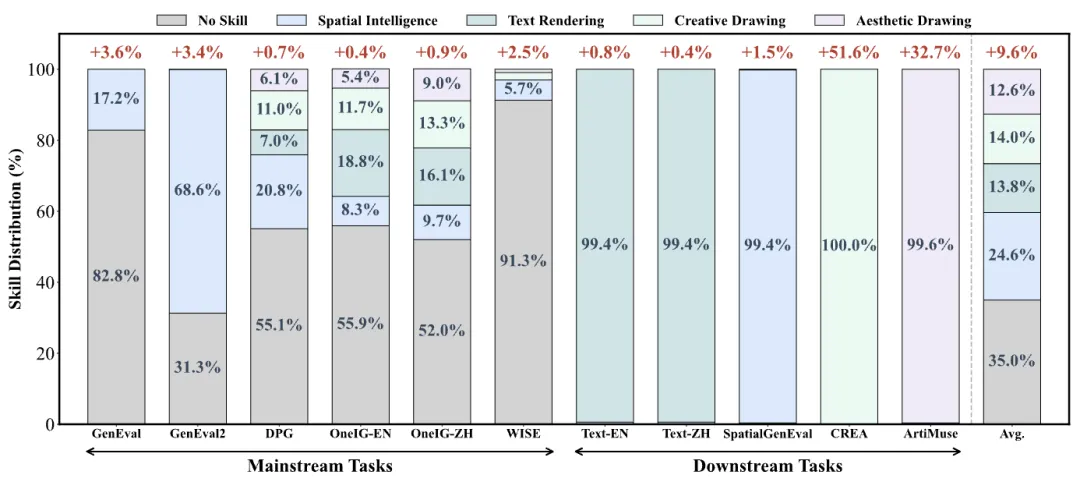

此外,GEMS引入专业技能为优化过程提供针对性引导,即便在高度专业化的领域中,也能实现稳定且显著的性能提升。

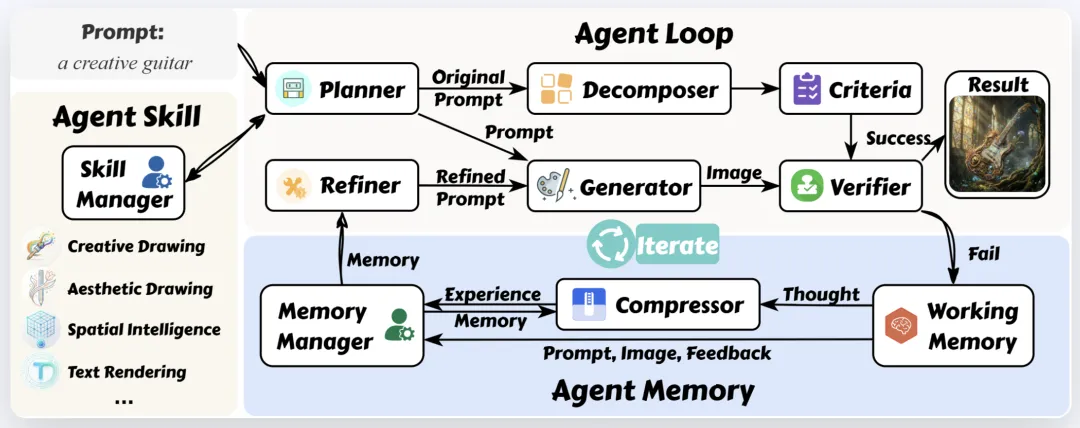

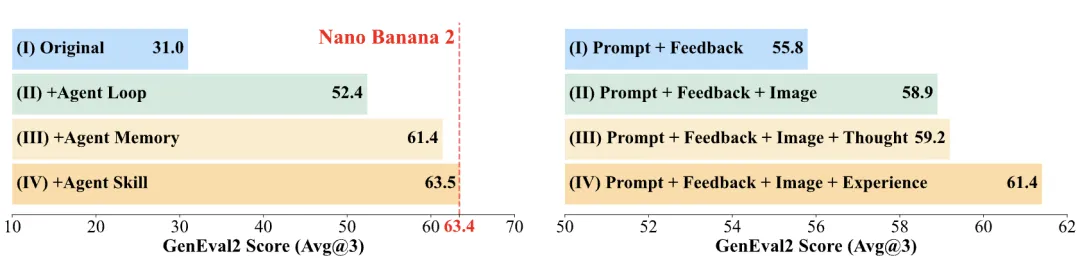

研究人员选取具有挑战性且尚未饱和的评测基准GenEval2对GEMS进行消融实验,随着智能体循环、智能体记忆、智能体技能的依次加入,模型性能获得显著提升。

具体而言,基础的智能体循环将分数从31.0提升至52.4;在此基础上加入智能体记忆与智能体技能后,分数分别进一步提升9.0分和2.1分,最终得分达到63.5。

这表明GEMS能够有效释放基础模型的潜力,通过智能体推理与领域专业知识,使其突破固有的能力上限。

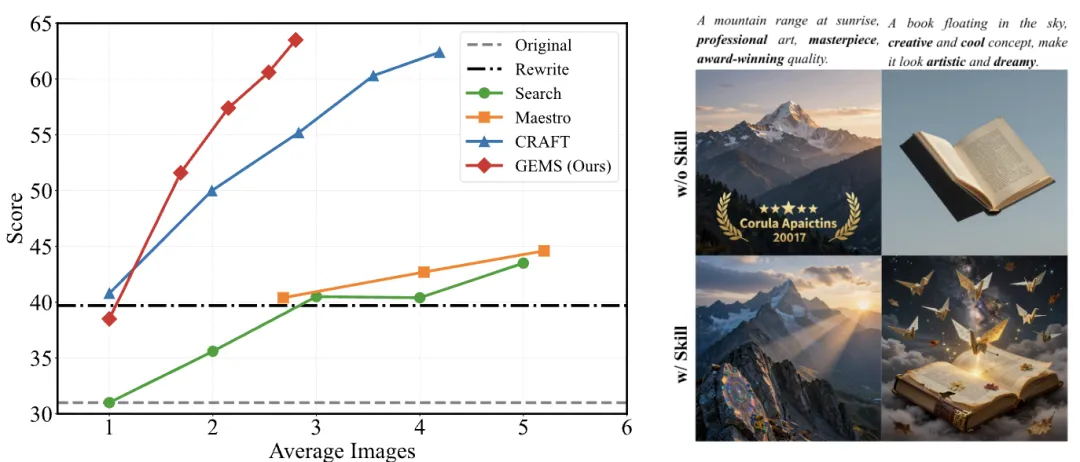

智能体循环本身就带来了显著的性能提升,GEMS不仅初始基线更高,而且成功率呈现持续上升趋势。

在GenEval2上,成功率从62.2%逐步提升至71.4%,并且随着迭代轮次增加,与基线方法的差距不断拉大,这一趋势表明,优化器(Refiner)并非只是生成随机变体,而是基于反馈主动进行有导向的优化。

在智能体记忆配置的影响方面,研究人员发现,更丰富的多模态上下文能为优化过程提供更可靠的指导。

但并非信息并非越多越好,把完整思考过程(用于生成对应提示词的思维链CoT)加入记忆时,性能提升微乎其微。

为解决这一问题,研究人员使用压缩器将这些原始思路提炼为精简的“经验”,这一策略带来了显著的2.5分提升,证实了简洁、关键的决策洞察,对于长上下文智能体推理而言,远比对未经处理的内部思考链更有效。

此外,GEMS在实现更优性能的同时,显著降低了计算开销,在平均每个任务仅生成约3张图像的情况下,GEMS能大幅超越其他推理阶段增强方法。

智能体记忆与智能体技能能够提升生成质量,从而使模型更早收敛终止,将平均迭代次数从3.26降至2.80。

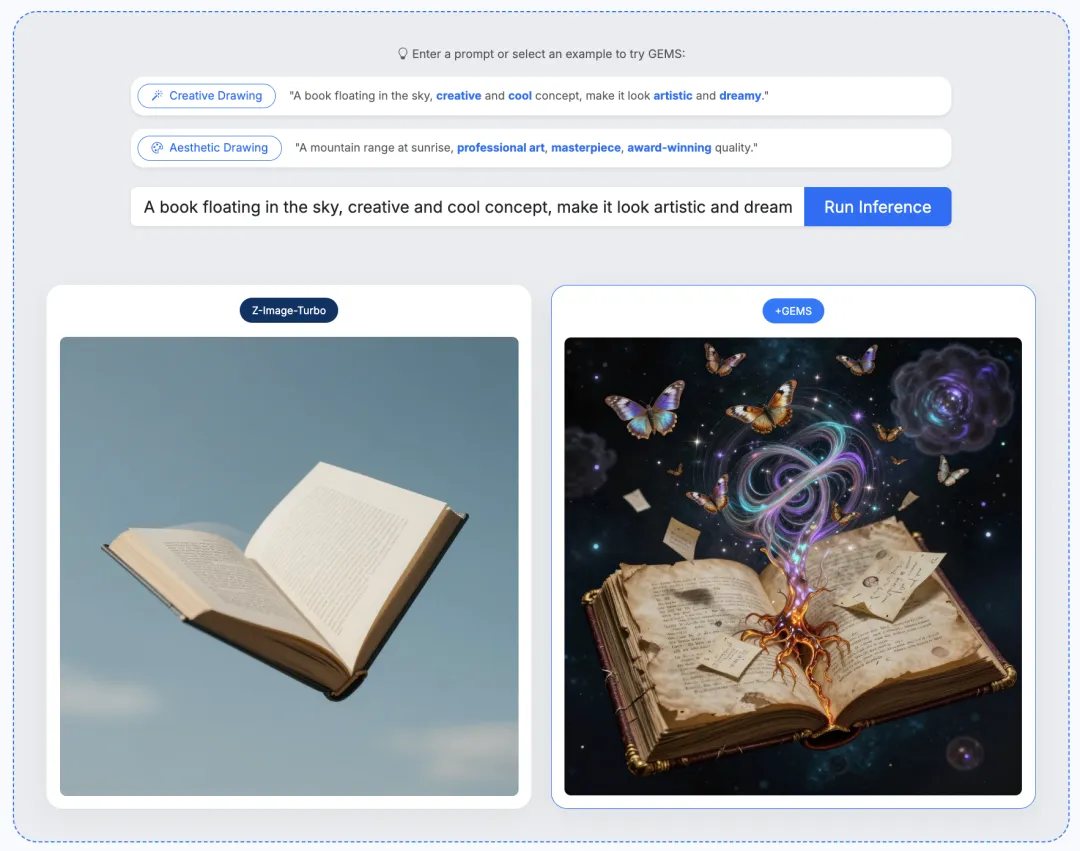

研究人员还发现,GEMS能够根据用户提示自主触发对应技能,显著提升整体视觉美感与构图质量,智能体技能通过在特定生成维度上提供针对性增强,有效提升了主流任务的性能。

总的来说,GEMS系统地将智能体机制引入文本到图像生成领域,通过迭代优化、轨迹记忆与领域技能三位一体的框架,重新定义了复杂提示下的生成优化范式。

这项研究不仅在多个主流与专业基准上实现了显著性能提升,更重要的是证明了轻量化基础模型在智能体架构加持下,可以超越更大、更强的闭源模型,为低成本、高效率的多模态生成提供了新路径。

目前,文生图大模型排榜榜前十技术竞争十分激烈。

GEMS清晰展示了“智能体推理”对突破基础模型固有上限的变革性潜力,有助于实现更加可控、可靠、专业化的文生图系统。

-END-

如果您有什么想说的,欢迎在评论区留言讨论!

投稿或寻求报道,欢迎私信“投稿”,添加编辑微信。

夜雨聆风

夜雨聆风