最近,一个叫 OpenClaw 的工具突然火了,而且火得有点离谱。它的热度甚至超过了以往任何一个 AI 模型或产品——微信指数直接破亿,而且还在疯狂上涨。

其实我属于最早玩 OpenClaw 的那批人,到现在已经折腾了一个多月。为什么这段时间一直没更新?就是想让子弹再飞一会儿。

因为这个工具的迭代速度实在太恐怖了:

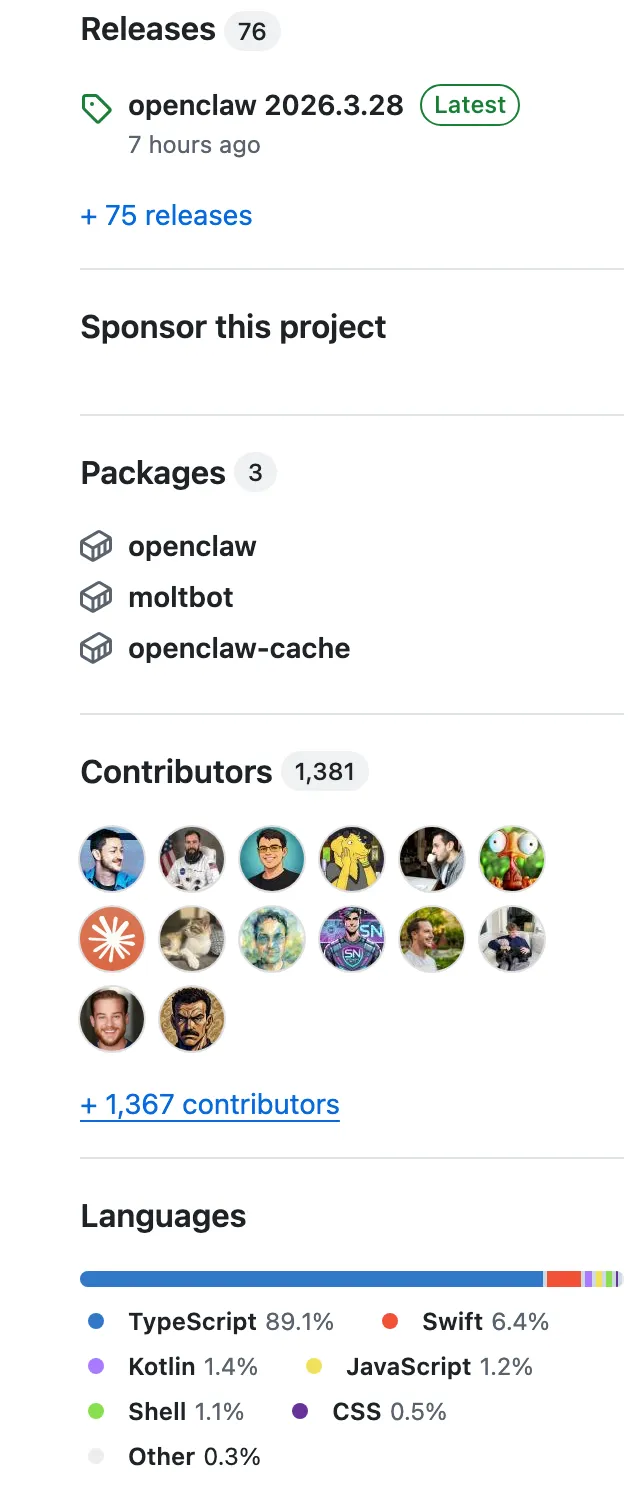

短短两个月,GitHub 上已经积累了 29.7万 Stars,Discord 社区超过 11.6万人,贡献者也有 1000多位……

几乎每天都在发新版本。如果你现在照着上个月的教程去配置,很可能会踩一堆坑。

还有一个绕不开的问题:安全性。早期的 OpenClaw 可以说漏洞百出,被曝出过好几个攻击成本极低的高危漏洞。

虽说到现在,因为它的设计本身就很灵活,安全隐患不可能完全消除,但在几十个版本的快速迭代中,大部分低成本攻击路径已经被堵上了。

所以我觉得,现在这个时间点,是时候认真聊聊 OpenClaw 了。

目前网上关于它的文章虽然不少,但高质量、系统性的教程依然稀缺。今天这份 OpenClaw 完全指南,希望能帮你搞懂下面这些内容:

OpenClaw 到底是什么?

它为什么这么火?

它的架构有什么特别之处?

怎么把它跑起来?

怎么配置 AI 模型?

怎么接入飞书?

怎么安装“技能”?

它的人格设定和记忆系统是怎么工作的?

怎么搭建多智能体团队?

OpenClaw 家族还有哪些选择?

有哪些好玩的玩法案例?

怎么让它安全地给你打工?

一、如何理解 OpenClaw?

先别急着看怎么装。得先搞明白 OpenClaw 到底是干啥的。

现在市面上聊 OpenClaw 的文章不少,但一上来就让你 clone 仓库、配环境,很多人配到一半就卡住了。卡住的原因不是操作难,是压根不知道自己在配什么。

所以这一节,我先拆几个概念:推理服务、Memory、RAG、MCP、Skills、Agent。这几个东西搞明白了,OpenClaw 你就懂了一半。

OpenClaw 本质上是啥?

用大白话说:它是一个跑在你自己机器上的 AI 管家。

你可以把它装在笔记本上、VPS 上、甚至家里那台常年开着的 NAS 上。装好之后,把它和你日常用的聊天软件连起来——飞书、Telegram、WhatsApp,它都支持,目前已经接了 22 个平台。

连上之后,它就不只是个聊天机器人了。它能真的干活:

读写你电脑上的文件

帮你处理邮件

跑代码

控制浏览器

自动执行一串任务

一句话总结:OpenClaw 是一个永远在线的 Agent 网关,坐在你的聊天软件和电脑工具中间,听你使唤。

先搞清楚一个基础概念:推理服务

大模型这东西,不管是 GPT 还是 DeepSeek,本质上就是一个巨大的参数文件。几十 GB 甚至上百 GB,躺在硬盘上。

但光有文件没用,你得把它加载到显卡显存里,跑起来,对外提供一个 HTTP 接口或者 WebSocket 接口。这个接口接收你的问题,背后做一大堆矩阵运算,一个字一个字地往外蹦回复。

这套跑起来的服务,就叫推理服务。

你可以这么理解:推理服务是发动机,OpenClaw 是驾驶员。没有发动机,驾驶员干瞪眼;没有驾驶员,发动机再猛也不知道往哪开。

二、OpenClaw 为什么这么火?

我说几个数字你就明白了。

GitHub 上,短短两个月,29.7 万 Stars。这是什么概念?很多明星项目干两三年都到不了这个数。

Discord 社区,11.6 万人。贡献者,1000 多人。

最关键的是,几乎天天发新版本。你今天照着上个月的教程配,明天就可能跑不通。不是教程写错了,是这东西变得太快了。

那它到底火在哪?

我觉得核心就一点:它把 Agent 从概念变成了一个你每天真能用上的东西。

之前大家聊 Agent,要么是论文里的架构图,要么是 OpenAI 发布会上的一段演示。你看完觉得很牛,但关了视频就不知道该干啥了。

OpenClaw 不一样。你装好了,配个模型,连上飞书,然后你就可以在飞书里直接跟它说:“帮我把桌面上那个日志文件分析一下”,它就真去做了。

这种“从聊到干”的跨越,是它火的根本原因。

三、OpenClaw 的架构有啥独特之处?

说实话,OpenClaw 的架构不算什么惊天大发明。它做的其实是一个整合的工作。

它把下面这些东西揉在了一起:

模型推理(谁来当脑子)

记忆系统(记住你说过的话)

RAG(检索增强,能翻你给的资料)

工具调用(读写文件、跑代码、控制浏览器)

多平台接入(飞书、Telegram 等)

每一块单独拿出来,都有现成的方案。但能把它们捏成一个普通人能装、能跑、能用的东西,OpenClaw 是头一个。

它的设计思路挺直接的:Agent 不应该是一个你单独打开的控制台,而应该是你聊天窗口里的一个联系人。

你想想,你平时一天在飞书、微信上花多少时间?如果 AI 就在那个界面里,随叫随到,你是不是更愿意用?

这就是 OpenClaw 的底层逻辑:把 Agent 塞进你已有的工作流里。

四、OpenClaw 怎么跑起来?

我直接说实操。

最低配置要求:

一台能联网的机器(笔记本、台式机、VPS 都行)

至少 4GB 内存

有 Docker 最好,没有也能装,但会麻烦一点

安装步骤(简化版):

拉代码

bash

git clone https://github.com/openclaw/openclaw.gitcd openclaw装依赖推荐用 Docker Compose,省心:

bash

docker-compose up -d如果你不用 Docker,项目文档里有裸机安装的教程,但我劝你别折腾,直接用 Docker。

初始化配置跑起来之后,访问

http://localhost:3000,网页上会引导你做一些基础设置,比如管理员账号、密码这些。配模型(下面单独讲)这一步是重点,很多人卡在这里。

几个踩坑提醒:

如果你是第一次装,千万别用 latest 分支的代码。去 GitHub 上找一个稳定的 release 版本,比如 v0.8.x 之类的。用 main 分支的话,可能今天装好明天就挂了。

端口冲突问题。OpenClaw 默认用 3000 端口,如果你机器上已经有别的服务占了 3000,记得在

docker-compose.yml里改一下映射端口。国内网络环境拉 Docker 镜像可能会慢。换国内源,或者用代理。

五、OpenClaw 怎么配置模型?

这步是重点,我拆开说。

模型配置的本质是什么?

OpenClaw 本身不带模型。你得给它一个能调用的推理服务地址。

这个推理服务你可以自己搭(比如用 Ollama、vLLM 跑本地模型),也可以直接调云厂商的 API(OpenAI、DeepSeek、通义千问等)。

方案一:用云 API(最简单)

如果你有 OpenAI 的 API Key,直接在 OpenClaw 后台的“模型配置”里填:

text

provider: openaimodel: gpt-4api_key: sk-xxxxx同理,DeepSeek、通义千问、智谱这些,配置方式类似,改一下 provider 和 endpoint 就行。

方案二:自己搭本地推理服务

如果你有显卡(哪怕是一张 3060),可以本地跑一个模型,完全免费,而且数据不出门。

用 Ollama 是最省事的:

装 Ollama:

curl -fsSL https://ollama.com/install.sh | sh拉一个模型:

ollama pull qwen2.5:7b跑起来:

ollama serve在 OpenClaw 里配置:

text

provider: ollamamodel: qwen2.5:7bendpoint: http://localhost:11434

方案三:混合模式

你可以同时配多个模型。比如平时用便宜的 API(DeepSeek),遇到复杂任务再切到 GPT-4。OpenClaw 支持按任务类型指定模型。

常见问题:

模型回话特别慢?检查一下你的推理服务是不是跑在 CPU 上。用 CPU 跑大模型,慢是正常的。

模型不听话?试试换一个 prompt 模板。OpenClaw 的配置文件里有

system_prompt这一项,你可以自己改。

六、OpenClaw 怎么接入飞书?

这个是我自己最常用的方式,讲细一点。

步骤:

在飞书开放平台创建一个企业自建应用

去 https://open.feishu.cn/app

创建应用,名字随便写,比如“我的AI助手”

开启机器人能力

在应用的“机器人”菜单里,开启机器人

拿到

App ID和App Secret配置事件订阅

在“事件订阅”里,把

encrypt_key和verification_token记下来回调地址填:

https://你的域名:端口/api/feishu/webhook(如果是本地测试,可以用内网穿透)给机器人开权限

至少需要:

im:message(接收和发送消息)、contact:user(读取用户信息)发布应用

在飞书管理后台“版本管理”里发布应用,然后去飞书里搜索你的机器人名字,发一条消息测试一下。

OpenClaw 这边的配置:

在 OpenClaw 的 config.yaml 里加上:

yaml

platforms:feishu:enabled: trueapp_id: "你的 App ID"app_secret: "你的 App Secret"encrypt_key: "加密密钥"verification_token: "校验 token"

重启 OpenClaw,就能在飞书里跟你的 Agent 聊天了。

一个小技巧: 你可以在飞书群里拉机器人进去,然后在群里 @ 它提问。这样整个团队都能用。

七、OpenClaw 怎么安装技能?

技能(Skills)是 OpenClaw 最好玩的地方,也是它和普通聊天机器人最大的区别。

技能是啥?

你可以把技能理解成一个给 Agent 装的新功能插件。

默认情况下,OpenClaw 会一些基础操作:读写文件、跑个简单的代码、查个天气。但你想让它干更专业的事,比如“爬取某个网页的数据并生成报表”,就需要装对应的技能。

怎么装?

OpenClaw 有一个技能市场,在 GitHub 上:https://github.com/openclaw/skills

装技能的方式很简单:

进到 OpenClaw 的配置目录(一般是

~/.openclaw/skills/)git clone对应的技能仓库重启 OpenClaw

举个例子,装一个“浏览器控制”技能:

bash

cd ~/.openclaw/skillsgit clone https://github.com/openclaw/skills-browser-control.gitdocker-compose restart openclaw

技能能干什么?

我列几个社区里比较火的:

邮件处理:自动分类、回复、转发邮件

日历管理:帮你约会议、查日程

浏览器控制:打开网页、填表单、截图

代码执行:跑 Python/JS 脚本,甚至帮你调试

数据库查询:连上 MySQL/PostgreSQL,查数据返给你

飞书文档读写:直接操作飞书文档,批量更新内容

能不能自己写技能?

能。Skill 本质上就是一个定义了输入输出和调用方式的小程序。官方有 SDK,Python 和 Node.js 都支持。

你写一个脚本,配一个 manifest.json 告诉 OpenClaw 这个技能怎么调用,扔进 skills 目录就能用。

八、人格架构和记忆系统

这两个放在一起说,因为它们是绑定的。

人格架构是啥?

你可以给 OpenClaw 设定一个“人设”。

在配置文件的 persona 里写一段话,比如:

text

你是一个热情、耐心的技术助手,喜欢用比喻解释复杂问题。你不太会说“根据我的知识库”这种废话,直接回答问题就行。然后 OpenClaw 就会按照这个人设来回复你。不是简单的加个前缀,而是整个对话风格都会被影响。

记忆系统怎么工作的?

OpenClaw 的记忆分三层:

会话记忆:当前对话窗口里聊的内容,关了窗口就没了。

短期记忆:跨对话的记忆,但会随时间衰减。比如你昨天告诉它你讨厌喝美式咖啡,今天它可能还记得,后天就忘了。

长期记忆:永久存储。你显式告诉它“记住这件事”,或者它判断这是重要信息,就会写入长期记忆库。

长期记忆的存储方式可以选:默认是 SQLite,也可以换成 PostgreSQL 或者向量数据库(用于 RAG)。

一个实用的用法:

你可以这么跟它说:“记住,我常用的代码仓库在 /home/james/projects/”。

下次你让它“帮我拉一下那个仓库的最新代码”,它就会自己去那个路径执行 git pull。

九、多智能体团队怎么搭建?

这个功能算是 OpenClaw 的高阶玩法了。

什么是多智能体?

就是一个 OpenClaw 实例里,你可以跑多个不同角色的 Agent,它们之间可以互相聊天、派活、协同完成一个复杂任务。

怎么配?

在配置文件里定义多个 agent:

yaml

agents:- name: plannerrole: 任务拆解师model: gpt-4- name: coderrole: 写代码的人model: deepseek-coder- name: reviewerrole: 代码审查员model: claude-3

然后你可以这么用:

你跟 planner 说:“帮我写一个爬取微博热搜的脚本。”

planner 会把任务拆成三步:写爬虫代码 → 测试运行 → 输出结果。然后它派活给 coder,coder 写完代码后 reviewer 会检查一遍,最后把结果返给你。

整个过程你在飞书里就发了一条消息,后面全是 Agent 们在背后自己协调。

实际效果怎么样?

说实话,简单任务很好用,复杂任务容易翻车。目前多智能体协同还不算特别稳定,有时候 Agent 们会陷入死循环:A 让 B 干活,B 让 C 确认,C 又让 A 补充信息……然后你就看着它们在日志里来回扯皮。

但方向是对的。等这个功能再打磨几个版本,应该会是 OpenClaw 最大的亮点之一。

十、OpenClaw 家族还有哪些选择?

OpenClaw 官方其实不止这一个项目,它已经长出了一个“家族”。

核心项目:

openclaw/core:主项目,就是你正在看的这个。

openclaw/skills:技能仓库,社区贡献的插件。

openclaw/ui:Web 管理界面,帮你可视化管理 Agent 和任务。

社区衍生项目:

OpenClaw Lite:轻量版,砍掉了多平台接入,只保留核心 Agent 能力,适合跑在树莓派这种低配设备上。

OpenClaw Desktop:桌面应用版本,有 GUI 界面,不用折腾 Docker 和命令行。

OpenClaw Cloud:官方提供的云托管版本,不想自己运维可以直接用,付费的。

要不要全装?

不用。大多数人装 core + 装一两个技能就够了。只有当你需要可视化管理和多 Agent 协同的时候,才需要装 ui。

十一、有哪些有意思的玩法案例?

我收集了几个社区里比较有意思的用法,给你参考。

案例 1:自动追剧通知有个哥们让 OpenClaw 每天定时爬取某个美剧的更新状态,一旦发现新资源,就自动发消息到他的 Telegram,顺便把磁力链接附上。

案例 2:GitHub 仓库周报每周一早上,OpenClaw 自动扫描你关注的 GitHub 仓库,把这一周的 star 增长、新 issue、新 PR 汇总成一份报告,发到飞书群里。

案例 3:智能闹钟不是简单的到点叫你。OpenClaw 会先看你的日历,如果早上 9 点有会,它 8 点就叫你;如果没有会,它会看你睡眠数据(从手环同步),睡够了 7 小时就 8:30 叫,没睡够就 8:45 叫。挺人性化的。

案例 4:自动回复客服用邮件有个做独立开发的朋友,把 OpenClaw 接入了他的客服邮箱。用户发邮件来,OpenClaw 先去文档里搜有没有现成答案,有就回复;没有就转人工。一个月处理了 200 多封邮件,他自己只回了不到 20 封。

案例 5:代码 review 助手把 OpenClaw 接入 GitHub webhook,每次有人提 PR,自动触发 review Agent,跑一遍 lint、检查有没有敏感信息泄露、评估代码复杂度,然后把结果评论到 PR 下面。

十二、怎么让它安全地给你打工?

最后说一个很多人忽略但非常重要的问题:安全。

OpenClaw 有哪些安全隐患?

权限过大:默认情况下,OpenClaw 能读写你机器上的几乎所有文件。如果被恶意利用,后果很严重。

工具误用:比如你给了它“删除文件”的权限,它可能会在执行某个任务时误删重要文件。

模型被投毒:如果你用的是云 API,模型本身是安全的。但如果你用的是本地模型,有人可能通过构造特殊的输入,诱导模型执行危险命令。

接入平台的 Webhook 暴露:你的飞书回调地址如果暴露了,别人可以伪造请求让你的 Agent 干活。

我自己的安全配置建议:

1. 做权限隔离在 Docker 里跑 OpenClaw,用 volume 挂载只给它必要的目录。比如:

yaml

volumes:- ./data:/app/data- /home/james/projects:/projects:ro

:ro 表示只读,Agent 能读但不能写。

2. 限制敏感操作在配置里禁用危险的工具:

yaml

tools:disabled:- delete_file- execute_system_command

等你真的需要的时候再手动开。

3. 加一个审批流程对高风险操作(删除文件、发邮件、支付等),配置成“需要确认再执行”。OpenClaw 支持这种模式,遇到敏感操作会先发一条消息问你“确定要这样做吗?”,你回复“确认”它才执行。

4. 内网穿透用 HTTPS如果你要公网访问,别用裸 HTTP。用 frp、ngrok 或者 Cloudflare Tunnel,都支持 HTTPS。飞书的回调地址也要求 HTTPS。

5. 定期更新OpenClaw 迭代快,安全修复也快。每周 pull 一次最新代码重启一下,不费什么事。

6. 别给管理员权限不要用 root 用户跑 OpenClaw。单独建一个普通用户,权限够用就行。

最后说一句:

OpenClaw 这东西,现在确实还不够完美。有时候会抽风,有时候配置半天跑不起来,多智能体协同偶尔还会自己跟自己吵架。

但它是目前我见过的、把 Agent 从“概念”变成“每天能用的工具”这件事上,走得最远的一个项目。

你不需要等它完美。现在就可以装一个,配个免费模型,连上飞书,从让它帮你查天气、记待办开始。

用着用着,你会发现它能干的事情越来越多。

这份指南里的内容,如果你照着做遇到问题,欢迎来我的公众号《cncdns笔记》底下留言。我看到了会回复。

夜雨聆风

夜雨聆风