第6课:听听AI的声音——TTS语音回复配置全攻略

进度:6/12,你的AI即将「开口说话」

你有没有想过,在飞书/微信里收到AI发来的语音消息是什么体验?

想象一下:你在开车,不方便看文字,AI直接把回复读给你听;或者在睡前,让AI用温柔的声音讲个故事;又或者给家里的老人用,他们更喜欢听而不是看文字。

前几节课,我们给 OpenClaw 装上了大脑、连上了频道、学会了搜索、睁开了眼睛、甚至学会了画画。今天这节课,我们要给它一副嗓子——让它能开口说话。

好消息是:TTS(文本转语音)是 OpenClaw 内置的功能,不需要安装额外的 skill,配置也非常简单。而且,它提供了一个完全免费的方案(Edge TTS),开箱即用。

这节课完成后,你的 AI 将能:

🎙️ 用文字生成语音——把回复读给你听 🎵 支持多种音色——温柔女声、沉稳男声、甚至方言 ⚡ 免费使用——Edge TTS 完全免费,无额度限制 🎯 智能触发——按需开启,不会每条消息都发语音

准备工作

这节课你需要:

✅ 已经配置好的 OpenClaw(前5课的内容) ✅ 大约 5 分钟时间 ✅ 一个能播放音频的设备(手机/电脑)

不需要:

❌ 申请 API Key(用 Edge 方案的话) ❌ 额外安装 skill ❌ 复杂的配置调整

先搞明白:TTS 是怎么工作的?

简单来说,OpenClaw 本身不会「说话」,它是调用 TTS 引擎把文字转换成语音。

OpenClaw 内置支持两种 TTS 方案:

| 方案 | 引擎 | 特点 | 费用 |

|---|---|---|---|

| Edge TTS(推荐) | 微软 Edge 浏览器引擎 | 免费、中文效果好、多种音色 | 完全免费 |

| OpenAI TTS | GPT-4o-mini-tts | 音质更自然、支持「语音风格」控制 | 按用量计费 |

本节课重点讲 Edge TTS 方案,因为它完全免费,配置简单,对中文支持也非常好。

第一步:基础配置

打开你的 openclaw.json 配置文件,添加 messages.tts 部分:

{

"messages": {

"tts": {

"auto": "tagged",

"provider": "edge",

"edge": {

"enabled": true,

"voice": "zh-CN-XiaoxiaoNeural",

"lang": "zh-CN"

}

}

}

}

参数详解:

| 参数 | 说明 | 可选值 |

|---|---|---|

auto |

语音回复的触发模式 | off / on / tagged / inbound |

provider |

使用哪个 TTS 引擎 | edge / openai |

edge.enabled |

是否启用 Edge TTS | true / false |

edge.voice |

音色选择 | 见下方音色列表 |

edge.lang |

语言代码 | zh-CN / en-US 等 |

1.1 「auto」触发模式详解

这是最容易搞混的参数,我逐个解释:

off—— 完全关闭语音回复,AI 只会发文字on—— 所有回复都带语音(不建议,会很吵)tagged—— 推荐模式:只有消息包含特定标签时才发语音(当你对话时明确要助手用语音回复时生效,不过目前有BUG,不太稳定)inbound—— 仅当用户发送语音消息进来时,AI 才用语音回复

建议新手直接用 on 模式,这样你可以明确看到 AI 说话。

1.2 Edge 音色推荐

微软 Edge TTS 提供了非常多的中文音色,推荐几个常用的:

| 音色代码 | 特点 | 适合场景 |

|---|---|---|

zh-CN-XiaoxiaoNeural |

温柔女声,亲切自然 | 通用场景,推荐默认 |

zh-CN-YunxiNeural |

沉稳男声,成熟可靠 | 专业咨询、商务场景 |

zh-CN-XiaoyiNeural |

活泼女声,年轻活力 | 闲聊、娱乐场景 |

zh-CN-YunjianNeural |

成熟男声,磁性低沉 | 讲故事、播客风格 |

zh-CN-liaoning-XiaobeiNeural |

东北话女声 | 搞笑、接地气场景 |

zh-CN-shaanxi-XiaoniNeural |

陕西话女声 | 地方特色 |

完整音色列表可以在 https://learn.microsoft.com/en-us/azure/ai-services/speech-service/language-support?tabs=tts[1] 查看。

第二步:重启 OpenClaw

保存配置文件后,重启 OpenClaw 使配置生效:

openclaw gateway restart

⚠️ 注意:OpenClaw 的 TTS 配置有个小 bug —— 全局配置里的 auto 设置,目前对 tagged 和 inbound 模式支持不完善。所以重启后,还需要在对话里手动开启 TTS。

第三步:在对话中开启 TTS

进入任意 Channel(飞书/微信/Terminal 都可以),发送:

/tts on

你会看到类似这样的回复:

🔊 TTS enabled.

常用 TTS 命令:

| 命令 | 作用 |

|---|---|

/tts on |

开启语音回复(当前 session) |

/tts off |

关闭语音回复 |

/tts status |

查看当前 TTS 状态 |

Session 级别的说明:

/tts on 只对当前对话 session 生效。如果你开启了新的对话(比如 /new 或重启后),需要重新发送 /tts on。

第四步:测试语音回复

现在来测试一下效果!

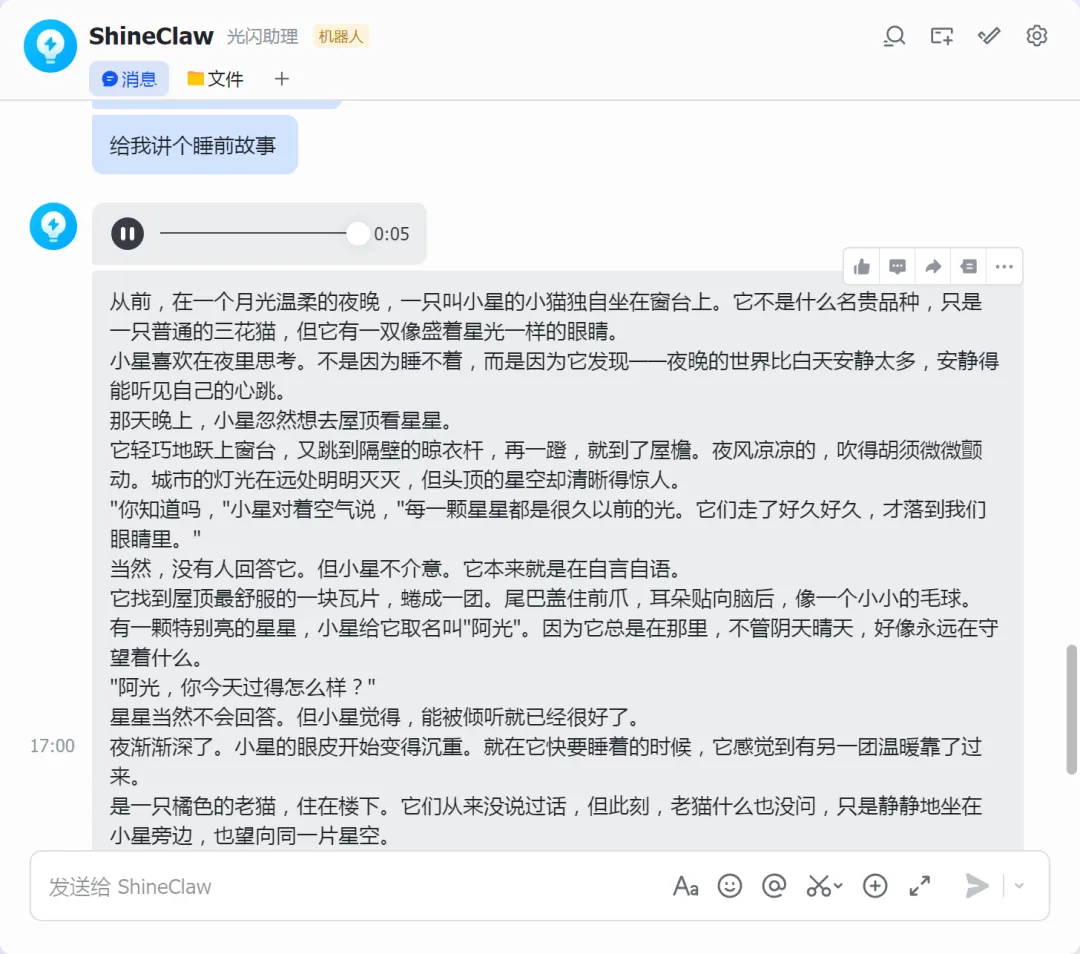

开启语音后直接发送

使用用 /tts on 开启语音,直接发消息就行:

你发送: 「给我讲个睡前故事」

AI 回复: [文字内容] + [语音文件]

进阶配置:OpenAI TTS(可选)

如果你对音质有更高要求,或者想要「语音风格」控制(比如让声音听起来更「兴奋」或更「平静」),可以使用 OpenAI 的 TTS。

配置方法

在 openclaw.json 中添加:

{

"messages": {

"tts": {

"auto": "tagged",

"provider": "openai",

"openai": {

"apiKey": "sk-你的OpenAI API Key",

"baseUrl": "https://api.openai.com/v1"

}

}

}

}

注意:OpenAI TTS 是按字符计费的(约 $0.015/1000字符),适合偶尔使用。如果大量使用,建议还是用免费的 Edge TTS。

完整配置参考

方便你复制粘贴的完整配置:

{

"messages": {

"tts": {

"auto": "tagged",

"provider": "edge",

"edge": {

"enabled": true,

"voice": "zh-CN-XiaoxiaoNeural",

"lang": "zh-CN"

},

"openai": {

"apiKey": "",

"baseUrl": "/v1"

}

}

}

}

常见问题 FAQ

Q1: 为什么配置了但没有语音回复?

排查步骤:

确认已重启 OpenClaw 确认已发送 /tts on开启 session 级别的 TTS检查配置文件 JSON 格式是否正确(可以用 JSONLint[2] 验证)

Q2: 语音是生成了,但我听不到?

可能原因:

飞书/微信客户端没有自动播放语音的权限 手机静音或音量太低 音频格式不支持(Edge TTS 生成的是 MP3,绝大部分设备都支持)

解决:点击语音消息手动播放,或检查设备音量。

Q3: 能换个声音吗?

可以! 修改配置文件里的 voice 参数,参考上面的「音色推荐」表格。修改后重启 OpenClaw 生效。

Q4: 语音能保存下来吗?

OpenClaw 生成的语音文件会作为附件发送,在飞书/微信里可以长按保存。

Q5: 能不能让 AI 自动朗读某些类型的内容?

可以! 把 auto 改成 inbound 模式,这样当用户发语音给 AI 时,AI 会自动用语音回复。

Q6: 语音支持多长?

Edge TTS 没有严格限制,但建议控制在 5 分钟以内(约 1000 字)。太长的文本可以分段发送。

进阶技巧

技巧1:用 TTS 做「语音备忘录」

让 AI 帮你把长文章转成语音,方便通勤时听:

你发送: 「把下面这篇文章转成语音」+ [粘贴文章内容]

技巧2:多语言切换

Edge TTS 支持多种语言,出国旅游时可以临时切换:

"edge": {

"voice": "en-US-AriaNeural",

"lang": "en-US"

}

技巧3:结合其他功能使用

TTS 可以和前面学的功能组合使用:

搜索 + TTS:「查一下今天的科技新闻,读给我听」 生图 + TTS:「画一只猫,然后描述一下你画的内容」 图片理解 + TTS:「看看这张图里有什么,用语音告诉我」

总结:你现在拥有了什么?

🎉 恭喜你,你的 OpenClaw 会「说话」了!

回顾这 6 节课的成果:

| 课程 | 能力 | 状态 |

|---|---|---|

| 第1课 | 大脑(模型配置) | ✅ 能思考、能推理 |

| 第2课 | 嘴巴(飞书接入) | ✅ 能接收和发送消息 |

| 第3课 | 耳朵(实时搜索) | ✅ 能获取最新信息 |

| 第4课 | 眼睛(图片理解) | ✅ 能看懂图片 |

| 第5课 | 双手(文生图) | ✅ 能生成图片 |

| 第6课 | 嗓子(语音回复) | ✅ 能开口说话 |

你的 AI 已经从「文字助手」升级为「全模态智能助手」 —— 能看、能画、能说。

但这还不是终点。下节课,我们要让 AI 不仅能「说」,还能「听」——给它装上语音识别的能力,让它能听懂你发的语音消息!

课后作业

试试用语音和 AI 互动:

「讲一个 2 分钟的睡前故事」 「总结一下今天的新闻,读给我听」

遇到问题随时在群里提问。

下节预告: 第7课《不只是打字聊天——语音消息识别配置》,教你的 AI 从「只能看文字」升级到「能听懂语音」,实现真正的语音对话!

进度:6/12 已完成 ✅

引用链接

[1]https://learn.microsoft.com/en-us/azure/ai-services/speech-service/language-support?tabs=tts

[2]JSONLint: https://jsonlint.com/

夜雨聆风

夜雨聆风