前段时间在我的 MacBook 上安装 openclaw+ollama,并部署了 Qwen2.5 7b的模型,电脑卡的不行,然后又费劲巴拉的卸载掉了。最近看到网上说可以用llama.cpp 部署 Qwen3.5 比较适合低配置的电脑,于是开始部署。

我的电脑配置如下:

由于内存较小,我找 AI 再次确认了这个安装方案:

M2 MacBook Air (8GB内存) 上部署 llama.cpp + Qwen3.5-4B 模型

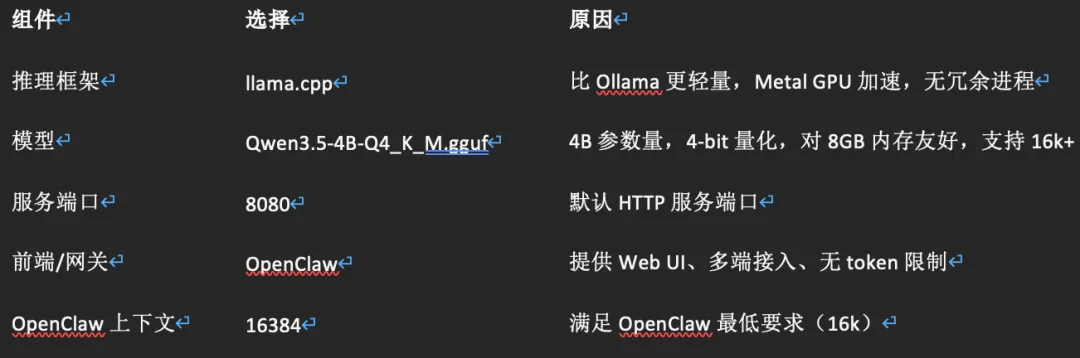

📦 最终方案概览

🧰 前期准备

1. 安装 Homebrew(如未安装)

/bin/bash -c "$(curl -fsSL https://raw.githubusercontent.com/Homebrew/install/HEAD/install.sh)"

2. 安装 Node.js(OpenClaw 需要 v22+)

brew install node

node -v # 应显示 v22.x 或更高

3. 安装 Python 环境(用于下载模型)

pip3 install modelscope

🚀 第一步:部署 llama.cpp 和模型

1. 安装 llama.cpp

brew install llama.cpp

✅ Homebrew 安装会自动开启 Metal GPU 加速,无需额外配置。

2. 下载 Qwen3.5-4B GGUF 模型(国内魔塔源)

modelscope download --model unsloth/Qwen3.5-4B-GGUF Qwen3.5-4B-Q4_K_M.gguf --local_dir .

下载完成后,将模型移动到统一目录(可选):

mkdir -p ~/Documents/llama-models

mv Qwen3.5-4B-Q4_K_M.gguf ~/Documents/llama-models/

3. 启动 llama-server(关键参数)

打开一个专用终端窗口,执行:

cd ~/Documents/llama-models

llama-server -m Qwen3.5-4B-Q4_K_M.gguf --host 127.0.0.1 --port 8080 -ngl 99 --ctx-size 16384

参数解释:

-m:模型文件路径 --host 127.0.0.1:仅本机访问(如需局域网改为 0.0.0.0) --port 8080:服务端口 -ngl 99:将模型全部加载到 GPU(M2 Metal) --ctx-size 16384:上下文窗口大小(必须 ≥16000 以满足 OpenClaw 要求)

⚠️ 此窗口不能关闭,服务必须保持运行。

验证服务是否成功:

curl http://127.0.0.1:8080/health # 返回 {"status":"ok"}

curl http://127.0.0.1:8080/v1/models # 返回模型信息

🔌 第二步:安装 OpenClaw

1. 使用一键脚本安装(推荐)

curl -fsSL https://openclaw.ai/install.sh | bash

或国内镜像:

curl -fsSL https://open-claw.org.cn/install-cn.sh | bash

2. 解决 openclaw: command not found

安装后如果执行 openclaw 提示找不到命令,是因为 npm 全局目录未加入 PATH。解决方法:

# 查找 openclaw 实际安装位置

find ~ -name "openclaw" -type f 2>/dev/null

# 假设输出为 /Users/你的用户名/.local/bin/openclaw

# 将 ~/.local/bin 添加到 PATH

echo 'export PATH="$HOME/.local/bin:$PATH"' >> ~/.zshrc

source ~/.zshrc

之后 openclaw --version 应正常显示版本号。

3. 安装并启动网关服务

openclaw gateway install # 注册后台服务

openclaw gateway start # 启动网关

如果遇到 Gateway service not loaded,则按提示执行 openclaw gateway install 即可。

⚙️ 第三步:配置 OpenClaw 连接 llama.cpp

方法一:使用向导(简单)

openclaw onboard

按照提示选择/填写:

安全提示:选择 Yes Model/auth provider:Custom Provider API Base URL:http://127.0.0.1:8080/v1 API Key:任意(如 none) Endpoint compatibility:OpenAI-compatible Model ID:Qwen3.5-4B Endpoint ID:任意(如 my-qwen)

向导验证通过后即完成基础配置。

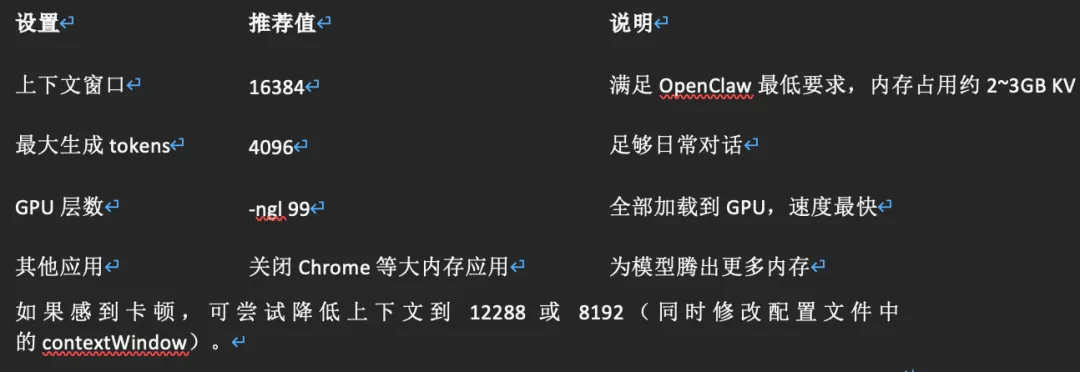

💡 性能与内存建议(针对 8GB M2)

📚 参考命令速查

启动 llama-server | —llama-server -m ~/Documents/llama-models/Qwen3.5-4B-Q4_K_M.gguf --host 127.0.0.1 --port 8080 -ngl 99 --ctx-size 16384 |

启动 OpenClaw 网关 | openclaw gateway start |

停止 OpenClaw 网关 | openclaw gateway stop |

重启 OpenClaw 网关 | openclaw gateway restart |

打开 Web UI | openclaw dashboard |

查看模型列表 | openclaw models list |

查看配置项 | openclaw config get <path> |

运行诊断 | openclaw doctor |

🎉 结语

至此,已经在 M2 MacBook Air 上成功搭建了一套完全本地、无 token 限制的 AI 对话服务。整套方案充分利用了 llama.cpp 的轻量和 Metal 加速,以及 OpenClaw 的便捷 Web 界面。后续可以进一步探索 OpenClaw 的更多功能(如接入 Telegram、Discord 等)。

Happy prompting! 🦞

奇妙科学

奇书引万般,妙理播云汉。

微信号|fantascience

夜雨聆风

夜雨聆风