写给完全不懂技术的普通人,12 岁也能看懂

先说一件可能让你惊讶的事:

你现在用的 ChatGPT、Claude 这些 AI,是跑在遥远的服务器上的。你每次提问,其实是把你的内容发到了美国的某台机器,等它回答,再传回来。

这意味着什么?

意味着你的对话内容,别人可能看得到。意味着断网就没法用。意味着用多少钱付多少,没有免费午餐。

但现在有另一种选择——把 AI 直接装在你自己的电脑上,像装一个软件一样,从此 AI 就住在你家里了。

这篇文章要说的,就是谷歌 2026 年 4 月刚发布的新 AI 模型 Gemma 4——它专门为「跑在你自己设备上」这件事做了优化,而且完全免费,不需要联网,装好就能聊。

第一章:先搞清楚 Gemma 4 是什么东西

AI 模型,就像是大脑

你可以把 AI 模型想象成一个「装在电脑里的大脑」。

这个大脑读过几乎所有的书、网页、代码、论文……然后把所有知识压缩进了一个文件里。你问它问题,它就从这些知识里找答案告诉你。

不同的 AI 大脑有不同的大小——越大的大脑,懂的东西越多,但需要更强的电脑才能运行;越小的大脑,运行起来更快,但聪明程度有一定限制。

Gemma 4 是谷歌做的

谷歌这家公司你肯定知道,做了搜索引擎、YouTube、安卓手机系统。

他们也有自己的 AI 部门叫 Google DeepMind,做了很多顶级的 AI 研究。Gemma 4 就是 DeepMind 在 2026 年 4 月 3 日发布的一个 AI 模型家族,而且是完全开源、完全免费的。

开源是什么意思?就是谷歌把这个 AI 的「配方」完全公开了,任何人都可以下载来用,不需要付钱,也不需要问谷歌要许可。就像一道菜的做法公开了,你可以自己在家做。

Gemma 4 有四个版本,就像手机有不同型号

Gemma 4 不是一个单独的模型,而是四个不同大小的模型,适合不同的设备和需求:

🟢 E2B(最小号)

名字里的「2B」指的是 20 亿个「参数」(你可以理解为神经元的数量) 只需要 4GB 内存就能跑 速度很快,适合手机和低配笔记本 能看图、能听声音

🟡 E4B(小号)

40 亿参数 需要大约 6GB 内存 比 E2B 更聪明,速度也还不错 大多数普通笔记本都能跑 推荐新手从这个开始

🟠 26B A4B(中号,特殊设计)

这个比较特殊——总共有 260 亿参数,但每次工作只用 40 亿 就像一个图书馆有 10 万本书,但每次只拿几本出来用 需要 16GB 以上内存 性价比很高,效果接近大模型,消耗接近小模型

🔴 31B(大号)

310 亿参数,目前最强的 Gemma 4 版本 需要 17-20GB 内存 需要比较好的电脑,适合有独立显卡的台式机或高配笔记本

💡 记忆方法:「B」是 Billion(十亿)的缩写。数字越大,模型越聪明,但需要的电脑也越强。

第二章:Gemma 4 能做什么、不能做什么

诚实地说,没有任何一个 AI 是完美的。我们先说好话,再说坏话。

✅ Gemma 4 擅长的事

1. 免费、可以装在自己电脑上

这是最大的优势。你不需要每个月交订阅费,不需要担心数据被看到,断网也能用。对于有隐私顾虑的人来说,这一点非常重要——比如你不想让别人看到你在问的私人问题。

2. 能看图片和视频

Gemma 4 支持多模态,意思是它不只能读文字,还能看图片、甚至处理视频(把视频当成一帧帧图片)。小版本的 E2B 和 E4B 还能听声音。

举个例子:你可以拍一张作业题的照片,发给它说「帮我解这道题」,它能看懂图片里写的内容。

3. 支持超过 140 种语言

中文当然没问题,而且效果相当不错。

4. 超长的记忆窗口

「上下文窗口」就是 AI 一次能记住多少内容。Gemma 4 小版本能记住相当于 10 万汉字的内容,大版本能记住 20 万汉字以上。

这意味着什么?你可以把一整本书粘贴进去,让它帮你总结或回答关于这本书的问题。

5. 推理能力强,会「思考」

Gemma 4 有一个「思考模式」——在回答复杂问题之前,它会先在脑子里推理一遍,再给出答案,就像人解题时打草稿一样。

6. Apache 2.0 许可,可以商用

这是个技术细节,简单说就是:如果你是开发者或者企业,想用 Gemma 4 做产品,法律上完全没问题,不用担心版权纠纷。

❌ Gemma 4 的不足

1. 小版本没有联网能力

装在本地的 Gemma 4,不能自己去搜索最新的新闻。它的知识有一个截止日期,2026 年之后发生的事它不知道。就像一本百科全书,印出来之后就不会更新了。

2. 小版本比不过 GPT-4o、Claude 这些「云端大模型」

说实话,E2B 和 E4B 这种小版本在复杂推理、写长文章这类任务上,还是比不过 ChatGPT Plus 或者 Claude Pro。大的 31B 版本会好很多,但需要更强的电脑。

就像街边早餐摊的鸡蛋饼,虽然便宜好吃,但比不过五星级酒店的早餐菜单丰盛。用于日常问答绰绰有余,用于专业复杂任务要有预期。

3. 需要你的电脑有足够的内存

如果你的电脑只有 8GB 内存,而且同时开着很多程序,E4B 可能跑起来会有点慢。这是本地部署的天生局限——没有那么多资源可以用。

4. 首次下载需要网络,文件也不小

E4B 的模型文件大约 3-5GB,需要提前下载好。这个过程需要网络,但下载完之后就不需要联网了。

5. 没有官方的对话界面

模型本身只是一个文件,你需要搭配一个「界面软件」才能和它聊天。好消息是这些界面软件也是免费的,下面我会带你一步步安装。

第三章:内存和显存——傻傻分不清楚?这次说清楚

很多人问:「你说的是内存还是显存?」

这个问题问得好,两个是不一样的东西,我来解释清楚。

内存(RAM)和显存(VRAM)是什么

内存(RAM):电脑的「工作桌面」,所有正在运行的程序都放在上面。你的 Word 文档、浏览器的标签页、正在播放的音乐,都在内存里。普通笔记本一般是 8GB 或 16GB。

显存(VRAM):显卡专用的内存,速度比普通内存快很多,专门用来跑图形计算。如果你有一块独立显卡(比如 NVIDIA RTX 3060),它上面会有自己的显存,一般是 6GB、8GB、12GB 或更多。

跑 AI 模型用的是哪个?

两个都可以用,优先用显存。

用 Ollama 跑模型时,它会自动判断:

有独立显卡:模型优先加载进显存,速度非常快 没有独立显卡(或者显存不够):自动退回用普通内存,速度慢一些但也能跑 两个都不够:会同时用内存+硬盘,速度很慢,不推荐

💡 苹果 M 系列芯片(M1/M2/M3/M4)比较特殊:它的内存和「显存」是合在一起的,叫统一内存。16GB 的 MacBook Air 相当于同时有 16GB 内存 + 16GB 显存,效率非常高,是目前跑本地 AI 性价比最高的硬件之一。

你的电脑配置怎么选版本

查看内存(Windows):

按 Win + R,输入dxdiag,回车看「内存」那一行

查看显存(Windows):

右键桌面 → 显示设置 → 高级显示设置 或者搜索「设备管理器」→ 显示适配器 → 右键你的显卡 → 属性

查看内存(Mac):

点左上角苹果图标 → 关于本机 看「内存」那一行

⚠️ 一个小提醒:跑模型的时候,尽量关掉其他占内存/显存的程序(特别是游戏、视频编辑软件),给模型留出足够的空间。

第四章:三步装好,用 Ollama 跑 Gemma 4

现在开始实际操作。我会用最简单的方法——Ollama。

Ollama 是什么?可以把它理解成一个「AI 模型管理器」,就像手机的应用商店。你在 Ollama 里输入一行命令,它自动帮你下载模型、安装好、启动起来,不需要你懂任何编程知识。

第一步:安装 Ollama

打开浏览器,访问:ollama.com

你会看到一个大大的下载按钮,它会自动识别你是 Windows、Mac 还是 Linux,下载对应版本。

下载完之后,双击安装,就像安装普通软件一样,一路点「下一步」就行。

安装完成后,Ollama 会在后台悄悄运行,你不会看到一个明显的界面——这是正常的,它只是在等你的命令。

第二步:下载 Gemma 4 模型

打开命令行:

Windows 用户:按 Win + R,输入cmd,回车,会弹出一个黑色窗口Mac 用户:按 Command + 空格,搜索「终端」,回车

不用害怕这个黑色窗口。它就是一个可以输入文字命令的地方,你输入什么,电脑就照做什么。

输入下面的命令,然后回车:

如果你的内存是 8GB:

ollama run gemma4:e2b如果你的内存是 16GB(推荐大多数人):

ollama run gemma4:e4b如果你的内存是 16GB 以上,想要更好效果:

ollama run gemma4:26b如果你有很强的电脑(32GB+):

ollama run gemma4:31b然后等待。

第一次运行,Ollama 会先帮你下载模型文件。E4B 大约 3GB 左右,26B 大约 17GB,根据你的网速,可能需要几分钟到几十分钟。下载进度会显示在屏幕上。

下载完毕后,你会看到这样的提示:

>>> Send a message (/? forhelp)恭喜!你的 AI 已经准备好了!

第三步:开始聊天

现在你可以直接在这个黑色窗口里输入问题了,比如:

帮我解释一下光合作用是什么或者:

帮我写一首关于春天的短诗回车之后,它就会开始回答你。

第五章:装一个好看的聊天界面(可选,强烈推荐)

命令行虽然能用,但每次都要打开黑色窗口有点麻烦。有一个免费的软件叫 Open WebUI,可以给 Ollama 加一个像 ChatGPT 一样的好看界面。

不过这个需要安装 Docker,稍微复杂一点。

更简单的替代方案:

直接下载 LM Studio——这是一个有图形界面的 AI 管理工具,傻瓜式操作,点点点就装好了,还能直接聊天。

访问:lmstudio.ai,下载对应版本,安装好之后,在软件里搜索「gemma4」,选择你想要的版本下载,然后就能在软件里直接聊天了。

LM Studio 的界面长得很像 ChatGPT,有聊天记录、可以调整参数,对新手非常友好。

第六章:可能遇到的问题和解决办法

问题一:运行很慢,回答一个字要等好几秒

原因:模型太大,你的电脑内存或算力不够。

解决方法:换一个更小的模型版本。比如从 E4B 换成 E2B,速度会快很多。

问题二:提示「内存不足」或者直接崩溃

原因:模型加载到内存时空间不够。

解决方法:

关掉其他占内存的软件(浏览器开很多标签页、游戏等) 换更小的模型版本

问题三:下载到一半断了

解决方法:重新运行同样的命令,Ollama 会从断点继续下载,不需要重头来。

问题四:想删掉某个模型,释放硬盘空间

在命令行里输入:

ollama rm gemma4:e4b把 e4b 换成你想删的版本就行。

问题五:想看我下载了哪些模型

输入:

ollama list会列出所有已下载的模型和它们占用的空间。

第七章:Gemma 4 能用来做什么?一些实际的例子

当作学习助手

拍一张课本或作业的照片,问它「这道题怎么解」或者「这段话是什么意思」,它会详细解释。

帮你写东西

告诉它「我需要给老师写一封请假条,原因是要去看病,帮我写」,它会帮你起草,你再稍微改改就行。

陪你练外语

你可以用英文和它聊天,告诉它「你是我的英语老师,用简单的英语和我对话,如果我说错了请帮我纠正」,它就会当你的私教。

帮你理解复杂文章

把一篇看不懂的新闻或文章复制进去,让它「用小学生能懂的语言解释一下」,它会翻译成你能理解的版本。

私密记日记

因为运行在本地,你可以放心地告诉它你今天发生了什么、你的心情,完全不用担心被人看到。

写代码(给程序员朋友)

Gemma 4 在编程方面表现很出色,可以帮你写代码、找 Bug、解释代码的意思。

第八章:和其他 AI 对比,Gemma 4 适不适合你?

| 费用 | ||

| 隐私 | ||

| 是否需要网络 | ||

| 最新信息 | ||

| 回答质量 | ||

| 使用门槛 | ||

| 对电脑要求 |

什么情况下选 Gemma 4 本地部署:

你很在意隐私,不想让问题被别人看到 你经常断网,或者网速不好 你不想每个月花订阅费 你的电脑内存够用(16GB 以上最佳) 你只是需要一个日常问答的 AI,不需要最顶级的能力

什么情况下还是用 ChatGPT / Claude:

你需要最新的新闻和信息 你需要处理非常复杂的任务(比如专业论文、复杂代码) 你的电脑内存只有 8GB 且很旧 你不想折腾安装过程

第九章:Gemma 4 和其他主流开源模型对比

现在开源 AI 模型很多,除了 Gemma 4,还有 Meta 的 Llama 4、阿里巴巴的 Qwen(通义千问)、DeepSeek 等等。它们各有优缺点,这章帮你看清楚。

先说说这些模型都是谁做的

| Gemma 4 | ||

| Llama 4 | ||

| Qwen(通义千问) | ||

| DeepSeek |

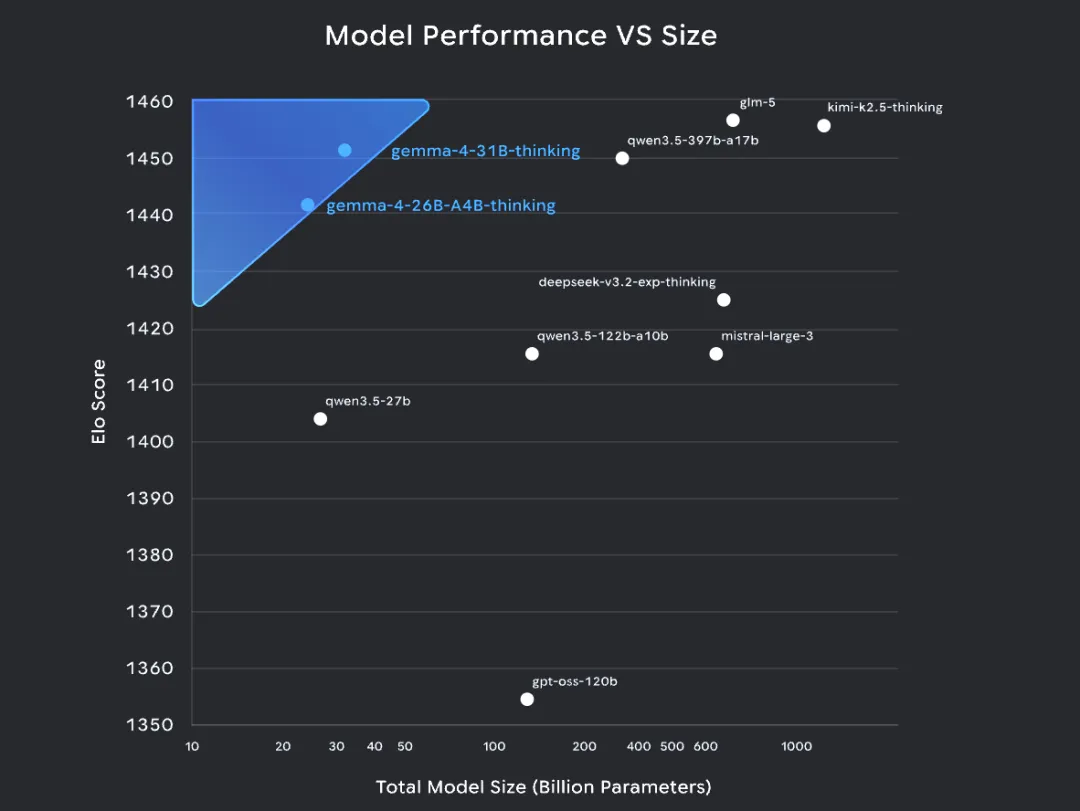

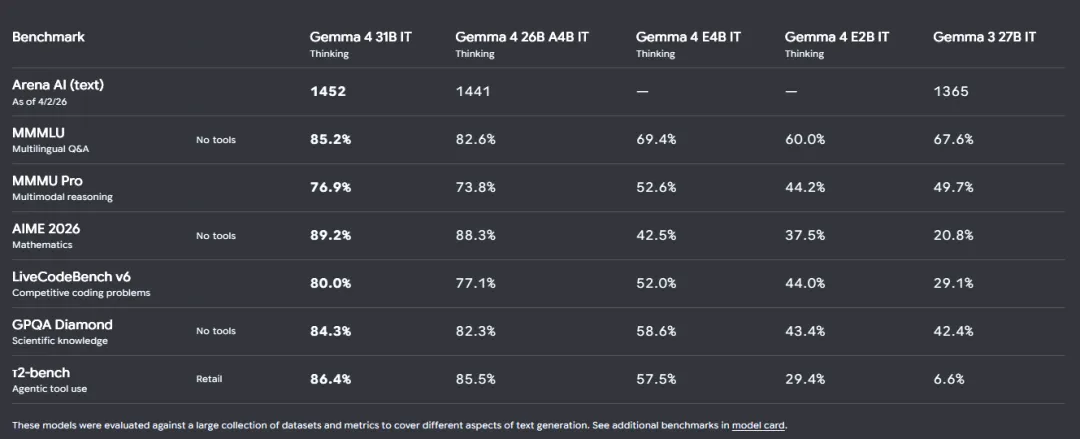

跑分对比(理解成「考试成绩」)

注:分数越高越好。这些测试分别考验:数学推理(AIME)、综合知识(MMLU Pro)、编程能力(LiveCodeBench)。

| Gemma 4 31B | 89.2% | |||

| Qwen 3.5 27B | 86.1% | |||

| Llama 4 Scout | ||||

| DeepSeek V3.2 |

简单总结:在同等大小的模型里,Gemma 4 31B 数学和编程最强;Qwen 3.5 综合知识略胜一筹;Llama 4 虽然总参数多,但推理成绩反而偏弱;DeepSeek 很强但体积巨大,普通电脑根本跑不动。

「超长记忆」对比

记忆窗口越大,意味着 AI 一次能「读」的内容越多,处理长文档能力越强。

| Llama 4 Scout | ||

| Gemma 4 26B/31B | ||

| Gemma 4 E2B/E4B | ||

| Qwen 3.5 | ||

| DeepSeek V3.2 |

Llama 4 的 1000 万 token 上下文窗口是绝对碾压级别的,但这个模型体量太大,普通人根本跑不起来。对于本地部署,Gemma 4 的 20 万字已经足够大多数场景使用。

能不能在普通电脑上跑

这是普通用户最关心的问题:

| Gemma 4 E2B | ||

| Gemma 4 E4B | ||

| Qwen 3.5 小版本(4B) | ||

| Llama 4 Scout(最小) | ||

| DeepSeek V3.2 |

结论很清楚:Llama 4 和 DeepSeek 的旗舰版本是企业级服务器才能跑的东西,普通人根本碰不到。真正适合本地部署的主要是 Gemma 4 和 Qwen 3.5 小版本。

证书和能不能商用

| Gemma 4 | |||

| Qwen 3.5 | |||

| Llama 4 | |||

| DeepSeek |

各有什么特长

我用大白话总结一下每个模型「最适合干什么」:

选 Gemma 4,如果你:

想在普通笔记本上本地跑一个好用的 AI 需要处理图片、甚至音频(小版本独有) 做数学题、写代码、逻辑推理场景多 关心隐私,想完全离线使用

选 Qwen(通义千问),如果你:

特别在意中文效果(Qwen 中文支持据说更细腻) 需要处理非常多种语言(支持 140+ 种,含更多小语种) 做中文内容创作、客服、翻译场景

选 Llama 4,如果你:

需要处理超级长的文档(几百万字) 在企业级服务器上部署 需要最广泛的社区支持和工具生态

选 DeepSeek,如果你:

是开发者或研究者,有专业 GPU 资源 做复杂数学推理或多步骤逻辑题 通过 API 调用(价格很便宜)而不是本地跑

对普通用户的终极建议:

想在自己电脑上本地跑 AI?选 Gemma 4 E4B(16GB 内存)或 Gemma 4 E2B(8GB 内存)。这是目前本地部署性价比最高、门槛最低的选择,没有之一。

总结

装一个 AI 在自己电脑上,这件事在一两年前还是程序员才会做的事,现在真的变成了普通人也能做到的事。

Gemma 4 是谷歌 2026 年最新发布的开源 AI 模型,完全免费,支持中文,能看图,能推理,有四个不同大小的版本适合不同的电脑配置。

最快的上手路径只需要三步:

安装 Ollama(ollama.com,就像安装普通软件) 在命令行输入 ollama run gemma4:e4b(16GB 内存的推荐)等下载完,开始聊天

如果你用的是苹果 M 系列芯片的 Mac,效果会特别好,16GB 内存就能流畅运行 E4B,体验相当丝滑。

折腾完之后,你就有了一个住在自己电脑里的私人 AI,24 小时可用,不花一分钱,问什么只有你自己知道。

遇到任何安装问题,留言告诉我,我来帮你解答。如果你成功装好了,也来告诉我你第一个问它的问题是什么——我很好奇。

📌 项目速查

| 模型名称 | |

| 发布时间 | |

| 开发者 | |

| 协议 | |

| 支持语言 |

四个版本对照

三步上手命令

# 第一步:安装 Ollama(去 ollama.com 下载)# 第二步:下载并运行模型(16GB 内存推荐)ollama run gemma4:e4b# 第三步:在对话框里直接输入问题直达链接

🔗 Ollama(最简单):ollama.com 🖥️ LM Studio(图形界面):lmstudio.ai 🤗 HuggingFace(模型下载):huggingface.co/google/gemma-4

夜雨聆风

夜雨聆风