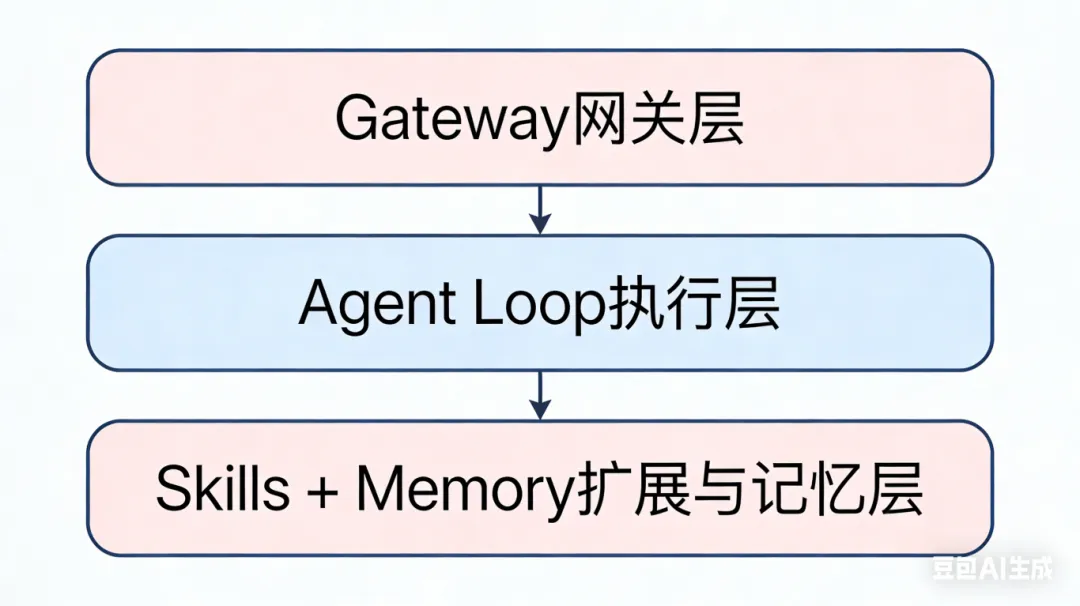

Gateway(网关层) :运行在本地的守护进程,负责对接微信、飞书、浏览器等通讯渠道,是AI与外部世界的“总接线员”。 Agent Loop(执行层) :AI接到指令后,自动拆解任务,按照“规划→工具调用→观察结果→反思”的循环执行。每一步都会停下来评估,再决定下一步。这种自适应的闭环机制,使AI能够处理非线性的复杂任务。 Skills + Memory(扩展与记忆层) :社区贡献的上万个“技能包”,AI可以直接调用甚至自己编写新技能;同时通过记忆文件记录长期偏好,实现持续进化。

路径一:架构优化。 减少“思考”的频率——让AI批量处理多个步骤后再反思,而不是每步都反思。或者引入“分层规划”:高层做长期规划,低层执行时不需要每步都汇报。这些技术路线已经有人在探索,但还没有成熟到产品化。 路径二:算力成本继续下降。 如果推理成本再降两个数量级,那么即使效率低,经济账也可能算得过来。这不是回避问题,而是承认:技术问题有两种解法,一种是让算法更聪明,另一种是让资源更便宜。两者都在发生。

第一层受益者:大模型厂商。 OpenAI、Anthropic、谷歌、深度求索——每一轮Agent调用都在消耗他们的API,都在贡献营收。OpenClaw越火,他们的收入越高。而且他们不需要承担开源维护的成本。 第二层受益者:企业级服务商。 浪潮信息的“企千虾”、百度智能云的Agent框架、各大云厂商的一键部署方案——他们提供的是“安全、可控、可审计”的企业级方案,收费自然不菲。这些服务的核心价值不是技术,而是风险转移:企业付钱,服务商承担安全责任。 第三层:技术基础设施提供商。 英伟达通过NemoClaw平台试图建立“Agent安全标准”,这相当于在淘金热中卖铲子的同时,还试图制定“铲子的行业标准”。如果成功,这将是一个比卖芯片更持久的商业模式。

不要焦虑,但要学习。 Agent不会明天就替代你的工作,但它会逐渐改变你的工作内容。学会“给Agent下指令、拆解任务、验证结果”将成为基本技能,就像今天会用Excel一样。 不要裸奔,但要尝试。 在非关键场景中使用Agent,体验它的能力和局限。不要在生产环境或涉及敏感数据时使用,但可以在个人项目、学习、轻度自动化中尝试。 不要依赖,但要利用。 保持自己完成核心任务的能力,定期进行“无Agent训练”。把Agent当作副驾驶,而不是自动驾驶。

术语 | 通俗解释 | 技术性解释 |

Agent(智能体) | 能自己“动脑子干活”的AI,不再是问答式互动 | 具备自主感知-规划-执行闭环的AI系统,可在最小人工干预下完成多步骤任务 |

Agent Loop | AI的“想→做→看→再想”循环,每一步都自我评估 | 核心执行范式:规划→工具调用→观察结果→反思,然后进入下一轮迭代 |

Gateway(网关) | AI的“总接线员”,负责连接模型与各种应用 | 本地守护进程,统一管理多通道消息收发,是AI与外部系统的通信枢纽 |

Skill(技能) | AI可“即插即用”的能力包,如网页搜索、文件处理 | 可插拔功能模块,封装特定任务的提示词和工具调用逻辑 |

MCP(模型上下文协议) | 让不同AI和工具“说同一种语言”的标准接口 | Anthropic主导的开放协议,被类比为“AI领域的USB接口” |

Token | AI理解和生成文字的最小信息单元 | 大模型的分词单位,API调用按Token计费,是AI应用的直接成本 |

Token能效比 | 花在“干活”上的Token占比 | 有效产出Token与总消耗Token的比值,当前Agent类应用普遍偏低 |

提示词注入 | 黑客通过恶意指令让AI“干坏事” | 利用LLM的越狱攻击,通过构造特定输入绕过原始指令,诱导非预期操作 |

沙箱环境 | AI的“游乐场”,只能在内活动 | 安全隔离机制,将AI可访问的系统资源限制在受限环境中 |

夜雨聆风

夜雨聆风