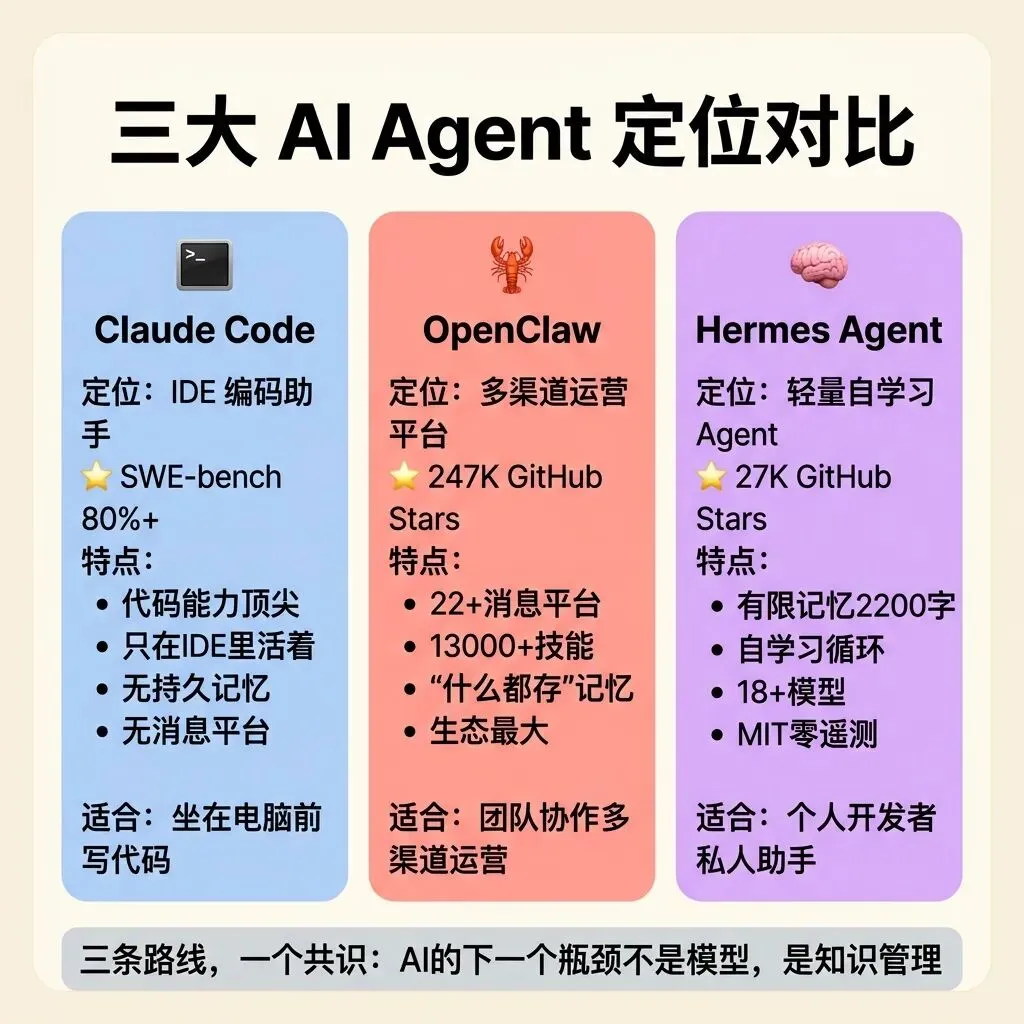

放弃 OpenClaw?这才是第一个真正"越用越聪明的" AI分身

引言

如果你一直关注 AI Agent,最近的圈子被一个新名字刷爆了:Hermes Agent。

短短两个月狂揽 27,000+ GitHub Stars,甚至很多大佬直接喊话:"已经准备删掉 OpenClaw 了!"

它之所以被当做 OpenClaw 的头号竞品,不是因为它功能多(事实上没那么多),而是因为它做到了我们一直想要的科幻级功能:自我进化。

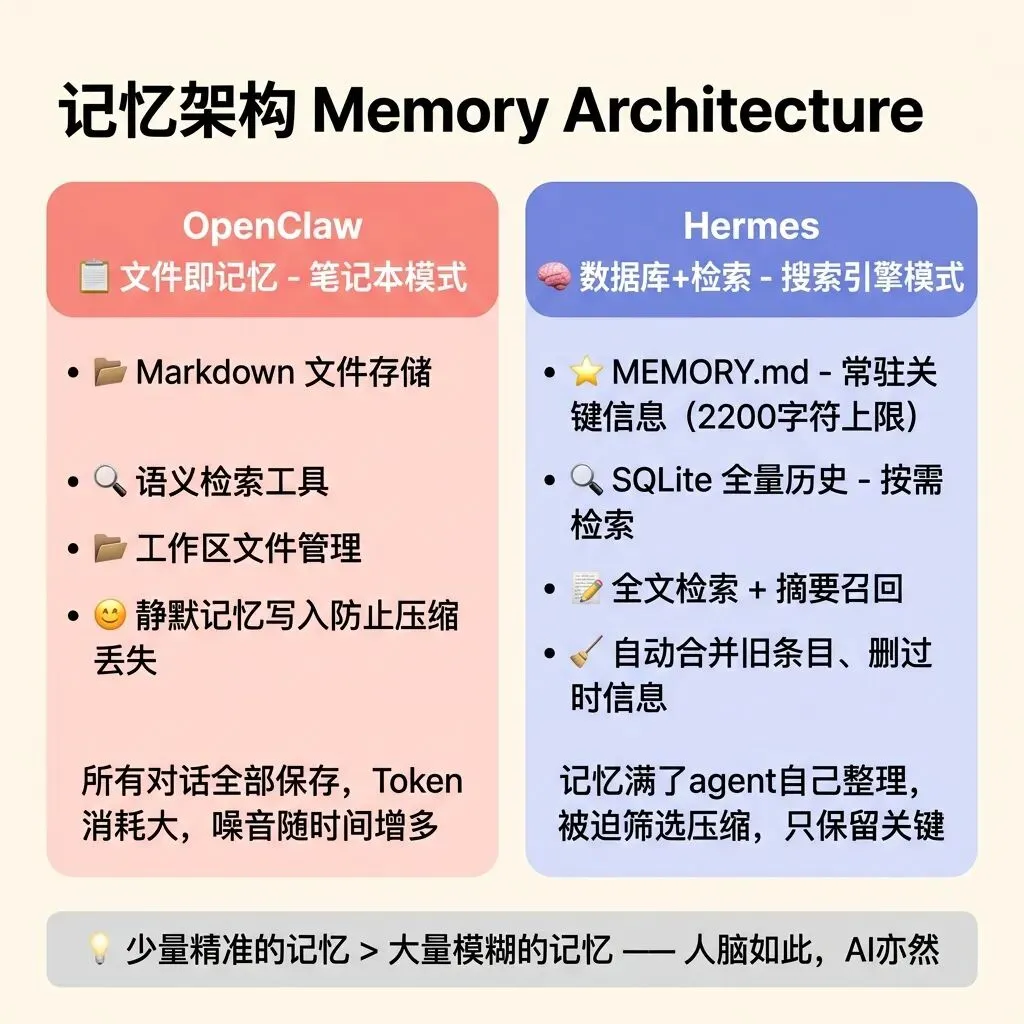

1. 记忆哲学的世纪分歧:为什么 OpenClaw 越用越慢?

用久了你会发现,不管是哪家的大满贯 Agent,到最后都会变得又慢又贵。为什么?因为它们的策略是"全量存储"。

把你扔过的所有文档、踩过的所有坑、半途而废的对话,像废纸篓一样全部塞进上下文。

而 Hermes 做了个极其反直觉的减法:给记忆加了 2200 字符的硬性上限。

记忆满了怎么办?它会像一个勤奋的秘书:主动合并旧笔记、删掉废话、把 10 条相关记录压缩成 1 条。 这其实也是当前 AI 圈最高阶的玩法——知识不靠堆积,靠不断地重新编译。 留下的,全是纯度极高的“认知真金”。

也正因如此,全网评价高度一致:

“🎙 "切到 Hermes 太爽了,响应速度比 OpenClaw 快了太多倍了。而且因为 token 开销小,挂个中转站 API 几乎不用花钱!" —— 来自 X 博主 @马天翼 @Andy Stewart

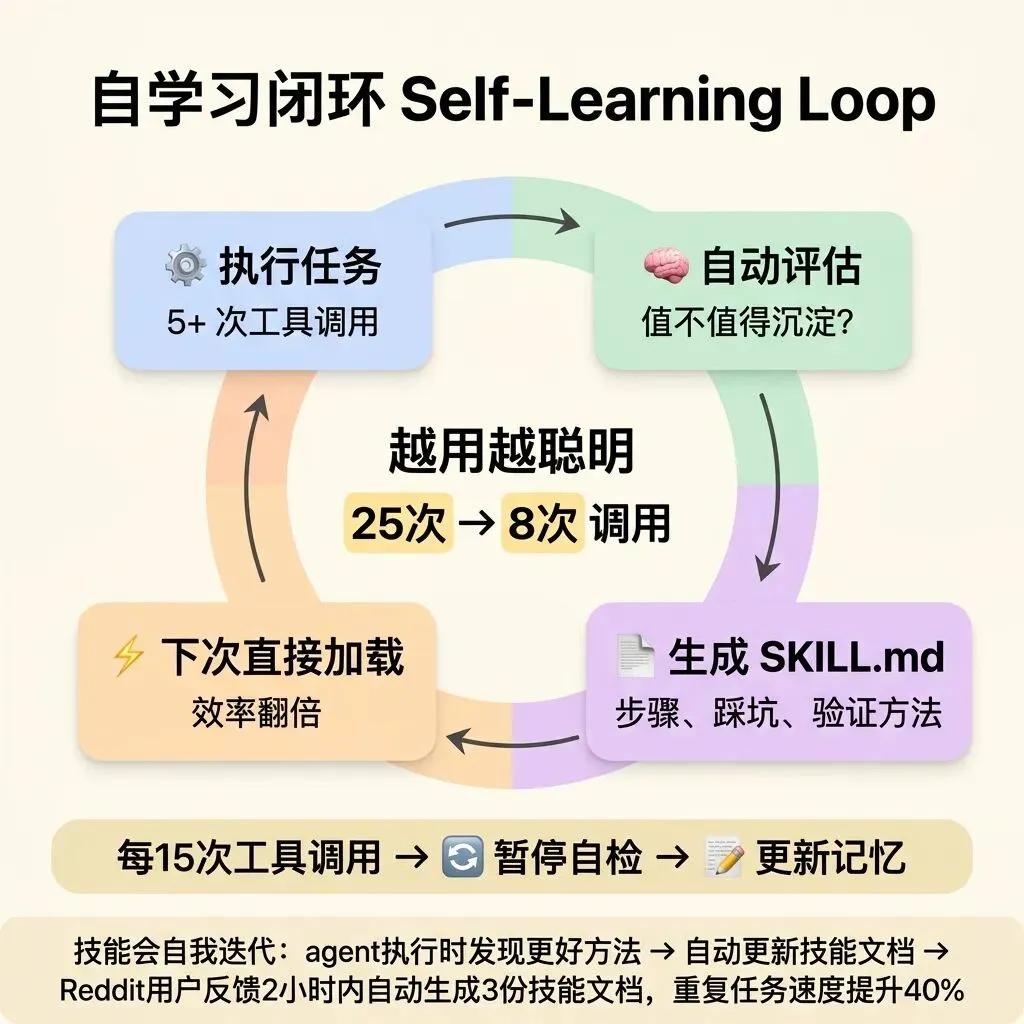

2. 恐怖的自学习循环:它给自己写操作手册

这是 Hermes 最可怕的杀手锏。

绝大多数 Agent 还是一个“算盘”状态:你拨一下,它动一下。同样的报错它可能下次继续犯。

而 Hermes 内置了一套闭环学习循环(Closed Learning Loop):

第一阶段(执行):它跌跌撞撞花了 25 次工具调用帮你完成了一个复杂任务。 第二阶段(反思):它会进入“静默思考”,总结这次踩坑经历了什么。 第三阶段(沉淀):它会把最优解自动编写成一张 .md技能卡片。下次遇到同类任务,直接照着最佳实践走。

社区实测数据非常惊艳:

同样任务,一个月后调用次数从 25 次缩减到了 8 次。 Reddit 极客实测,短短 2 小时内它悄悄生成了 3 份专属效率手册,同类研究任务提速 40%!

“🎙 "Skill saved、memory updated 这些状态实时能看到,能直接感知它在成长。在这个时代,下一阶段比的不是能接多少工具,而是谁的 agent 自己会成长。" —— 来自 X 博主 @雨哥向前冲 @wangray

3. 最新重磅更新,自带“双剑合璧”

就在昨天(4月7日),Hermes 又抛出了一个深水炸弹:它直接内置了 AI 大神 Andrej Karpathy 提出的 LLM-Wiki 模式。

你只需在对话框甩出一个指令:/llm-wiki <你要研究的主题>几分钟后,Hermes 就会自动开启爬虫、扒代码、啃论文,并用 Markdown 在你本地组装出一个结构极其清晰的 Obsidian 知识库。

它不再只是一个听话的网关,而是一个合格的全自动化科研助理。

4. 到底该怎么选?

咱们不吹不擂,给点最中肯的实操建议。

❌ 不需要换:如果你觉得现在的 Agent 已经完全够用,不需要折腾。 🌍 选 OpenClaw:如果你想要一个生态庞大、“多渠道集成之王”,能一拖二十地搞联运。 🧠 选 Hermes:如果你真正需要的是一个长期进化的大脑分身,喜欢它随着你的习惯变得敏锐、节省和高效。

(附:如果你是老用户,它甚至贴心地自带 hermes claw migrate 命令,老数据秒迁移)

💡 一个最后的洞察

在这个月之暗面和 OpenAI 们疯狂厮杀模型参数的狂飙时代,Hermes 的走红反而像一种返璞归真。

它回答了那个终极问题:给机器一本没重点的流水账,和一本高度提纯的小册子,哪个效能更高?

少量精准的记忆,远大于海量模糊的堆砌。人脑如此,AI 亦然。

夜雨聆风

夜雨聆风