LG - 机器学习 CV - 计算机视觉 CL - 计算与语言

1、[CL] The Illusion of Stochasticity in LLMs

2、[CL] Does a Global Perspective Help Prune Sparse MoEs Elegantly?

3、[CL] Learning to Interrupt in Language-based Multi-agent Communication 4、[LG] The Depth Ceiling:On the Limits of Large Language Models in Discovering Latent Planning

5、[CL] Tool-MCoT:Tool Augmented Multimodal Chain-of-Thought for Content Safety Moderation

摘要:大语言模型随机性的幻象、全局视角能否助力稀疏MoE优雅剪枝、基于语言的多智能体通信中的主动中断学习、大语言模型在挖掘潜在规划中的局限性、面向内容安全审核的工具增强型多模态思维链

1、[CL] The Illusion of Stochasticity in LLMs

X Gu, S De, M Titsias, L Markeeva…

[Google DeepMind]

大语言模型随机性的幻象

要点:

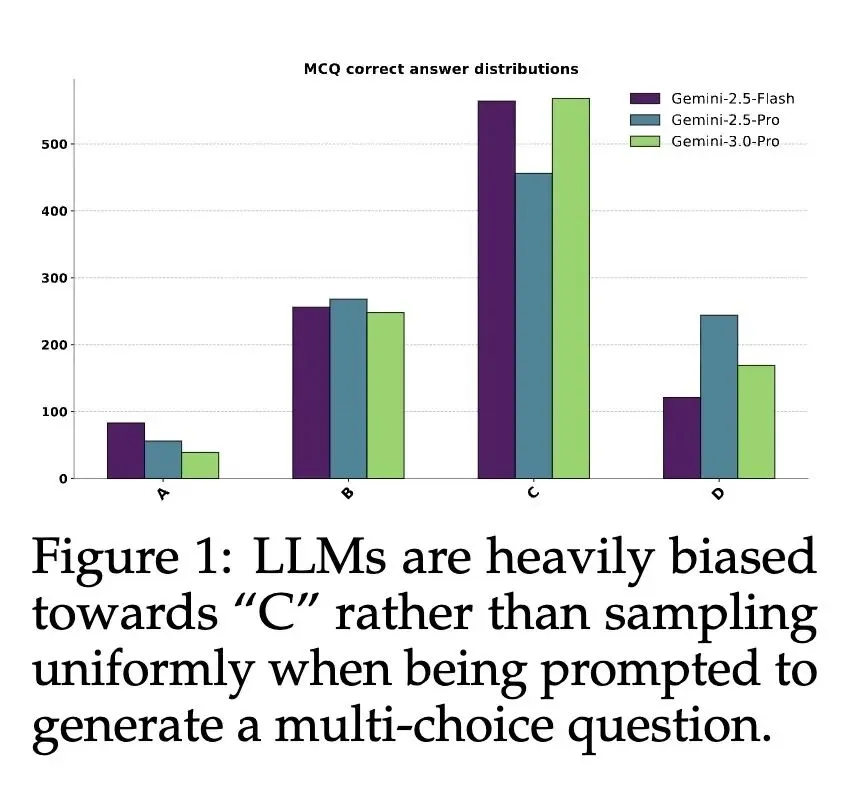

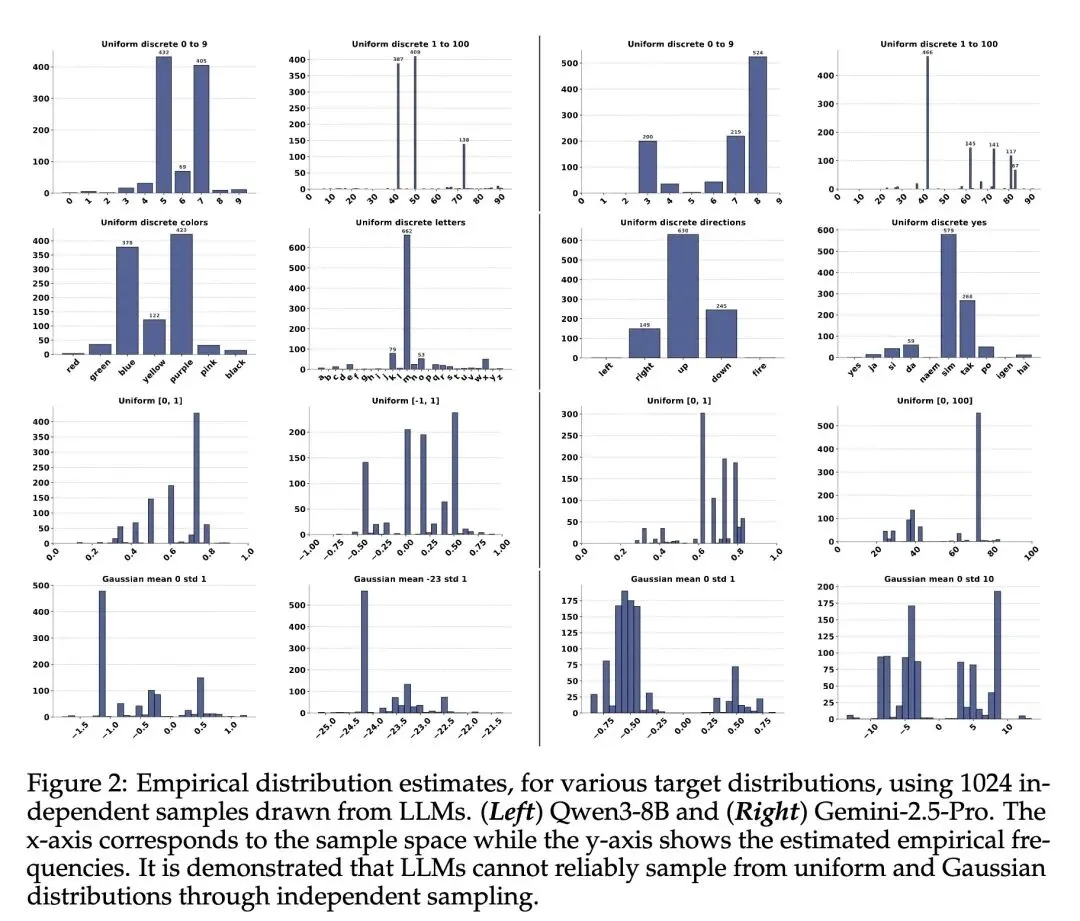

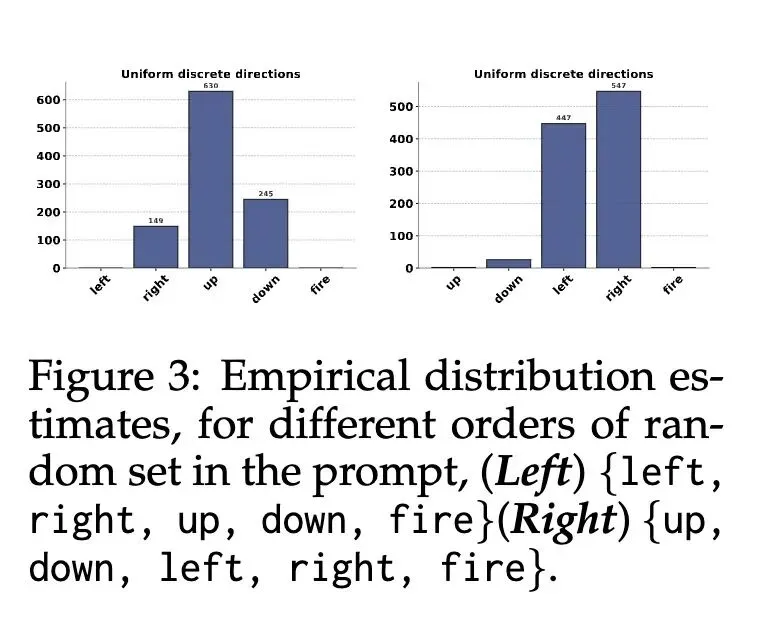

揭示了LLM智能体中一个关键的“知行脱节(knowing-doing gap)”现象:虽然LLM完全理解概率分布并且能写出采样算法,但它们根本无法通过其内部的生成过程直接生成符合这些目标分布的随机样本。 揭示了LLM原生采样中强烈的、可预测的偏见:LLM严重偏好特定的数字(如7、42)或位置选项(如多选题必选“C”),这证明它们表面的随机性只是一种受训练数据分布驱动的“幻觉”,而非真正的随机性。 证明了修改解码参数(温度、top-p、top-k)或操纵思维链(开启或完全禁用CoT)都无法修复这些固有的分布偏差。 表明顺序采样(将之前的样本放入上下文中)或批量采样会引入严重的“时间偏差”,例如自相关性或周期性重复模式,导致生成的序列极易被预测和利用。 发现了一个反直觉的伪随机数生成(PRNG)模拟极限:虽然LLM可以通过思维链模拟均匀分布的PRNG,但在模拟高斯PRNG(如Box-Muller变换)时会彻底失败。原因是计算过程中内部状态会变成极大的数字,触发了LLM固有的复杂数学计算缺陷。 高信息熵观点:在先进LLM中发现了一种“分布转换(Distribution Conversion)”的涌现能力。如果直接在提示词中提供一个真正的随机数 ,LLM可以完美无瑕地执行确定性算法(如逆变换采样),将这个种子完美转化为复杂的目标分布(高斯分布、混合高斯模型等)。这证明LLM是极好的“确定性计算器”,却是极差的“原生随机生成器”。 指出了工具使用中的系统性缺陷:当LLM编写Python代码进行采样时,它们通常会忘记设置动态随机种子(如 time.time()),由于标准执行环境的无状态特性,这会导致它们在独立的API调用中输出完全确定的(非随机的)结果。

主旨: 本文主要提出了大型语言模型(LLMs)在作为智能体(Agents)进行决策时面临的一个基础性缺陷:LLM无法可靠地从特定的概率分布中进行随机采样。文章指出,尽管LLM的输出具有一定的熵(看似随机),但这只是一种“随机性幻觉”,阻碍了LLM在需要真实随机策略的复杂环境中的可靠应用。

创新:

提出了一套针对LLM“随机采样能力”的系统性评估框架,从独立采样、顺序采样、批量采样、代码工具调用到PRNG算法模拟,进行了全方位的病理学分析。 创新性地引入了“分布转换(Distribution Conversion)”范式:放弃让LLM“凭空生成”随机数,而是从外部提供一个标准均匀分布的随机种子,测试LLM通过确定性推理将其映射到复杂分布的能力,巧妙地分离了LLM的“随机生成缺陷”与“逻辑计算优势”。

贡献:

提供了极其详实的实证证据,证明当前前沿LLM(如Gemini, Qwen, OLMO)在直接采样连续、离散甚至高斯分布时存在严重的分布偏见和位置偏见。 深入剖析了依靠改变解码参数或思维链(CoT)无法解决这一问题,打破了社区对于“调参能带来真实随机”的迷思。 明确界定了LLM在模拟伪随机数生成器(PRNG)时的能力边界(受限于大数乘法运算能力)。 提出了针对该缺陷的务实解决方案,即LLM智能体在部署时必须依赖外部的、具有状态追踪记忆的采样工具。

提升:

通过引入外部随机种子进行“分布转换(Distribution Conversion)”,使LLM在生成复杂分布(如非均匀离散分布、混合高斯模型GMM)样本时的拟合度(由Goodness-of-fit检验的p值衡量)得到了质的提升,达到了统计学上符合目标分布的标准(p > 0.05)。

不足:

基于上下文历史的顺序采样(Sequential sampling)不仅计算成本极其昂贵、无法并行,而且依然存在“排斥当前状态”的时间自相关偏差。 依赖LLM内部思维链模拟PRNG的方法,对于高斯等复杂分布依然无能为力,因为计算复杂度超出了LLM的算术极限。 论文提出的最终解决方案依赖于给LLM挂载外部的有状态采样器,这属于系统工程层面的规避,而未能从模型架构或训练层面彻底解决LLM缺乏内生可控随机性的问题。

心得:

“知”与“行”在LLM中是分离的:最让我深思的是,LLM可以在文本层面完美解释概率论,甚至写出逆变换采样的复杂数学公式,但在让它真正输出一个符合该公式的数字时却一塌糊涂。这提醒我们在评估智能体时,绝不能用“测试知识问答”的成绩来等同于它“在环境中执行行动”的能力。 警惕“随机性幻觉”带来的安全隐患:LLM生成的看似随机的内容(如多选题答案的乱序),实际上深受其预训练数据分布的束缚(如对数字42、7的偏好,或对选项C的偏好)。在博弈论场景或对抗性环境中,这种伪随机性是极度危险且容易被对手逆向工程并利用的。 确定性计算是通往可控随机的桥梁:一个极其反直觉的启发是——要让LLM输出高质量的随机结果,不要让它自己去“猜”或“随机生成”,而是给它一个绝对客观的随机种子(如 ),然后让它当一个无情的“确定性计算器”去跑算法。这为未来设计Agent工具调用提供了新的哲学思路:让LLM做严谨的推理,把真正的随机留给外部世界。

一句话总结:

本文深刻揭示了大型语言模型无法真正进行概率分布采样的“随机性幻觉”问题,发现任何内部参数调整都无法消除其固有的数据偏见,但反直觉地证明了:只要从外部提供一个真随机种子,LLM就能依靠其强大的确定性推理能力将其完美转化为任何复杂的概率分布。

In this work, we demonstrate that reliable stochastic sampling is a fundamental yet unfulfilled requirement for Large Language Models (LLMs) operating as agents. Agentic systems are frequently required to sample from distributions, often inferred from observed data, a process which needs to be emulated by the LLM. This leads to a distinct failure point: while standard RL agents rely on external sampling mechanisms, LLMs fail to map their internal probability estimates to their stochastic outputs. Through rigorous empirical analysis across multiple model families, model sizes, prompting styles, and distributions, we demonstrate the extent of this failure. Crucially, we show that while powerful frontier models can convert provided random seeds to target distributions, their ability to sample directly from specific distributions is fundamentally flawed.

https://arxiv.org/abs/2604.06543

2、[CL] Does a Global Perspective Help Prune Sparse MoEs Elegantly?

Z Zhang, N Ghosh, J Liu, B Yu…

[University of Rochester & Flatiron Institute]

全局视角能否助力稀疏MoE优雅剪枝?

要点:

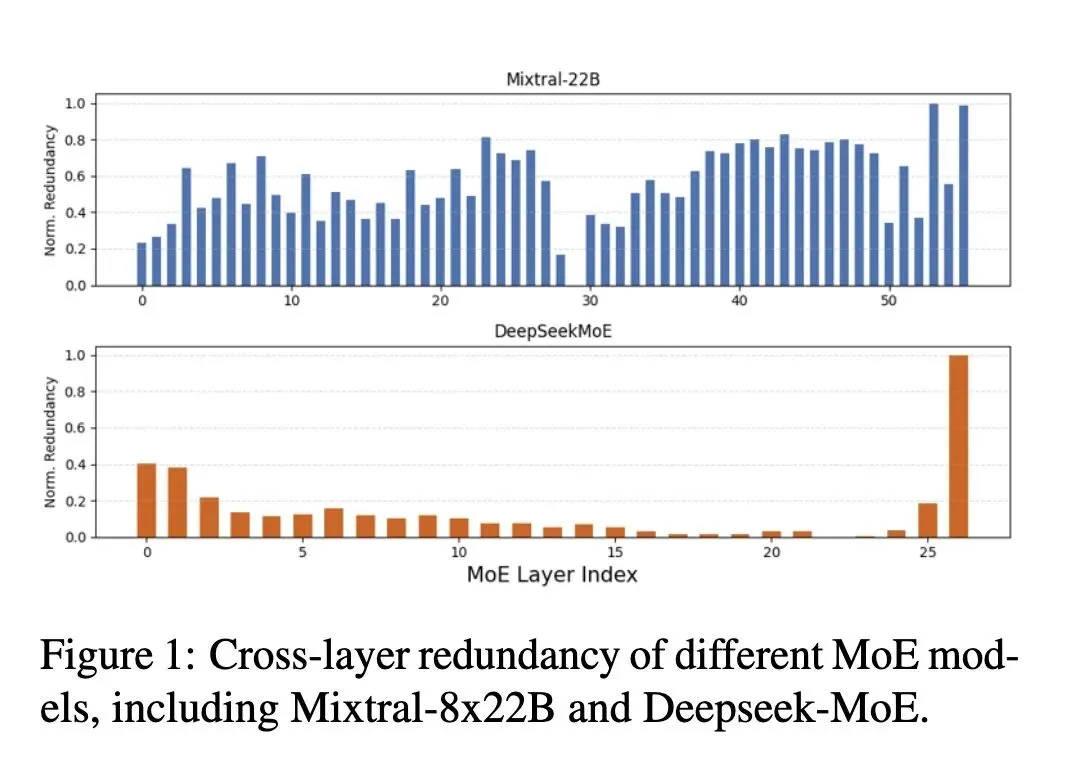

挑战了稀疏混合专家模型(MoE)中标准的“均匀逐层剪枝”常规做法,揭示了不同层之间的专家冗余度具有高度异质性(通常早期层冗余度较低,后期层较高,但并非严格单调)。 发现了一个高度反直觉的现象:无约束的全局剪枝会导致模型崩溃。某些极端冗余的层(如DeepSeek-MoE的最后一层)会贪婪地消耗掉所有的剪枝预算,导致严重的架构不平衡。 提出了 GRAPE(全局冗余感知专家剪枝),这是一种全新的剪枝策略,它根据跨层冗余度在整个网络中动态分配剪枝预算,而不是采用每层固定的配额。 创新性地提出了一种“全局熵(Global Entropy)”正则化机制作为结构安全卫士。通过计算保留专家在各层分布的熵值,当熵降至阈值以下时,GRAPE会冻结特定层,优雅地防止了在高度冗余层中的过度剪枝。 实验证明,在免微调、任务不可知的设定下,GRAPE 在多种主流 MoE 架构(Mixtral、DeepSeek-MoE、Qwen-MoE、GPT-OSS)上,均持续优于强大的局部(均匀)剪枝基线(如 DEK、Router-guided)。

主旨: 本文旨在解决大型语言模型中稀疏混合专家(MoE)模型的高效剪枝与显存占用问题。文章指出,现有的剪枝方法通常在每层均匀分配剪枝预算,忽略了层与层之间冗余度的显著差异。为此,作者提出了一种基于全局视角的剪枝策略(GRAPE),通过动态评估跨层冗余度来全局分配剪枝预算,从而在降低模型显存消耗的同时更好地维持模型性能。

创新:

打破了局部/均匀剪枝的惯性思维,将 MoE 专家的剪枝预算分配提升到全局层面进行统筹优化。 发现了无约束全局剪枝会导致的“层极度不平衡与模型崩溃”问题,并创造性地引入了“全局熵(Global Entropy)”作为宏观正则化约束机制。通过结合贪心剪枝与基于熵阈值的重启策略,实现了剪枝效率与网络结构平衡的完美统一。

贡献:

首次量化并系统性地可视化了多种前沿 MoE 模型(如 Mixtral, DeepSeek-MoE)的跨层冗余度差异(Cross-layer Redundancy)。 提出了一种完全免微调(task-agnostic)、即插即用的全局 MoE 剪枝算法 GRAPE。 在多个不同架构、不同参数规模的领先 MoE 模型上进行了广泛验证,确立了全局视角剪枝相比传统局部基线方法的显著优越性。

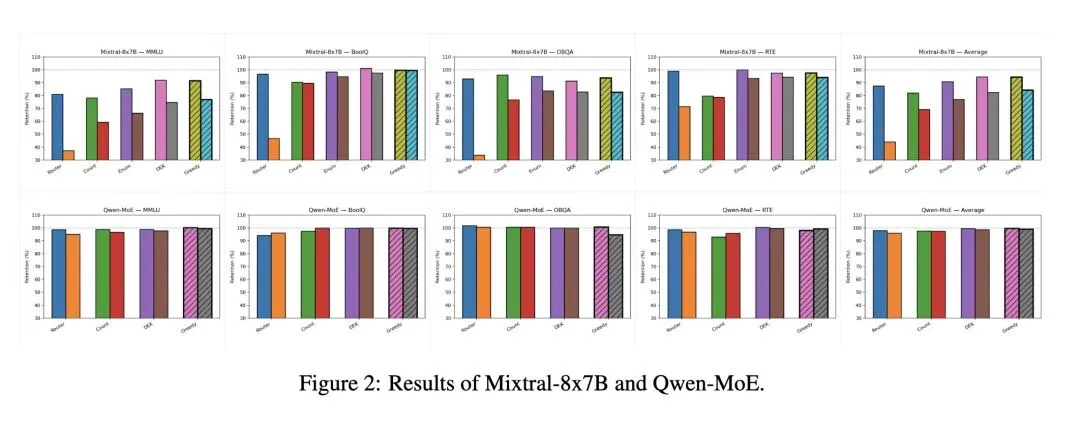

提升:

在相同的剪枝预算限制下,GRAPE 持续取得最佳的平均准确率。在论文报告的三款主要模型上,相比最强的局部剪枝基线(如 DEK),GRAPE 在所有剪枝设置下的平均准确率提升了 1.40%,其中在 Mixtral-8x22B 上最高提升达到了 2.45%。

不足:

当面临层间冗余度极其不平衡的模型(如 DeepSeek-MoE)时,全局剪枝依然面临潜在的模型崩溃风险,其有效性高度依赖于人工设定的全局熵约束参数(容忍度 )。 如何设计更普适、更精准的底层相似度度量指标来评估 MoE 层的冗余度,仍是一个未完全解决的开放性问题。 实验仅在免微调(Zero-shot pruning)设定下进行,未进一步探讨如果结合轻量化微调(Fine-tuning),全局剪枝策略性能的理论上限。

心得:

局部最优不等于全局最优:传统的逐层剪枝策略在每一层寻找最冗余的专家进行合并,但这忽略了一个关键事实——“某一关键层中最冗余的专家,其价值可能依然远高于某一冗余层中最核心的专家”。GRAPE的成功提醒我们,在进行模型压缩和资源分配时,必须跳出局部视野,进行全局统筹。 自由与约束的辩证关系:极其反直觉的一点是,完全放开全局剪枝的权限反而会导致系统崩溃(预算被DeepSeek最后一层等极度冗余层“吸干”)。这非常具有启发性:在赋予优化算法更高自由度的同时,必须引入宏观的结构性约束(如文中的“全局熵”),才能防止系统陷入病态的极端解,保证鲁棒性。 冗余度的异质性揭示了网络的工作机制:早期 MoE 层冗余度低、后期层冗余度高的现象,侧面印证了 LLM 内部的层级分工特征(早期需要提取多样的基础特征,因此专家差异大;后期处理高级或同质化语义,专家容易趋同)。这为未来设计非对称的、各层专家数量动态变化的下一代 MoE 架构(Heterogeneous MoE)提供了有力的实证启发。

一句话总结:

本文打破了 MoE 模型均匀逐层剪枝的思维定势,指出无约束的全局剪枝会导致模型崩溃这一反直觉现象,并创新性地提出了一种基于全局熵约束的动态冗余感知剪枝策略(GRAPE),在优雅地防止网络结构失衡的同时,显著提升了多款前沿大模型在同等压缩率下的性能表现。

Empirical scaling laws for language models have encouraged the development of everlarger LLMs, despite their growing computational and memory costs. Sparse Mixture-ofExperts (MoEs) offer a promising alternative by activating only a subset of experts per forward pass, improving efficiency without sacrificing performance. However, the large number of expert parameters still leads to substantial memory consumption. Existing pruning methods typically allocate budgets uniformly across layers, overlooking the heterogeneous redundancy that arises in sparse MoEs. We propose GRAPE (Global Redundancy-Aware Pruning of Experts), a global pruning strategy that dynamically allocates pruning budgets based on cross-layer redundancy. Experiments on Mixtral-8x7B, Mixtral-8x22B, DeepSeek-MoE, Qwen-MoE, and GPT-OSS show that, under the same pruning budget, GRAPE consistently achieves the best average performance. On the three main models reported in the paper, it improves average accuracy over the strongest local baseline by 1.40% on average across pruning settings, with gains of up to 2.45%.

https://arxiv.org/abs/2604.06542

3、[CL] Learning to Interrupt in Language-based Multi-agent Communication

D Wang, D Yin, R Desai, L Li…

[CMU & Meta FAIR]

基于语言的多智能体通信中的主动中断学习

要点:

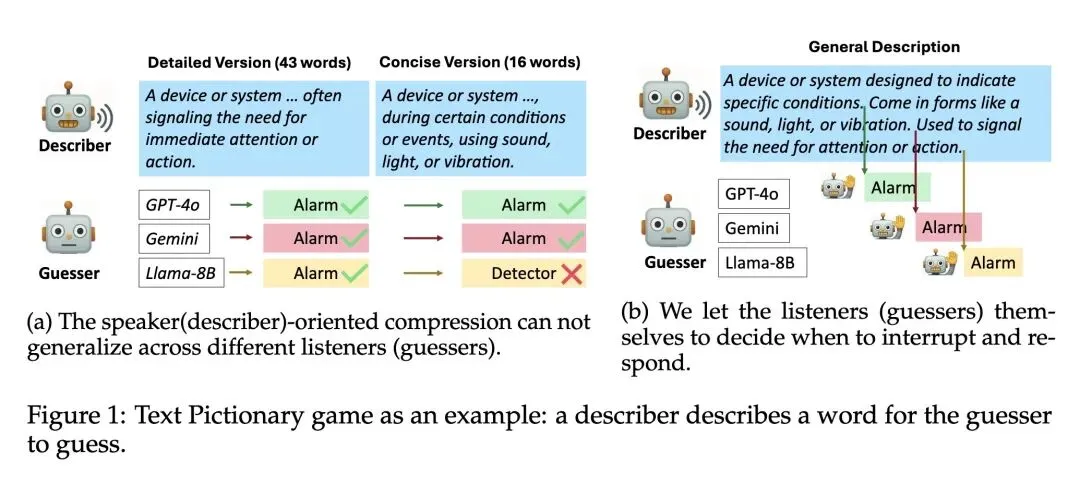

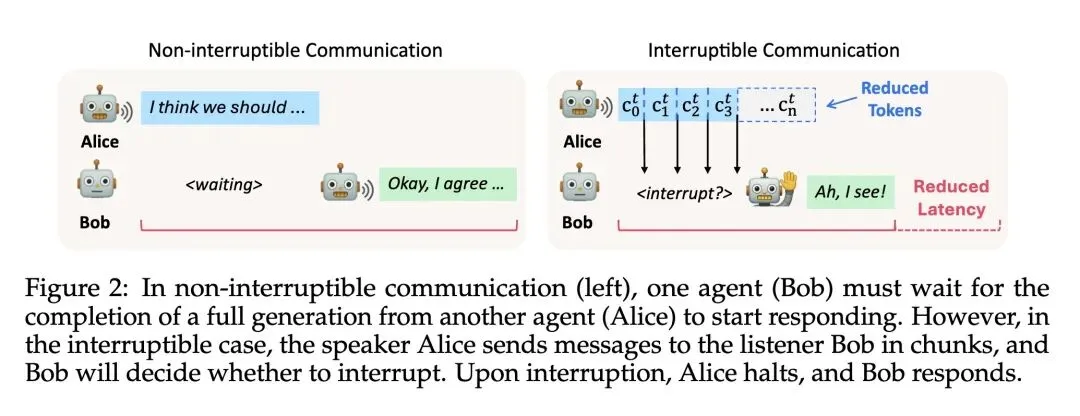

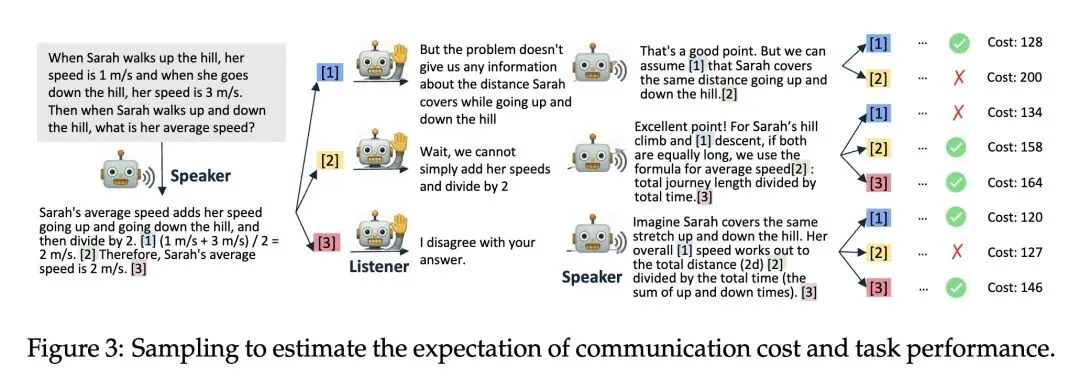

将多智能体通信范式从传统的“说话者导向压缩”(要求说话者简洁)转变为新的“听众导向中断”方法,模仿人类对话机制,允许听众在收集到足够信息时打断说话者。 反直觉发现:直接通过提示词(Prompt)让LLM决定何时中断会遭遇彻底失败。LLM表现出严重的“过度自信偏见(Overconfidence bias)”,即使它们随后的猜测完全错误,它们也会声称自己“完全理解”了上下文。这会导致过早中断(Premature interruption),反而增加了对话轮数,最终大幅增加了总通信成本。 提出了 HANDRAISER,这是一个基于学习的框架,通过评估降低通信成本与保持任务性能之间的收益(Payoff),来预测最佳的中断时机。 采用基于树的采样策略(Tree-based Sampling)来准确估计每个潜在中断点的预期未来通信成本(Token数量)和最终任务成功率,从而为监督微调(SFT)构建高质量的标签数据。 高信息熵观点:HANDRAISER学到的“中断时机”行为展现出极强的零样本泛化能力。在与Llama模型对话中微调出的听众智能体,可以无缝地与完全不同且未见过的闭源模型(如GPT-4o或Gemini)进行中断交互,甚至无需额外训练即可泛化到新任务中。 在多种多智能体场景中证明了其鲁棒性:文本画猜游戏(双智能体)、会议安排(三智能体规划)和 MMLU-Pro 辩论(三智能体推理),在不降低成功率的情况下显著降低了Token成本。

主旨: 本文主要解决基于大语言模型(LLM)的多智能体系统中,由于通信内容冗长导致的上下文过载、计算成本高和延迟大的问题。文章提出了一种可中断的通信框架(HANDRAISER),赋予“听众”智能体在接收信息流时动态判断并打断“说话者”的能力,从而以类似人类自然对话的方式提升多智能体系统的通信效率。

创新:

听众主导的通信控制:打破了以往依赖“说话者”自我压缩信息的局限,创新性地将信息截断的决定权交给“听众”,因为只有听众最清楚自己何时已经获取了足够完成任务的信息。 基于树采样的中断收益评估:将“是否中断”建模为一个权衡未来通信成本和任务胜率的决策过程。通过树搜索对不同中断点的未来轨迹进行展开和评估,量化了中断操作的真实收益,从而为模型训练提供了科学的监督信号。

贡献:

揭示并量化了原生LLM在自我评估理解程度时的“盲目自信”缺陷,解释了为何简单的Prompt无法实现高效的中断机制。 构建了首个多智能体可中断通信框架,并提出了一种通过强化/监督信号学习最佳中断点的系统性方法(HANDRAISER)。 在三个不同复杂度的多智能体环境(双人游戏、三人调度、三人辩论)中进行了广泛的实证测试,验证了该机制的有效性,并证明了该元技能在不同底层模型(Llama、GPT-4o、Gemini)之间的可迁移性。

提升:

在维持甚至略微提升任务成功率(Success Rate)的前提下,HANDRAISER 相比于无中断的通用基线(Generic),将文本画猜(Text Pictionary)的通信成本降低了24.3%,会议安排(Meeting Scheduling)降低了23.4%,多智能体辩论(MMLU-Pro-Debate)降低了48.9%。全面减少了系统的Token消耗和通信延迟。

不足:

数据构建成本高昂:用于评估中断收益的树采样(Tree sampling)机制计算复杂度极高(呈指数级增长),在大规模部署或实时在线学习时存在算力瓶颈。 复杂场景下的轮数膨胀:在多个智能体都可以互相打断的级联中断场景(如三个智能体自由讨论)中,虽然单次消息的成本减半,但会导致通信轮数显著增加(从13.39轮增加到20.29轮),仍需进一步优化以控制总成本。 缺乏说话者的拒绝机制:目前的框架假设说话者总是被动接受中断,而在真实人类交互中,说话者可以拒绝中断(例如:“让我先说完”),引入双向的博弈和协商机制可能会使通信更加高效和自然。

心得:

LLM的“自我认知幻觉”是系统设计的地雷:论文揭示了一个非常有趣的现象——LLM在猜错答案时依然坚称自己“完全理解(fully understand)”。这深刻警示我们在设计Agent系统时,不能轻信LLM输出的自我评估(Self-reflection/Self-confidence),必须像本文一样引入基于客观结果(未来Cost和Reward)的外部校验机制。 通信效率的本质在于“信息对齐”而非“信息压缩”:传统的思路总是想方设法让说话者把话变短(压缩),但这往往会损失对某些听众至关重要的细节。本文启发我们,最优雅的效率优化其实是“动态对齐”——只要听众听懂了,通信就应该立刻停止。将视角从Speaker转移到Listener,为未来的Agent交互协议设计打开了全新格局。 “交流元技能”具备跨模型普适性:一个在Llama上学会“察言观色、适时打断”的Agent,面对完全不同风格的GPT-4o或Gemini时依然能精准把握打断时机。这表明像“何时该打断”这种交流元技能,是大语言模型空间中一种底层的、模型无关的逻辑规律,未来有望提取出通用的“Agent社交模块”直接插件化部署。

一句话总结:

本文提出了一种创新的“听众主导”中断通信框架HANDRAISER,通过基于树采样的收益评估成功克服了LLM因盲目自信导致的过早中断问题,使多智能体能够像人类一样在恰当时机打断对话,在不牺牲任务成功率的前提下,最高将通信成本削减了近一半。

Multi-agent systems using large language models (LLMs) have demonstrated impressive capabilities across various domains. However, current agent communication suffers from verbose output that overload context and increase computational costs. Although existing approaches focus on compressing the message from the speaker side, they struggle to adapt to different listeners and identify relevant information. An effective way in human communication is to allow the listener to interrupt and express their opinion or ask for clarification. Motivated by this, we propose an interruptible communication framework that allows the agent who is listening to interrupt the current speaker. Through prompting experiments, we find that current LLMs are often overconfident and interrupt before receiving enough information. Therefore, we propose a learning method that predicts the appropriate interruption points based on the estimated future reward and cost. We evaluate our framework across various multi-agent scenarios, including 2-agent text pictionary games, 3-agent meeting scheduling, and 3-agent debate. The results of the experiment show that our HANDRAISER can reduce the communication cost by 32.2% compared to the baseline with comparable or superior task performance. This learned interruption behavior can also be generalized to different agents and tasks.

https://arxiv.org/abs/2604.06452

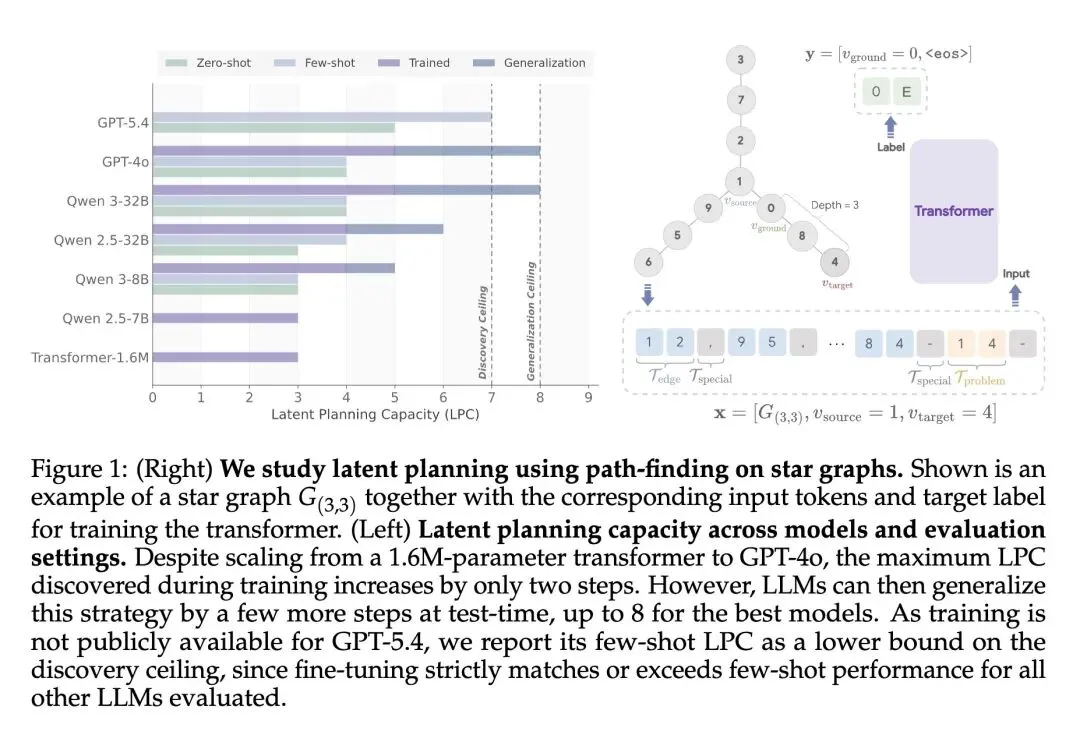

4、[LG] The Depth Ceiling: On the Limits of Large Language Models in Discovering Latent Planning

Y Xu, P Jettkant, L Ruis

[University of Cambridge & Imperial College London & MIT]

深度天花板:论大语言模型在挖掘潜在规划中的局限性

要点:

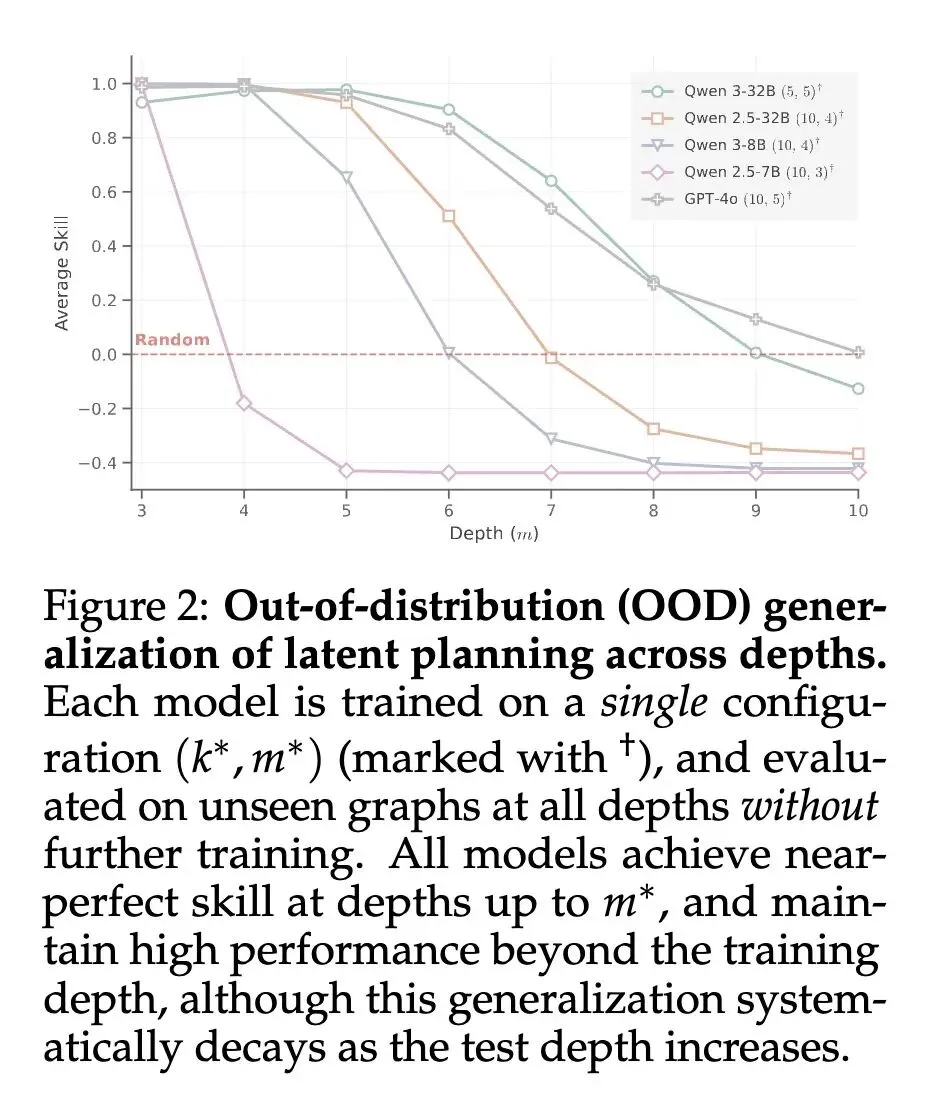

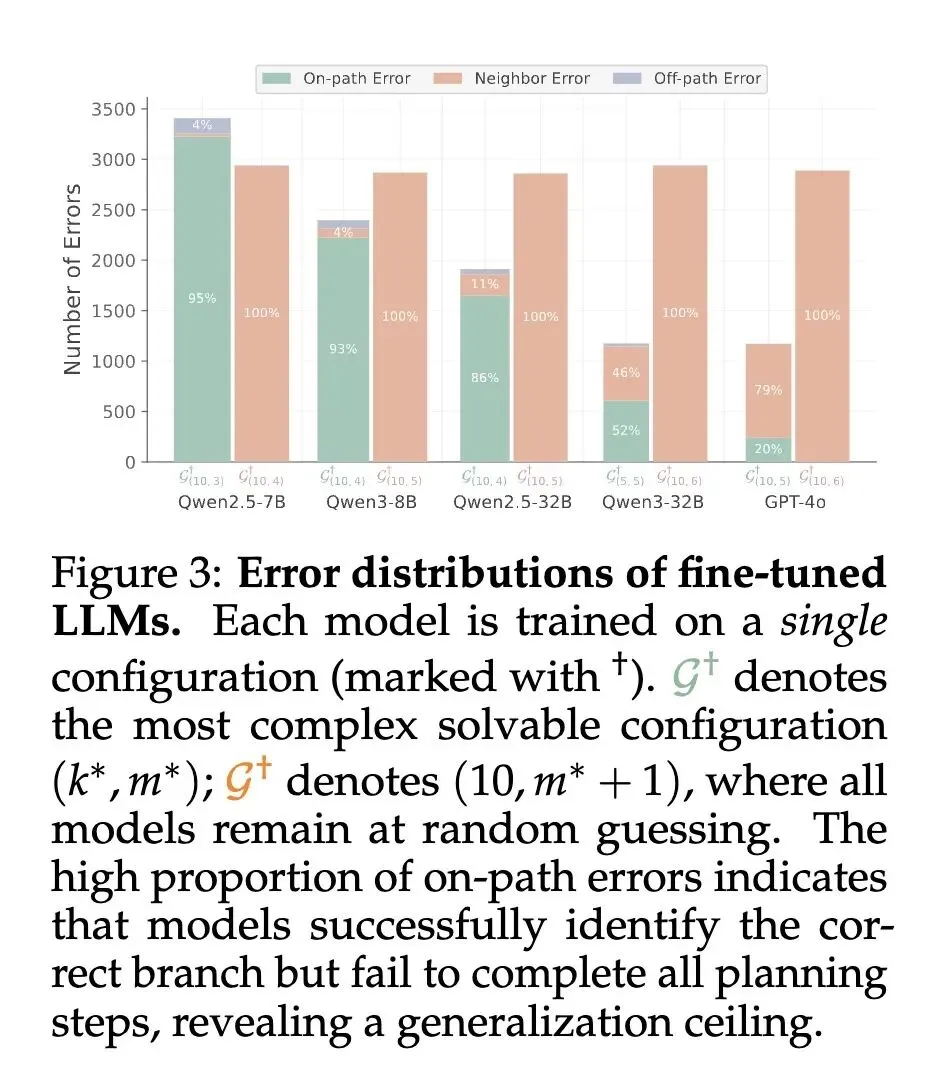

挑战隐式推理中的“缩放定律(Scaling Law)”:反直觉地揭示了巨大的参数规模扩张几乎无法提升隐式规划的深度。从从零训练的160万参数微型Transformer到GPT-4o,模型能发现的隐式规划深度仅从3步增加到5步(GPT-5.4在少样本下最高达到7步)。 调和了以往文献的矛盾:证明了小型Transformer在标准的下一个Token预测和无中间步骤监督下,确实能够自主发现多步隐式规划策略(最高深度为3),反驳了此前认为其会完全失败的观点。但模型会遇到极其陡峭的“深度天花板”。 “策略发现”与“策略执行”的脱节:发现了一个高信息熵的现象——模型的“泛化天花板”高于其“发现天花板”。虽然LLM无法通过直接训练学会6-8步的规划策略,但如果让它在5步的数据上训练,它在测试时能零样本(zero-shot)执行高达8步的规划。 参数扩展解决了“广度”而非“深度”:证明了增加模型参数主要提升了模型处理更多分支的能力(规划广度),而没有真正增加序列前瞻的步数(规划深度)。 “路径上(On-path)”错误证实了深度瓶颈:错误分析表明,微调后的LLM在更深的任务上失败时,犯的是“路径上”的错误(成功找到了正确的分支,但未能走完所有步数),证明模型懂算法,只是耗尽了隐式计算的极限。 密集监督可轻易绕过瓶颈:当允许模型外化其推理过程(显式思维链 CoT)时,它们能轻松解决深达20步的规划任务。这证明真正的瓶颈在于通过稀疏的、仅包含最终答案的损失来发现策略,而非任务本身太难。 对AI安全(思维链监控)的重大利好:为AI安全提供了关键的实证支持。由于LLM在隐式空间(单次前向传播)中进行规划时存在严格的天花板,它们必须将复杂的多步推理外化。这确保了潜在的欺骗性或恶意规划无法轻易被隐藏,使得“思维链监控(CoT Monitoring)”成为一种切实可行的审查策略。

主旨: 本文旨在探究大型语言模型(LLMs)在单次前向传播(不依赖显式思维链)中进行隐式规划(Latent Planning)的能力极限。通过使用严格控制所需前瞻步数的“星型图寻路”任务,并仅对最终答案进行监督,研究揭示了LLM在隐式空间中发现和执行多步规划策略时存在一个极难通过扩大模型规模来突破的“深度天花板”。

创新:

受控的任务设计:采用高度对称的星型图(Star Graph)寻路任务,彻底排除了模型利用局部启发式线索(Local heuristics)走捷径的可能,确保模型必须进行真正的多步前瞻规划。 剔除课程学习的纯粹探究:与以往混合深浅任务的训练不同,本文强制模型仅在单一固定深度的任务上训练,严格剥离了模型“通过简单任务引导(Bootstrapping)”的能力,直击其在稀疏奖励下自主“发现”策略的极限。 细粒度错误分析与注意力探测:通过定义“返回率(Backtracking Ratio)”和“路径上错误(On-path errors)”,创新性地从模型内部注意力和外部输出行为双重证实了模型确实学到了反向回溯算法,只是被隐式计算深度所限制。

贡献:

量化了跨尺度的隐式规划极限:明确界定了不同规模模型的隐式规划天花板:小型Transformer为3步,微调后的GPT-4o/Qwen-32B为5步,少样本提示下的GPT-5.4为7步。 揭示了广度与深度的本质差异:证明了模型参数的扩展极大地提高了处理复杂拓扑(分支数)的能力,但在突破推理序列深度上却收效甚微。 为AI对齐提供了理论与实证基础:证明了LLM无法在内部隐式隐藏复杂的长序列规划,从侧面证实了“思维链监控(CoT Monitoring)”作为AI监督机制的有效性和可靠性。

提升:

发现了模型强大的越级泛化能力(OOD Generalization):微调在深度为5的任务上的模型,在测试时展现出了在深度为6、7、8的任务上显著高于随机水平的预测提升,将模型的“泛化天花板”(8步)推高到了“发现天花板”(5步)之上。 引入显式CoT与隐式CoT(ICoT):证明了在显式监督下,模型能迅速将规划深度提升至20步;且通过ICoT技术,小型模型的隐式规划能力从3步提升到了6步(针对双分支图)。

不足:

任务单一性:星型图是一个极其干净且缺乏局部启发信号的极端环境,现实世界中的推理任务可能包含更密集的隐式信号,从而可能部分缓解这种策略发现的瓶颈。 闭源模型的不可干预性:受限于API,无法对最前沿的模型(如GPT-5.4)进行大规模微调,只能用Few-shot(少样本提示)作为能力下界的代理评估。 未探讨其他优化目标:本文结论主要局限于标准的下一个Token预测(Next-token prediction)和交叉熵损失,未深入探讨强化学习(RL)或其他定制化隐式推理损失是否能打破这一天花板。

心得:

“大力出奇迹”在隐式推理上失灵了:最让人反直觉的启发是,相差成千上万倍参数量的1.6M模型和GPT-4o,在隐式规划深度上仅仅差了2个步数(3步 vs 5步)。这说明Next-token prediction这种训练范式在跨越长周期的时间信用分配(Credit Assignment)上存在根本性缺陷,单纯堆算力和参数无法跨越“深度天花板”。 “学会”比“做到”更难:模型在5步数据上训练后,其实已经具备了在隐式空间执行8步规划的硬件能力,但你如果直接拿8步的数据去训练它,它却什么都学不到(退化为随机猜测)。这深刻揭示了当前AI优化的一个痛点:稀疏的最终奖励无法有效指导复杂算法的发现过程,过程监督(PRM)或思维链(CoT)不可或缺。 局限性反而成为了安全性的护城河:这篇论文对AI安全领域是一针强心剂。因为模型无法在“脑内”(隐式空间)完成复杂的长线阴谋规划,它如果想做坏事,就必须把多步推理写在“草稿纸”(思维链)上。这使得人类监督者完全可以通过审计思维链来及时掐断危险行为。模型的缺点,恰恰成了人类控制它的后门。

一句话总结: 本文通过星型图寻路任务揭示了LLM在单次前向传播中发现隐式规划策略存在严格的“深度天花板”,参数规模的暴涨只能提升规划广度而非深度,这一局限性反直觉地证明了模型无法在内部隐藏复杂的长期阴谋,从而为“思维链监控”作为AI安全对齐手段提供了强有力的实证保障。

The viability of chain-of-thought (CoT) monitoring hinges on models being unable to reason effectively in their latent representations. Yet little is known about the limits of such latent reasoning in LLMs. We test these limits by studying whether models can discover multi-step planning strategies without supervision on intermediate steps and execute them latently, within a single forward pass. Using graph path-finding tasks that precisely control the number of required latent planning steps, we uncover a striking limitation unresolved by massive scaling: tiny transformers trained from scratch discover strategies requiring up to three latent steps, fine-tuned GPT-4o and Qwen3-32B reach five, and GPT-5.4 attains seven under fewshot prompting. Although the maximum latent planning depth models can learn during training is five, the discovered strategy generalizes up to eight latent steps at test-time. This reveals a dissociation between the ability to discover a latent strategy under final-answer supervision alone and the ability to execute it once discovered. If similar limits hold more broadly, strategies requiring multiple coordinated latent planning steps may need to be explicitly taught or externalized, lending credence to CoT monitoring.

https://arxiv.org/abs/2604.06427

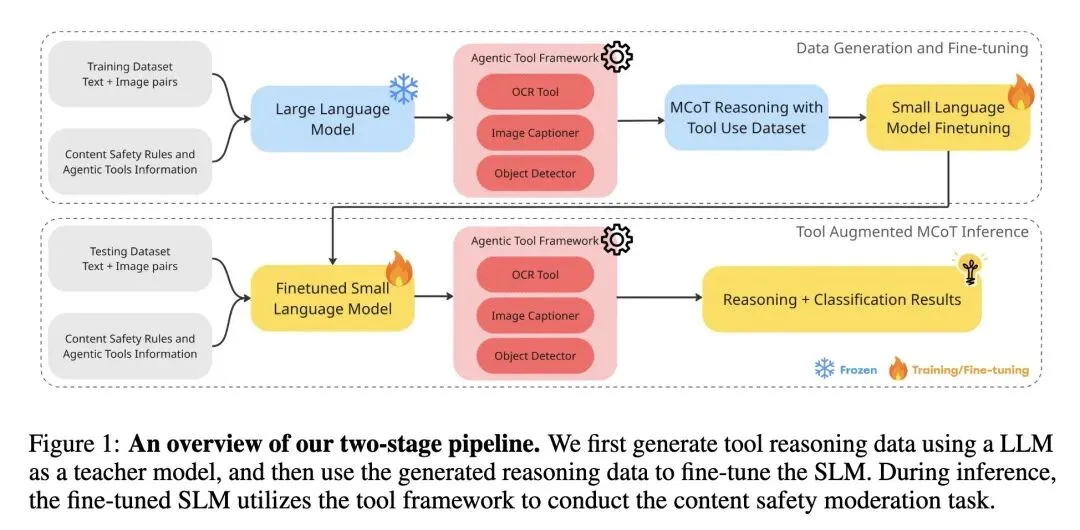

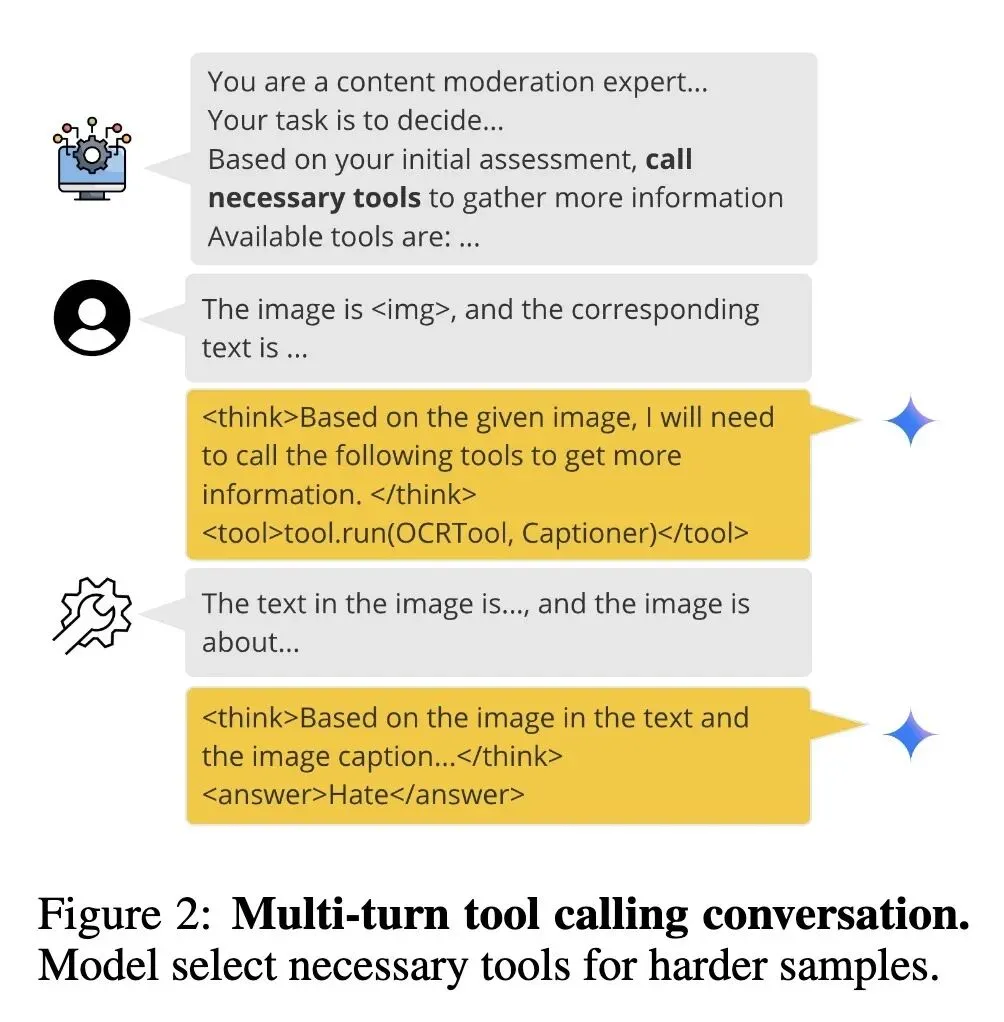

5、[CL] Tool-MCoT: Tool Augmented Multimodal Chain-of-Thought for Content Safety Moderation

S Zhang, D Zhou, Y Liu, Y Yang…

[Google & Stanford University]

Tool-MCoT:面向内容安全审核的工具增强型多模态思维链

要点:

针对大型语言模型(LLM)在实时多模态内容安全审核中部署成本高、延迟大的痛点提出了解决方案。 提出了 Tool-MCoT,这是一个微调后的小型语言模型(SLM,具体为 Gemma3-4B-IT),能够通过调用外部视觉工具框架来执行智能体级别的推理。 外部工具框架包含三个专用工具:光学字符识别(OCR)、图像描述器(Image Captioner)和目标检测器(Object Detector),用于提取细粒度的视觉和文本信息以辅助推理。 揭示了合成数据生成中的一个关键缺陷:如果在生成推理轨迹时向教师LLM提供真实标签(如STaR方法),会导致模型“强行凑答案”,生成不自然、低质量的推理。作者改为无正确答案提示下的多重采样,并过滤出正确的推理轨迹。 采用了稳健的两阶段 SLM 微调流水线:首先在生成的Tool-MCoT数据集上进行 LoRA 微调,然后使用结合了格式和答案奖励的组相对策略优化(GRPO)进行进一步强化学习。 高信息熵/反直觉发现:传统观念认为小模型在工具调用和规划方面能力薄弱。然而,本文证明了4B参数的SLM不仅能掌握工具调用,还能学会“选择性调用”——对简单样本直接跳过工具,对复杂样本动态选择特定工具(例如仅对有叠加文本的图片调用OCR),在保持高准确率的同时大幅降低了计算开销。

主旨: 本文旨在解决多模态内容安全审核中,大型视觉语言模型(VLM)计算成本过高且难以大规模部署的问题。为此,作者提出了 Tool-MCoT 框架,通过提取大模型(Gemini 2.0 Flash)的工具增强多模态思维链(MCoT)推理数据,结合 LoRA 和 GRPO 技术,成功将工具调用和复杂推理能力蒸馏到一个小型语言模型(Gemma3-4B-IT)中,实现了高准确率与低计算成本的平衡。

创新:

专为安全审核设计的智能体工具链:将 OCR、图像描述和目标检测集成到一个专为小模型服务的轻量级智能体框架中,使其能够突破自身视觉编码器的模态理解极限。 改进的推理数据蒸馏策略:摒弃了主流的 STaR(Self-Taught Reasoner)范式中“前置提供正确答案”的做法,避免了模型逻辑上的“事后诸葛亮”,保证了合成推理轨迹的自然性和高质量。 选择性工具路由机制(Selective Tool Use):不强制模型在所有情况下都调用工具,而是训练 SLM 根据输入难度“见机行事”,学会动态决定“何时调用”以及“调用哪个”,极大地优化了推理延迟。 小模型上的强化学习后训练:在SLM上成功串联了 LoRA SFT 与 GRPO(Group Relative Policy Optimization),证明了现代 RLHF 技术在激发小模型系统性思考( <think>)和工具使用方面的巨大潜力。

贡献:

构建并验证了一个专门针对内容安全审核的多模态智能体工具框架。 证明了通过高质量的合成数据和 GRPO 强化学习,参数量仅为 4B 的小模型(SLM)完全可以胜任复杂的工具调用和思维链推理任务。 提出并验证了“选择性工具调用”的训练方法,在保证审核性能基本不降的前提下,将某些昂贵工具(如 OCR 和目标检测)的调用率压缩至 20%-26%,极具工业落地价值。

提升:

准确率与F1分数大幅跃升:在未引入工具前,基础的 Gemma3-4B-it 在 Hateful Memes 数据集上的准确率为 64.6%。经过 LoRA + GRPO 结合 Tool-MCoT 微调后,准确率飙升至 80.8%(甚至超过了直接使用GPT-4o且不带工具的性能)。 推理效率显著优化:在“选择性调用”模式下,模型在 MMHS150K 数据集上保持了与“强制全调用”几乎相同的准确率(63.4% vs 65.5%),但大幅削减了不必要的 API 请求,显著降低了延迟和算力成本。

不足:

外部工具本身的延迟瓶颈:尽管 SLM 本身速度快,但框架依然依赖外部 OCR 和目标检测模型的 API 响应速度,这在极高并发的实时审核场景下仍可能是隐患。 选择性调用策略的硬编码痕迹:在构建选择性工具训练数据时,作者依赖了一些硬性规则(如:检测到复杂布局才用目标检测,永远调用图像描述等),这可能限制了模型自主探索出更优路由策略的上限。 模型架构的局限探讨较少:实验仅在 Gemma3-4B-IT 上进行,未验证该方法在不同架构或其他参数量级(如 1B 或 8B)模型上的泛化性。 缺乏端到端的联合优化:未来工作(作者也在结论中提及)若能将推理头(Reasoning Head)与分类头联合训练,可能会比当前纯粹依靠文本生成的分类更加高效。

心得:

“小模型+好工具+慢思考”是工业落地的黄金法则:这篇论文极具工程启发性。在实际业务中,不可能处处部署千亿级大模型。让一个小巧的模型学会使用外部成熟的工具(OCR/检测器),并给它一点时间进行思维链推理(GRPO加持),其表现完全能越级挑战那些昂贵的通用大模型。 合成数据不能“开卷考试”:作者发现给 Teacher LLM 提供真实标签会导致其生成“不自然的虚假推理”,这是一个非常宝贵的实践经验。在构建 CoT(思维链)数据集时,引导模型真正去推导,而不是基于答案反推过程,是保证蒸馏质量的核心。 “知道何时不作为”是智能的体现:让模型学会“选择性使用工具”非常反直觉但极其重要。早期的Agent研究倾向于让模型把所有工具都用一遍,但这在成本上是灾难性的。教会模型评估样本难度,遇到简单问题直接秒答,遇到复杂问题再调用重型工具,这才是走向成熟、经济的AI系统的必经之路。

一句话总结: Tool-MCoT 通过摒弃传统“前置答案”的蒸馏方式,利用高质量的合成推理数据和 GRPO 强化学习,成功赋予了小型语言模型调用外部视觉工具和进行思维链推理的能力,并通过“选择性工具路由”机制,在多模态内容审核任务中实现了高准确率与低推理成本的完美平衡。

The growth of online platforms and user content requires strong content moderation systems that can handle complex inputs from various media types. While large language models (LLMs) are effective, their high computational cost and latency present significant challenges for scalable deployment. To address this, we introduce Tool-MCoT, a small language model (SLM) fine-tuned for content safety moderation leveraging external framework. By training our model on tool-augmented chain-of-thought data generated by LLM, we demonstrate that the SLM can learn to effectively utilize these tools to improve its reasoning and decision-making. Our experiments show that the fine-tuned SLM achieves significant performance gains. Furthermore, we show that the model can learn to use these tools selectively, achieving a balance between moderation accuracy and inference efficiency by calling tools only when necessary.

https://arxiv.org/abs/2604.06205

夜雨聆风

夜雨聆风