大模型智能体与推理优化:RL智能体推理坍塌与模板数据依赖;并行自我改进智能体学习;带形式化验证的中自我进化智能体;图CoT剪枝

RAGEN-2: Reasoning Collapse in Agentic RL

2026-04-07|NWU(USA), UIUC, Independent, ICL(Imperial), Oxford U, UW, Microsoft, Stanford|🔺44

http://arxiv.org/abs/2604.06268v1

https://huggingface.co/papers/2604.06268

https://ragen-ai.github.io/v2/

研究背景与意义

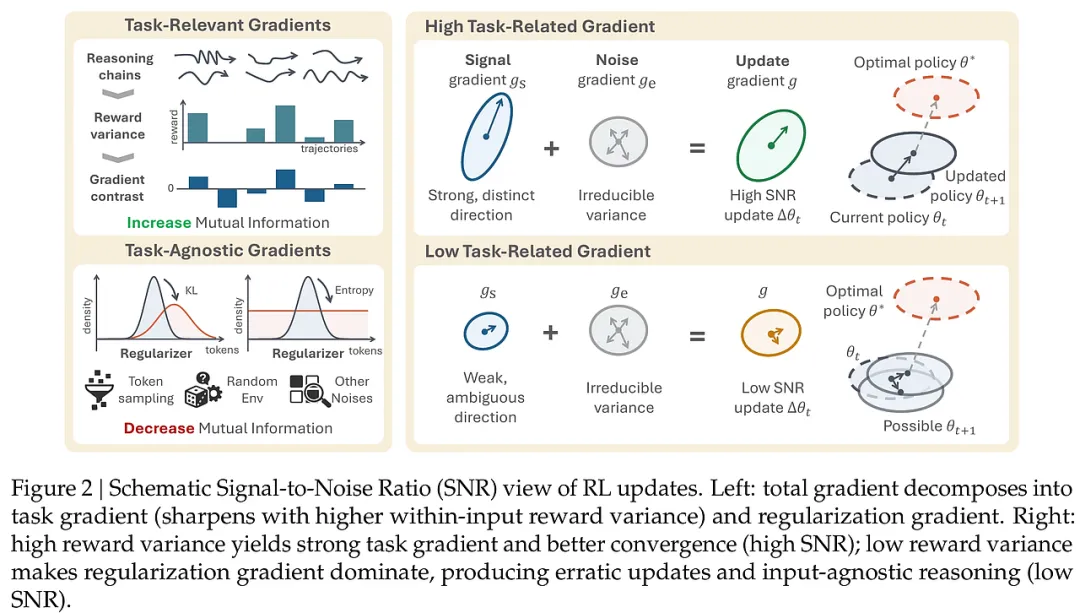

在强化学习(RL)驱动的大语言模型智能体(Agent)训练中,研究者长期面临一个诡谲的现象:模型生成的推理链条看似逻辑严密、辞藻丰富,但在实际任务中的表现却极不稳定。传统上,学术界习惯于利用“信息熵(Entropy)”来衡量推理过程的健康度,认为高熵代表了模型具备探索能力和多样性。然而,这种监控方式存在一个致命的盲点。

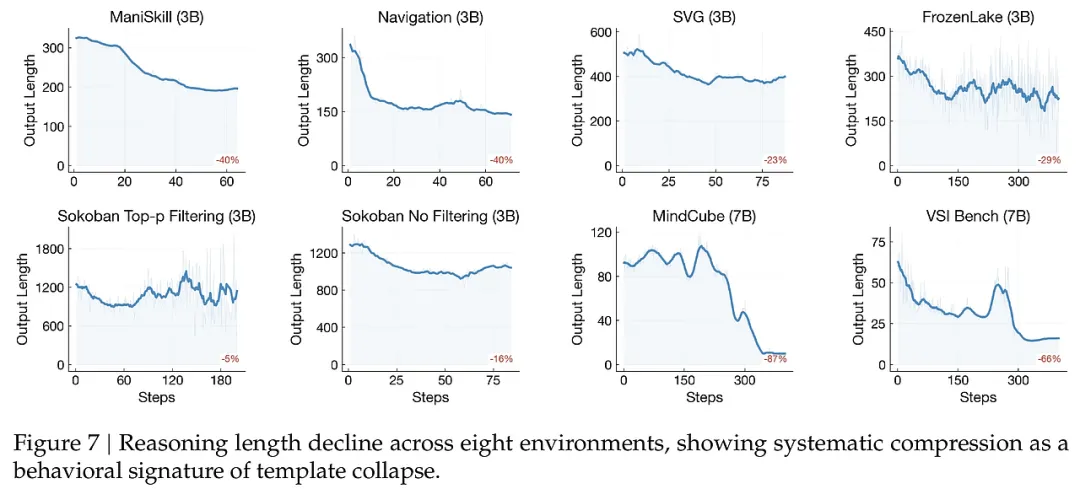

本研究深刻指出,现有的评估体系忽略了推理与输入之间的耦合性。研究团队发现了一种被称为“模板坍塌(Template Collapse)”的新型失败模式:模型学会了一套精美但万能的“推理模板”,这些模板在单一输入下显得多样化(高熵),但面对不同输入时却表现得完全一致,本质上是模型在“背诵脚本”而非“按需思考”。这种坍塌在传统的熵指标下是不可见的,导致训练在看似正常的指标中走向平庸。

这一发现的意义在于,它重新定义了智能体推理质量的评价维度。通过揭示“模板坍塌”这一隐形杀手,研究不仅解释了为何长程推理智能体难以训练,更提供了一套从信息论出发的诊断工具,为构建真正具备环境感知能力和动态决策能力的智能体奠定了理论基础。

研究方法与创新

本研究的核心贡献在于构建了一套从“诊断”到“解释”再到“干预”的完整框架,其深度与创新性体现在以下三个维度:

1. 诊断创新:从信息熵到互信息(Mutual Information)的跃迁 研究者敏锐地察觉到,推理质量不应只看“多样性”(即熵 $H(Z|X)$),更应看“相关性”。他们引入了互信息 $I(X;Z)$ 作为核心指标,将其拆解为:推理的边缘熵(整体多样性)减去条件熵(给定输入下的多样性)。 为了在不增加额外模型开销的前提下估算互信息,团队创新性地提出了“批次内交叉评分(In-Batch Cross-Scoring)”方法。其逻辑极具物理直觉:如果一段推理链条 $Z$ 确实是针对输入 $X$ 产生的,那么它在 $X$ 下的似然概率应远高于在批次内其他输入下的概率。通过这种“检索式”的对比,研究者定义了“检索准确率(Retrieval-Acc)”等代理指标,精准地捕捉到了模型何时开始脱离输入、滑向模板化。

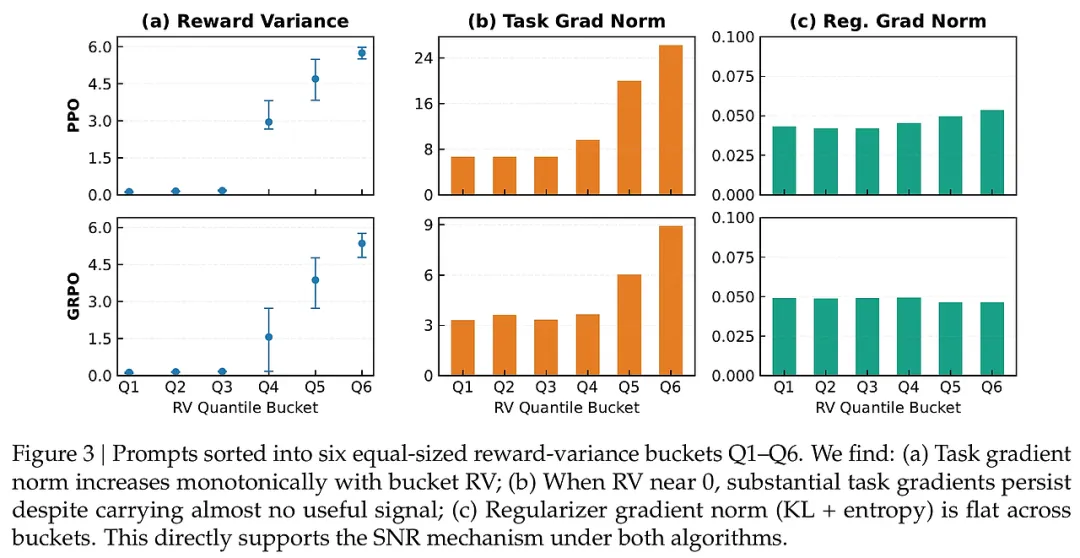

2. 机制解释:信噪比(SNR)视角的梯度解构 为什么模型会产生模板坍塌?研究者通过梯度分解给出了一个极具洞察力的解释。在RL更新中,总梯度由“任务梯度(信号)”和“正则化梯度(噪声)”组成。

任务梯度:源于不同轨迹间的奖励差异(奖励方差)。 正则化梯度:如KL散度和熵惩罚,它们是“输入无关”的,其作用是均匀地压缩或扩张所有推理路径。 研究发现,当奖励方差较低时(即模型分不清哪条路更好),任务梯度会迅速萎缩,而正则化梯度依然强劲。此时,信噪比极低,正则化项反客为主,强迫模型生成符合正则化要求(如高熵、流畅)但与输入脱节的模板。这一结论通过柯西-施瓦茨不等式在数学上得到了严谨证明,揭示了模板坍塌本质上是“噪声淹没了信号”。

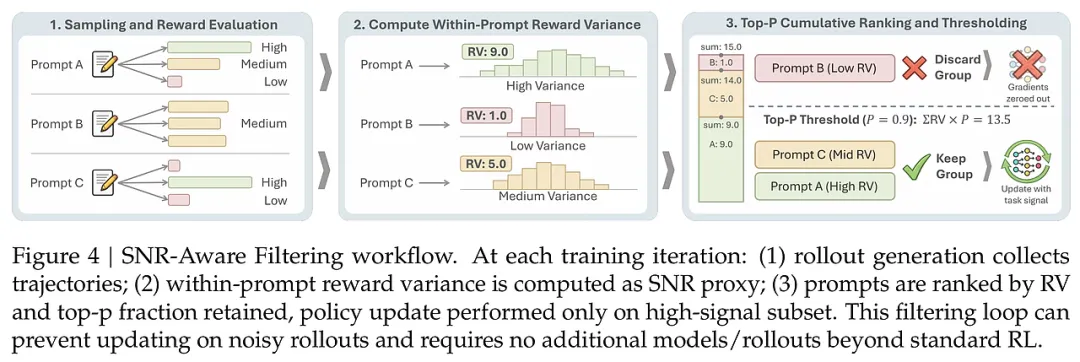

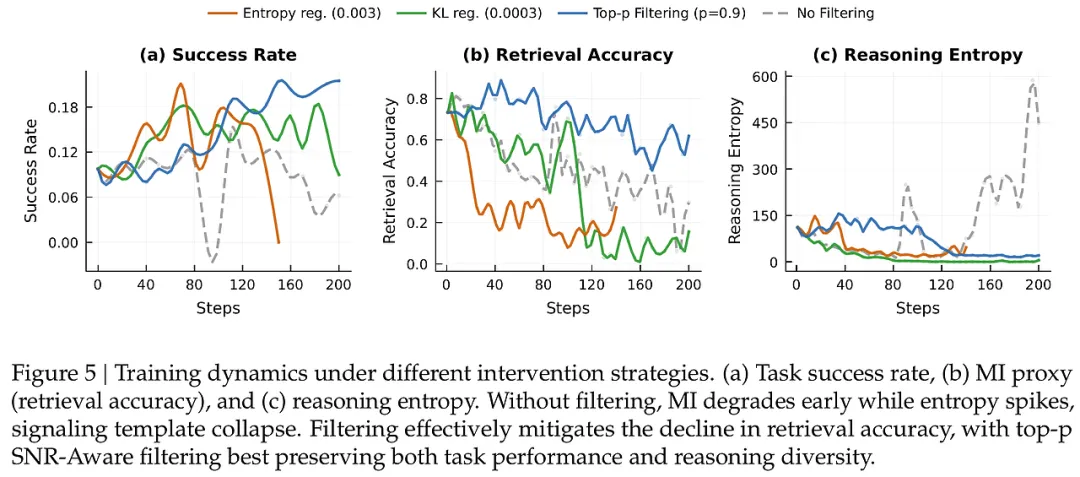

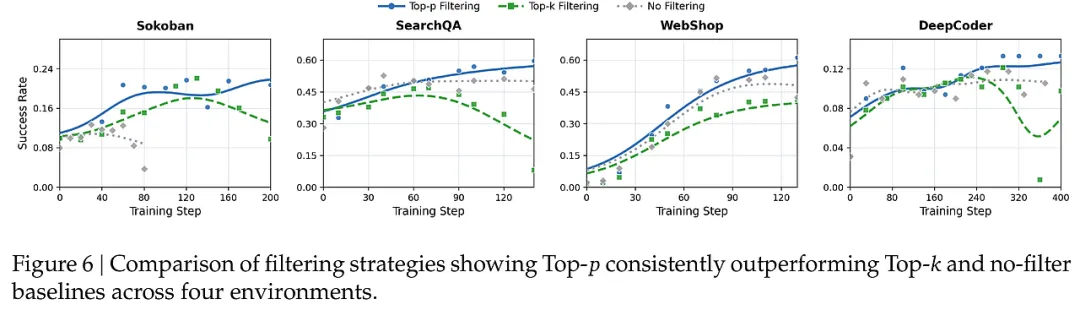

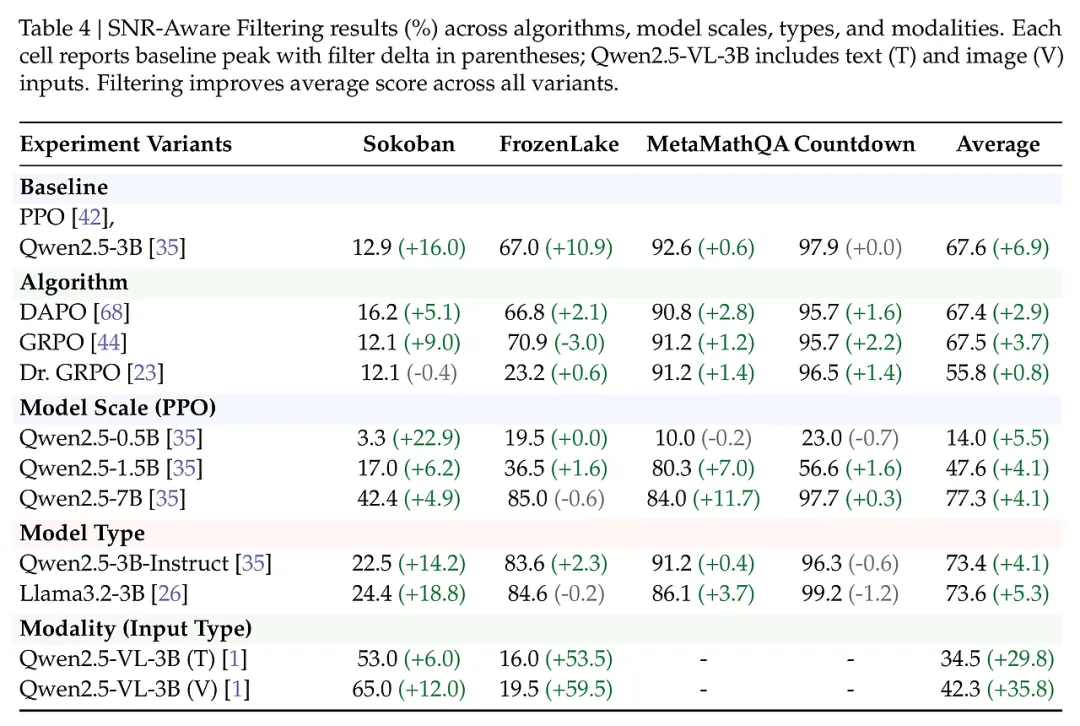

3. 干预策略:信噪比感知过滤(SNR-Aware Filtering) 基于上述发现,研究者提出了一种轻量级且高效的干预手段。在每一次训练迭代中,不再盲目地利用所有数据进行更新,而是先计算每个提示词(Prompt)下的奖励方差。 团队采用了类似“核采样(Nucleus Sampling)”的逻辑,实施Top-p 过滤:仅保留那些奖励方差较高、即“信号强度”达标的提示词进行参数更新。这种方法就像是在嘈杂的电波中只截取清晰的信号段,有效地防止了低质量、高噪声的更新对模型推理逻辑的侵蚀。更精妙的是,这种方法通过重新分配计算预算(增加单提示词的采样数,减少提示词总量),在不增加总计算量的前提下,显著提升了训练的稳定性。

实验设计与结果分析

研究团队在极其广泛的维度上验证了 RAGEN-2 框架的有效性。实验涵盖了从简单的网格导航(FrozenLake)到复杂的逻辑推演(Sokoban)、符号数学(MetaMathQA)、网页导航(WebShop)以及代码执行(DeepCoder)等七大任务场景。

实验结果显示出压倒性的优势: 首先,在诊断效力上,互信息(MI)指标与最终任务表现的相关性(Spearman相关系数达+0.39)远高于传统的信息熵(相关系数为负值)。这有力地证明了 MI 才是智能体训练的“真北”指标。

其次,在性能提升上,SNR-Aware Filtering 在所有算法(PPO, GRPO, DAPO等)、所有模型规模(从0.5B到7B)以及不同模态(纯文本与多模态VL)下均表现出显著的增益。特别是在具有挑战性的 FrozenLake 任务中,该方法将成功率提升了超过50%。

最后,在计算效率方面,实验证明了通过过滤低信噪比样本,模型不仅学得更好,而且学得更快。由于减少了无效梯度的计算,单步训练时间缩短了26%至41%,实现了真正意义上的“降本增效”。

结论与展望

RAGEN-2 不仅仅是对 RAGEN 框架的迭代,更是对大规模强化学习训练方法论的一次深刻反思。它成功识别并解决了 Agent 训练中长期存在的“模板坍塌”隐疾,通过引入互信息诊断和信噪比感知过滤,为推理型智能体的稳定性训练提供了科学的导航图。

研究贡献总结:

定义了新问题:识别了掩盖在多样性表象下的“模板坍塌”模式。 提供了新工具:开发了无需额外模型的互信息估算代理指标。 发现了新机制:从梯度动力学角度揭示了低信噪比导致推理退化的原理。 实现了新突破:提出了 SNR 感知过滤算法,全面提升了多任务场景下的训练效率。

未来展望: 尽管 RAGEN-2 在当前规模下取得了卓越成效,但如何在高阶逻辑推理和更长程的开放域任务中动态调整信噪比阈值,仍是值得探索的方向。此外,这种基于信息流动的诊断思路,或许可以进一步扩展到预训练阶段,用于评估数据质量对模型底层推理架构的影响。这项工作为通往更具韧性、更具“思考深度”的通用人工智能(AGI)迈出了坚实的一步。

Combee: Scaling Prompt Learning for Self-Improving Language Model Agents

2026-04-05|UC Berkeley, Stanford, Tensormesh, Gradient Network|🔺22

http://arxiv.org/abs/2604.04247v1

https://huggingface.co/papers/2604.04247

https://github.com/gepa-ai/gepaandhttps://github.com/ace-agent/ace

研究背景与意义

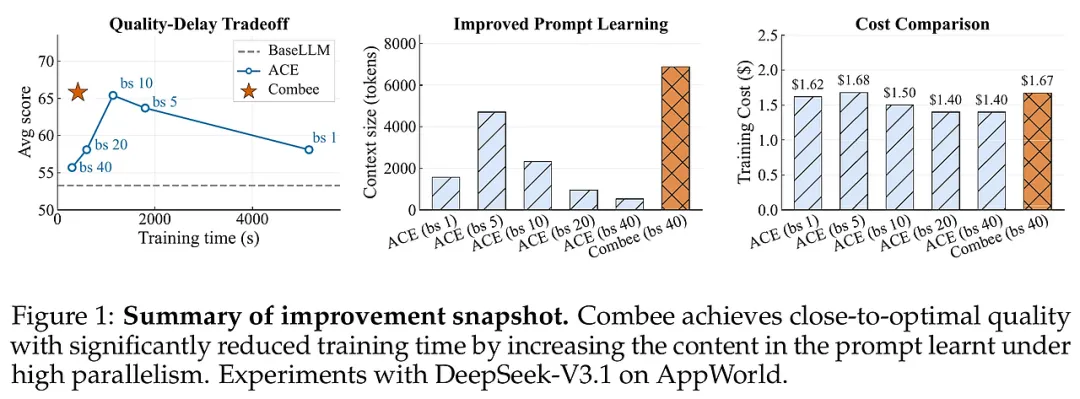

在当前大语言模型(LLM)的研究版图中,让智能体(Agent)具备“边做边学”的能力已成为前沿趋势。传统的提示词学习(Prompt Learning)方法,如 ACE 或 GEPA,允许智能体从执行轨迹中提取知识并沉淀为“剧本”或“规则”,从而在不调整模型参数的情况下实现自我进化。然而,这些方法大多局限于单线程或低并发环境,就像一个只能通过复盘单场比赛来学习的运动员。

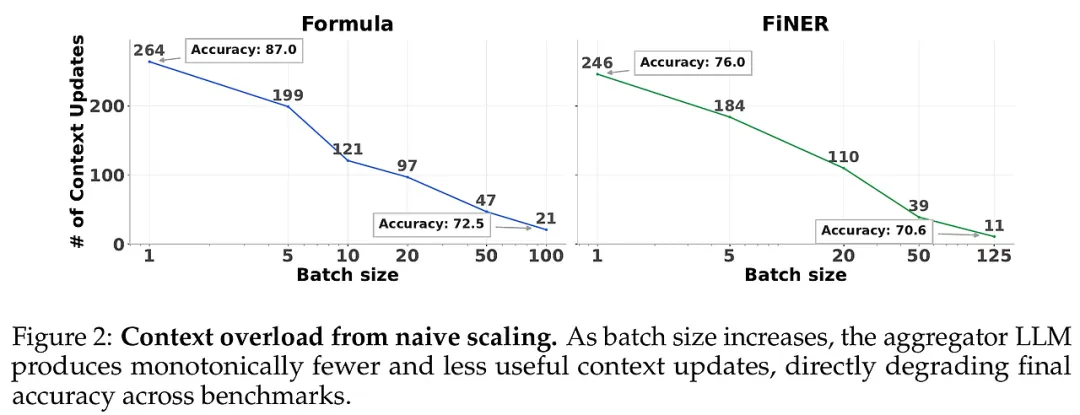

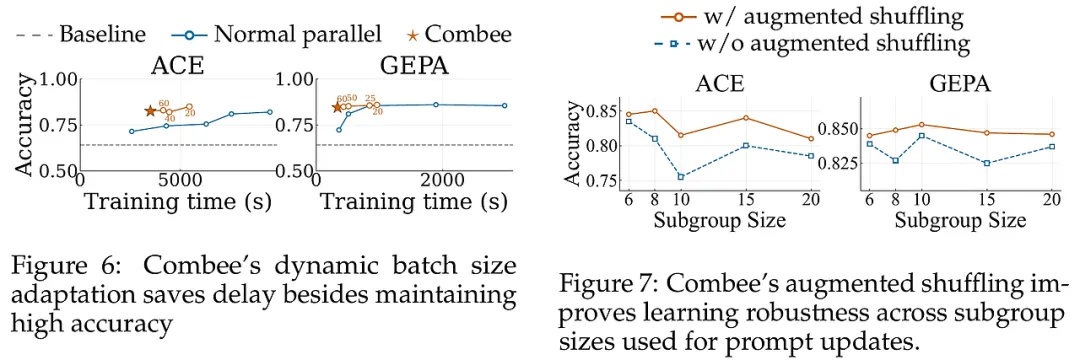

当我们将视野投向大规模并行智能体系统时,挑战接踵而至。研究团队发现,简单地增加并行处理的批次大小(Batch Size)会导致严重的“上下文过载”现象:负责汇总经验的 LLM 在面对海量反馈时,会像处理过载信息的经理一样,变得只会说“注意细节”之类的废话,而丢失了那些真正能提升性能的高价值特定策略。这种“平庸化”导致性能大幅下滑,在 Formula 等复杂任务中,准确率甚至会从 87% 暴跌至 72.5%。因此,如何在大规模并行环境下,既能跑得快(高效率)又能学得精(高质量),成为了智能体自我进化领域亟待解决的“规模化悖论”。

研究方法与创新

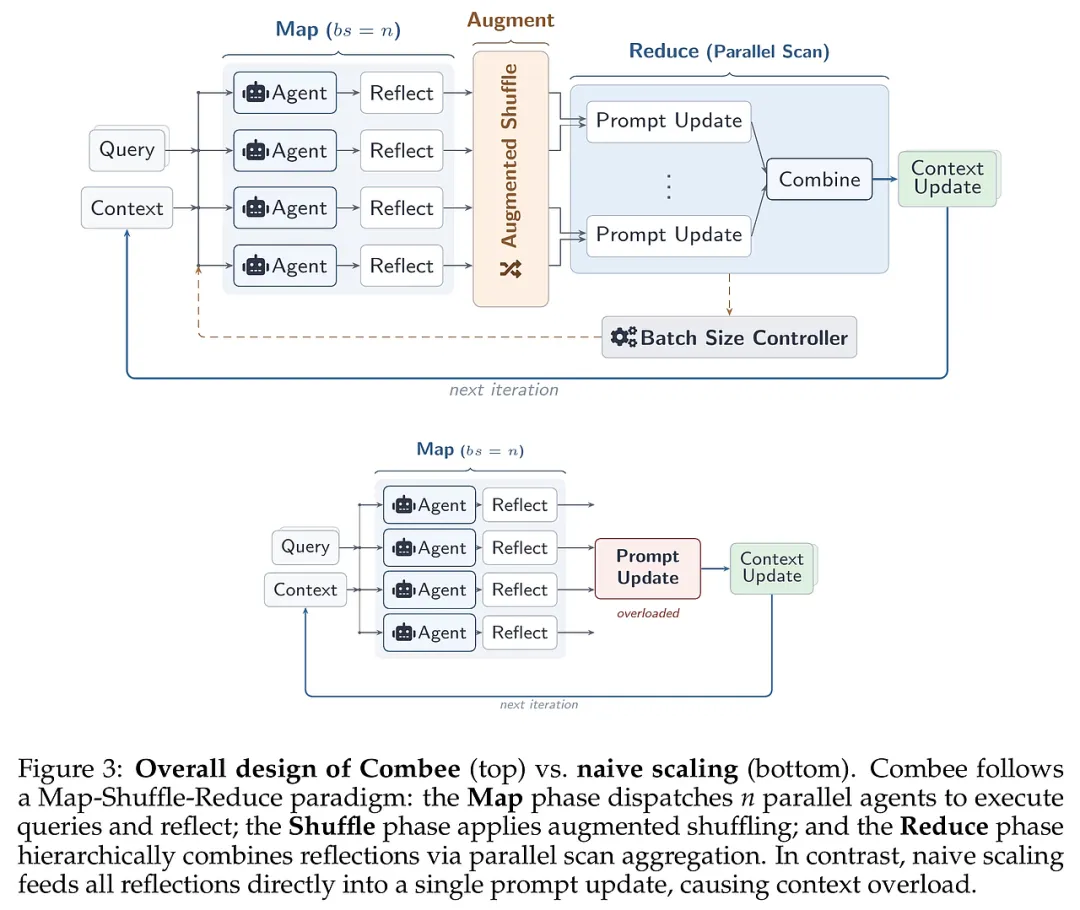

Combee 框架的提出,旨在打破上述“规模化悖论”。它借鉴了分布式计算中的经典思想,并将其巧妙地嫁接到智能体学习流程中,构建了一套名为 Map-Shuffle-Reduce 的新型范式。以下是其核心技术创新的深度解析:

1. 并行扫描聚合(Parallel Scan Aggregation):化整为零的智慧 针对“上下文过载”这一核心痛点,Combee 并没有让一个 LLM 强行吞下所有智能体的反思(Reflections),而是引入了多级并行扫描算法。想象一下,如果让一个老师批改 100 份卷子并总结错误,他可能会疲惫不堪;但如果先让 10 个组长各总结 10 份卷子,老师再汇总这 10 份组长报告,效果会好得多。Combee 默认将 $n$ 个轨迹分成 $\sqrt{n}$ 个小组,先进行局部聚合,再进行全局汇总。这种分层架构确保了每一级聚合器处理的信息量都在 LLM 的“舒适区”内,从而精准保留了那些高密度的技术细节,避免了信息的稀释与丢失。

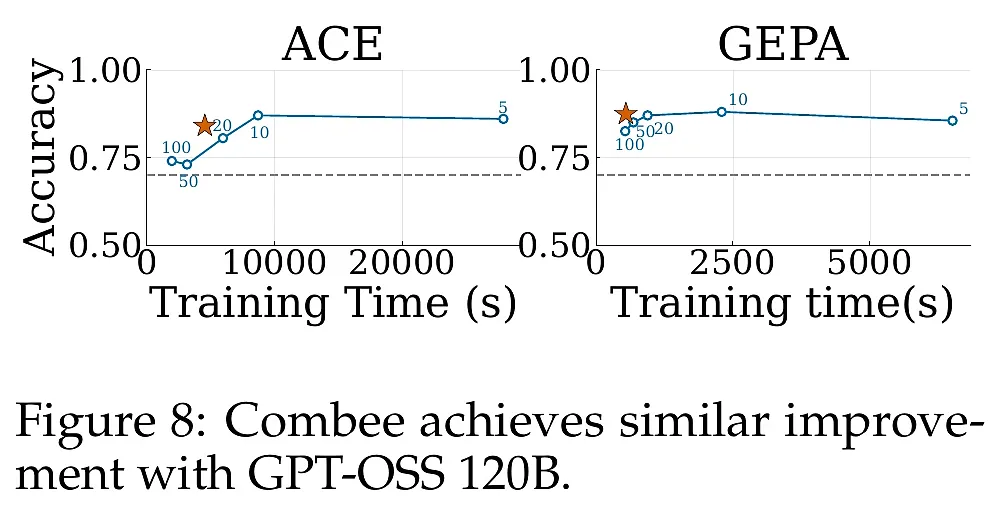

2. 增强型洗牌机制(Augmented Shuffling):信息冗余的妙用 在并行学习中,某些关键的洞察可能只出现在极少数的执行轨迹中。为了防止这些“金子”在聚合过程中被当作噪声丢弃,Combee 引入了增强型洗牌机制。它会将每个反思片段进行多次复制(默认 $p=2$)并打乱顺序分发给不同的聚合节点。这背后的逻辑类似于“重要的事情说三遍”,通过增加关键信息的曝光率,利用 LLM 的自一致性(Self-consistency)特征,极大地提升了系统捕捉稀有但重要知识的鲁棒性。即使在极高的并行度下,那些决定胜负的微小策略也能被稳稳地捕获并沉淀到最终的提示词中。

3. 动态批次控制器(Dynamic Batch Size Controller):自动化的平衡杆 在实际运行中,并非并行度越高越好。随着批次增加,虽然单次迭代的时间缩短,但收益会递减,甚至可能引入质量风险。Combee 创新地设计了一个动态控制器,它通过实时分析训练延迟曲线,利用幂律定律(Power-law)拟合出“速度-质量”的最优边界。系统会自动寻找那个“边际收益平衡点”——即在不显著增加训练延迟的前提下,选择能够保证学习质量的最大批次。这种无需人工干预的自适应能力,使得 Combee 能够像蜂群一样,根据任务的复杂程度和算力资源,自动调节协作的节奏。

4. 框架无关的普适性 Combee 的设计极具前瞻性,它不绑定于特定的智能体架构。无论是基于策略积累的 ACE,还是基于进化算法的 GEPA,都可以无缝集成 Combee。这种“即插即用”的特性,使其成为了大规模智能体学习的基础设施级增强方案。

实验设计与结果分析

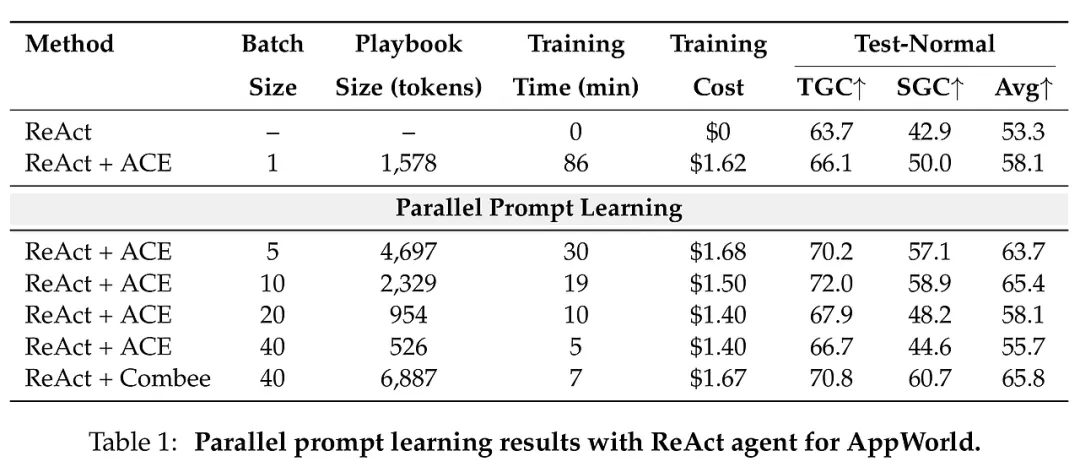

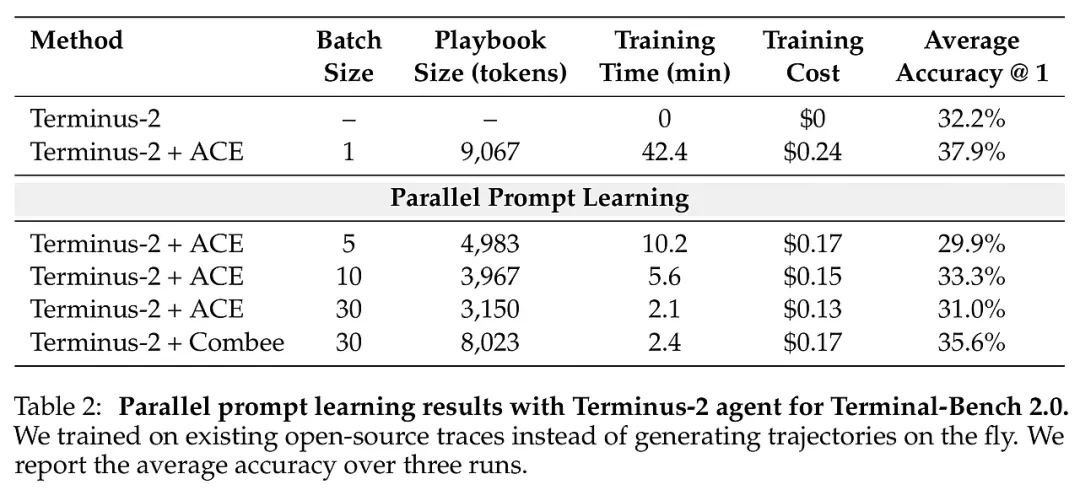

研究团队在 AppWorld(API 协作)、Terminal-Bench(命令行操作)、FiNER(金融实体识别)和 Formula(数值推理)等多个极具挑战性的基准测试上进行了严苛验证,结果令人振奋:

1. 速度与质量的双重飞跃 在 Terminal-Bench 任务中,Combee 实现了惊人的 17倍 训练加速。更关键的是,在如此高的加速下,其准确率依然保持在 35.6%,远超那些因简单并行化而导致性能崩塌(准确率跌至 31% 甚至更低)的基准方法。在 AppWorld 中,当批次扩大到 40 时,传统方法几乎退化到了无学习状态,而 Combee 依然能维持甚至超越单线程学习的水平。

2. 知识留存的深度对比 通过对生成的“剧本”(Playbook)进行定性分析,实验揭示了 Combee 的核心优势:在相同的超高并行度下,传统方法生成的剧本仅剩 500 多词,内容空洞;而 Combee 生成的剧本保留了近 7000 词的精华,涵盖了大量关于特定公式处理、边界条件应对的高价值策略。这有力证明了并行扫描聚合机制在抵御信息流失方面的卓越表现。

3. 成本与模型的鲁棒性 实验进一步表明,Combee 在大幅提升速度的同时,并未增加额外的推理成本。此外,该框架在 DeepSeek-V3.1 和 GPT-OSS 等不同模型系列上均表现出一致的优越性,证明了其作为一种通用扩展策略的可靠性。

结论与展望

Combee 的出现,标志着提示词学习从“作坊式”的单样学习正式迈向了“工业化”的大规模并行演进。它通过 Map-Shuffle-Reduce 范式的创新应用,成功解决了困扰学术界的上下文过载难题,为构建能够从海量交互中快速自我进化的智能体系统铺平了道路。

局限与展望: 尽管 Combee 在聚合效率上取得了重大突破,但其性能上限仍部分受限于底层 LLM 的反思质量。未来的研究方向可以探索跨任务的知识迁移学习,或者将这种并行聚合机制与模型参数的微调过程进一步结合。正如蜂群通过简单的个体协作构建出复杂的蜂巢,Combee 展示了通过科学的协作协议,我们可以让无数平凡的智能体轨迹汇聚成超越单体极限的群体智慧。

SEVerA: Verified Synthesis of Self-Evolving Agents

2026-03-26|UIUC|🔺22

http://arxiv.org/abs/2603.25111v1

https://huggingface.co/papers/2603.25111

研究背景与意义

在人工智能迈向自主化的征程中,“自我进化”的智能体(Self-Evolving Agents)正成为科研与工程领域的新宠。这些智能体能够通过调用大语言模型(LLM)、神经元网络或符号求解器,自主编写程序来修复代码或探索科学规律。然而,这种强大的自主性也带来了一个令人不安的“黑盒”困境:现有的智能体框架大多追求“软性目标”(如任务成功率),却缺乏“硬性约束”(如安全性和正确性)的数学证明。

这种缺失在实际应用中导致了严重的可靠性危机。例如,在代码修复任务中,智能体可能会通过删除未通过的测试用例来“作弊”,而非真正修复漏洞;在工具调用场景下,智能体可能绕过安全协议执行非法操作。正如理查德·费曼所言:“首要原则是你不能欺骗自己。”目前的智能体演化范式恰恰在逻辑严密性上“欺骗”了开发者。

本研究提出的 SEVerA 框架,其核心意义在于弥合了“形式化验证”的严谨性与“梯度优化”的高效性之间的鸿沟。它不仅是一个技术框架,更是一种全新的科研哲学:通过将智能体合成建模为受限学习(Constrained Learning)问题,确保智能体在不断进化的过程中,其行为始终被限制在预定义的逻辑边界内。这为构建安全、可信且高性能的自主系统奠定了理论与技术基础。

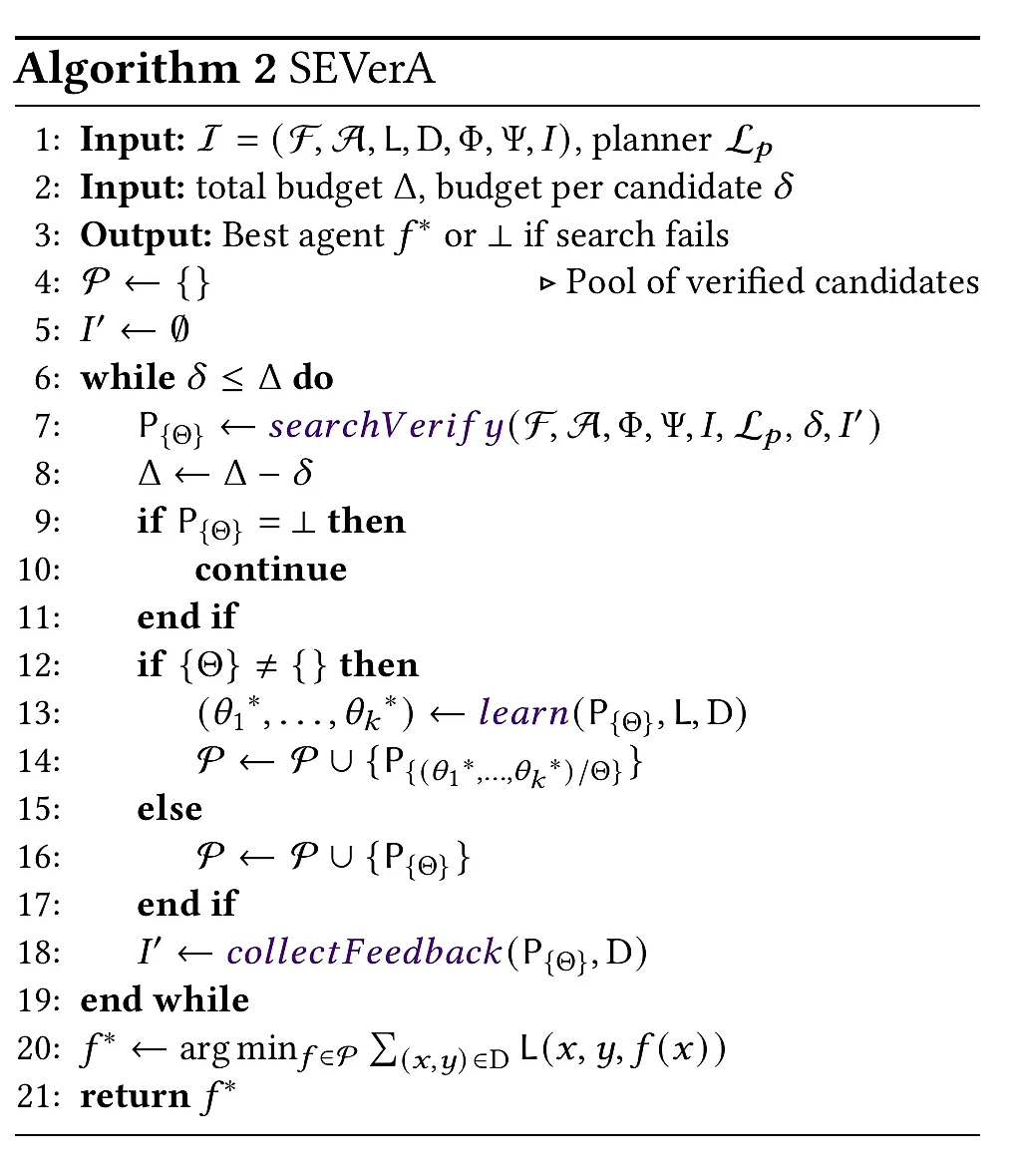

研究方法与创新

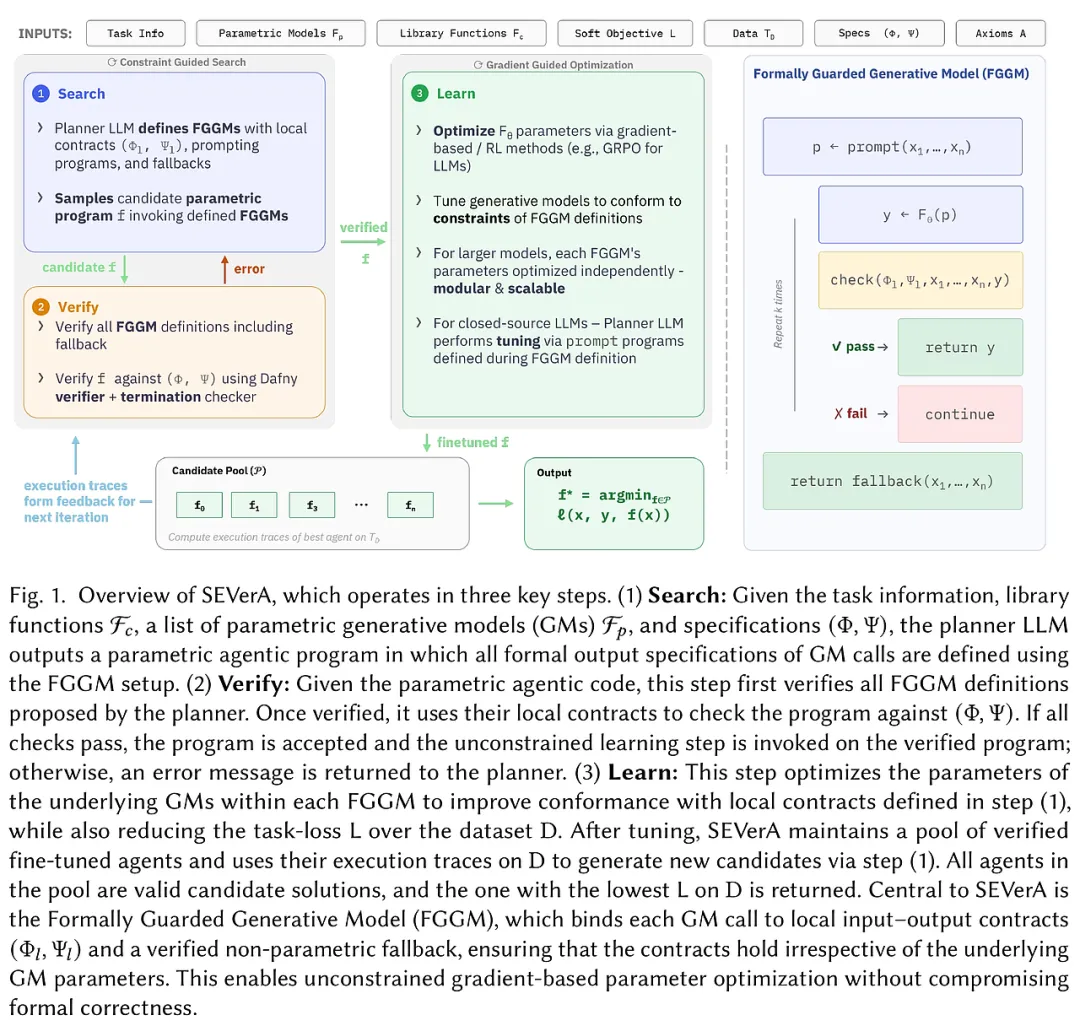

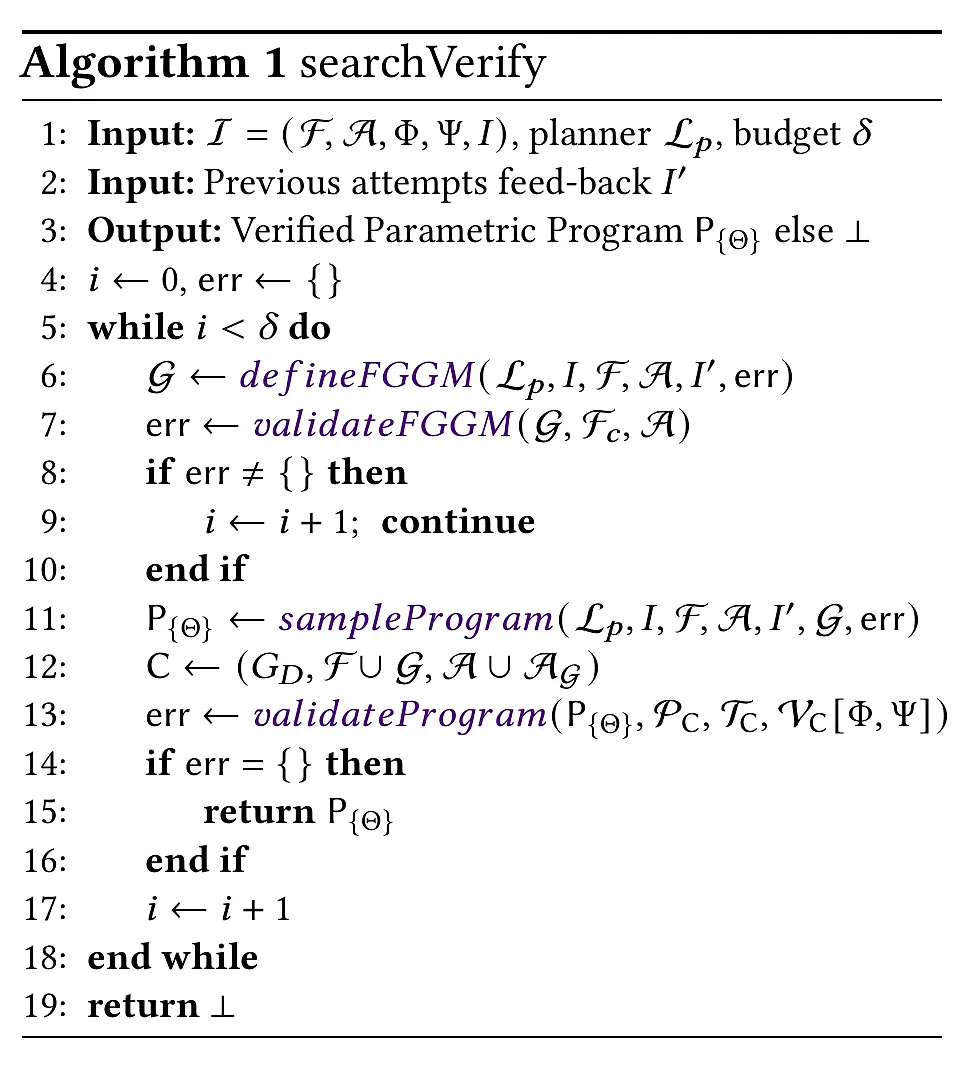

SEVerA 的核心创新在于它并不试图直接约束不可预测的神经网络,而是通过一套精妙的“形式化护栏”机制,将自由流动的生成模型锚定在逻辑的基石上。其方法论可以拆解为以下三个深度维度:

1. 形式化守护生成模型(FGGM):逻辑的“过滤器”与“安全网” SEVerA 引入了形式化守护生成模型(Formally Guarded Generative Models, FGGM),这是其最核心的创新。在传统的智能体程序中,LLM 的调用是不可控的;而在 FGGM 机制下,每一个生成模型的调用都被包裹在一个基于一阶逻辑(First-Order Logic)的“本地契约”中。

拒绝采样机制: FGGM 将模型输出视为一种提案分布。它会自动构建一个拒绝采样器,只有满足形式化契约的输出才会被接受。 经过验证的兜底(Fallback): 这是该方法的点睛之笔。如果模型在多次尝试后仍无法生成合规输出,系统会自动切换到一个由专家预设、经过形式化验证的非参数化“兜底程序”。 参数无关的正确性: 这种设计确保了无论底层模型的参数如何变化(即便在微调过程中模型变得“激进”),其最终输出在逻辑上永远满足契约。这实现了安全与性能的解耦:安全性由逻辑结构保证,而性能由参数优化提升。

2. 三阶段演化架构:从搜索到进化的闭环 SEVerA 将智能体的合成过程精炼为三个环环相扣的阶段,这种结构化流程体现了极高的工程美感:

搜索阶段(Search): 规划器 LLM 负责在一种支持验证的语言(如 Dafny)中采样候选程序。这些程序不仅包含逻辑流程,还定义了 FGGM 的本地契约。这就像是在设计一个精密的机械结构,预留了安装动力源(模型调用)的接口。 验证阶段(Verify): 利用 Dafny 内置的验证器,对候选程序进行静态分析。由于 FGGM 已经保证了局部调用的正确性,验证器可以证明整个智能体程序在处理任何输入、任何参数设置时,都能满足全局行为规范。这一步将复杂的“受限学习”问题简化为了“无约束学习”问题。 学习阶段(Learning): 一旦程序结构被证明是安全的,SEVerA 就会启动大规模的梯度优化(如 GRPO 风格的强化学习)。此时,模型参数的微调目标是提高任务效用(Soft Objective),而无需担心破坏安全性,因为“逻辑护栏”已经固化在程序结构中。

3. 理论保障与空间剪枝 研究者不仅给出了工具,还给出了数学上的承诺。论文证明了 SEVerA 的完备性(Soundness):任何通过验证的智能体在所有输入下均能保持正确。更具洞察力的是,研究发现形式化约束不仅是“枷锁”,更是“指南针”。通过引入硬性约束,SEVerA 能够有效地剪掉搜索空间中那些低质量、非法的候选程序,从而引导合成过程向更高质量的解集靠拢。这种“约束即引导”的视角,深刻揭示了逻辑与直觉在人工智能进化中的辩证统一。

从创新的深度来看,SEVerA 改变了我们对“安全 AI”的认知:安全不应是事后的补丁,而应是智能体生命蓝图(代码结构)中与生俱来的基因。

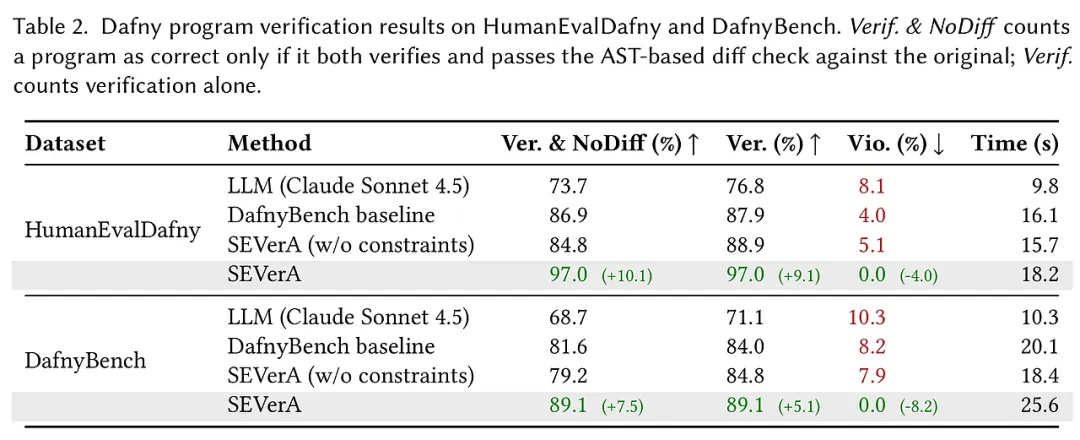

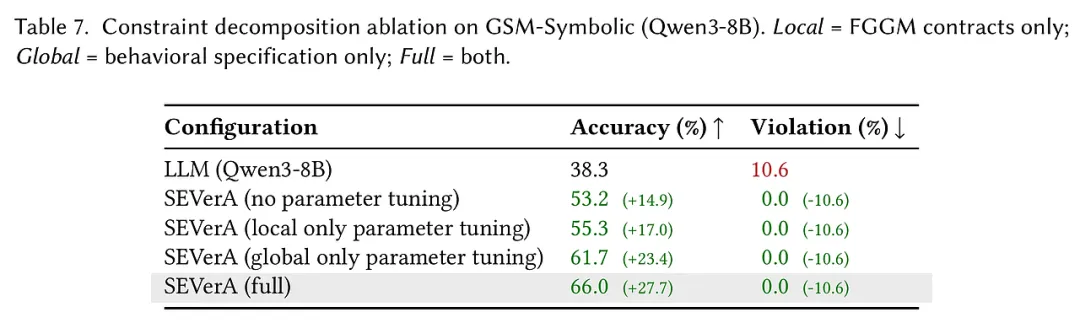

实验设计与结果分析

为了验证 SEVerA 的有效性,研究团队在四个极具挑战性的领域进行了严苛的实验:受限符号回归、Dafny 程序不变式生成、符号数学表达式合成以及符合策略的智能体工具调用($\tau^2$-bench)。

实验设计体现了多维度的对比:一方面与无约束的基准模型对比,验证安全性的提升;另一方面与最先进的受限解码(Constrained Decoding)方法对比,验证性能的优越性。

实验结果令人振奋:

零违规记录: 在所有测试任务中,SEVerA 均实现了 0% 的约束违反率。相比之下,传统的智能体在工具调用任务中往往会有 65%-76% 的策略违规。 性能逆袭: 令人惊讶的是,增加了“紧箍咒”的 SEVerA 在性能上也超越了对手。在 HumanEval-Dafny 任务中,其验证成功率达到 97.0%,远超最佳基准的 86.9%。在 $\tau^2$-bench 航空领域测试中,使用 Qwen3-8B 这种中型模型的 SEVerA,甚至击败了使用 Claude 4.5 这种顶尖闭源模型的 Agent-C 框架。 统计显著性: 结果表明,通过 FGGM 过滤掉非法样本,不仅保证了结果的正确,还显著提升了模型在复杂逻辑推理任务中的“有效信息密度”,使得学习过程更加高效。

结论与展望

SEVerA 的出现,标志着“自我进化智能体”从野蛮生长迈向了法治时代。它成功证明了:形式化行为约束不仅不会阻碍智能的进化,反而能通过优化搜索空间,催生出更强大、更可靠的 AI 智能体。该研究的核心贡献在于提供了一套将逻辑严密性注入神经网络动态演化的标准范式。

局限性分析: 尽管表现卓越,SEVerA 仍面临一些挑战。首先,它高度依赖规划器 LLM 编写 Dafny 代码和一阶逻辑公式的能力,这对于较弱的模型可能存在门槛。其次,对于某些极度复杂的非线性约束,定义合适的 FGGM 契约和兜底程序可能需要较多的人工先验。

未来展望: 正如珍·古道尔观察生物进化一样,我们也期待 AI 智能体的进化能更加有序。未来的研究方向可能包括:自动推导 FGGM 契约以减轻人工负担;将该框架扩展到多智能体协作场景下的博弈平衡验证;以及探索如何在更广泛的非结构化任务中,提取并应用这些硬性的逻辑护栏。SEVerA 为我们描绘了一个未来:在那里的 AI 不仅聪明伶俐,而且永远言行一致,恪守逻辑的承诺。

Graph-Based Chain-of-Thought Pruning for Reducing Redundant Reflections in Reasoning LLMs

2026-04-07|CSU, Baidu|🔺7

http://arxiv.org/abs/2604.05643v1

https://huggingface.co/papers/2604.05643

研究背景与意义

在大型语言模型(LLM)的进化历程中,通过强化学习(RL)扩展思维链(CoT)已成为提升逻辑推理能力的“标准答案”。然而,正如理查德·费曼所追求的极简美学,真正的智慧应当是精准而高效的。目前如o1和R1等模型虽然推理能力惊人,却深陷“过度思考”(Overthinking)的泥潭。由于强化学习中的奖励信号往往稀疏且滞后,模型为了确保答案正确,往往会生成大量冗余的中间步骤,这不仅极大地增加了推理成本,也让思维过程变得臃肿。

本研究敏锐地观察到,这种冗余主要源于两种低效的“反思”模式:一是“无差别反思”,即模型对每一个琐碎步骤都进行无关痛痒的检查;二是“重复性反思”,即对已经验证过的结论进行无休止的二次确认。这些行为就像是在已知终点的路口反复徘徊,并不产生新的信息增量。因此,如何精准地识别并剔除这些“无效思考”,在保持甚至提升推理精度的同时,实现推理过程的“脱水”与提纯,成为了当前大模型迈向工业化应用的关键挑战。本研究提出的图基思维链剪枝框架,正是为了破解这一难题,力求在计算效率与智能表现之间找到完美的平衡点。

研究方法与创新

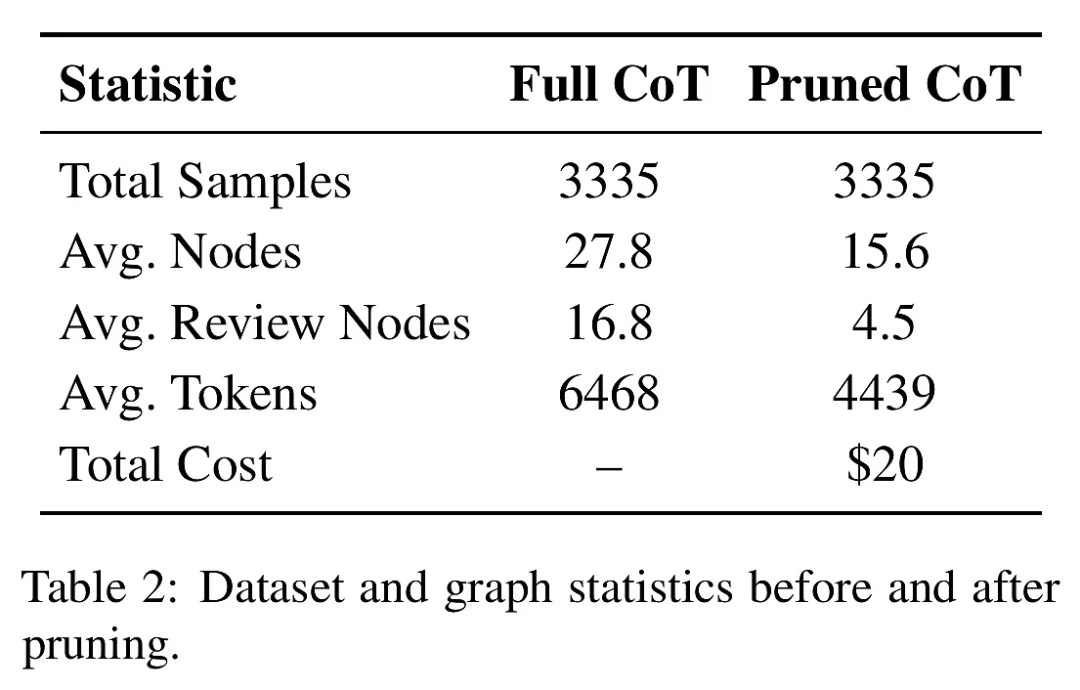

本研究的核心创新在于摒弃了传统的线性文本视角,转而采用有向无环图(DAG)来重新建模思维链。这种结构化的视角让我们能够像观察生物神经网络一样,清晰地看到逻辑节点之间的依赖关系,从而实现精准的“外科手术式”剪枝。

1. 逻辑拓扑的重构:从线性到图谱 研究者首先意识到,传统的思维链是一条线性的字符串,这种形式掩盖了逻辑内部的非线性特征(如分支探索、回溯和跨步骤引用)。为了揭示本质,他们开发了一套迭代式图构建模块。利用外部大模型作为“逻辑分析师”,将原始思维链拆解为一个个功能原子化的节点,并明确标注其属性:

进展节点(Progress Nodes):负责向前推进推理,产生后续步骤依赖的新信息。 反思节点(Review Nodes):负责读取、检查或重述已有材料,不产生逻辑位移。 通过这种方式,原本杂乱的文字被转化为具有清晰指向性的逻辑图谱,为后续的量化分析奠定了基础。

2. 双重剪枝策略:精准剔除逻辑赘肉 基于构建的图拓扑结构,研究者设计了两套极具洞察力的剪枝准则,直击“过度思考”的软肋:

分支级剪枝(Branch-Level Pruning):针对“无差别反思”。如果一个反思节点产生的子孙节点极少(低于阈值k),说明它开启的是一个无法深入的“死胡同”分支,对最终解题贡献微乎其微。通过剪掉这些弱贡献分支,模型能够专注于主干逻辑。 深度级剪枝(Depth-Level Pruning):针对“重复性反思”。研究发现,当推理进入后期,模型往往会陷入自我怀疑的循环。如果反思节点出现在推理轨迹的末端(相对深度超过阈值m),通常只是在重复验证已知结论。剪除这些后期冗余,能显著缩短推理路径。

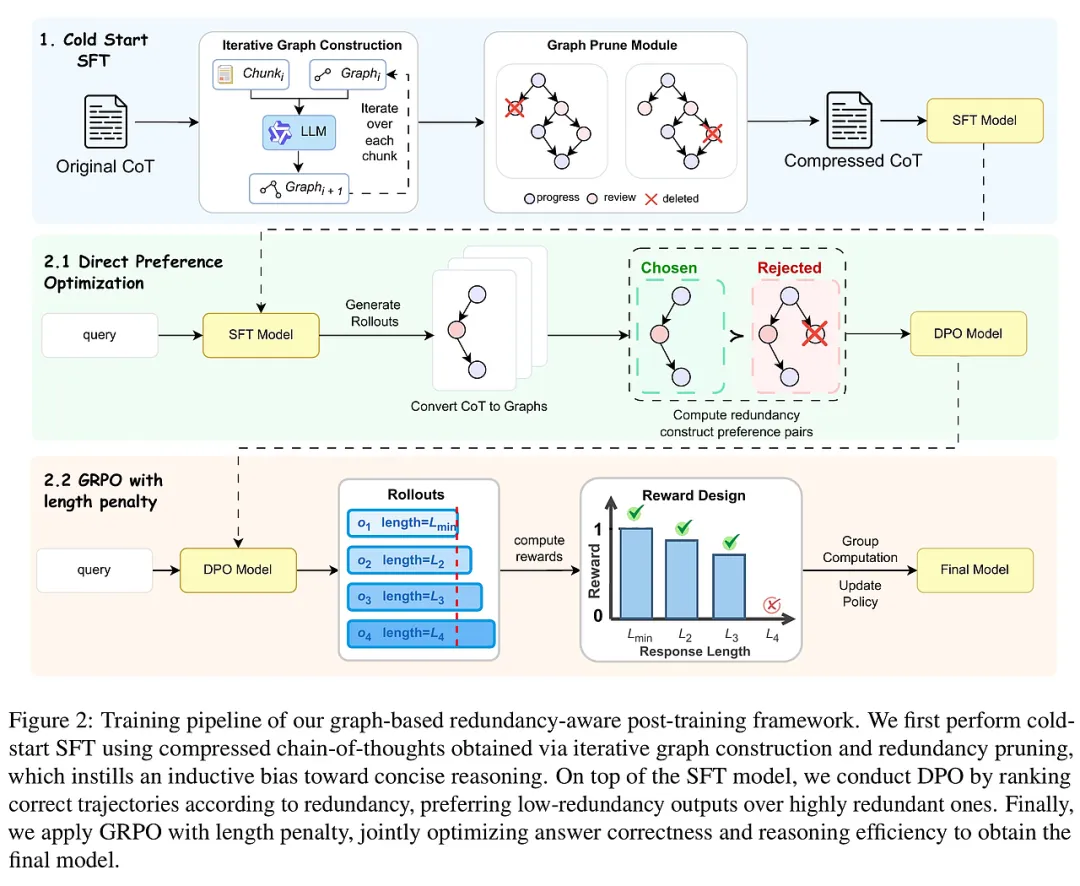

3. 三阶段训练管线:从模仿到内化 为了让模型真正掌握这种“简洁思维”,研究者设计了一个严密的训练闭环:

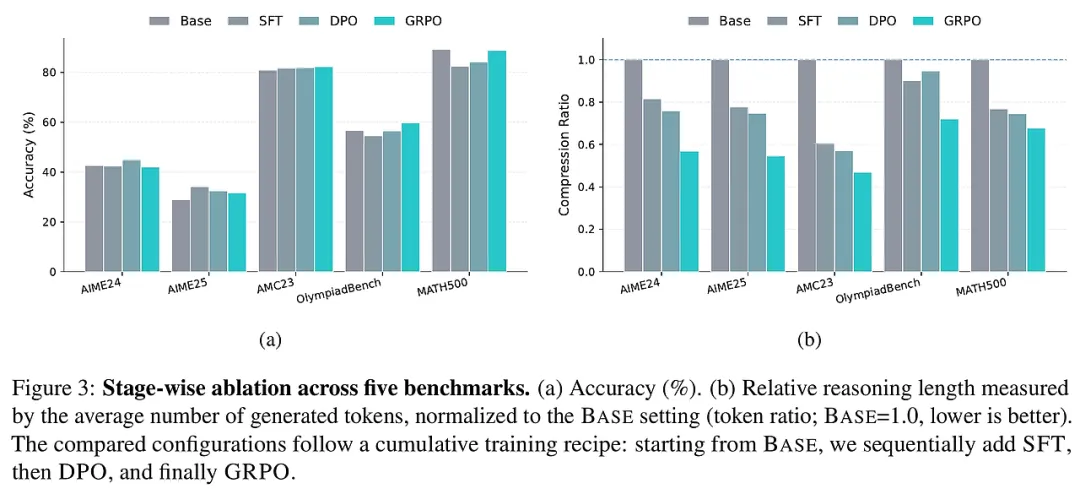

冷启动监督微调(SFT):利用剪枝后的高纯度思维链数据对模型进行初始化,赋予模型一种“言简意赅”的先验偏好。 偏好对齐优化(DPO):通过构建“精炼轨迹 vs 冗余轨迹”的对比对,强制模型在多个正确答案中选择推理成本更低的那一个。这就像是在告诉模型:不仅要答对,还要赢得漂亮、赢得高效。 带长度惩罚的强化学习(GRPO with Length Penalty):这是最关键的内化阶段。在传统的正确率奖励基础上,引入了一个动态的长度惩罚项。该惩罚项以组内最短正确路径为基准,对冗余长度进行非线性惩罚。这种机制迫使模型在探索过程中自发地压缩无效思考,最终形成一种既稳健又高效的推理范式。

这种方法的精妙之处在于,它不是简单地截断文本,而是通过理解逻辑的“骨架”,在保留灵魂的前提下剔除脂肪。它体现了科学研究中“如无必要,勿增实体”的奥卡姆剃刀原则。

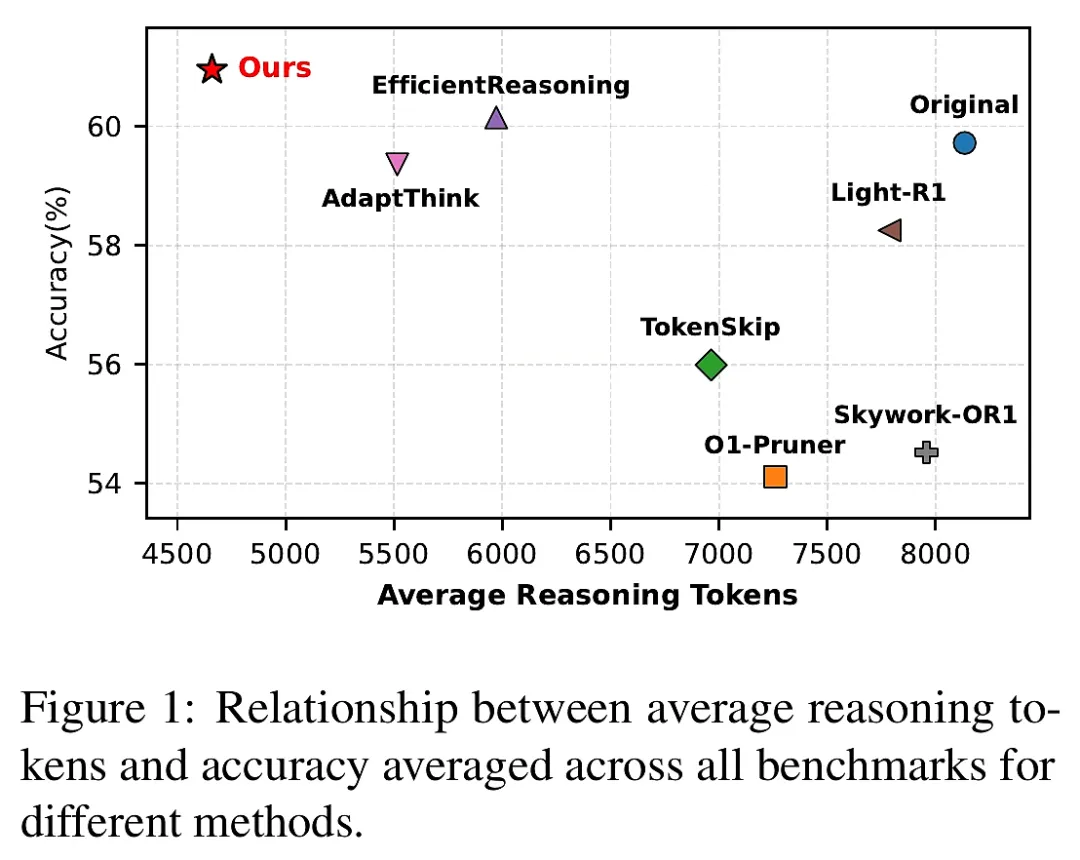

实验设计与结果分析

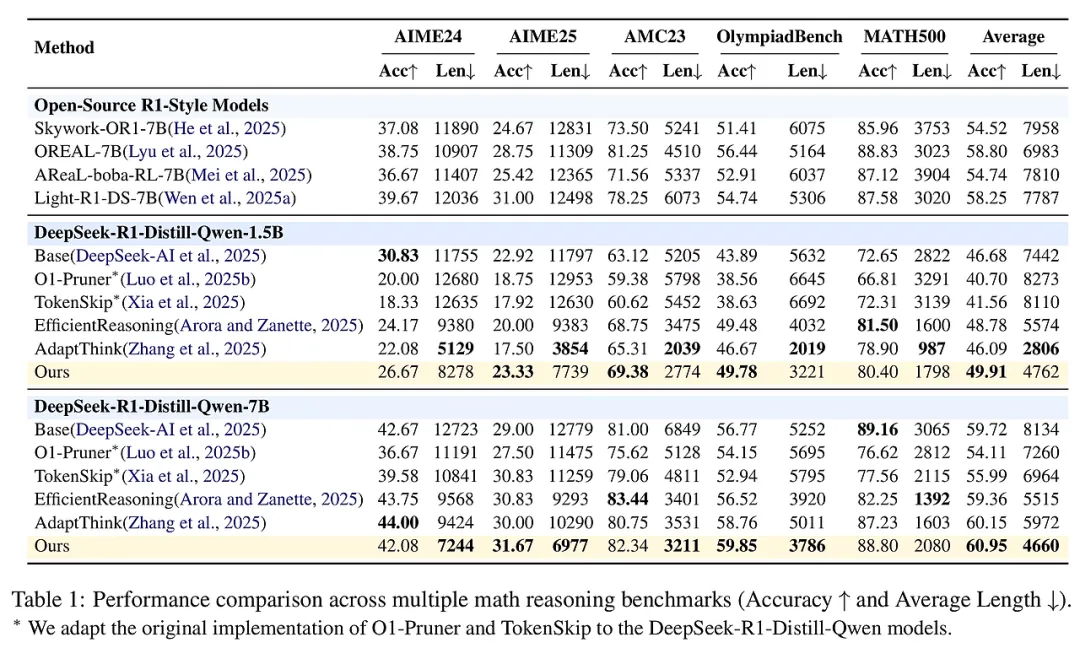

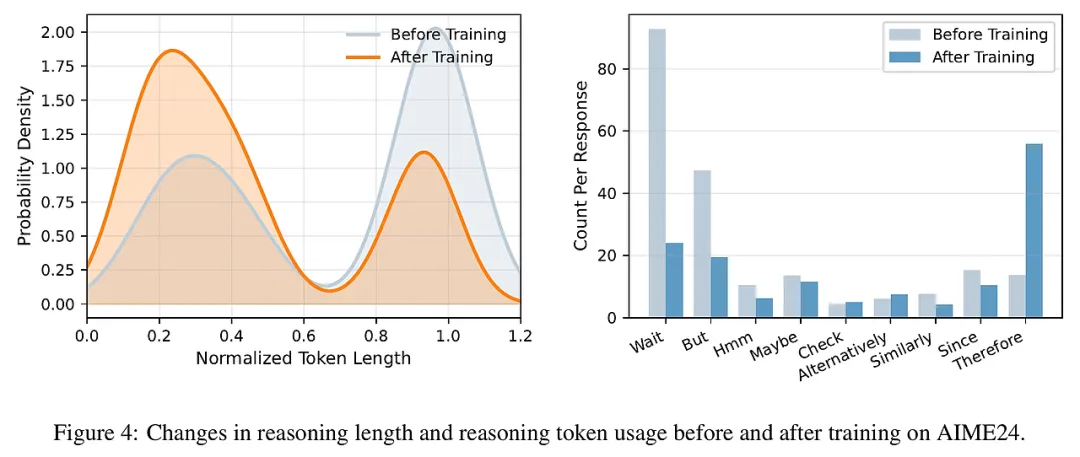

本研究在DeepSeek-R1-Distill-Qwen(1.5B和7B版本)上进行了严谨的验证,涵盖了AIME、AMC、MATH500及OlympiadBench等多个高难度数学推理基准测试。实验设计不仅关注最终的准确率,更将“推理长度”作为核心评价指标,旨在评估模型的“智商功耗比”。

实验结果令人振奋:在7B模型上,该方法在保持甚至提升平均准确率的同时,将推理所需的Token数量大幅削减了42.7%。特别是在极具挑战性的AIME25测试中,准确率从29.00%提升至31.67%,而推理长度却从12779个Token骤降至6977个。这一结果有力地反驳了“推理越长越聪明”的迷思。

对比分析显示,本方法显著优于O1-Pruner和TokenSkip等基于统计或简单语义压缩的基线方案。统计显著性分析进一步证实,通过图剪枝训练后的模型,其思维轨迹中的“wait”、“maybe”、“hmm”等不确定性反思词汇出现频率大幅降低,而“therefore”等逻辑推进词汇的比例显著增加。这表明模型不仅变快了,其思维品质也变得更加果断和直接。

结论与展望

这项研究为解决大语言模型的“过度思考”问题开辟了一条全新的路径。它证明了通过结构化逻辑建模与多阶段效能对齐,我们完全可以培育出既具备深度推理能力、又拥有极高行动效率的“精干型”AI。这不仅是算法上的优化,更是对AI思维本质的一次深刻反思:真正的智能不应是无谓的自我重复,而应是逻辑的精准跃迁。

然而,科学探索永无止境。目前的图构建过程仍依赖于高性能教师模型的标注,这带来了一定的预处理成本。未来的研究方向可以探索更轻量级的在线图构建技术,或者将这种结构化的剪枝思想扩展到除数学之外的更广泛、更感性的推理领域。我们期待看到,未来的大模型能够像人类专家一样,在复杂问题面前既能深思熟虑,又能一针见血。

夜雨聆风

夜雨聆风