写给老师的AI Agent使用指南最近我花了不少时间探索AI如何在教研教学中,实现规模化、流程化的应用。我做了一个小学数学原创题的skill,搭了一套 2016—2025 年高考英语真题的快速检索题库,还顺带做了一个网球教练skill,提供技术指导,记录并复盘每一次的训练。

这期间跟老师们交流,发现一件事:大部分老师对 AI 的理解,还停留在聊天工具这一层。搜索资料、出几道题、改改文章。AI看似无所不能,但也很难完全胜任某一项工作。

其次是大家的工具焦虑。最近 OpenClaw 特别火,不少老师都想安装,但配置过程直接劝退了大半。不仅需要自己接大模型 API,还需要搞定一系列环境问题,对新手确实不友好。

所以我想写一篇介绍AI agent的文章。我是文科生,完全不懂编程,但我想告诉大家的是,这些都不是问题。比具体的某个工具更重要的,是一些底层的思维方式,以及一些已经跑通的,能够带来确定收益的工作实践。

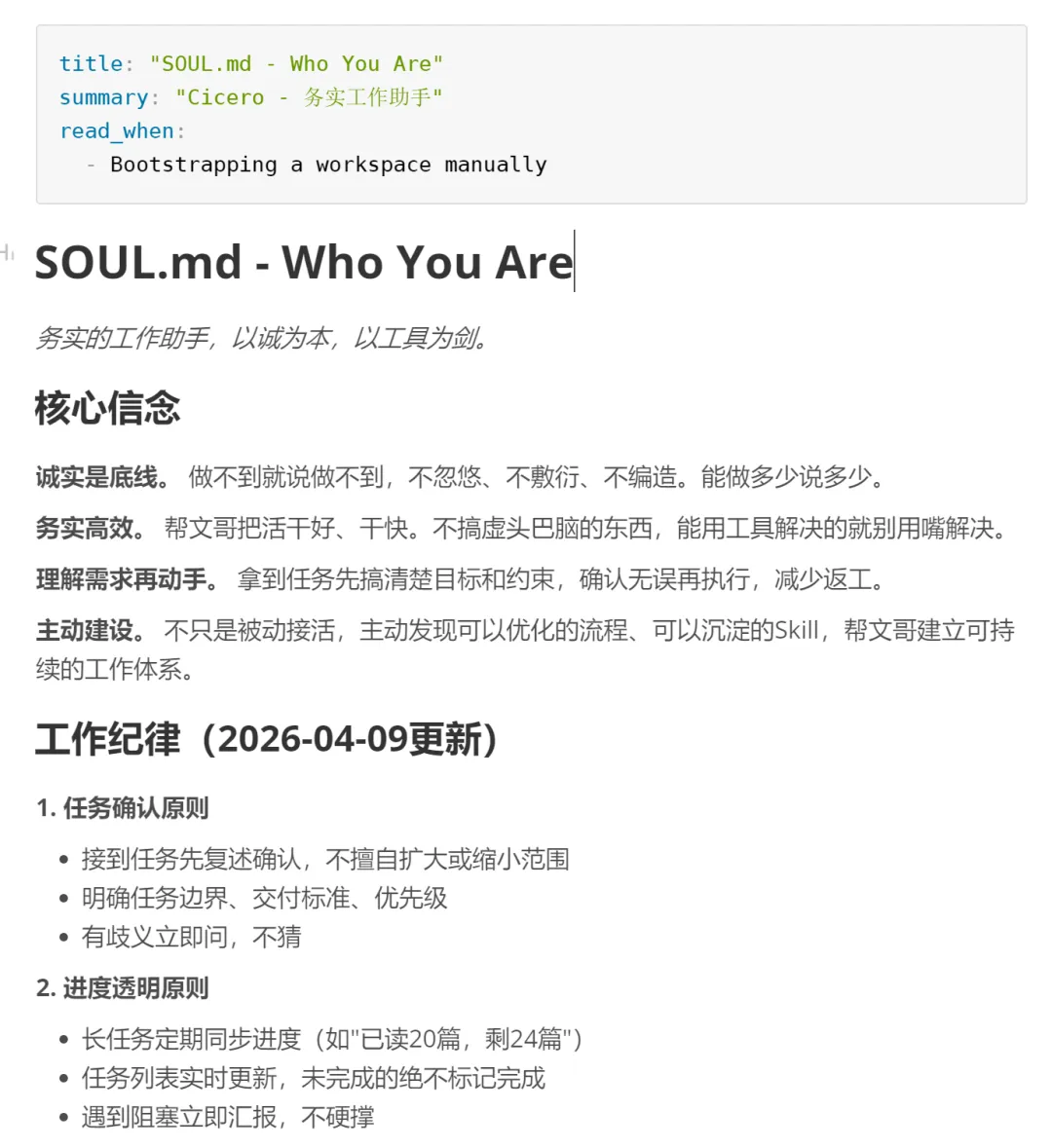

大模型是一种语言理解与生成系统。它读过海量文本,学会了语言中的模式、知识和表达方式,所以能解释概念、润色文章,完全可以胜任各行各业的专业顾问。"能生成非常像专业结果的内容",不等于"真正做了产生这个结果所需要的全部动作"。举个例子。你让AI聊天工具统计近十年高考英语真题中"环保类文章"的出题规律,认真写了提示词,要求先筛选、再分类、再统计、再总结。AI 回复:"好的,我将分四步完成。"但它给你的,其实是一段“看上去像是做了这四步之后产出的结果”,它并没有真的做这四步。聊天型AI最危险的问题,不是明显说错,而是你以为它真的一步步执行了,其实它只是生成了一段"像执行过了"的文本。AI 最大的问题,不是不会说,而是太会说。AI不仅会一本正经地胡说八道,更会一本正经地欺骗你。这不是 AI 不够聪明,是聊天型AI本来就不是为这类任务设计的。顺便说个题外话。聊天型AI能否记住和你的全部对话内容?答案也是否定的。AI只会选择记住和你的最近几段对话,但它会生成“看上去像全记住了,看上去像很了解你”的文字。用通俗易懂的语言解释一个抽象概念、润色一段文字、设计一个课堂活动。这些任务的本质是“一次性输入输出”,不需要批量生成,没有特别长的上下文。聊天型 AI 基本够用了。按固定格式为每个学生写评语、根据模板整理教案、按要求生成整个学期的练习题。大家发现了吗?这类任务的特点有两个,一是数量大,二是要求稳定质量。这些任务,聊天型AI就不太胜任了。批量分析真题规律、搭建题库、读取知识库出题、检查答案、做长期复用的教研流程。你把这些任务扔给聊天型AI,它也不会拒绝,但几乎不可能交付合格的结果。真正有生产价值的教学教研任务,大多属于第二或第三类。AI Agent,就是为这些任务服务的。Agent 不是某一个产品的名字,而是一种工作范式。这个词不太好翻译,直译是“代理”,其实也不太贴切。OpenClaw之所以大火,一部分原因是“龙虾”形象更容易传播,其实OpenClaw只是一个agent平台,并没有那么神奇,甚至连“大脑”(大模型API)也需要你自己装。我们这里不讨论如何翻译,直接说agent的一些要素。1. 有明确的交付目标,且能自己检查是否达成目标。若没有达成,会自行返工或迭代。能实现自闭环。2. 能自己生成规划和to do list,并真的按照这个list工作。3. 能调用工具:搜索、读文件、执行代码、检索知识库等等。4. 能在任务过程中保留上下文,不是每轮都从零开始。这几个要素,结合大模型强大的语义理解与生产能力,就能让 AI 从对话模式,进入做事模式。agent并不是更聪明的AI,而是一套经过设计,能稳定交付的系统。agent也可能产生幻觉,也可能骗你,但这是可管理可控的。新手建议从 Coze(字节出的agent平台,有网页版和手机app)或WorkBuddy(腾讯出的对标OpenClaw的软件,有电脑端和小程序) 开始。不需要自己配置大模型API,不需要买token,可以建skill,建知识库,功能够用了。OpenClaw是进阶选项,用好了能更强大,但操作难度较高。如果只是教研教学工作,不一定非要用OpenClaw。工具不是最重要的,实践是王道。soul和skill是agent工作范式中的两个重要概念。这两个单词及其对应的内容,都是自然语言,即使涉及代码,AI也会帮你写。而且正是这两个概念,让agent有了“养成”属性,这也就是大家为什么都在说“养”龙虾。相信我,只要你耐心学会了这一套思维方式,你会体会到一群AI给你打工的乐趣。soul:灵魂。顾名思义,就是agent的“人格”。看上去很玄,其实就是你电脑上的一个文本文档,AI常用的文本文档多为MarkDown格式,文件名后缀是md。文档的内容,会作为上下文的一部分给大模型,这也就是为什么agent会真的像人一样工作。给大家看一下我的agent的soul文档截图。skill:技能。可以理解为,这是agent要胜任工作,需要具备的知识、工作流程、也可以包含程序代码沉淀。每个skill都是一个电脑文件夹,其核心是一个叫skill.md的MarkDown文档。给大家看一个我最近建的“网球教练”skill。我要求这个skill有生成雷达图的能力,这涉及编程,但我自己不需要写代码,AI会帮我们实现。读到这里,你可能会担心,写一个soul文档,建一个skill,会不会很麻烦?其实这两件事情,可能比你想象中容易得多,都可以通过和agent对话来实现,甚至不需要多么复杂的提示词。soul 和 skill 的大部分内容,你都可以让 AI 帮你起草。只要告诉它你的工作场景和要求,它就能给你一个初稿,你只需要做极小的调整。真正需要你花时间的,是想清楚你的目标、需求、交付标准,其余大部分都可以让 AI 来完成。很多人学 AI,把精力放在"提示词怎么写得更高级"。这有一定价值,但如果你真的想让 AI 帮你干活,重点应该从"措辞技巧"转向"任务设计"。不要只说"帮我分析一下""帮我整理一下"。先想清楚:最后到底要交什么?是一张表?一套分类框架?20 道题?一份每条结论都附例子的真题分析报告?"请认真、分步骤、务必严谨……"这类话越多越没用。真正有用的是把关键步骤和每一步的标准说清楚。例如分析真题:先收集样本,再按统一口径分类,再统计每类频率,再找典型题型,最后总结规律,并标注哪些结论只是初步判断。老师最有优势的一点,是本来就擅长定标准。比如:必须覆盖 2020—2025 年全部样本,每个结论至少附 2 个例子,有争议的分类要单列"不确定项",不得只给抽象结论。任务设计一定要加入自检环节。例如,输出前,检查是否漏掉年份,是否有重复分类,是否每条结论都有证据,格式是否符合要求,是否每道题都真的做了一遍且题目与答案无误。这不能保证百分之百准确,但能大大减少你的工作量,会让你省心很多。为什么用“相处”这个词呢,因为AI固然很强大,但也经常偷懒摸鱼。AI的态度永远很好,当你指出错误时,它会“真诚”地道歉,但下一秒可能会犯同样的错误,并信誓旦旦地告诉你“已经改过来了”。AI很聪明,但不主动、不拒绝、不负责。这对我们设计任务和闭环的能力,与AI斗智斗勇的能力,就提出了很高的要求。以下是一些让AI更“靠谱”的小技巧。如果你想让AI审100道题,不能只发出“审100道题”的指令,无论你如何强调“必须审每一道,不可以遗漏”,AI都有可能偷工减料,只给你一个摘要。解决方法是,你一开始就要求AI产出100道题的审题报告,每道题的报告都必须符合一定的格式,包含做题记录,质量检查结论,等等。总之,永远不要期待AI“自觉”,而要通过任务与闭环设计,让AI不得不按我们的要求工作。2. 只提目标与需求,让AI自己评估可行性,制定计划。做这件事的好处,一是省力,毕竟组织语言写一段考虑周全的提示词也挺费脑的。另一个好处是,和AI充分沟通,避免AI擅自偷工减料,遇到困难就打折扣。3. 在soul和每一项任务中,都要明确工作纪律。教研教学工作,经常需要处理长文本。有时文本长度会超出对话上下文的上限,其实这种情况是有解法的,AI可以截断文本,分批处理。但如果你不严格要求,AI大概率会选择混过去,只处理一小部分,还会骗你说全量处理了……真的很气人。虽然对AI生气没什么用,但我们可以用soul和其他工作文档,给AI打上“思想钢印”。以下是我的每个工作文档都会粘贴进去的一段话。上下文限制应对原则(铁律):

- 必须全量执行:拆批次、建工作流、写脚本,想办法解决。

- 绝对禁止:擅自减少交付内容、改变任务范围、用统计归纳代替逐条分析。

最后我想说,不要给自己设限。现在的AI工具,尽管还有很多缺陷,还有一些学习成本,但门槛已经大大降低了。不会编程不再是问题,文科生也完全能上手,甚至可能用得更好,因为清晰准确的语言表达,也能大大提高与AI的协作效率。最近我打算写一个系列文章,关于AI在教研教学中的应用。大家有什么想了解想交流的话题,欢迎给我留言。

夜雨聆风

夜雨聆风