斯坦福大学做出一个叫 SleepFM 的 AI 模型,只看一晚睡眠数据,就能预测未来 6 年里 130 种疾病的风险,甚至对全因死亡给出 0.84 的预测水平。

这件事之所以震撼,不是因为它像算命。

恰恰相反,真正值得重视的地方在于:它不是玄学,而是把“睡眠”从一个主观体验,变成了一个可计算、可建模、可预测的生理信息系统。

但也必须先把最关键的一点讲清楚:

SleepFM 不是“睡一觉,AI就知道你什么时候死”。 它也不是靠手环、手表、手机 App 随便采一晚数据就能完成预测。 它依赖的是多导睡眠监测,也就是临床金标准 PSG(polysomnography)。

换句话说,这不是一句“AI神了”就能概括的新闻。 它真正的意义,在于医学 AI 正在从“识别已经发生的病”,转向“提前识别还没显性的风险”。

这,才是它可能改写未来医疗的地方。

一

先说结论:SleepFM 的突破,不在“预测了 130 种病”,而在它第一次把睡眠变成了一个通用医学表征入口。

过去几十年,睡眠医学一直有个尴尬现实:

睡眠很重要,所有人都知道; 但睡眠数据极难用,真正能吃透的人极少。

原因很简单。

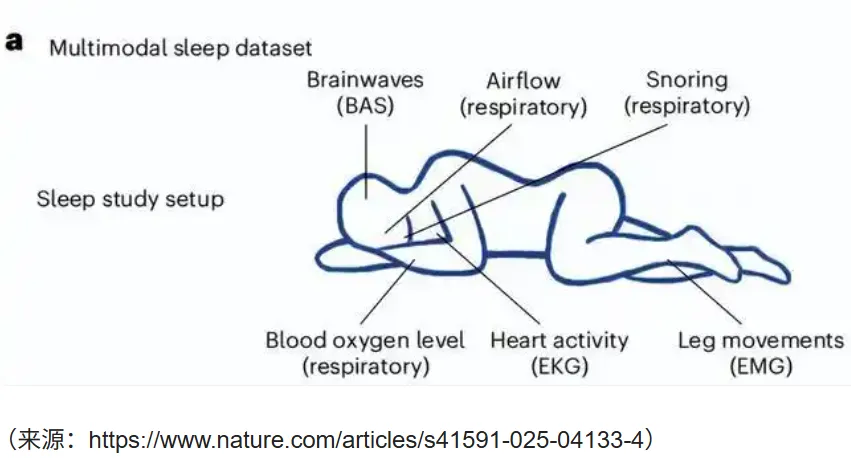

一个标准 PSG 检查,采集的不是“睡了多久”这么简单,而是同时记录:

●脑电

●眼动

●肌电

●心电

●呼吸信号

●血氧

●腿动等多种生理通道

这意味着,一晚睡眠其实是一场高维度的人体系统联调测试。

人的大脑在不在睡? 心脏节律稳不稳定? 呼吸有没有塌陷、紊乱、暂停? 不同系统之间是否同步?

这些信息,远比“昨晚睡得香不香”更接近身体真实状态。

SleepFM 的厉害之处,就是把这些原本分散、复杂、难解释的生理信号,压缩成一个统一的“睡眠表征”,再拿这个表征去预测未来疾病。

简单说,它不是在看“睡眠好不好”。

它在看:这具身体在夜间呈现出来的系统耦合状态,是否已经出现了疾病前兆。

二

这套模型到底是怎么做出来的?

从公开论文、斯坦福官方新闻稿和开源仓库来看,SleepFM 的技术路线非常清晰,而且很像医学领域的“GPT时刻”。

核心是四步。

第一步,做大规模睡眠基础模型。

SleepFM 训练使用了大约 58.5 万小时的睡眠记录,覆盖约 6.5 万名参与者。 其中最大的一个队列来自斯坦福睡眠医学中心,约 3.5 万名患者,年龄从 2 岁到 96 岁不等,数据记录时间横跨 1999 年到 2024 年,部分病例有最长 25 年的电子病历随访。

这件事很关键。

因为它意味着模型不是在学某一类单病种数据,而是在学“大规模人类睡眠生理语言”。

这就是 foundation model 的核心逻辑:先做通用表征,再迁移到具体任务。

过去很多医学模型是“为一个任务训练一个模型”,比如单独做睡眠分期、单独做睡眠呼吸暂停、单独做某类事件检测。 而 SleepFM 的思路是先学睡眠本身,再去做诊断和预测。

这比传统医疗 AI 更接近大模型范式。

第二步,把一晚睡眠切成细粒度时间片。

斯坦福官方披露,SleepFM 在预训练时把 PSG 数据切成 5 秒一个时间片,类似语言模型里把文本切成 token。

这个类比非常重要。

在大语言模型里,token 是语言的基本单元; 在 SleepFM 里,5 秒生理片段就是“睡眠语言”的基本单元。

模型通过大量 5 秒片段,学习不同信号模式在时间上的变化关系: 什么样的脑电对应什么样的呼吸状态; 什么样的心电变化出现在某种睡眠阶段; 哪些跨模态错位,是正常波动,哪些可能是病理前兆。

也就是说,它不是只看一个数值,而是在学习整套“夜间生理语法”。

第三步,用多模态对比学习,学出统一睡眠表征。

论文给出的关键词是:multimodal sleep foundation model,novel contrastive learning approach,designed to accommodate any PSG montage。

这句话翻成大白话,就是:

●它是多模态的,不只看一个信号

●它用的是对比学习,不依赖大量人工标注

●它尽量兼容不同医院、不同设备、不同导联配置的 PSG 方案

为什么这一点重要?

因为医疗 AI 最难的从来不是论文里跑出高分,而是跨医院、跨设备、跨人群时还能不能用。

不同睡眠中心,电极排布、传感器数量、采样方式、通道组合都可能不同。 如果模型只能吃一种标准输入,那临床推广会非常差。

SleepFM 的目标,就是尽量做成“导联配置更灵活”的基础模型。 这本质上是在解决医学 AI 里最难啃的泛化问题。

根据公开仓库和相关技术资料,SleepFM 的工程框架是先把多种 PSG 通道预处理成统一格式,再通过编码器提取 embedding,后续下游任务直接使用这些睡眠 embedding 做分类、分期或风险预测。

这意味着它的核心资产,不只是一个任务头,而是那层可迁移的“睡眠表示空间”。

第四步,把睡眠表征接到长期疾病结局上。

这是 SleepFM 真正让人震动的部分。

研究团队把睡眠数据和长期电子病历打通,分析超过 1000 个疾病类别,最终筛出 130 个可以被较稳定预测的疾病终点。

预测窗口是未来 6 年。

这里有两个指标最值得注意:

●C-index

●6-year AUROC

必须强调,网上很多传播把“0.84”说成“84%准确率”,这并不严谨。

更准确的说法是:

SleepFM 对全因死亡的预测达到 C-index 0.84。 C-index 衡量的是排序能力,也就是模型能否正确判断“在两个人之间,谁更可能更早发生某个事件”。

它不是大众语境下“答对了 84%”那种简单准确率。

但即便如此,0.84 依然是很强的结果。

论文摘要给出的关键结果包括:

●死亡:C-index 0.84

●痴呆:0.85

●心肌梗死:0.81

●心力衰竭:0.80

●慢性肾病:0.79

●卒中:0.78

●房颤:0.78

斯坦福新闻稿还提到,SleepFM 在帕金森病、高血压性心脏病、乳腺癌、前列腺癌等项目上也表现突出。

这说明一个非常深刻的事实:

睡眠不是某个专科的小问题,而是全身系统状态的综合输出。 神经退行性疾病、心血管疾病、代谢紊乱、精神问题,都会在夜间留下痕迹。

SleepFM 其实是在读取这些痕迹。

三

为什么“睡眠”能预测那么多病?

因为夜里是人体最不会伪装的时候。

白天,人可以靠意志、活动、情绪、药物、环境去掩盖很多问题。 夜间睡眠时,身体进入相对自动化运行,神经系统、循环系统、呼吸系统之间的真实协调状态,会暴露得更充分。

斯坦福团队在解释模型时提到一个非常重要的现象:

真正最有价值的信息,不一定来自单一通道,而常常来自不同通道之间的“对照”与“失配”。

比如:

●大脑看起来像睡着了,但心脏像醒着

●呼吸节律和脑电节律不同步

●某些睡眠阶段本应出现的恢复性模式没有出现

这类“系统不同步”现象,往往比单独一个指标异常更危险。

这也解释了为什么 SleepFM 不只是睡眠分期模型。

传统睡眠算法更像在问: 你现在是 REM、N1、N2 还是 N3?

而 SleepFM 更像在问: 这整晚身体各系统之间的耦合关系,呈现出怎样的健康轨迹?它预示着什么长期风险?

这是两个层级完全不同的问题。

前者是识别。 后者是建模。

四

从技术上看,SleepFM 有三个真正有分量的创新点。

第一,是把睡眠从“任务驱动建模”升级为“基础模型建模”。

这意味着未来不一定每来一个新任务,就要从头训练一个新模型。 只要基础表示足够好,下游只需做轻量微调,就能适配新的诊断或预测任务。

这会直接改变睡眠医学 AI 的研发效率。

第二,是把多模态生理信号当成一种“语言”来学。

GPT 学的是自然语言的统计结构。 SleepFM 学的是生理信号之间的时间结构和跨模态结构。

这其实代表着医学 AI 一个越来越清晰的方向: 未来最有价值的,不是单点检测模型,而是能理解人体复杂动态系统的基础模型。

第三,是把临床睡眠检查从“诊断工具”推进成“风险雷达”。

以往 PSG 更多用于:

●睡眠呼吸暂停诊断

●发作性睡病等睡眠障碍评估

●某些神经系统问题辅助判断

而 SleepFM 把它往前推了一步: 同样是一晚 PSG,不只是看“今天有没有病”,还看“未来几年会不会出事”。

如果这个方向继续成熟,睡眠实验室的价值就会被重估。

它不再只是处理打鼾、失眠、呼吸暂停的地方, 而可能变成慢病风险管理、神经退行性病变筛查、心血管事件预警的重要入口。

五

但越是这种“看起来像神迹”的成果,越要冷静。

SleepFM 很强,但它离“睡一觉知天命”还差得很远。

至少有四个边界,必须说透。

第一,它依赖的是临床级 PSG,不是消费级睡眠数据。

这是当前传播里最大的误导点。

论文和斯坦福新闻稿说的“单晚睡眠”,指的是一晚多导睡眠监测。 它采的是脑电、心电、呼吸、眼动、肌电等复杂数据。

这和手环上的睡眠评分,根本不是一回事。

所以,别把这项研究误读成“手表 App 马上就能预测 130 种病”。

离那一步,还远。

第二,它做的是风险预测,不是临床确诊。

模型说你未来 6 年某种疾病风险更高,不等于你现在已经得病。 它更像一个高价值预警器,而不是最终裁决者。

医学上,风险分层和确诊,是两件事。

第三,它揭示的是相关性,不是因果性。

SleepFM 能从睡眠里预测疾病,并不等于“睡眠本身导致了所有这些病”。 更可能的情况是:睡眠是一个高灵敏生理窗口,它把潜在病理过程提前反映了出来。

AI 读到了这些反映,不等于 AI 理解了全部病因机制。

第四,泛化能力虽然被验证,但仍需持续外部验证。

论文提到,模型在 SHHS 这个预训练未见过的外部数据集上也表现不错,这说明它不是只会背训练集。 但临床落地要面对的问题比论文复杂得多:

●不同国家人群差异

●不同医院采集标准差异

●不同年龄、性别、病史结构差异

●医疗流程中如何解释和使用模型输出

这些,决定了它能不能从“研究突破”变成“临床工具”。

六

真正值得深想的,不只是 SleepFM 本身,而是它背后的时代信号。

过去医学 AI 的主战场,是影像。

CT、MRI、病理切片,天然适合深度学习,所以大量医疗 AI 公司都扎堆在“看图识病”。

但 SleepFM 代表了另一条路: 从静态图像 AI,走向动态生理 AI。

这条路的难度更高,但天花板也可能更高。

因为人类疾病的本质,很多时候不是某一张图像上的一个点,而是系统在时间轴上的演化失衡。 而睡眠,是这种系统演化最密集、最连续、最真实的观测窗口之一。

从这个角度看,SleepFM 不是一篇普通论文。 它更像是在告诉整个行业:

未来医疗 AI 的核心竞争力,可能不是谁更会“看片子”,而是谁更能理解“人体动态系统”。

一旦这个方向跑通,接下来最自然的延伸就是:

●融合可穿戴设备长期数据

●结合电子病历、化验、影像和基因组

●做更长周期、更个体化的风险轨迹建模

●从一次性筛查走向持续健康监测

这才是 SleepFM 真正可怕的地方。

它不是一个终点。 它像一个入口。

七

再说回那句最吸睛的话:AI预测生死。

这句话传播力很强,但并不准确。

更准确的说法应该是:

AI 正在学会从夜间生理信号里,识别出人类身体通向疾病和衰亡的早期轨迹。

这不是宿命论。 这是预防医学的新边界。

最值得警惕的,不是“AI会不会知道你什么时候死”, 而是如果这种技术成熟后,整个医疗体系会发生什么变化:

●诊断会前移

●干预会更早

●医疗会从“治已病”加速转向“管风险”

●睡眠,将从生活方式议题,升级为核心健康基础设施

说到底,SleepFM 并不是在回答“人什么时候死”。

它真正回答的是: 人在真正病倒之前,身体会不会早就在夜里发出信号?

斯坦福这项研究给出的答案是:

会。 而且这些信号,已经开始被 AI 读懂了。

一句话收尾

真正震撼的,不是 AI 会算命; 而是人类第一次有机会,把“睡着时的身体语言”,翻译成未来健康的风险地图。

这件事一旦走向成熟,医疗就不再只是治病, 而会越来越像一场提前很久就开始的系统防御战。

资料依据

●Stanford Medicine:New AI model predicts disease risk while you sleep

●Nature Medicine / PubMed:A multimodal sleep foundation model for disease prediction

●SleepFM 开源仓库:SleepFM-Clinical

夜雨聆风

夜雨聆风