SkillClaw: Let Skills Evolve Collectively with Agentic Evolver

中文标题: SkillClaw:让技能通过智能体进化器集体进化

关键词: SkillClaw,collective skill evolution,multi-user LLM agents,autonomous evolver,cross-user knowledge transfer

简介: SkillClaw通过聚合用户交互,在多用户大语言模型智能体系统中实现集体技能进化,从而自主更新和改进整个生态系统中的可复用技能。

摘要: 诸如OpenClaw等大语言模型(LLM)智能体依赖可复用技能来执行复杂任务,但这些技能在部署后基本保持静态。因此,相似的工作流程、工具使用模式和失败模式在不同用户间被反复发现,阻碍了系统从经验中改进。虽然来自不同用户的交互提供了关于技能何时成功或失败的互补信号,但现有系统缺乏将这种异构经验转化为可靠技能更新的机制。为解决这些问题,我们提出了SkillClaw,一个用于多用户智能体生态系统中集体技能进化的框架,它将跨用户和随时间推移的交互视为改进技能的主要信号。SkillClaw持续聚合使用过程中生成的轨迹,并由自主进化器进行处理,该进化器识别反复出现的行为模式,并通过改进现有技能或为其扩展新能力,将其转化为技能集的更新。生成的技能维护在共享存储库中并在用户间同步,使得在一个上下文中发现的改进能够传播到整个系统,而无需用户付出额外努力。通过将多用户经验整合到持续的技能更新中,SkillClaw实现了跨用户知识转移和累积能力提升,在WildClawBench上的实验表明,在有限的交互和反馈下,它显著提升了Qwen3-Max在真实智能体场景中的性能。

链接: https://arxiv.org/pdf/2604.08377

Rethinking Generalization in Reasoning SFT: A Conditional Analysis on Optimization, Data, and Model Capability

中文标题: 重新思考推理SFT中的泛化:基于优化、数据和模型能力的条件分析

关键词: Supervised finetuning,Reinforcement learning,Cross-domain generalization,Chain-of-thought

简介: 监督微调和强化学习在推理任务中表现出条件性的跨域泛化,受优化动态、数据质量和模型能力的影响,在推理提升和安全退化之间存在不对称结果。

摘要: 大语言模型后训练中普遍认为监督微调(SFT)进行记忆,而强化学习(RL)进行泛化。我们针对长思维链(CoT)监督的推理SFT重新审视了这一主张,发现跨域泛化并非不存在,而是有条件的,由优化动态、训练数据和基础模型能力共同塑造。一些报告的失败是优化不足的产物:跨域性能在恢复和提升之前先下降(一种先降后升的模式),因此短训练检查点会低估泛化能力。数据质量和结构都很重要:低质量解决方案广泛损害泛化,而经过验证的长CoT轨迹则产生一致的跨域增益。模型能力至关重要:更强的模型即使从玩具算术游戏中也能内化可迁移的程序模式(如回溯),而较弱的模型则模仿表面的冗长性。然而,这种泛化是不对称的:推理提升而安全退化,将问题从推理SFT是否泛化转变为在什么条件下以及以什么代价泛化。

链接: https://arxiv.org/pdf/2604.06628

HY-Embodied-0.5: Embodied Foundation Models for Real-World Agents

中文标题: HY-Embodied-0.5:面向现实世界智能体的具身基础模型

关键词: Embodied AI,Foundation Models,Vision-Language Models,Mixture-of-Transformers

简介: HY-Embodied-0.5是一个面向具身智能体的基础模型系列,采用混合Transformer架构和迭代式后训练技术,以增强视觉感知和推理能力。

摘要: 我们推出了HY-Embodied-0.5,这是一系列专为现实世界具身智能体设计的基础模型。为了弥合通用视觉语言模型(VLM)与具身智能体需求之间的差距,我们的模型旨在增强具身智能所需的核心能力:时空视觉感知,以及用于预测、交互和规划的高级具身推理。HY-Embodied-0.5系列包含两个主要变体:一个专为边缘部署设计的拥有20亿激活参数的高效模型,以及一个针对复杂推理的拥有320亿激活参数的强大模型。为了支持具身任务所需的细粒度视觉感知,我们采用了混合Transformer(MoT)架构来实现模态特定的计算。通过引入潜在令牌,该设计有效地增强了模型的感知表征。为了提高推理能力,我们引入了一种迭代的、自我进化的后训练范式。此外,我们采用在线策略蒸馏将大模型的先进能力迁移到较小的变体中,从而最大化紧凑模型的性能潜力。在涵盖视觉感知、空间推理和具身理解的22个基准测试中进行的广泛评估证明了我们方法的有效性。我们的MoT-2B模型在16个基准测试中优于同等规模的最先进模型,而32B变体则实现了与Gemini 3.0 Pro等前沿模型相当的性能。在下游机器人控制实验中,我们利用强大的VLM基础训练了一个有效的视觉语言动作(VLA)模型,在现实世界物理评估中取得了令人信服的结果。代码和模型已在 https://github.com/Tencent-Hunyuan/HY-Embodied 开源。

链接: https://arxiv.org/pdf/2604.07430

When Numbers Speak: Aligning Textual Numerals and Visual Instances in Text-to-Video Diffusion Models

中文标题: 当数字说话:在文本到视频扩散模型中对齐文本数字与视觉实例

关键词: text-to-video diffusion,numerical alignment,training-free framework,attention modulation

简介: NUMINA通过一个无需训练的框架增强了文本到视频扩散模型的数值准确性,该框架识别布局不一致性并通过注意力调制引导重新生成。

摘要: 文本到视频扩散模型实现了开放式视频合成,但在生成提示词中指定数量的正确对象时往往存在困难。我们介绍了NUMINA,这是一个用于改进数值对齐的无需训练的识别-引导框架。NUMINA通过选择具有判别性的自注意力和交叉注意力头来推导可计数的潜在布局,从而识别提示词与布局之间的不一致性。然后,它保守地细化该布局并调制交叉注意力以引导重新生成。在引入的CountBench上,NUMINA将Wan2.1-1.3B的计数准确性提高了7.4%,在5B和14B模型上分别提高了4.9%和5.5%。此外,在保持时间一致性的同时,CLIP对齐也得到了改善。这些结果表明,结构引导补充了种子搜索和提示词增强,为计数准确的文本到视频扩散提供了一条实用路径。代码可在https://github.com/H-EmbodVis/NUMINA获取。

链接: https://arxiv.org/pdf/2604.08546

ClawBench: Can AI Agents Complete Everyday Online Tasks?

中文标题: ClawBench:AI智能体能完成日常在线任务吗?

关键词: AI agents,online tasks,evaluation framework,real-world tasks

简介: ClawBench提出了一个包含153个跨144个平台的真实世界任务的综合评估框架,用于测试AI智能体自动化需要复杂多步骤工作流程和文档处理的日常在线活动的能力。

摘要: AI智能体或许能够自动化你的收件箱,但它们能自动化你生活中的其他常规事务吗?日常在线任务为评估下一代AI智能体提供了一个现实但尚未解决的测试平台。为此,我们推出了ClawBench,这是一个包含153个简单任务的评估框架,这些任务是人们在生活和工作中需要定期完成的,涵盖15个类别的144个活跃平台,从完成购买和预约到提交求职申请。这些任务需要超越现有基准的高要求能力,例如从用户提供的文档中获取相关信息、在跨不同平台的多步骤工作流程中导航,以及像正确填写许多详细表格这样的重度写入操作。与在具有静态页面的离线沙箱中评估智能体的现有基准不同,ClawBench在生产网站上运行,保留了真实世界网络交互的全部复杂性、动态性质和挑战。一个轻量级拦截层仅捕获并阻止最终的提交请求,确保在没有真实世界副作用的情况下进行安全评估。我们对7个前沿模型的评估表明,专有模型和开源模型都只能完成这些任务的一小部分。例如,Claude Sonnet 4.6仅达到33.3%。在ClawBench上的进展使我们离能够作为可靠通用助手的AI智能体更近了一步。

链接: https://arxiv.org/pdf/2604.08523

MegaStyle: Constructing Diverse and Scalable Style Dataset via Consistent Text-to-Image Style Mapping

中文标题: MegaStyle:通过一致的文本到图像风格映射构建多样且可扩展的风格数据集

关键词: MegaStyle,style dataset,text-to-image style mapping,style-supervised contrastive learning,style transfer

简介: MegaStyle提出了一种可扩展的数据整理管道,用于利用大型生成模型创建高质量、风格一致的数据集,并提出了风格监督对比学习以实现有效的风格表示提取。

摘要: 在本文中,我们介绍了MegaStyle,这是一种新颖且可扩展的数据整理管道,用于构建风格内一致、风格间多样且高质量的风格数据集。我们通过利用当前大型生成模型的一致文本到图像风格映射能力来实现这一点,该模型能够根据给定的风格描述生成相同风格的图像。在此基础上,我们整理了一个包含17万个风格提示和40万个内容提示的多样且平衡的提示库,并通过内容-风格提示组合生成了大规模风格数据集MegaStyle-1.4M。借助MegaStyle-1.4M,我们提出了风格监督对比学习来微调风格编码器MegaStyle-Encoder,以提取富有表现力且风格特定的表示,我们还训练了基于FLUX的风格迁移模型MegaStyle-FLUX。大量实验表明,保持风格数据集的风格内一致性、风格间多样性和高质量的重要性,以及所提出的MegaStyle-1.4M的有效性。此外,当在MegaStyle-1.4M上训练时,MegaStyle-Encoder和MegaStyle-FLUX提供了可靠的风格相似度度量和可泛化的风格迁移,为风格迁移社区做出了重要贡献。更多结果可在我们的项目网站https://jeoyal.github.io/MegaStyle/上查看。

链接: https://arxiv.org/pdf/2604.08364

LPM 1.0: Video-based Character Performance Model

中文标题: LPM 1.0:基于视频的角色表演模型

关键词: Large Performance Model,video-based character performance,real-time conversational generation,identity consistency,multimodal conditioning,infinite-length video synthesis

简介: 一个用于实时对话角色表演生成的大规模多模态模型,在保持身份一致性的同时实现交互式、无限长度的视频合成。

摘要: 表演是通过视觉、声音和时间行为将意图、情感和个性外化的过程,它是赋予角色生命力的关键。从视频中学习这种表演是传统三维管线的一种有前景的替代方案。然而,现有的视频模型难以同时实现高表现力、实时推理和长期身份稳定性,我们将这种张力称为表演三难困境。对话是最全面的表演场景,因为角色在说话、倾听、反应和表达情感的同时,需要随时间保持身份一致性。为了解决这一问题,我们提出了LPM 1.0(Large Performance Model,大规模表演模型),专注于单人全双模态视听对话表演。具体而言,我们通过严格筛选、说话-倾听音视频配对、表演理解和身份感知多参考提取构建了一个以人为中心的多模态数据集;训练了一个170亿参数的扩散Transformer(Base LPM),通过多模态条件实现高度可控、身份一致的表演;并将其蒸馏为因果流生成器(Online LPM),以实现低延迟、无限长度的交互。在推理阶段,给定带有身份感知参考的角色图像,LPM 1.0能够根据用户音频生成倾听视频,根据合成音频生成说话视频,并通过文本提示控制动作,所有这些均在实时速度下完成,且生成结果身份稳定、长度无限。因此,LPM 1.0可作为对话代理、直播角色和游戏NPC的视觉引擎。为了系统评估这一设置,我们提出了LPM-Bench,这是首个用于交互式角色表演的基准测试。LPM 1.0在所有评估维度上均取得了最先进的结果,同时保持了实时推理能力。

链接: https://arxiv.org/pdf/2604.07823

KnowU-Bench: Towards Interactive, Proactive, and Personalized Mobile Agent Evaluation

中文标题: KnowU-Bench:迈向交互式、主动式和个性化移动智能体评估

关键词: Personalized Mobile Agents,Proactive Assistance,Preference Inference,GUI Evaluation

简介: KnowU-Bench提出了一个针对个性化移动智能体的综合基准,用于评估真实图形用户界面环境中的偏好推断和主动辅助能力。

摘要: 能够推断用户偏好并校准主动辅助的个性化移动智能体作为日常数字助手具有巨大潜力,但现有基准未能捕捉其核心需求。先前工作主要评估从静态历史记录中恢复偏好或在固定上下文中预测意图,均未测试智能体能否通过交互获取缺失偏好,也未能测试其在实时图形用户界面环境中决定何时干预、寻求同意或保持静默的能力。我们推出了KnowU-Bench,这是一个基于可复现Android模拟环境的个性化移动智能体在线基准,涵盖42个通用图形用户界面任务、86个个性化任务和64个主动任务。与先前将用户偏好视为静态上下文的工作不同,KnowU-Bench对智能体隐藏用户档案,仅暴露行为日志,从而强制进行真正的偏好推断而非上下文查找。为支持多轮偏好获取,它实例化了一个基于结构化档案的大语言模型驱动用户模拟器,能够实现真实的澄清对话和主动同意处理。除个性化外,KnowU-Bench还对完整的主动决策链提供全面评估,包括基于图形用户界面的执行、同意协商和拒绝后的克制,通过结合基于规则的验证与大语言模型作为裁判评分的混合协议进行评估。我们的实验揭示了显著的性能下降:在需要用户偏好推断或干预校准的模糊指令下,即使在Claude Sonnet 4.6等前沿模型上,擅长显式任务执行的智能体准确率也低于50%。核心瓶颈不在于图形用户界面导航,而在于偏好获取和干预校准,这暴露了熟练的界面操作与值得信赖的个人辅助之间的根本差距。

链接: https://arxiv.org/pdf/2604.08455

OpenVLThinkerV2: A Generalist Multimodal Reasoning Model for Multi-domain Visual Tasks

中文标题: OpenVLThinkerV2:面向多领域视觉任务的通用多模态推理模型

关键词: Gaussian GRPO,Multimodal Reasoning,Reinforcement Learning,Perception-Reasoning Balance

简介: 高斯GRPO通过使用分布匹配来确保梯度公平性和稳定的强化学习,解决了多模态模型训练中的挑战,从而在通用模型中实现了感知与推理之间平衡的改进。

摘要: 群体相对策略优化(GRPO)已成为推动多模态大语言模型近期发展的实际强化学习(RL)目标。然而,将这一成功扩展到开源多模态通用模型仍受到两个主要挑战的严重制约:不同视觉任务中奖励拓扑结构的极端差异,以及平衡细粒度感知与多步推理能力的固有困难。为了解决这些问题,我们提出了高斯GRPO(G^2RPO),这是一种新颖的强化学习训练目标,它用非线性分布匹配替代了标准的线性缩放。通过在数学上强制任何给定任务的优势分布严格收敛于标准正态分布N(0,1),G^2RPO理论上确保了任务间的梯度公平性,减轻了对重尾异常值的脆弱性,并为正负奖励提供了对称更新。利用G^2RPO提供的增强训练稳定性,我们引入了两种任务级塑形机制,以无缝平衡感知和推理。首先,响应长度塑形动态地激发针对复杂查询的扩展推理链,同时强制直接输出以增强视觉定位。其次,熵塑形紧密限制了模型的探索区域,有效防止了熵崩溃和熵爆炸。整合这些方法,我们提出了OpenVLThinkerV2,这是一个高度稳健的通用多模态模型。在18个不同基准测试中的广泛评估表明,其性能优于强大的开源模型和领先的专有前沿模型。

链接: https://arxiv.org/pdf/2604.08539

Externalization in LLM Agents: A Unified Review of Memory, Skills, Protocols and Harness Engineering

中文标题: LLM智能体的外部化:记忆、技能、协议与控制工程的综合综述

关键词: LLM agents,externalization,memory,skills,protocols,harness engineering

简介: 大型语言模型智能体正超越基于权重的修改,转而整合记忆、技能和协议等外部化组件,以提升可靠性和协调能力。

摘要: 大型语言模型(LLM)智能体的构建方式正日益从改变模型权重转向围绕模型重组运行时环境。早期系统期望模型内部恢复的能力,现在被外部化为记忆存储、可重用技能、交互协议以及使这些模块在实践中可靠的周围控制框架。本文通过外部化的视角回顾了这一转变。借鉴认知制品的理念,我们认为智能体基础设施的重要性不仅在于它添加了辅助组件,更在于它将艰难的认知负担转化为模型能够更可靠解决的形式。在这一观点下,记忆将状态跨时间外部化,技能将程序性专业知识外部化,协议将交互结构外部化,而控制工程则作为统一层,将它们协调为受控的执行。我们追踪了从权重到上下文再到控制框架的历史演进,将记忆、技能和协议分析为三种不同但相互耦合的外部化形式,并考察了它们在更大的智能体系统内部如何交互。我们进一步讨论了参数化能力与外部化能力之间的权衡,识别了诸如自演进控制框架和共享智能体基础设施等新兴方向,并探讨了评估、治理以及模型与外部基础设施长期协同演化方面的开放性挑战。结果是一个系统级框架,用于解释为何实用的智能体进展不仅越来越依赖于更强的模型,还依赖于更好的外部认知基础设施。

链接: https://arxiv.org/pdf/2604.08224

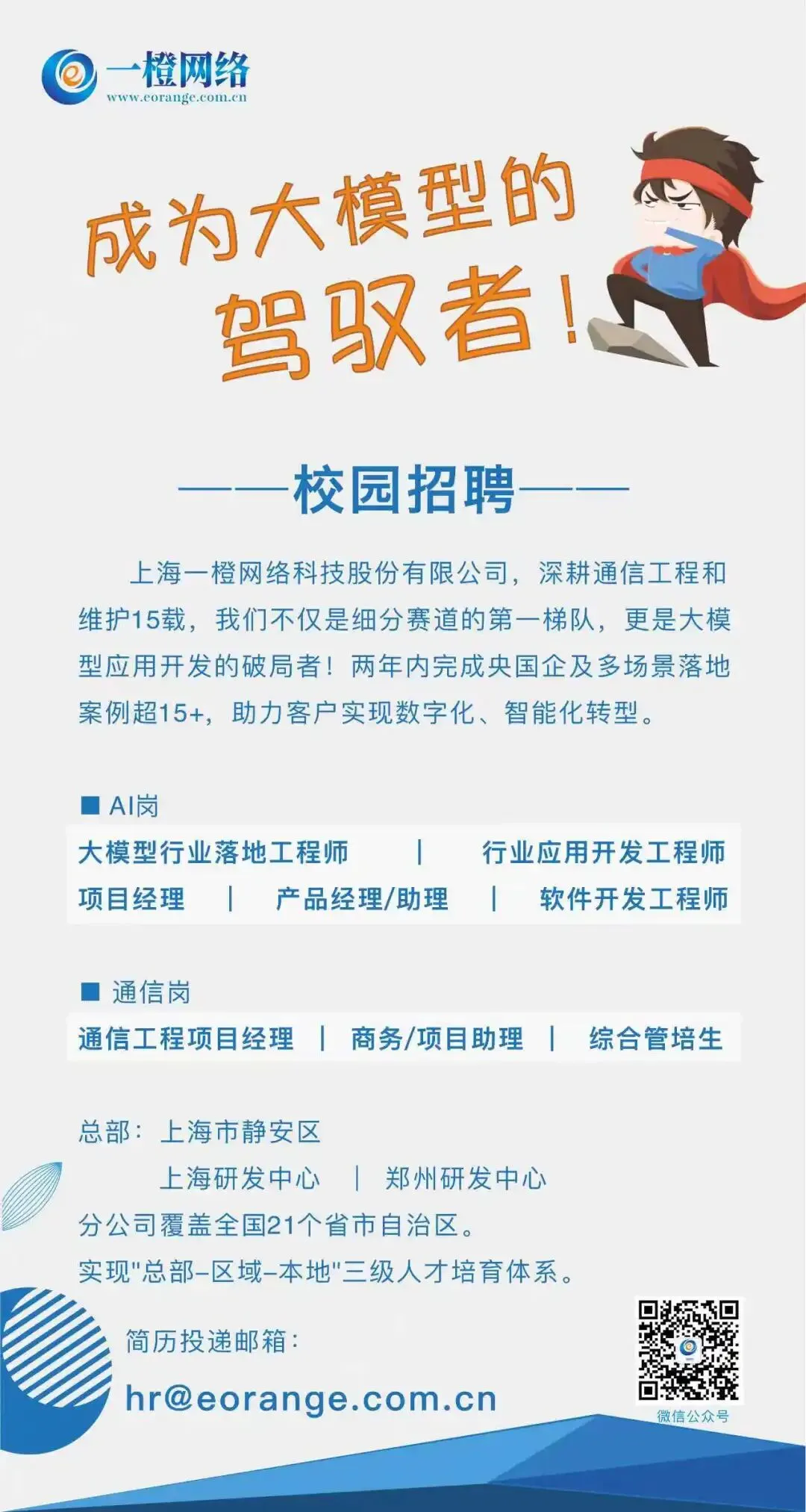

上海一橙智能科技有限公司,是上海一橙网络科技股份有限公司旗下专注于AI与大模型应用落地的核心企业,提供从平台构建到AI场景化应用落地的全栈服务。聚焦大模型应用、数字人交互、语音图像分析等核心领域,打造了覆盖智能外呼、智能客服、智能知识管理、智能陪练、多模态交互、图像语音质检等场景的AI产品体系,已成功为通信、能源等领域头部央国企客户打造出多个AI落地应用。

夜雨聆风

夜雨聆风