很多人第一次用 OpenClaw,都会经历一个类似的阶段。

刚上手时会觉得:

这东西真聪明,能写、能查、能调工具、还能像个助手一样跟你对话。

但用一阵子之后,热情很快就会往下掉。

原因也很常见:

• 让它做事,感觉时灵时不灵

• 隔一天再问同样的话题,它像失忆了一样

• 明明已经聊过很多轮,但它还是抓不住重点

• 你以为自己在“养一个助手”,最后发现更像是在“反复重新培训一个实习生”

于是很多人会得出一个结论:

是不是模型还不够强?

这其实是最容易出现、也最容易把方向带偏的误判。

因为这几天我反复看了一圈大家怎么写 OpenClaw,也顺手复盘了一些对标账号最近的内容之后,越来越强烈地觉得:

很多人把 OpenClaw 用不起来,不是因为模型不够强。

而是因为他们根本还没有把 OpenClaw 接进自己的工作系统。

说白了,问题常常不在“脑子”,而在“系统”。

具体看,通常卡在 3 个地方。

▲ OpenClaw 使用复盘封面图

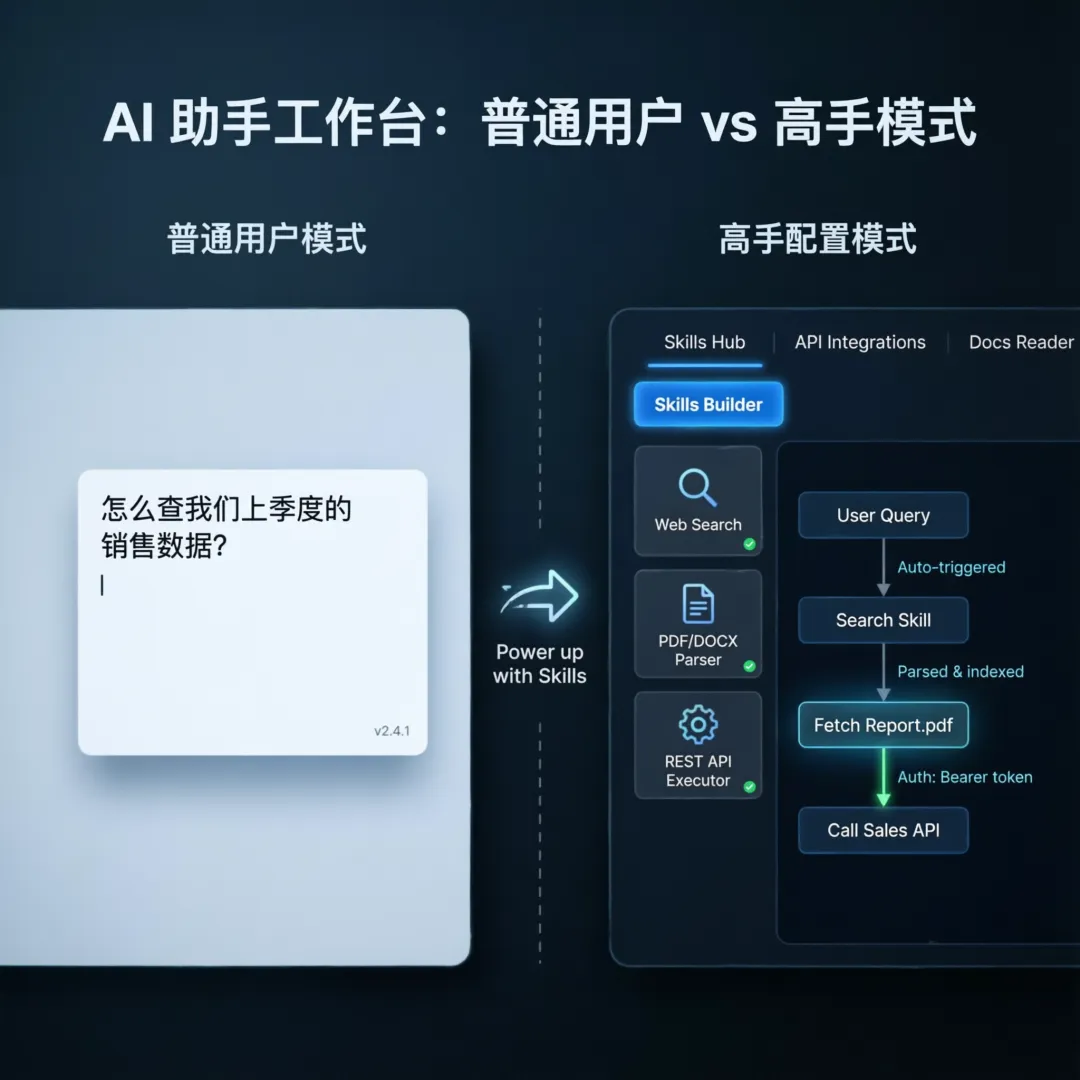

一、不会配 Skills,所以它只能“会回答”,不能“会做事”

这是最常见的一层问题。

很多人用 OpenClaw 的方式,还是停留在最原始的提问模式:

• 帮我写个文案

• 帮我总结一下

• 帮我想几个标题

• 帮我查一下这个信息

这样当然也能用。

但如果只停在这里,OpenClaw 在你手里就只是一种“更强一点的聊天工具”。

问题是,OpenClaw 的价值从来不只是“会回答”。

它真正厉害的地方,在于:

它能接工具、调能力、跑动作。

也就是说,一个装好、配好的 OpenClaw,和一个只会聊天的 OpenClaw,本质上根本不是同一种产品体验。

前者是助手。

后者只是问答框。

很多人觉得 OpenClaw 不够强,本质上不是模型不够强,而是:

你根本没有把它该有的能力边界打开。

就像一部新手机,刚开机也能打电话。

但你如果一直不装微信、不装地图、不装支付、不装相册编辑,它当然也就只能停留在“基础可用”。

所以为什么最近那么多对标文章都在反复讲 Skills?

因为 Skills 决定的不是“多一个功能”,而是:

你的 OpenClaw 到底是一个只能陪你聊天的 AI,还是一个能真正进到工作现场的 AI。

▲ Skills 配置与普通问答对比图

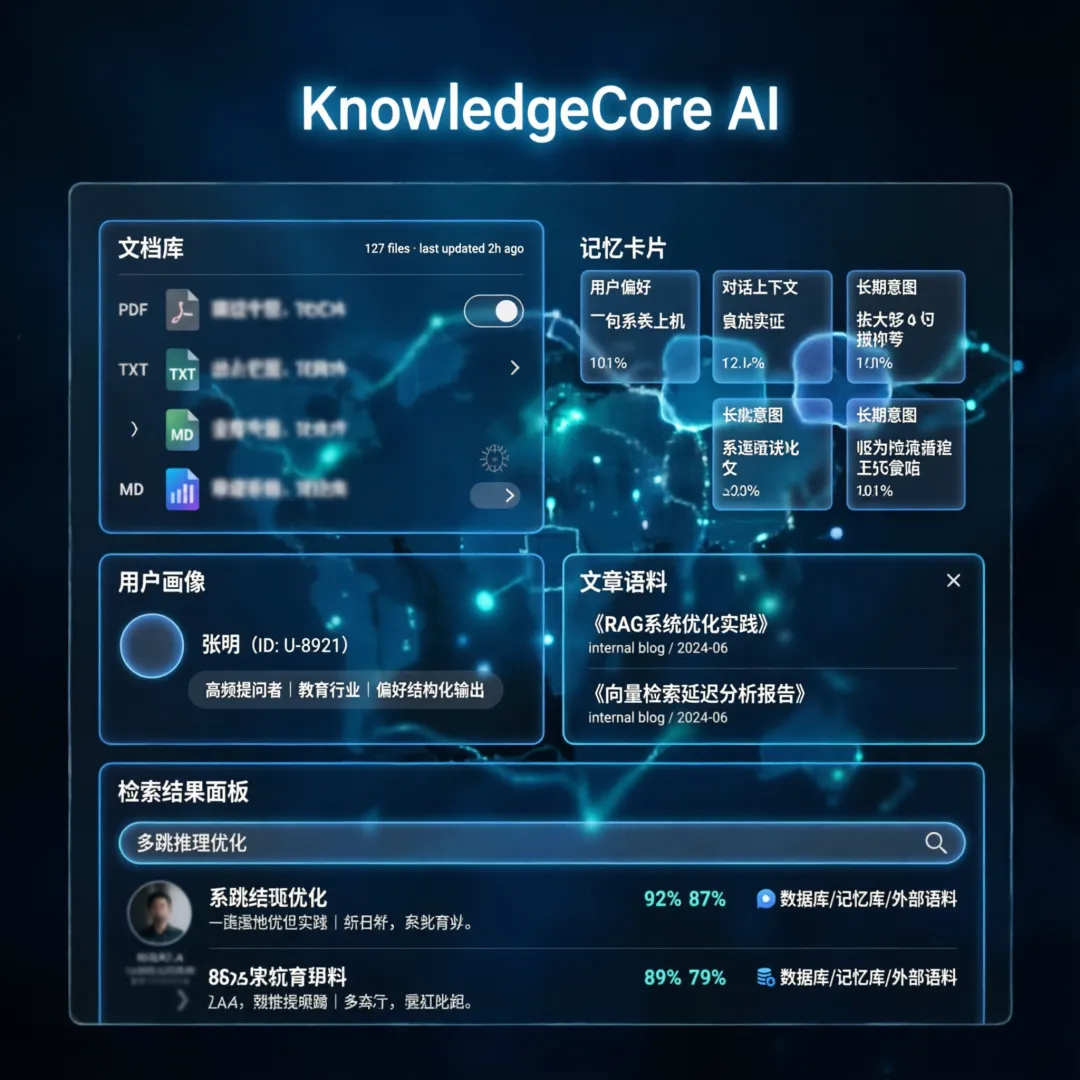

二、没有记忆系统,所以它每次都像第一次见你

第二个问题,比不会配 Skills 更隐蔽。

很多人其实已经让 OpenClaw 开始做一些任务了,

但用起来还是不顺,最典型的抱怨就是:

“它不记事。”

今天刚说过的背景,明天忘了。

上周已经确认过的偏好,这周还要再说一遍。

明明前面已经跑过一次流程,它下一次还是像从零开始理解你。

这时候很多人还是会继续怪模型。

但模型并不天然负责长期记忆。

大多数时候,模型只是在当前上下文里“临时表现得很懂你”。

如果没有记忆、没有知识接入、没有把你自己的资料和规则沉淀下来,

那它当然不可能真的变成一个“越用越懂你”的助手。

这也是为什么有的人会觉得:

• 同样是 OpenClaw,别人越用越顺

• 自己却总在重复解释、重复纠偏、重复从头来过

差别往往就在这里。

一个没有记忆系统的 OpenClaw,再聪明,也很容易停留在“短期聪明”。

而一个能持续记住信息、继承背景、接上知识源的 OpenClaw,才会真正开始“涨记性”。

这一步一旦跨过去,体验会完全不一样。

因为你不再是在反复使用一个“会说话的工具”,

而是在逐步培养一个“开始理解你工作方式的助手”。

▲ 知识库与记忆系统示意图

三、没有工作流,所以它始终只是零散帮忙,不会持续增值

第三个问题,是很多人最容易忽略的。

他们其实已经会问问题、会装一点能力、也知道要让 AI 帮自己做事。

但他们的使用方式仍然是碎片化的:

• 今天让它想标题

• 明天让它写个开头

• 后天让它总结一篇文章

• 再过两天让它整理一下会议内容

每次都能帮一点。

但每次都只是“帮一点”。

长期下来,用户就会觉得:

它有用,但没那么值钱。

为什么?

因为它没有进入你的工作流。

这里的差别非常大。

“零散提问”意味着:

AI 只是偶尔来帮你一下。

“进入工作流”意味着:

AI 开始参与一整条链路。

比如同样是做内容:

• 不是只让它起标题

• 而是让它参与对标扫描、选题判断、提纲拆解、初稿生成、标题优化、复盘沉淀

再比如同样是做项目:

• 不是只让它写一段说明

• 而是让它帮你整理需求、跟进事项、记录决策、调工具执行、沉淀文档

一旦 AI 从“单点协助”进入“连续流程”,它的价值感就完全变了。

你会开始明显感受到:

它不是在替你做一个动作。

它是在接住你的一部分工作系统。

而这,才是真正能把 OpenClaw 用顺、用深、用出差距的关键。

▲ AI 工作流编排界面图

四、真正拉开 OpenClaw 差距的,不是模型参数,而是你有没有把它接进自己的系统

很多人喜欢讨论模型。

哪个更强。

哪个更聪明。

哪个更会写。

哪个推理更厉害。

这些当然重要。

但如果只盯着这里,往往会把注意力放错地方。

因为在真实使用里,OpenClaw 能不能好用,往往不取决于“最强那一下”,而取决于“长期是否顺手”。

而“长期是否顺手”,靠的不是单次回答有多惊艳,

靠的是这三件事有没有搭起来:

• 能力扩展:它能不能调用该调的工具

• 记忆能力:它能不能记住你长期的背景和偏好

• 工作流接入:它能不能进入你日常反复发生的任务链条

这才是决定体验上限的真正因素。

也就是说,很多人以为自己在比较模型。

其实真正拉开差距的,是系统。

▲ 系统能力对比信息图

五、如果你现在也觉得 OpenClaw 不够好用,先别急着怪模型

如果你现在用 OpenClaw 也有类似感受:

• 聪明是聪明,但总觉得差一点

• 能干活,但不够稳定

• 偶尔惊艳,但长期不顺

• 聊起来不错,做起来一般

那你可以先别急着把锅甩给模型。

先问自己 3 个问题:

1)我有没有把该接的 Skills 接上?

如果没有,它大概率还只是个问答工具。

2)我有没有给它记忆和知识来源?

如果没有,它每次都只能临时理解你。

3)我有没有把它放进一个固定工作流里?

如果没有,它就只能零碎帮忙,很难持续增值。

你会发现,很多“OpenClaw 不够强”的抱怨,

最后其实都能落回到这三个问题上。

结语

OpenClaw 真正的价值,从来不只是“回答得像不像一个聪明人”。

而是它能不能逐渐变成一个:

会做事、会记事、能进入你工作系统的助手。

当你开始用系统的方式去用它,

你会发现它的变化不是“更会聊天了”,

而是“终于开始像一个真正的助手了”。

所以,很多人把 OpenClaw 用不起来,问题真不一定在模型。

更大的可能是:

你还没把它,从一个 AI 对话框,真正用成一个 AI 助手。

如果你也在持续观察 OpenClaw、Agent、Skills、记忆和工作流这条线,欢迎点个关注。

后面我会继续把值得拆、值得学、值得直接拿来用的内容,尽量讲明白一点、讲透一点。

夜雨聆风

夜雨聆风