IBM10分钟讲透多模态AI:为什么2026 AI不再是“只会聊天”,而是能看、能听、能任意生成

AI发展太快,很多人还在用“ChatGPT只会打字”这个旧认知。

IBM技术专家Martin Keen最新视频,把多模态AI这个2026最核心概念一次性讲透。

看完你会明白:真正的AI革命不是更大模型,而是让AI同时处理多种数据类型——文字、图片、音频、视频,甚至LIDAR、热成像……全部打通。

一、什么是“模态”?为什么需要“多模态”?模态 = 数据类型。

- 单模态LLM:输入文本 → 输出文本(最常见的ChatGPT式)。

- 多模态AI:能同时输入和输出多种模态。

例子:你发一张手机截图+一句文字“帮我解决这个问题”,AI就能直接看图+理解文字并给出方案。

金句:多模态AI让AI从“只会听你说话”变成“真正看得见、听得懂”。

二、早期方案:模块化特征融合(已过时但仍有用)早期多模态系统像“拼装”:

- 一个文本LLM

- 再加一个视觉编码器(类似CLIP)

- 图像先被编码成数值特征向量,再塞进LLM。

优点:模块可替换、成本低。

缺点:信息在传递中会丢失,LLM看到的只是“总结版”图像,不是原始信号。

金句:早期方案像翻译官,容易丢细节;现在的主流是让AI自己同时看原文。

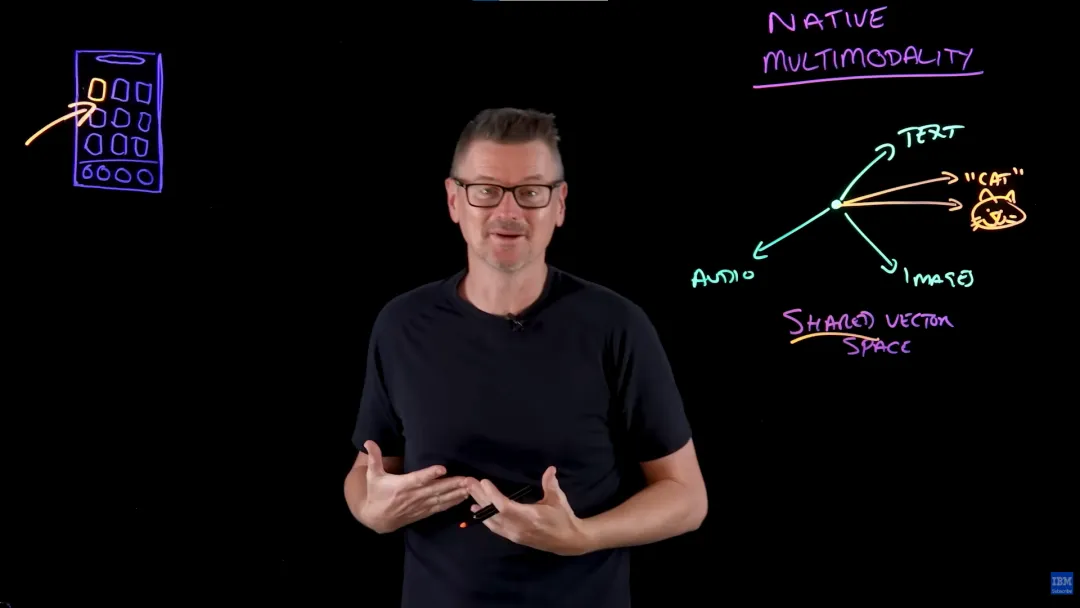

三、2026主流:原生多模态 + 共享向量空间(核心技术)最先进的方式是原生多模态:

所有数据类型(文本、图像、音频)都被分块 + 嵌入到同一个高维向量空间。

- 文字:词/子词 → 向量点

- 图像:切成小块(patches)→ 每个块一个向量点

- 音频:切成小段 → 向量点

这些点在同一空间里,模型能同时关注文字和图像,自动找到关联。

例子:你问截图右下角那个小图标是什么,模型能直接聚焦那个位置。

金句:共享向量空间让AI不再“翻译”,而是真正“同时思考”多种模态。四、视频处理:时序推理是关键视频比静态图像难,因为有时间维度。

早期方法:随机抽几帧 → 视觉编码器处理(容易丢失动作顺序)。

现在:模型直接理解“先拿起水瓶 → 再放下”这类时序信息。

金句:多模态AI真正厉害的地方,是能理解“事情发生的顺序”。五、任意输入 → 任意输出(Any-to-Any)原生多模态的终极形态:

输入文字+图片 → 输出视频;输入音频 → 输出文字+图像……

这才是2026 AI创新的真正引擎。看完立刻行动:

- 打开Gemini或Claude,上传一张图片+文字prompt,测试多模态能力。

- 试着问一个“看图说话”问题,感受共享向量空间的威力。

- 把今天一个工作场景改成多模态prompt(截图+文字),让AI帮你解决。

你现在最想用多模态AI解决什么问题?是看图分析、视频理解,还是图文混合生成?评论区告诉我,我挑高赞帮你写第一条实战prompt模板~

夜雨聆风

夜雨聆风