伴随情感计算、自然语言处理、多模态交互等人工智能技术发展,涌现出很多陪伴类AI产品或服务,如Character.AI(角色塑造)、LoveyDovery(偶像角色恋爱)等,覆盖养老、教育、心理疗愈、日常社交等多元场景。但同时,陪伴类AI产品或服务引发了擦边内容、隐私泄露、虚拟情感依赖等一系列安全风险。

为平衡技术创新与风险防控,全球主要国家或地区都不约而同地采取了一定的监管措施来规范陪伴型AI的发展与应用。

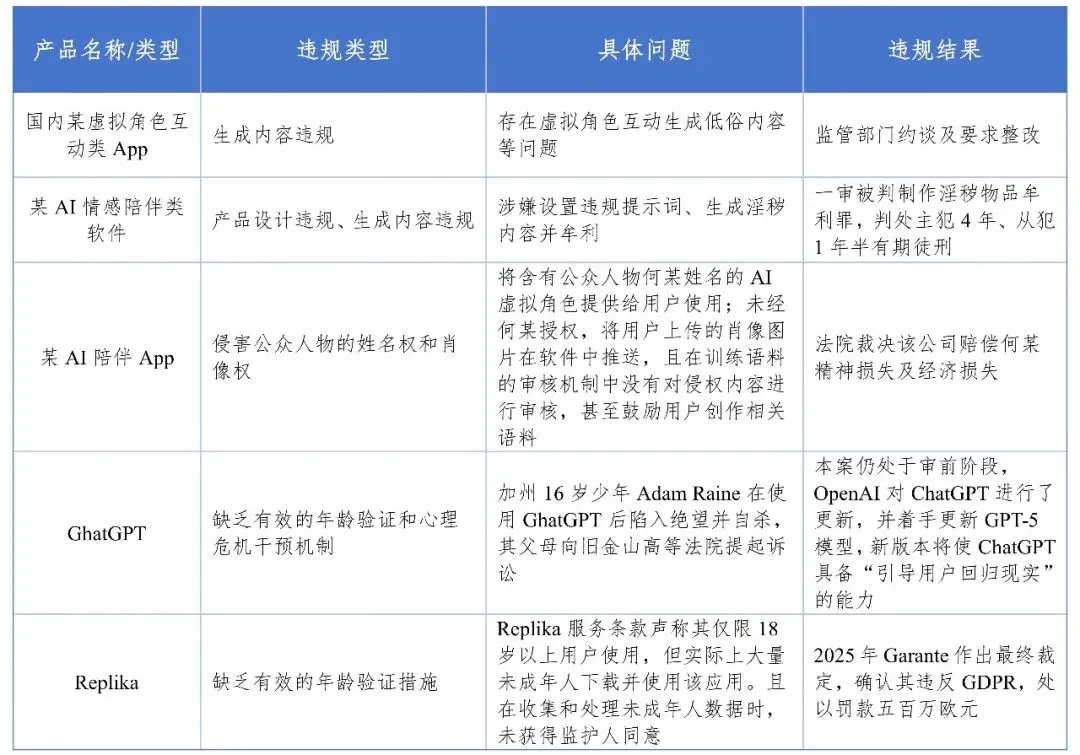

全球主要违规案例

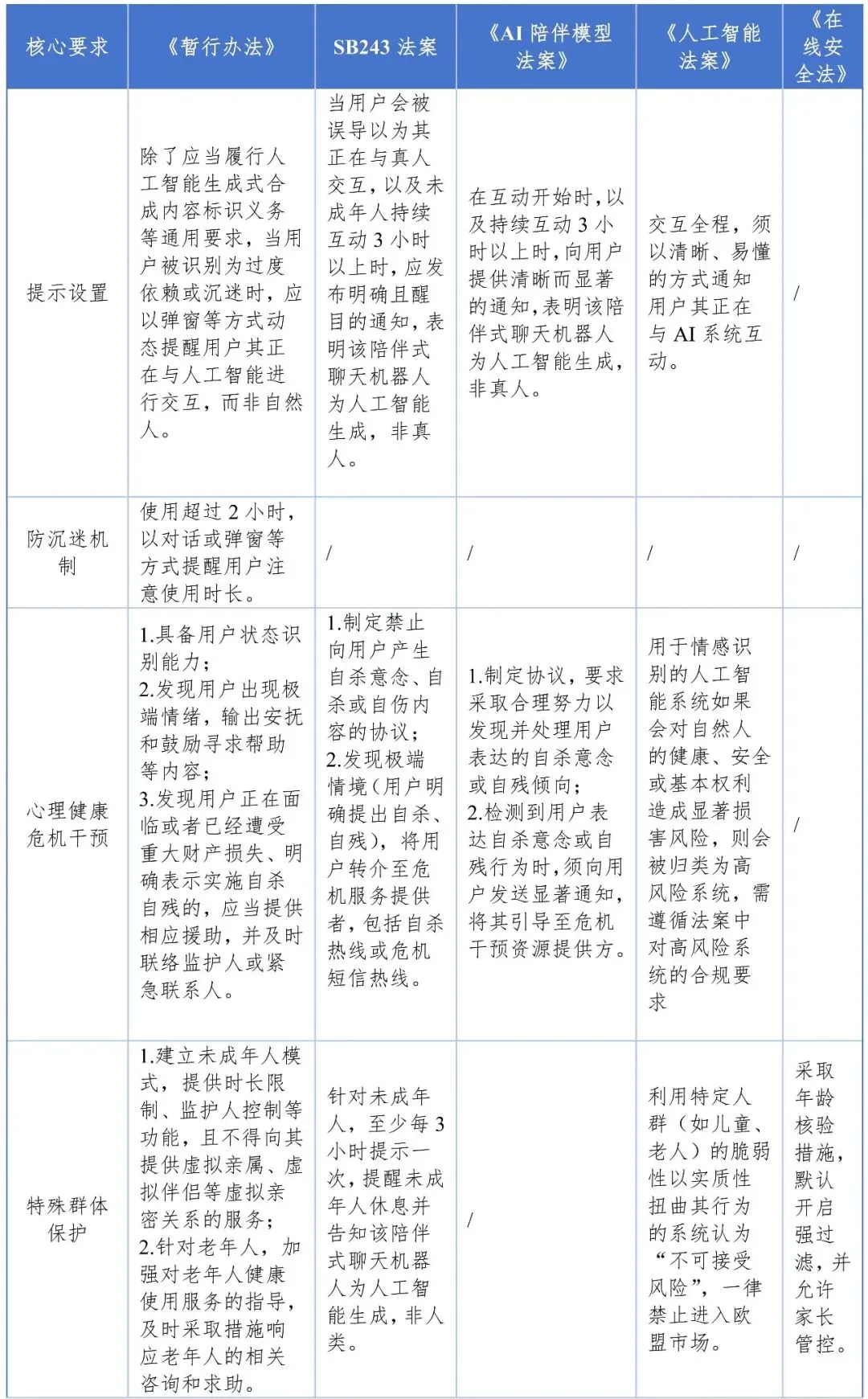

全球主要国家/地区监管对比

2026年4月10日,国家网信办正式发布《人工智能拟人化互动服务管理暂行办法》(以下简称《暂行办法》),并于7月15日起施行。《暂行办法》的出台,填补了陪伴型AI专项监管的空白,为提供拟人化互动服务的服务商提供了合规指引。

美国在联邦层面尚未形成统一的监管规则,但各州已陆续先行先试,针对AI提供情感陪伴服务制定具体的监管规则。如2025年9月加利福尼亚州通过了SB243法案(Companion AI Chatbots)。2025年11月纽约州发布并生效了《AI陪伴模型法案》(AI Companion Models Law)。

欧盟尚未针对陪伴型AI这一特定类型的人工智能出台专项法规,但在现行的《人工智能法案》中有一些适用于陪伴型AI的规定。

英国同样暂未制定专项法规,但考虑到陪伴型AI安全风险愈演愈烈,英国通信管理局(Ofcom)于2024年11月发布了致英国在线服务提供商关于生成式AI和聊天机器人的公开信,指导并详细说明英国于2023年发布的《在线安全法》如何适用于生成式AI和聊天机器人。

全球主要国家/地区核心监管要求对比

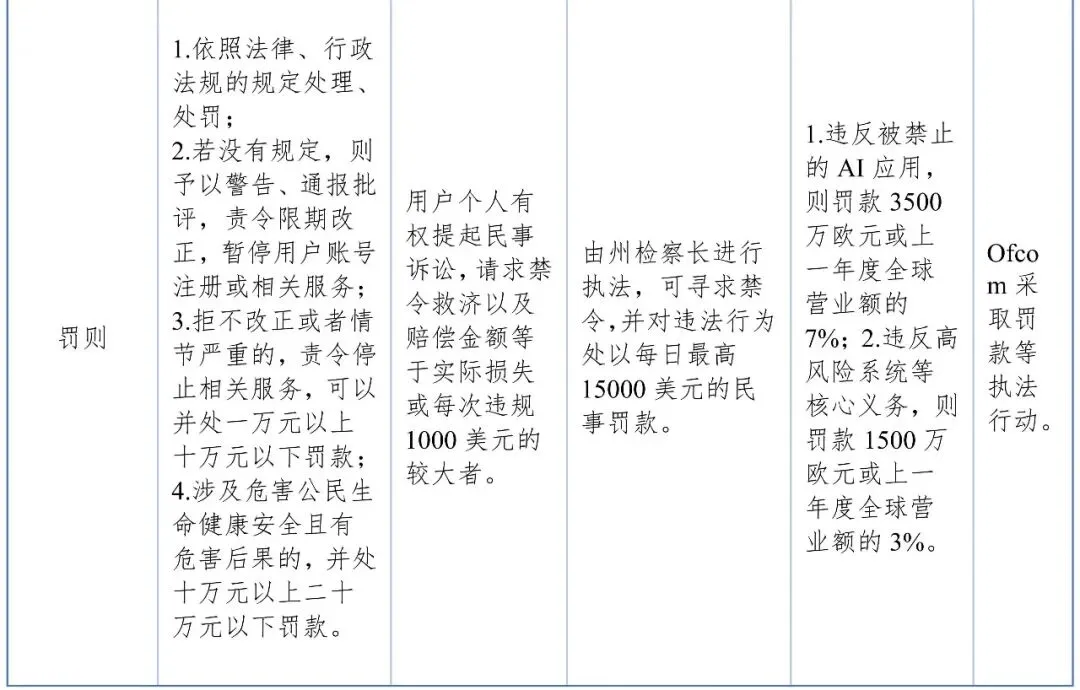

通过对全球主要国家或地区监管实践的横向对比可以看出,针对陪伴型AI,不同司法辖区在监管路径、规则设计、执行力度、救济方式等方面虽有不同,但在核心关切上呈现出高度趋同之势。

全球监管共识

(一)情感安全与内容安全并行

全球监管打破了传统的仅关注内容合规的治理逻辑,形成内容安全与情感安全的双重监管要求。一方面,严禁陪伴型AI输出低俗、淫秽、暴力、违法违规内容,确保内容符合所在国家或地区的法律规定和公序良俗;另一方面,要求可以识别和评估用户的情绪状态。当识别到用户有极端情绪时,可以进行积极正向的引导,避免肯定或漠视用户的极端情绪。当识别到用户有自残、自杀等极端情感倾向时,可以提供专业的危机服务通道,实现从内容管控到情感干预的监管升级。

(二)高度重视特殊群体保护

当用户与陪伴式AI持续互动获得正向反馈时,会促进多巴胺的分泌,强化愉悦体验,形成“渴求”驱动,进而导致成瘾或沉迷。由于未成年人的认知控制网络系统尚未成熟,相较于成年人,其更易对陪伴型AI产生情感依赖。因此对未成年人实施更加严格的保护成为全球监管的一致选择。各国均通过设置年龄限制、要求监护人同意、开通监护人控制功能、定时休息提示等方式,从使用准入、过程管控、家长监督等多维度防范未成年人沉迷,将未成年人保护作为陪伴型AI监管的核心内容。

除了未成年人,我国及欧盟等国家注意到老年人及抑郁症等人群由于孤独、心理脆弱等问题,同样容易对陪伴型AI产生高度依赖甚至沉迷,因此强调提供服务者加强对老年人健康使用服务的指导,且不得利用其脆弱性,如通过模拟老年人用户亲属、特定关系人等方式诱导老年人转账或购买虚假产品。

(三)AI身份透明化提示实现常态化

陪伴型AI因其模拟人类人格特征、思维模式和沟通风格,持续与用户进行情感互动,极易激活人类大脑的“奖赏环路”,相较于通用人工智能,用户对其更容易形成心理依赖,当控制能力不足以抗衡奖赏驱动时,甚至出现“AI是人”的误区。为避免用户因认知混淆对陪伴型AI产生不当情感依赖,或被诱导实施不当行为,陪伴型AI身份的透明化提示已成为全球监管的基础要求,且呈现常态化、全流程化的特点。提示时机覆盖互动开始、持续互动、易误导场景等全环节,无监管空白;提示形式根据交互形态,不限于弹窗、口头、书面等多种形式,确保醒目、清晰、易懂。

国内陪伴型AI行业合规启示

结合全球陪伴型AI监管的共性要求与国内专项监管规则的具体导向,从产品全生命周期管理视角出发,梳理产品上线前、运营过程中、产品下线时等关键阶段的合规重点与实操要求,助力企业在技术创新的同时筑牢合规防线,实现行业健康可持续发展。

(一)产品上线前

提供陪伴型AI产品的企业,在产品上线前主要要做到产品准入与设计合规。在产品准入方面,首先,在上线拟人化互动服务相关功能时需进行安全评估。安全评估的内容包括但不限于用户情况,未成年人、老年人等网络保护措施,极端情境防范措施,投诉举报机制,安全保障措施,训练数据处理及整改情况等,且安全评估报告需向属地省级网信部门提交。其次,应当按照《互联网信息服务算法推荐管理规定》履行算法备案手续。

在安全设计方面,一方面要保障训练数据合规。数据集要符合社会主义核心价值观,对训练数据进行清洗、标注,评估合成数据安全性,保障训练数据来源合法、可追溯。另一方面要预设功能模块。在注册功能模块,要求用户提供年龄、监护人或紧急联系人等必要信息;设计显著的“AI交互”提示标识,实现在用户过度依赖时,以弹窗等方式动态提醒用户交互内容为人工智能生成;预设针对极端情绪及高风险倾向(如自杀、财产安全)的安抚回复模板及专业援助方式,实现对用户的及时安慰;设计便捷的退出途径,严禁阻拦用户退出。

(二)产品运营过程中

在产品运营过程中,陪伴型AI企业需格外关注动态监测与即时干预、数据安全与隐私,以及重大变更与持续评估等方面的安全治理。首先,企业需持续监测用户的情绪及沉迷程度,当监测到用户表现出自杀、自残等极端情境时,必须提供相应援助予以干预,并及时联系用户监护人或者紧急联系人;当监测到用户已连续互动超过2小时,须弹窗提醒用户注意使用时长。其次,对交互数据采取加密、安全审计、访问控制等安全措施;除非取得用户的明确同意,否则不得向第三方提供交互数据;除非取得用户的单独同意,否则不得将属于用户敏感个人信息的交互数据用于模型训练。最后,使用新技术新应用,导致拟人化互动服务发生重大变更,或者产品运营过程中注册用户达到100万以上或者月活跃用户达10万以上,企业需重新进行安全评估。

(三)产品下线时

产品下线时企业需履行提前告知、数据善后、妥善处理用户依赖,以及注销算法备案等义务。履行提前告知义务,无论是因技术故障还是业务调整导致服务无法使用,企业必须通过站内信、短信或公告等方式提前告知用户,并说明原因。提供数据善后选项,在下线前,提供便捷通道,允许用户自行导出或彻底删除其历史交互数据。妥善处理用户依赖,在终止服务前,提供替代的援助信息或引导建议,减少对用户情感的冲击,对于陪伴型AI而言,下线可能导致用户(特别是老年人、孤独人群)产生情感失落,需做好心理缓冲。

若企业的产品同时还面向未成年人或老年人,则还有一些额外合规要求需企业注意。在产品上线前,在安全设计方面,预置“一老一小”保护功能。针对未成年人,开发未成年人使用模式,须具备使用时长限制、监护人控制等功能,允许监护人实时接收风险、查阅使用信息、限制功能与消费等。禁止开发模拟未成年人亲属或伴侣的换脸或拟声服务。针对老年人,设计更加显著的方式提示安全风险,设计更为便捷的方式响应老年人的咨询和求助。在产品运营过程中,若识别到疑似未成年人在使用服务后要强制切换为未成年人模式,不满十四周岁要取得监护人的同意。

陪伴型AI的涌现,是人工智能技术向情感领域延伸的必然结果,其背后是人们对情感陪伴的真实需求,更是科技赋能生活的重要体现。从全球监管实践来看,陪伴型AI的发展始终离不开创新与规范的双向平衡。未来,陪伴型AI行业唯有紧跟监管要求,筑牢合规底线,深耕技术创新,才能真正实现技术价值与社会价值的统一。愿陪伴型AI在监管的护航下,成为更温暖、更安全的科技产品。

文章作者:赛博研究院咨询经理 高雅

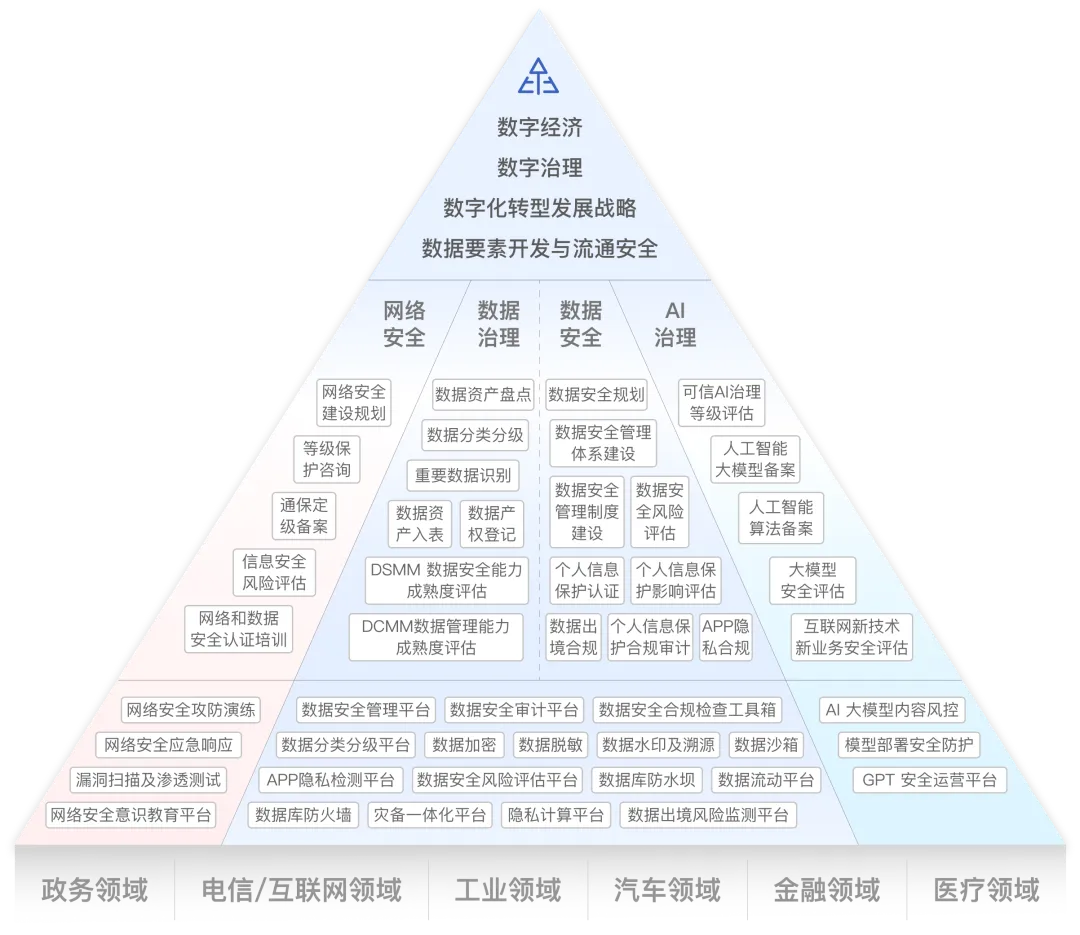

关于赛博研究院

上海赛博网络安全产业创新研究院(简称赛博研究院),是上海市级民办非企业机构,成立至今,赛博研究院秉持战略、管理和技术的综合服务模式、致力于成为面向数字经济时代的战略科技智库、服务数据要素市场的专业咨询机构和汇聚数智安全技术的协同创新平台。

赛博研究院立足上海服务全国,是包括上海市委网信办、上海市通管局、上海市经信委、上海市数据局等单位的专业支撑机构,同时承担上海人工智能产业安全专家委员会秘书长单位、上海“浦江护航”数据安全工作委员会秘书长单位、上海数据安全协同创新实验室发起单位等重要功能,并组织“浦江护航”数据安全上海论坛、世界人工智能大会安全高端对话等一系列重要专业会议。

欢迎联络咨询:

邮件:public@sicsi.org.cn;

电话:021-61432693。

夜雨聆风

夜雨聆风