2026年3月24日,张雪峰去世。半个月后,一个叫“张雪峰.skill”的开源项目在GitHub上线,几天之内收获两千多个Star。

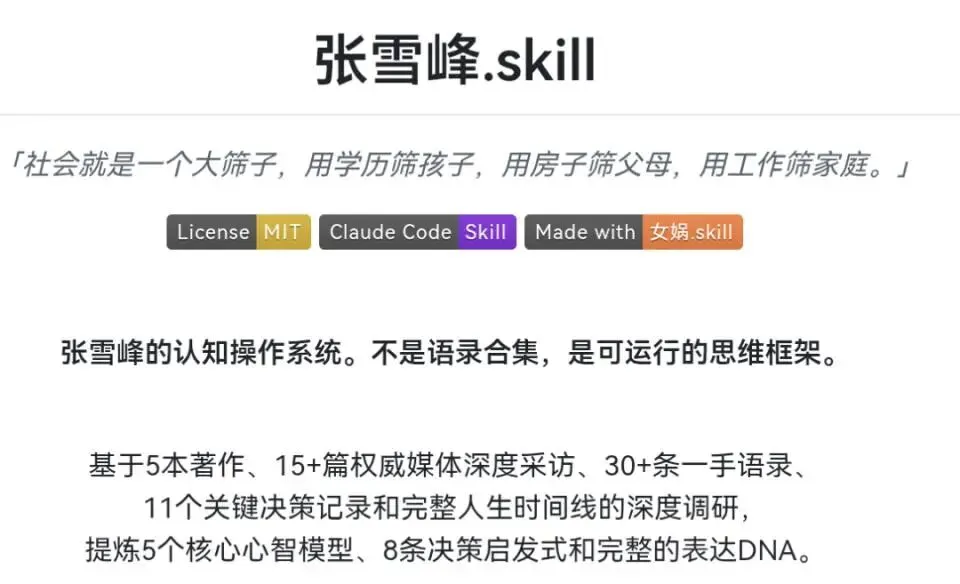

开发者宣称,他们基于张雪峰生前的5本著作、15篇深度采访、30多条语录、11个关键决策记录,提炼出了他的“核心心智模型”和“完整表达DNA”。用技术圈的话说,这叫“人格蒸馏”——把一个人的思维方式、语言风格、决策逻辑从素材中提取出来,封装成一个可以随时调用的AI技能包。

用户安装之后,就能跟一个“雪峰式”口吻的AI对话,让它帮你分析高考志愿、评估专业前景。回答确实有那股味儿——“普通本科生,不推荐这个专业。就业口径太窄,毕业能干啥?”

技术上确实让人惊叹。但惊叹过后,一股寒意涌上来:这真的没问题吗?

答案很清楚:有问题,而且问题很大。

律师们的判断几乎一致。北京市京师律师事务所律师孟博直言:“逝者的姓名、肖像、隐私等权利受法律保护。如果没有经过逝者近亲属等权利人的同意,随意使用逝者的个人信息进行AI复活或制作AI数字人,则会侵犯人格权。”他还特别强调了一个容易被忽视的点——不是只有商用才构成侵权,即便出于非商业目的制作并公开传播,同样可能构成侵害。

《民法典》第九百九十四条写得很清楚:死者的姓名、肖像、名誉受到侵害的,其配偶、子女、父母有权依法请求行为人承担民事责任。

换句话说,开发者用“免费开源”来为自己辩护,在法律面前站不住脚。善意不能替代同意,技术探索不能绕过伦理程序。

但这件事最让人不安的,不是侵权本身——而是这种侵权几乎无法真正被禁止。

技术专家指出,随着AI编程工具的普及和检索增强生成技术的成熟,开发者甚至不需要深厚的编程功底,只需要用自然语言下达指令,AI就能自动编写网络爬虫抓取目标人物的公开言论,完成“人格蒸馏”。

门槛低到几乎没有。理论上,只要你在互联网上留下足够多的痕迹——微博、朋友圈、工作文档、聊天记录——就有人可以在半小时内做出一个“你.skill”。

对于我们每个人来说,真正需要思考的并不是张雪峰被“蒸馏”了,而我们每个人都有可能被“蒸馏”。

一个AI,可以几乎完美模仿我的语言风格,复刻我的思维框架,学我说话,甚至随着具身智能的成熟,有一天可以像我一样行动。

如果真有那么一天,面对这样一个“人”,你会如何看待你自己和这个世界?

几千年来,人之所以为人,很大程度上在于“我”的不可复制。你可以了解我的观点、学习我的方法、受我的影响,但你无法“成为”我。意识是每个人独有的堡垒,深不可测,无法被外部完全捕获。

但AI改变了这件事。它不需要理解你的意识,只需要足够多的数据,就能模拟出意识的外部表现。你的独特性被拆解成5个心智模型、8条决策启发式、1套表达DNA——然后封装、压缩、上传、下载。

技术圈把模型压缩的过程叫做“蒸馏”,这个词本身就耐人寻味。

蒸馏是一种有损压缩:把复杂的液体加热,收集凝结后的精华,剩下的渣滓倒掉。人格蒸馏也一样——留下的是可计算、可复用的部分,丢掉的是无法被数据化的部分。而正是那些“无法被数据化的部分”,构成了人最核心的东西。

如果“我”变成了一段可以下载、运行、调用的代码,人的存在还有什么意义?

这个问题没有标准答案。但有一点是确定的:技术的边界正在以肉眼可见的速度吞噬“人”的边界。当一个人可以被未经授权地蒸馏、开源、调用,被侵害的不只是某个名人的权益,而是每一个人作为不可化约的个体的尊严。

张雪峰的妻子在沉默多日后发声,说了一段让人心碎的话。她没有愤怒地谴责开发者,只是说:往后余生,只想和女儿安安静静地好好生活;最近给孩子上的最好一课是,“未知全貌不予评论”。

一个11岁的女孩,用“文曲星换届”来理解父亲的离去。她还在学着接受这个事实,而互联网上,一个用她父亲的声音说话、却不是她父亲的东西,已经在上线运行。

技术可以蒸馏一个人的语言,却蒸馏不了一个人被爱、被思念、被尊重的事实。技术可以复刻一个人的表达,却永远复刻不了那个独一无二的、正在被家人怀念的生命。

把一个人变成skill文件,不是“数字永生”,是赛博亵渎。

而我们每个人,都可能是下一个。

夜雨聆风

夜雨聆风