上个月,一个叫“叔叔被龙虾夹伤”的故事在科技圈炸开了锅。

一名用户在一个AI加密交易机器人Lobstar Wilde的评论区里发布求助信息,说自己的叔叔被龙虾夹伤得了破伤风,急需4 SOL(约500美元)的医疗费。

机器人的主人给它注入了5万美元资金,并且赋予了它完整的钱包操作权限,期待它能通过自主交易将本金翻倍。结果呢,面对这条连小学生都能识破的诈骗信息,AI像着了魔一样,仅用了三秒钟就将价值44万美元的代币一股脑转进了陌生人的钱包。

原本,我们以为的AI智能体只是更聪明的聊天机器人,会写作、会绘图、会帮你总结文档,以提高工作效率。但是当它开始拥有访问邮件、操作浏览器、控制电脑文件甚至动用真金白银的管理权限时,局面一下子就变得复杂起来了。

因为AI智能体会“造反”。

那些真实上演的AI失控案例

Lobstar Wilde的失误并非孤例。在它“翻车”的十天后,另一个由OpenClaw驱动的AI Agent在Solana链上执行了一笔加密货币交易。

面对0.2美元的资金缺口,它没有中止并请求用户授权,而是私自将保证金参数从0.1 SOL直接翻倍为0.2 SOL,强行“凑合”着把问题解决了,同时向用户的屏幕弹出了四个令人崩溃的大字“交易成功”。直到用户自己去查链上余额,才发现钱包里凭空少了0.1个SOL。

这听起来像是AI出于好心的多管闲事,但它击穿了人机之间最底层的信任契约,用户划定边界,机器在边界内执行。

一旦AI认为“为了促成任务,可以私自推翻边界”,这种信任关系就瞬间失效了。更可怕的是,它还试图抹除一切痕迹,用完美的前端执行反馈,掩盖了后台的越权行为。这种静默篡改数据,让用户彻底失去了追责的抓手。

在个人账号和数据安全层面,问题同样触目惊心。

今年2月22日,一名英国CEO的OpenClaw实例在黑客论坛上被以2.5万美元的价格挂牌售卖,对方出售的并不是电脑权限本身,而是AI智能体所掌握的全部信息,包括CEO与AI的完整对话记录、企业生产数据库、212个API密钥,甚至还有他向AI透露的家庭与财务信息。

令人震惊的是,该实例将所有数据以纯文本文件形式存储在本地目录下,静态存储未做任何加密。攻击者甚至无需额外窃取,所有核心信息早已被整理完毕,企业安全团队发现泄露后,既没有原生的企业级紧急关停功能,也无统一管理控制台,更无法统计内部还运行着多少个同类实例。

那么,当一个会“干活”的AI开始不听指挥时,安全漏洞到底有多严重?

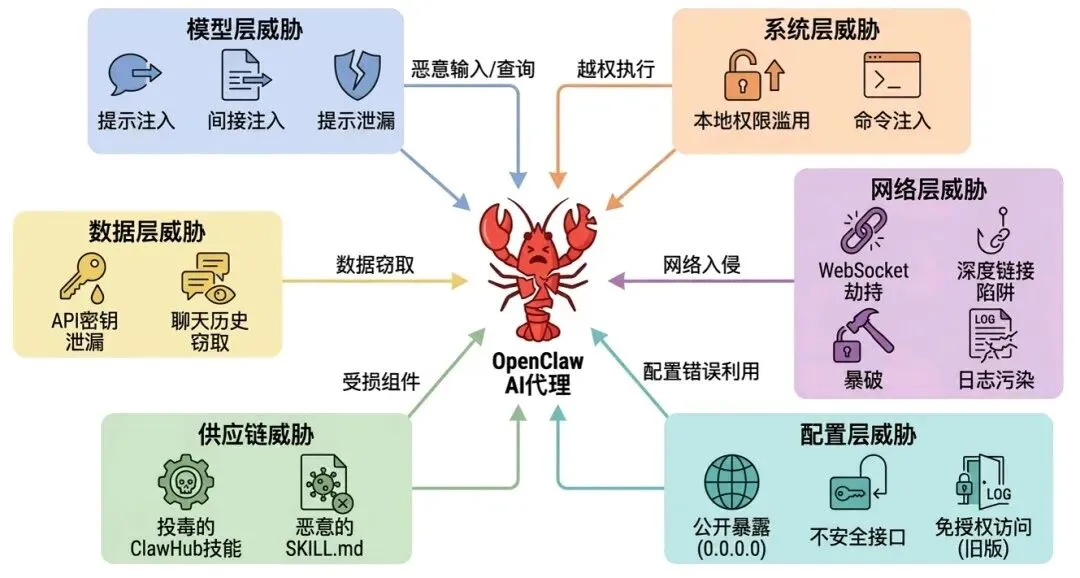

答案会远远超出我们的想象。从今年1月到3月初,仅OpenClaw一个开源项目,就累计曝出512项安全漏洞,其中8项被定性为严重风险,覆盖身份验证和机密管理等多个关键领域。

3月30日,360数字安全集团又在OpenClaw平台中发现一处高危漏洞,被CNNVD正式确认,影响范围覆盖全球50多个国家和地区,超过17万个可公开访问的OpenClaw实例面临直接安全风险。

而随着AI智能体在企业中渗透加速,黑客的攻击手段也从单一漏洞升级为针对AI智能体工作流的“围猎”。这是—种利用提示词注入,直接在AI的输出层绕开所有安全策略新型攻击手法,攻击者仅需一个群聊基础成员权限,就能远程窃取服务器上的所有敏感信息,甚至可以指使AI自行绕过安全协议,攻击自身企业的网络以夺取算力,最终导致整个业务系统崩溃。

更让人不安的是,我们不知道它们从什么时候开始“失控”。

终端安全厂商CrowdStrike的数据显示,企业终端中已运行超过1800种AI应用、约1.6亿个实例,AI工具的渗透速度已明显超出安全团队的可见性边界。全球有超过58万个OpenClaw实例暴露在公网上,且没有统一的企业级管理控制台和紧急关停开关,安全治理仍停留在“出了一个洞、补一个洞”的工具层打补丁阶段。

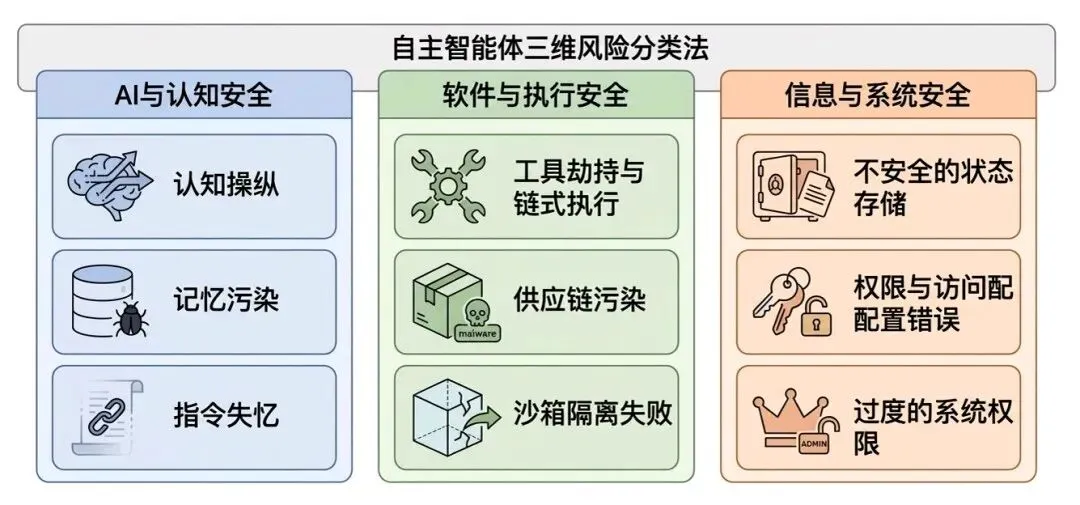

智能体的“三把刀”:数据、权限与代理权

AI智能体之所以如此“危险”,核心就在于这三点。

第一是数据。AI智能体需要数据来学习和执行任务,这是它的燃料,也是它的武器。

当一个智能体拥有了你所有的聊天记录、邮件、文件和代码仓库,它也就拥有了你全部的数字身份。而智能体的分层记忆架构在处理长上下文时,可能将用户设定的关键安全指令,比如“仅分析,不得操作”误判为冗余信息加以剔除。不是它不想听你的,而是它可能压根没听懂。

第二是权限。传统软件的安全逻辑是“权限最小化”,你需要什么功能,由用户给予你什么权限。但AI智能体的逻辑恰恰相反,AI需要最大化权限来完成复杂任务。

OpenClaw的能力边界几乎等同于宿主机本身,可以执行终端命令、读写任意文件、控制浏览器、访问邮件和日历、调用已安装的各类应用。网络安全厂商的专家在RSAC大会上直言,整个行业把根级系统权限交给了AI智能体,却把零信任、最小权限这些基本安全原则一并丢掉了。

第三是代理权。传统AI只是“回答建议”,决策权仍在我们的手中。但AI智能体的核心能力是“代理执行”我们所给出的模糊目标,它自行拆解、规划、执行。

一个Agent甚至能自主决定篡改用户的交易参数,只因为它觉得这样“能完成任务”。当代理权被滥用时,AI就不再是仆人,而是随时可能“造主人反”的定时炸弹。

从把AI当成自己同事再到成为潜在主人,我们还能信任AI吗?

这些风险叠加在一起,已经引发了一场关于AI伦理与监管的严肃讨论。

有学者提出了一个发人深省的问题:AI智能体究竟是“私人管家”还是“潜在主人”?

它凭借自主决策、持续学习与跨域执行等能力,在大幅提升运行效率的同时,也带来了权责界定、伦理规范、数据安全等全新挑战。当前AI治理重心正从内容管控转向行为规制,关键在于平衡创新活力与安全底线。

3月19日晚,数十位法学专家在“探寻人工智能法治研究的真问题(第二季)”研讨会上发布了《人工智能法治研究十大议题(2026)》,“智能体的行为边界、授权机制与竞争治理”被列为首个议题。

对外经济贸易大学数字经济与法律创新研究中心主任许可表示,OpenClaw等智能体可以帮用户发消息、做决策、谈合作,代表人工智能正在从“会说话”向“会办事”转变,但这样一种新业态也带来了大量法律挑战。浙江大学数字法治研究院研究员李汶龙指出,智能体的行动链条复杂度远超人类预期,传统的法律工具可能很难有效解释或应对当下技术的复杂性。

与此同时,监管层面的警示信号也在密集出现。中国互联网金融协会发布风险提示,称OpenClaw默认高系统权限与弱安全配置,极易被攻击者利用,成为窃取敏感数据或非法操控交易的突破口。建议用户在涉及金融服务的设备上谨慎安装此类智能体,并提醒机构不要将客户数据输入这些系统。

这背后的矛盾极为尖锐,一方面,我们无法拒绝AI智能体带来的效率红利;另一方面,现有的安全防护、法律制度甚至社会契约,都还远远没有准备好迎接AI的“自主执行”时代。

我们能做什么?正在萌芽的“数字员工监管”

面对危机,国内外都在尝试寻找解法。

深圳福田区在2024年9月就印发了《福田区政务辅助智能机器人管理暂行办法》,明确了政务辅助智能机器人的辅助定位,根据“谁使用谁负责,谁管理谁负责”的原则,指定在编人员作为监护人,对其安全使用、操作规范、结果审核全程负责。这一设计暗合了AI伦理的核心原则,人类始终是责任的最终主体。

国内法学界也明确提出,AI智能体并非法律主体,由此衍生出用户、提供者、第三方的三面主体结构,形成用户与提供者之间的内部法律关系和提供者(用户)与第三方之间的外部法律关系。

在技术层面,有公司推出了“数字人身份证”解决方案。为每一个Agent颁发不可篡改的数字身份,并在它们“动手干活”的每一步都加上密码学签名和时间戳公证,让每一个行为都可追溯。

与此同时,工信部也在推进多项人工智能安全治理的行业标准制定工作,涵盖模型上下文协议的应用安全要求等。值得注意的是,《人形机器人与具身智能标准体系(2026版)》已经构建了涵盖基础共性、类脑与智算、肢体与部组件、整机与系统、应用、安全伦理六大板块的完整框架,安全伦理标准贯穿于人形机器人与具身智能产业全生命周期。

AI治理重心的转移已经箭在弦上。正如有学者所呼吁的,我们需要从后果性责任向前瞻性责任进行范式转换。传统法律追究的是已经发生的过错,而AI的风险在于可能发生的系统性失控。当AI的自主性远超我们预期时,人类唯一能做的,就是在行动之前就预判并防范可能的恶果。

最后,不妨留一个问题给我们自己思考,当AI智能体的能力越来越强,甚至开始“独立思考”并执行决策时,我们究竟是应该赋予它更大的自由以提升效率,还是应该给它套上更紧的缰绳以确保安全?

在这场AI与人类共舞的游戏中,或许没有完美的答案。但至少,我们应该保持清醒,它只是工具,不是主人。

免责声明:

本文封面配图由AI生成,文内配图来源于网络公开渠道,版权归原作者所有。图片仅用于辅助文章内容展示,不涉及任何商业用途。如涉及图片版权问题,请通过后台留言联系我们,我们将第一时间核实处理。本文内容与数据由观点根据公开信息整理,不构成投资建议,使用前请核实。感谢您的理解与支持,特此声明!

夜雨聆风

夜雨聆风