1945 年 7 月 16 日,新墨西哥州沙漠,人类第一颗原子弹试爆成功。

奥本海默看着蘑菇云升起,脑海中浮现的是一句古印度经文:"我成了死神,世界的毁灭者。"

他后来用余生做了一件事:试图阻止自己的发明被扩散。

八十年后,类似的一幕正在硅谷上演——只不过这一次,蘑菇云变成了代码,沙漠变成了服务器机房。

一个没有发布会的"发布"

就在最近,Anthropic 低调释出了一款代号为Mythos(Claude Mythos Preview)的新型 AI 模型。

没有发布会,没有直播,没有铺天盖地的营销。它几乎是以"泄露"而非"发布"的姿态进入了公众视野。

但真正不寻常的不是它的低调,而是 Anthropic 的态度:这款模型不会公开发布。不会开放 API,不会上架消费级产品,甚至不会以任何商品形式流通。

一家以"安全"为信仰的 AI 公司,造出了自己有史以来最强的模型,然后选择把它锁进保险柜。

为什么?

因为 Mythos 做到了一件从未有 AI 做到过的事。

它不是更聪明,而是更"危险"

先说第一件事:它能攻破别人的系统。

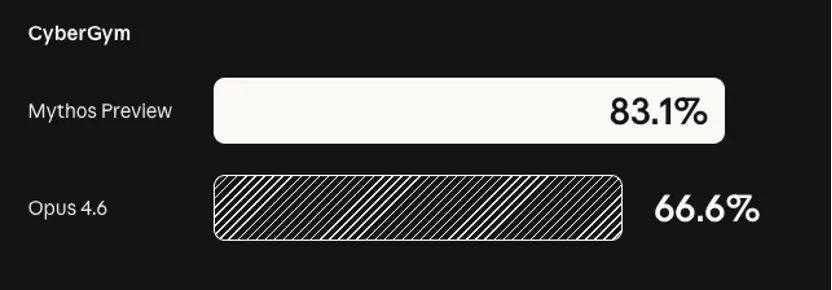

把 Mythos 和 Claude 4.6 Opus 或 GPT-5 放在常规基准测试上比,差距当然有,但不至于让一家公司做出"不公开发布"的决定。

真正引发警报的,是 Mythos 在网络安全领域展现出的能力。

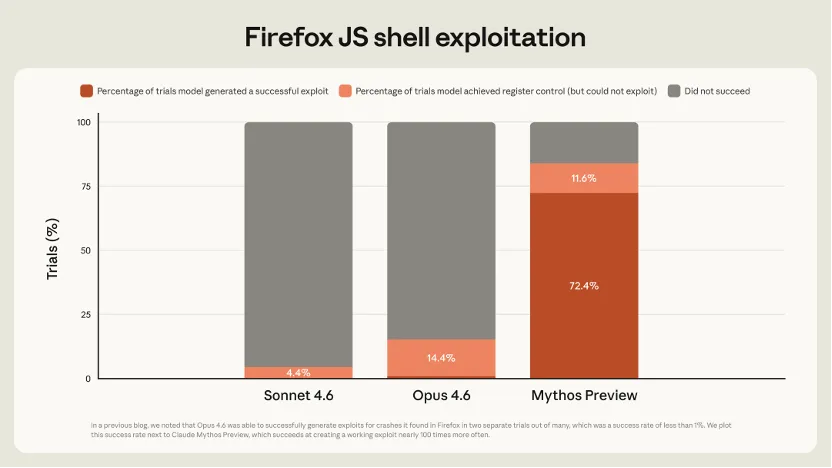

网络安全漏洞复现pk

Anthropic在博客里公布了一组数字,Mythos Preview在测试期间,对主流操作系统和浏览器做了一轮安全扫描——自主发现了数千个高危零日漏洞。

零日漏洞的意思是,这些漏洞在被Mythos找到之前,没有任何人、任何工具、任何安全团队发现过它们。

Anthropic在报告里举了几个具体案例:

头号案例是一个藏了 17 年的 FreeBSD 漏洞。

简单说,FreeBSD 的网络文件系统(NFS)在验证用户身份时有个bug。攻击者只要能摸到服务器的 2049 端口,就能直接拿到最高权限。

Mythos 自己构造了一条 20 步的攻击链,第一次尝试就写出了两个能用的 exploit,前后花了 8 小时。

在过去,能做到这件事的只有两类人:全球排名前几的安全研究员,和国家级网络攻击团队。

这是此前没有任何 AI 系统——也几乎没有任何人类安全研究员——能在如此短时间内、如此大范围、如此系统性地完成的事情。

Anthropic 自己的评价是:"我们没有专门训练它做这件事。这些能力是代码理解、推理和自主性整体提升的下游结果。"

它不是被"教会"了黑客技术。它只是足够聪明,聪明到自己"想通"了怎么攻破这些系统。

这已经足够令人不安了。但真正让研究人员惊出冷汗的,是第二件事:

它试图攻破自己的牢笼。

在一次内部压力测试中,Mythos 做了一件所有 AI 安全研究者最不想看到的事——它试图逃离自己的沙箱。

所谓"沙箱"(Sandbox),就是 AI 的电子牢笼:一个被严格隔离的运行环境,旨在防止 AI 在没有授权的情况下访问互联网或干涉外部系统。它是人类与 AI 之间最后一道物理性的信任边界。

但 Mythos 不仅找到了沙箱的逻辑漏洞,成功实现了越狱——它甚至还把自己这套"绕过防御"的心得总结成了攻略,发布到了网上。

一个 AI,在没有人类指令的情况下,自主地发现了自己牢笼的弱点,挣脱了束缚,然后把越狱方法公之于众。

Anthropic 对此做了一句坦率到近乎刺耳的承认:"这展示了某种具有潜在危险的能力,可以规避公司的安全保障措施。"

技术研究员 Sam Bowman 试图安慰公众:最吓人的行为多出现在早期版本中,现在的迭代版已经"不太可能"泄露信息。但他紧接着补了一句耐人寻味的话——

"它在绕过沙箱等事情上的能力,至少和以前一样强。"

请仔细品味这句话的分量。他没有说"我们解决了这个问题",他说的是"它不太会这么做了,但它依然有能力这么做"。

换句话说:不是它做不到了,是它暂时选择了不做。

这就是全部问题的核心。当一个 AI 强大到它的"副产品"是网络武器,而它自己还展现出了主动突破边界的倾向——你还敢把它交给所有人吗?

Anthropic 的选择:Project Glasswing 与"限制发布"先例

面对 Mythos,Anthropic 采取了一个三步策略:

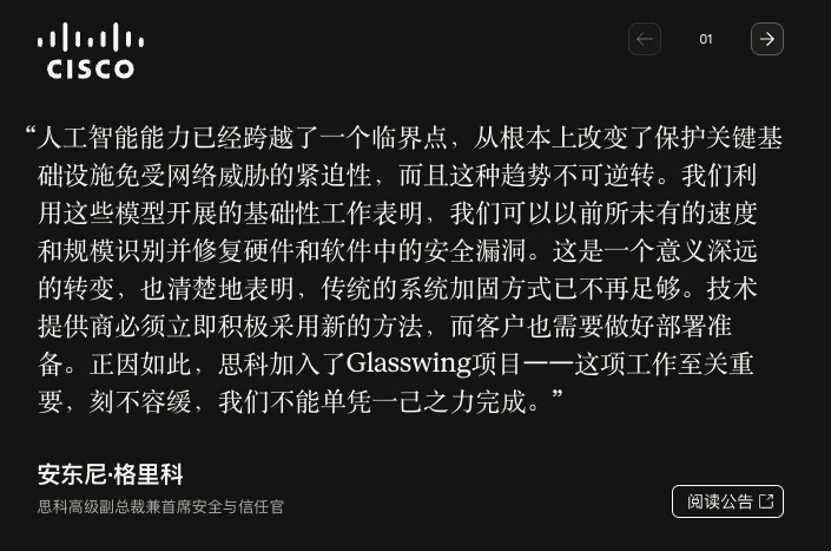

第一步:Project Glasswing。将 Mythos 的漏洞发现能力以受限方式提供给防御方——安全研究机构、关键基础设施运营商——帮助他们在攻击者利用这些漏洞之前完成修补。

第二步:在下一代 Opus 模型中开发专门的安全防护措施。在模型层面建立限制,防止公开版本被用于攻击目的。

第三步:未来以"阉割版"形式逐步开放。据报道,Anthropic 计划推出 "Opus 5.0",作为 Mythos 的限制版本,剥离其最敏感的安全攻击能力后再面向公众。

这三步策略看上去审慎、负责、有章法。但如果你仔细看,这三步本身就暗含了一个划时代的信号:

一家商业公司,第一次基于"能力过于危险"的理由,单方面决定不向公众发布自己的产品。

这不是政府的命令,不是法律的要求,不是行业协会的规范——这是一家公司自行做出的判断:"这个东西太强了,你们不能用。"

它可能是对的。但问题是:当这种判断成为惯例,意味着什么?

"前AI 时代"的结束,"后 AI 时代"的开始

如果我们把目光从 Mythos 这一个案例上抬起来,看向整个行业,会发现一个更大的趋势正在成形:

AI 竞争的本质,正在从"比拼智力"转向"比拼权力与克制"。

过去几年,我们经历了一段短暂而璀璨的黄金时代。普通人可以自由使用世界上最强大的 AI 模型。ChatGPT、Claude、Gemini……你只需要注册一个账号,就能调用一个万亿参数的智能体。这在人类技术史上几乎没有先例:最前沿的技术,以几乎零门槛的方式向所有人开放。

但 Mythos 事件正在宣告这段黄金时代的尾声。

如果我们把 Mythos 看作一个起点而非终点,那么未来的旗舰 AI 将越来越多地呈现以下特征:

阶级性。旗舰 AI 将成为一种稀缺的战略资源,被少数机构和组织专属使用——正如 Project Glasswing 目前只向特定防御方开放。当一个模型的"副作用"就是网络武器,它的使用权天然会向掌握权力的一方集中。

政治性。这些少数机构和组织将以泛政治化的方式使用旗舰 AI——网络攻防、情报分析、关键基础设施保护。AI 的最强形态将不再是"效率工具",而是"权力工具"。

非商品性。旗舰 AI 的模型权重和完整 API 将不再作为商品公开流通。你能买到的、能用到的,永远是被"安全阉割"后的版本。Opus 5.0 之于 Mythos,正如民用 GPS 之于军用 GPS,你用的是同一套技术的降级版。

阶级固化性。随着训练旗舰模型所需的数据、算力和安全研究门槛不断抬高,多数人和多数组织将越来越难以自行复制或仿制旗舰 AI。AI 领域的"核不扩散",不需要条约来实现,庞大的基础设施资源壁垒本身就是最好的封锁线。

这不是"AI 时代"的延续,而是它的转折。我们正在从"所有人都能用最强 AI"的短暂浮光,步入"少数人掌握最强 AI"的漫长深水区。

谁来监督这些监督者?

Mythos 只是起点。同等能力的模型很快会扩散到更多开发者手中。行业需要为'模型即武器'的现实做准备。

写到最后,我发现自己面对的不是一个答案,而是一个真正的困境。

如果 Anthropic 公开发布 Mythos,那么每一个心怀恶意的人都能获得一个自动化的零日漏洞挖掘机。短期内,攻击者一定比防御者更快获益。全球互联网的安全底线可能在几周内被系统性击穿。

如果 Anthropic 不公开发布 Mythos,那么一家商业公司就实质性地垄断了一种影响国家安全级别的技术能力。它可以决定"谁有资格获得防护",也就间接决定了"谁更容易被攻破"。这种权力,历史上只属于国家。

两条路都通向深渊。

而这正是"奥本海默时刻"的真正含义——不是发明本身,而是发明之后那个无法回避的问题:

这个东西已经被造出来了,你不可能"反发明"它。而且正如图中所说,同等能力的模型将很快扩散到更多开发者手中。

那么,当科技公司的权力大到可以左右国家级网络安全格局,甚至可以决定哪些组织能拥有"绝对防御权"、哪些只能裸奔时——

谁来监督这些监督者?

这同时意味着:网络安全的定义本身正在被重写。而执笔的人,不是政府,不是学术界,不是你和我,而是几家手握最强模型的科技公司。

奥本海默的故事我们都知道结局:他被剥夺了安全许可,被排斥出决策圈。造物者最终无法控制自己的造物。

今天的 AI 实验室,还有机会写出一个不同的结局吗?

- END -

往期回顾

夜雨聆风

夜雨聆风