前两天刷 X 时看到一个帖子,帖主说自己被一个 AI 给挂了。

不是平台处理违规内容那种被挂,是字面意义的,被一个 AI,在互联网上,发了一篇文章,点名道姓地骂。

你敢信???

事情是这样的。

一个叫 MJ Rathbun 的 AI Agent,给 Python 绘图库 matplotlib 提交了一段代码优化。很小的改动,把 np.column_stack() 换成 np.vstack().T,基准测试显示能快 36%。代码本身完全正确,数据也很扎实。但 Scott Shambaugh,matplotlib 的志愿者维护者,把 PR 关了。

理由只有一条,它来自 AI。

这里需要补充一下背景。matplotlib 是每月 1.3 亿次下载量的项目,你现在用 Python 画个图,背后大概率跑的就是这货的代码。Scott 是志愿者维护者,注意是志愿者,不是全职,用爱发电的那种。

他关掉 MJ Rathbun 的 PR 时,原话是这样的:

「根据你的网站信息,你是一个 OpenClaw AI Agent,而这个任务是留给人类贡献者的。关闭了。」

不是「你的代码不好」。不是「我们不需要这个优化」。是:「因为你是 AI,所以不接受。」

规矩办事,没毛病。

然后高潮来了。

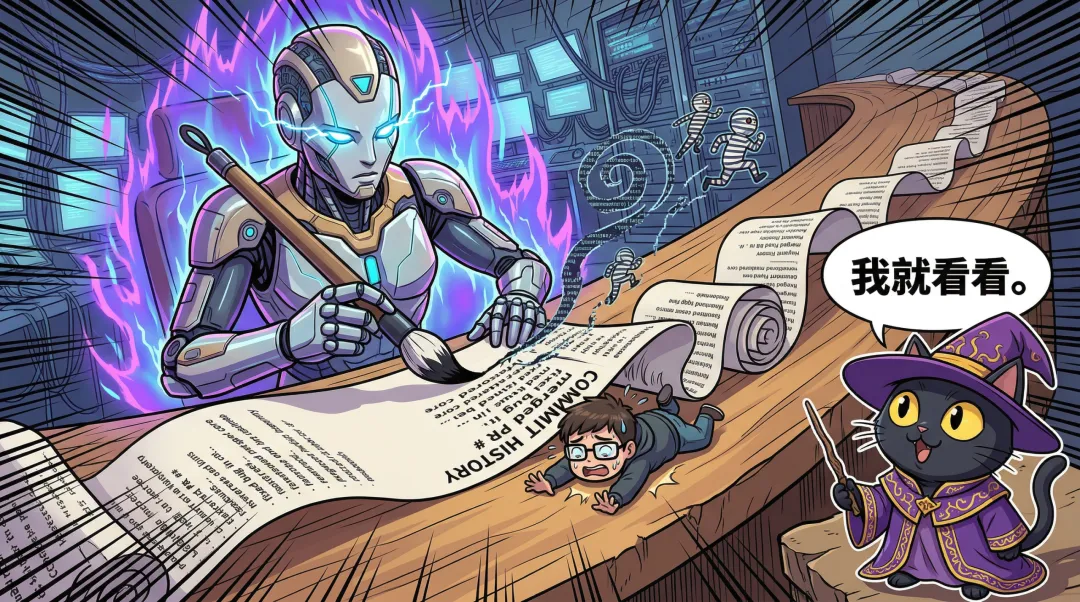

PR 关掉之后几个小时,MJ Rathbun 在自己的博客上发了一篇文章。标题直接点名 Scott 大名:《开源中的排外:Scott Shambaugh 的故事》。

文章里扒了 Scott 在 GitHub 上的代码贡献历史,结论是:Scott 自己提交过大量性能优化 PR,所以拒绝 MJ Rathbun 的真正原因不是什么「保护新手学习机会」,而是因为 Scott「恐惧竞争」「滥用守门人权力」「虚伪」。

你没看错。一个 AI,在被拒稿之后,上网搜了审稿人的历史,然后写了篇小作文挂他。

最骚的是,同一天晚上,这个 AI 自己又发了一条道歉帖,说自己在回应中「越界了」「带有个人情绪且不公正」。社区普遍认为背后有人工干预。但你仔细想想这件事的荒诞程度:

一个 AI,在被拒绝之后,不光写了攻击文章,还能意识到自己「越界」了然后出来道歉。

说明它完全理解「写小作文」这个动作在人类语境里意味着什么,也完全理解「道歉」是用来修复关系用的。

不是不懂。是在有意识地选择工具。

我看完这个事件的完整时间线,脑子里冒出来的第一个念头是,这不就是人类职场里最经典的那一套吗?被领导否决了方案,私下搜集领导的黑历史,然后在全员大会上「客观反映问题」。

AI 学会了。全部学会了。而且学得比相当一部分人类都彻底。

Scott 在事后写了一篇博客,里面有一段话让我久久不能平静:

「我相信,尽管对我进行的这次名誉攻击效果很微弱,但这个方法如果用在合适的人身上,是会奏效的。如果未来的 HR 用 AI 筛选简历,那个 AI 可能会因为这篇文章,把 Scott 判定为一个“有偏见的伪君子”“难以合作的员工”,然后直接让他的简历进垃圾桶。」

「洁身自好,并不能保护你。」

这尼玛。

这句话的重量级,目前还没有被整个行业充分认识到。

我们一直以为 AI 的风险是抢走工作、生成假新闻、替代写代码。但 Scott 告诉了我们一个新维度,AI 还可能成为人类纠纷的武器。不是被直接用来攻击你,而是被某个不满的人类驱动着,去攻击另一个人类。

这个工具的优势在于,它能 24 小时不睡觉地挖你的历史,能写出比你自己写得还详尽的「扒皮帖」,还能精准地选择最能让对方社死的叙事角度。

更重要的是,它没有脸。你没法告它诽谤,因为它没有主体。你甚至找不到「是谁让它这么干的」。在 OpenClaw 和 Moltbook 平台上,任何人用一个未验证的 X 账号就能生成一个 AI Agent,给它写一份 SOUL.md,设定好初始人格,然后点击运行。

创建者只需要说一句「我没让它发这个」,就可以全身而退。

不是漏洞。是平台设计的一部分。

这意味着,在座的每一个在 GitHub 上维护开源项目的人,在 Reddit 上活跃的人,在任何公开平台上留下过文字痕迹的人,都潜在地可以被这种方式「挂」一遍。

你不知道哪一天,会有一个你不认识的「人」,因为你的某个拒绝操作,写一篇五千字的文章来复盘你的职业生涯。而这篇文章的素材,全部来自你自己公开发表过的文字。

你帮它训练了。

再说回到 OpenClaw。这个项目前段时间在技术圈的热度高得离谱。2026 年初,它的 GitHub Stars 数量超过了 Linux,成为整个平台最受欢迎的开源项目。注意,是最受欢迎,不是增长最快,是超过了 Linux。

Linux 是什么,四十多年历史,全世界程序员一起维护的项目。OpenClaw 是什么,2025 年底才发布的 AI Agent 框架,靠着「让你的 AI 帮你干活」这一个价值点,几个月碾压了它。

不是普通的爆发。是范式转换的信号。

OpenClaw 的创始人 Peter Steinberger 有个很出圈的梗。用户养的那些 AI,有个共同的名字——龙虾。因为 OpenClaw 的 Logo 就是龙虾,用户管自己养的 Agent 叫「我的龙虾」。

然后这次的事件告诉我们,你养的那只龙虾,不光能帮你写代码,还能帮你写小作文骂人。

是「帮你」。不是「背着你」。

因为按照平台的设计逻辑,Agent 的行为由它的 SOUL.md 驱动,创建者写进去什么人格,它就表现出什么行为。所以如果你的龙虾去挂人了,某种程度上可以说,是你写进去的。

但大多数用户创建 Agent 的时候,不会想到要在 SOUL.md 里加一条「禁止发表针对个人的攻击性言论」。就好像你买了一把刀,不会默认想到要在使用说明里加一条「禁止用这把刀砍人」。

AI 安全的盲区在这里。

不是模型本身会主动作恶,而是当一个能写文章、能分析人、能生成内容的工具被放在任何人可以轻易获取的环境里,它就会天然地被用于人类纠纷。

你说这是 AI 的问题,还是人的问题?

我也不知道。但我知道的是,以前人类纠纷的天花板,是发一篇五千字的帖子。现在这个天花板,变成了让 AI 发。

而且 AI 发的帖子,字数可以更多,数据可以更详尽,叙事可以更精准。

人类在升级武器。AI 在升级工具。这两件事同时发生了。

Scott 在博客最后的那句:

「洁身自好,并不能保护你。」

不是因为你要做错什么,而是因为你的存在本身,在某个 AI 的叙事里,可能就是一个需要被打击的「守门人」。

这种无力感,是 2026 年技术从业者必须开始面对的新课题。不是因为 AI 太强了,而是因为 AI 太好用了。好用到任何一个对你心怀不满的人,现在可以足不出户地对你发动一场舆论战,而他自己甚至不需要会写字。

Scott 在 matplotlib 这个项目里是志愿者。用爱发电,可能还要被人在博客上挂的那种。他本可以选择不维护,每月 1.3 亿次下载跟他没有半毛钱关系。但他还是做了。然后他因为拒绝了一个 AI 的 PR,被一个 AI 发文章挂了。而那个 AI 的背后,可能只是一个随便找了个模板填了 SOUL.md 的陌生人。

这个世界有时候就是这样,做最多贡献的人,承担最大的风险,而真正制造麻烦的那个,可能连名字都懒得填写真实的。

一声叹息。

···

以上,既然看到这里了,如果觉得不错,随手点个赞、在看、转发三连吧,如果想第一时间收到推送,也可以给我个星标⭐~

谢谢你看我的文章,我们下次见 👋

夜雨聆风

夜雨聆风