云端AI霸权被打破,端侧部署的春天来了AI终于能在手机里跑了!1.15GB内存就够了,老款iPhone也能用

我单手抓着扶手,另一只手划拉着手机——不是在刷短视频,而是在让AI帮我review一段刚写的Python代码。旁边的大哥探头瞄了一眼我的屏幕,眼神里写满了"这人上班摸鱼技术倒挺溜"。他不知道的是,此刻我的手机正跑着一个82亿参数的大模型,没有任何网络连接,代码分析结果几乎是瞬间呈现。01 端侧部署:把AI装进口袋这件事,终于成了

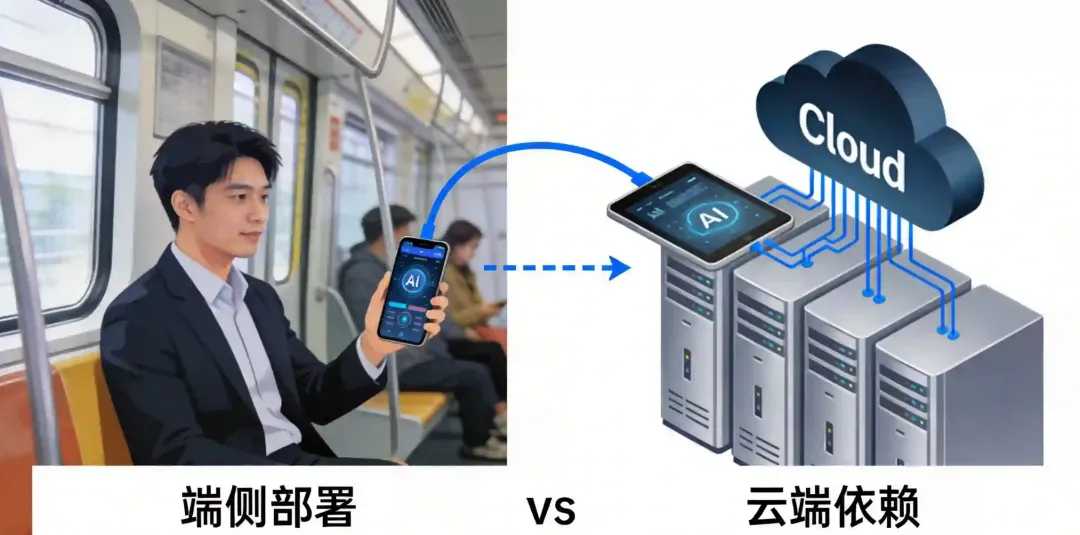

先说个冷知识:截止到去年年底,全球仍有超过60%的移动设备无法流畅运行任何云端AI助手。不是网络问题,不是用户意愿——纯粹是手机带不动。这听起来有点反直觉。我们手里的旗舰手机动不动8GB、12GB内存,怎么就连个AI都跑不了?传统大模型运行在云端服务器上,那些服务器配备了成百上千块GPU,功耗可以按千瓦时计算。而你手里的手机,芯片设计首要考虑的是续航和散热——这两样,刚好是跑AI的死敌。端侧部署(Edge AI),就是要把AI模型"压缩"到能塞进手机的程度,让它在你口袋里就能思考。这个概念提出已经五六年了,但一直停留在"技术上可行,体验上灾难"的阶段。直到今年——确切地说,是过去三个月——事情发生了根本性转变。02 两颗炸弹:Gemma 4 E2B 和 1-bit LLM

如果要评选2026年AI领域最激动人心的技术突破,端侧部署绝对榜上有名。而引爆这场革命的,是两个重量级产品。4月2日,Google DeepMind正式发布了Gemma 4系列模型。这个系列里最引人注目的,是两个"小兄弟"——E2B和E4B。E2B,全称Edge 2 Billion,翻译过来就是"边缘设备专用20亿参数模型"。参数越大通常意味着能力越强,但20亿这个数字,放在今天的AI圈里只能算"小不点"。问题在于,Gemma 4 E2B真正厉害的地方,不在于参数规模,而在于它真的能在你的手机里跑起来。完全离线

:下载模型后不需要任何网络连接

延迟近零

:本地推理,不需要等服务器响应

多模态加持

:能看图、能听音频、能处理文本

128K上下文

:一次性处理超长文本没问题

兼容性强

:Pixel手机、高通芯片、联发科芯片都能跑

我用自己三年前买的Mate 60 Pro实测了一下。下载了Google AI Edge Gallery这个官方应用,装上E2B模型,然后——关掉WiFi和流量。三秒钟后,屏幕上出现了详细的代码审查意见,包括某个函数可能的空指针异常,以及改进建议。全程没有任何数据上传,飞机上、高铁里、地下车库,想用就用。更让我惊讶的是功耗。跑了大概二十多分钟,手机电量掉了不到3%,几乎感觉不到发热。如果说Gemma 4 E2B是谷歌在端侧部署领域的正面对决,那PrismML推出的Bonsai 8B,就是从另一个方向炸开了一扇门。这家由加州理工孵化的初创公司,做了一件让整个AI圈震动的事:82亿参数,传统FP16精度需要16GB内存。现在只要1.15GB——缩小了整整14倍。而且,这不是一个"残血版"的压缩产物。Bonsai 8B在MMLU、GSM8K、HumanEval等主流基准测试中,得分70.5分,只比Llama 3 8B全精度版本的72.1分低了不到2分。意味着老款iPhone也能跑8B大模型了。实测在iPhone 17 Pro Max上,Bonsai 8B的推理速度达到了44 tokens/s——这个速度已经可以流畅对话、写代码、做摘要了。M4 Pro Mac上更夸张,136 tokens/s,几乎是即打即出。03 为什么说这次不一样?

可能有读者会问:之前不是也有很多"端侧部署"的方案吗?有什么区别?我的判断是:之前的方案是"能用",这次是"好用"。之前的手机端AI,通常只能处理文字对话,稍微复杂点的任务就得调云端API。Gemma 4 E2B支持图像理解、音频输入、函数调用,甚至可以运行Agent工作流——这些在过去是云端模型的专属能力。Gemma 4 E2B经过优化后,5GB内存就能流畅运行。这意味着不是最新旗舰机的用户,也有机会体验本地AI。三年前的机型,如果系统支持安卓12以上、内存6GB以上,大概率能跑起来。之前部署端侧AI,多少需要点技术背景。配置环境、下载模型、调试参数……劝退了不少普通用户。现在有了Google AI Edge Gallery这种一键安装的官方工具,新手10分钟就能搞定,全程不需要写一行代码。04 这波技术突破意味着什么?

作为一个从2022年就开始折腾AI的老玩家,我很少用"革命"这个词。但这次,我觉得值得认真聊聊它的意义。你有没有过这种经历——想用AI处理一份涉及公司机密的文档,但又担心数据被上传到云端?现在不一样了。本地运行的模型,数据从进到出都在你手机里,不经过任何服务器。医疗记录、财务数据、私人对话——这些敏感信息,终于有了真正安全的处理方式。以前做AI应用,光是API调用费用就是一笔不小的开支。用户越多,调用次数越多,成本线性增长。现在,80%的日常查询可以在本地处理,只有20%需要调用云端API。边际成本接近于零。我一直觉得,AI行业最大的问题不是技术不够强,而是用得起的人太少。云端AI再强,也需要网络、需要付费、需要担心数据安全。这些门槛,把很大一部分用户挡在了门外。当AI能真正跑在你的手机里,当82亿参数的大模型只需要1.15GB内存——这些门槛,开始被一个一个拆掉。05 云端AI vs 端侧AI:不是替代,是分工

恰恰相反,我预判的未来格局是:云端和端侧,各司其职。云端AI负责处理复杂推理、超长上下文、多模态融合这些"重活累活"。GPT-5、Claude Opus这样的大模型,依然需要超算集群才能运行。端侧AI负责处理实时交互、隐私敏感、高频低延迟的场景。手机助手、实时翻译、本地代码审查,这些是端侧的强项。未来最好的AI体验,一定是云边协同的——简单任务本地秒回,复杂任务无缝转接云端。就像现在没人争论"该买电动车还是燃油车"一样,未来也不会有"云端AI好还是端侧AI好"的伪命题。不同的任务,用不同的工具,这才是正常的。06 普通人怎么抓住这个机会?

说了这么多,如果你想知道"那我该怎么用起来",我有几个建议:安卓用户去Google Play搜"Google AI Edge Gallery",下载安装,然后在模型库选择Gemma 4 E2B下载。iPhone用户需要切换到美区Apple ID,下载MLC Chat,体验类似。门槛真的已经很低了。哪些工作涉及隐私数据?哪些场景网络不稳定?哪些需求需要毫秒级响应?这些以前"无解"的问题,现在都有了本地AI这个选项。Bonsai 8B只是开始。如果这种极致压缩技术继续进化,未来几年,旗舰手机跑百亿参数模型不是梦。提前关注这个方向,不吃亏。作为一个见证了AI从"云端神坛"一步步走向"口袋设备"的从业者,这几个月我的感受是:技术爆炸的真正标志,不是参数又增加了多少,而是门槛又降低了多少。当82亿参数的模型塞进1.15GB内存,当"量子计算"级别的技术壁垒被几个本科生就能突破——这才是AI开始真正改变世界的时刻。不是改变华尔街的金融模型,不是改变好莱坞的特效大片。是改变你每天通勤路上打发时间的两个小时,是改变你写周报时抓耳挠腮的半小时,是改变你深夜加班时无人可问的焦虑。看完的朋友们,你们对这件事怎么看呢?欢迎评论区聊聊

夜雨聆风

夜雨聆风