一、Active Memory:最大的亮点

v2026.4.12 引入了一个可选的 Active Memory 插件,核心逻辑很清晰:在 AI 生成回复之前,先跑一个专属的记忆子 Agent,从 QMD 记忆库中检索相关偏好、上下文和历史细节。

这意味着什么?

AI 不再等你提醒,它自己会去找。

具体功能:

• 三种上下文模式:message(当前对话)、recent(近期记忆)、full(全量记忆)。你可以根据场景选模式,不是一刀切。 • /verbose 实时查看:打命令就能看到 Active Memory 这次检索了哪些记忆,透明可控,不存在"黑箱焦虑"。 • QMD 检索优化:默认记忆检索的搜索路径加了遥测,排查"为什么它没记住"比之前容易十倍。

这个功能是可选插件,不是强制开启。担心性能或隐私的,可以继续用老方式;想体验"主动记忆"的,一键开启即可。

我的判断:这是 OpenClaw 历史上最接近"长期记忆"的一次尝试。不是什么花哨的 RAG 包装,是真的在解决"上下文断裂"的根本问题。如果你是重度用户,这个功能值得第一时间开。

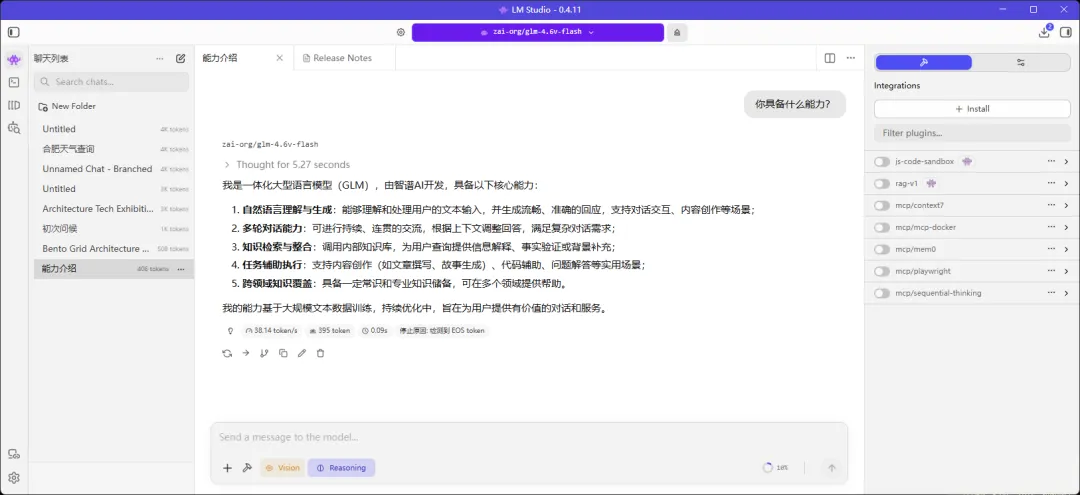

二、LM Studio:本地模型,这次真的能用了

第二件大事:OpenClaw 新增了 LM Studio 提供商,支持连接本地或自托管的 OpenAI 兼容模型。

这不是"我们加了个接口"那种敷衍。三个特性值得关注:

1. 运行时模型自动发现 — LM Studio 跑起来的模型,OpenClaw 自动识别,不用手动填模型名。 2. 流式预加载 — 模型切换时不再卡顿,体验接近云端。 3. 内存搜索 embedding — 本地也能做语义检索,不用完全依赖云端 API。

适合谁?

• 隐私敏感用户:医疗、法律、金融领域的从业者,数据不想出本地。 • API 费用敏感用户:调用量大的场景,本地模型边际成本趋近于零。 • 技术玩家:自己有显卡,想跑 Qwen、DeepSeek 这类开源模型的。

说实话,本地模型这两年一直在"能跑"和"好用"之间挣扎。OpenClaw 这次接进来,至少把"好用"那侧的体验拉了一大截。

三、Codex 正式捆绑:代码智能更纯粹

之前 Codex 是作为第三方插件存在的,这次正式内置为一级提供商。

变化在哪?

• Codex 现在管理自己的认证、原生线程、模型发现和压缩逻辑。 • openai/gpt-*系列继续走 OpenAI 提供商,不再和 Codex 混在一起。• 职责边界清晰,配置更简单,出问题好排查。

对于重度写代码的用户,这是个好消息。供应商分离意味着更少的隐藏耦合,出 bug 也更容易定位。

四、macOS 用户的 Talk Mode 来了(实验性)

macOS 用户专属:v2026.4.12 开始支持基于 Apple MLX 框架的本地语音识别。

功能亮点:

• 本地音频播放,不走云端,延迟低 • 支持打断处理,说完可以直接插话 • 系统语音 fallback,麦克风出问题也不至于完全哑火

注意这是实验性功能,苹果的 MLX 生态还在成熟中,对稳定性要求高的用户建议等后续版本。但如果你用的是 Mac 而且想体验语音交互,这个版本可以尝鲜了。

五、飞书集成:配置不再劝退

飞书集成这个版本做了配置流程优化。我自己用飞书,最烦的就是"配置文档看了一大圈,还是不知道哪里填错了"。

这次优化后,设置路径更清晰,常见坑基本都有引导。对飞书用户来说,体验提升是实打实的。

六、插件按需加载:启动终于快了

之前 OpenClaw 启动时,所有插件,不管你用不用,全部加载一遍。插件多的用户,开个工具箱要等好几秒。

这次改为按需加载,插件只在实际调用时才初始化。效果:启动更快,内存占用更省。

属于那种"不惊艳但用了就回不去"的优化。

七、安全修复:三个,值得单独说

版本再好用,安全问题不能将就。v2026.4.12 修了三处:

这三个修复说明开发团队在认真盯着安全研究社区的动态,不是等出事了再救火。

升级建议

推荐升级人群:

• 重度 OpenClaw 用户,尤其是多会话、长周期任务 • 有本地模型需求(隐私 or 成本) • macOS 用户想尝鲜语音 • 飞书集成用户

可以观察一段时间再升:

• 新功能尝鲜派,建议等小版本补丁 • 插件生态复杂的老用户,确认所有插件兼容后再动

总结

v2026.4.12 是一个"修内功"的版本,没有炸裂的新功能,但把几个核心体验——记忆、模型、性能——都往前推了一步。

尤其是 Active Memory,我认为是 OpenClaw 真正从"对话工具"走向"个人助理"的分水岭。记忆不该靠用户手动维护,AI 应该主动去找、去记、去用。这个理念落地的怎么样,值得所有用户亲自体验。

有问题欢迎在评论区交流,也欢迎点个在看,转发给同样被 AI 记忆问题困扰的朋友。

夜雨聆风

夜雨聆风